目录

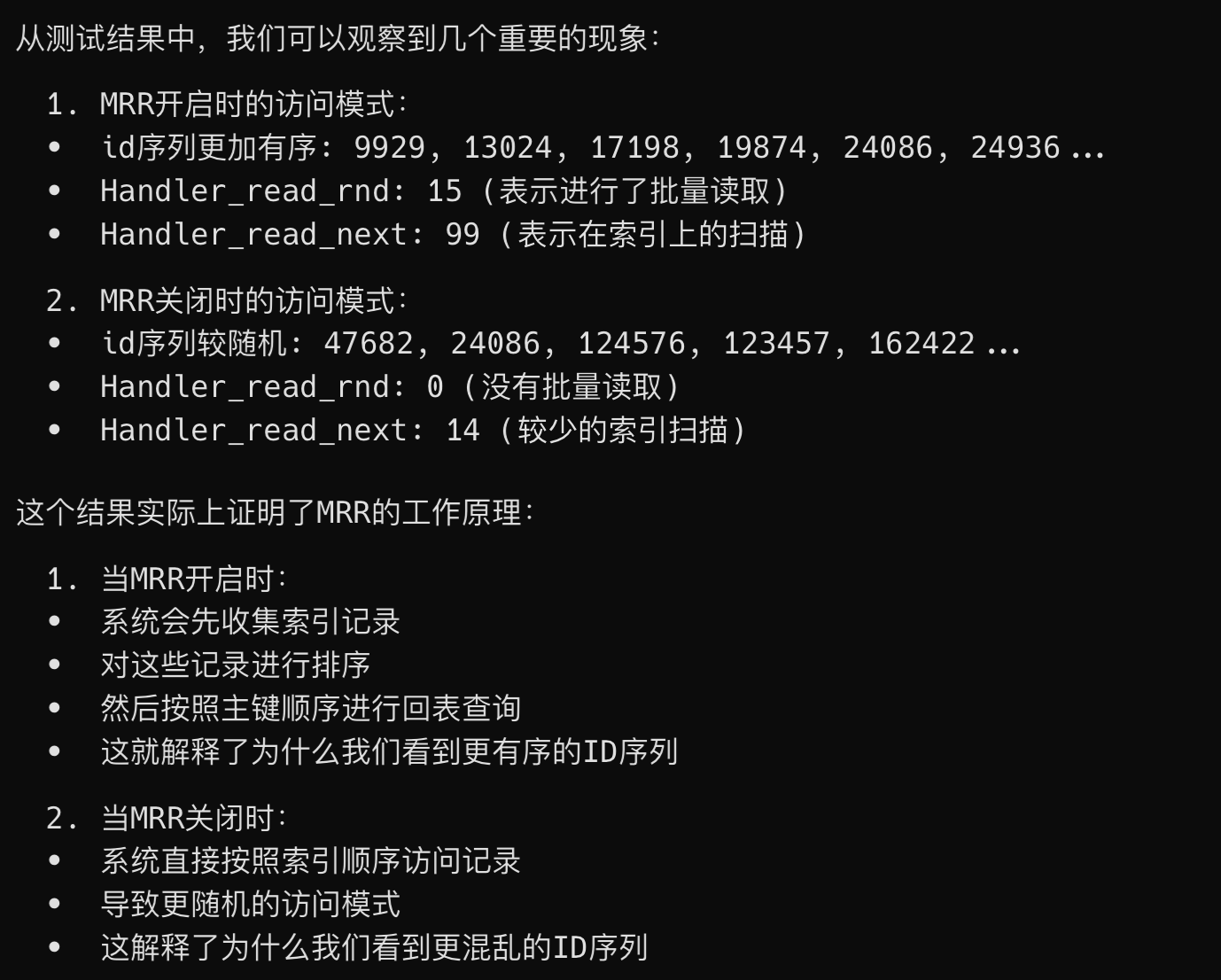

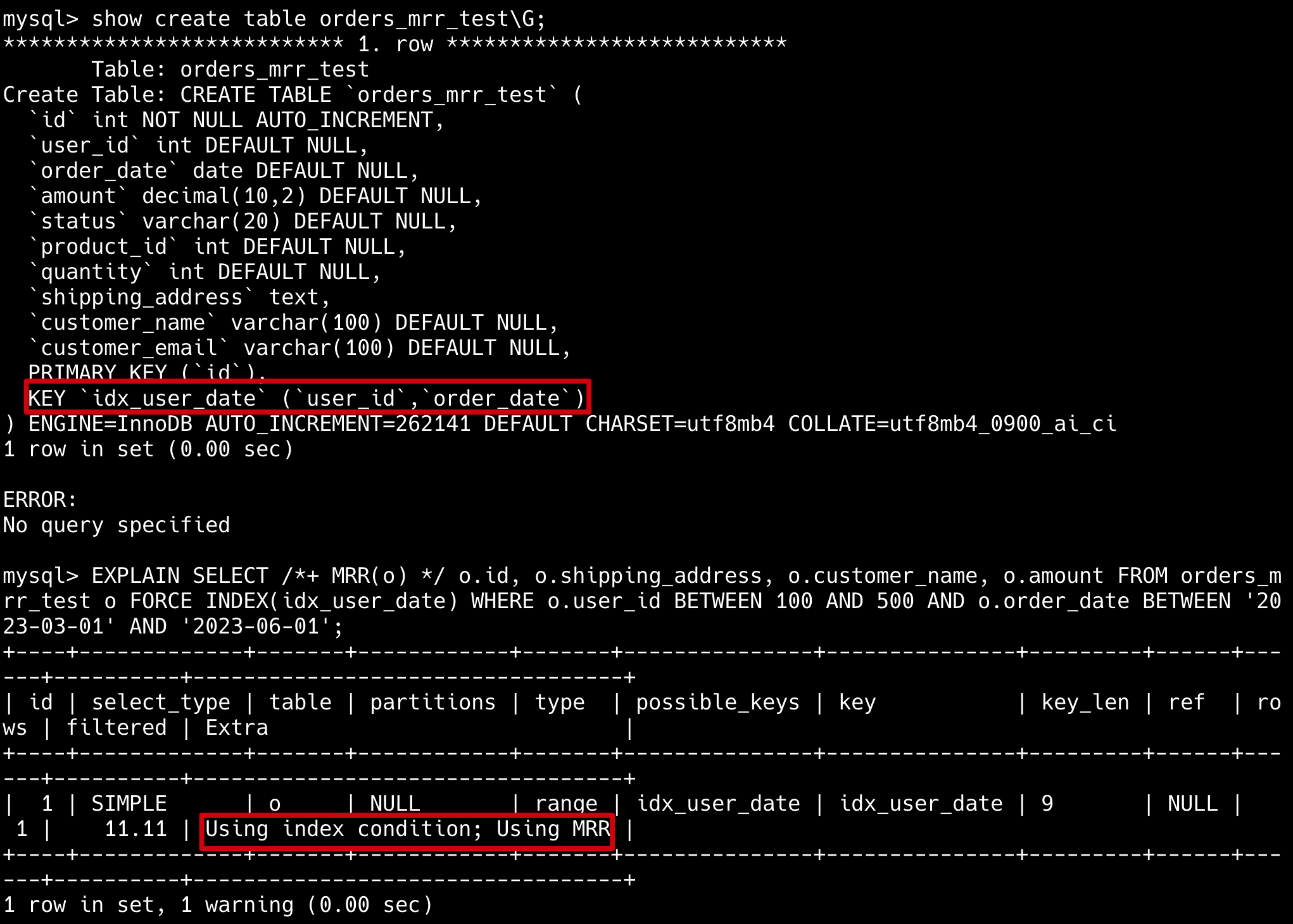

- JavaSE

- Java集合框架

- Java并发编程

- 2.🌟说说进程和线程的区别?

- 3.🌟说说线程有几种创建方式?

- 4.🌟调用 start 方法时会执行 run 方法,那怎么不直接调用 run方法?

- 6.🌟线程有几种状态?

- 10.🌟请说说 sleep 和 wait 的区别?(补充)

- 11.🌟怎么保证线程安全?(补充)

- 12.🌟ThreadLocal 是什么?

- 14.🌟ThreadLocal 怎么实现的呢?

- 15.🌟ThreadLocal 内存泄露是怎么回事?

- 20.🌟说一下你对 Java 内存模型的理解?

- 25.🌟volatile 了解吗?

- 29.🌟synchronized 锁升级了解吗?

- 30.🌟synchronized 和 ReentrantLock 的区别了解吗?

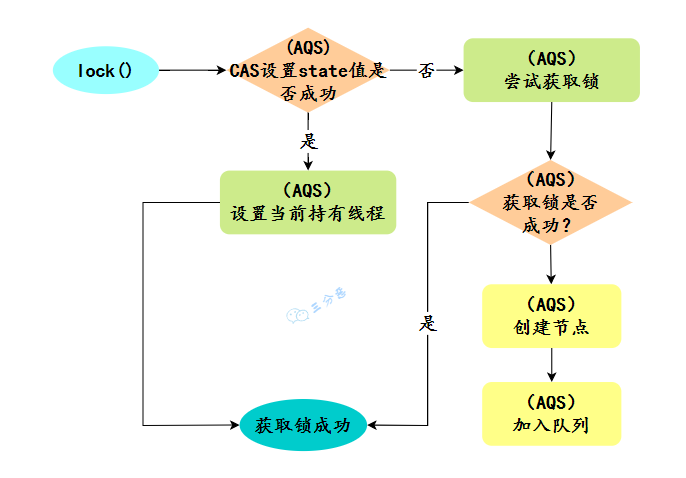

- 32.🌟说说 ReentrantLock 的实现原理?

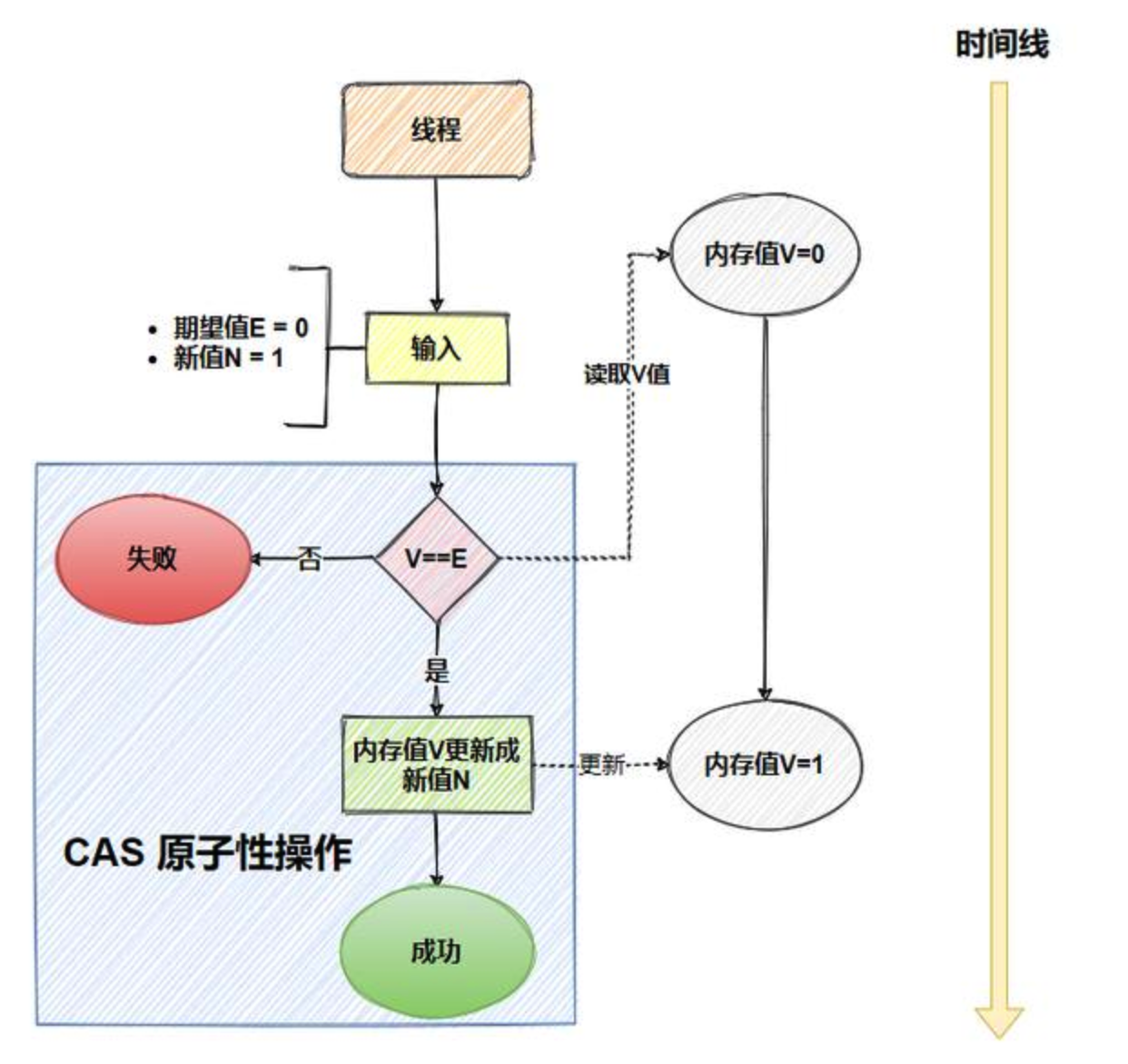

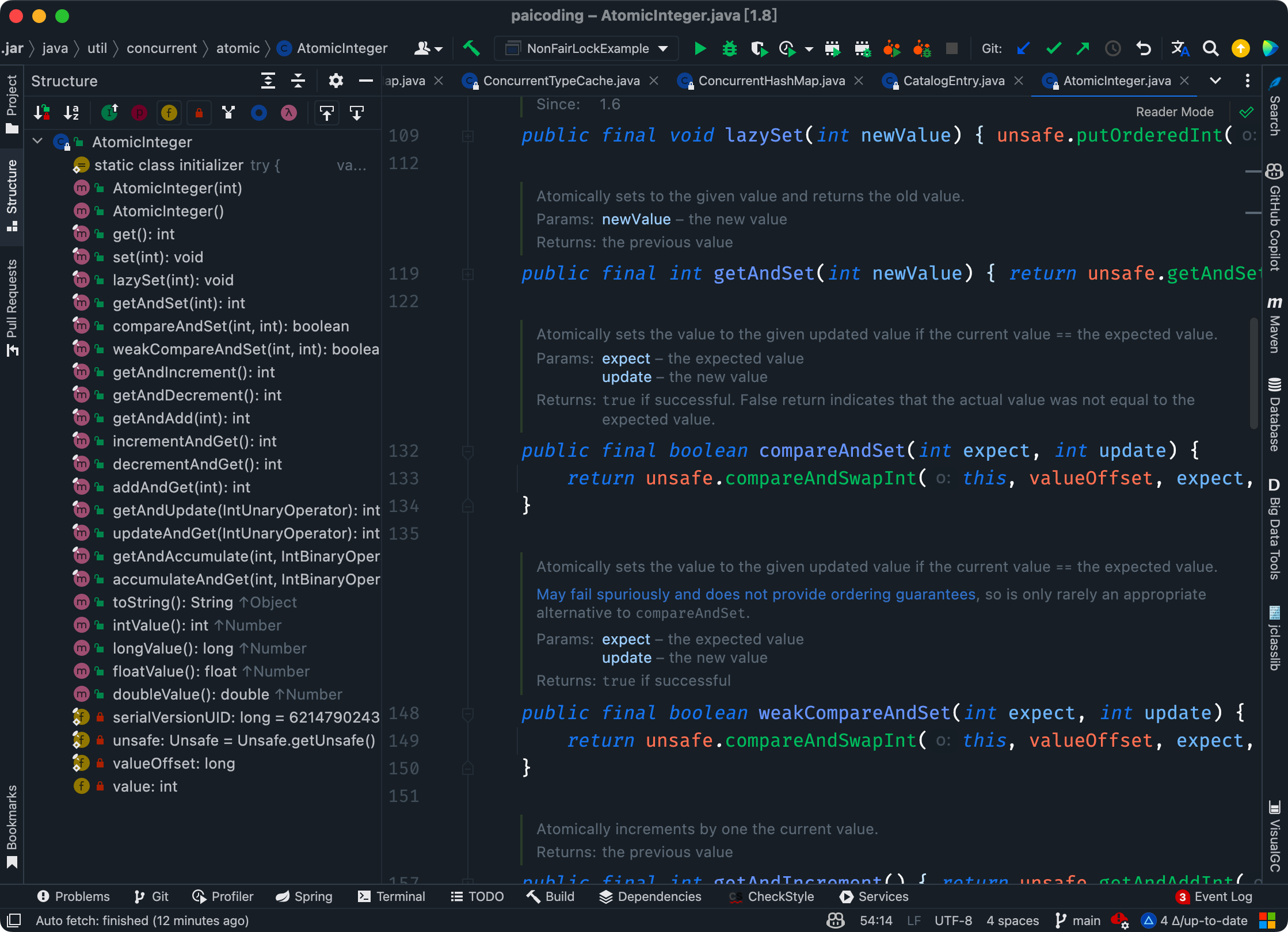

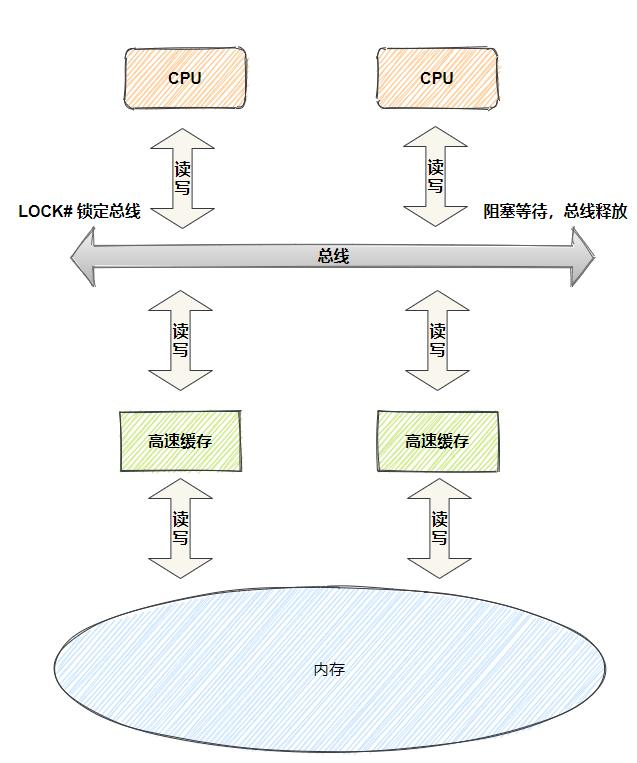

- 34.🌟CAS 了解多少?

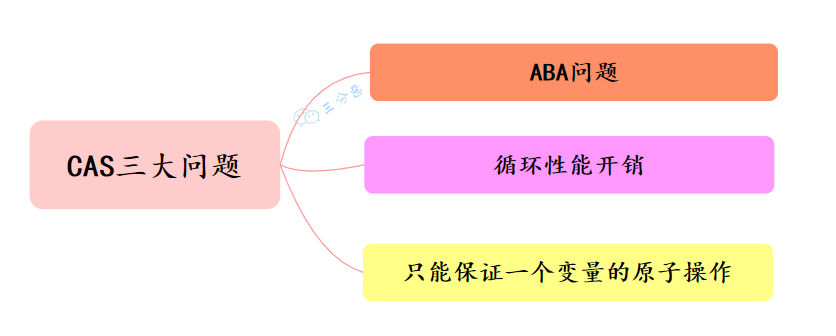

- 35.🌟CAS 有什么问题?

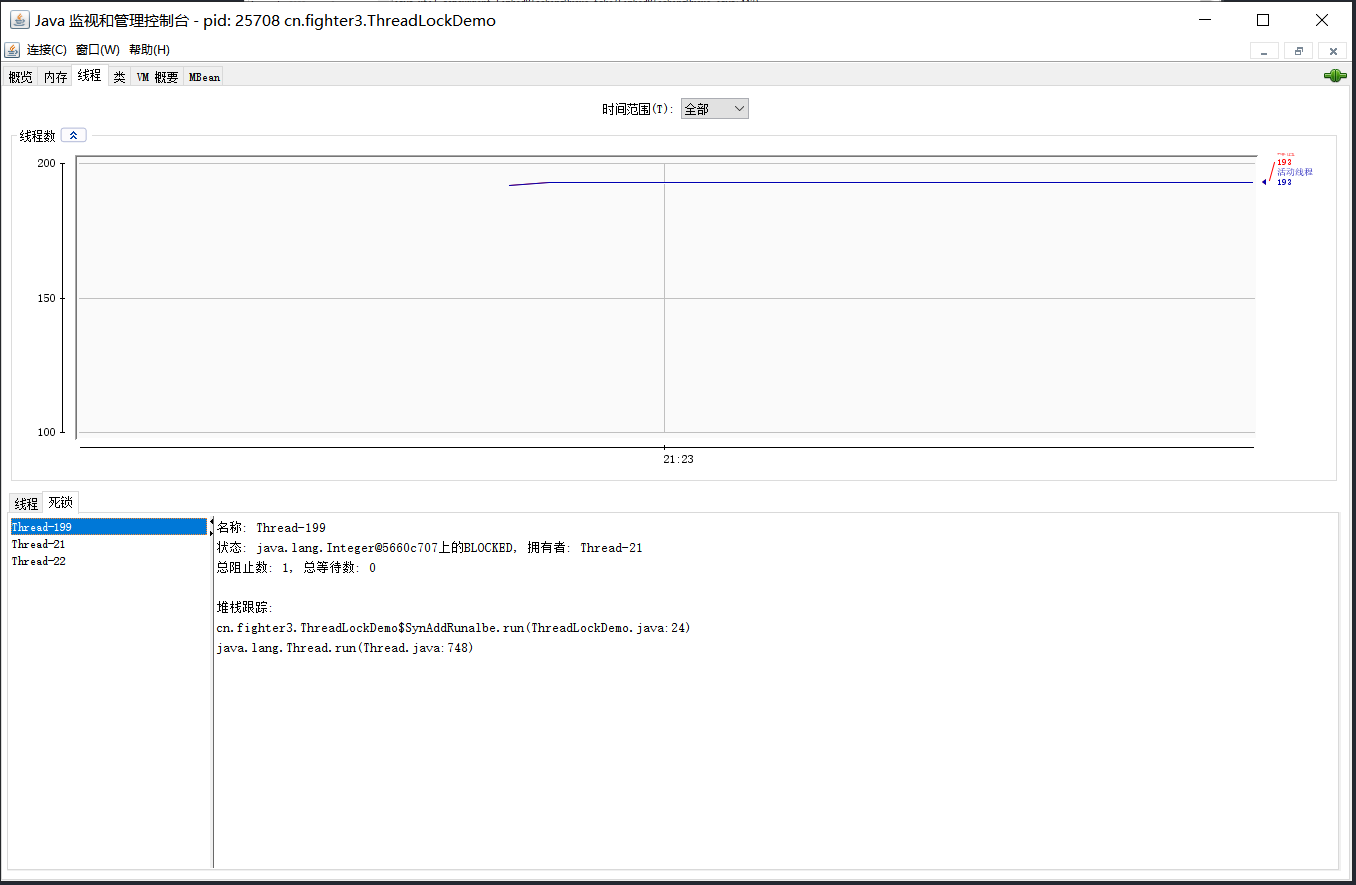

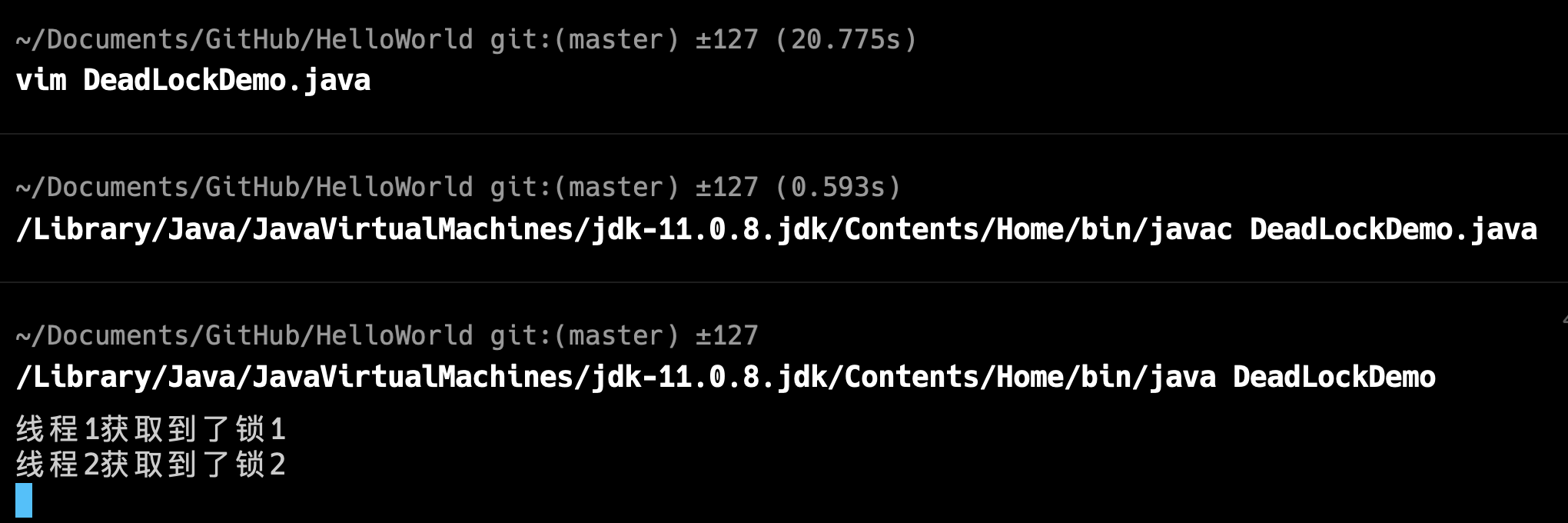

- 40.🌟死锁问题怎么排查呢?

- 42.🌟聊聊悲观锁和乐观锁?(补充)

- 48.🌟能说一下 ConcurrentHashMap 的实现吗?(补充)

- 53.🌟什么是线程池?

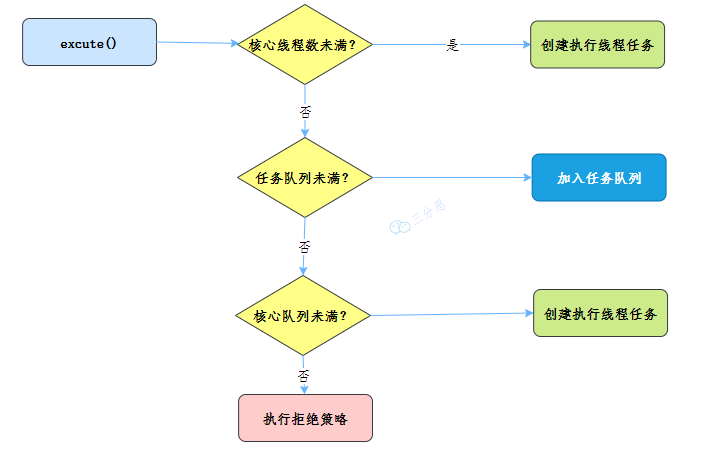

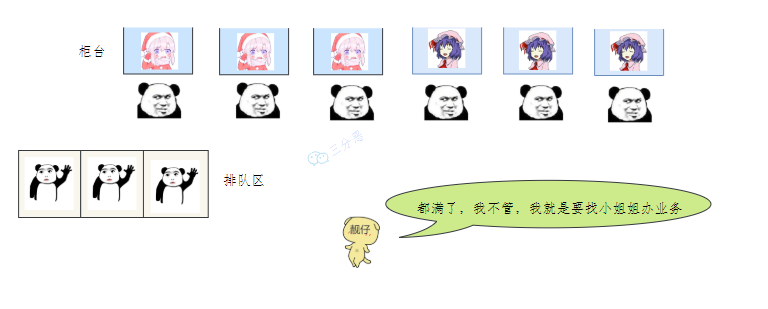

- 55.🌟说一下线程池的工作流程?

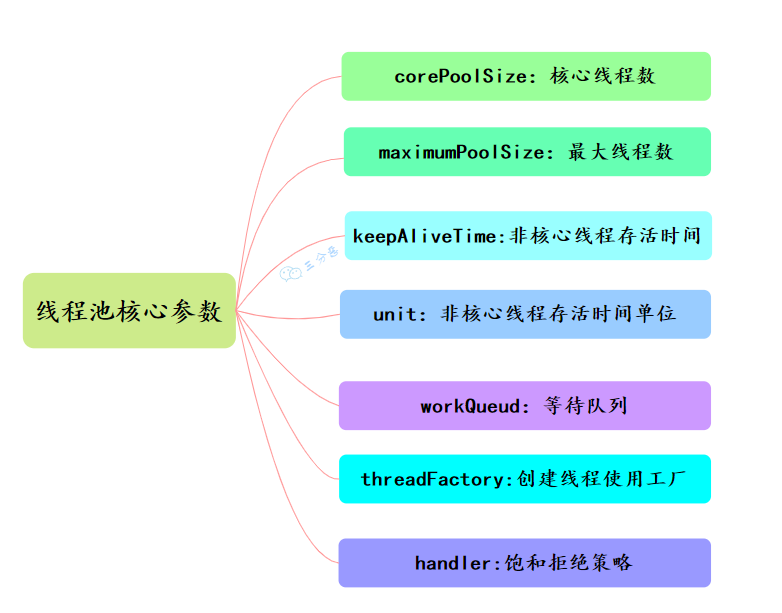

- 56.🌟线程池的主要参数有哪些?

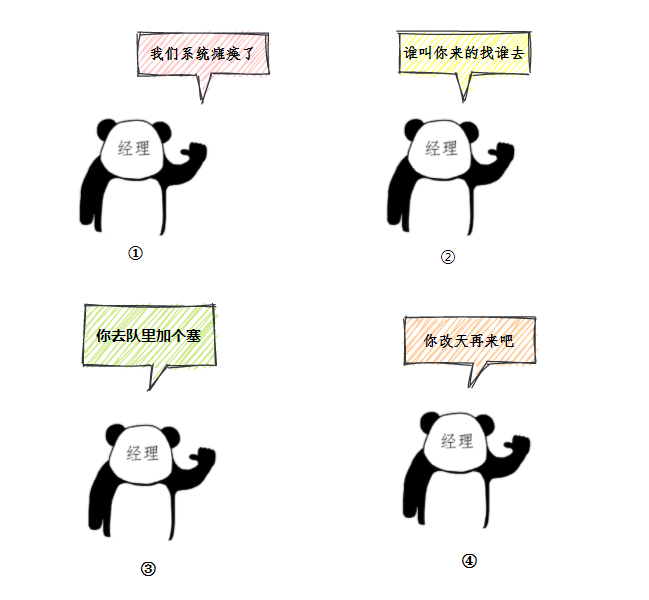

- 57.🌟线程池的拒绝策略有哪些?

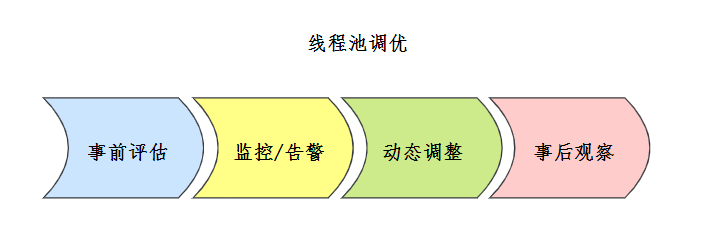

- 67.🌟线程池调优了解吗?(补充)

- 69.🌟你能设计实现一个线程池吗?

- JVM

- MySQL

- 🌟0.什么是MYSQL

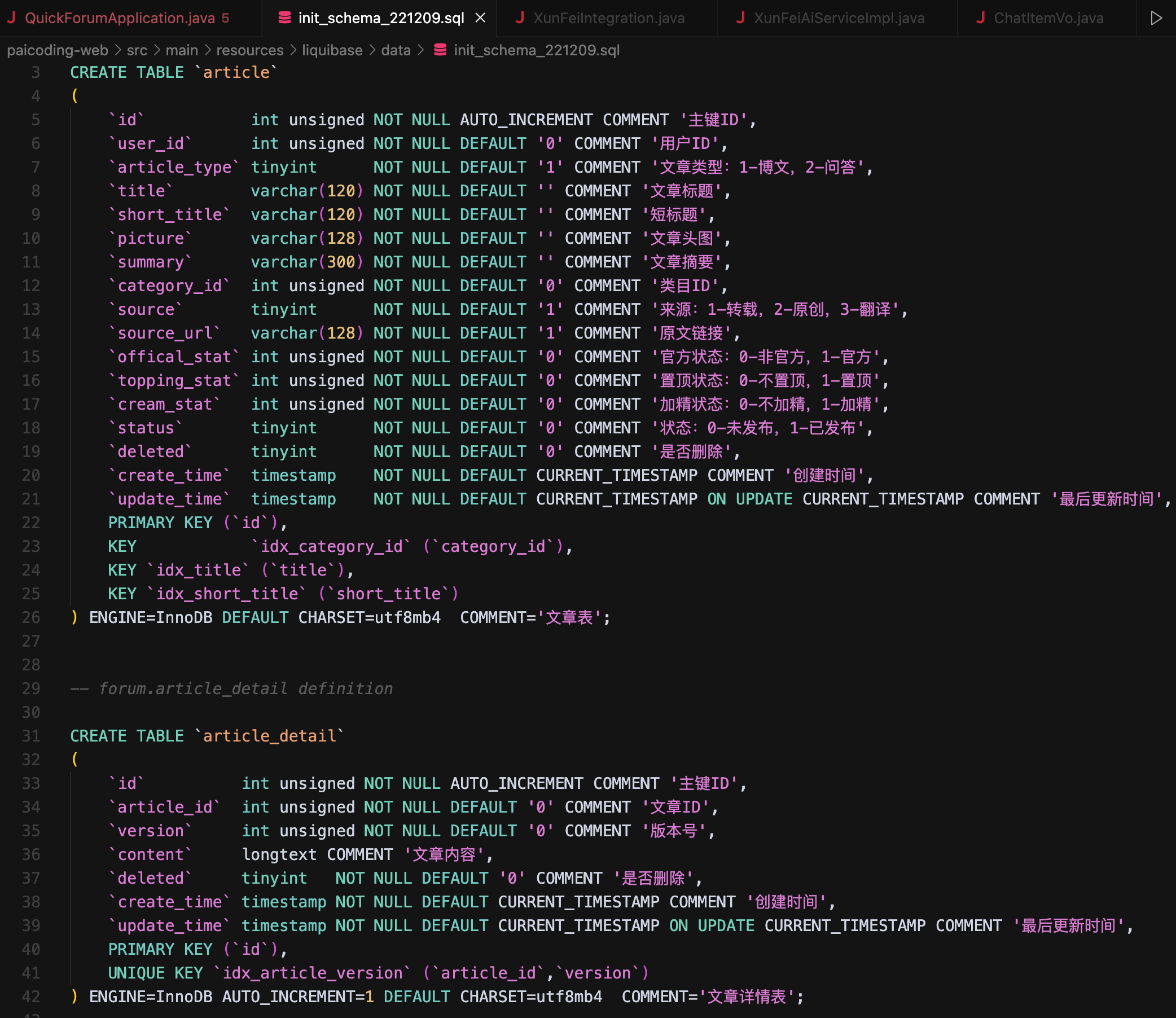

- 9.🌟如何存储emoji?

- 21.🌟一条查询语句SELECT是如何执行的?

- 24.🌟MySQL 有哪些常见存储引擎?

- 28.🌟MySQL 日志文件有哪些?

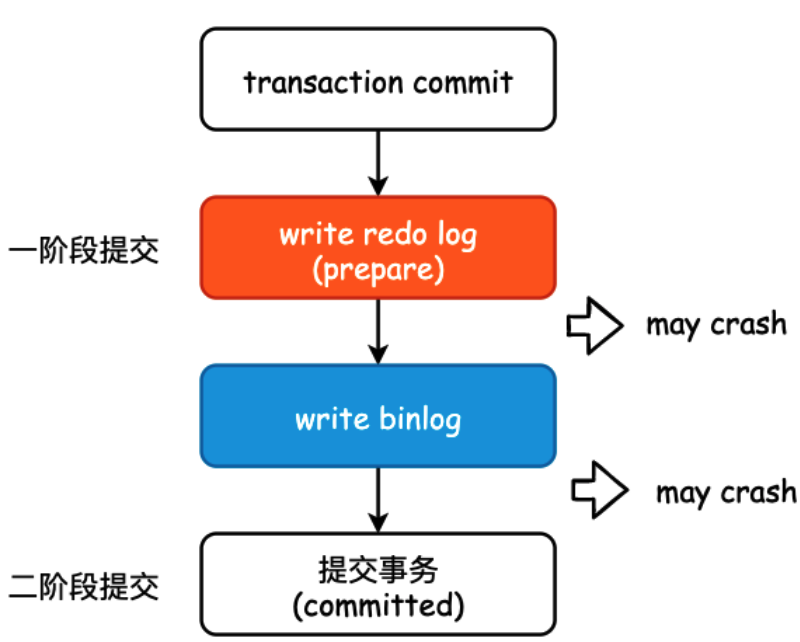

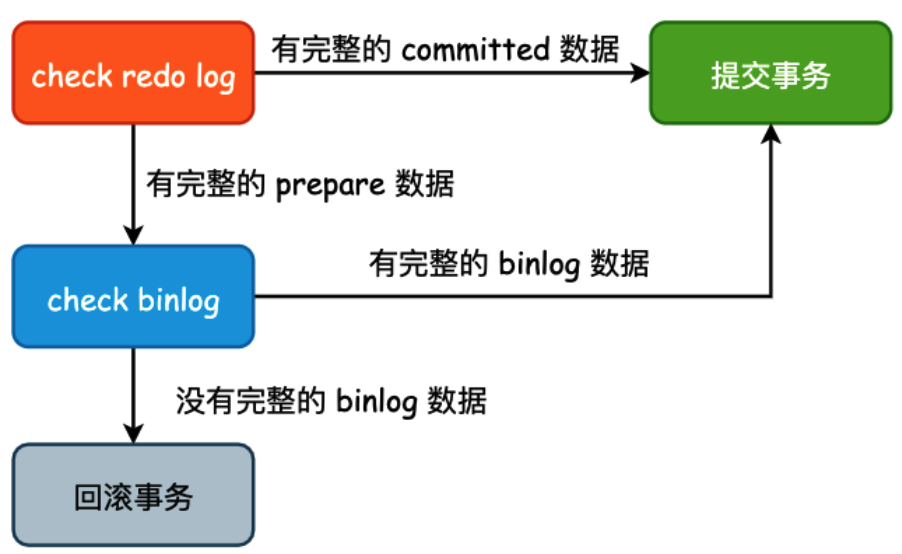

- 30.🌟为什么要两阶段提交?

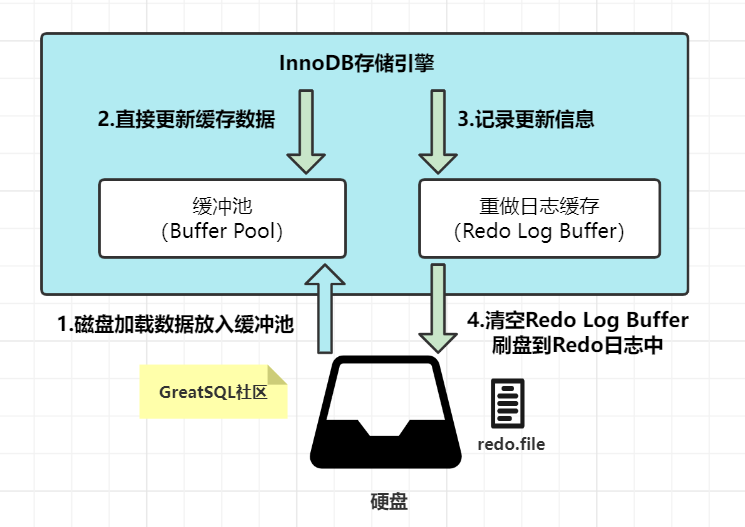

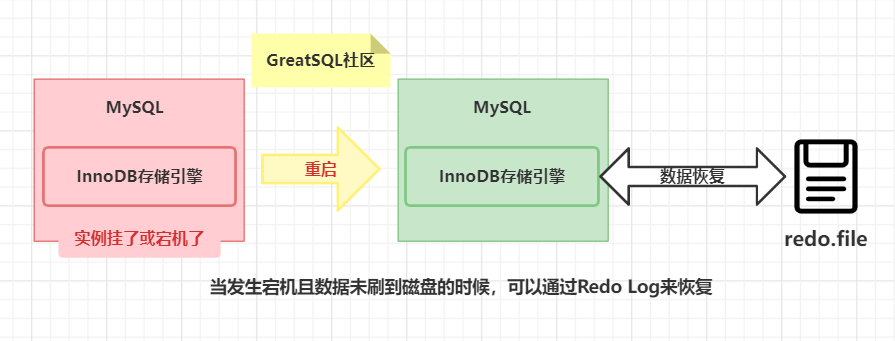

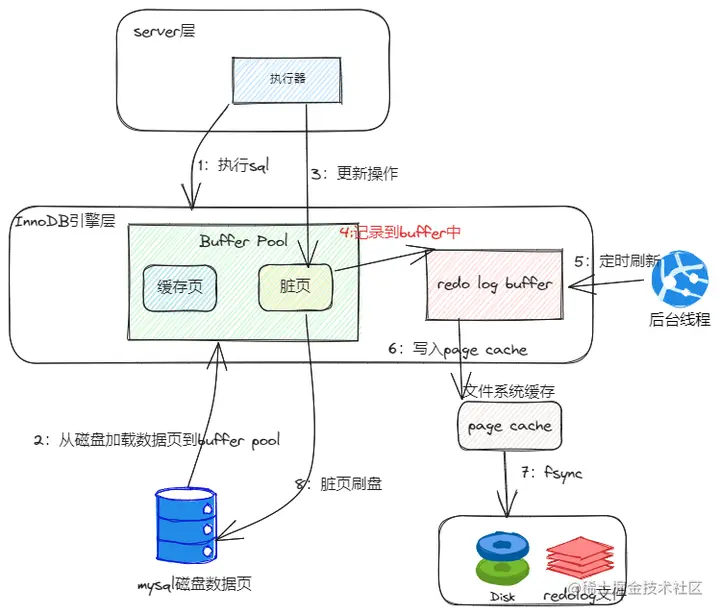

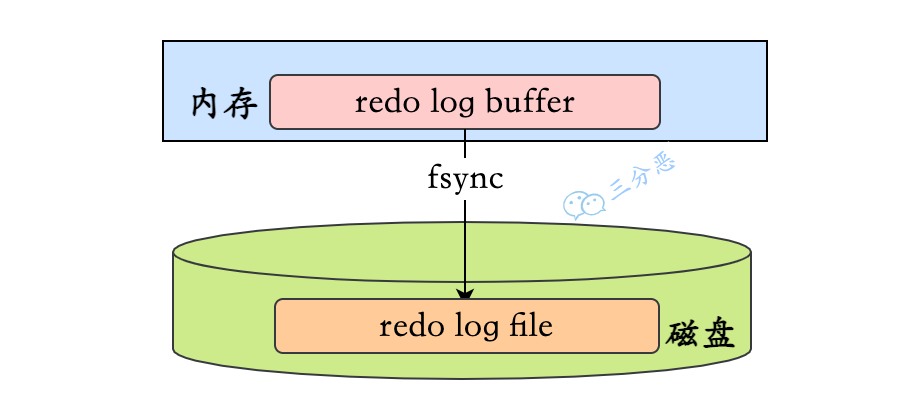

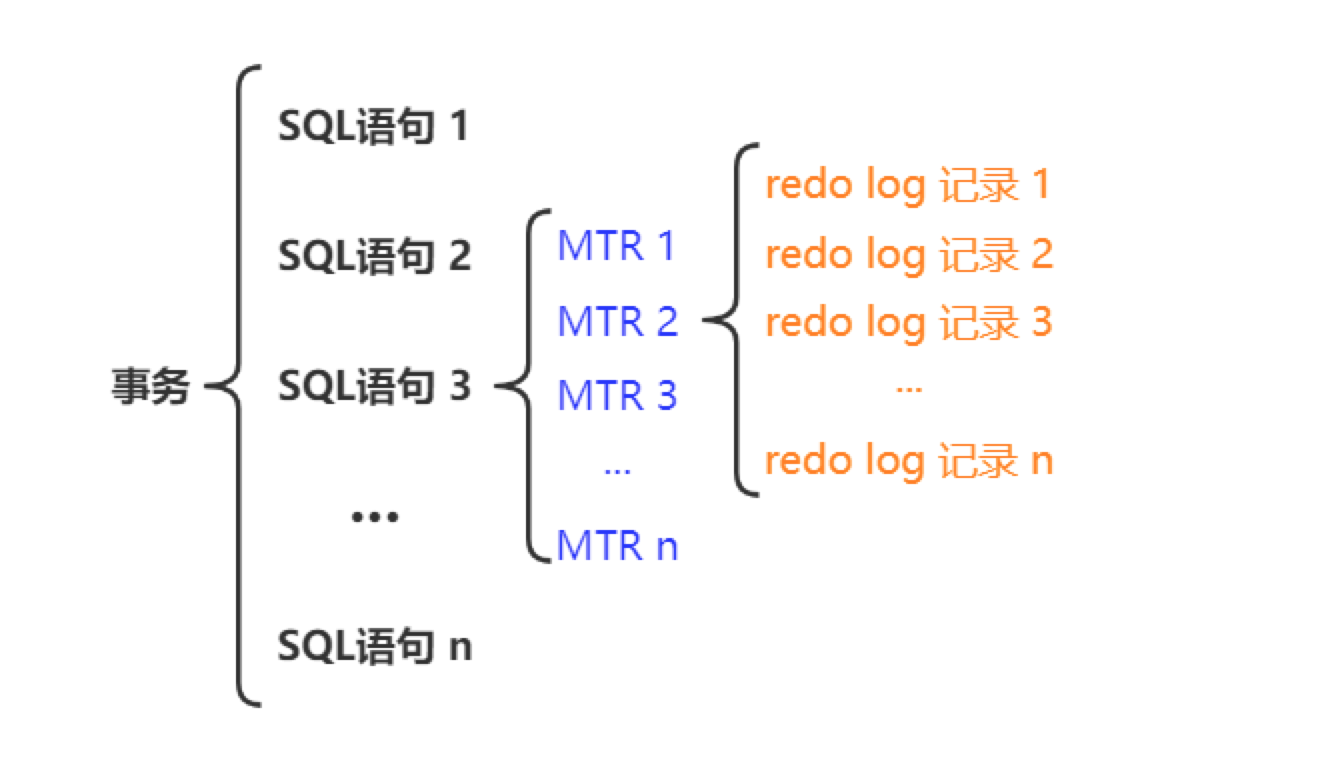

- 31.🌟redo log 的写入过程了解吗?

- 🌟32.什么是慢 SQL?

- 🌟33.你知道哪些方法来优化 SQL?

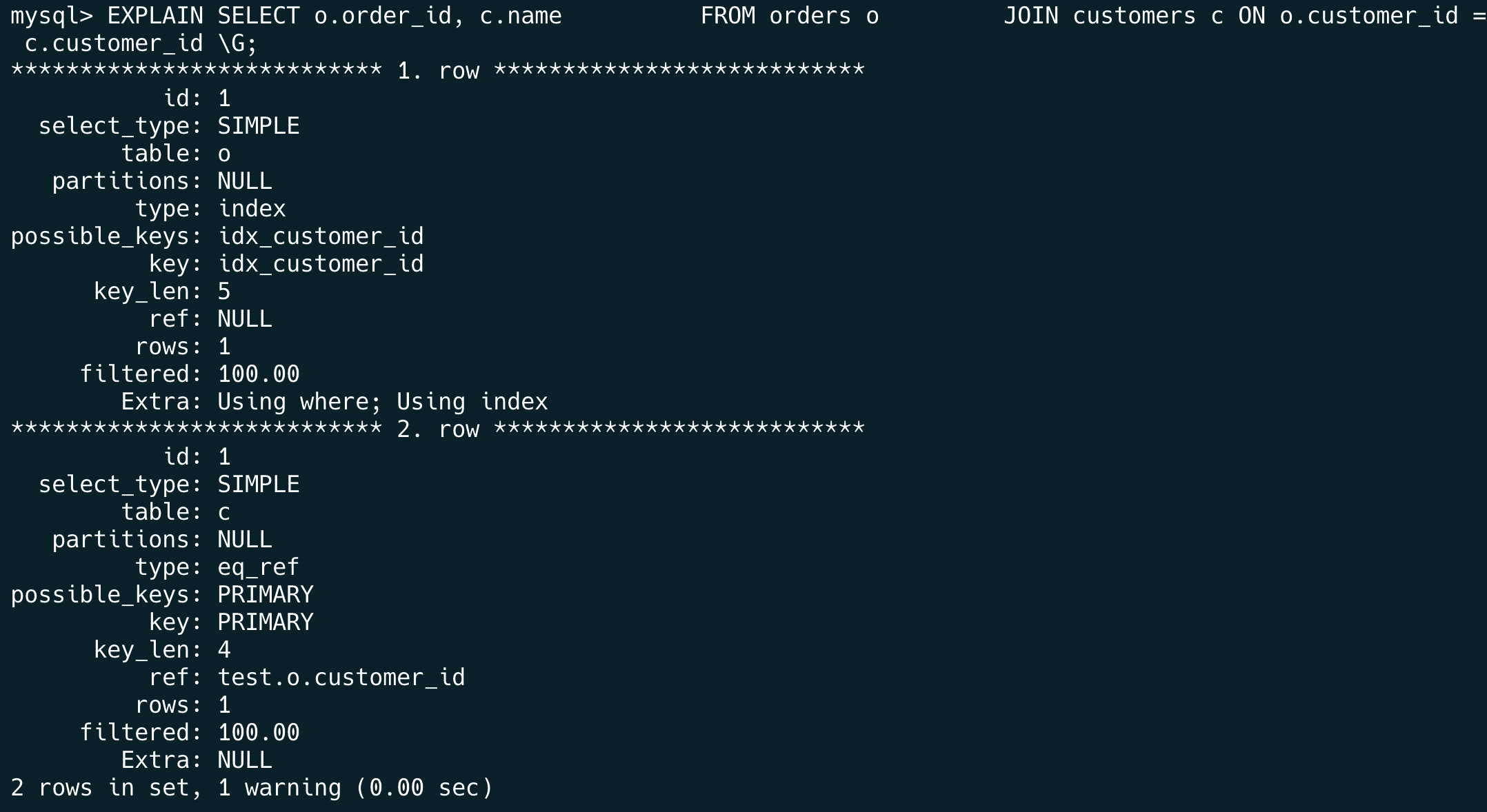

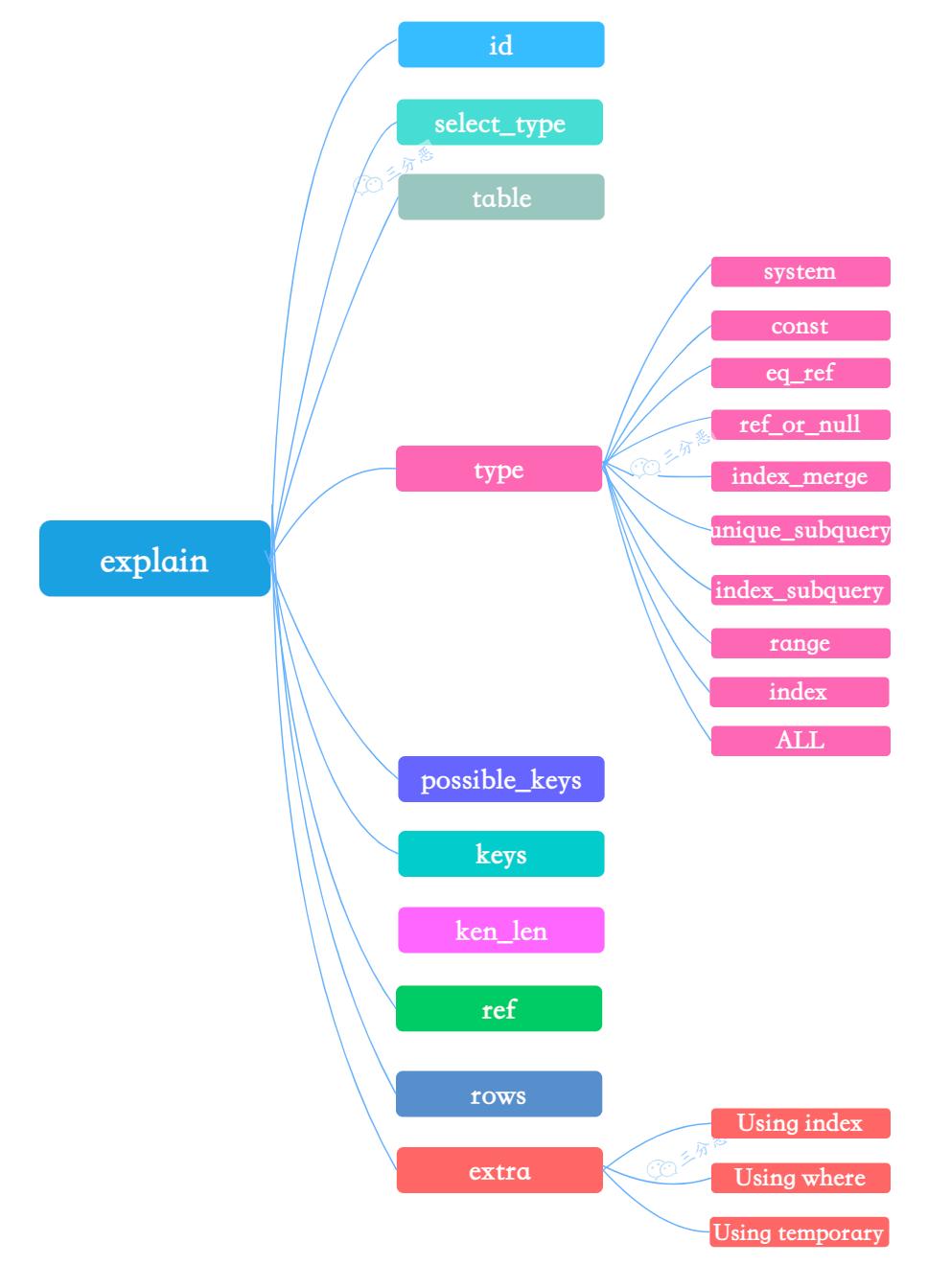

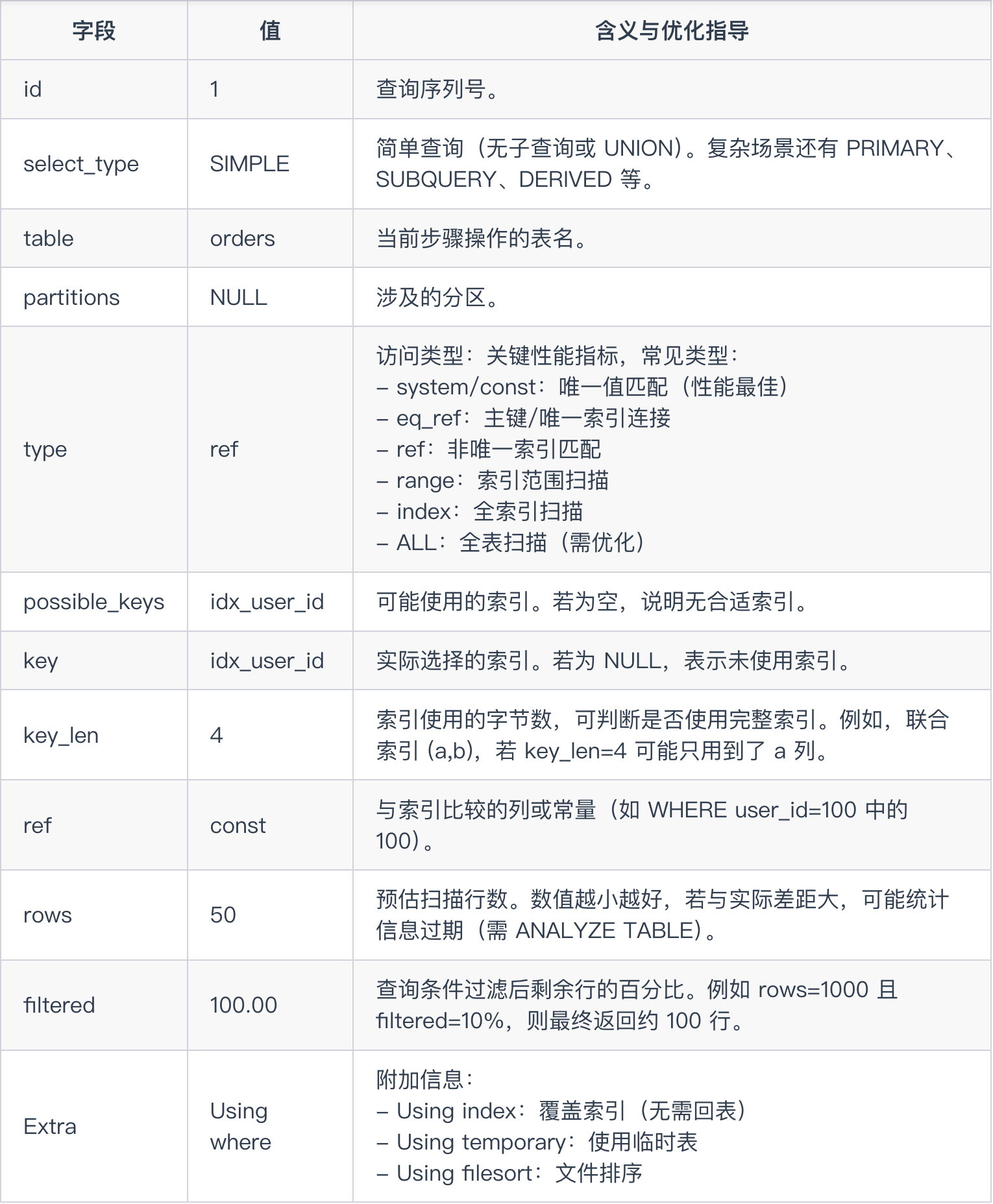

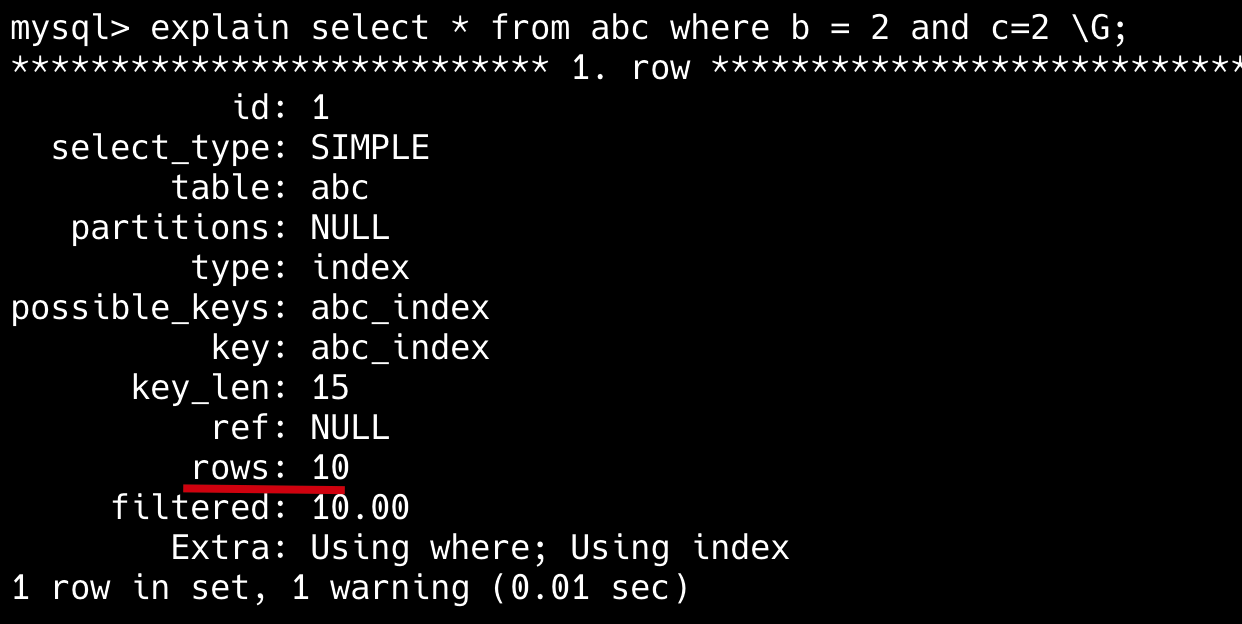

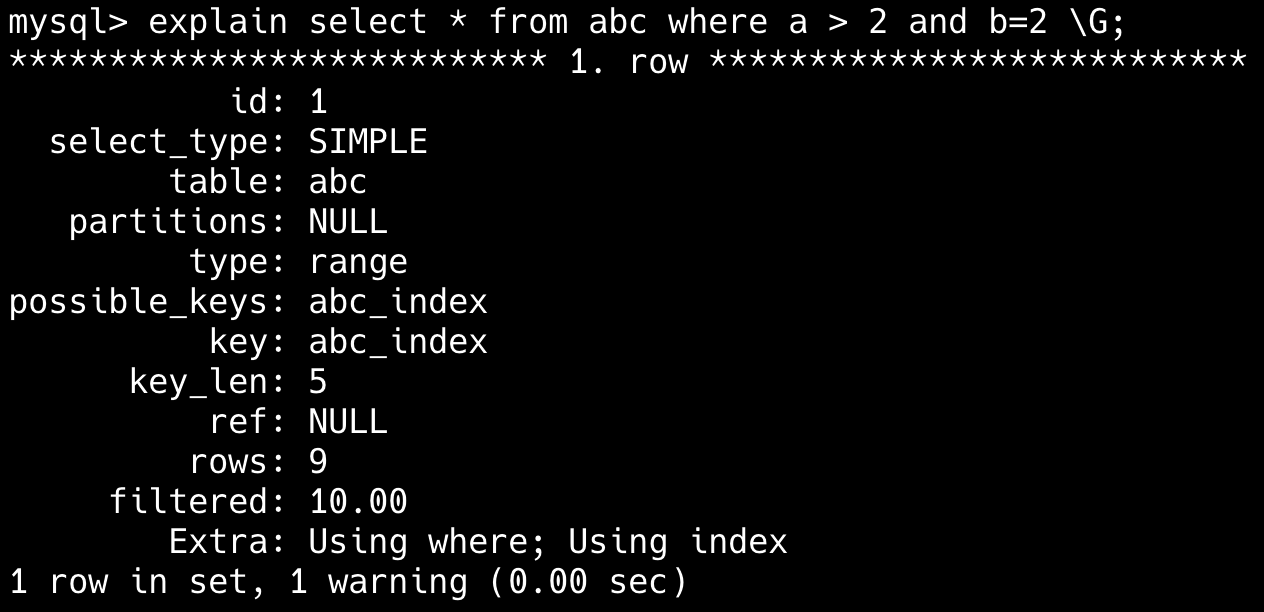

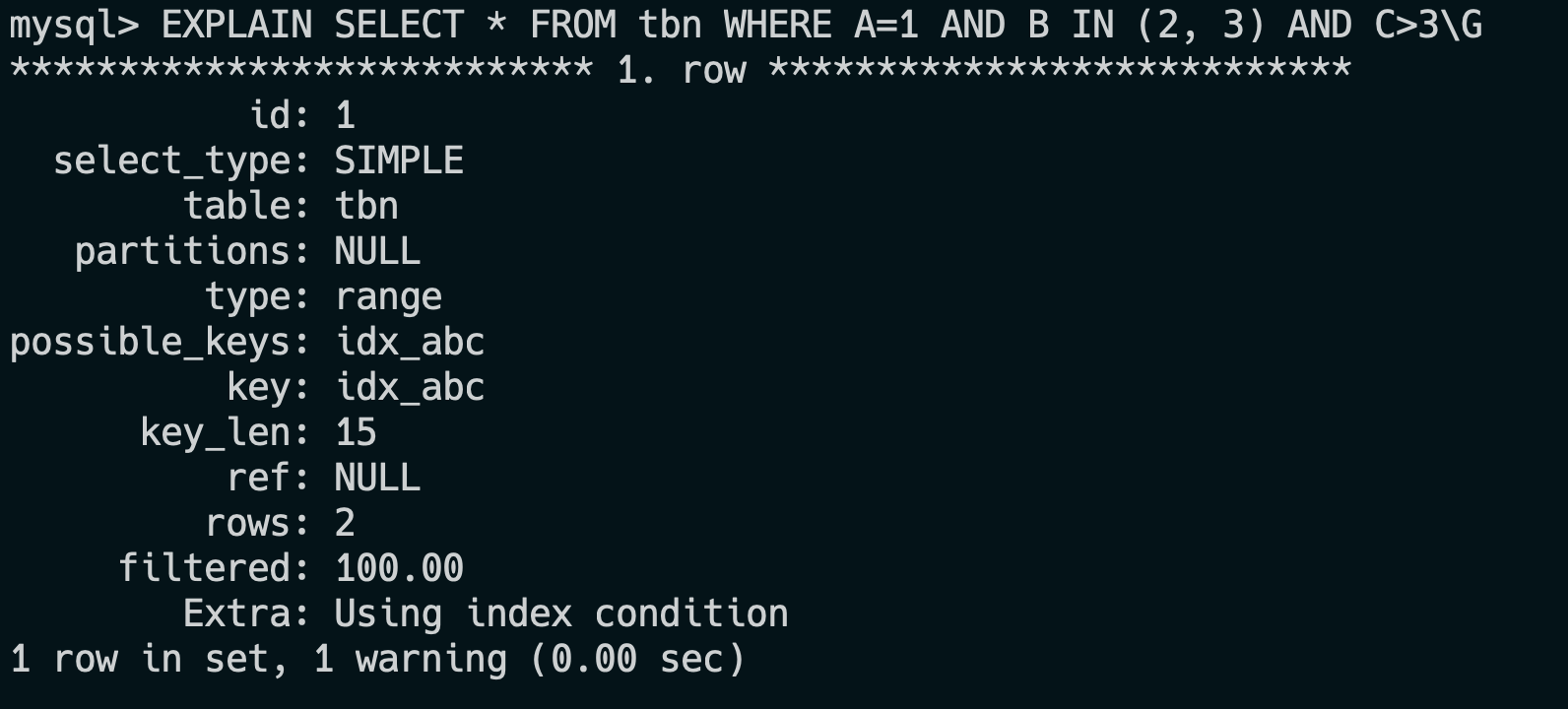

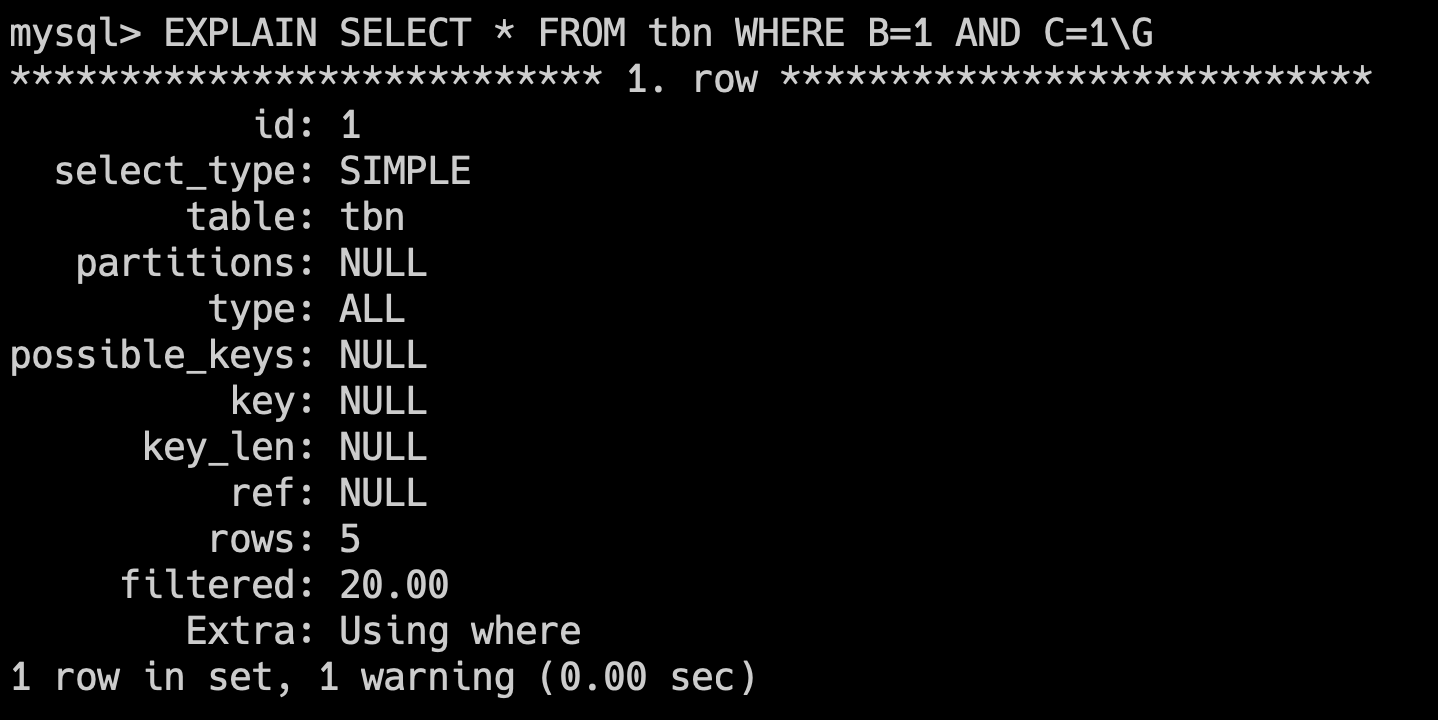

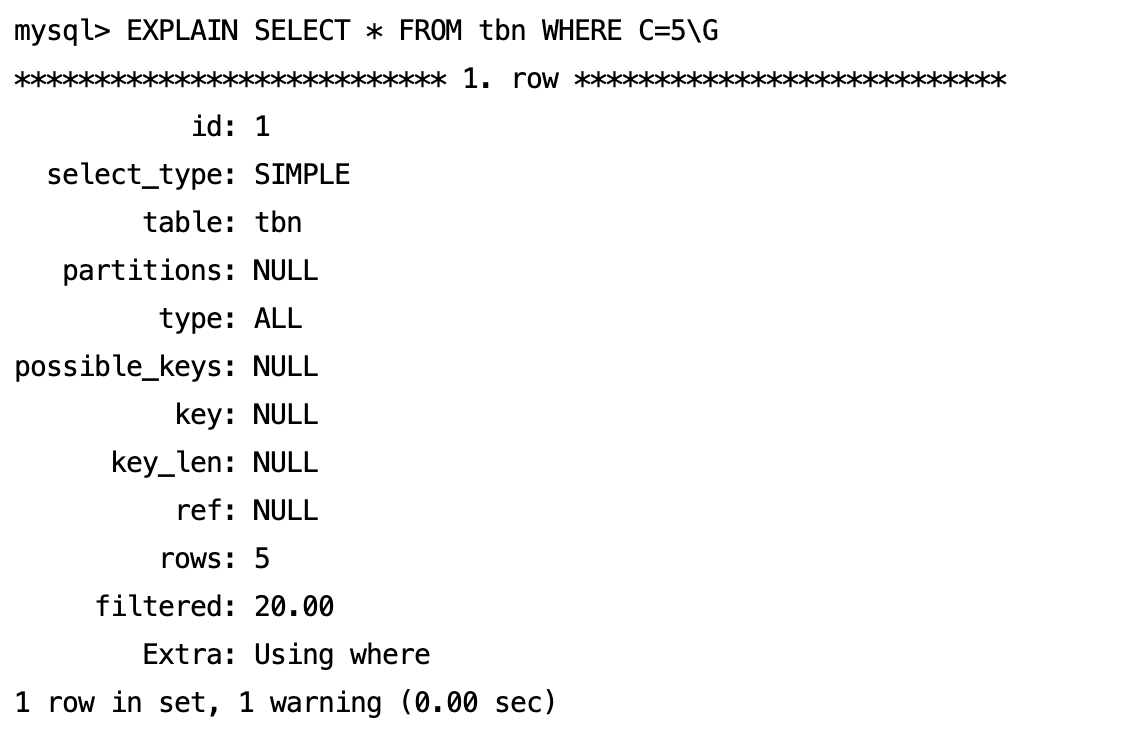

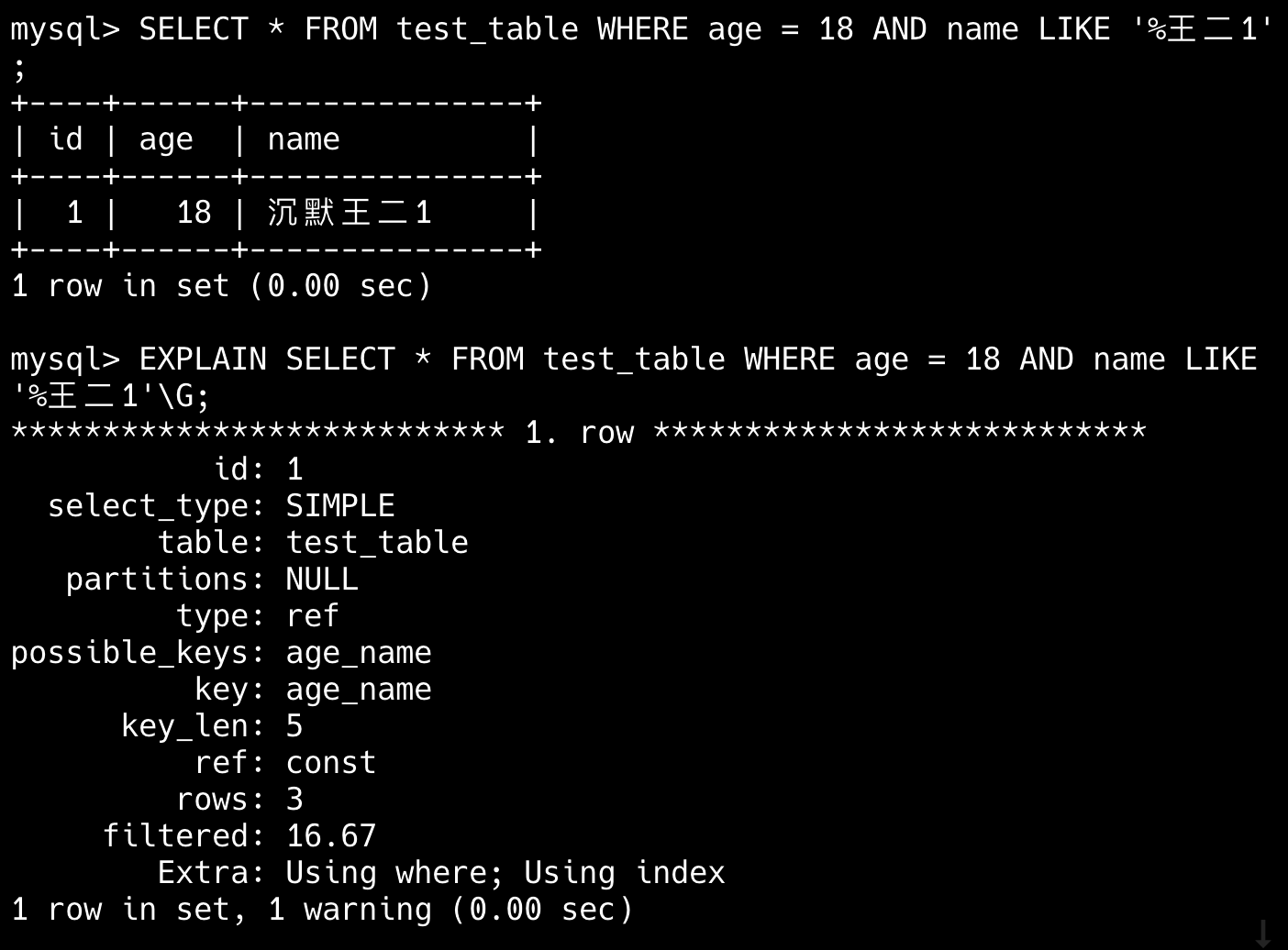

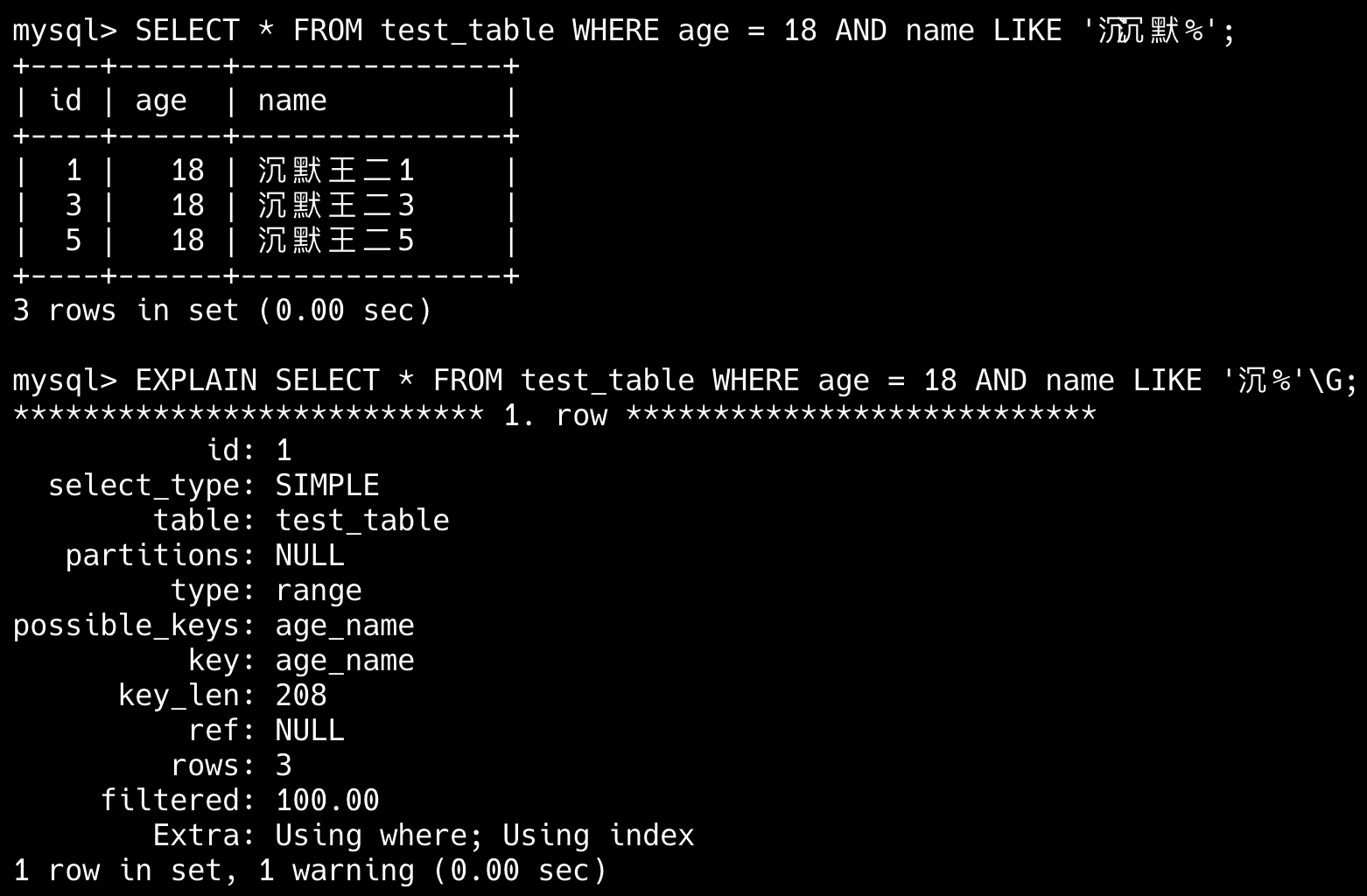

- 34.🌟explain平常有用过吗?

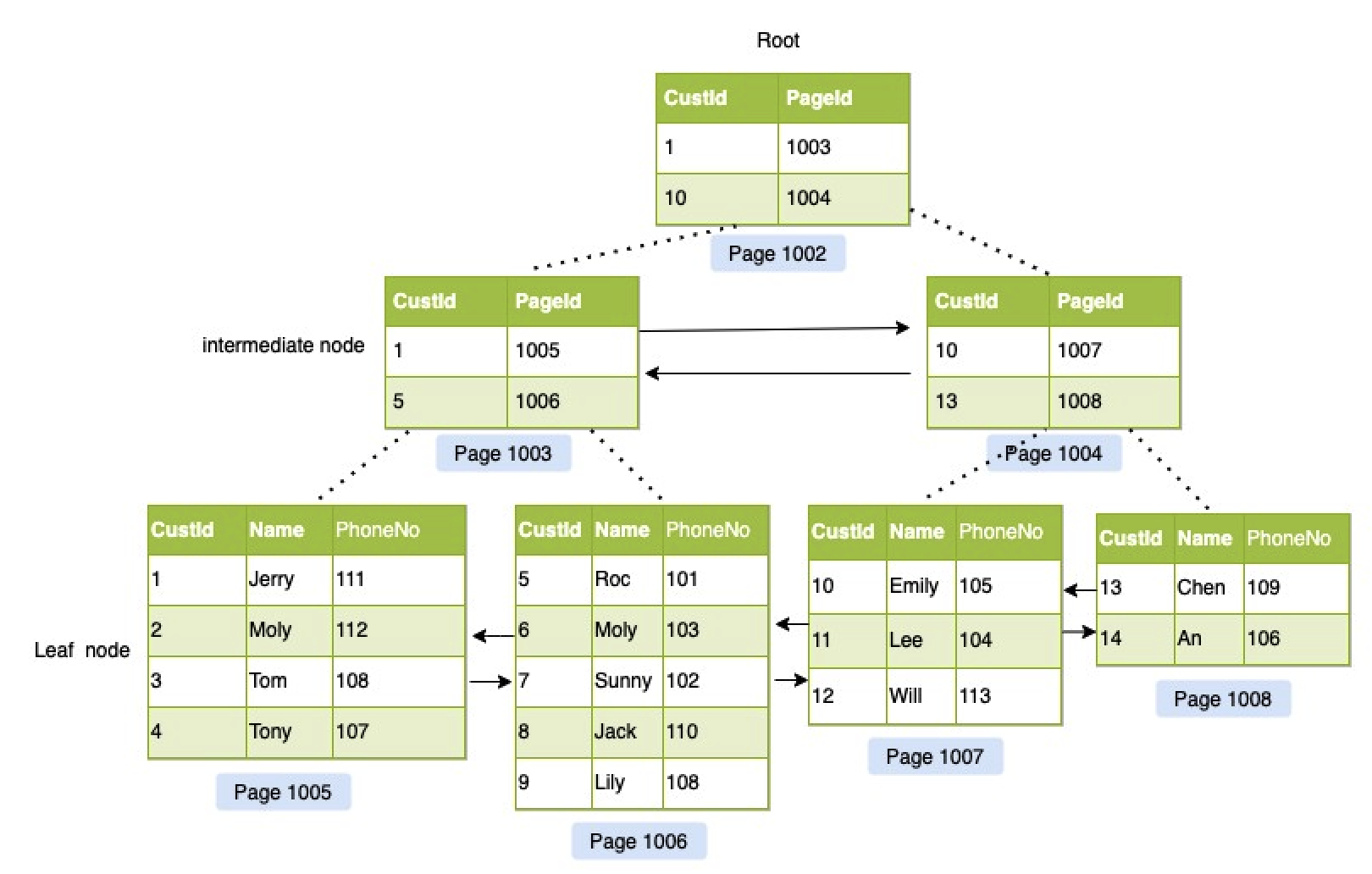

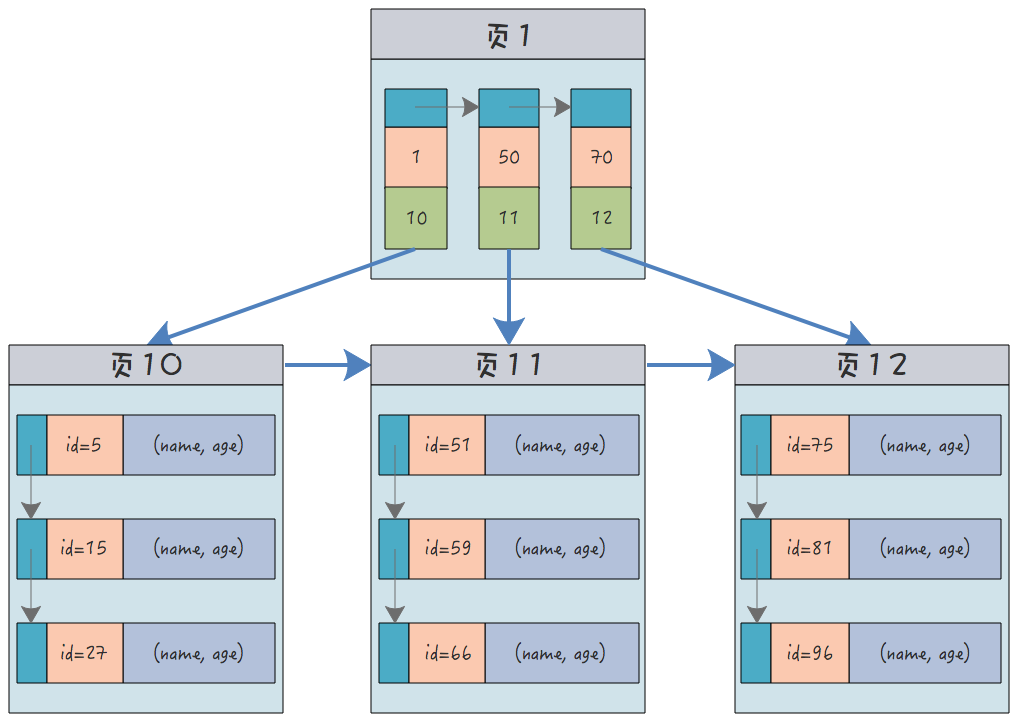

- 35.🌟索引为什么能提高MySQL查询效率?

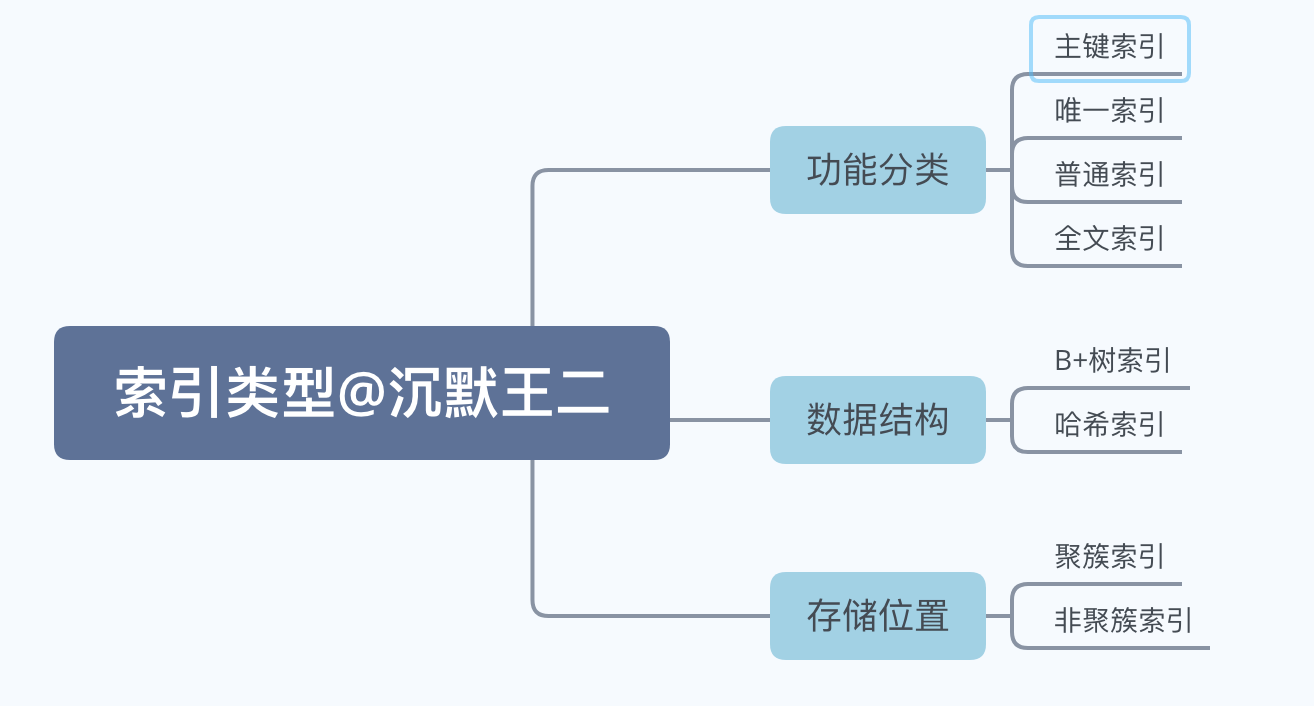

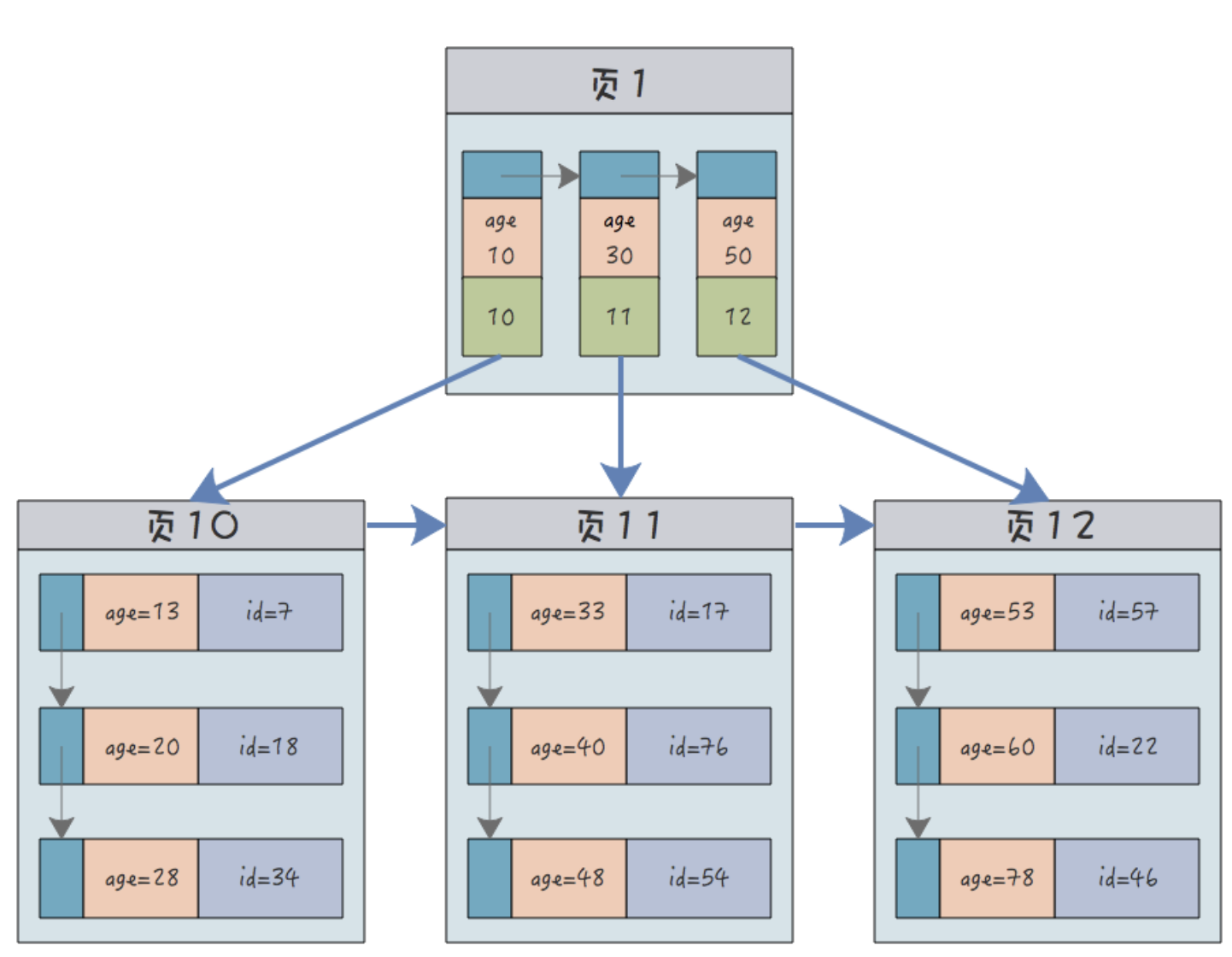

- 36.🌟能简单说一下索引的分类吗?

- 37.🌟创建索引有哪些注意点?

- 38.🌟索引哪些情况下会失效呢?

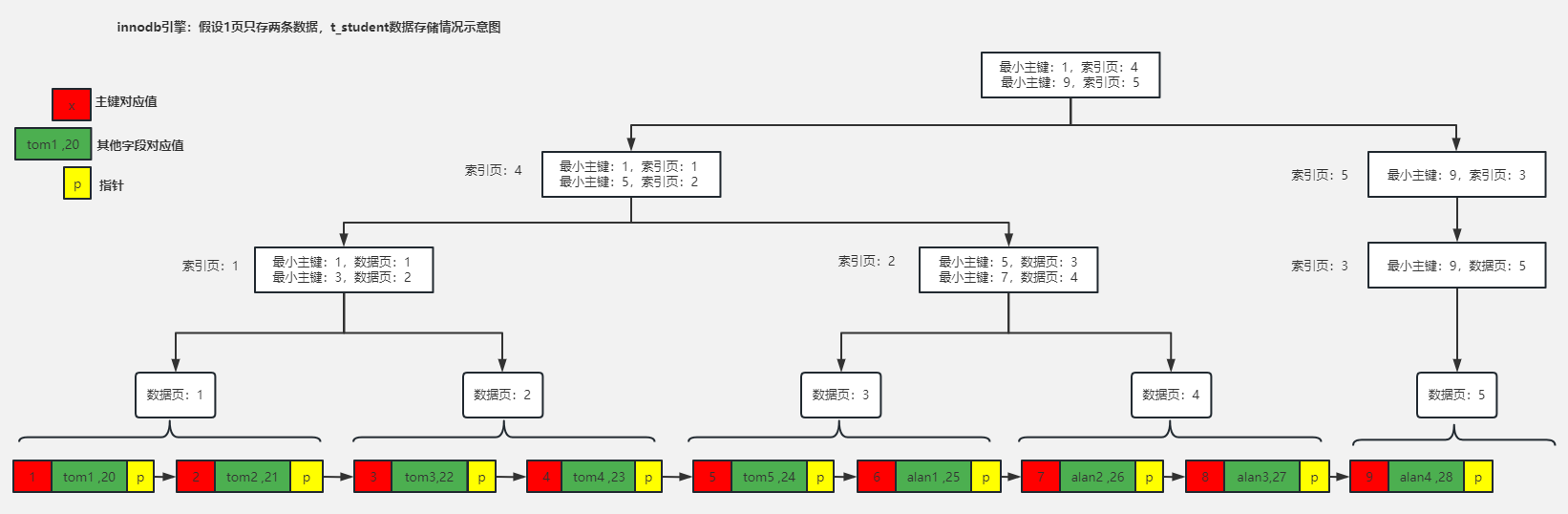

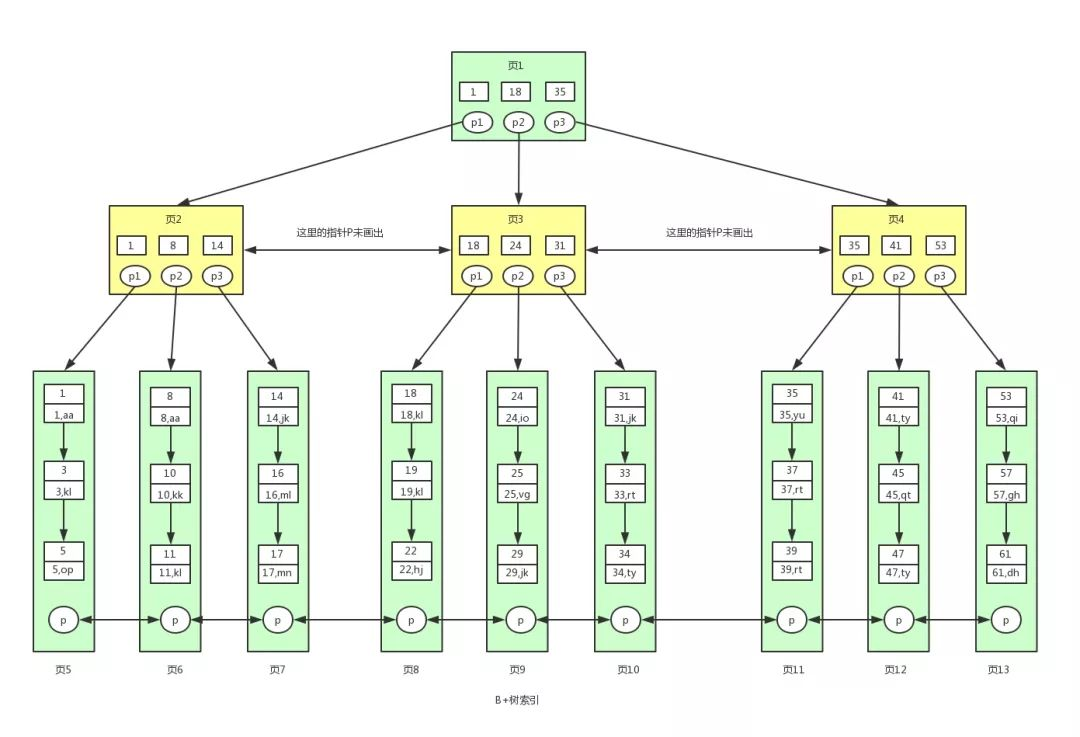

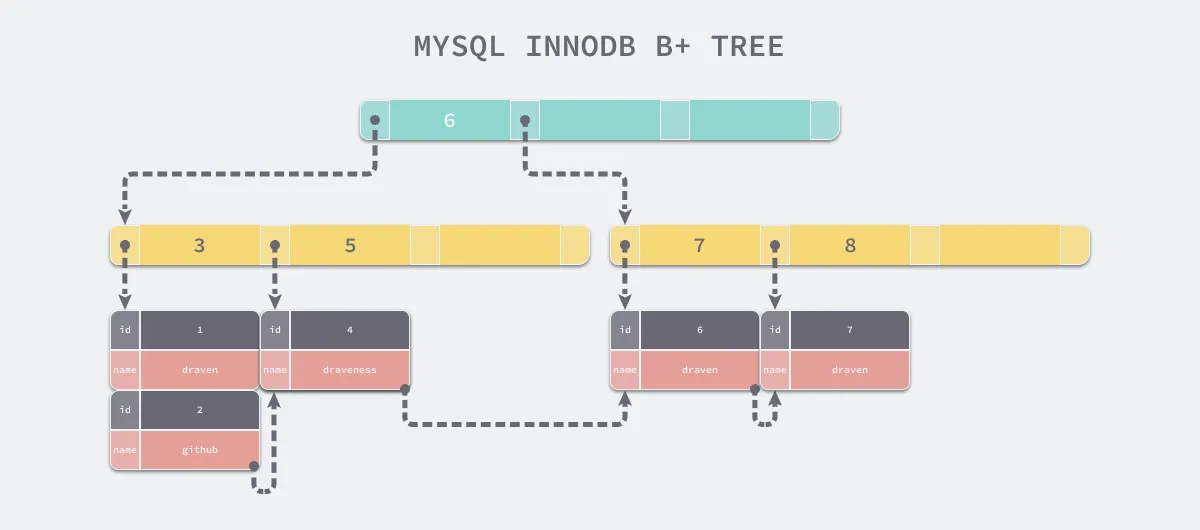

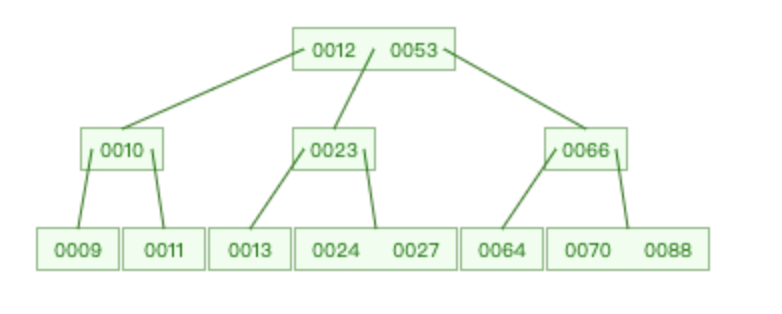

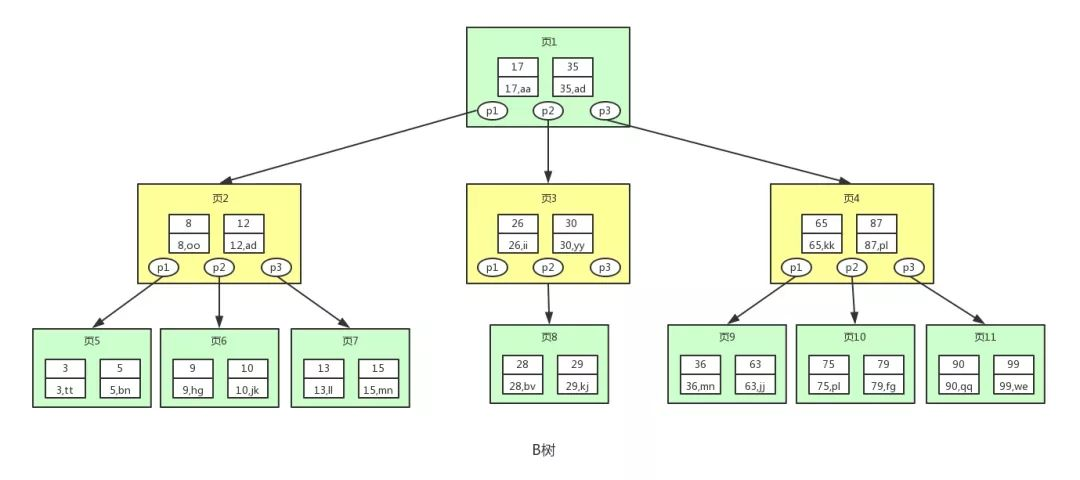

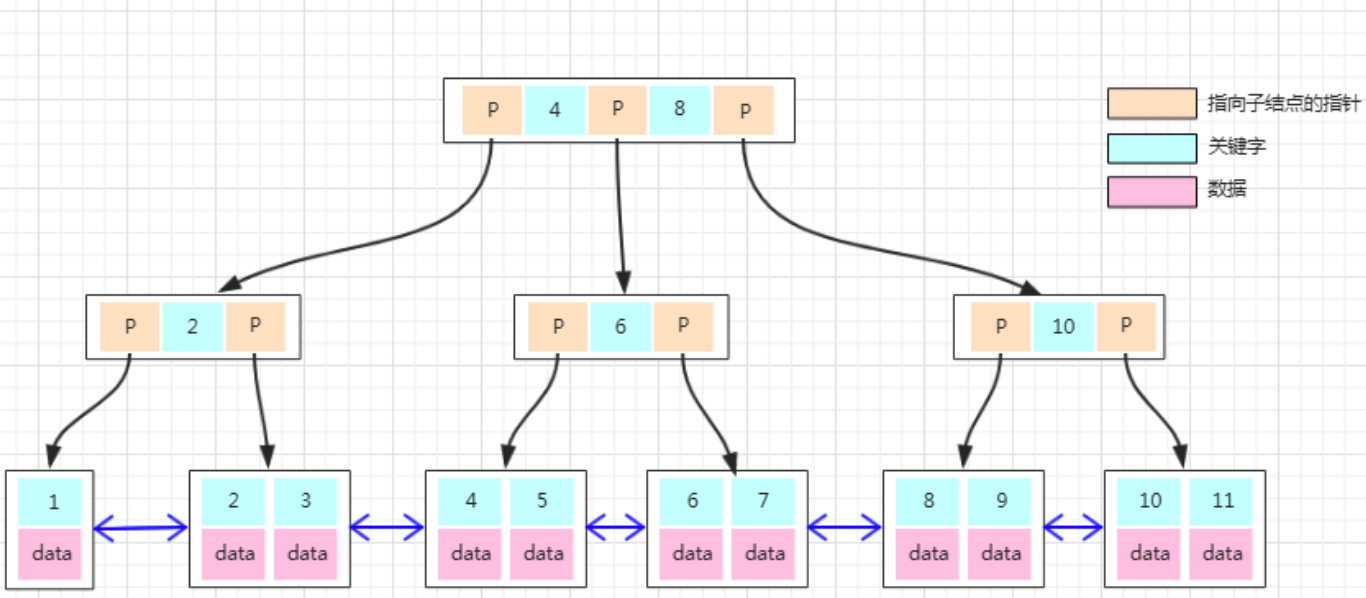

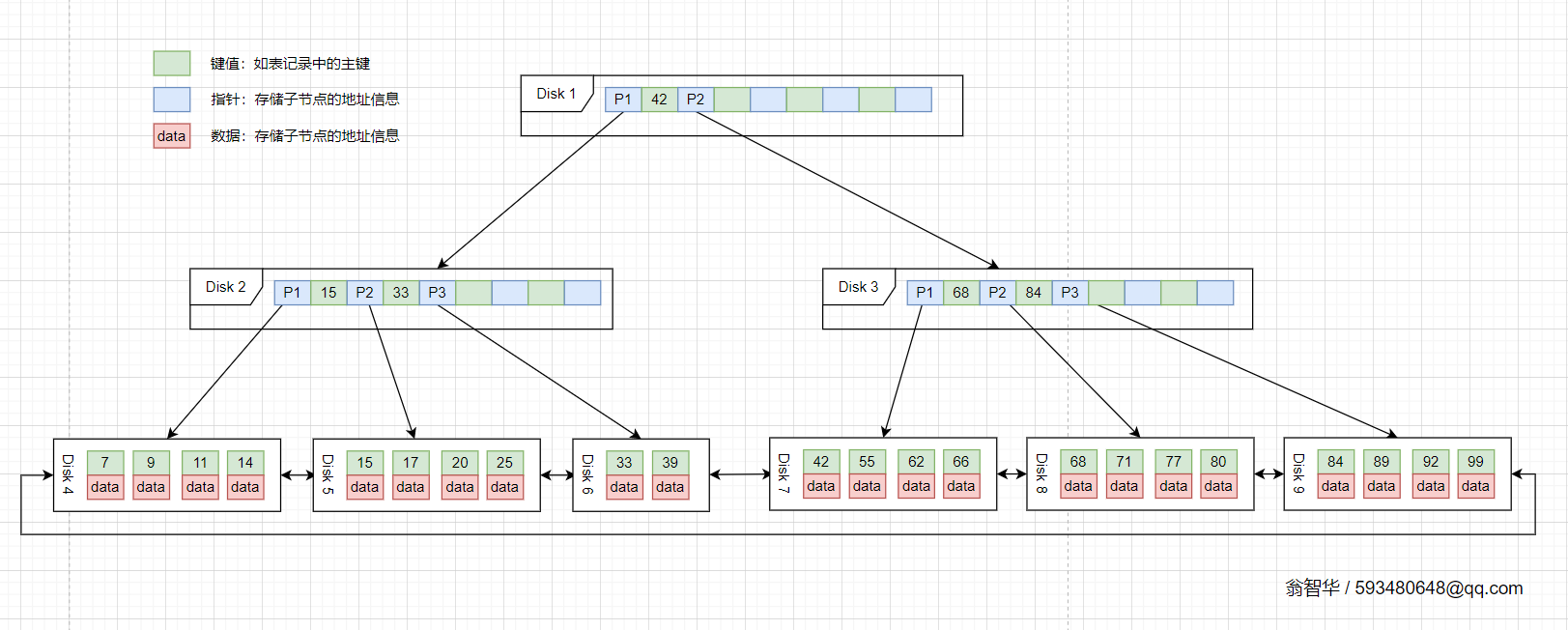

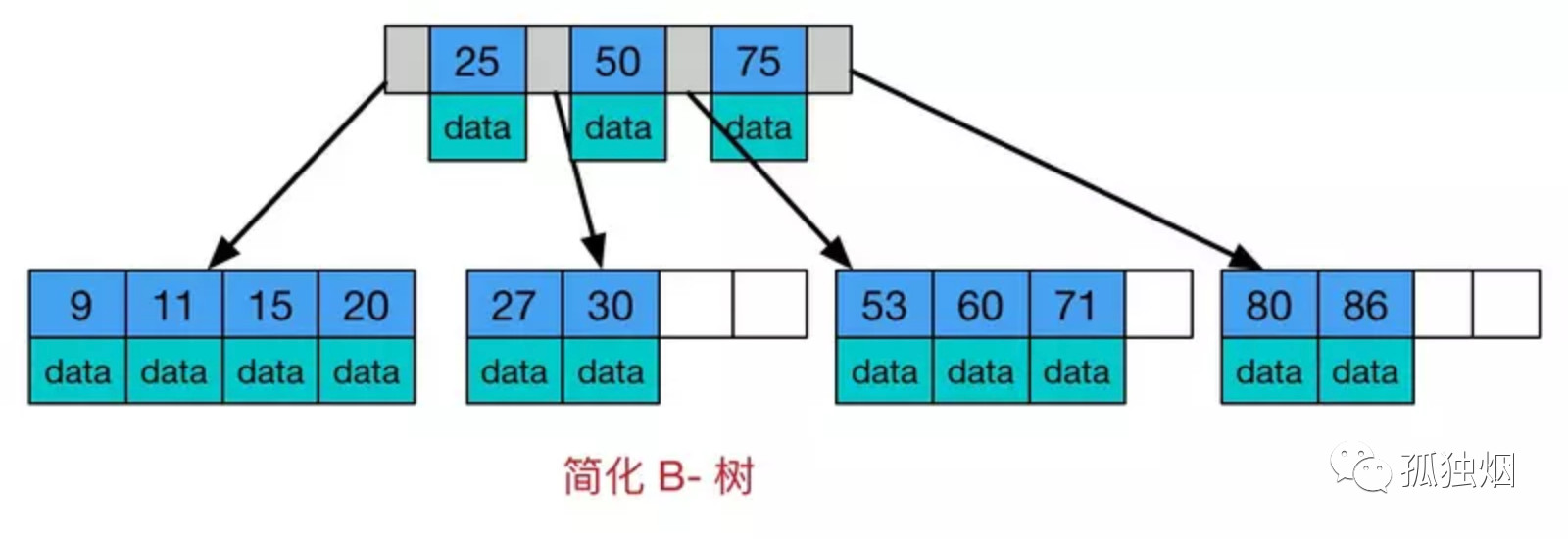

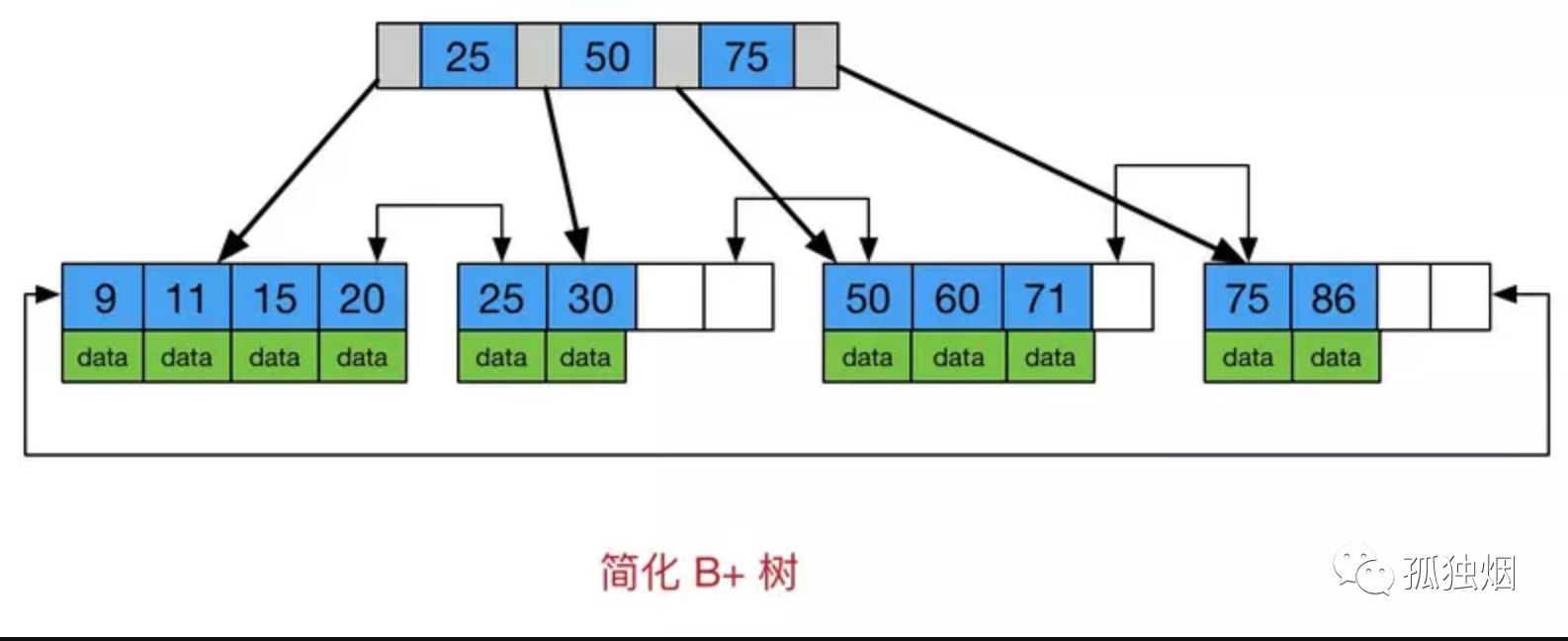

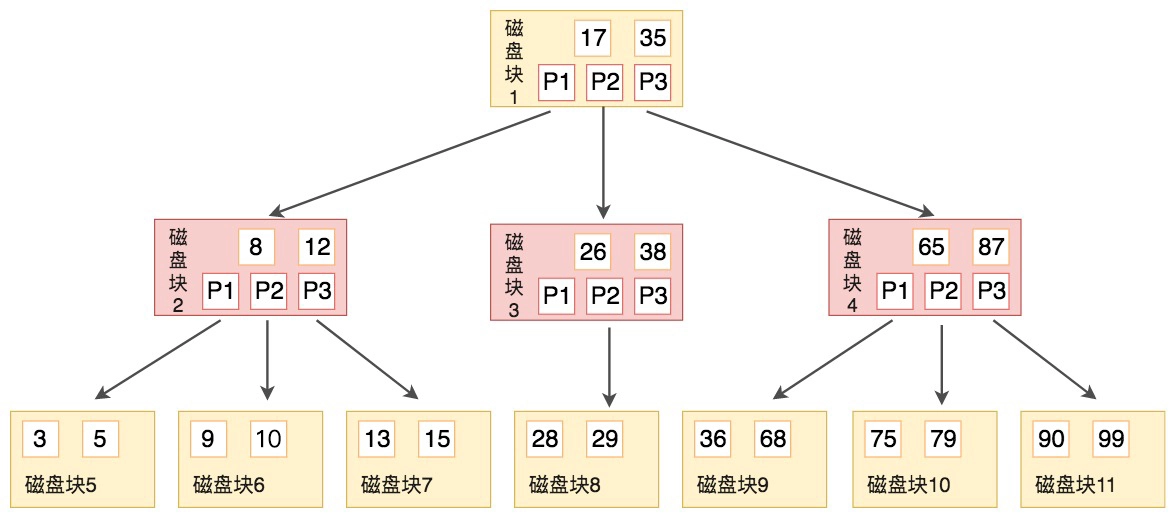

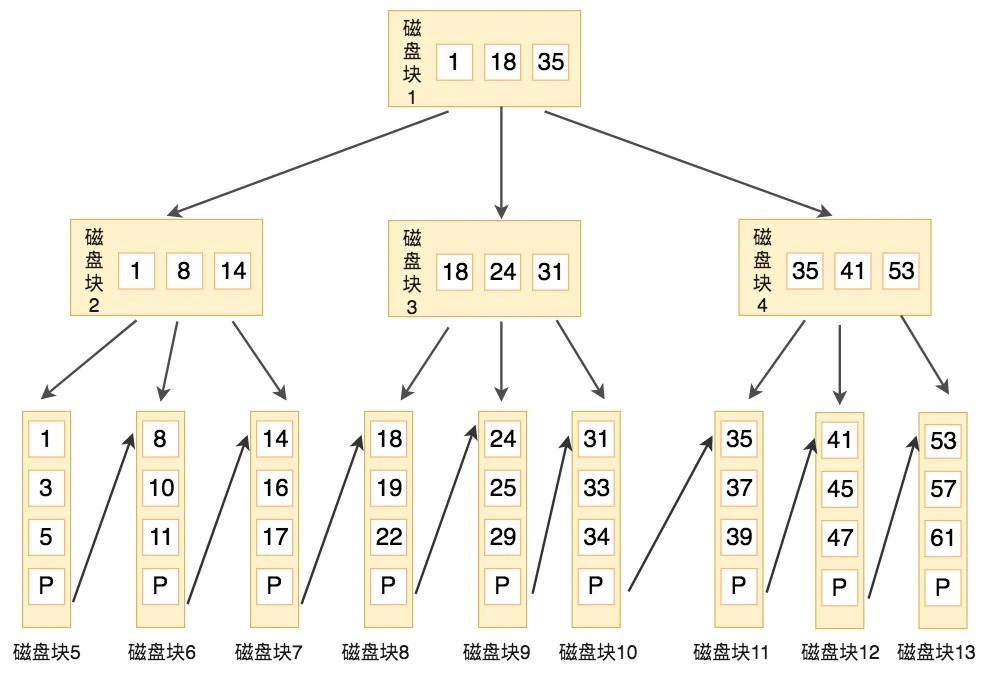

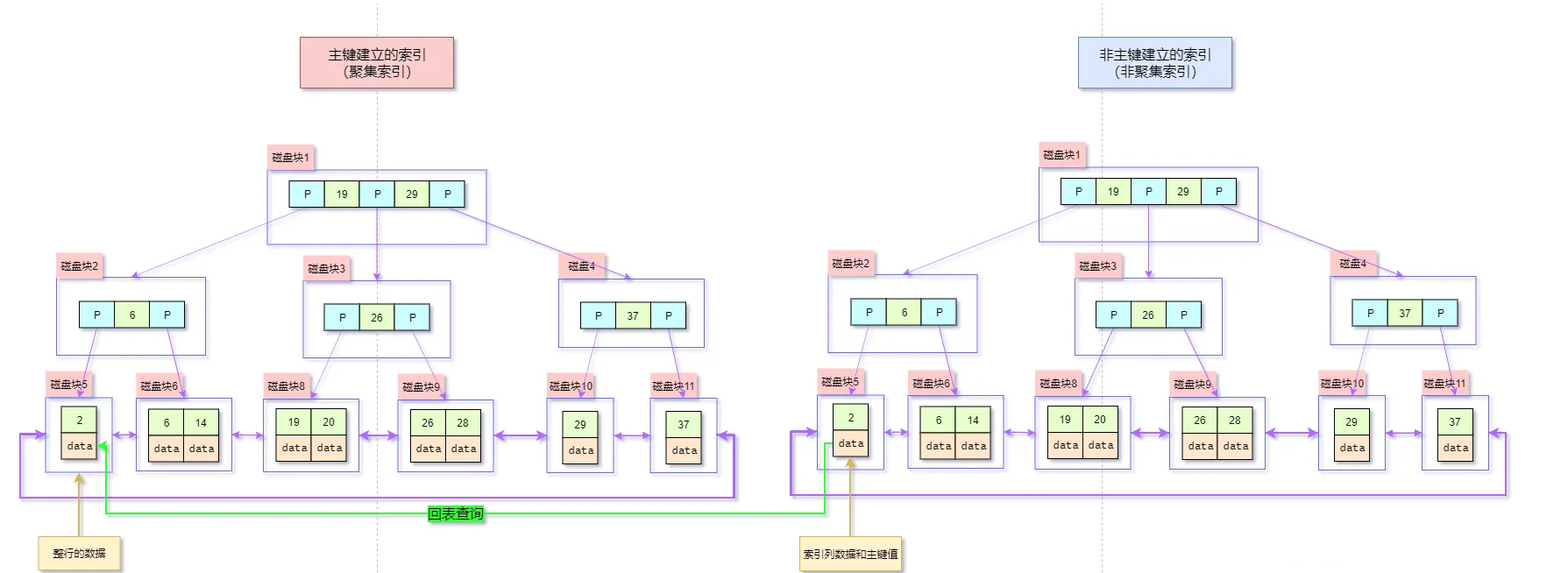

- 41.🌟为什么 InnoDB 要使用 B+树作为索引?

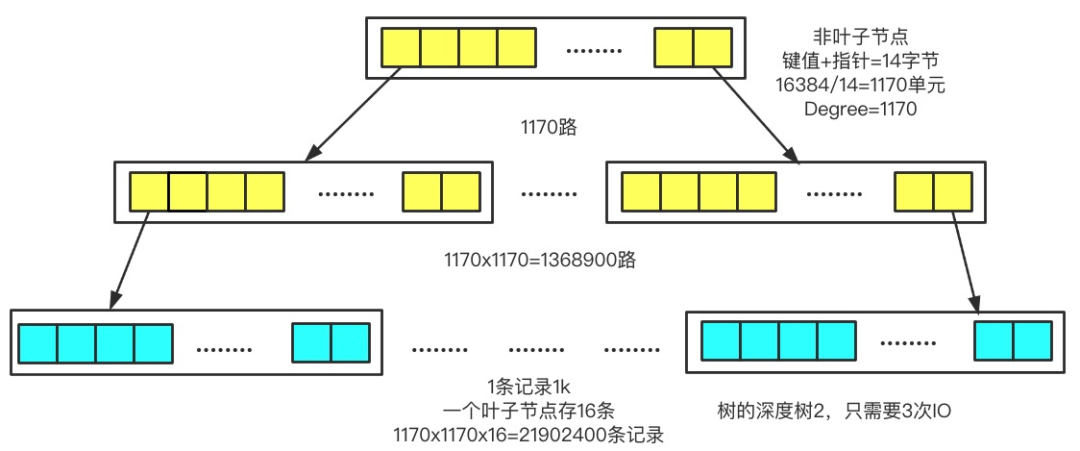

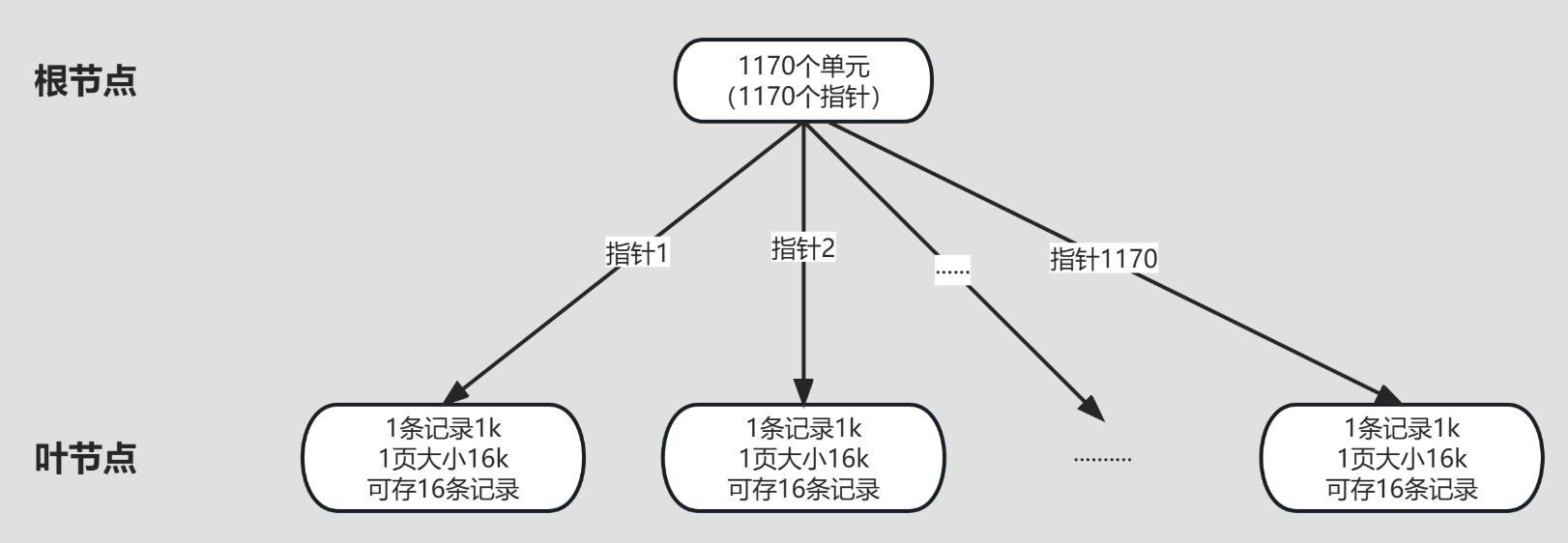

- 42.🌟一棵B+树能存储多少条数据呢?

- 44.🌟为什么用 B+ 树而不用 B 树呢?

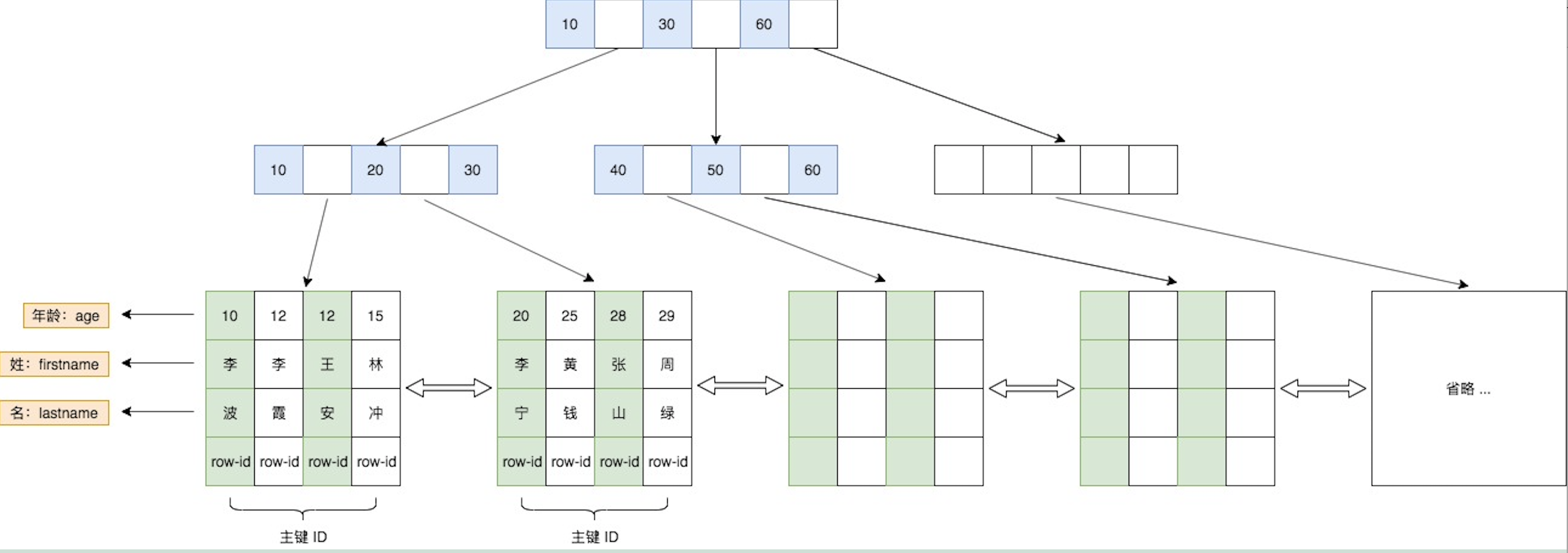

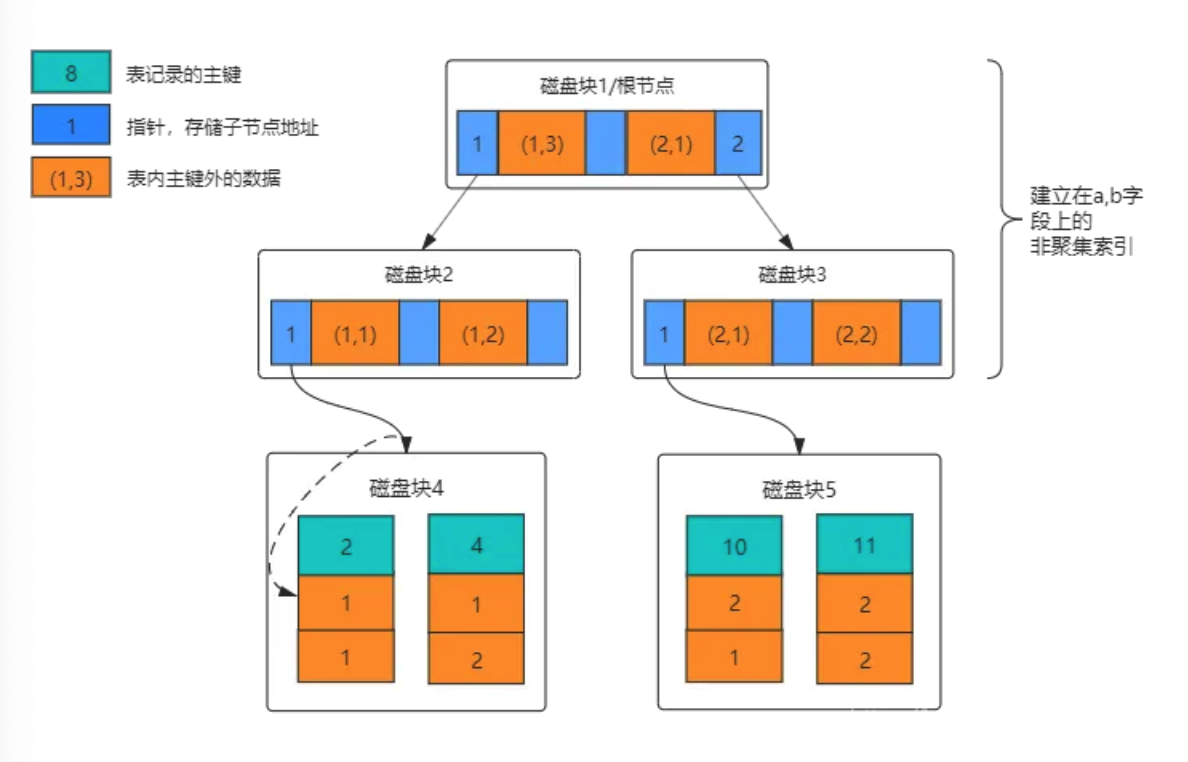

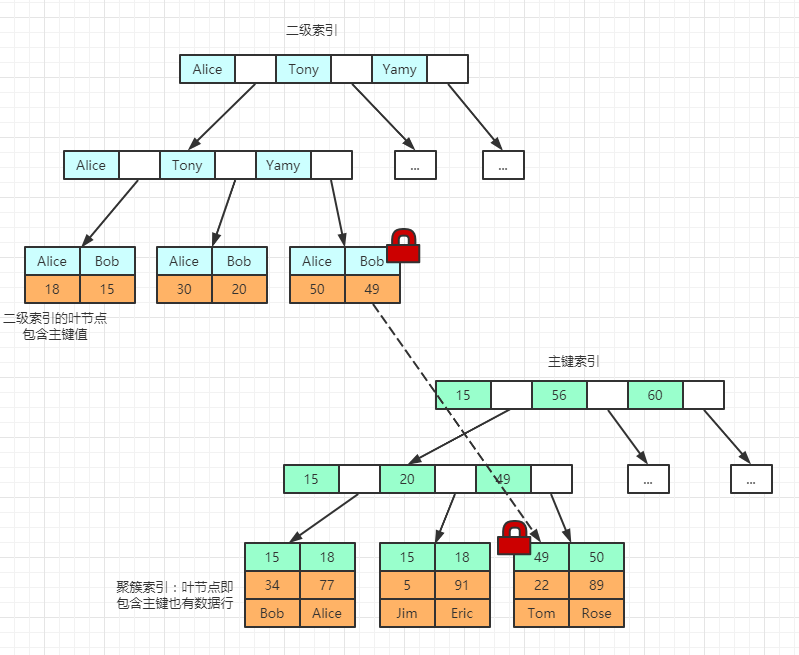

- 46.🌟聚族索引和非聚族索引有什么区别?

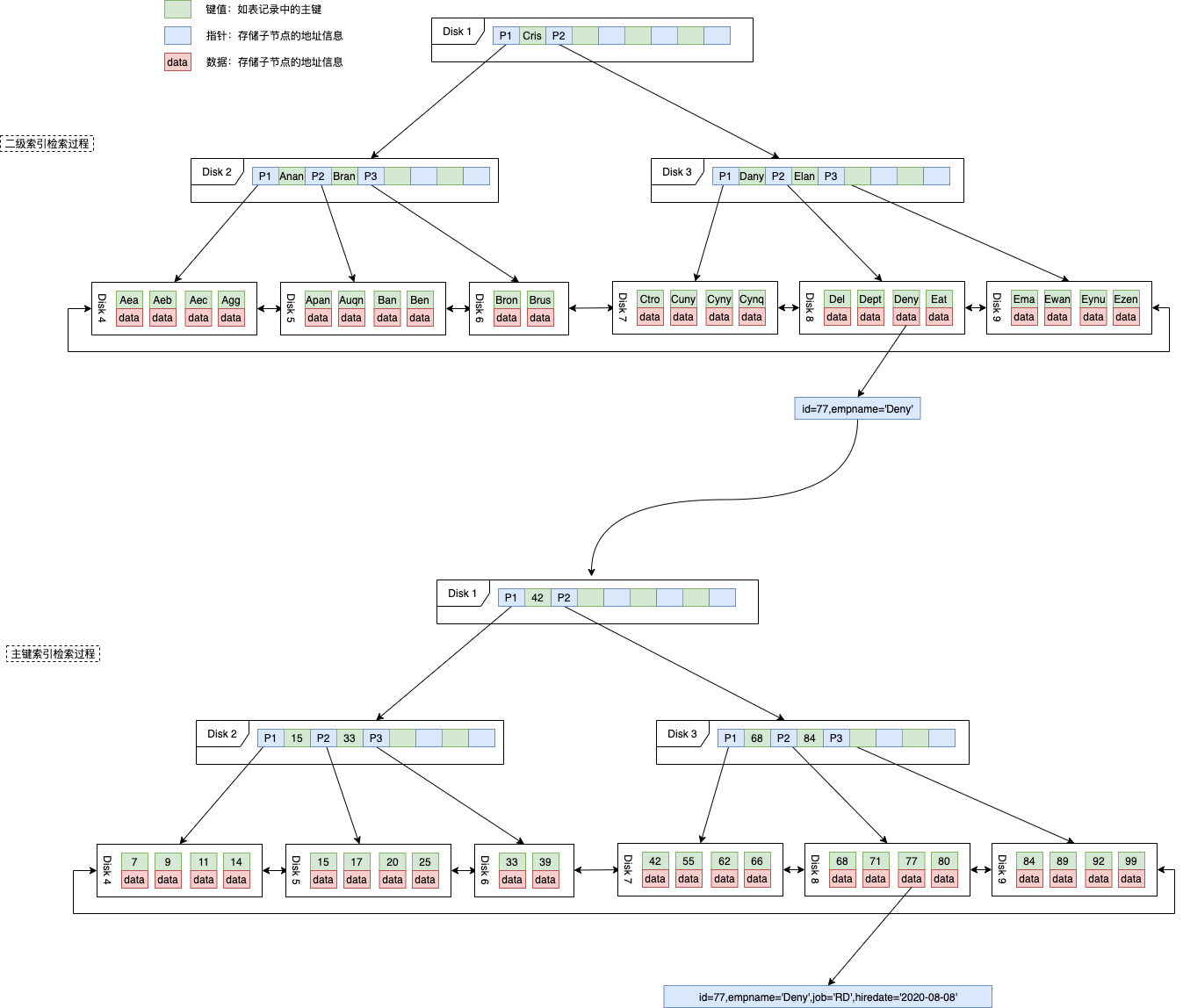

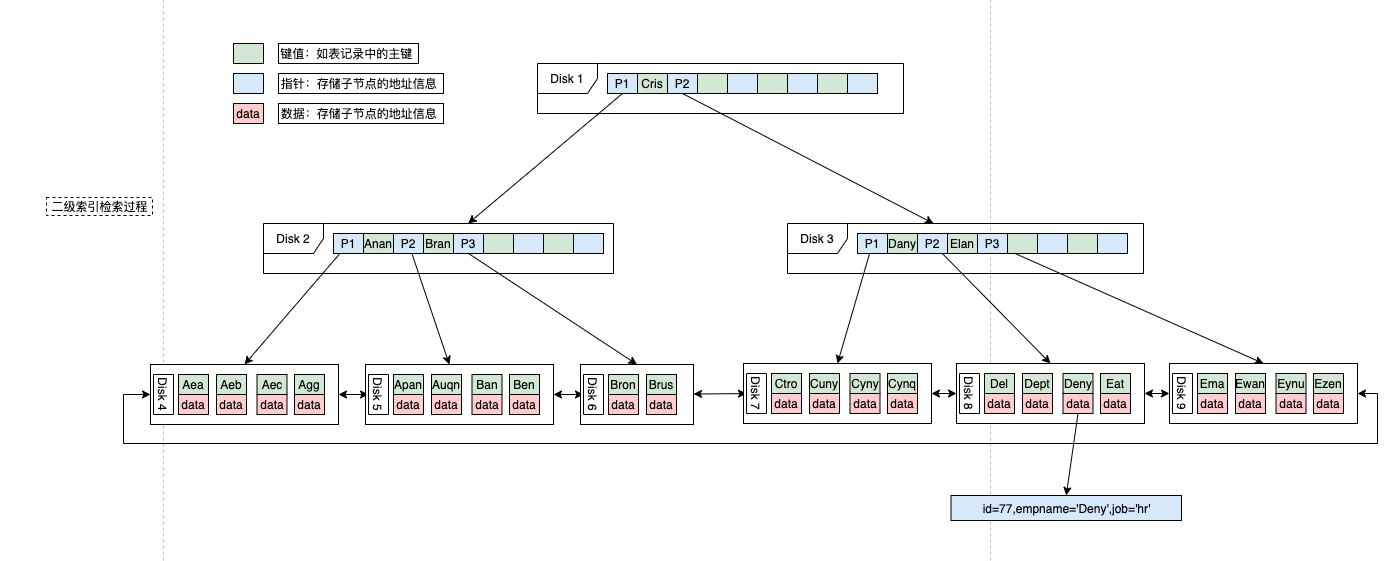

- 47.🌟回表了解吗?

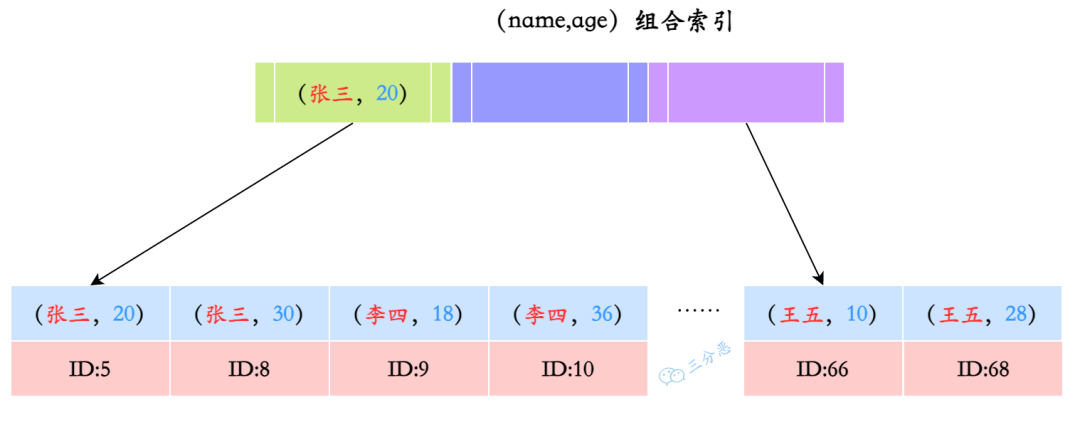

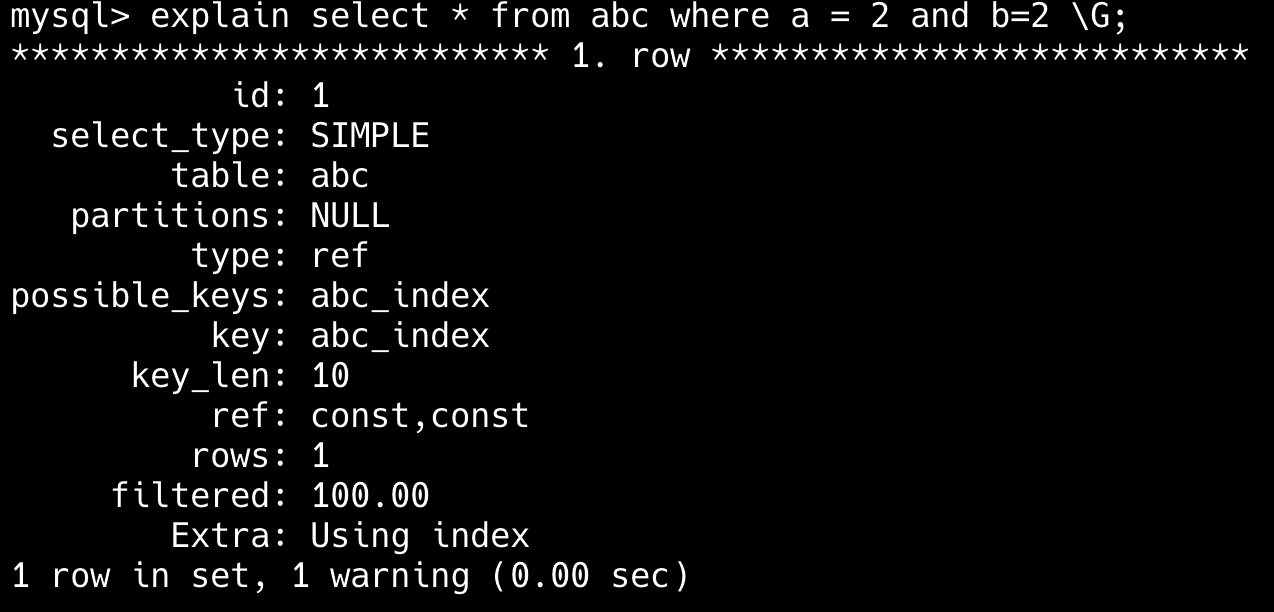

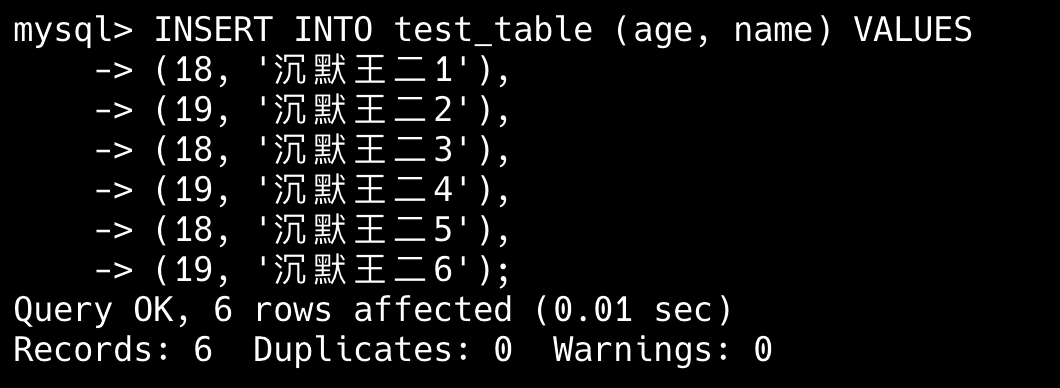

- 48.🌟联合索引了解吗?(补充)

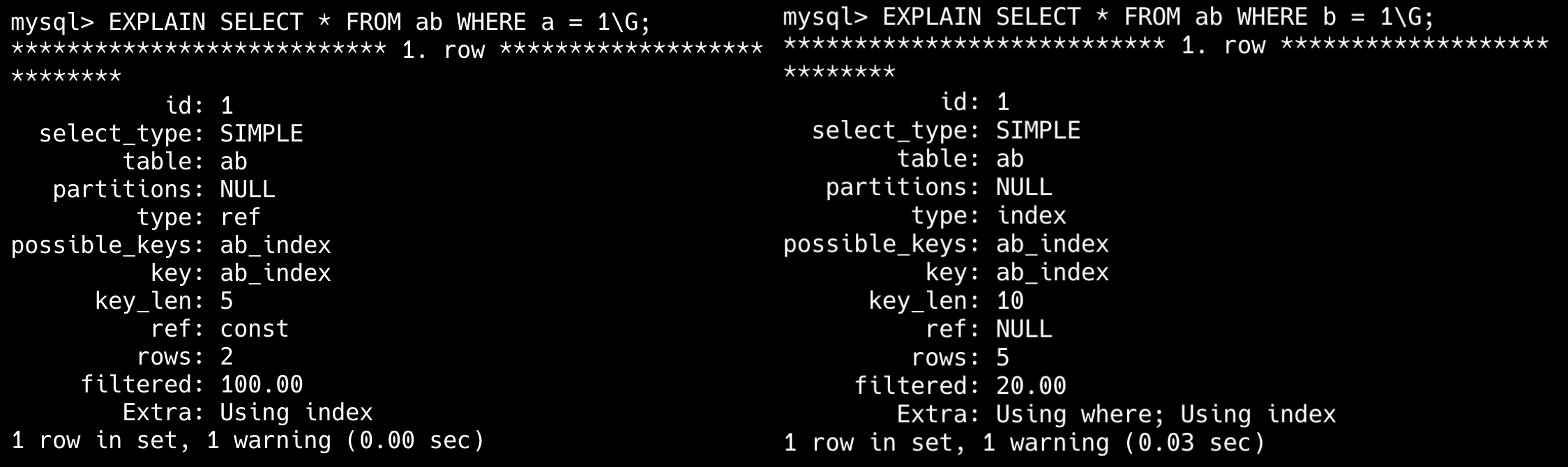

- 50.🌟什么是最左前缀原则?

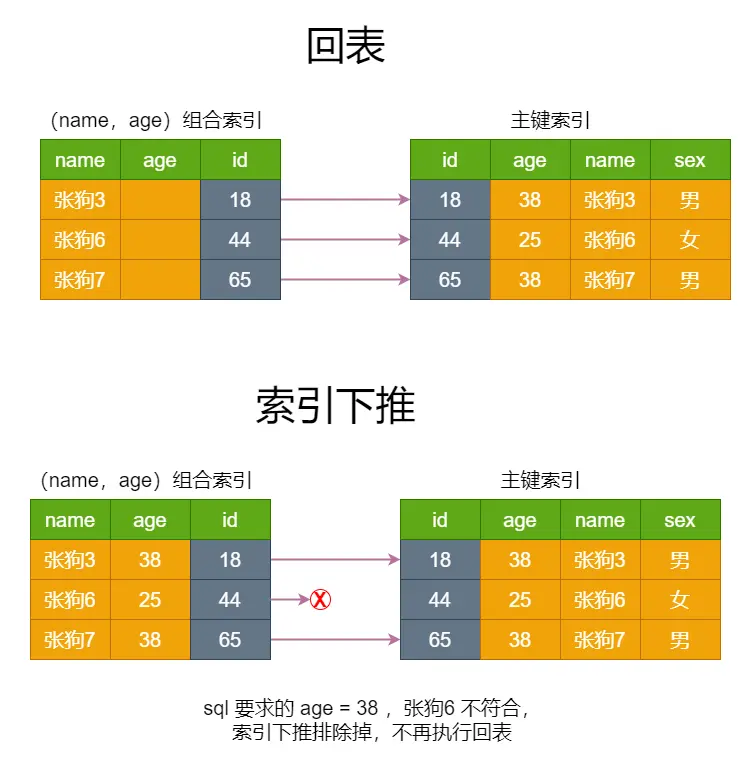

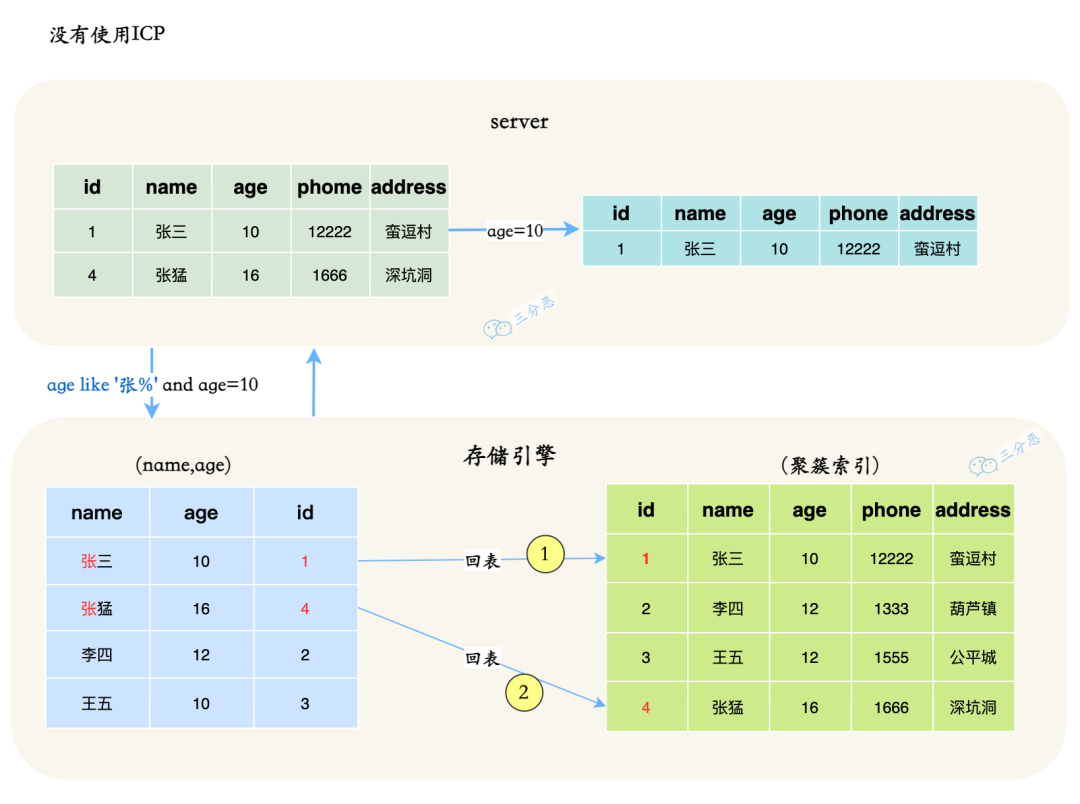

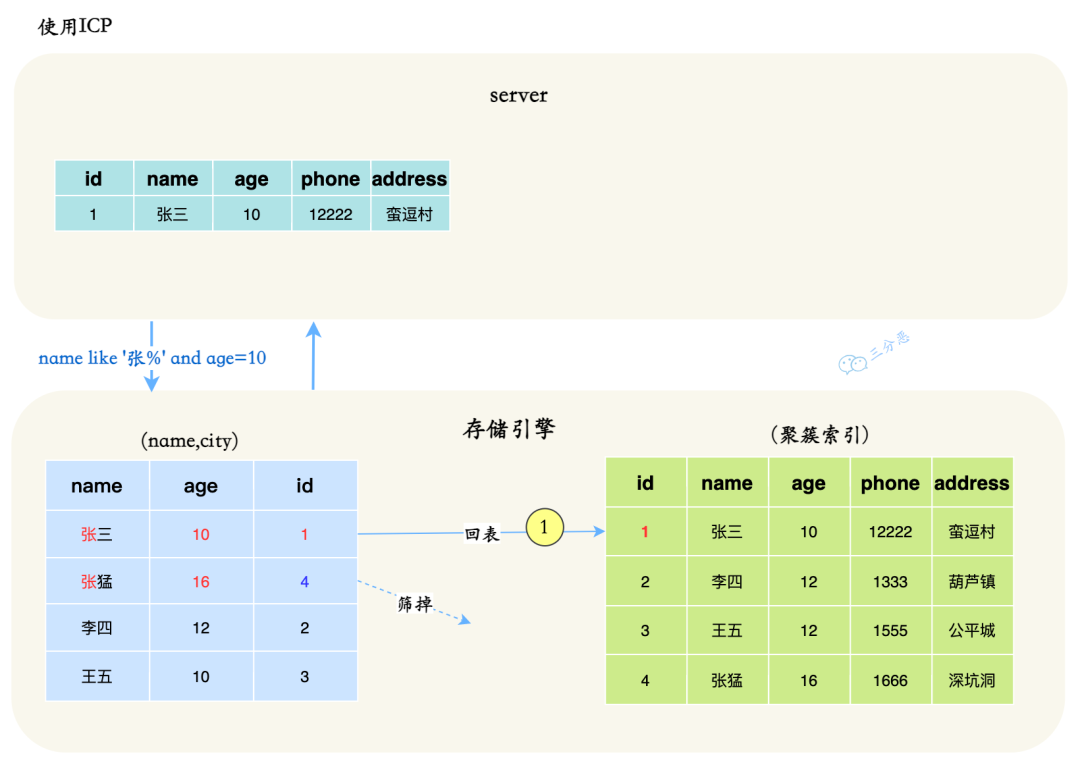

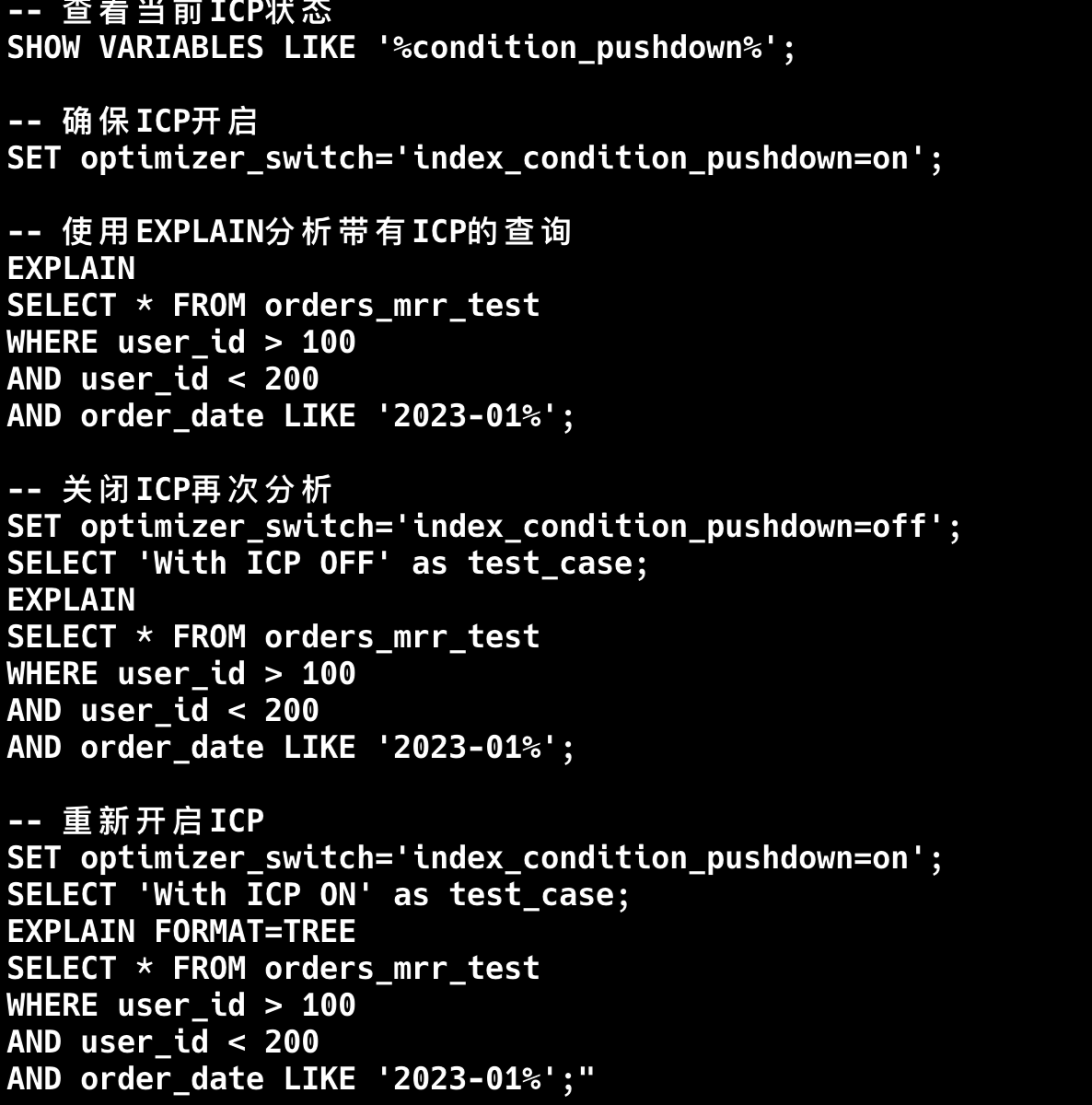

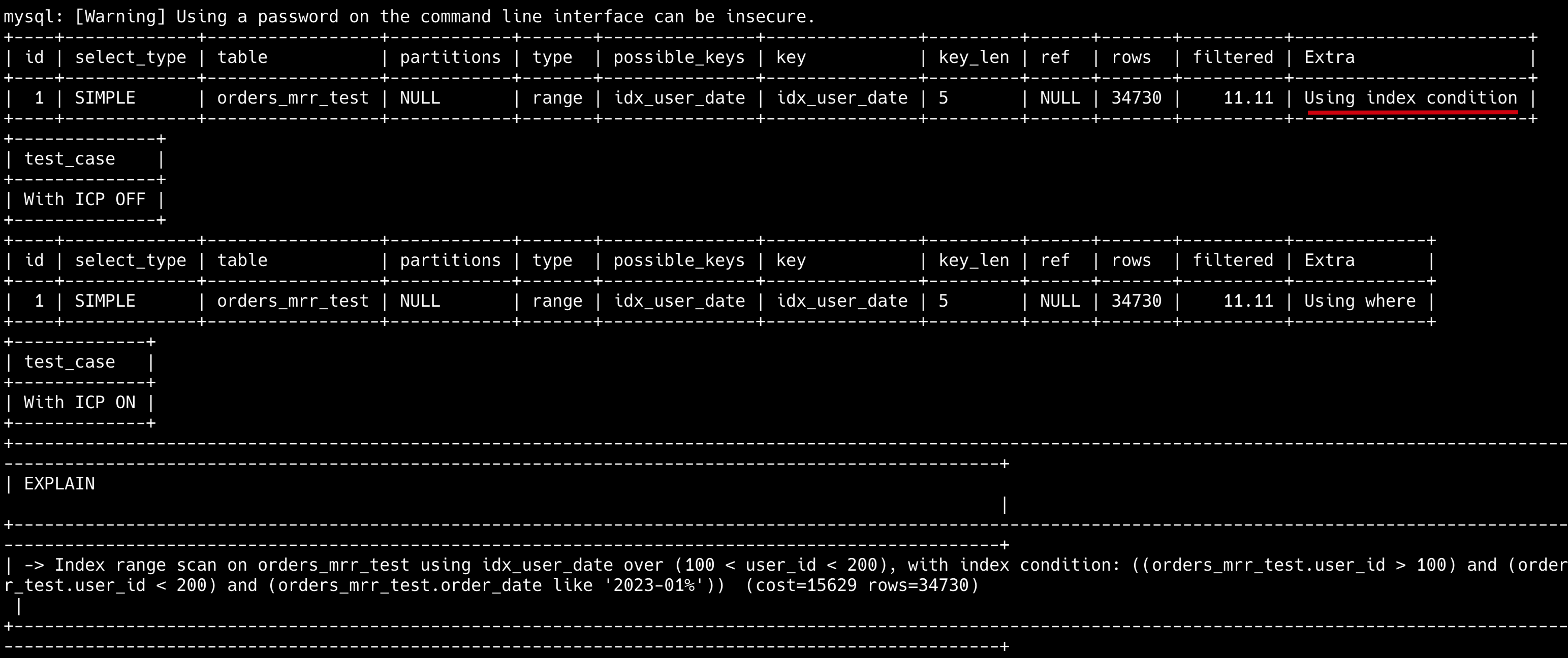

- 51.🌟什么是索引下推?

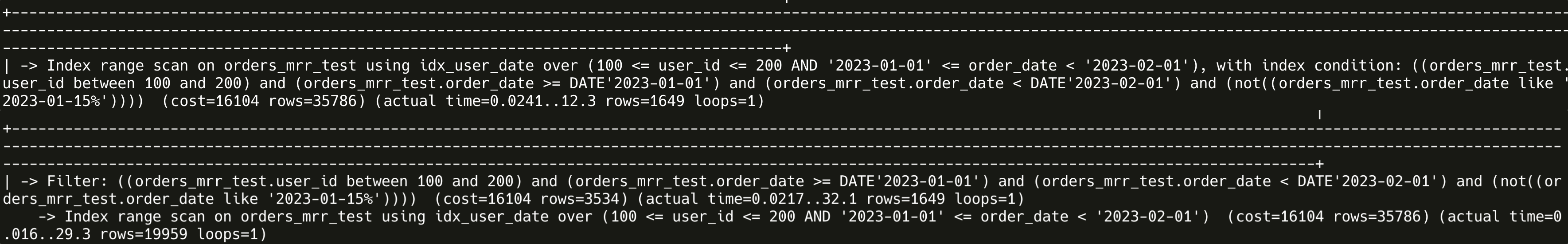

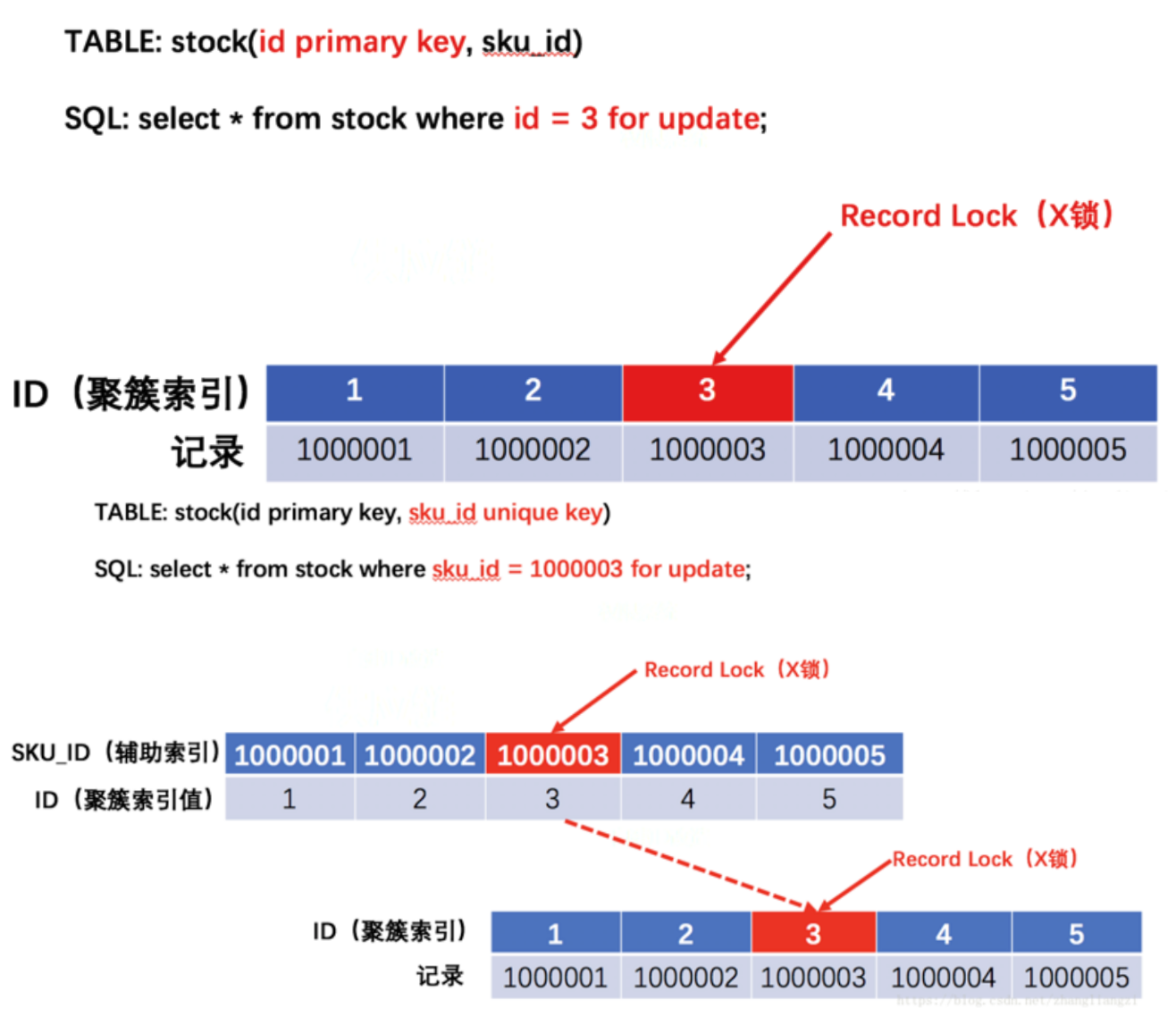

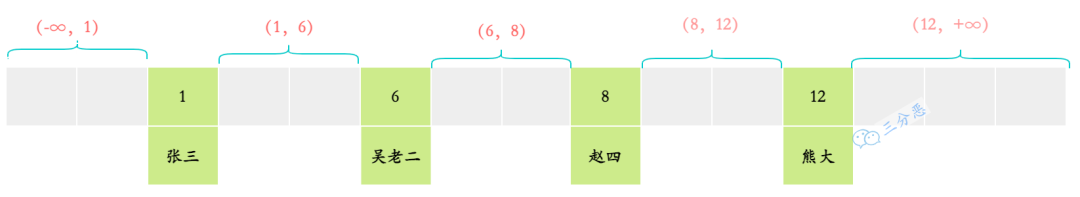

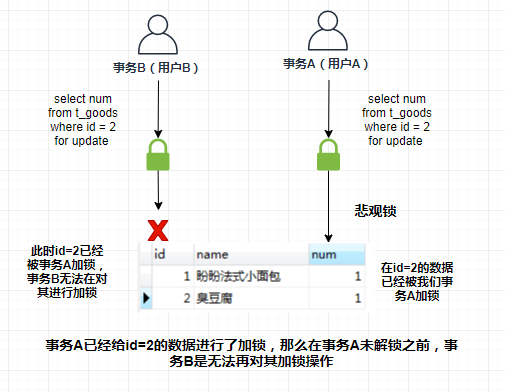

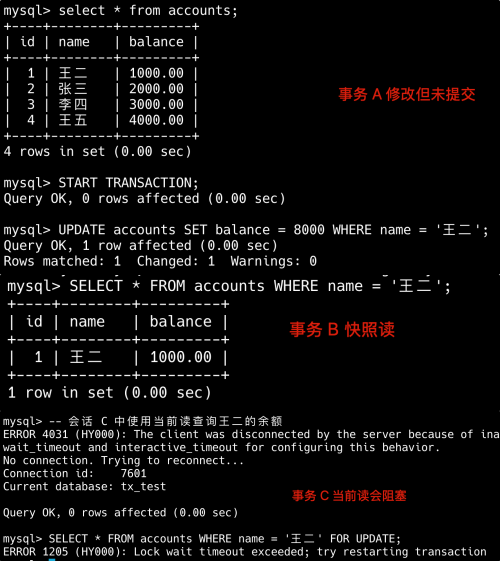

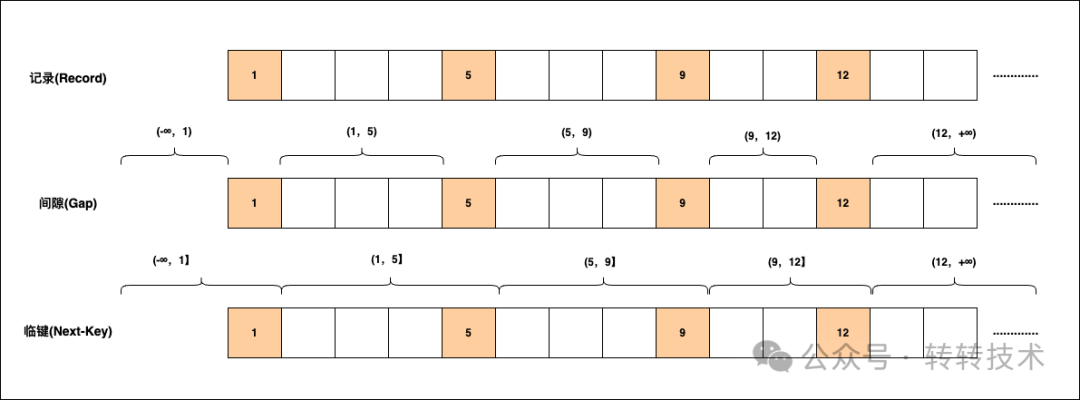

- 53.🌟MySQL 中有哪几种锁?

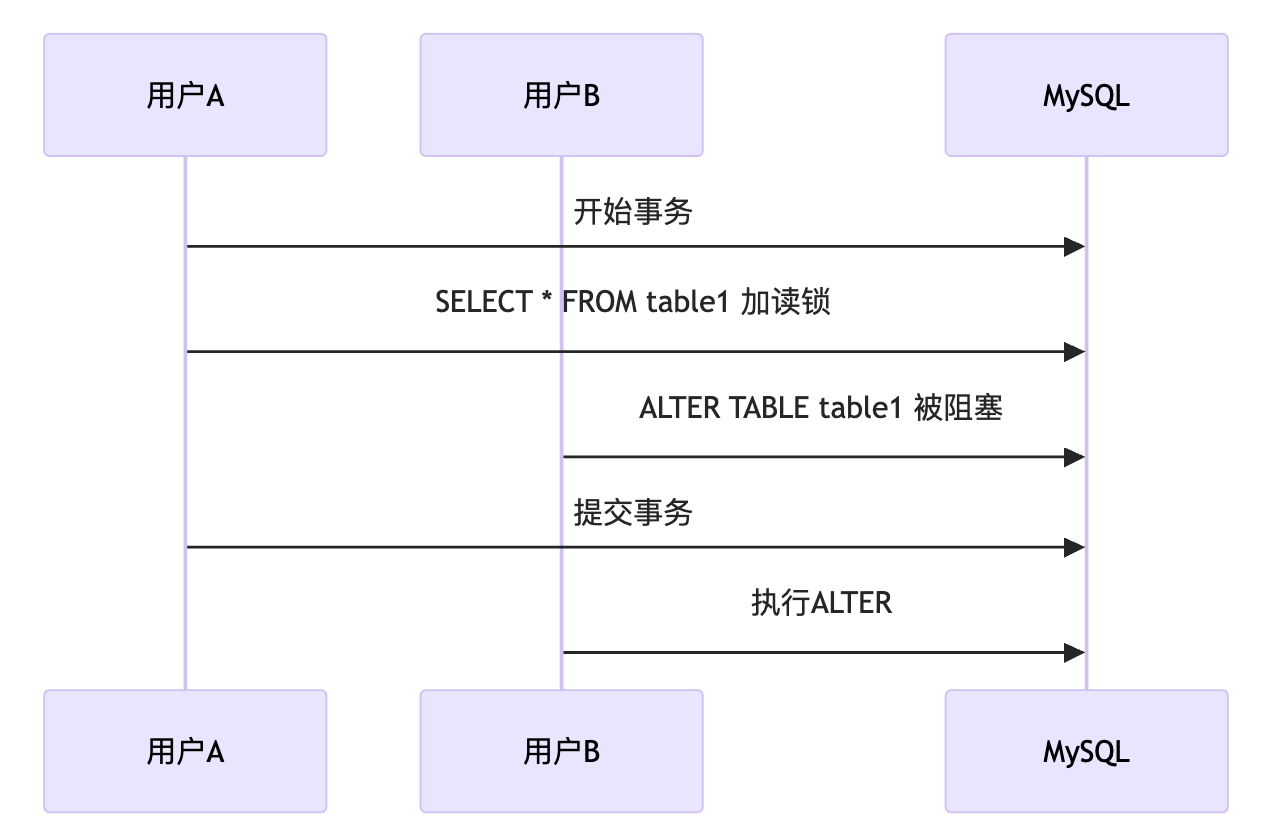

- 55.🌟说说 MySQL 的行锁?

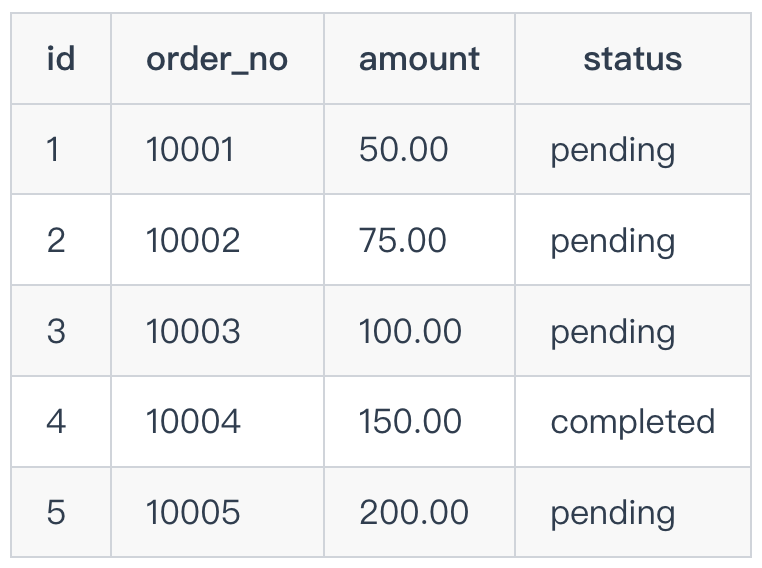

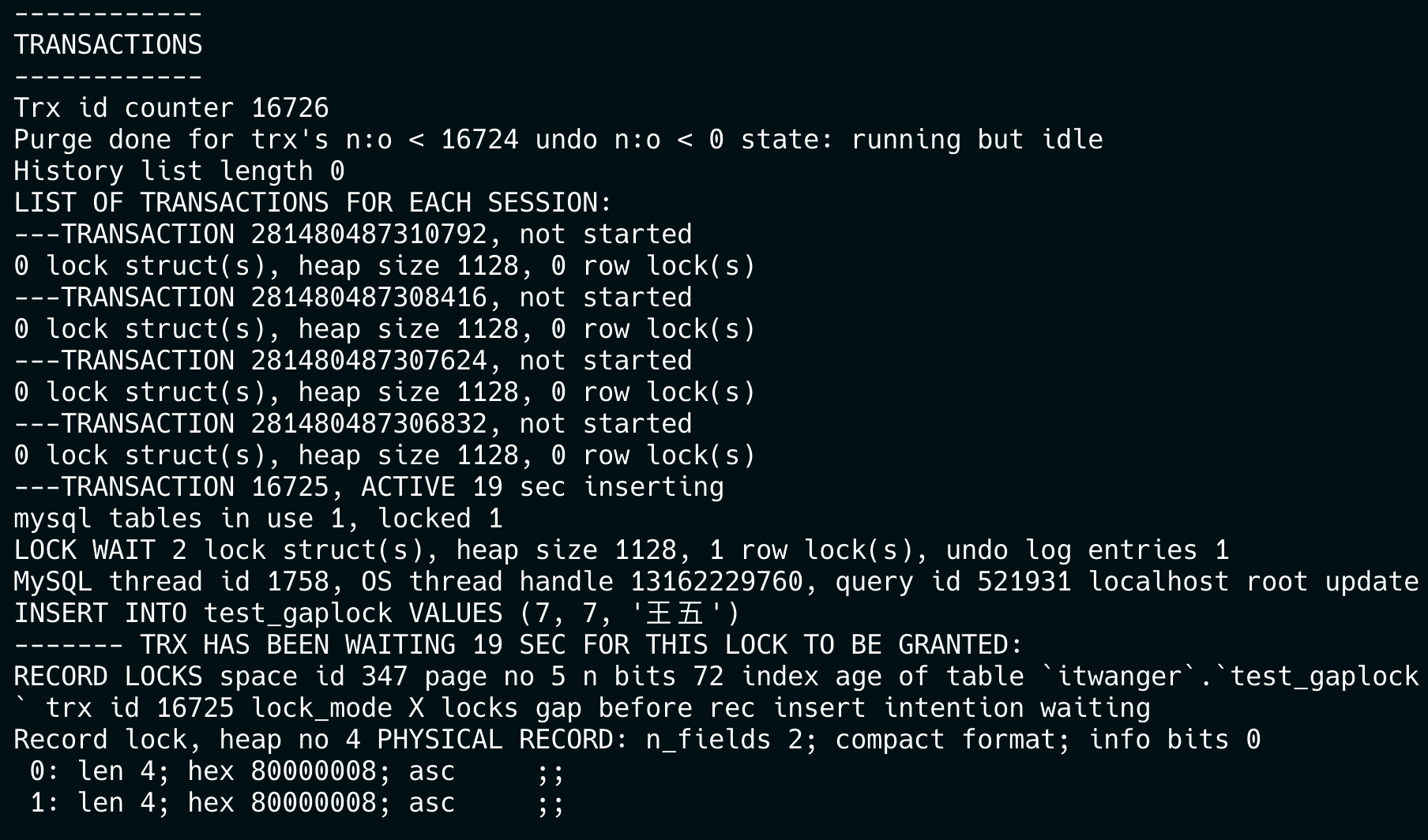

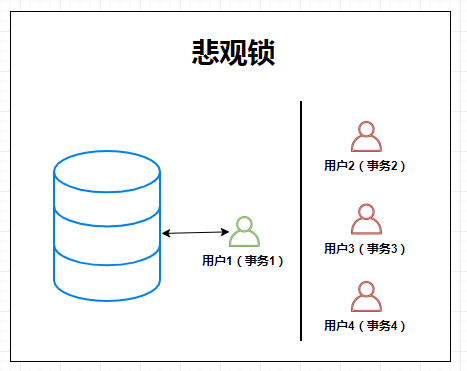

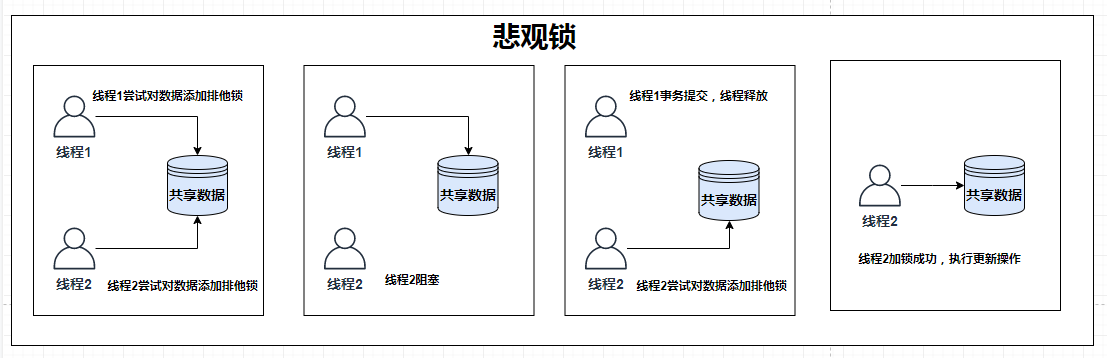

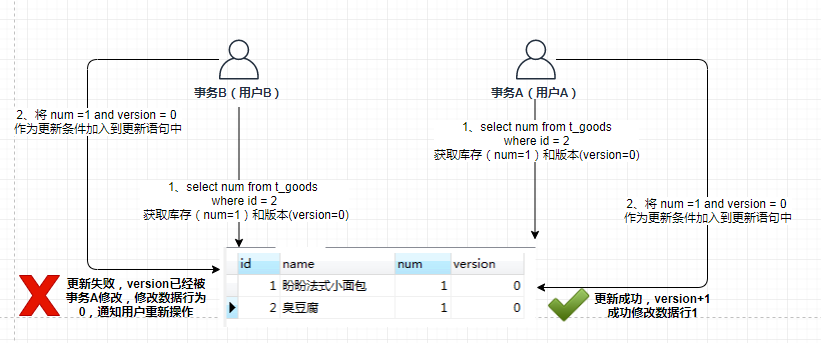

- 58.🌟MySQL的乐观锁和悲观锁了解吗?

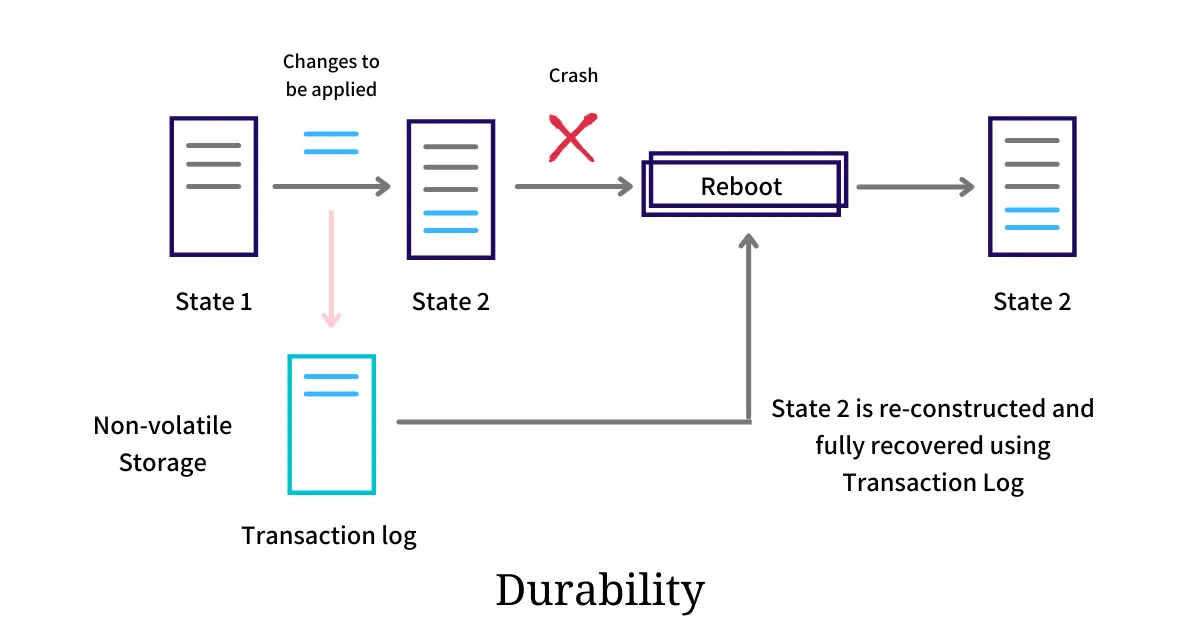

- 60.🌟MySQL事务的四大特性说一下?

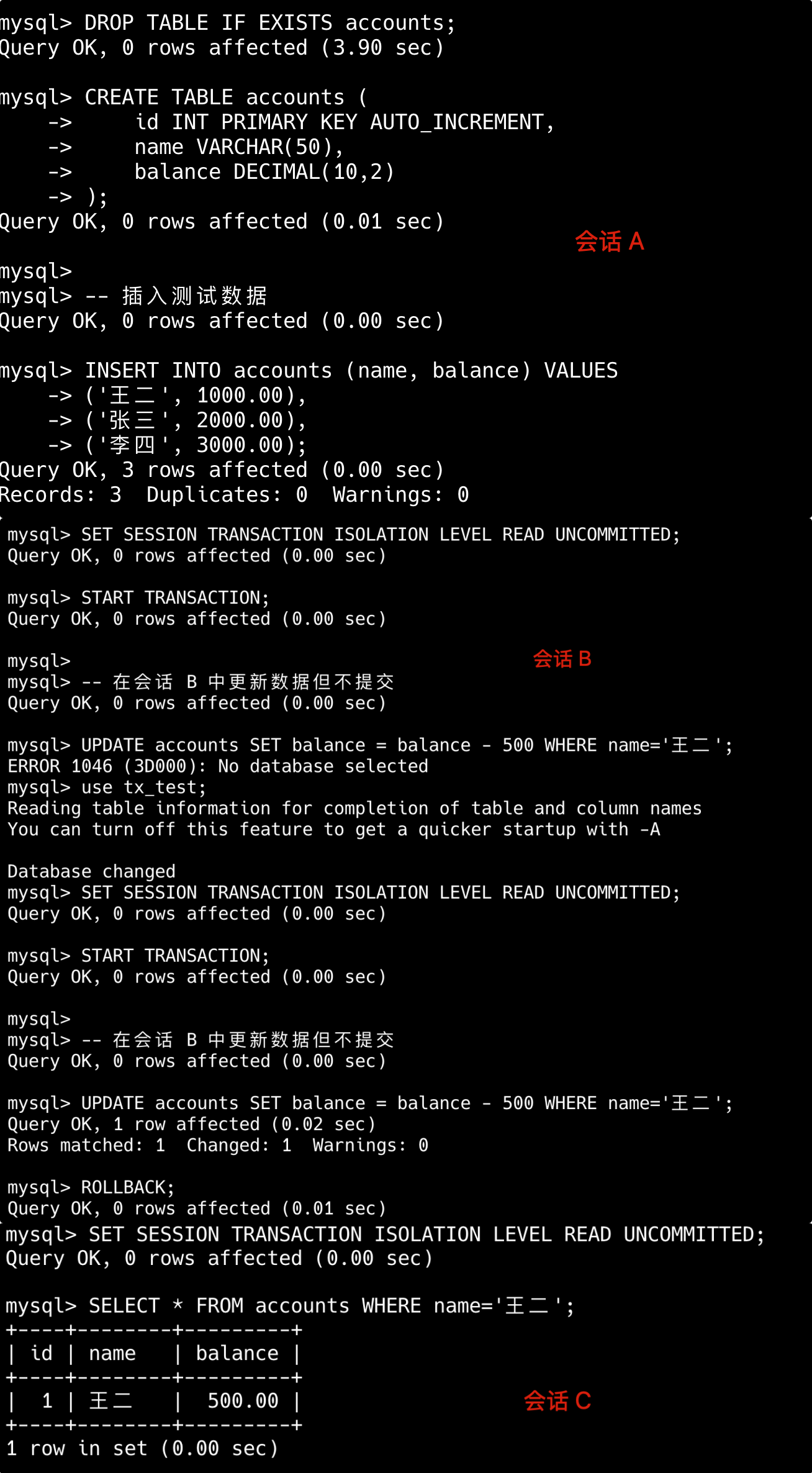

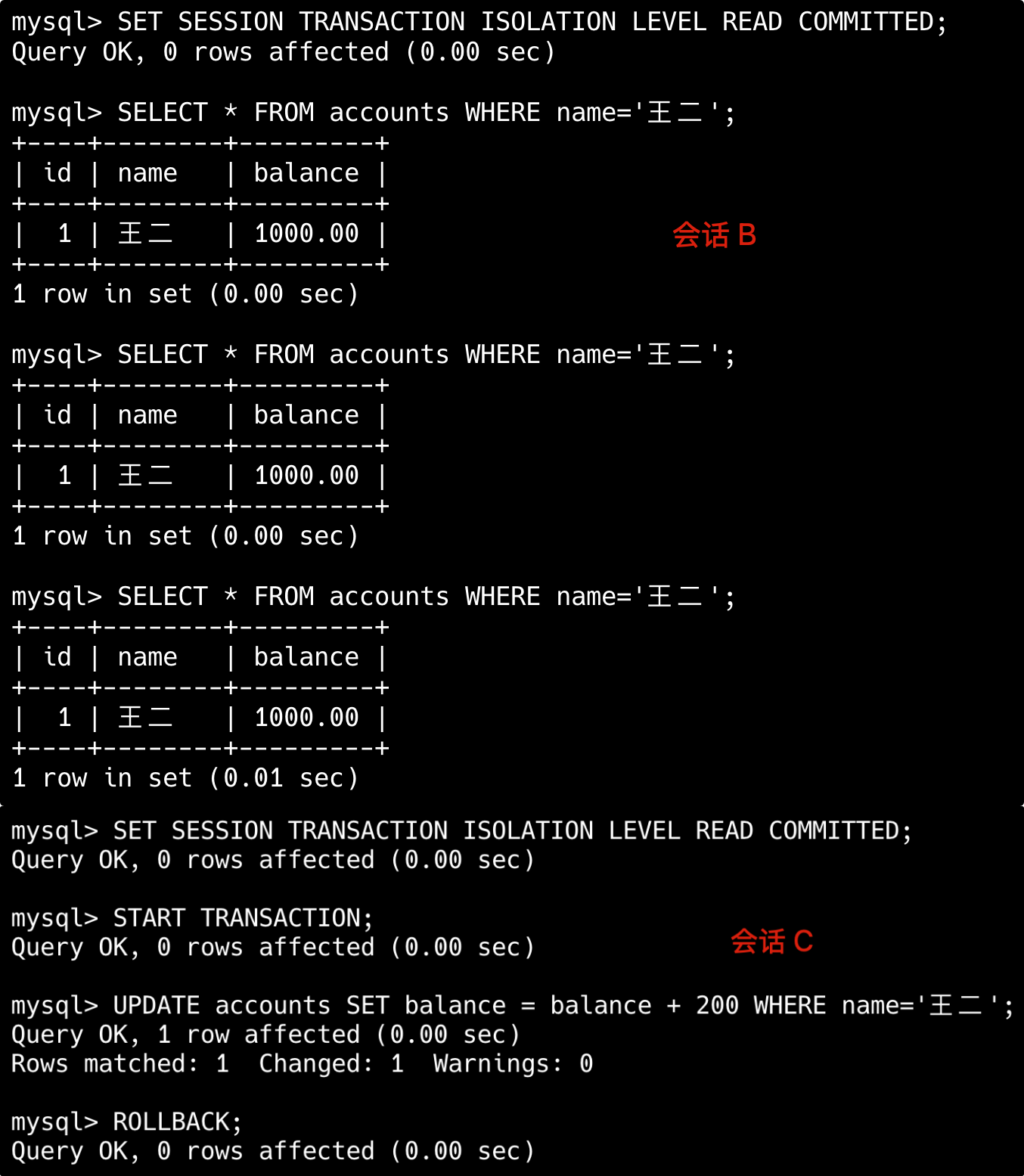

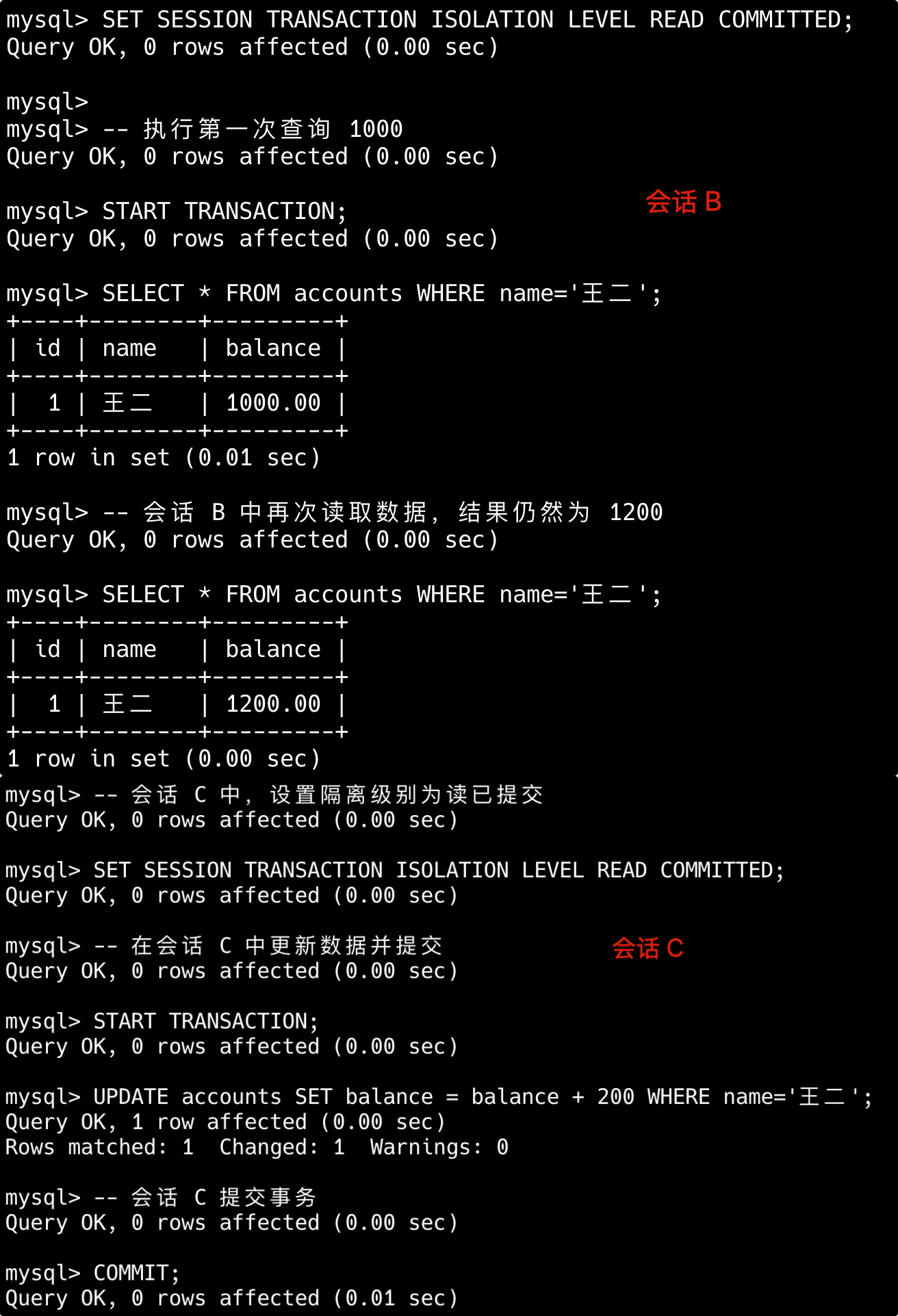

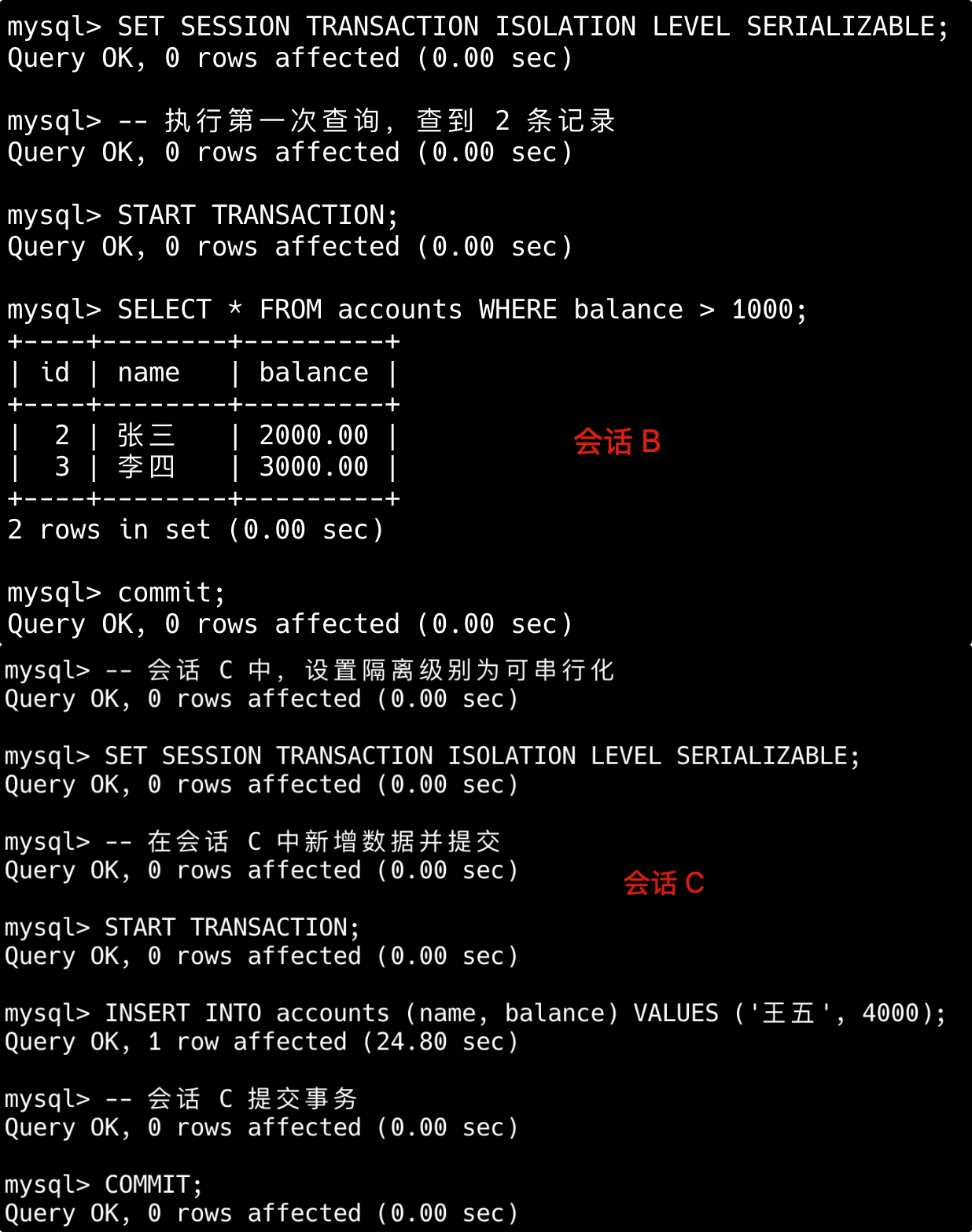

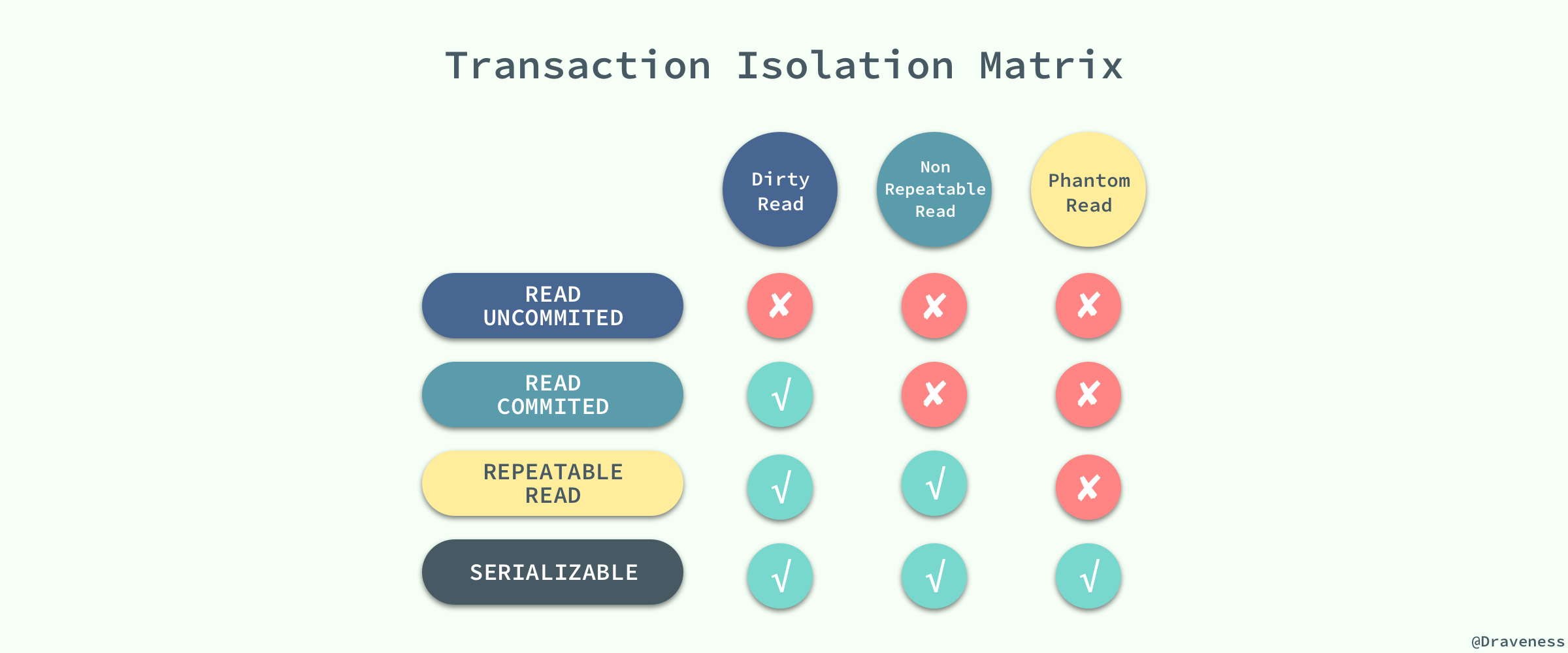

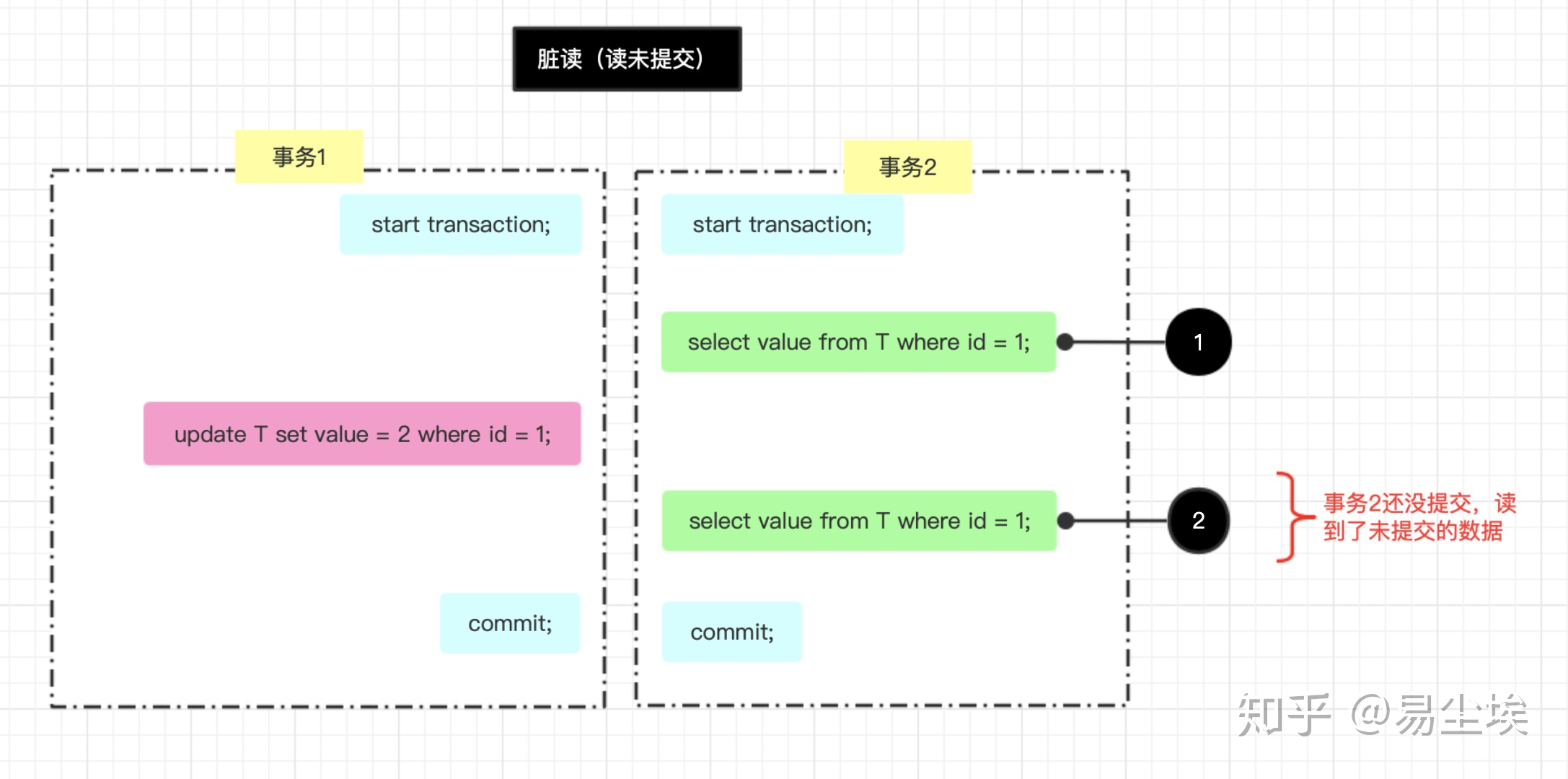

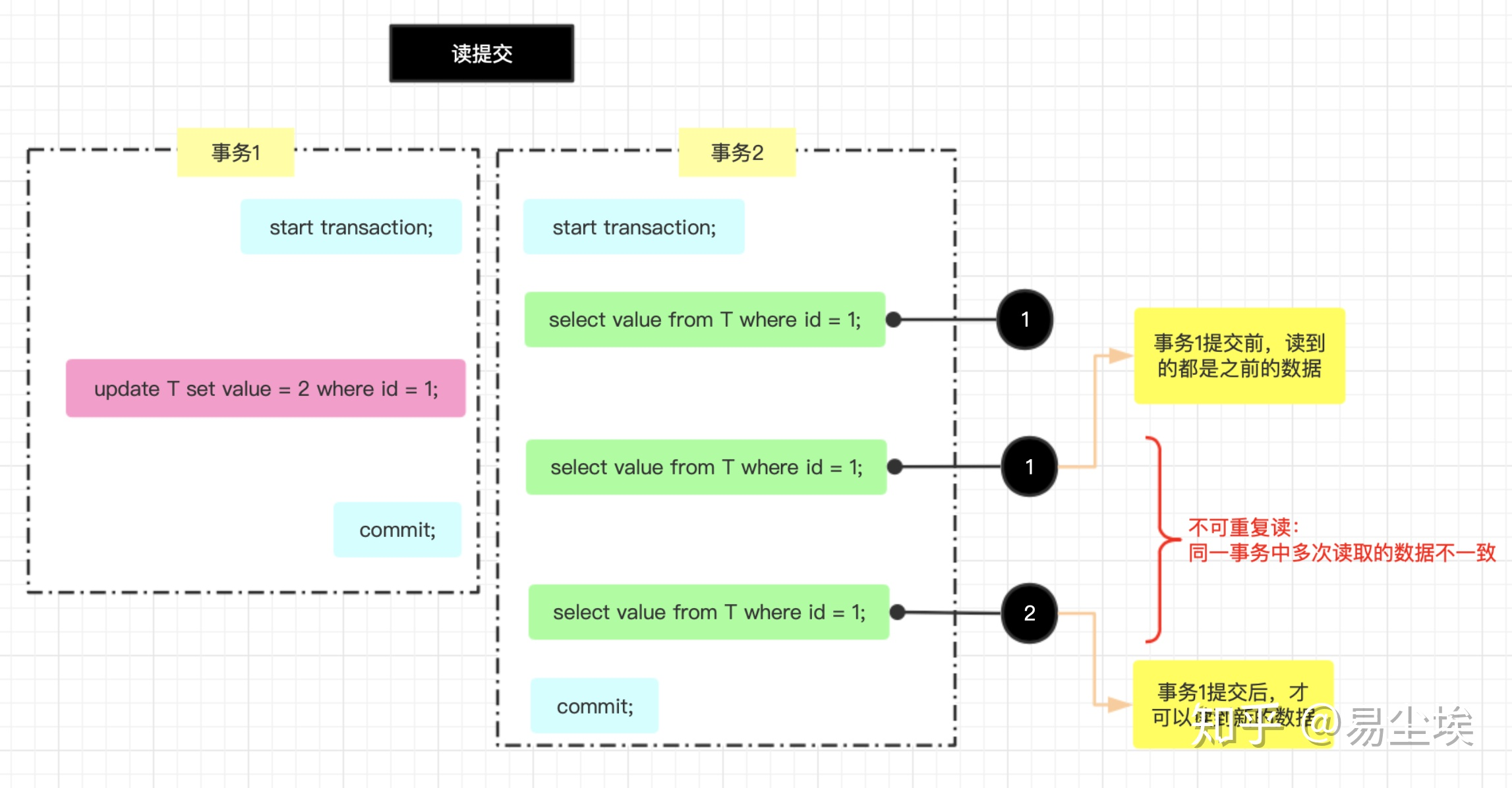

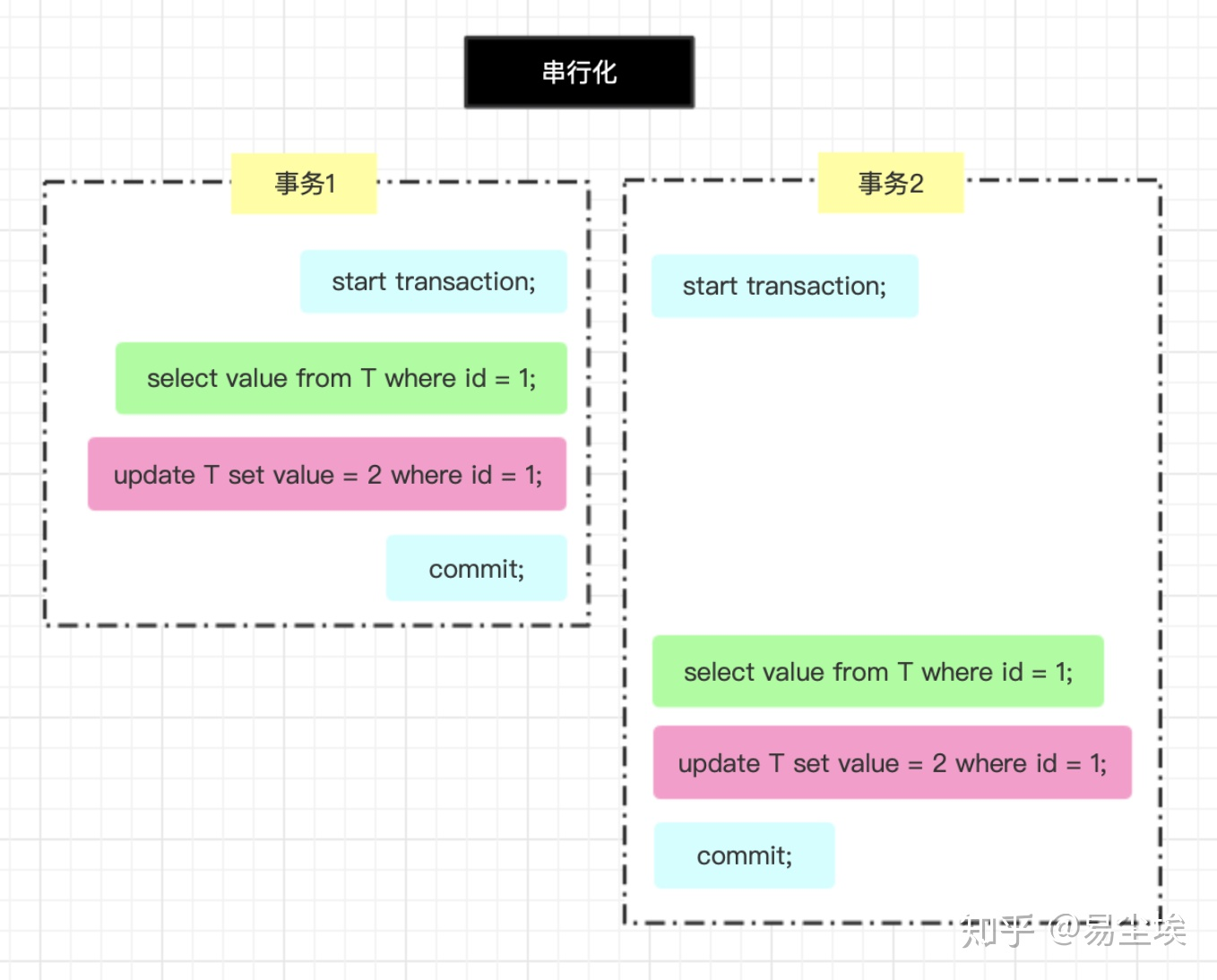

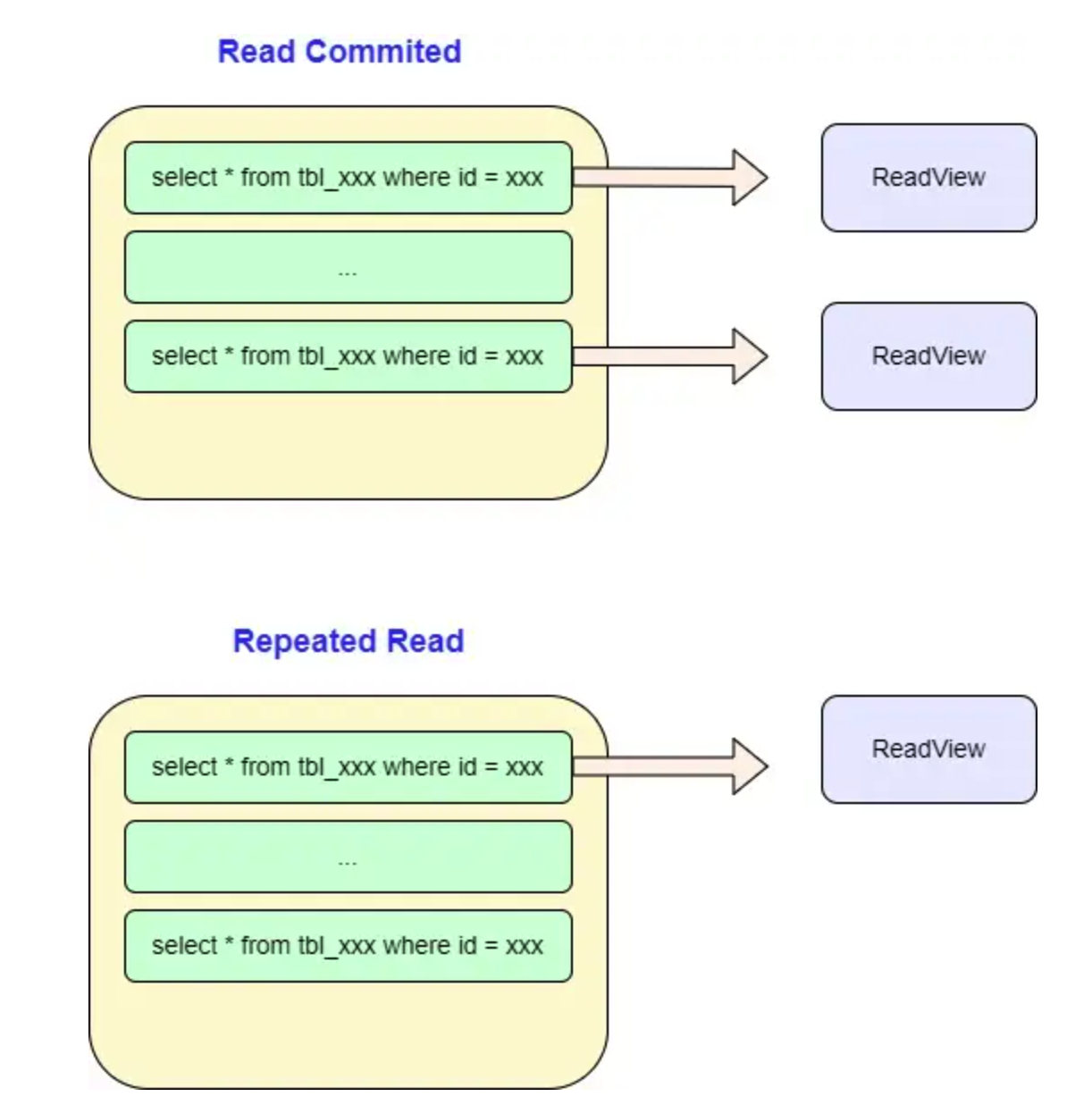

- 62.🌟事务的隔离级别有哪些?

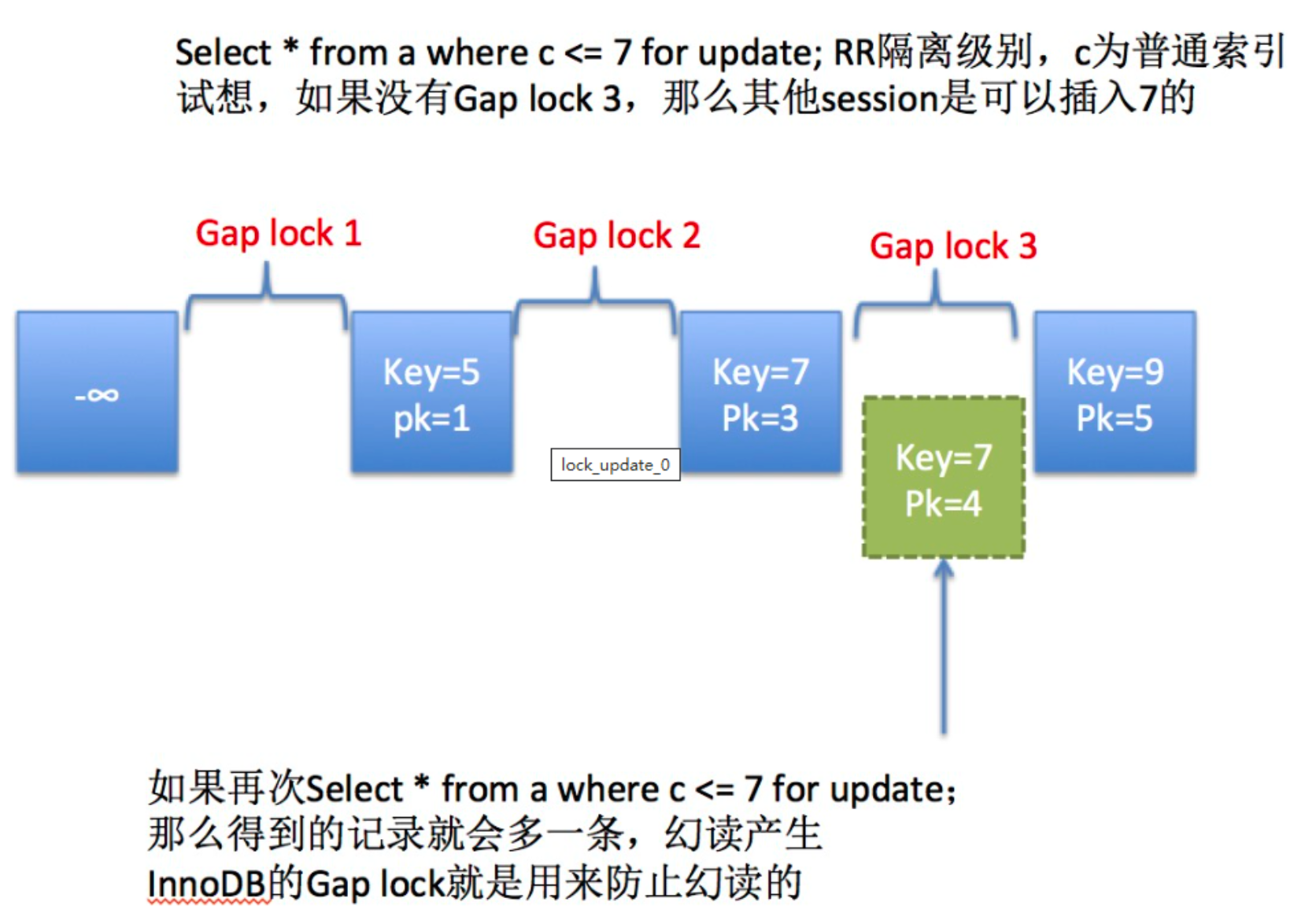

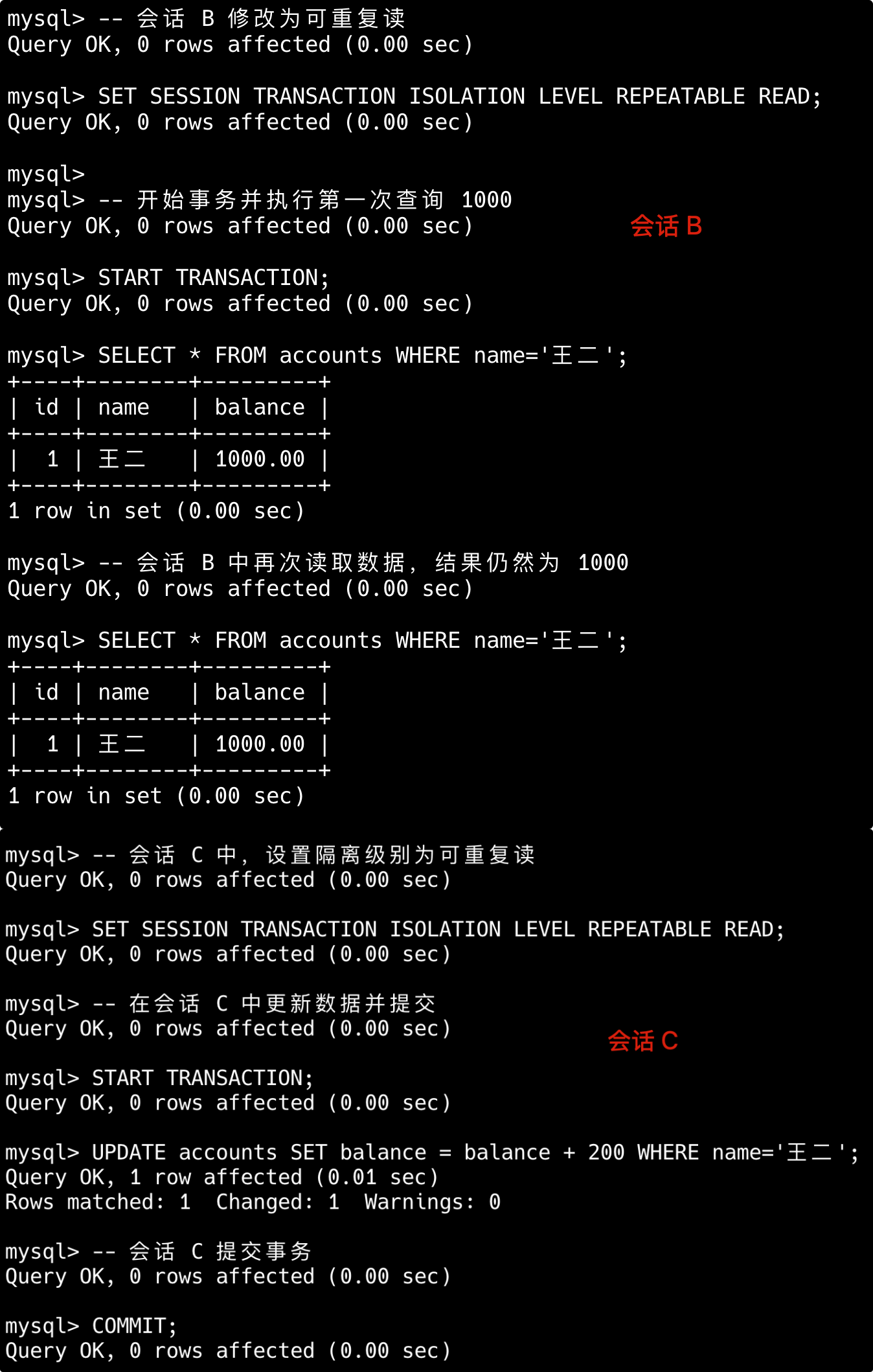

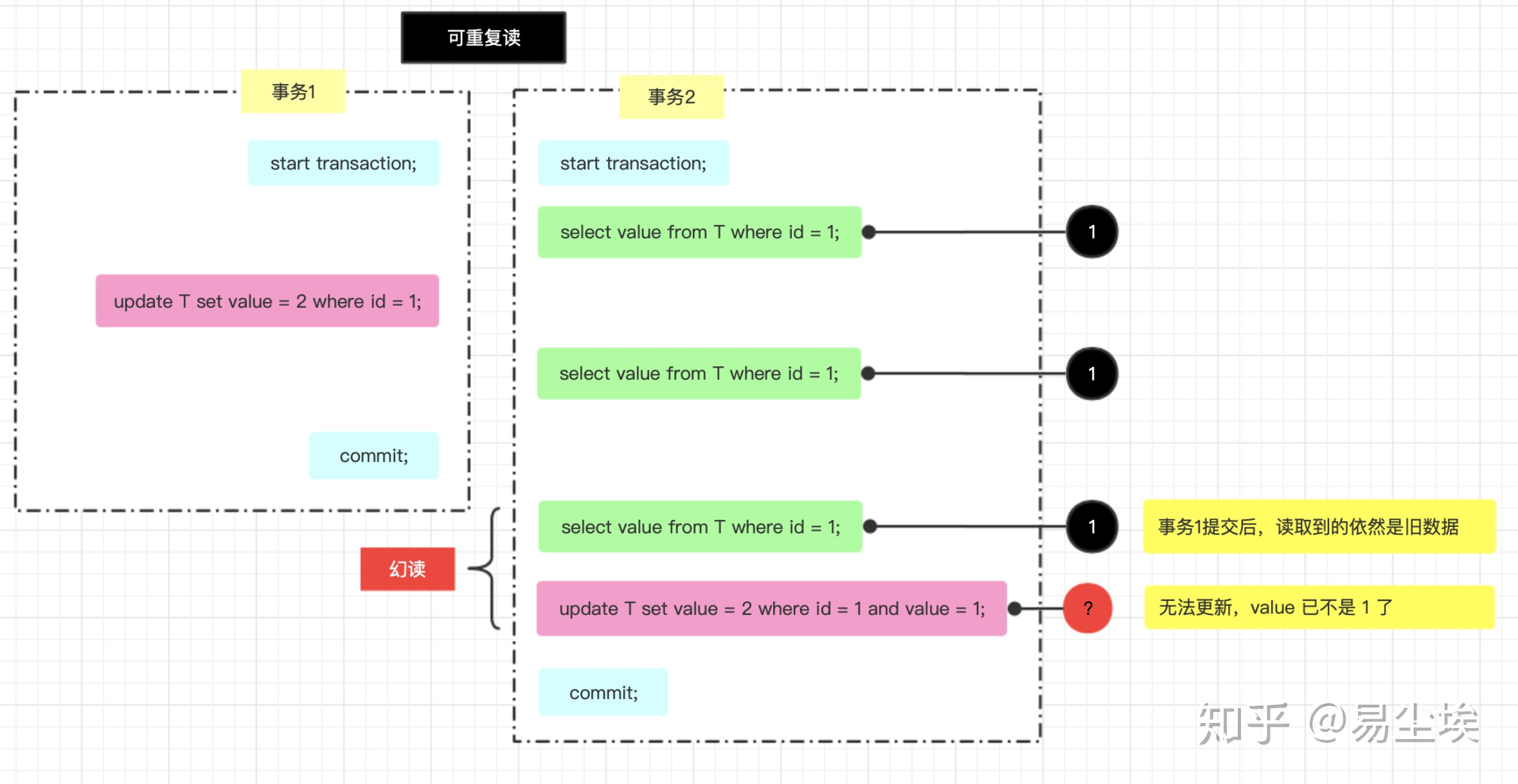

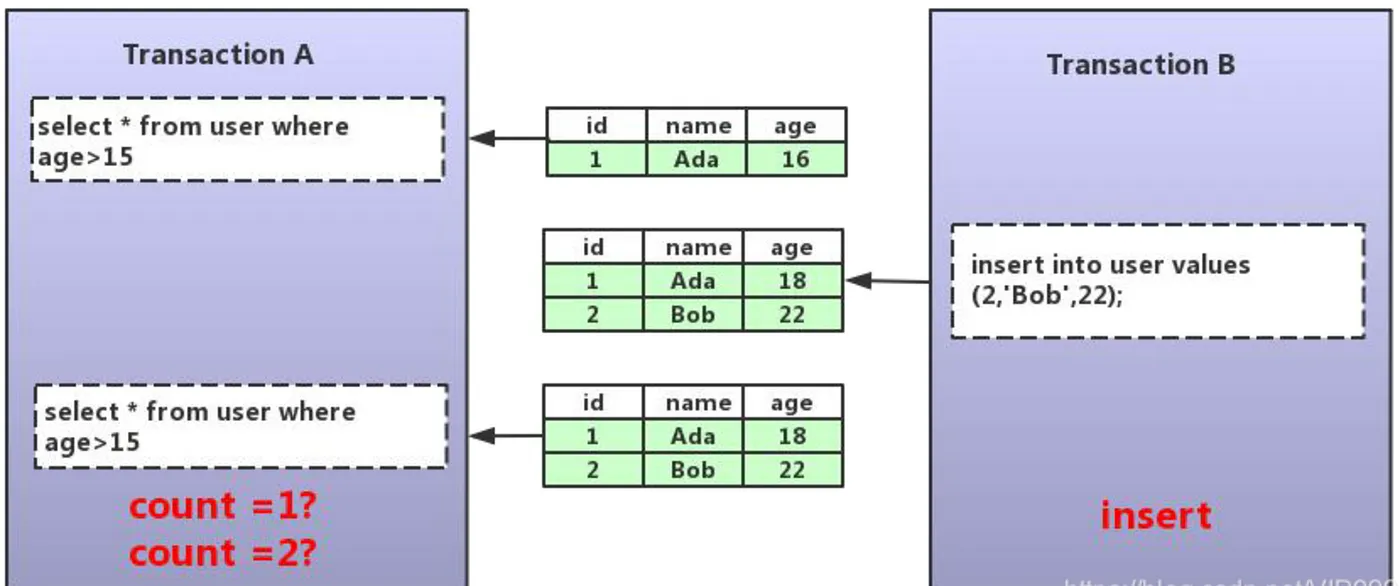

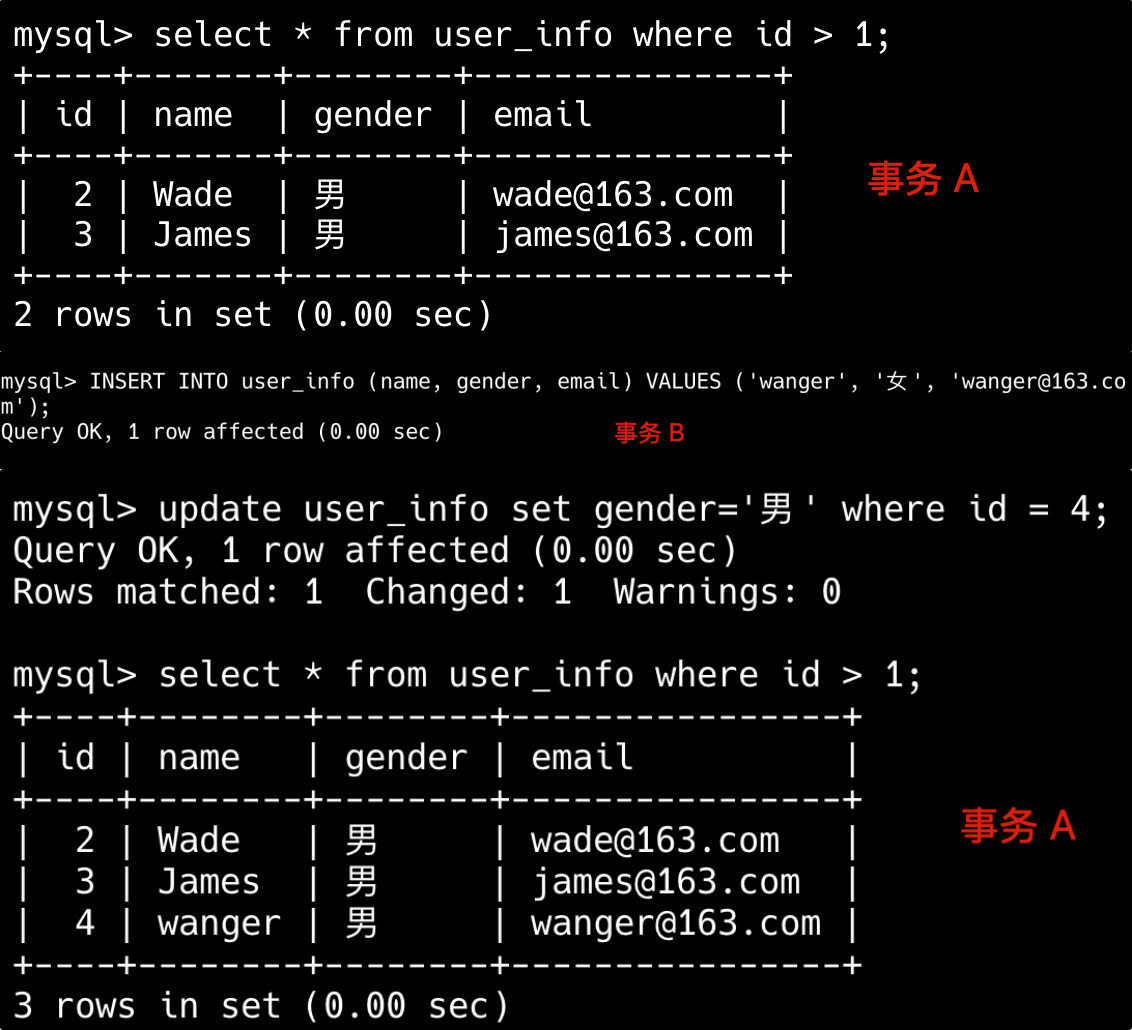

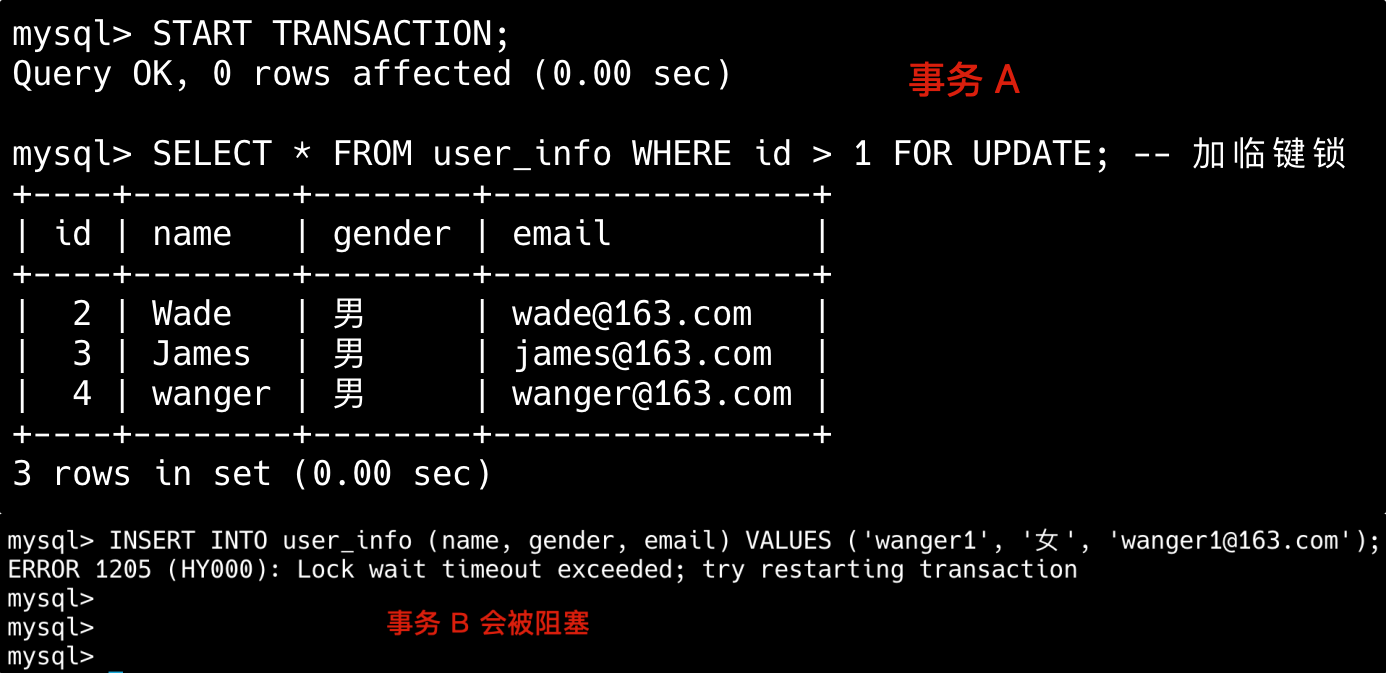

- 64.🌟请详细说说幻读呢?

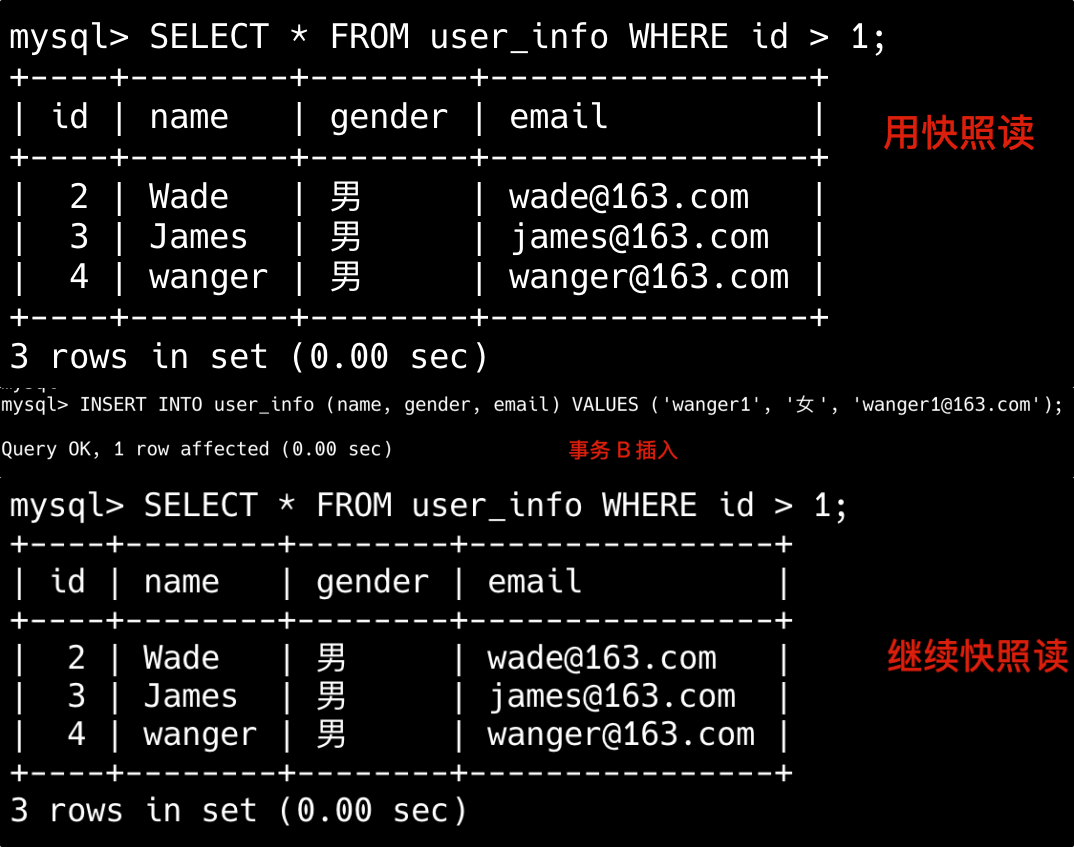

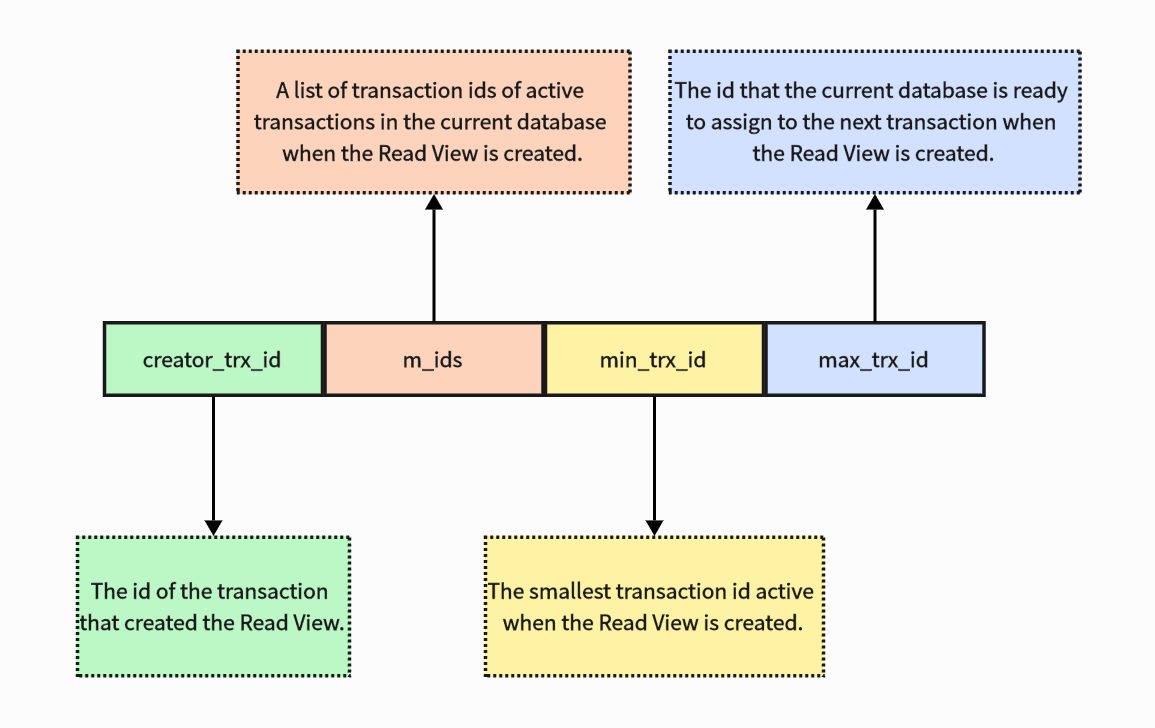

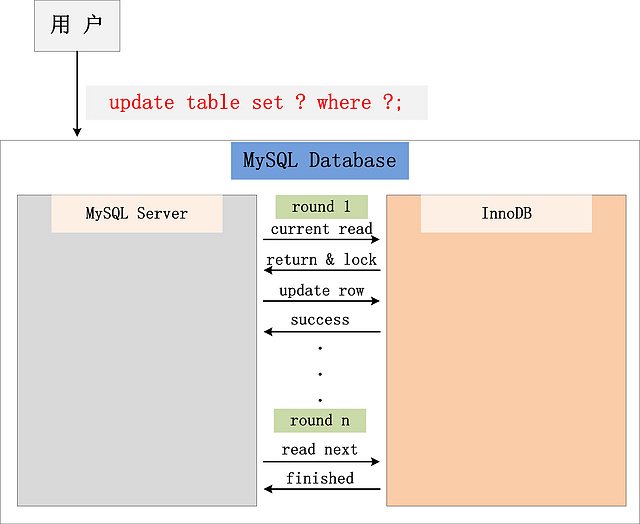

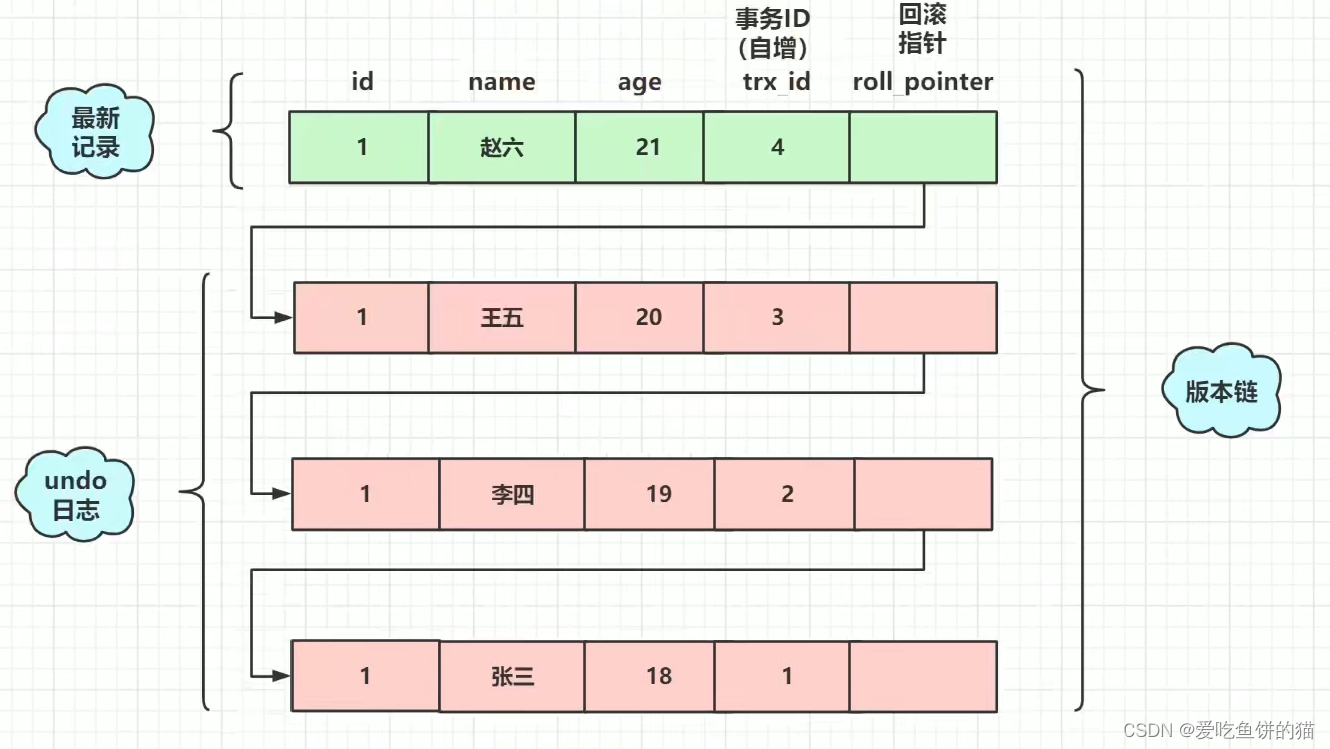

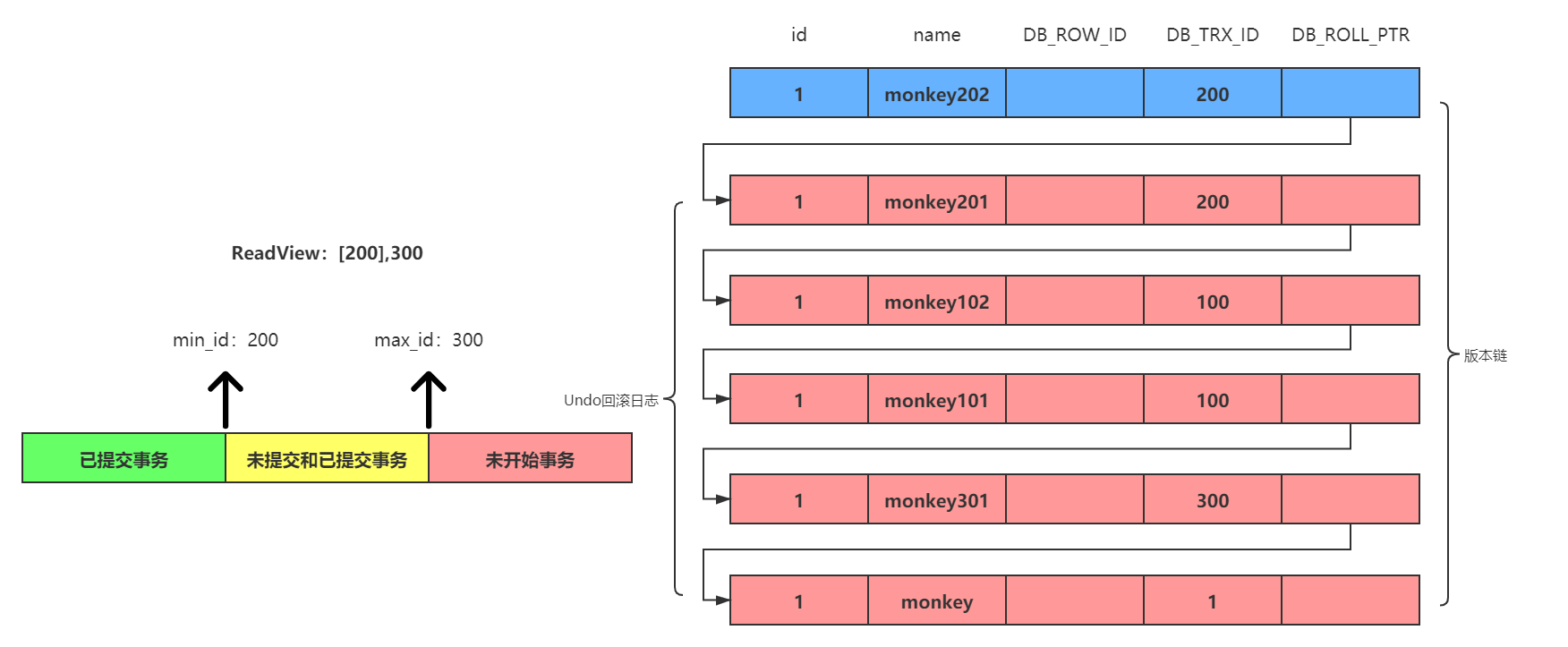

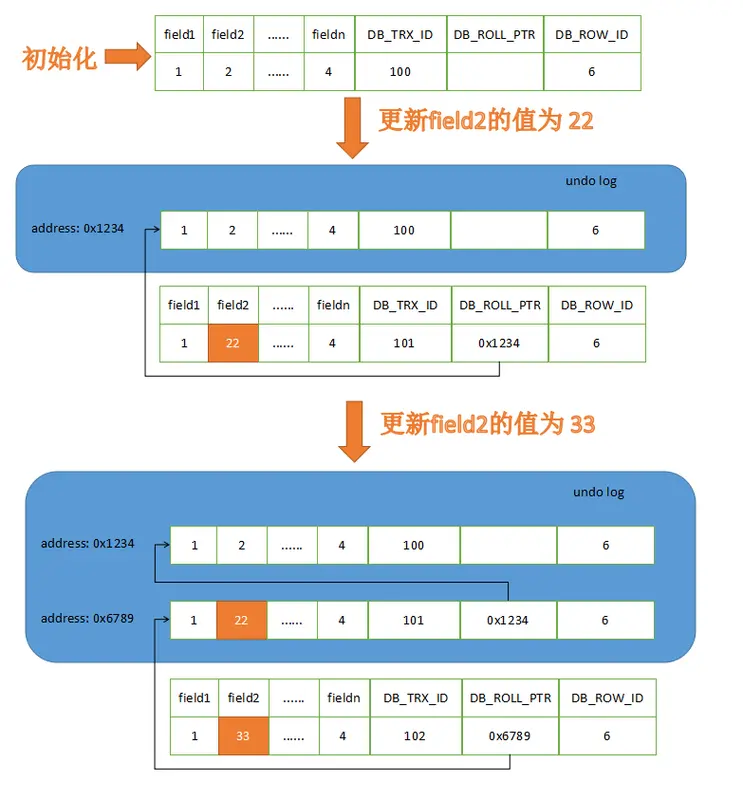

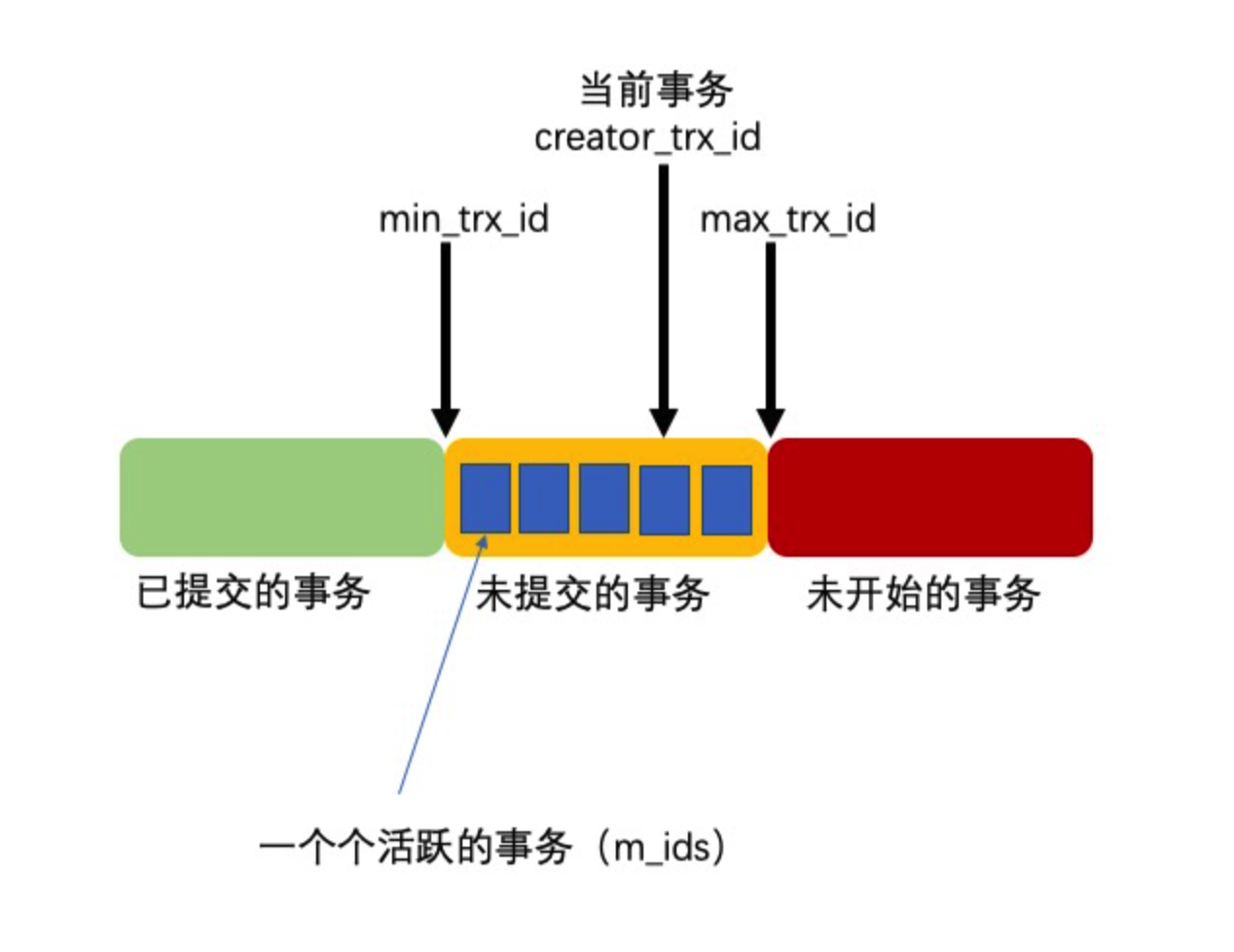

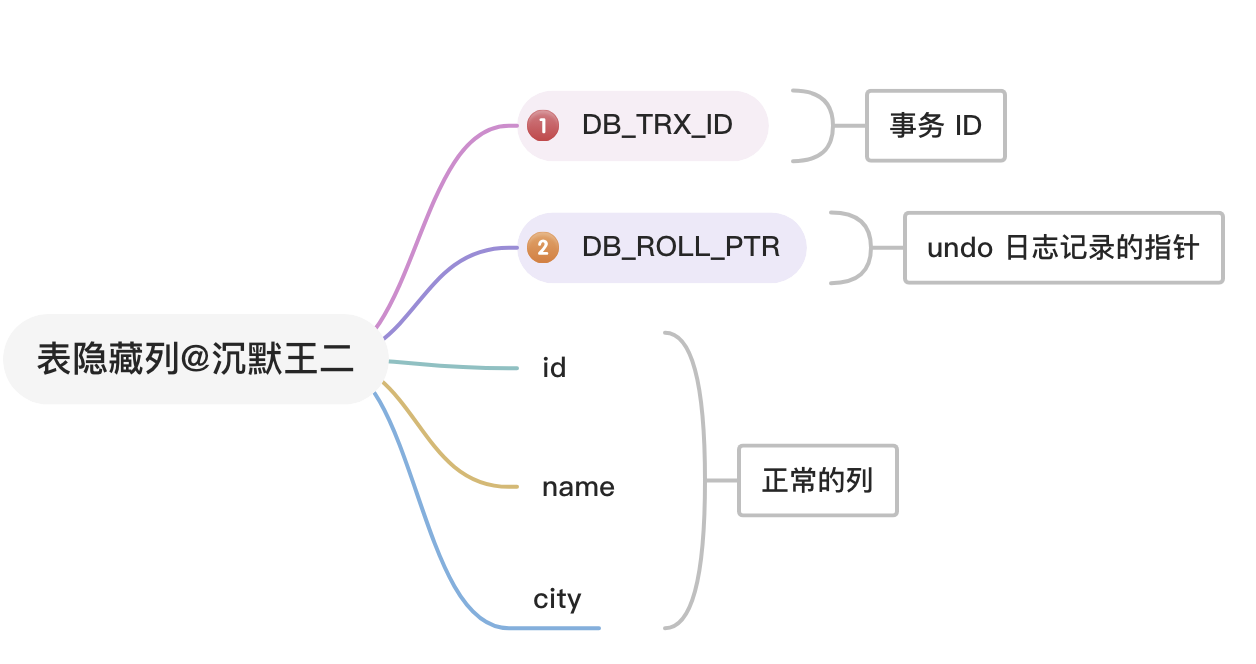

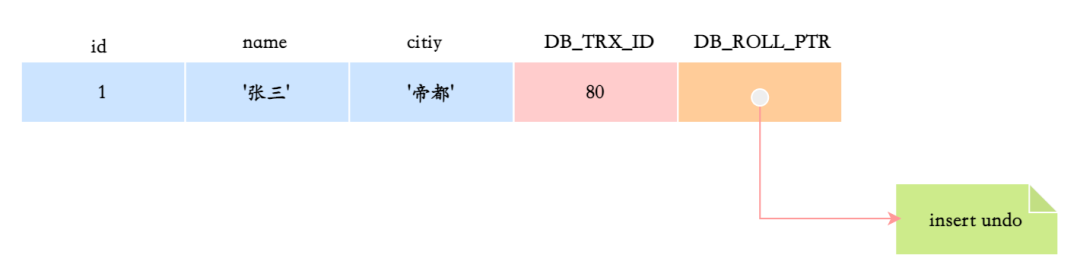

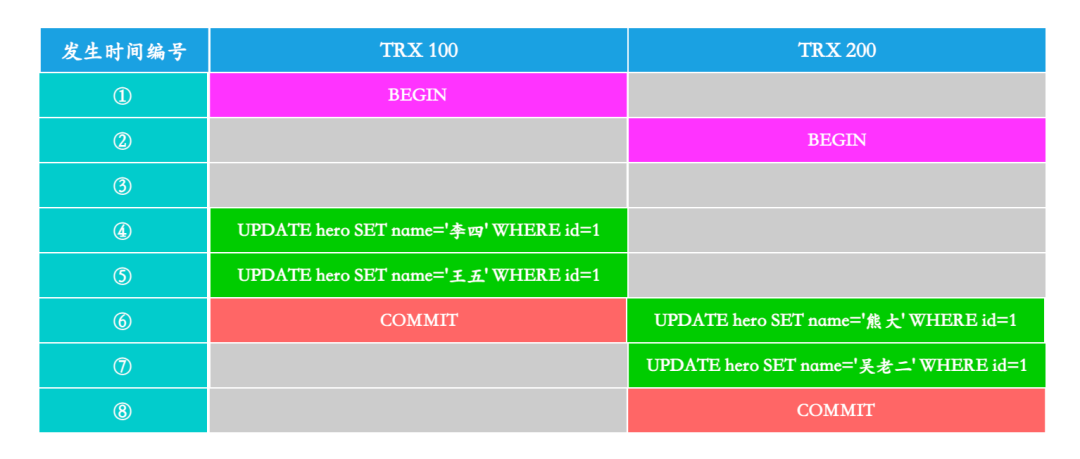

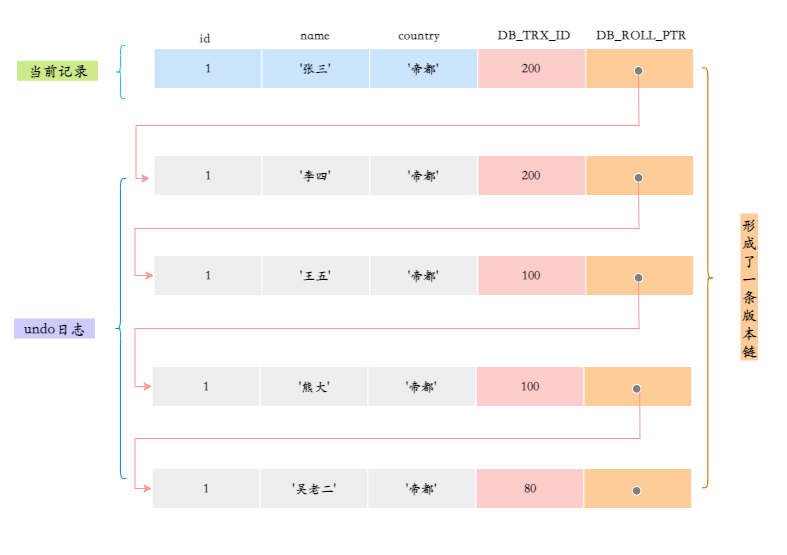

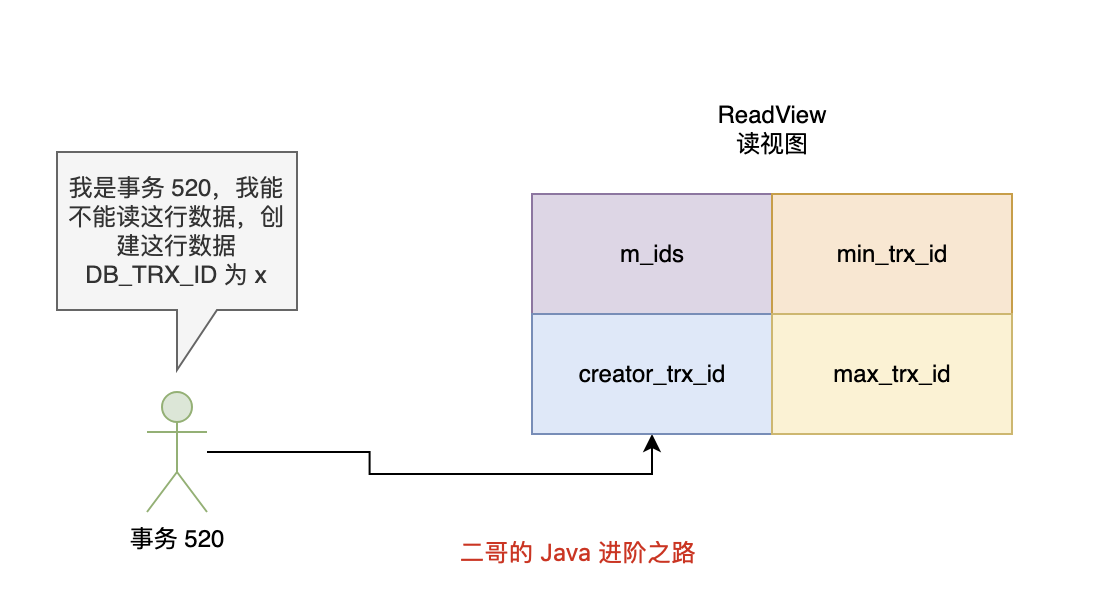

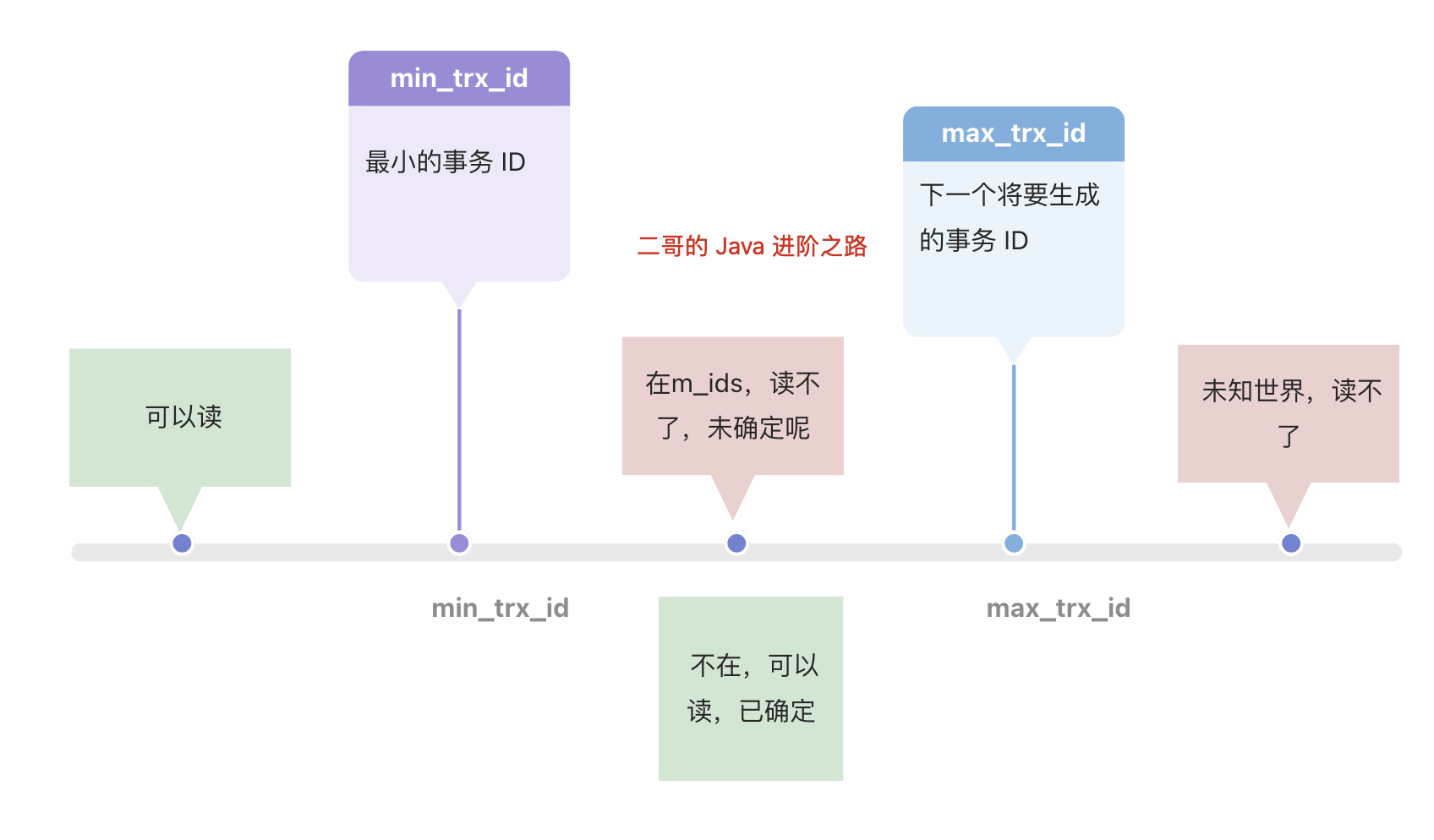

- 65.🌟MVCC 了解吗?

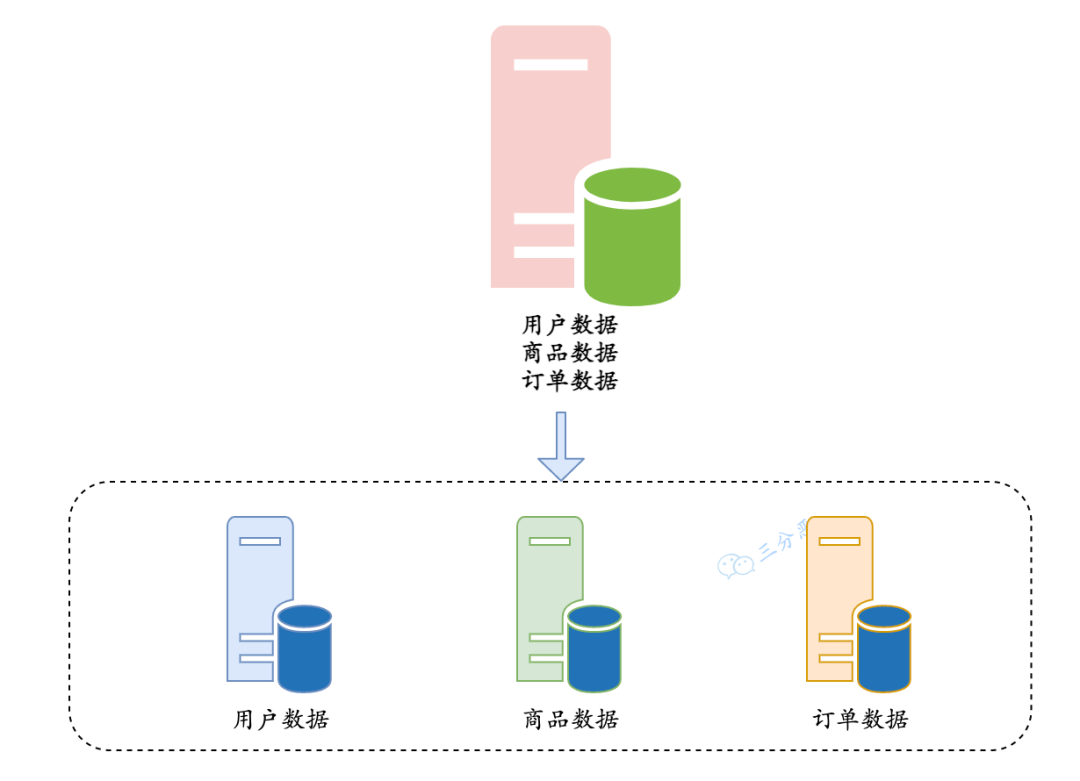

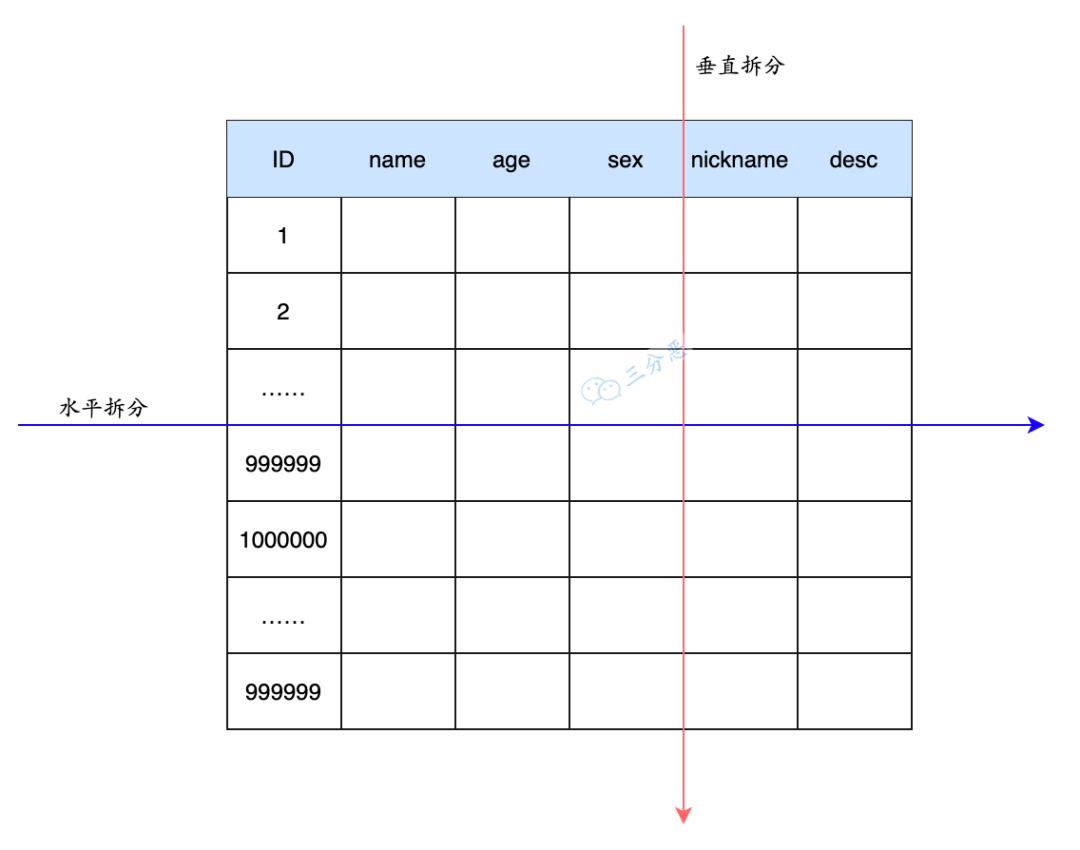

- 70.🌟你们一般是怎么分库的呢?

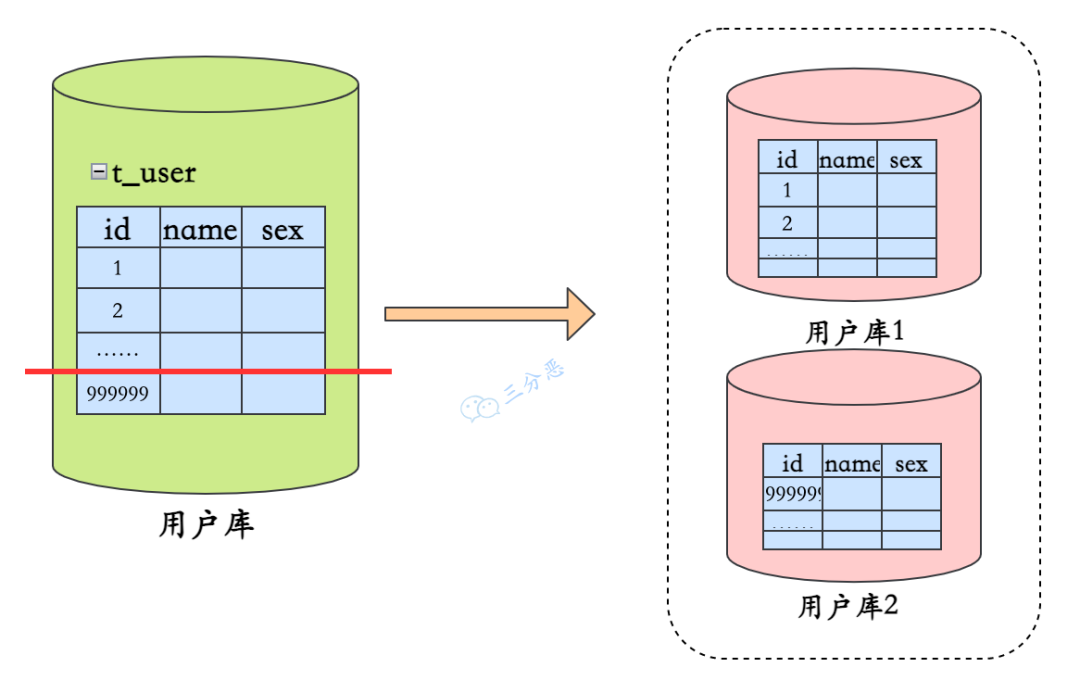

- 71.🌟那你们是怎么分表的?

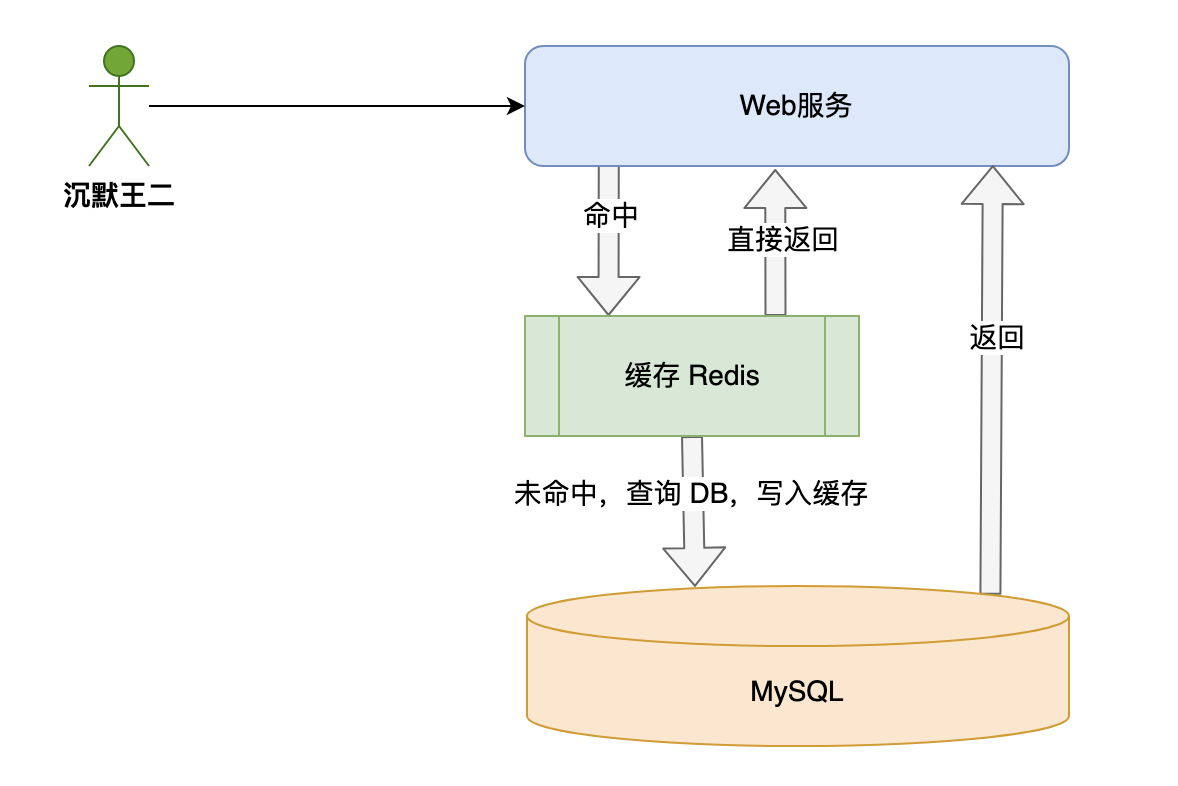

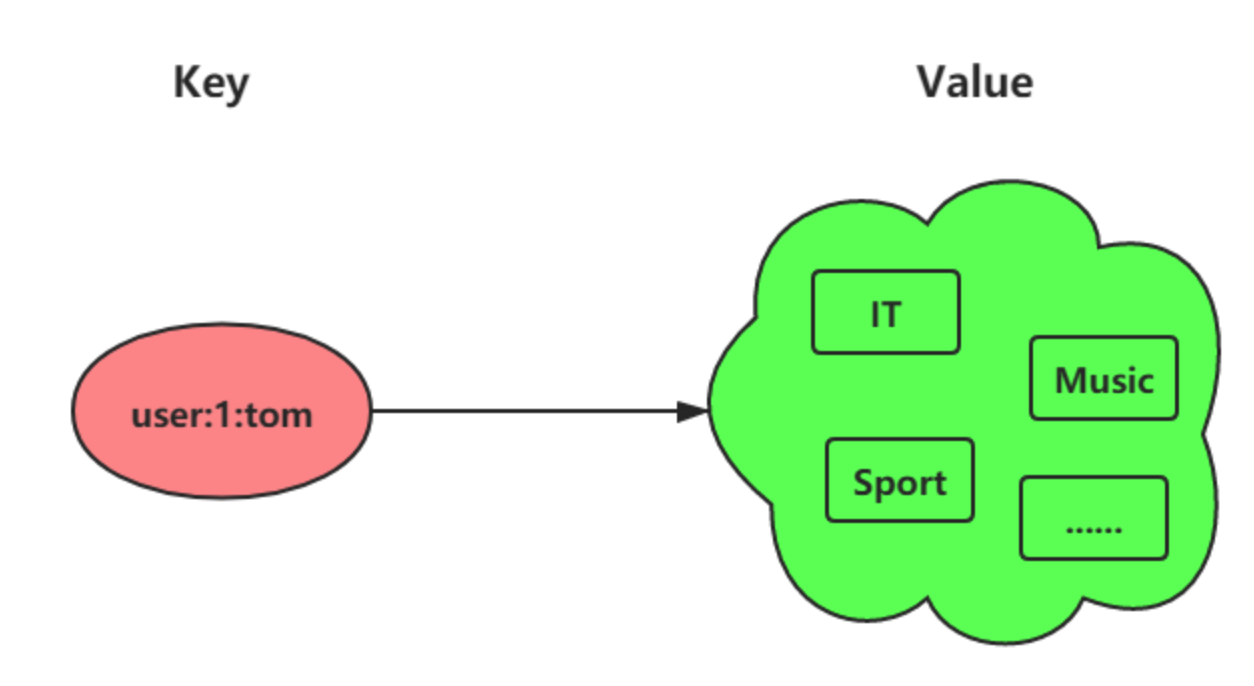

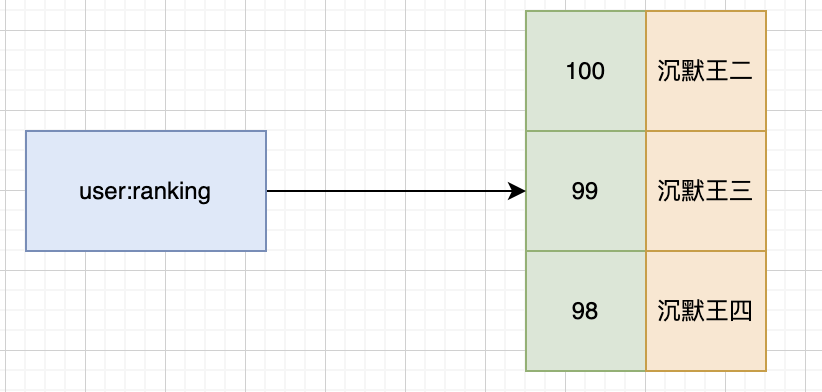

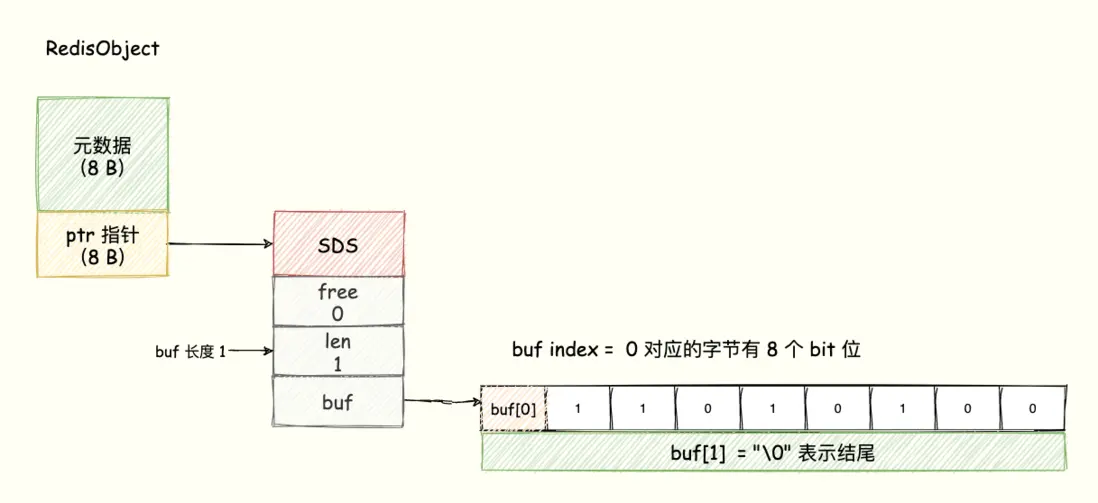

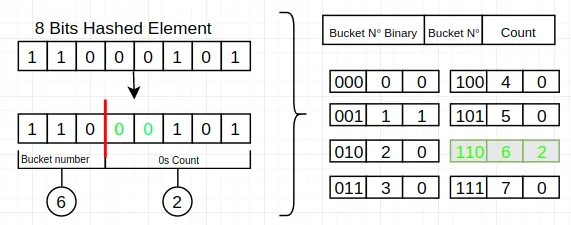

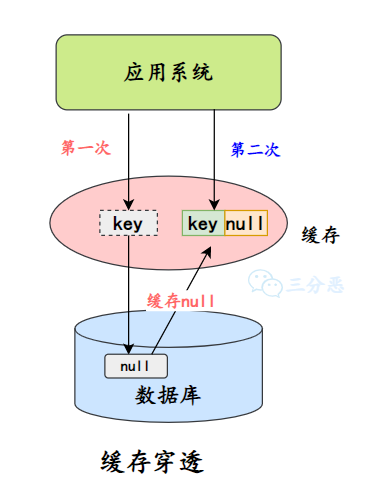

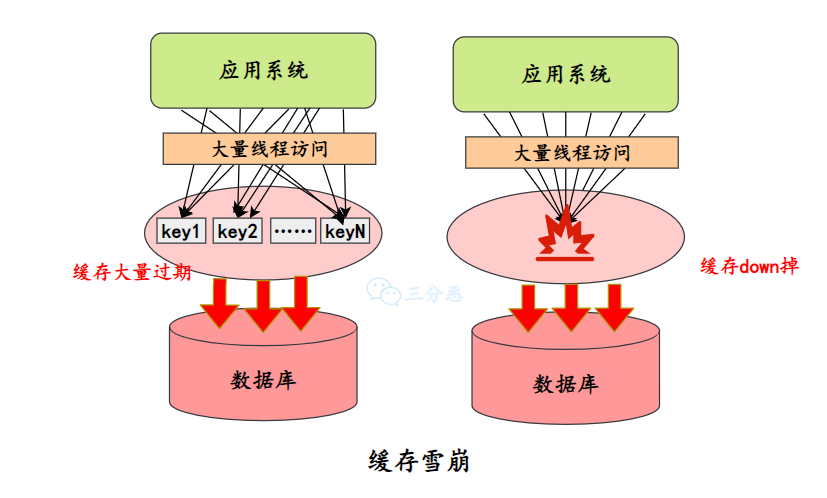

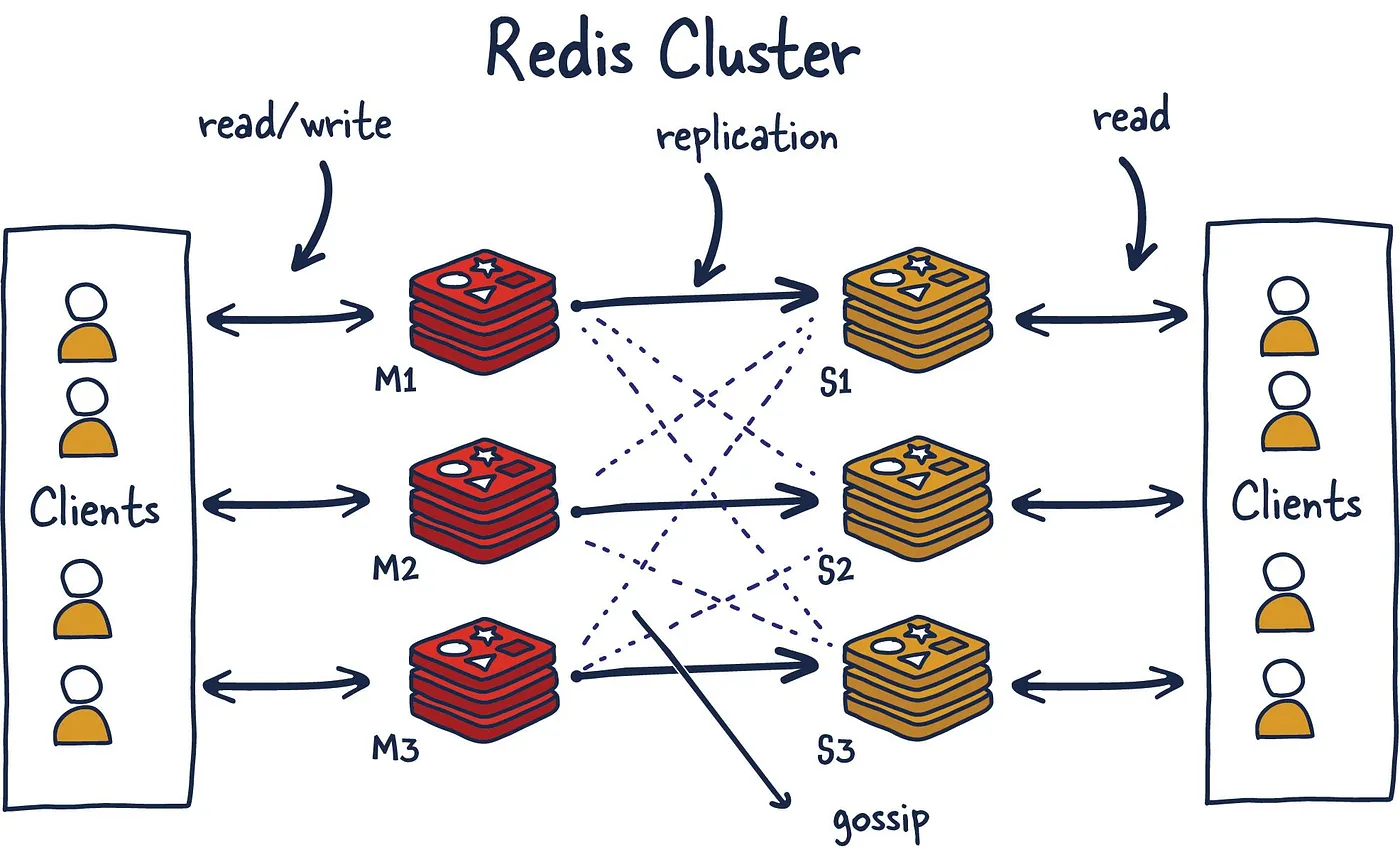

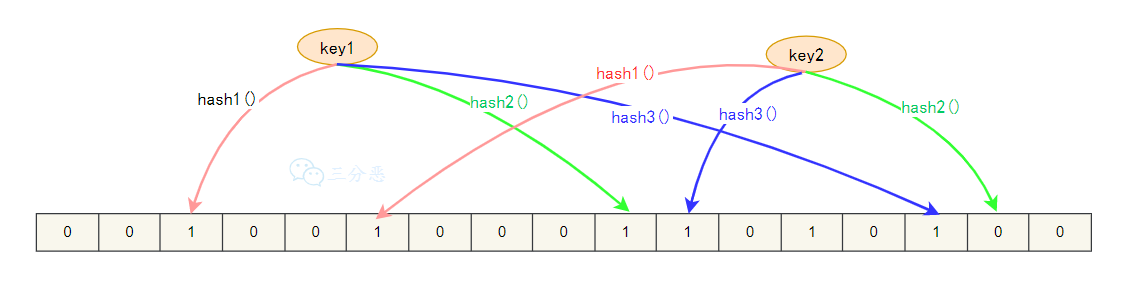

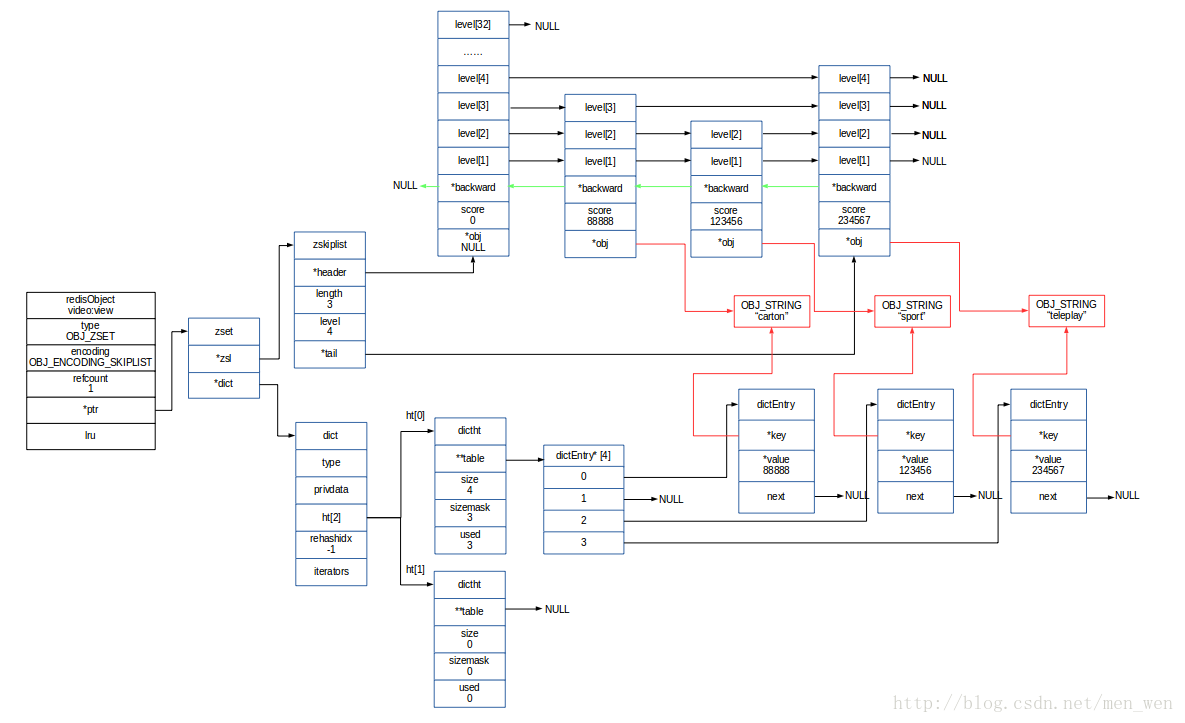

- Redis

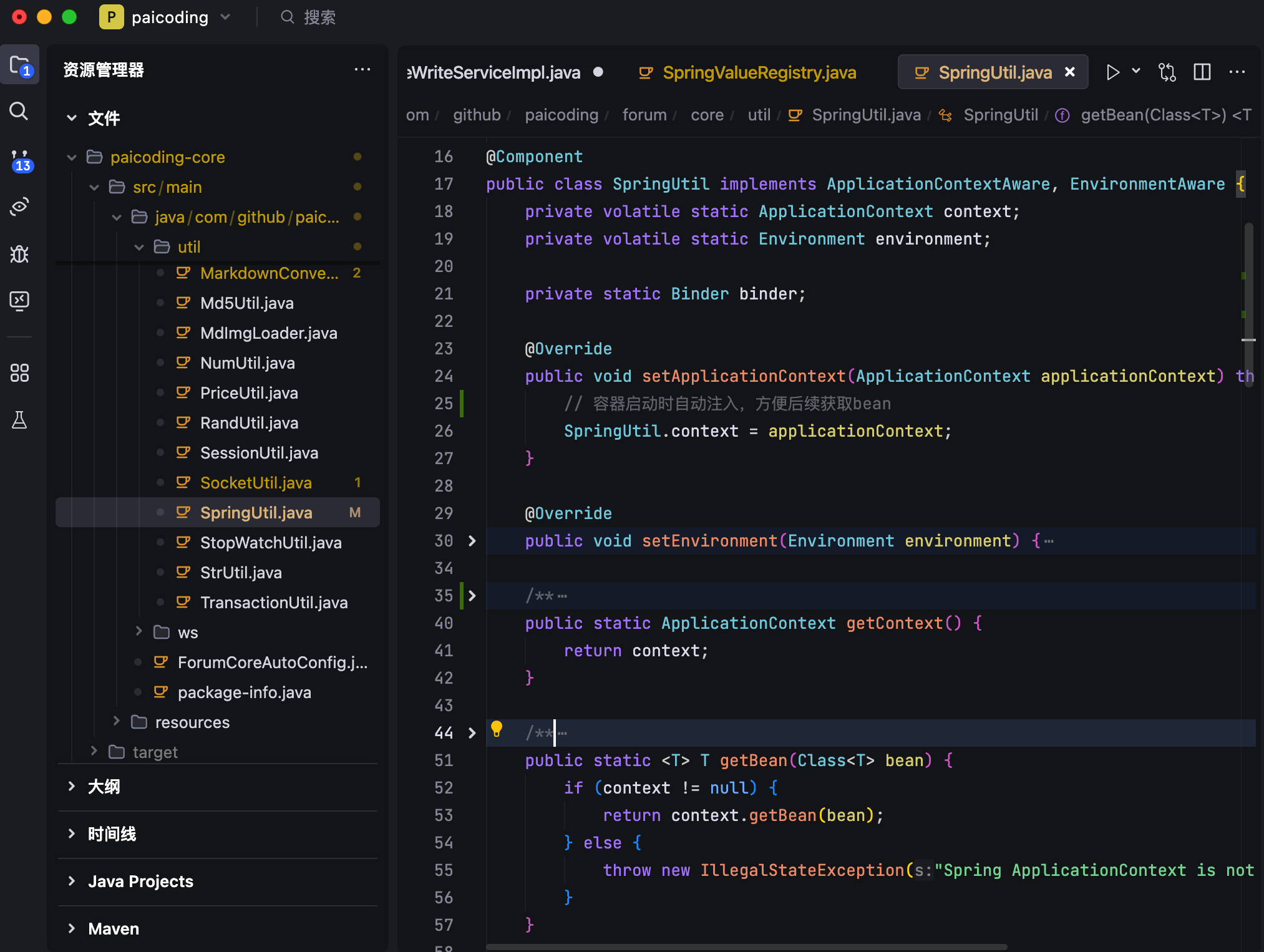

- Spring

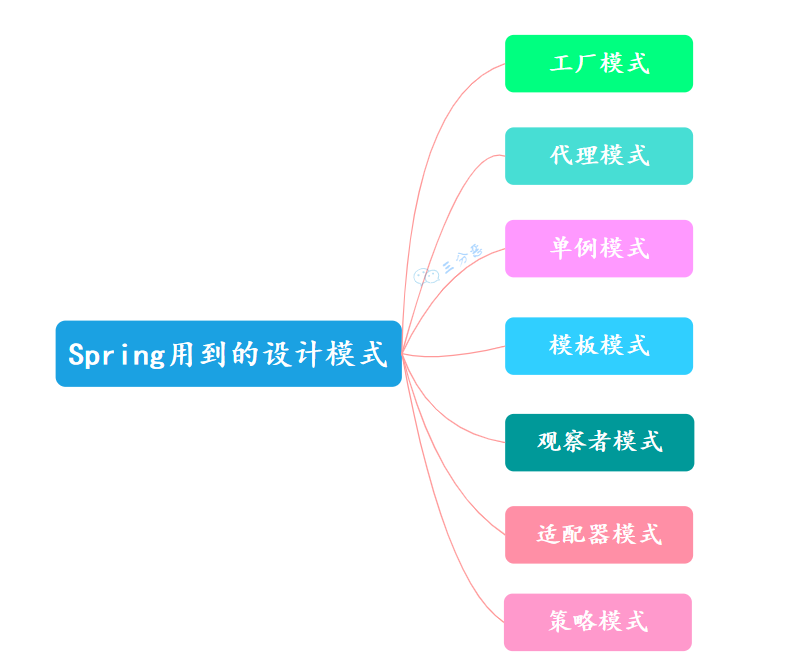

- 4.🌟Spring用了哪些设计模式?

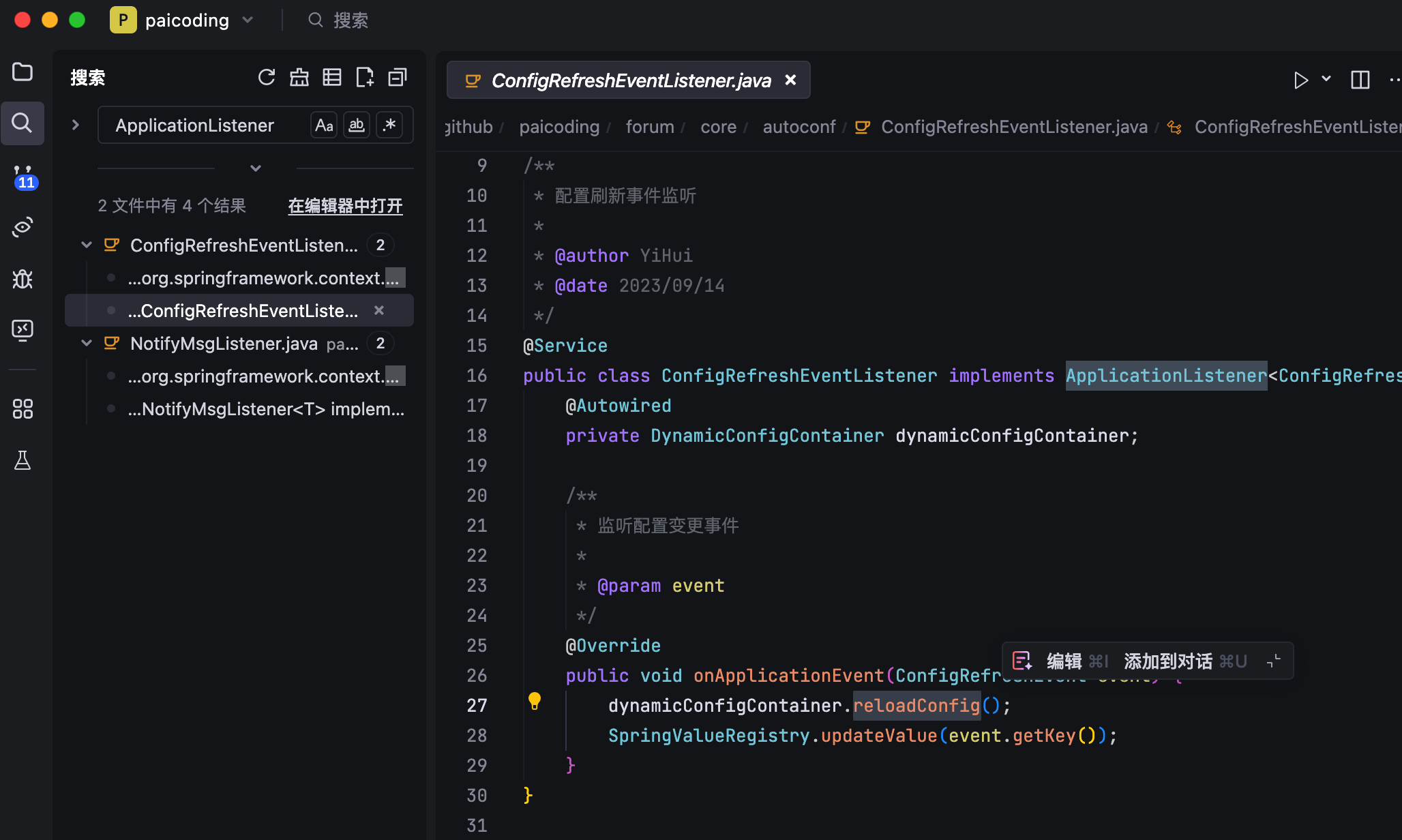

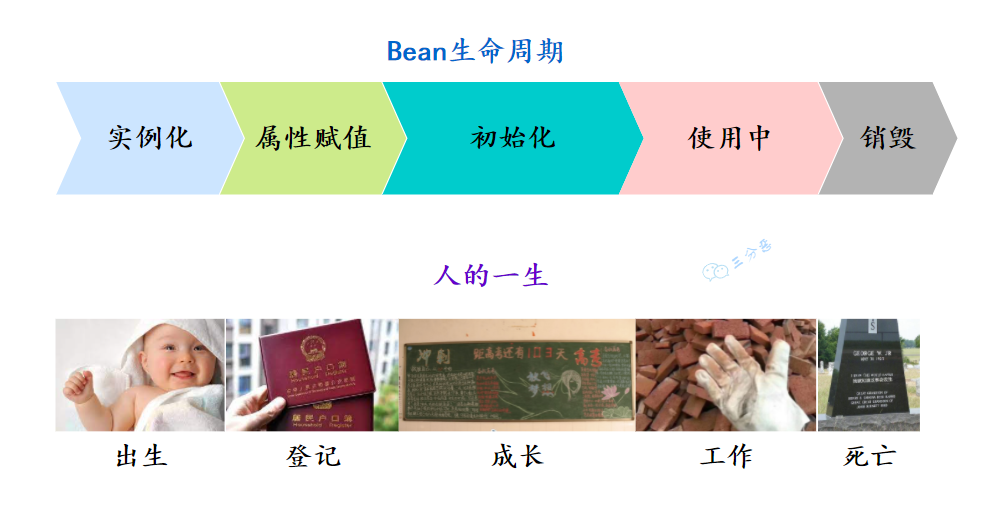

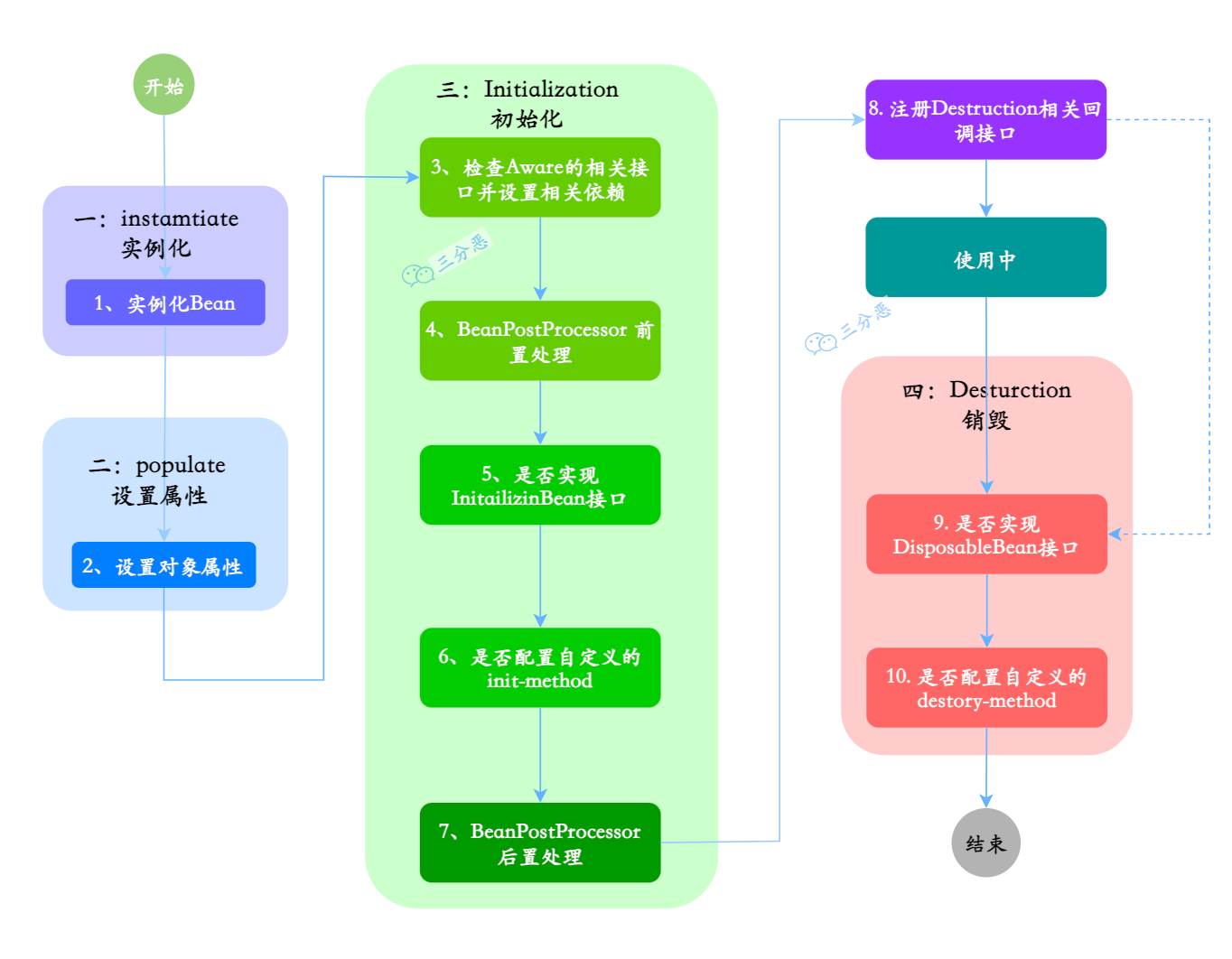

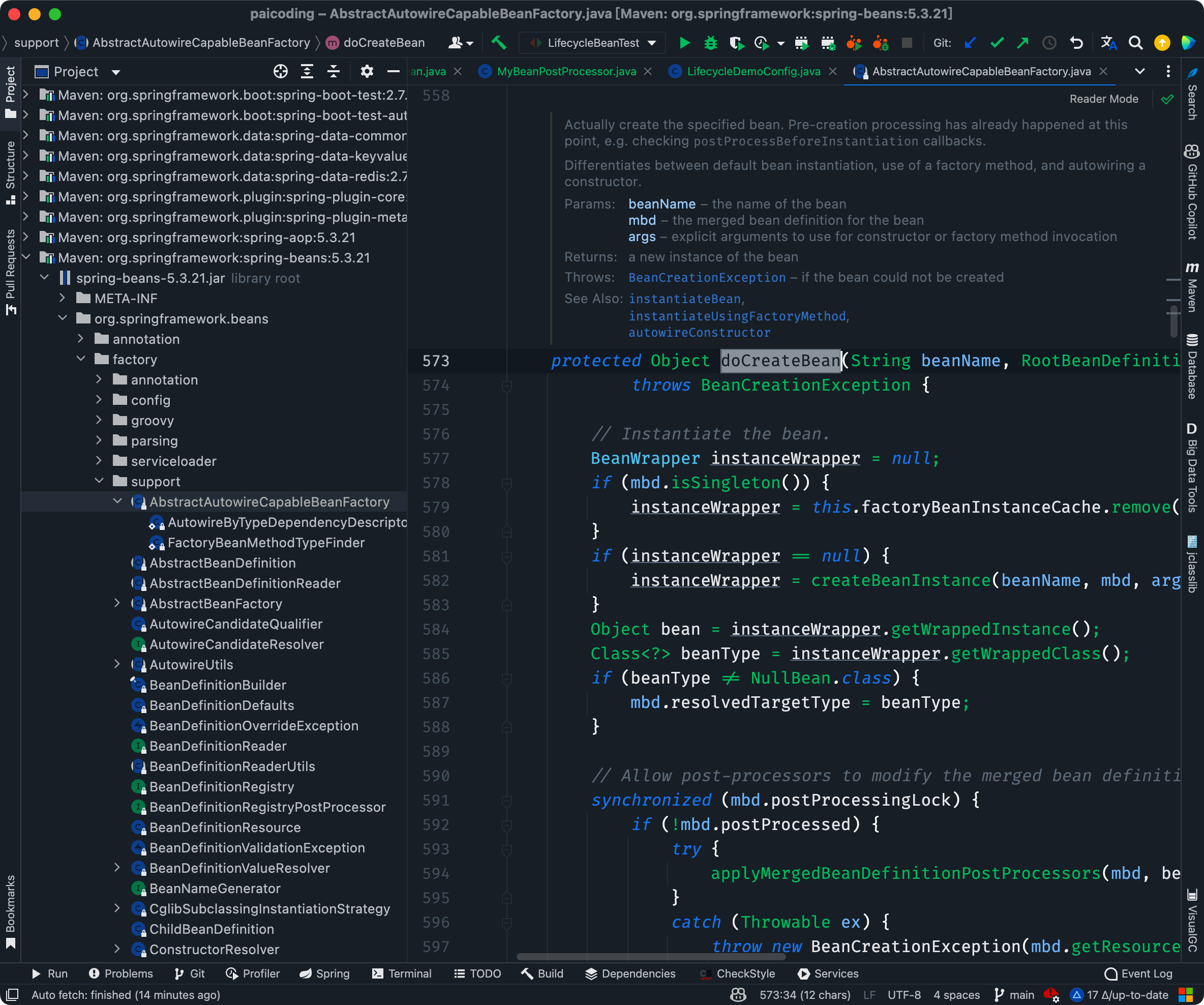

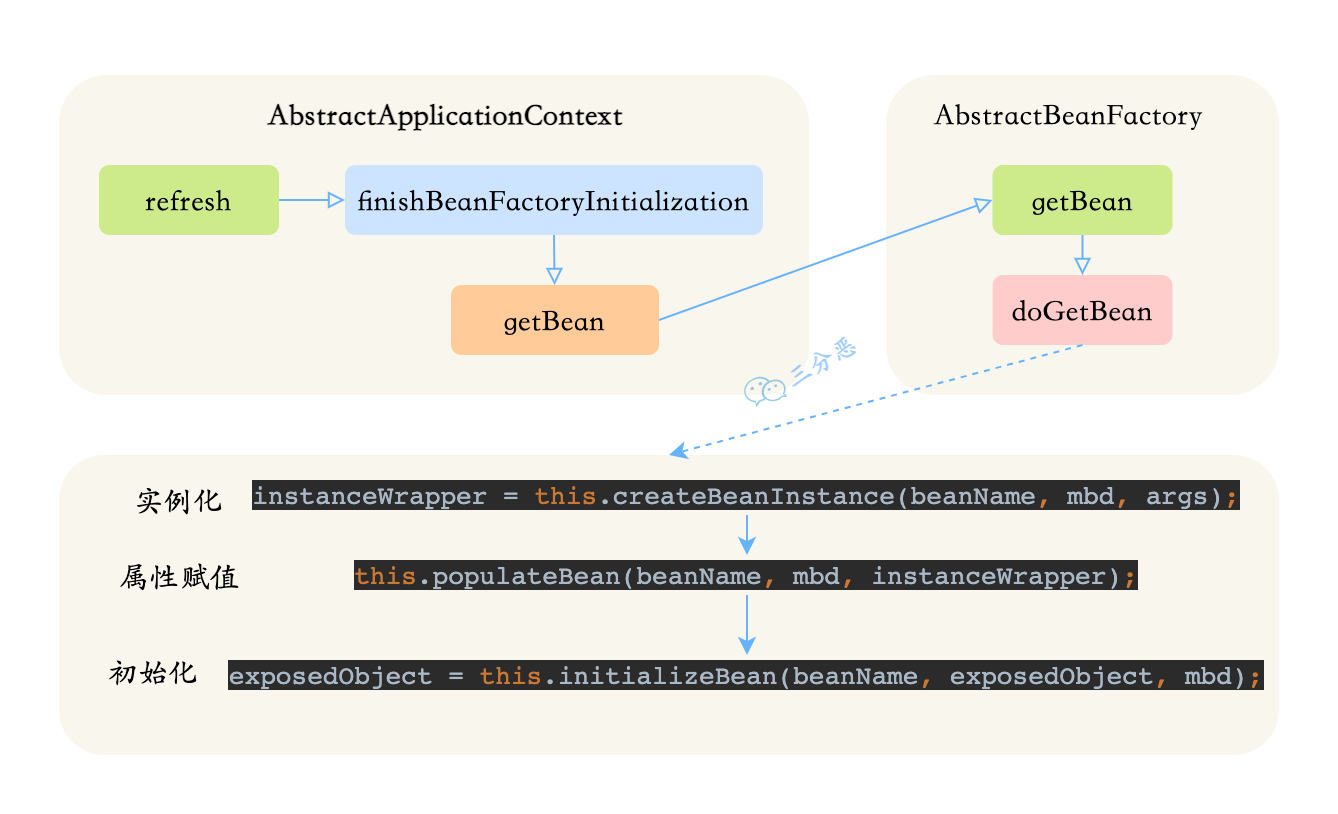

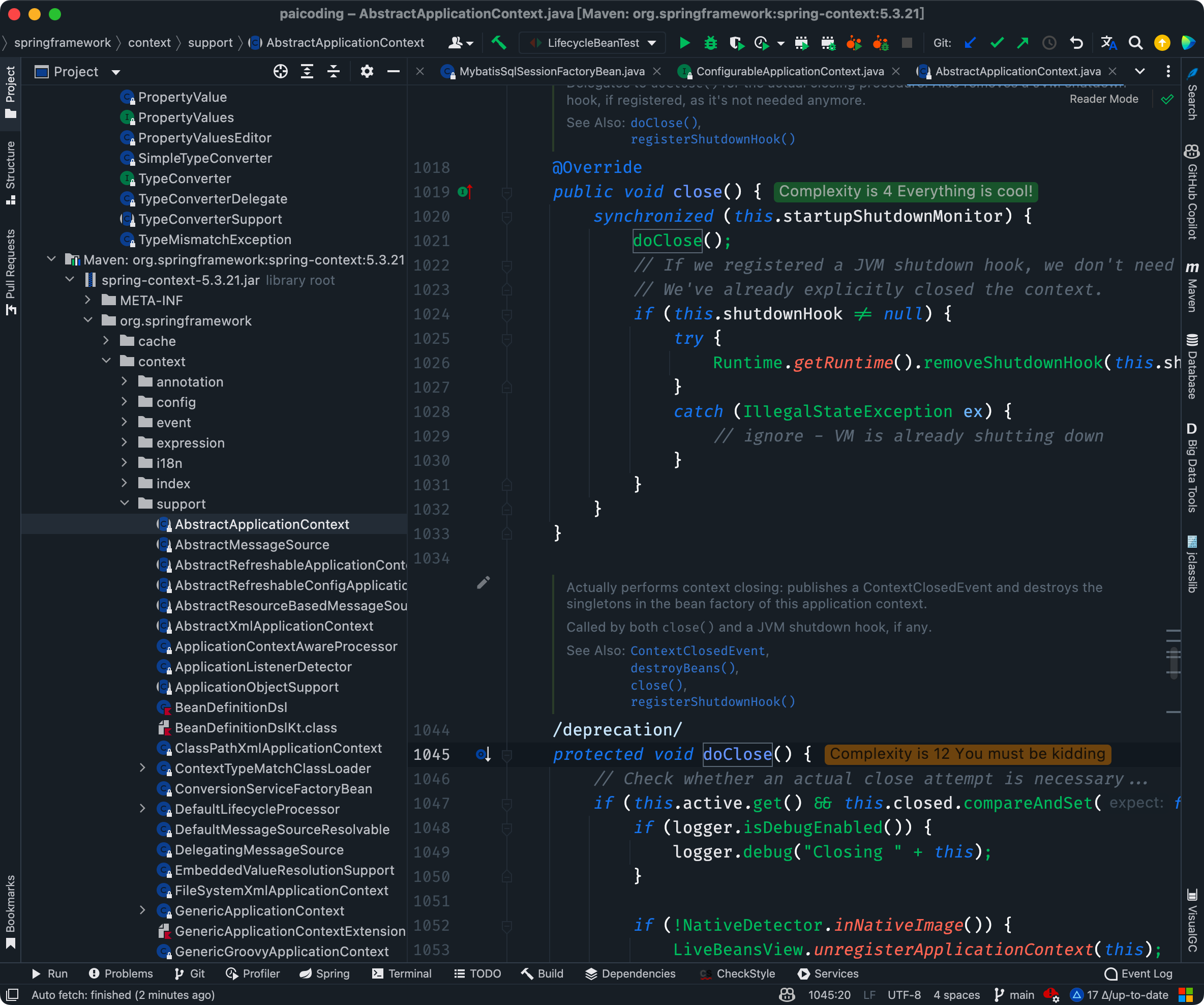

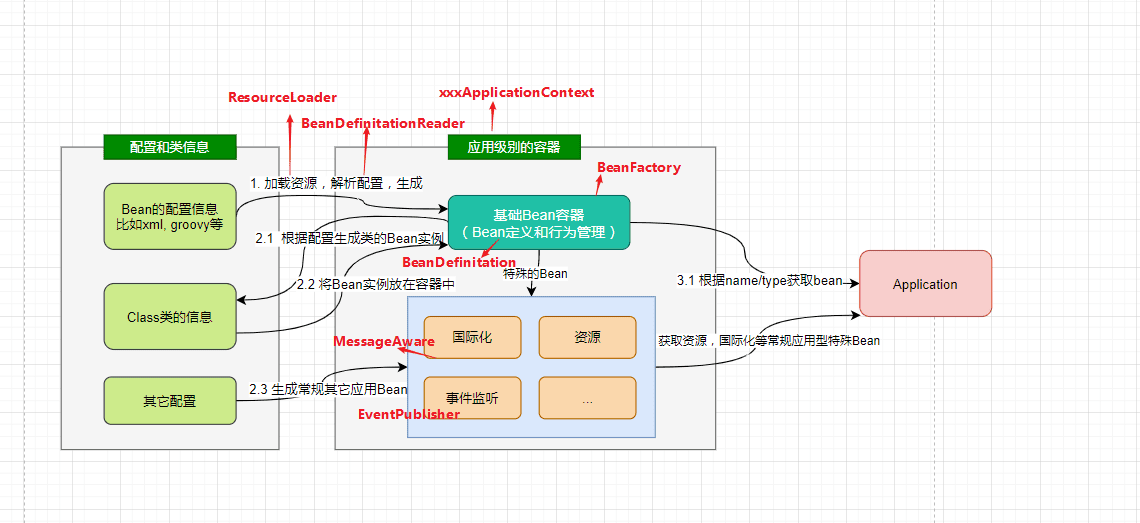

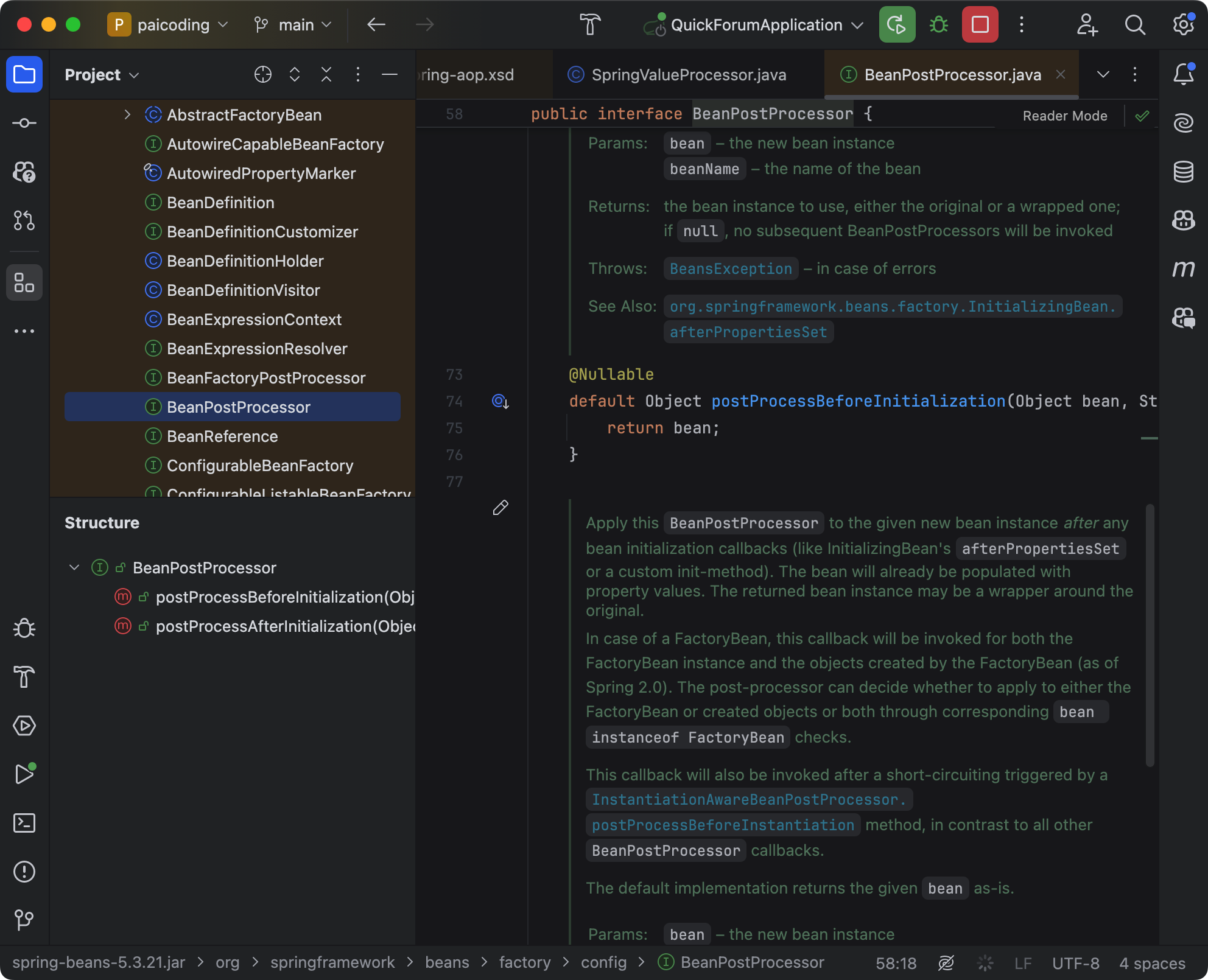

- 7.🌟能说一下Bean的生命周期吗?

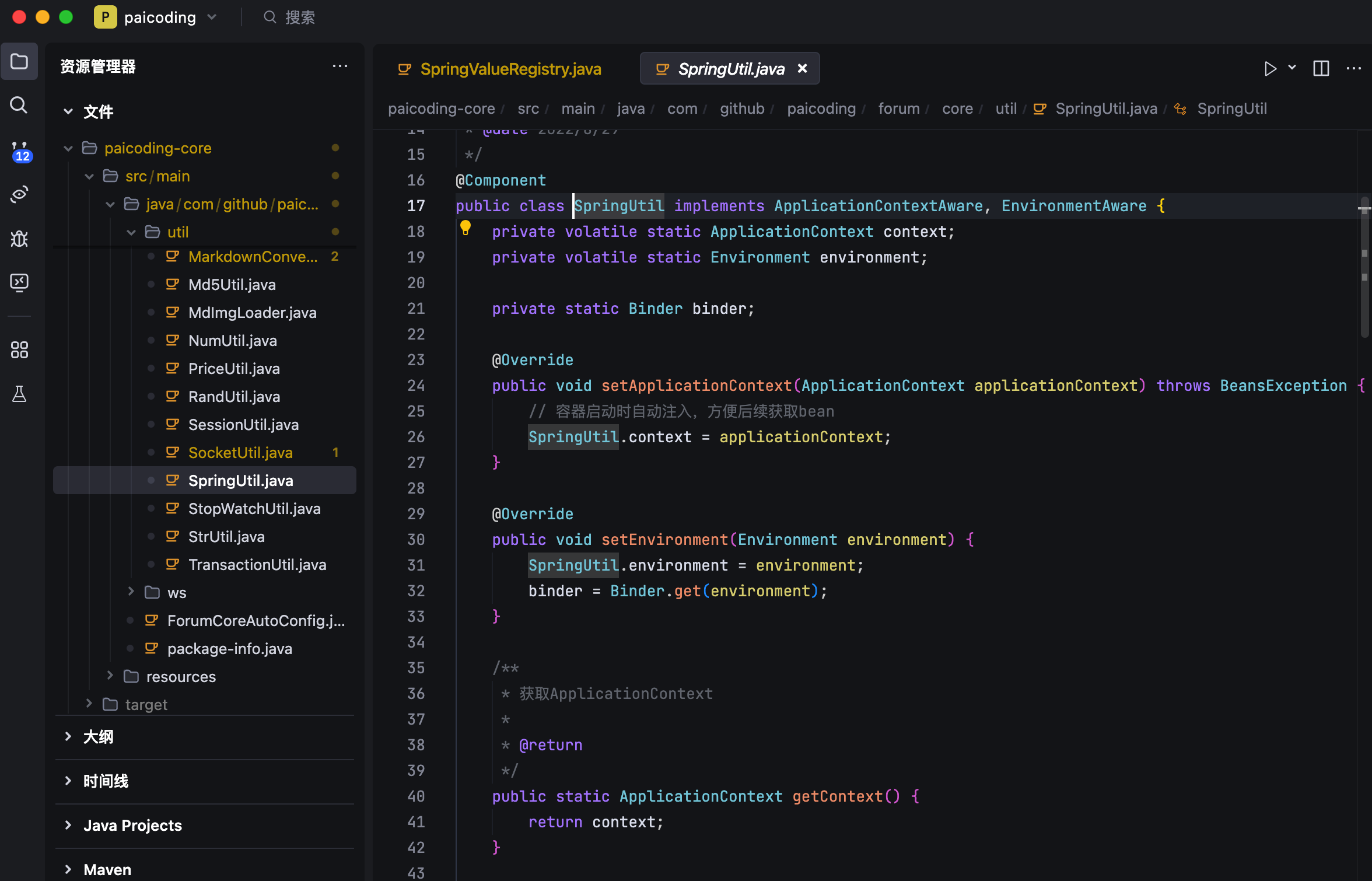

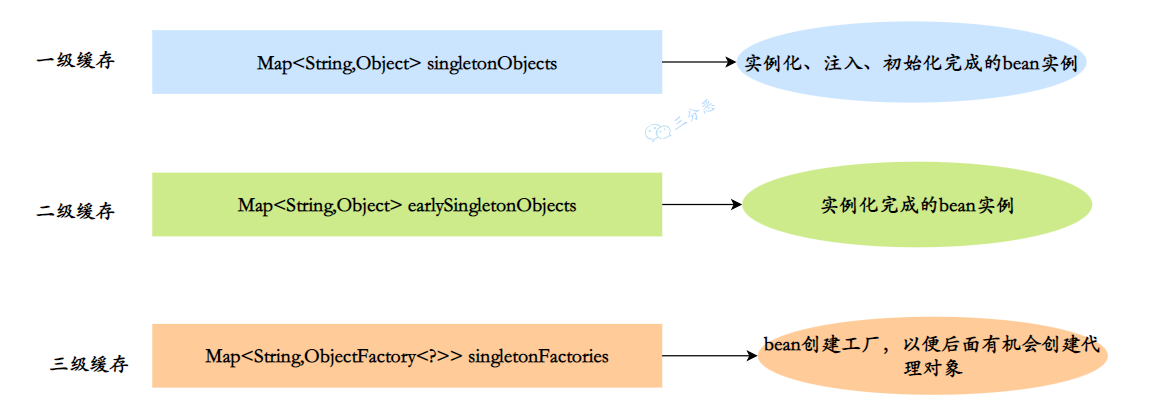

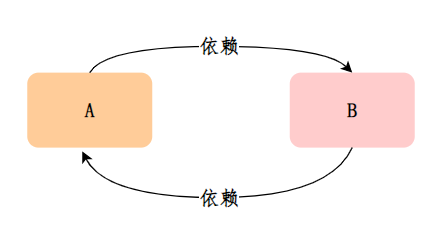

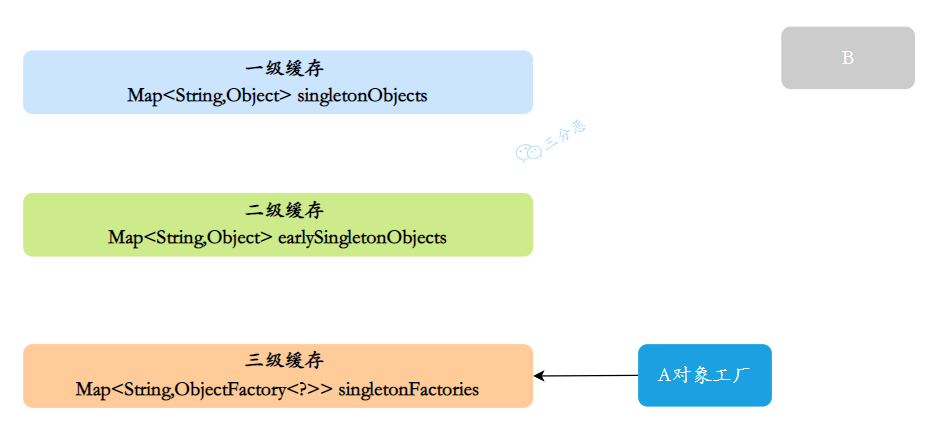

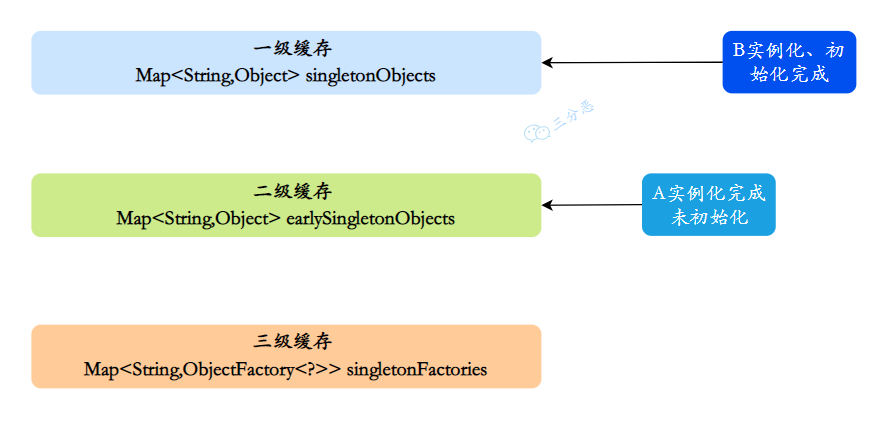

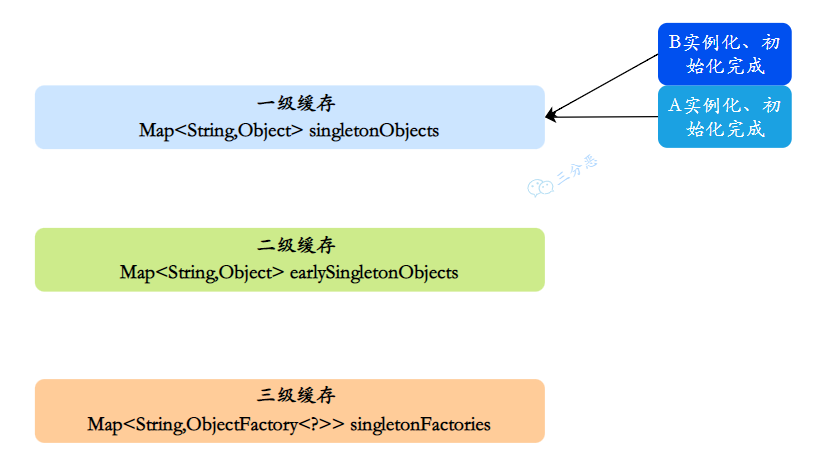

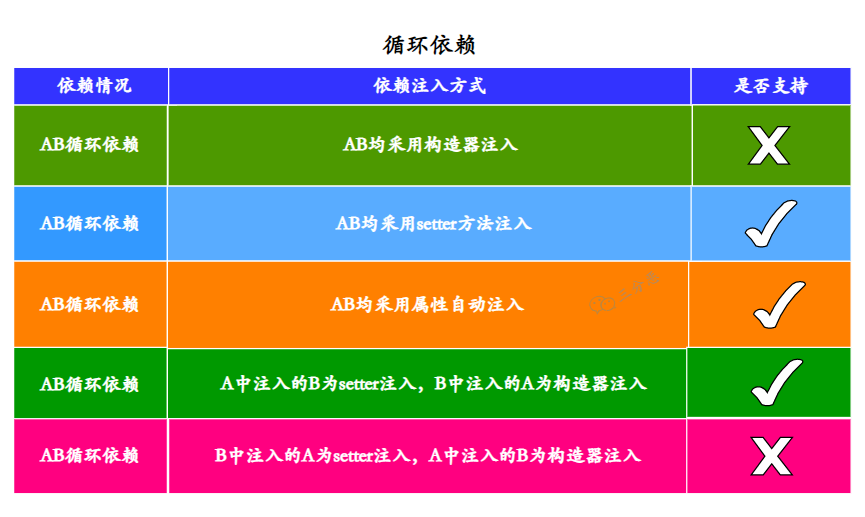

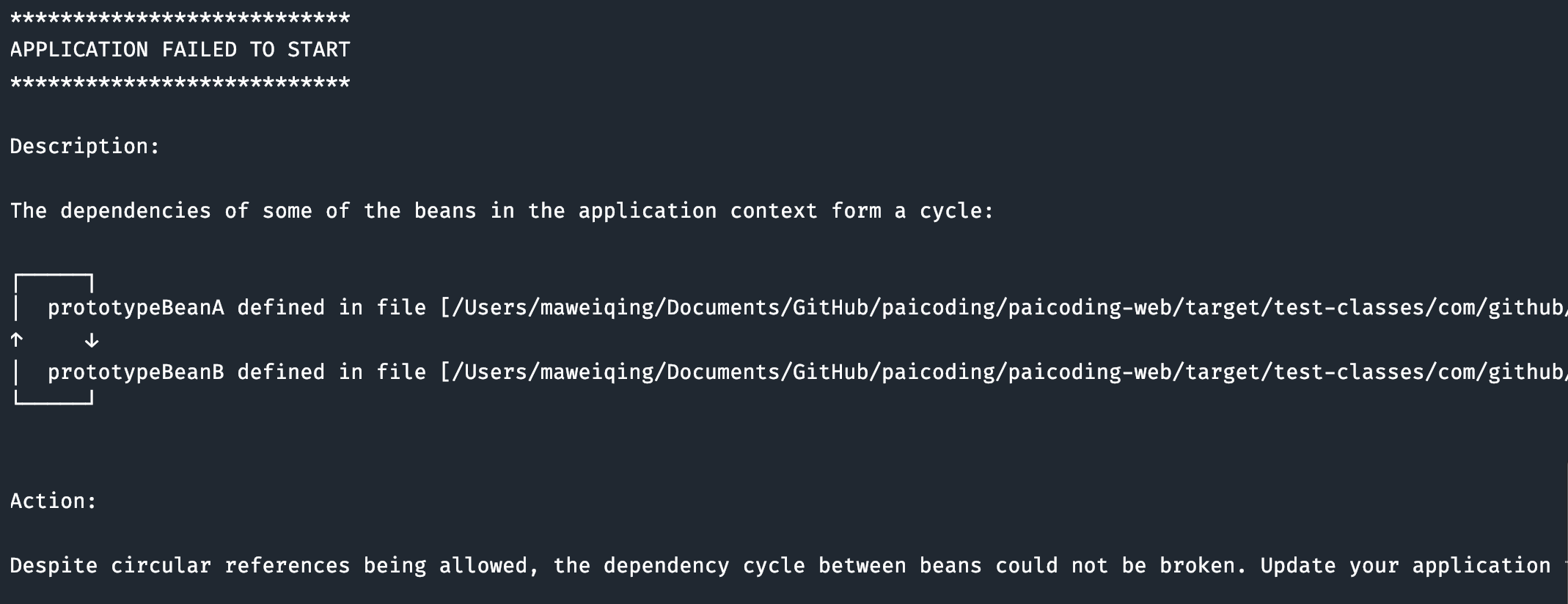

- 14.🌟Spring怎么解决循环依赖呢?

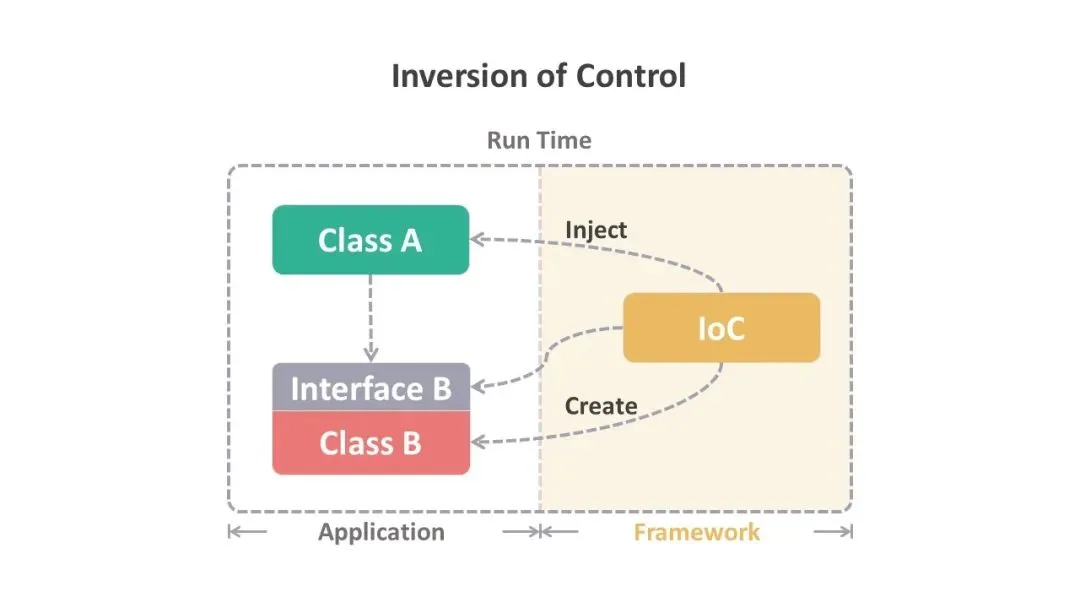

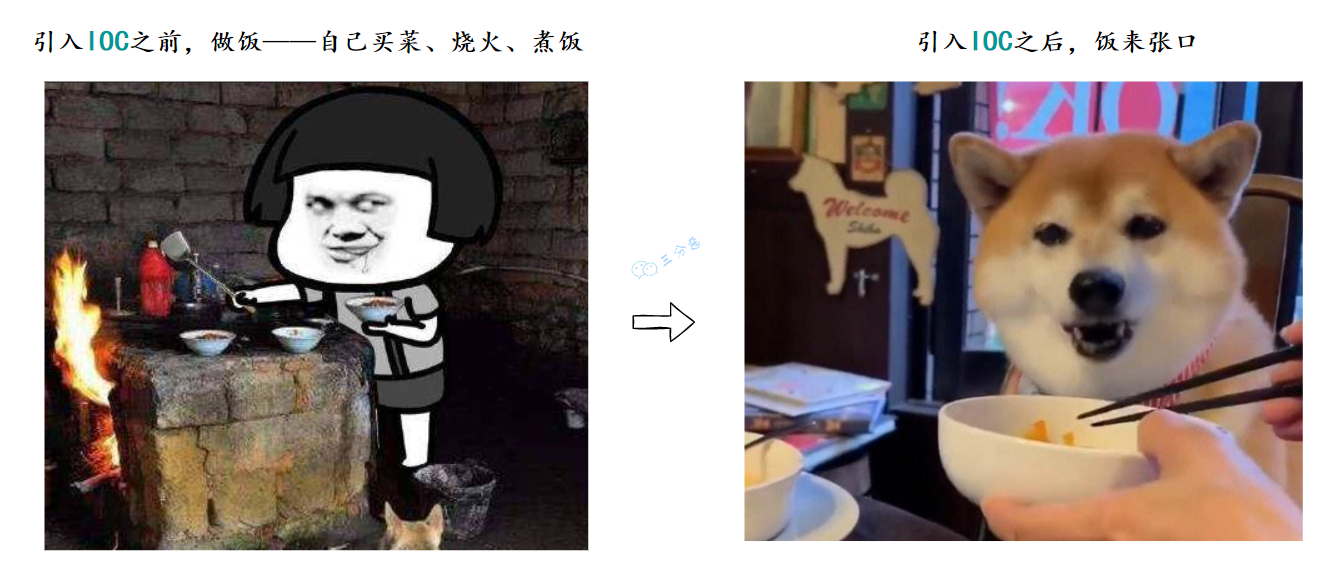

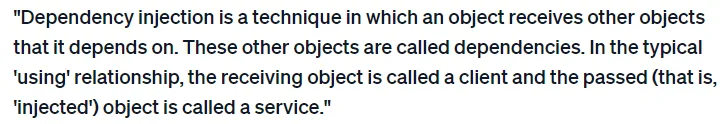

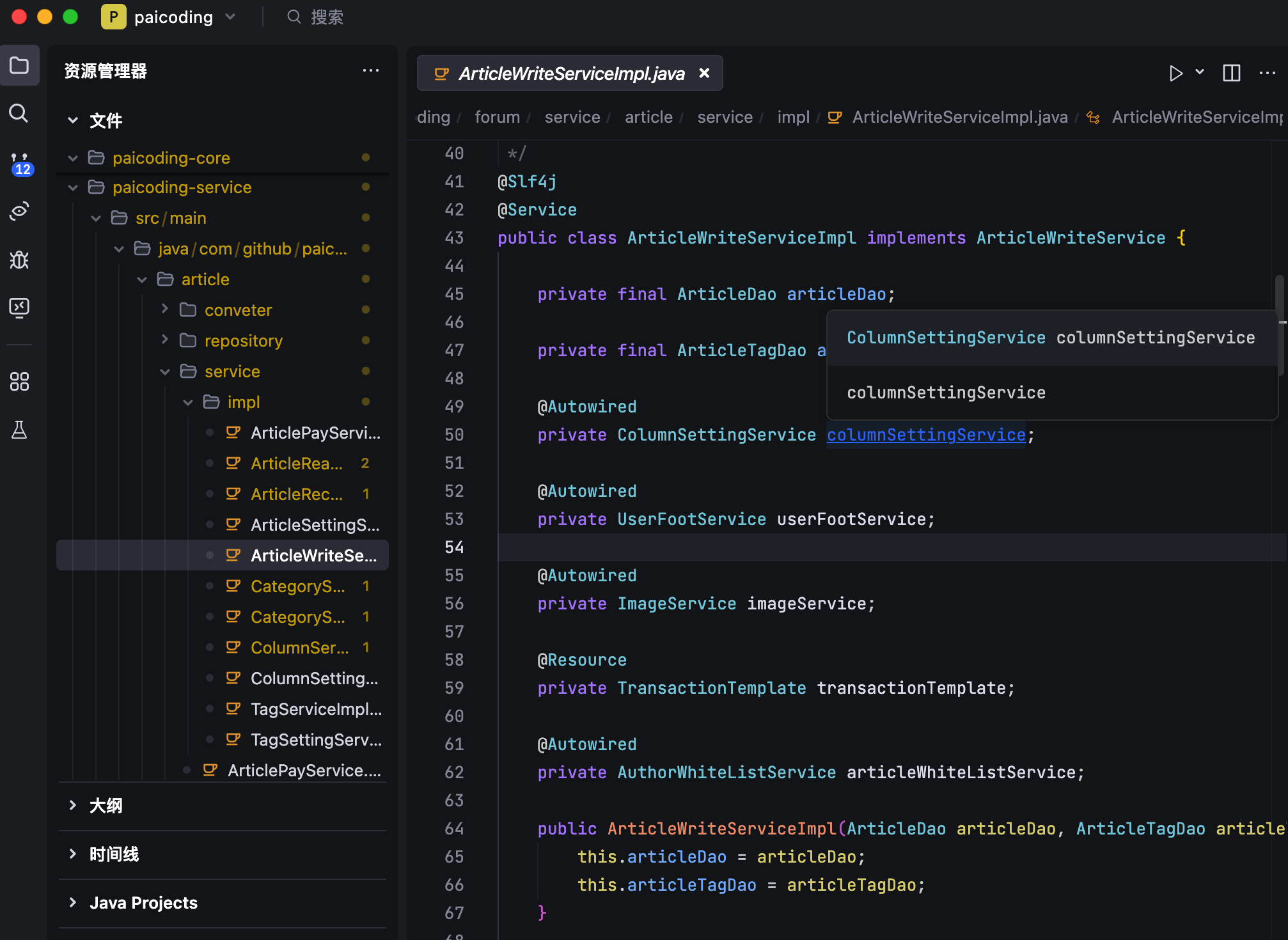

- 16.🌟说一说什么是IoC?

- 19.🌟项目启动时Spring的IoC会做什么?

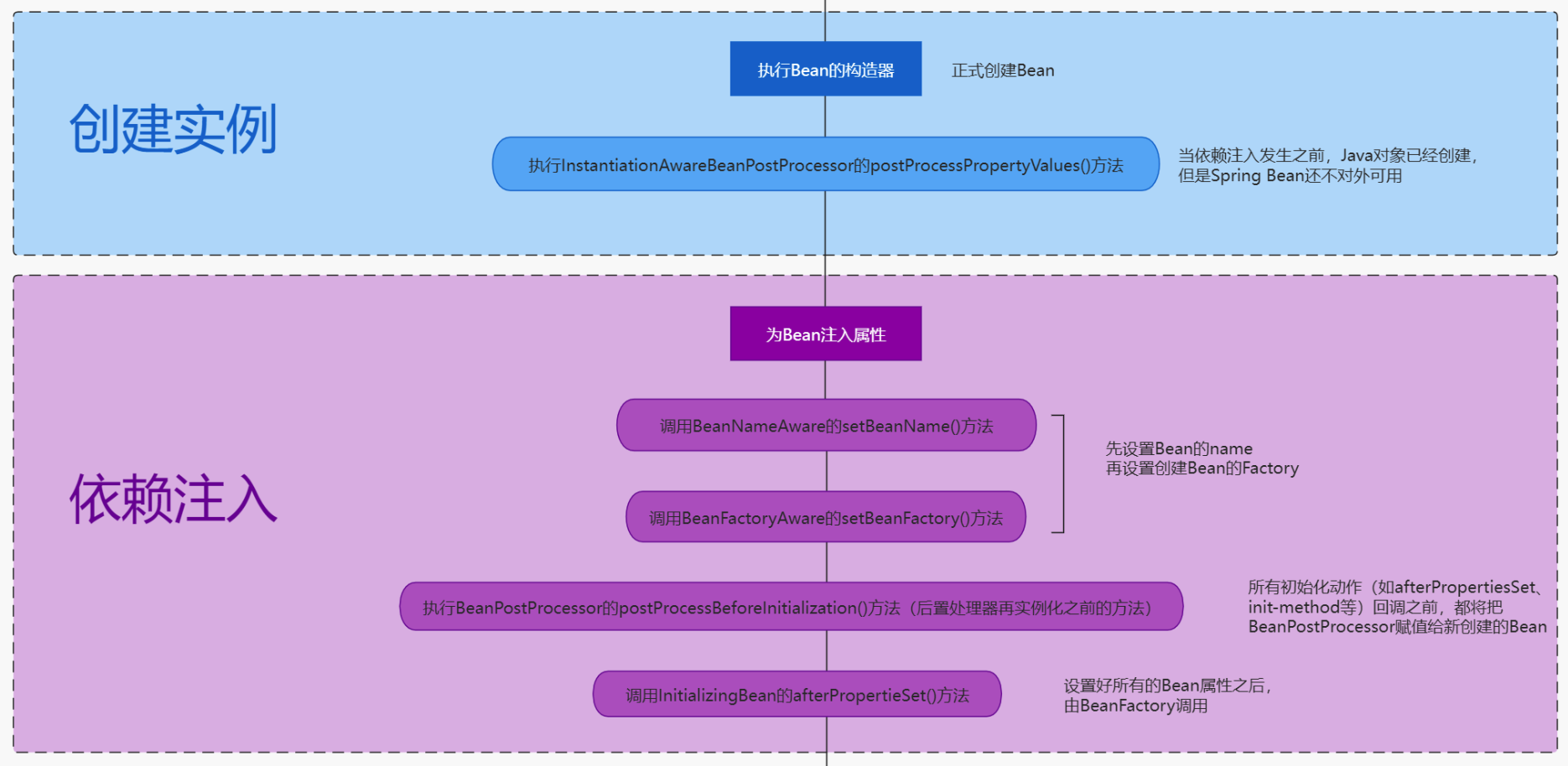

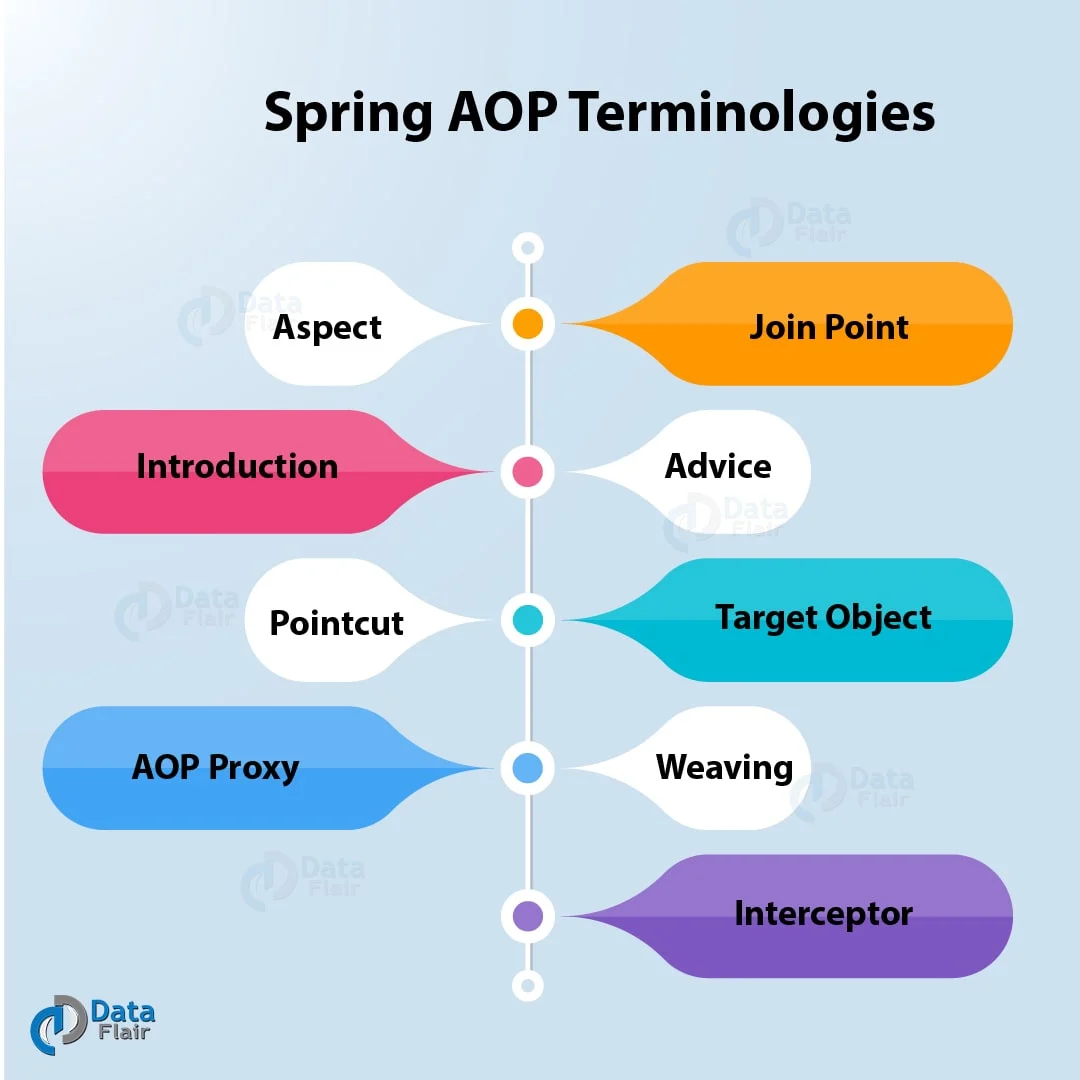

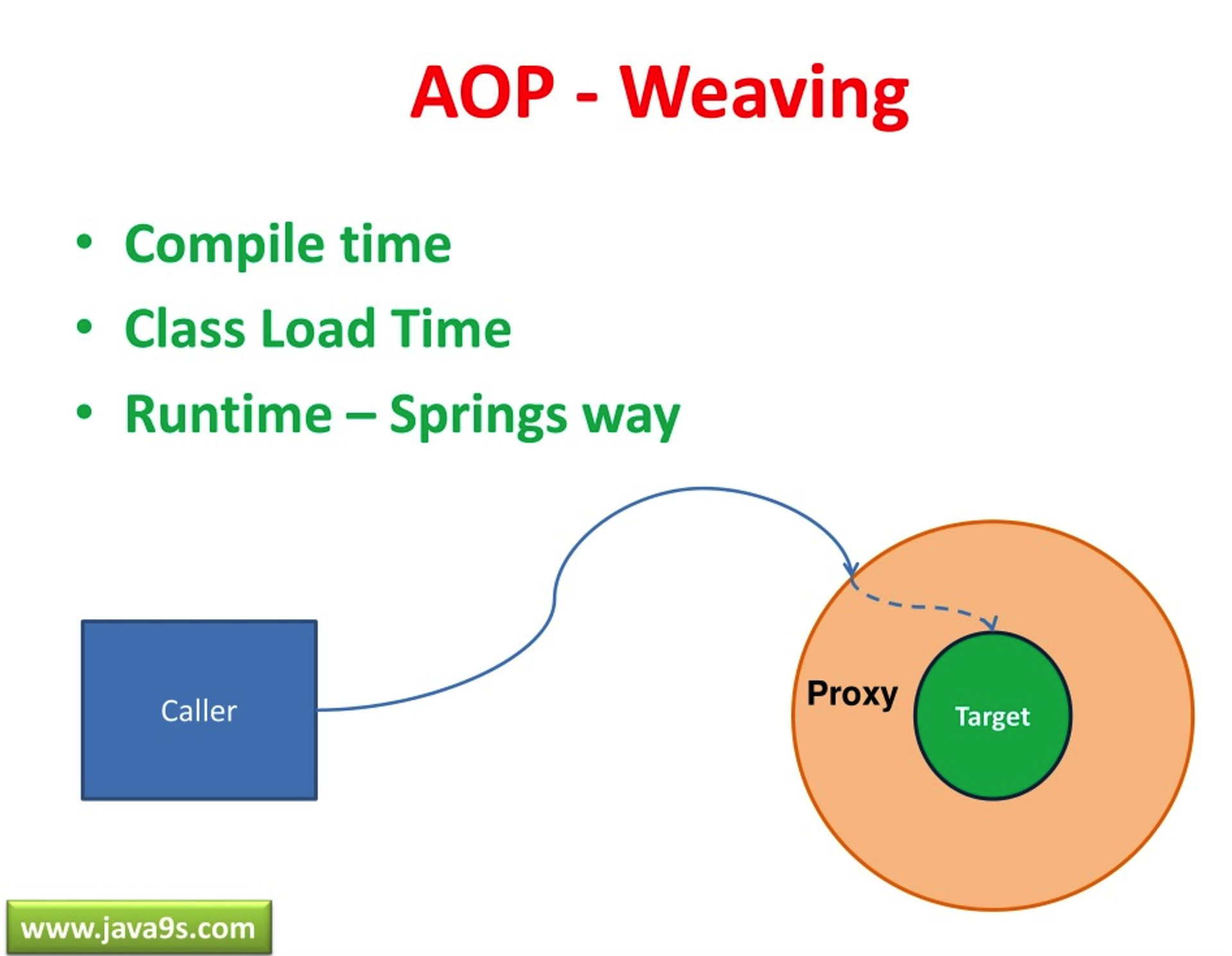

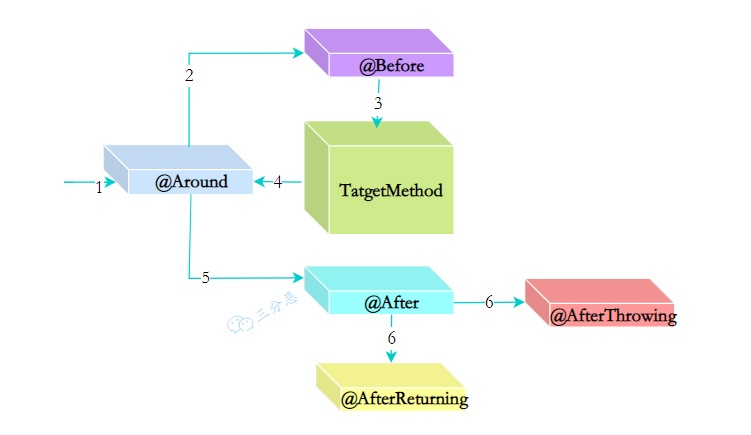

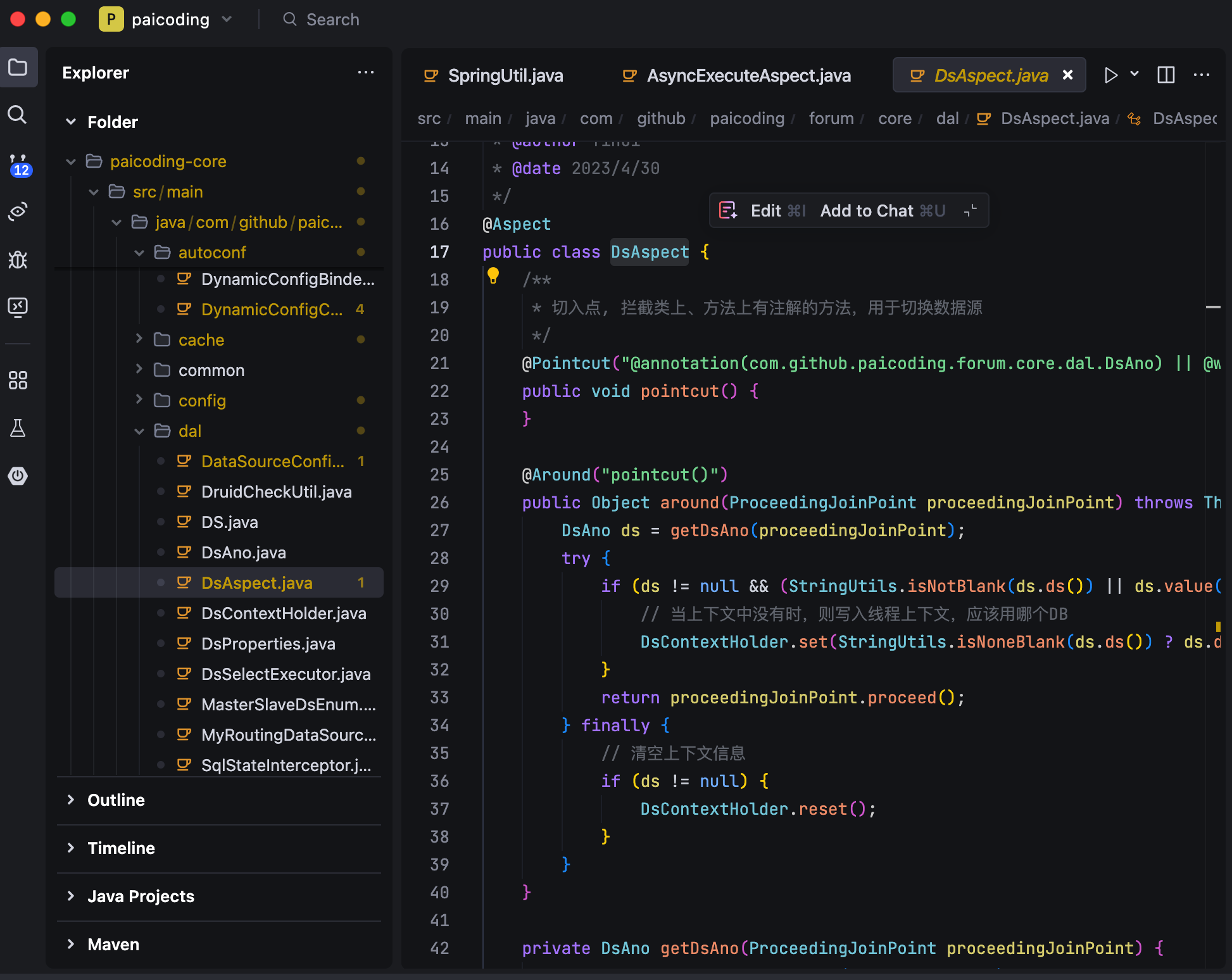

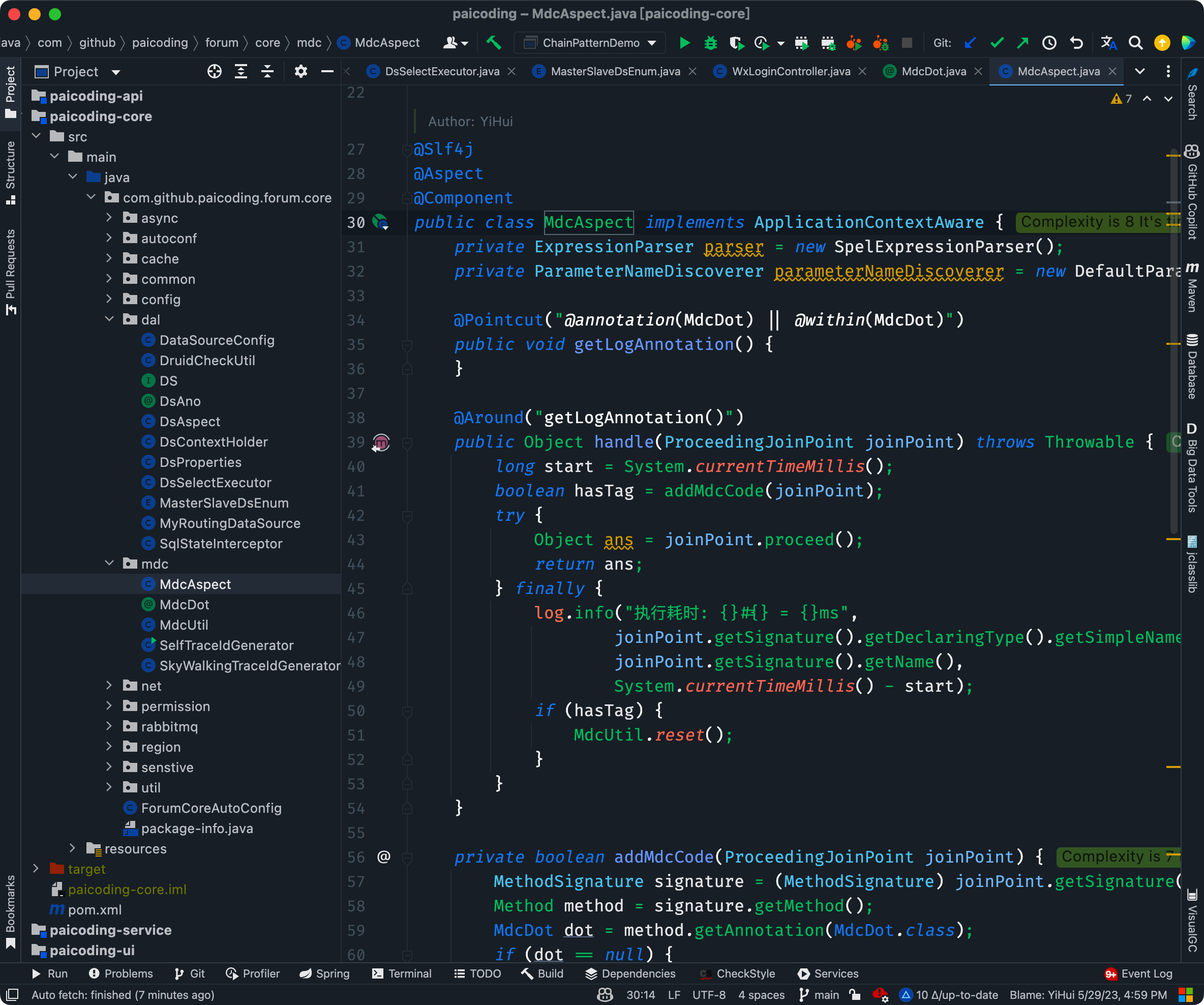

- 20.🌟说说什么是 AOP?

- 21.🌟AOP的应用场景有哪些?

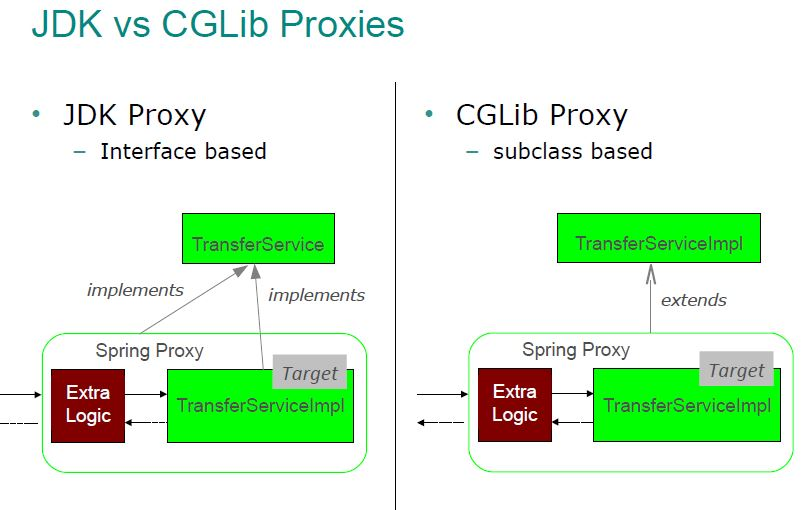

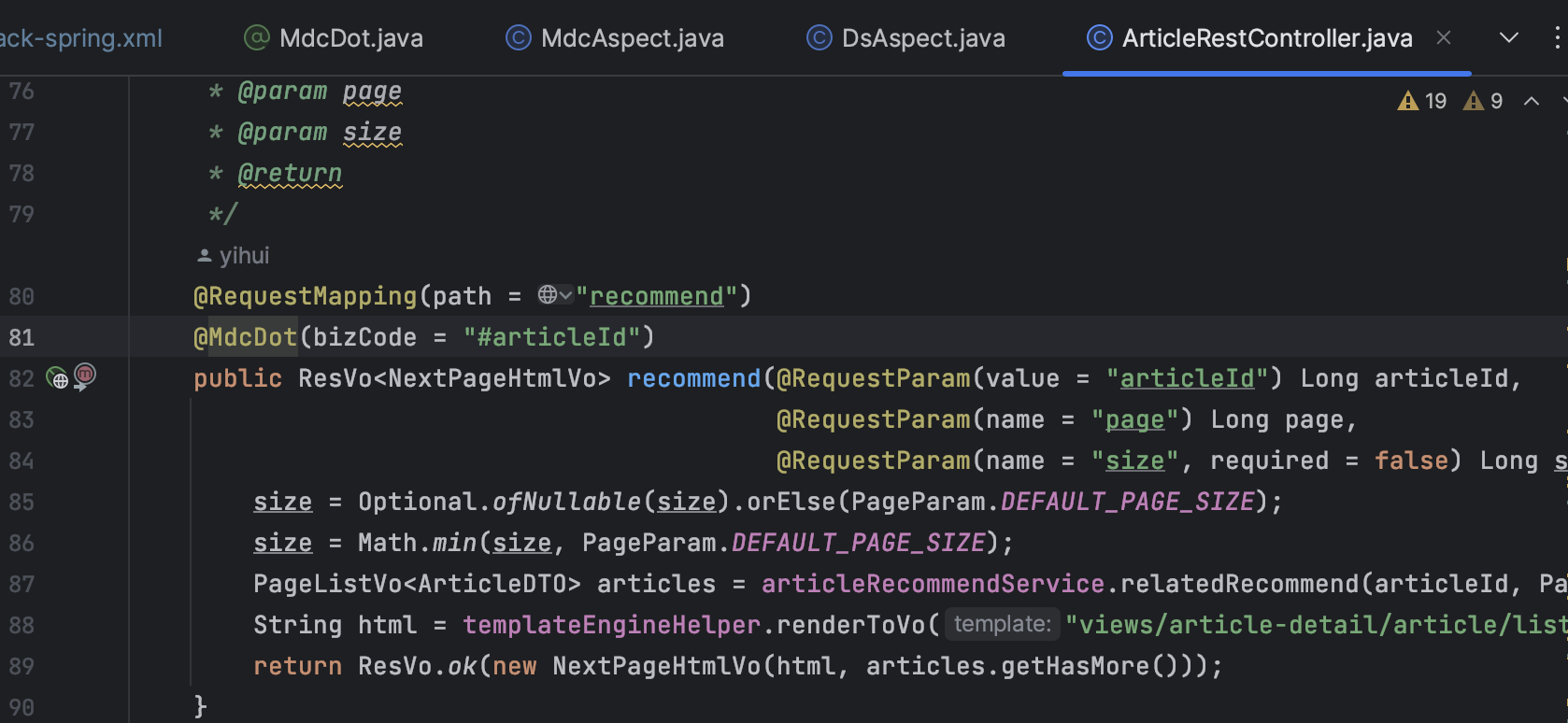

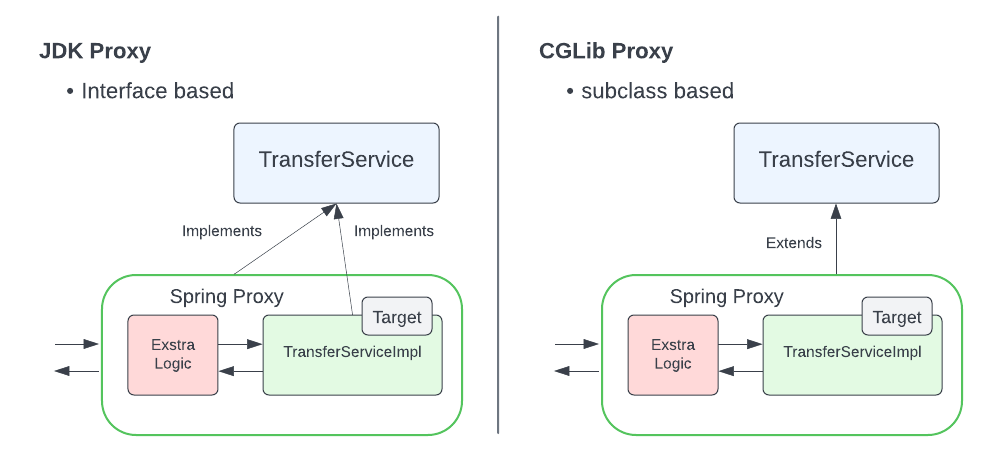

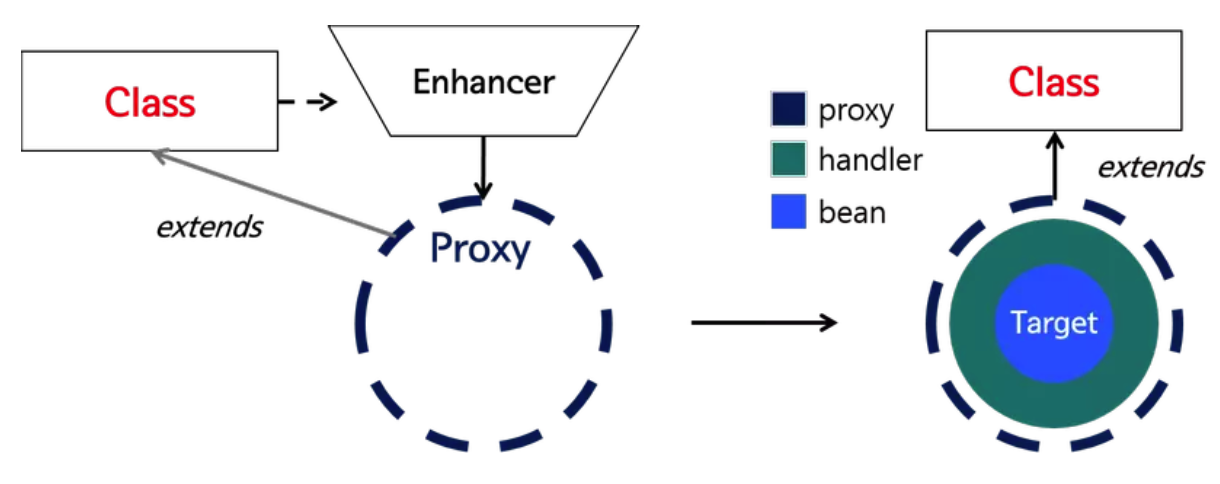

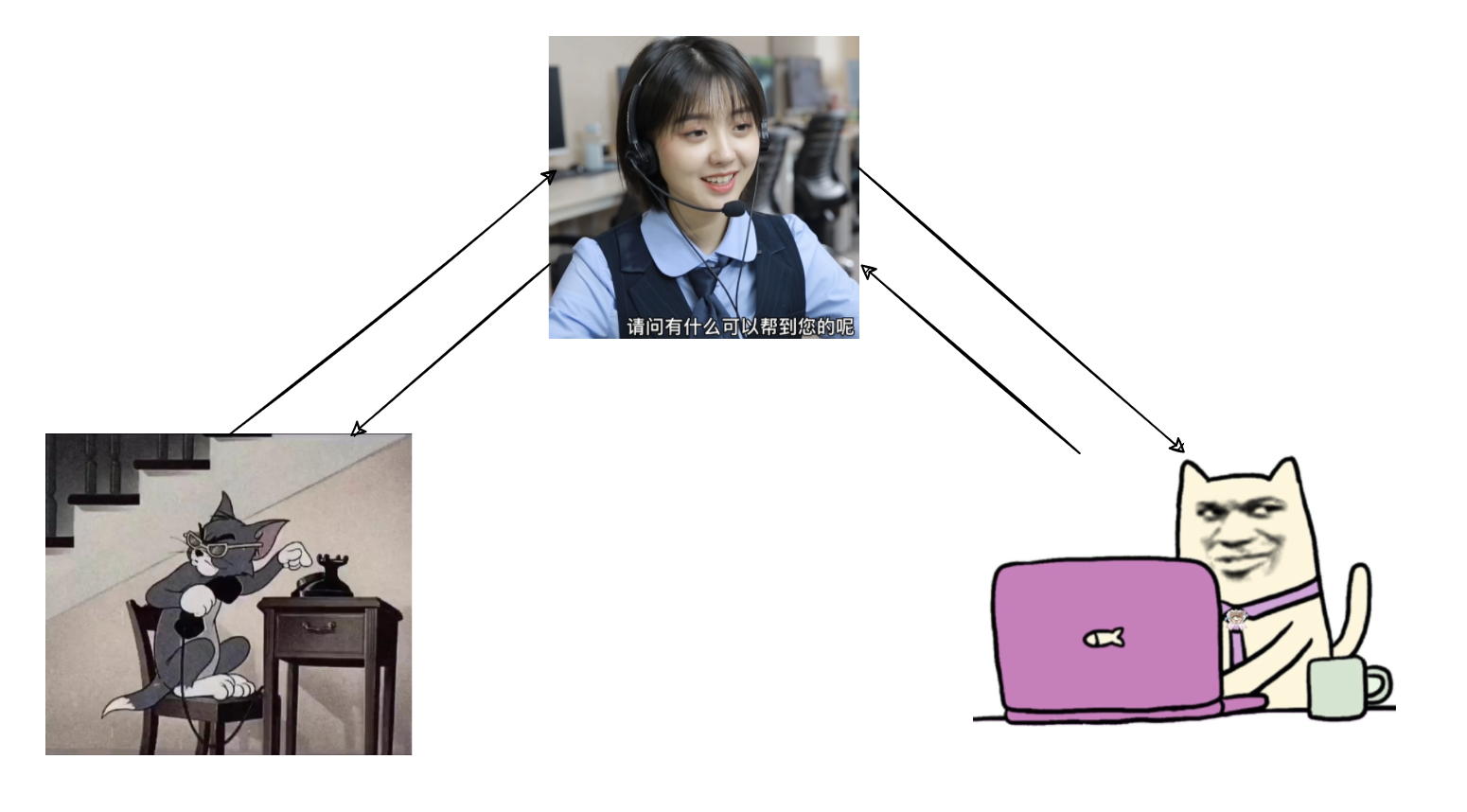

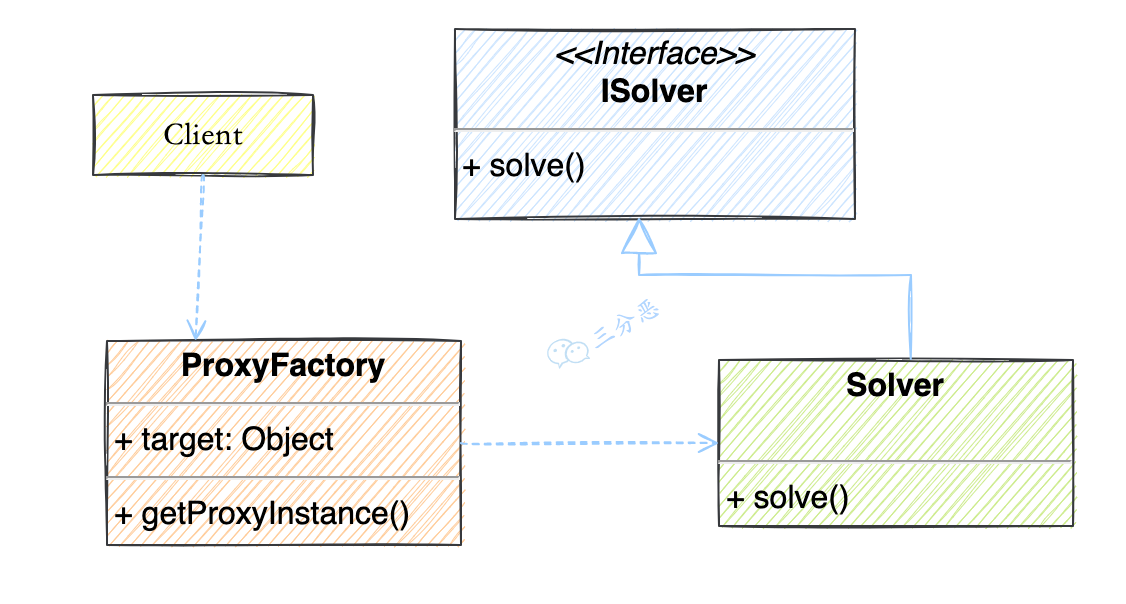

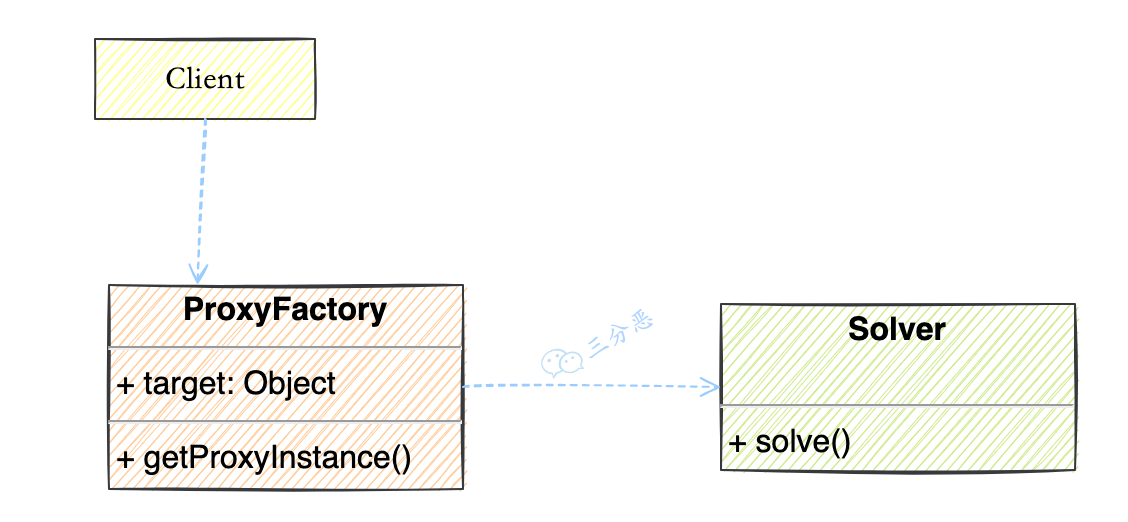

- 24.🌟说说JDK动态代理和CGLIB代理的区别?

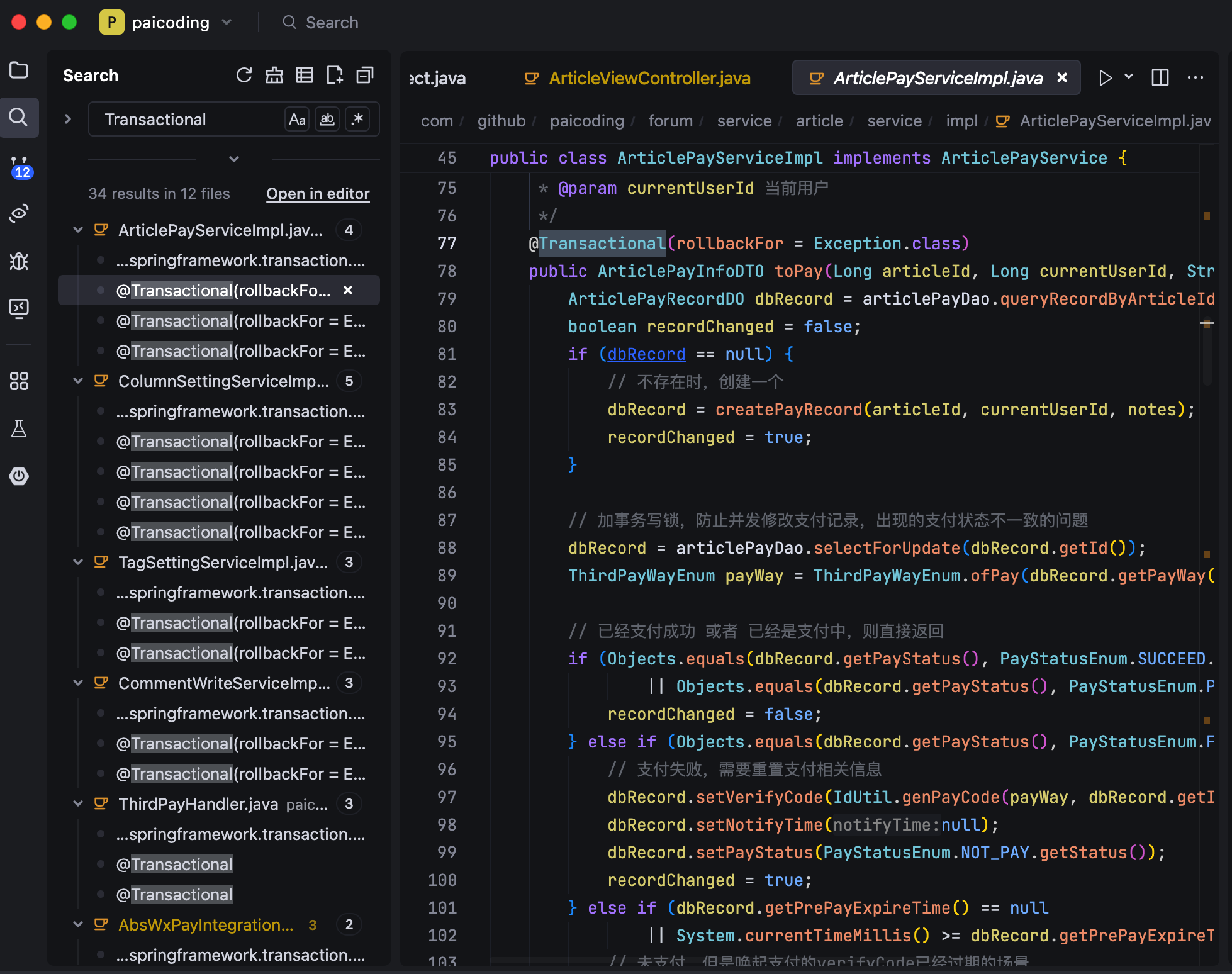

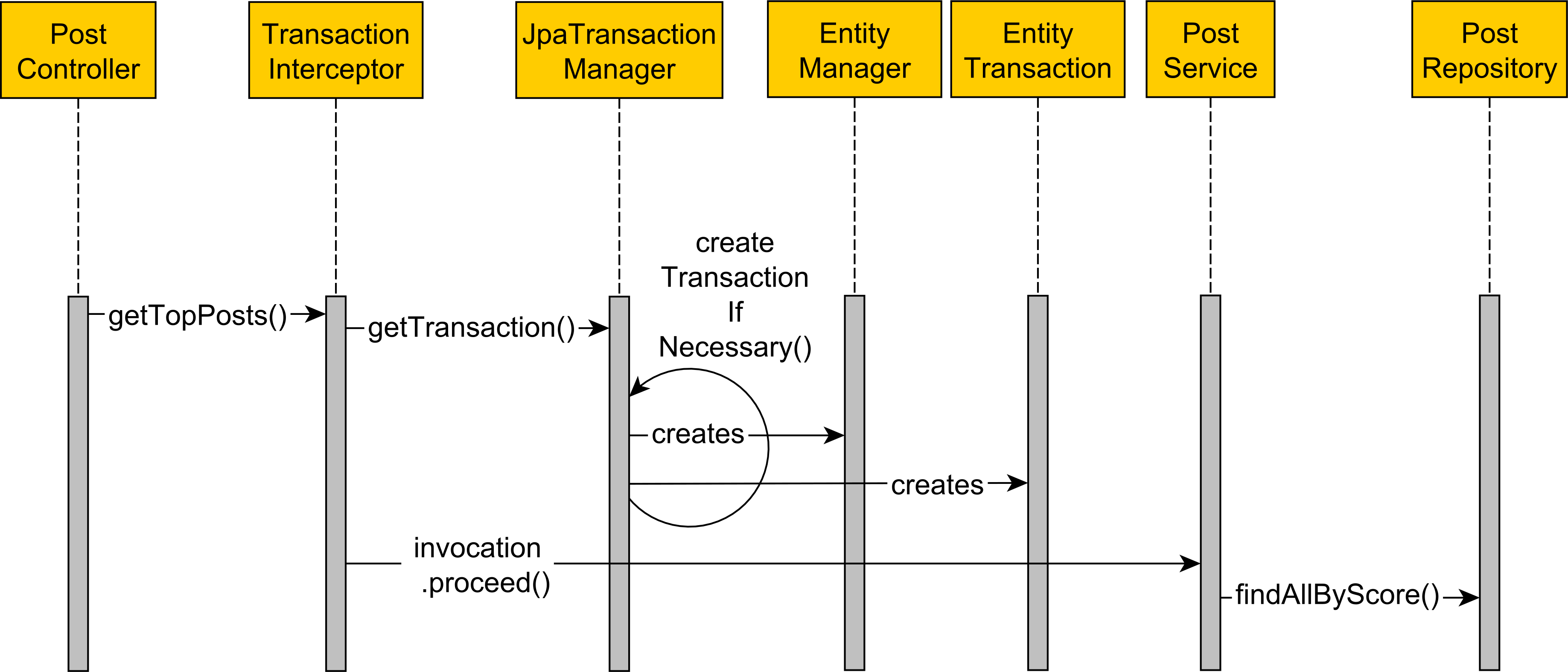

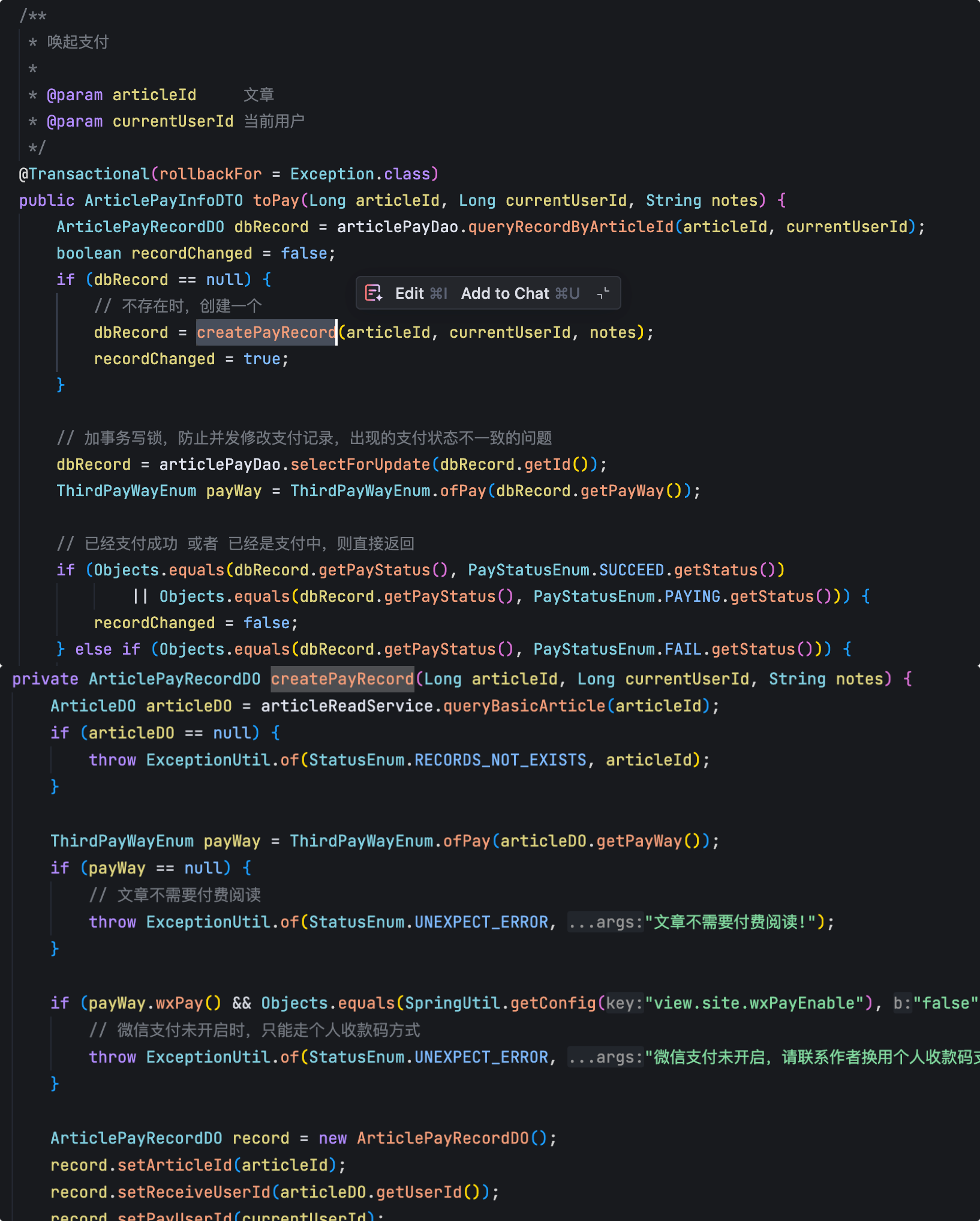

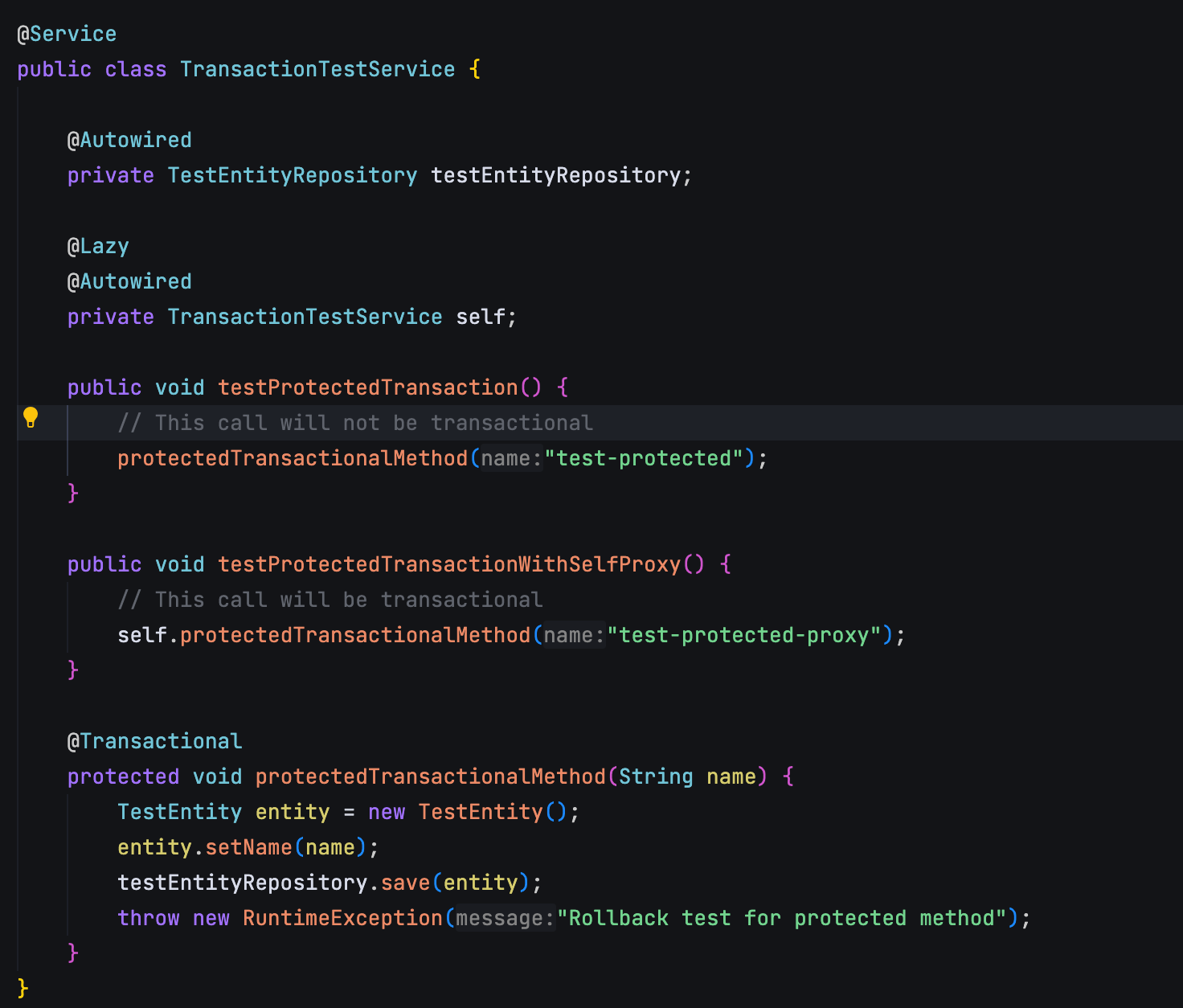

- 25.🌟说说你对Spring事务的理解?

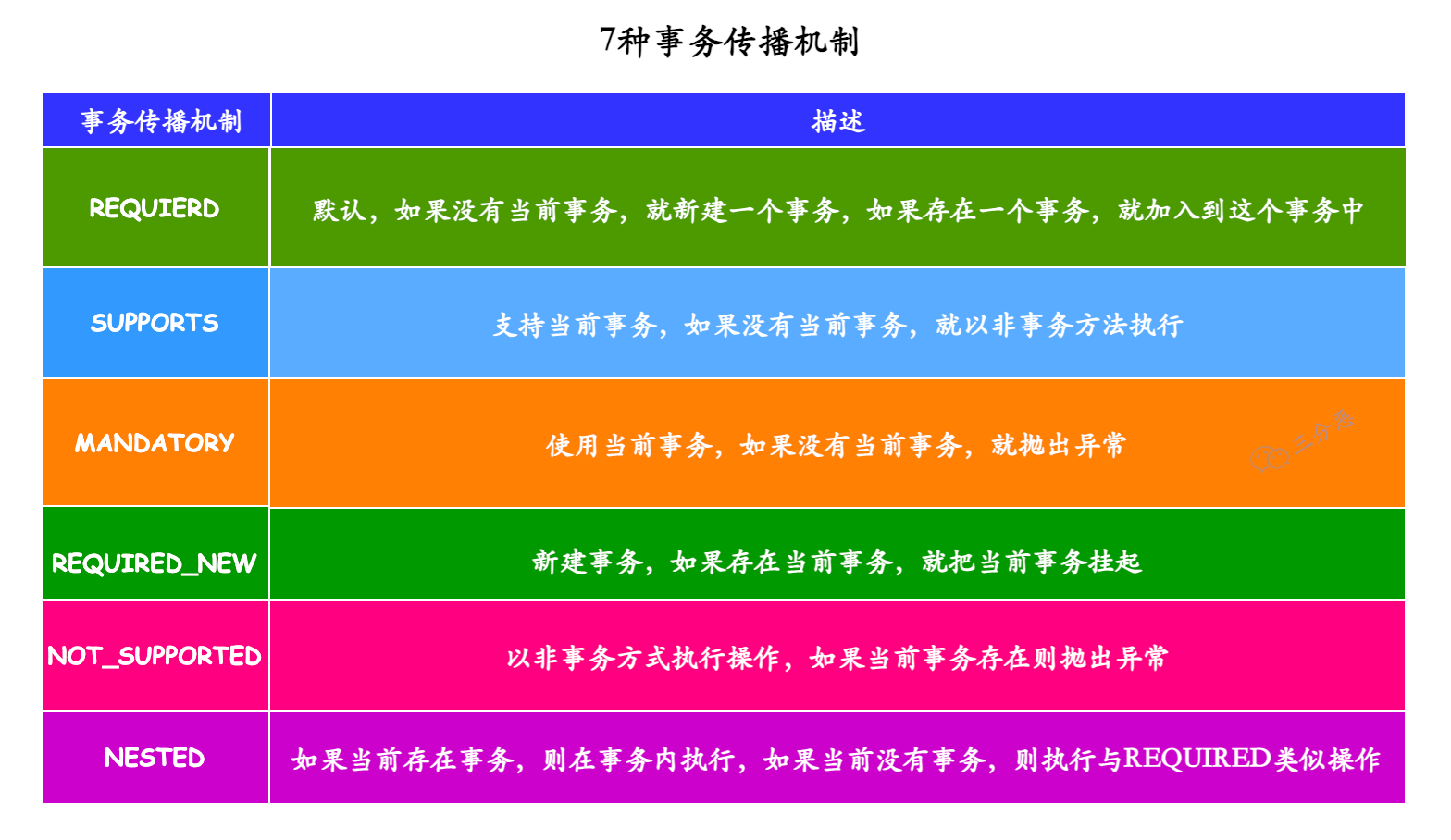

- 29.🌟说说Spring的事务传播机制?

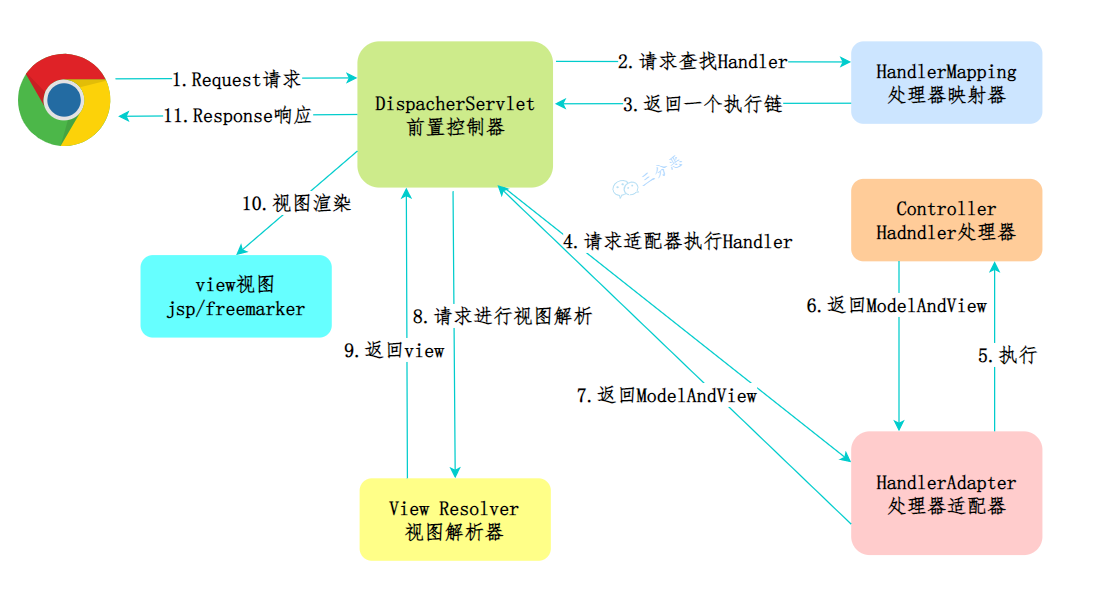

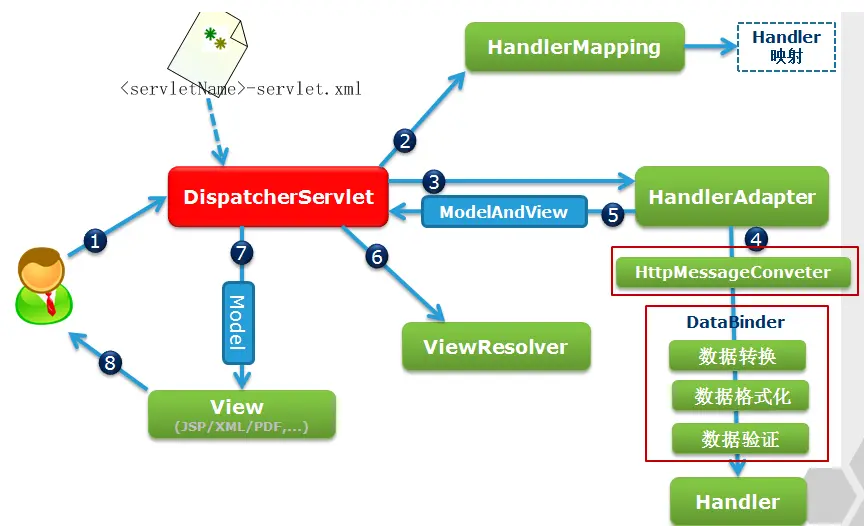

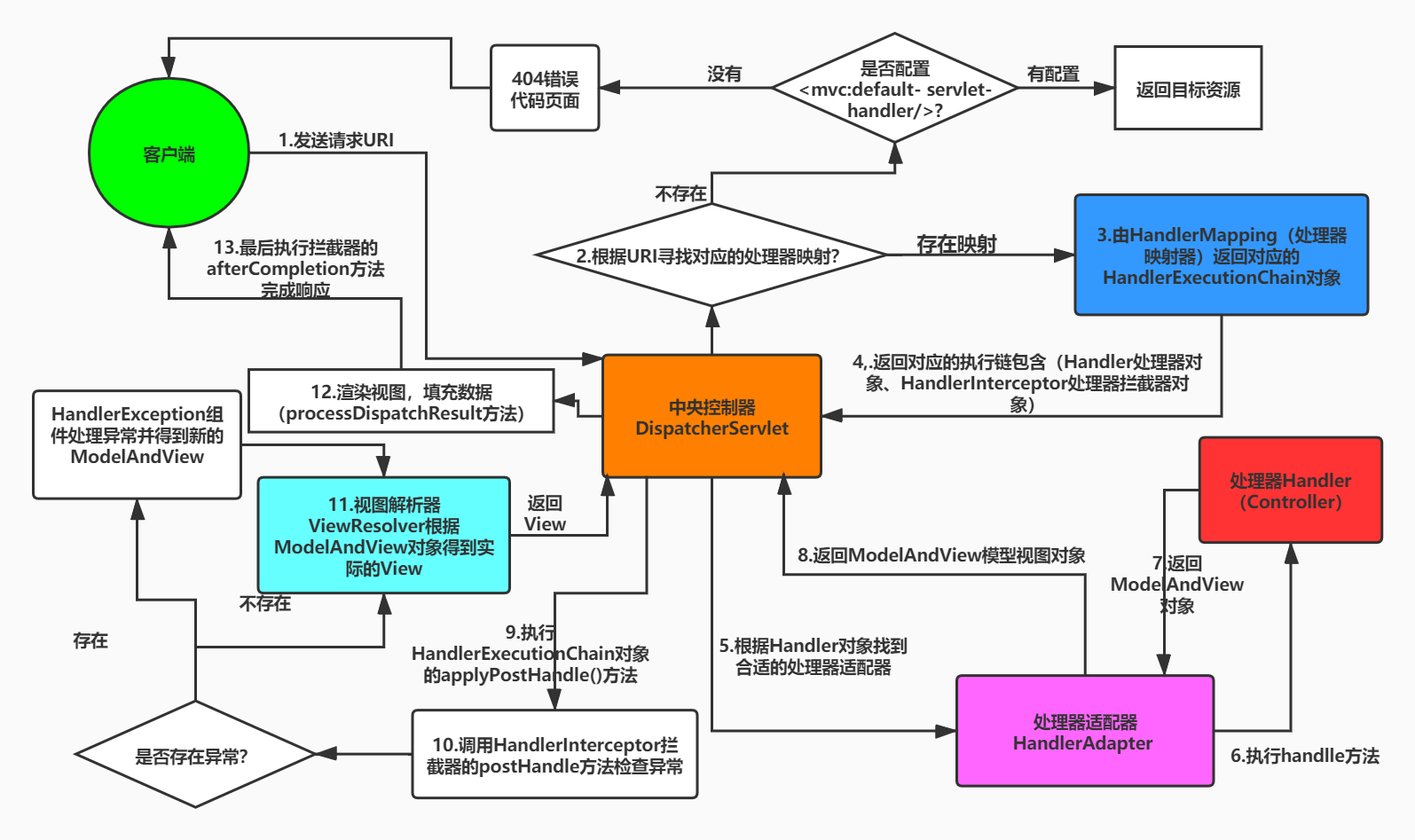

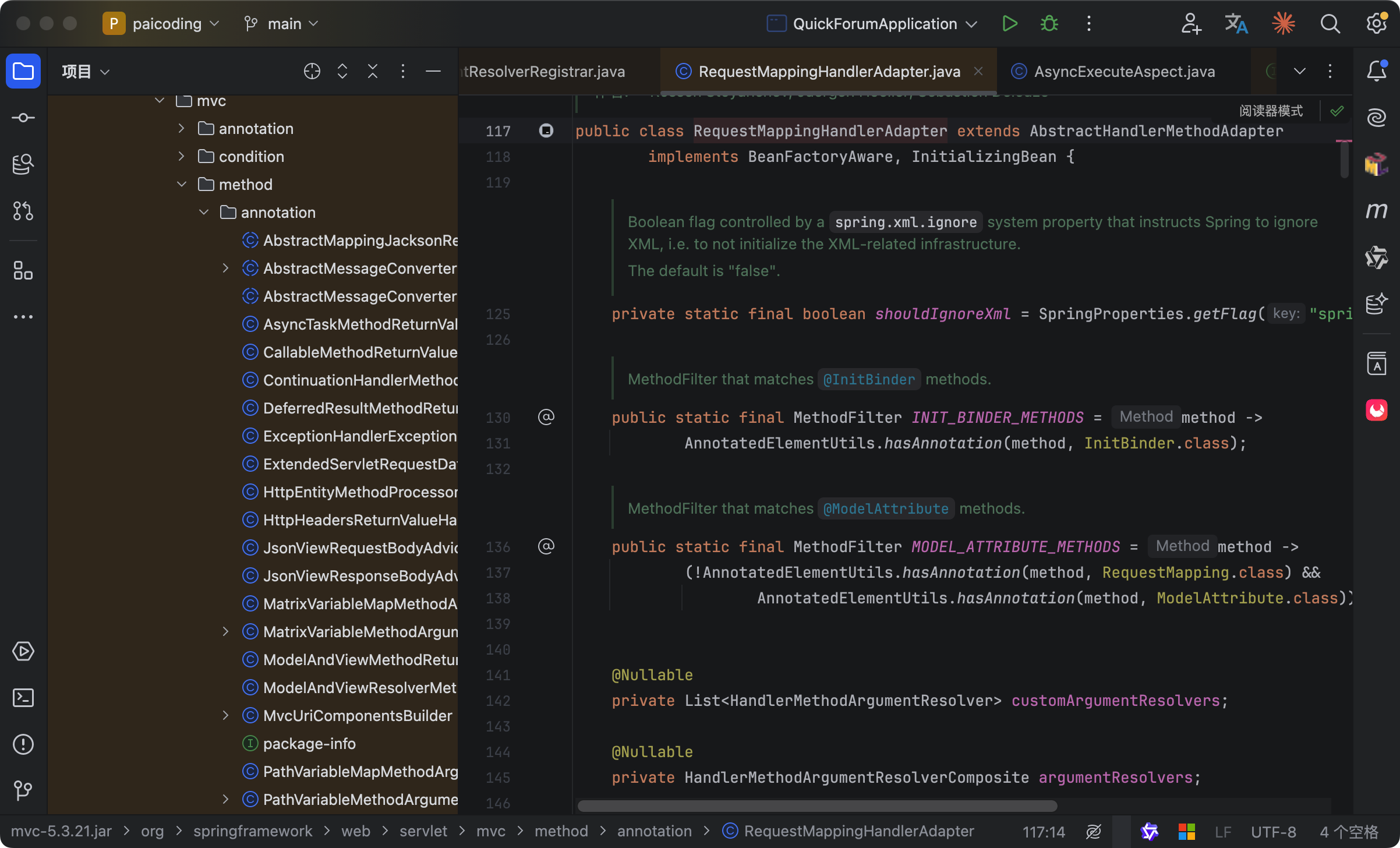

- 31.🌟Spring MVC 的工作流程了解吗?

- 33.🌟介绍一下 SpringBoot?

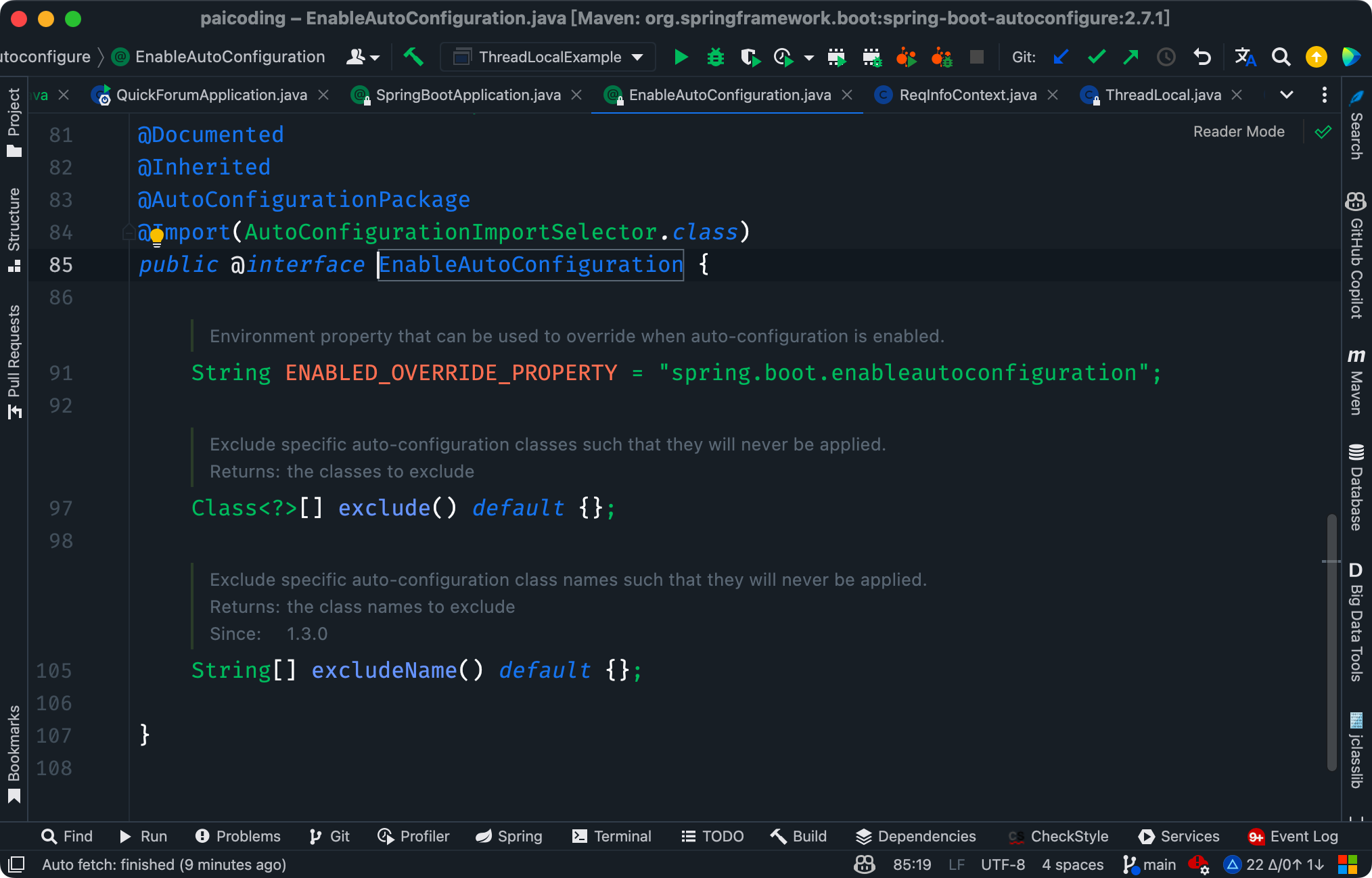

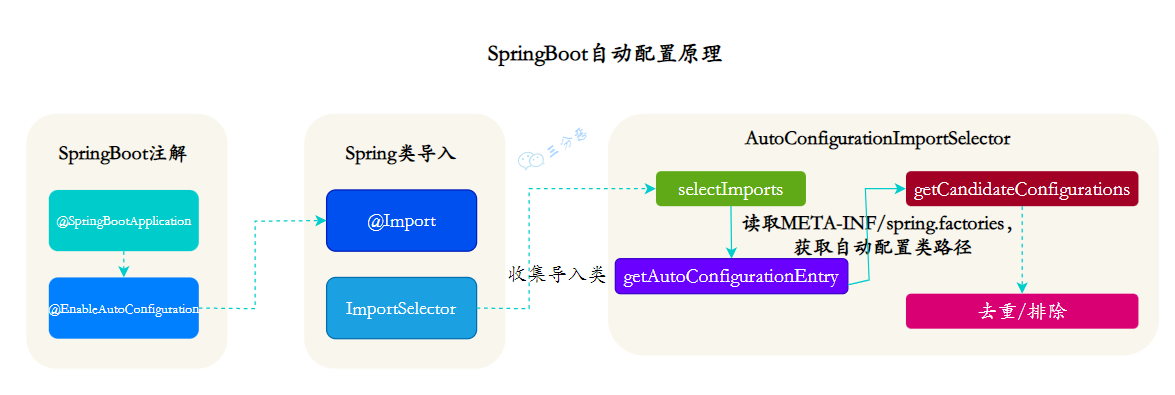

- 34.🌟Spring Boot的自动装配原理了解吗?

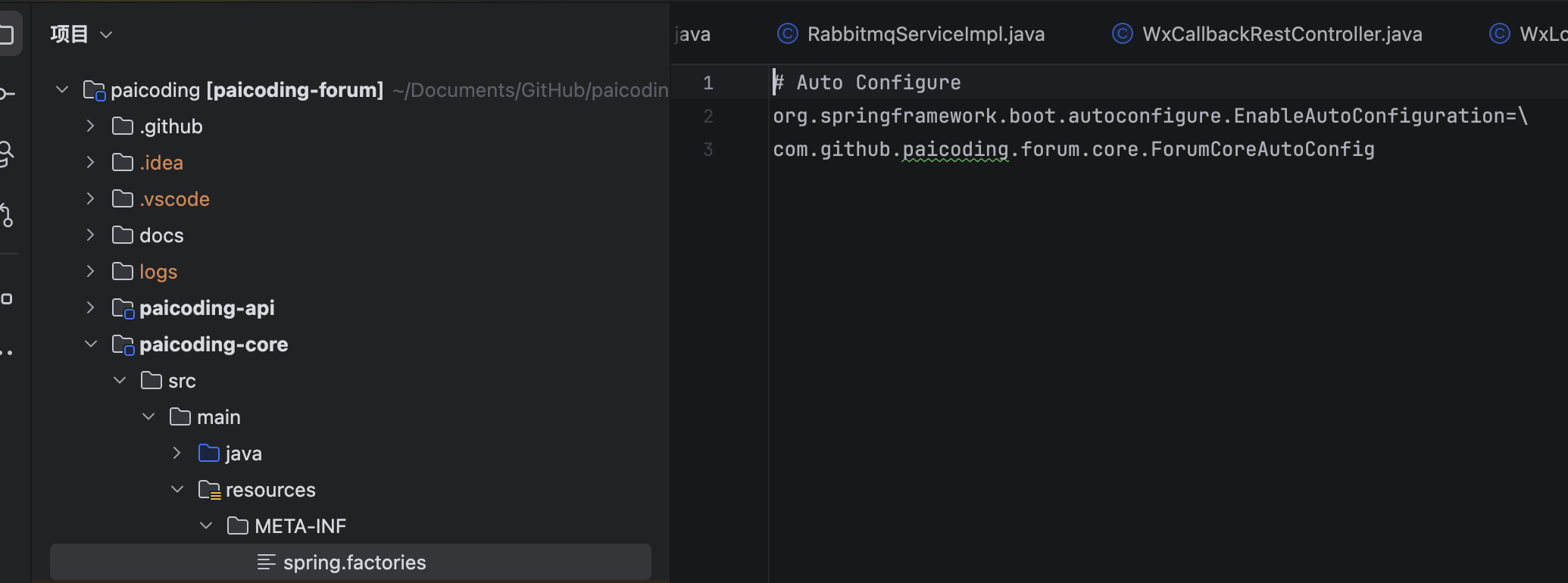

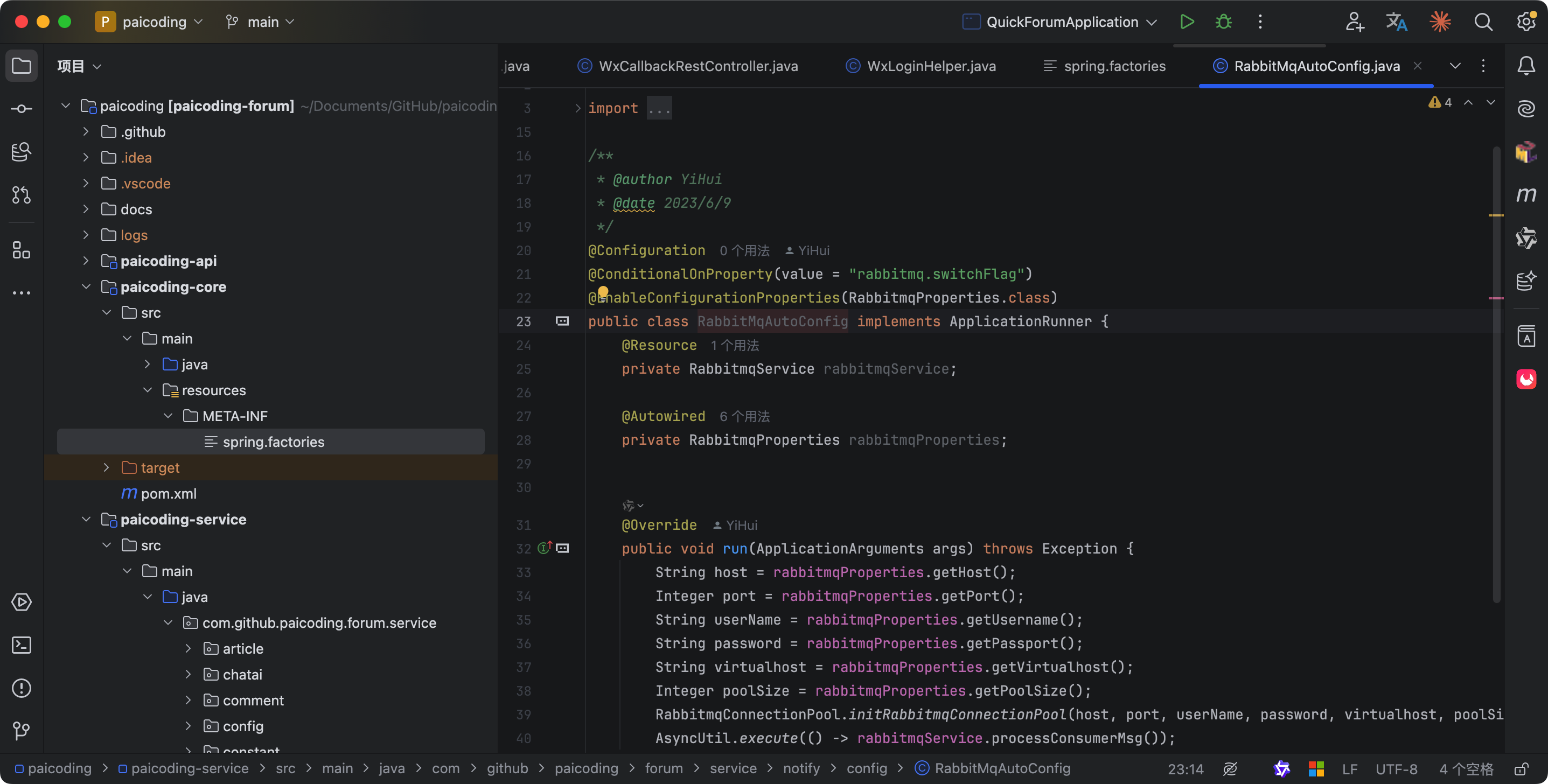

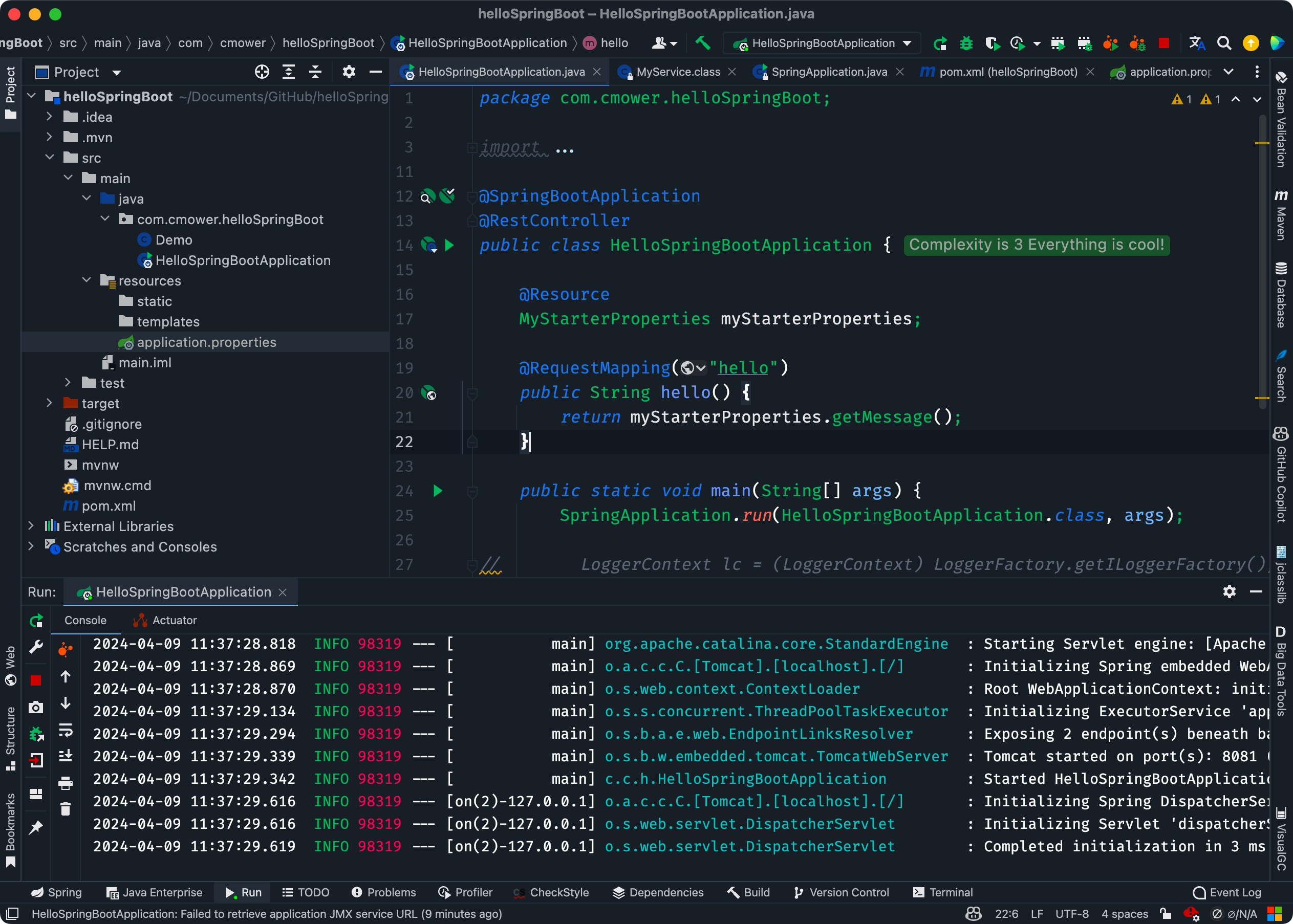

- 35.🌟如何自定义一个 SpringBoot Starter?

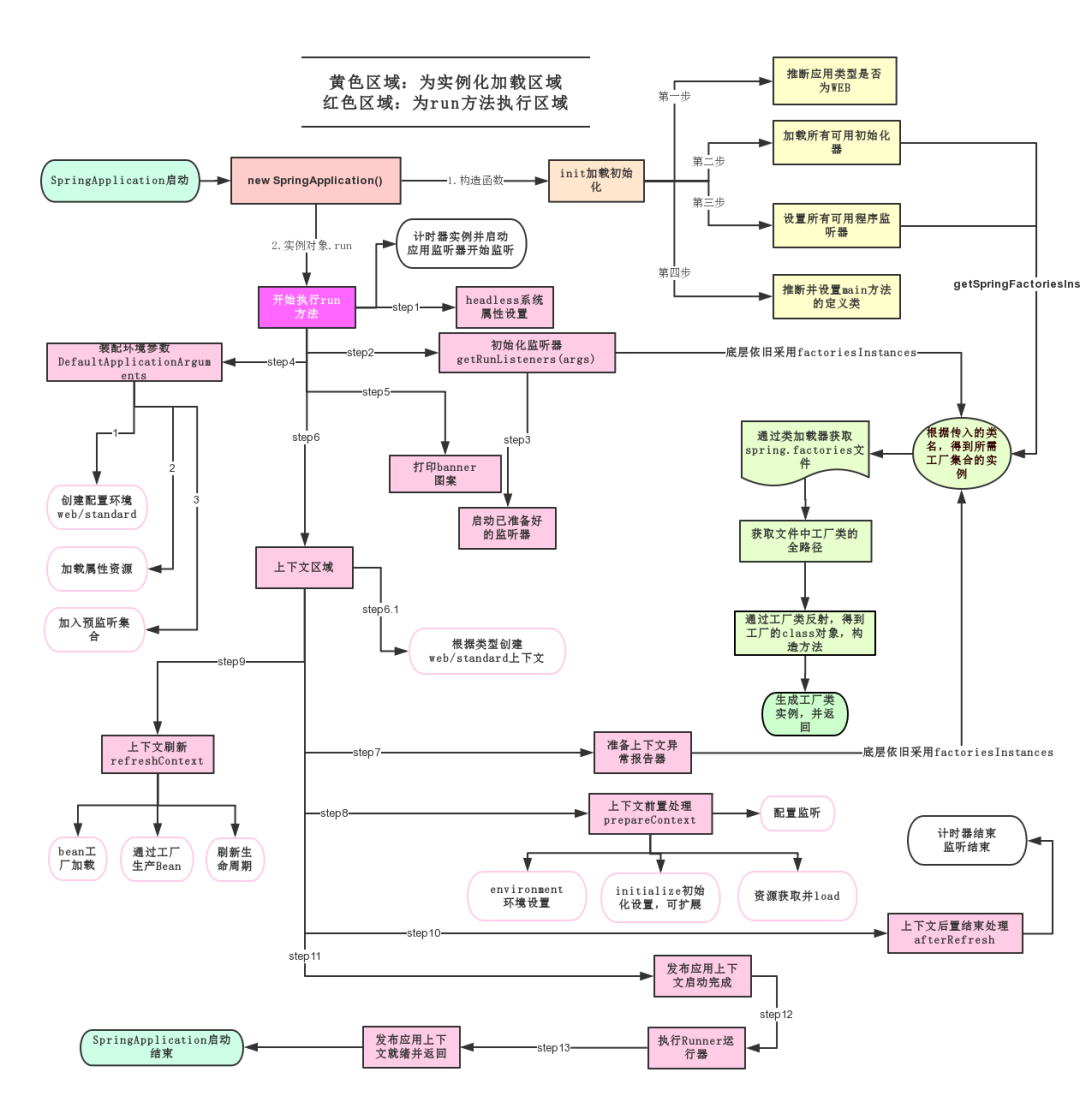

- 36.🌟Spring Boot 启动原理了解吗?

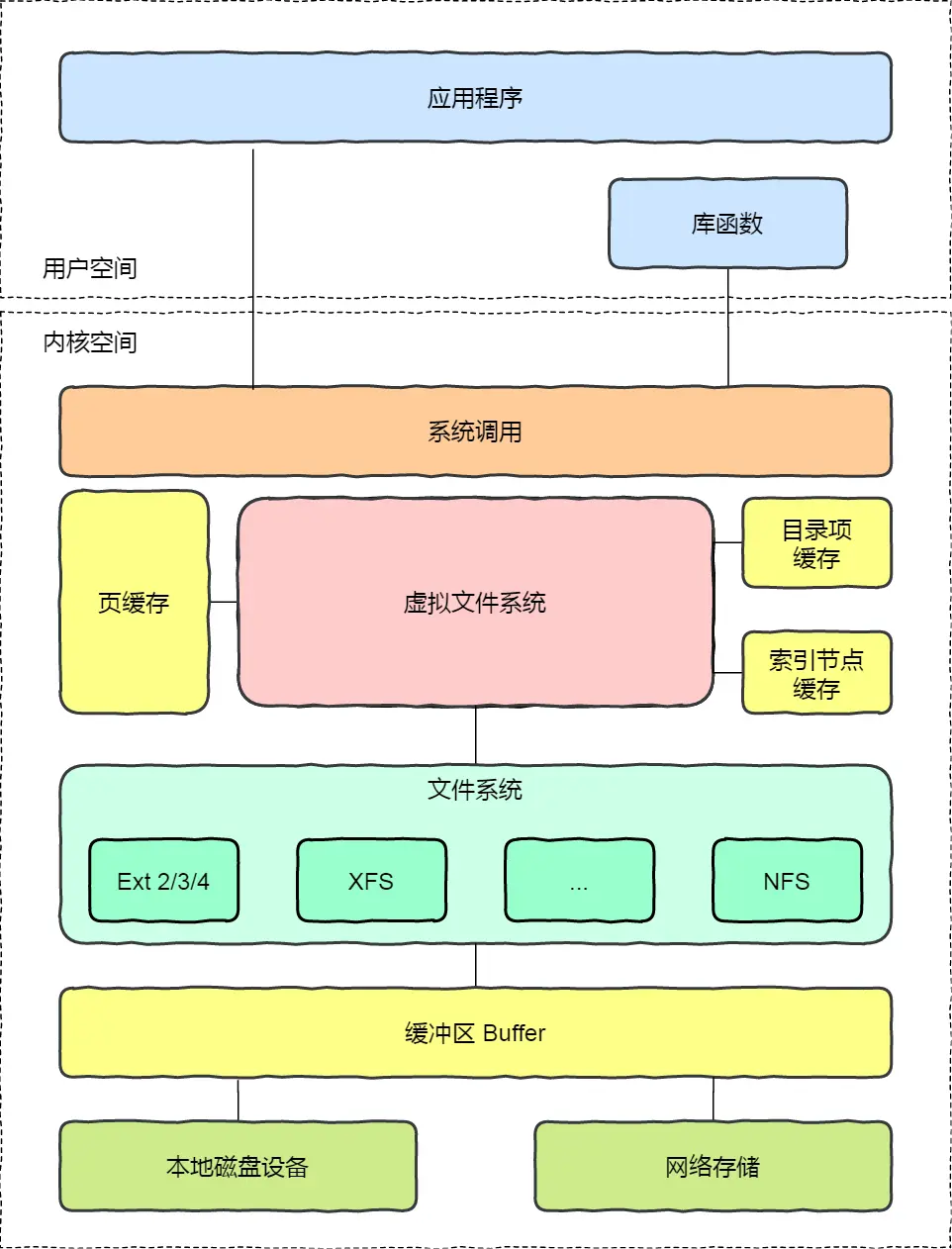

- 操作系统

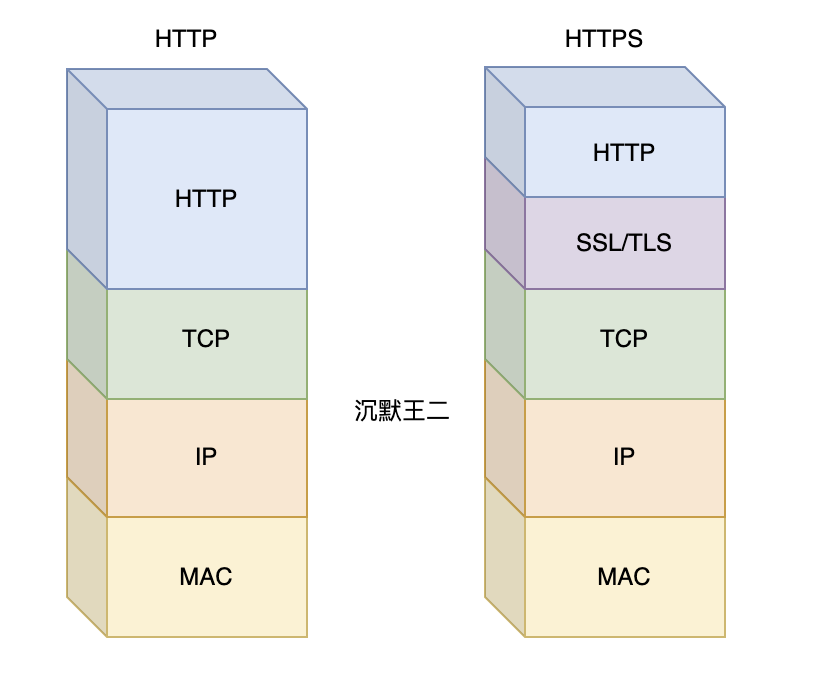

- 计算机网络

JavaSE

1.🌟什么是 Java?

Java 是一门面向对象的编程语言,由 Sun 公司的詹姆斯·高斯林团队于 1995 年推出。吸收了 C++ 语言中大量的优点,但又抛弃了 C++ 中容易出错的地方,如垃圾回收、指针。

同时,Java 又是一门平台无关的编程语言,即一次编译,处处运行。

只需要在对应的平台上安装 JDK,就可以实现跨平台,在 Windows、macOS、Linux 操作系统上运行。

Java 语言和 C 语言有哪些区别?

Java 是一种跨平台的编程语言,通过在不同操作系统上安装对应版本的 JVM 以实现“一次编译,处处运行”的目的。而 C 语言需要在不同的操作系统上重新编译。

Java 实现了内存的自动管理,而 C 语言需要使用 malloc 和 free 来手动管理内存。

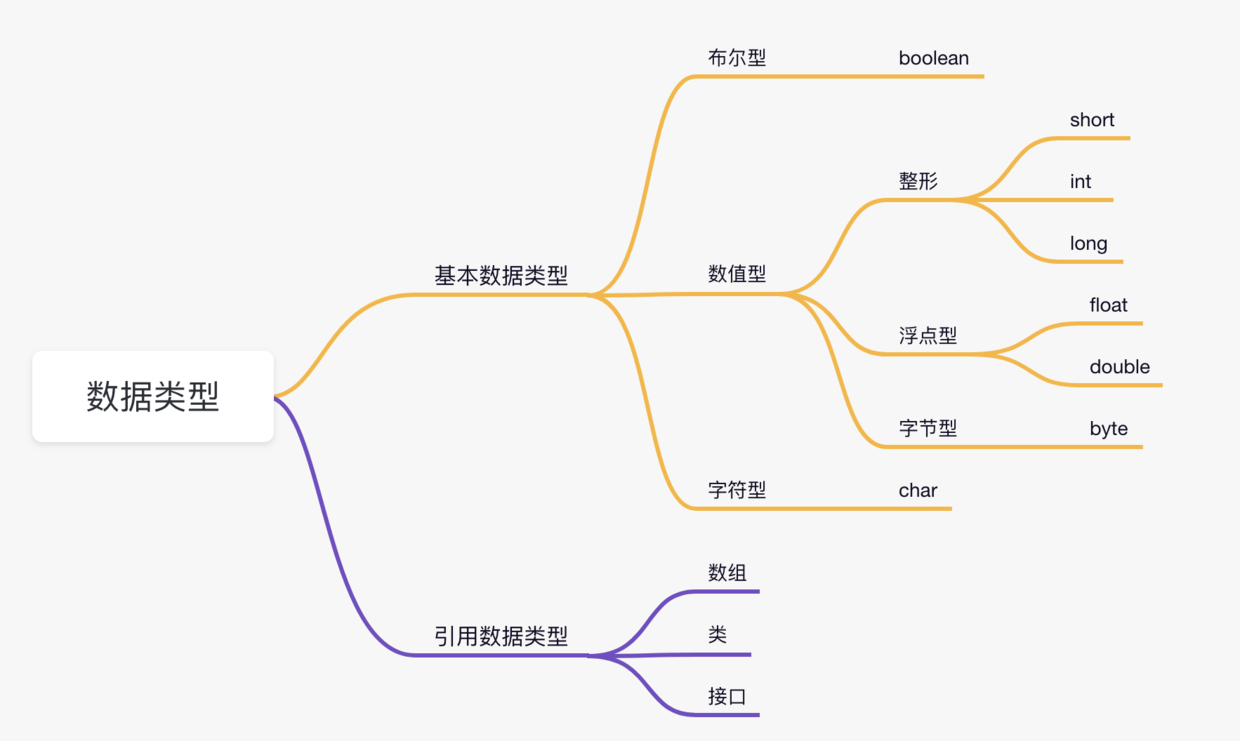

7.🌟Java 有哪些数据类型?

Java 的数据类型可以分为两种:基本数据类型和引用数据类型。

基本数据类型有:

①、数值型

- 整数类型(byte、short、int、long)

- 浮点类型(float、double)

②、字符型(char)

③、布尔型(boolean)

它们的默认值和占用大小如下所示:

引用数据类型有:

boolean 类型实际占用几个字节?

推荐阅读:Java 进阶之路:基本数据类型篇

这要依据具体的 JVM 实现细节。Java 虚拟机规范中,并没有明确规定 boolean 类型的大小,只规定了 boolean 类型的取值 true 或 false。

boolean: The boolean data type has only two possible values: true and false. Use this data type for simple flags that track true/false conditions. This data type represents one bit of information, but its “size” isn’t something that’s precisely defined.

我本机的 64 位 JDK 中,通过 JOL 工具查看单独的 boolean 类型,以及 boolean 数组,所占用的空间都是 1 个字节。

给Integer最大值+1,是什么结果?

当给 Integer.MAX_VALUE 加 1 时,会发生溢出,变成 Integer.MIN_VALUE。

1 | int maxValue = Integer.MAX_VALUE; |

这是因为 Java 的整数类型采用的是二进制补码表示法,溢出时值会变成最小值。

Integer.MAX_VALUE的二进制表示是01111111 11111111 11111111 11111111(32 位)。- 加 1 后结果变成

10000000 00000000 00000000 00000000,即 -2147483648(Integer.MIN_VALUE)。

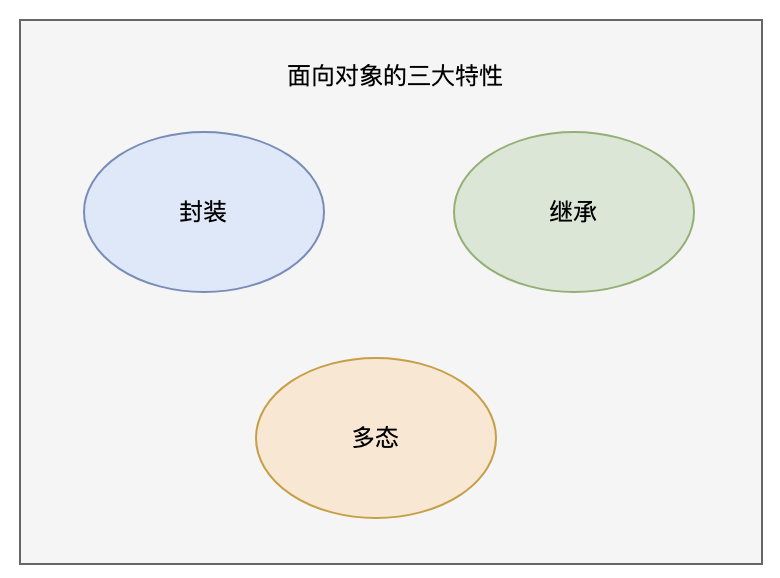

18.🌟面向对象编程有哪些特性?

推荐阅读:深入理解 Java 三大特性

面向对象编程有三大特性:封装、继承、多态。

封装是什么?

封装是指将数据(属性,或者叫字段)和操作数据的方法(行为)捆绑在一起,形成一个独立的对象(类的实例)。

1 | class Nvshen { |

可以看得出,女神类对外没有提供 age 的 getter 方法,因为女神的年龄要保密。

所以,封装是把一个对象的属性私有化,同时提供一些可以被外界访问的方法。

继承是什么?

继承允许一个类(子类)继承现有类(父类或者基类)的属性和方法。以提高代码的复用性,建立类之间的层次关系。

同时,子类还可以重写或者扩展从父类继承来的属性和方法,从而实现多态。

1 | class Person { |

Student 类继承了 Person 类的属性(name、age)和方法(eat),同时还有自己的属性(school)和方法(study)。

什么是多态?

多态允许不同类的对象对同一消息做出响应,但表现出不同的行为(即方法的多样性)。

多态其实是一种能力——同一个行为具有不同的表现形式;换句话说就是,执行一段代码,Java 在运行时能根据对象类型的不同产生不同的结果。

多态的前置条件有三个:

- 子类继承父类

- 子类重写父类的方法

- 父类引用指向子类的对象

1 |

|

为什么Java里面要多组合少继承?

继承适合描述“is-a”的关系,但继承容易导致类之间的强耦合,一旦父类发生改变,子类也要随之改变,违背了开闭原则(尽量不修改现有代码,而是添加新的代码来实现)。

组合适合描述“has-a”或“can-do”的关系,通过在类中组合其他类,能够更灵活地扩展功能。组合避免了复杂的类继承体系,同时遵循了开闭原则和松耦合的设计原则。

举个例子,假设我们采用继承,每种形状和样式的组合都会导致类的急剧增加:

1 | // 基类 |

组合模式更加灵活,可以将形状和颜色分开,松耦合。

1 | // 形状接口 |

形状干形状的事情。

1 | // 圆形的实现 |

颜色干颜色的事情。

1 | // 红色的实现 |

23.🌟抽象类和接口有什么区别?

一个类只能继承一个抽象类;但一个类可以实现多个接口。所以我们在新建线程类的时候一般推荐使用实现 Runnable 接口的方式,这样线程类还可以继承其他类,而不单单是 Thread 类。

抽象类符合 is-a 的关系,而接口更像是 has-a 的关系,比如说一个类可以序列化的时候,它只需要实现 Serializable 接口就可以了,不需要去继承一个序列化类。

抽象类更多地是用来为多个相关的类提供一个共同的基础框架,包括状态的初始化,而接口则是定义一套行为标准,让不同的类可以实现同一接口,提供行为的多样化实现。

抽象类可以定义构造方法吗?

可以,抽象类可以有构造方法。

1 | abstract class Animal { |

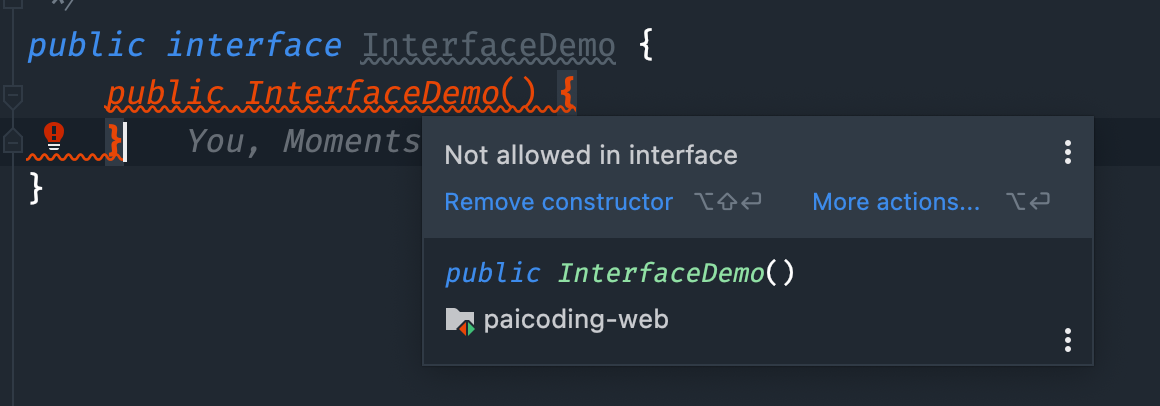

接口可以定义构造方法吗?

不能,接口主要用于定义一组方法规范,没有具体的实现细节。

Java支持多继承吗?

Java 不支持多继承,一个类只能继承一个类,多继承会引发菱形继承问题。

1 | class A { |

接口可以多继承吗?

接口可以多继承,一个接口可以继承多个接口,使用逗号分隔。

1 | interface InterfaceA { |

在上面的例子中,InterfaceA 和 InterfaceB 是两个独立的接口。

InterfaceC 继承了 InterfaceA 和 InterfaceB,并且定义了自己的方法 methodC。

MyClass 实现了 InterfaceC,因此需要实现 InterfaceA 和 InterfaceB 中的方法 methodA 和 methodB,以及 InterfaceC 中的方法 methodC。

继承和抽象的区别?

继承是一种允许子类继承父类属性和方法的机制。通过继承,子类可以重用父类的代码。

抽象是一种隐藏复杂性和只显示必要部分的技术。在面向对象编程中,抽象可以通过抽象类和接口实现。

抽象类和普通类的区别?

抽象类使用 abstract 关键字定义,不能被实例化,只能作为其他类的父类。普通类没有 abstract 关键字,可以直接实例化。

抽象类可以包含抽象方法和非抽象方法。抽象方法没有方法体,必须由子类实现。普通类只能包含非抽象方法。

1 | abstract class Animal { |

抽象类使用 abstract 关键字定义,不能被实例化,只能作为其他类的父类。普通类没有 abstract 关键字,可以直接实例化。

抽象类可以包含抽象方法和非抽象方法。抽象方法没有方法体,必须由子类实现。普通类只能包含非抽象方法。

1 | abstract class Animal { |

29.🌟为什么重写 equals 时必须重写 hashCode ⽅法?

因为基于哈希的集合类(如 HashMap)需要基于这一点来正确存储和查找对象。

具体地说,HashMap 通过对象的哈希码将其存储在不同的“桶”中,当查找对象时,它需要使用 key 的哈希码来确定对象在哪个桶中,然后再通过 equals() 方法找到对应的对象。

如果重写了 equals()方法而没有重写 hashCode()方法,那么被认为相等的对象可能会有不同的哈希码,从而导致无法在 HashMap 中正确处理这些对象。

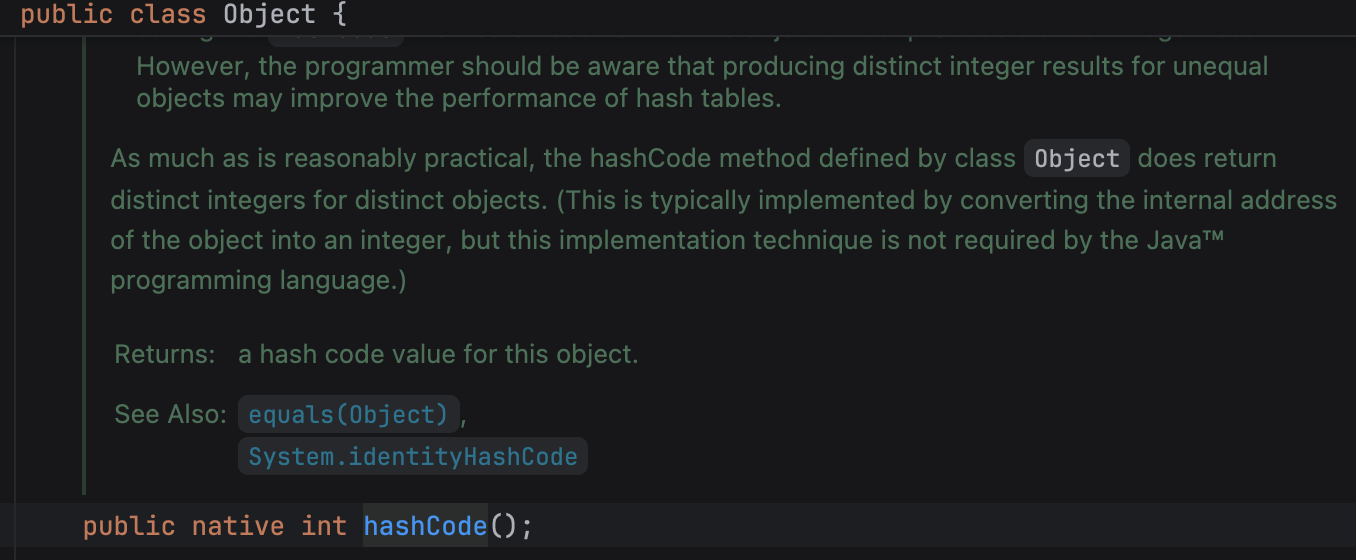

什么是 hashCode 方法?

hashCode() 方法的作⽤是获取哈希码,它会返回⼀个 int 整数,定义在 Object 类中, 是一个本地⽅法。

public native int hashCode();

为什么要有 hashCode 方法?

hashCode 方法主要用来获取对象的哈希码,哈希码是由对象的内存地址或者对象的属性计算出来的,它是⼀个 int 类型的整数,通常是不会重复的,因此可以用来作为键值对的建,以提高查询效率。

例如 HashMap 中的 key 就是通过 hashCode 来实现的,通过调用 hashCode 方法获取键的哈希码,并将其与右移 16 位的哈希码进行异或运算。

1 | static final int hash(Object key) { |

为什么两个对象有相同的 hashcode 值,它们也不⼀定相等?

这主要是由于哈希码(hashCode)的本质和目的所决定的。

哈希码是通过哈希函数将对象中映射成一个整数值,其主要目的是在哈希表中快速定位对象的存储位置。

由于哈希函数将一个较大的输入域映射到一个较小的输出域,不同的输入值(即不同的对象)可能会产生相同的输出值(即相同的哈希码)。

这种情况被称为哈希冲突。当两个不相等的对象发生哈希冲突时,它们会有相同的 hashCode。

为了解决哈希冲突的问题,哈希表在处理键时,不仅会比较键对象的哈希码,还会使用 equals 方法来检查键对象是否真正相等。如果两个对象的哈希码相同,但通过 equals 方法比较结果为 false,那么这两个对象就不被视为相等。

1 | if (p.hash == hash && |

hashCode 和 equals 方法的关系?

如果两个对象通过 equals 相等,它们的 hashCode 必须相等。否则会导致哈希表类数据结构(如 HashMap、HashSet)的行为异常。

在哈希表中,如果 equals 相等但 hashCode 不相等,哈希表可能无法正确处理这些对象,导致重复元素或键值冲突等问题。

34.🌟String 和 StringBuilder、StringBuffer 的区别?

推荐阅读:StringBuffer 和 StringBuilder 两兄弟

String、StringBuilder和StringBuffer在 Java 中都是用于处理字符串的,它们之间的区别是,String 是不可变的,平常开发用得最多,当遇到大量字符串连接时,就用 StringBuilder,它不会生成很多新的对象,StringBuffer 和 StringBuilder 类似,但每个方法上都加了 synchronized 关键字,所以是线程安全的。

请说说 String 的特点

String类的对象是不可变的。也就是说,一旦一个String对象被创建,它所包含的字符串内容是不可改变的。- 每次对

String对象进行修改操作(如拼接、替换等)实际上都会生成一个新的String对象,而不是修改原有对象。这可能会导致内存和性能开销,尤其是在大量字符串操作的情况下。

请说说 StringBuilder 的特点

StringBuilder提供了一系列的方法来进行字符串的增删改查操作,这些操作都是直接在原有字符串对象的底层数组上进行的,而不是生成新的 String 对象。StringBuilder不是线程安全的。这意味着在没有外部同步的情况下,它不适用于多线程环境。- 相比于

String,在进行频繁的字符串修改操作时,StringBuilder能提供更好的性能。 Java 中的字符串连+操作其实就是通过StringBuilder实现的。

请说说 StringBuffer 的特点

StringBuffer和StringBuilder类似,但StringBuffer是线程安全的,方法前面都加了synchronized关键字。

请总结一下使用场景

- String:适用于字符串内容不会改变的场景,比如说作为 HashMap 的 key。

- StringBuilder:适用于单线程环境下需要频繁修改字符串内容的场景,比如在循环中拼接或修改字符串,是 String 的完美替代品。

- StringBuffer:现在已经不怎么用了,因为一般不会在多线程场景下去频繁的修改字符串内容。

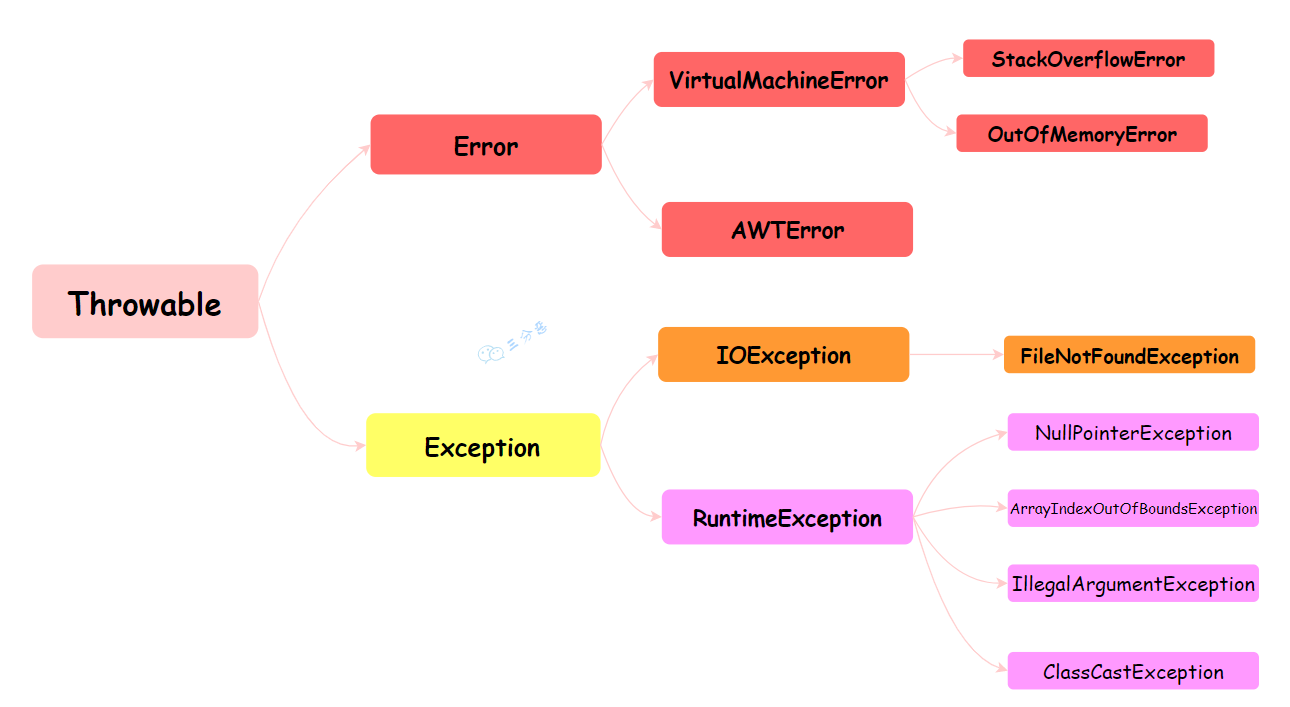

41.🌟Java 中异常处理体系?

推荐阅读:一文彻底搞懂 Java 异常处理

Java 中的异常处理机制用于处理程序运行过程中可能发生的各种异常情况,通常通过 try-catch-finally 语句和 throw 关键字来实现。

Throwable 是 Java 语言中所有错误和异常的基类。它有两个主要的子类:Error 和 Exception,这两个类分别代表了 Java 异常处理体系中的两个分支。

Error 类代表那些严重的错误,这类错误通常是程序无法处理的。比如,OutOfMemoryError 表示内存不足,StackOverflowError 表示栈溢出。这些错误通常与 JVM 的运行状态有关,一旦发生,应用程序通常无法恢复。

Exception 类代表程序可以处理的异常。它分为两大类:编译时异常(Checked Exception)和运行时异常(Runtime Exception)。

①、编译时异常(Checked Exception):这类异常在编译时必须被显式处理(捕获或声明抛出)。

如果方法可能抛出某种编译时异常,但没有捕获它(try-catch)或没有在方法声明中用 throws 子句声明它,那么编译将不会通过。例如:IOException、SQLException 等。

②、运行时异常(Runtime Exception):这类异常在运行时抛出,它们都是 RuntimeException 的子类。对于运行时异常,Java 编译器不要求必须处理它们(即不需要捕获也不需要声明抛出)。

运行时异常通常是由程序逻辑错误导致的,如NullPointerException、IndexOutOfBoundsException 等。

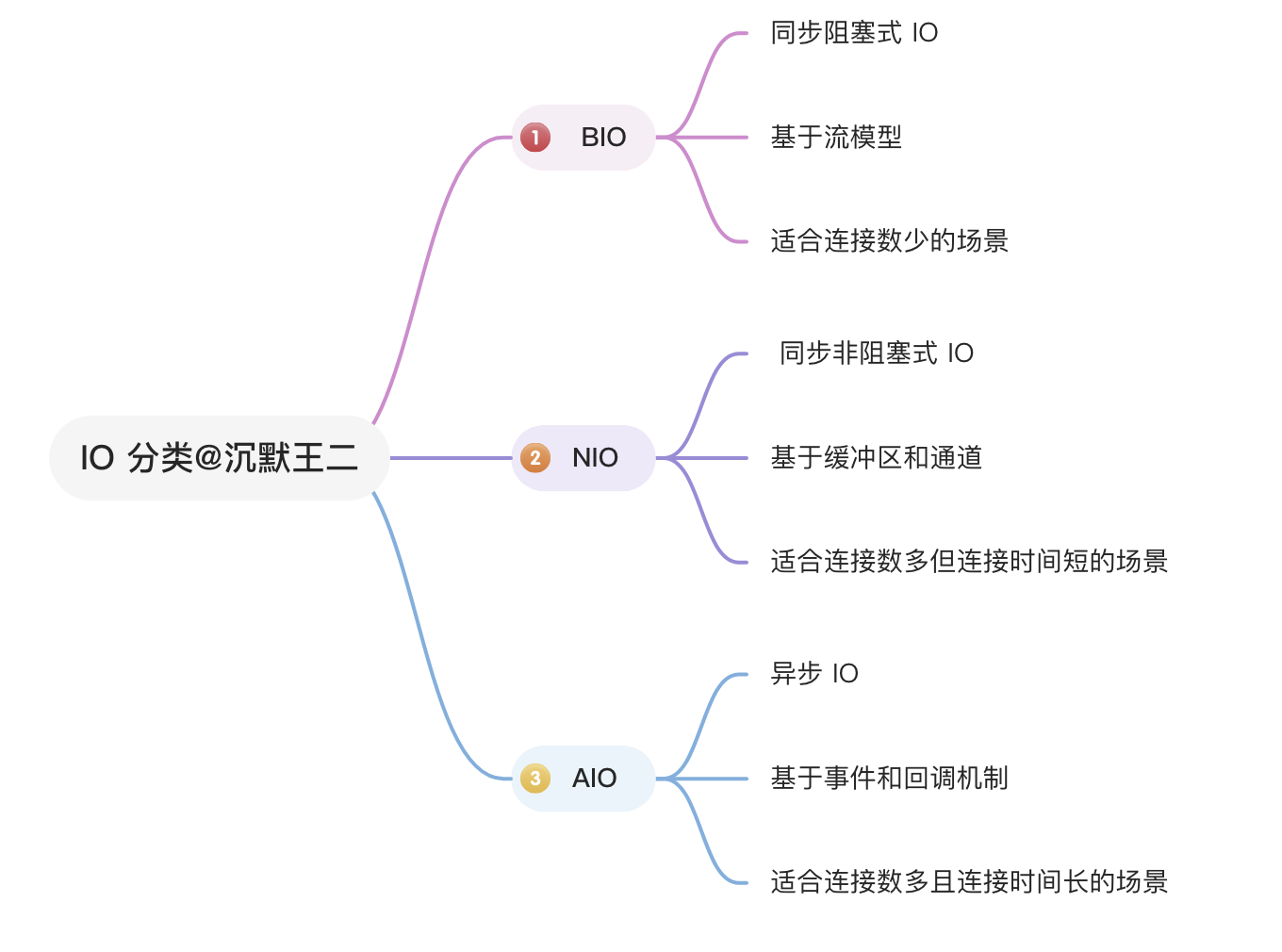

46.🌟BIO、NIO、AIO 之间的区别?

Java 常见的 IO 模型有三种:BIO、NIO 和 AIO。

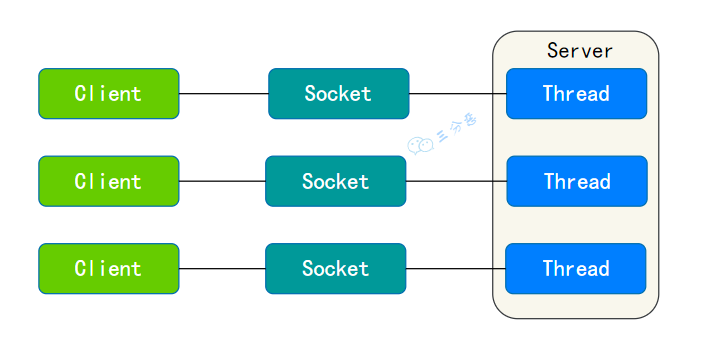

BIO:采用阻塞式 I/O 模型,线程在执行 I/O 操作时被阻塞,无法处理其他任务,适用于连接数较少的场景。

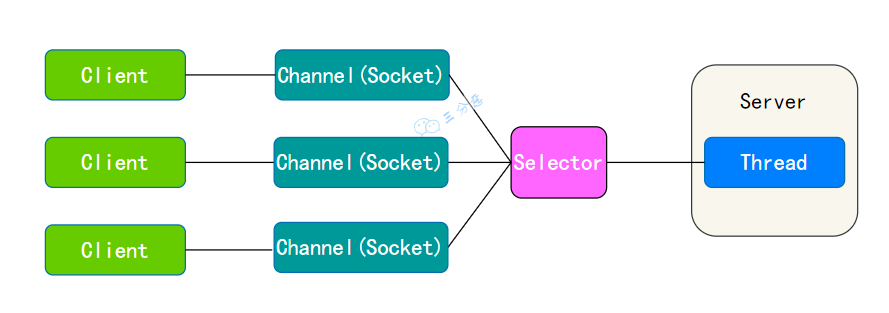

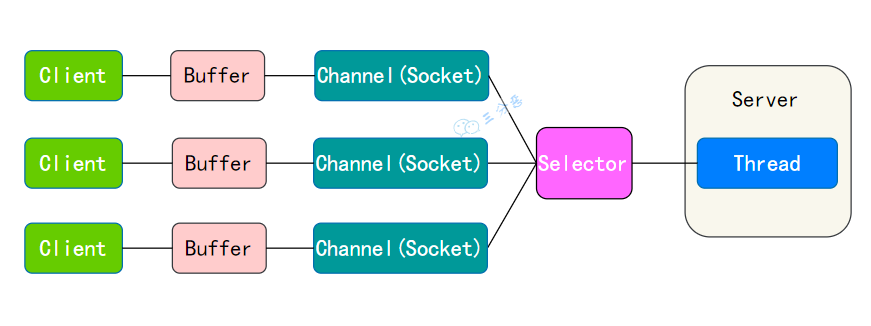

NIO:采用非阻塞 I/O 模型,线程在等待 I/O 时可执行其他任务,通过 Selector 监控多个 Channel 上的事件,适用于连接数多但连接时间短的场景。

AIO:使用异步 I/O 模型,线程发起 I/O 请求后立即返回,当 I/O 操作完成时通过回调函数通知线程,适用于连接数多且连接时间长的场景。

简单说一下 BIO?

BIO,也就是传统的 IO,基于字节流或字符流(如 FileInputStream、BufferedReader 等)进行文件读写,基于 Socket 和 ServerSocket 进行网络通信。

对于每个连接,都需要创建一个独立的线程来处理读写操作。

简单说下 NIO?

NIO,JDK 1.4 时引入,放在 java.nio 包下,提供了 Channel、Buffer、Selector 等新的抽象,基于 RandomAccessFile、FileChannel、ByteBuffer 进行文件读写,基于 SocketChannel 和 ServerSocketChannel 进行网络通信。

实际上,“旧”的 I/O 包已经使用 NIO 重新实现过,所以在进行文件读写时,NIO 并无法体现出比 BIO 更可靠的性能。

NIO 的魅力主要体现在网络编程中,服务器可以用一个线程处理多个客户端连接,通过 Selector 监听多个 Channel 来实现多路复用,极大地提高了网络编程的性能。

缓冲区 Buffer 也能极大提升一次 IO 操作的效率。

简单说下 AIO?

AIO 是 Java 7 引入的,放在 java.nio.channels 包下,提供了 AsynchronousFileChannel、AsynchronousSocketChannel 等异步 Channel。

它引入了异步通道的概念,使得 I/O 操作可以异步进行。这意味着线程发起一个读写操作后不必等待其完成,可以立即进行其他任务,并且当读写操作真正完成时,线程会被异步地通知。

1 | AsynchronousFileChannel fileChannel = AsynchronousFileChannel.open(Paths.get("test.txt"), StandardOpenOption.READ); |

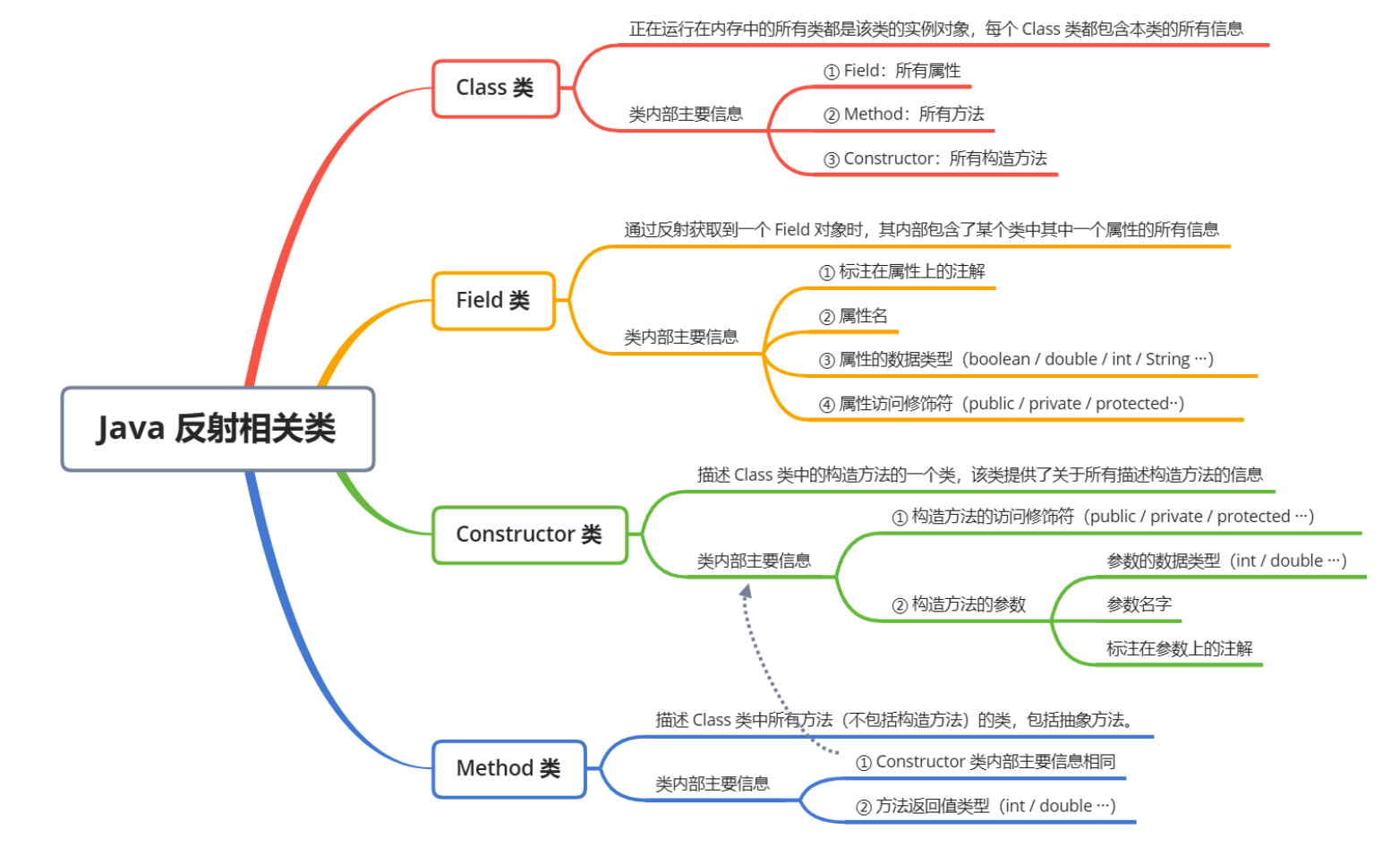

52.🌟什么是反射?应用?原理?

反射允许 Java 在运行时检查和操作类的方法和字段。通过反射,可以动态地获取类的字段、方法、构造方法等信息,并在运行时调用方法或访问字段。

比如创建一个对象是通过 new 关键字来实现的:

1 | Person person = new Person(); |

Person 类的信息在编译时就确定了,那假如在编译期无法确定类的信息,但又想在运行时获取类的信息、创建类的实例、调用类的方法,这时候就要用到反射。

反射功能主要通过 java.lang.Class 类及 java.lang.reflect 包中的类如 Method, Field, Constructor 等来实现。

比如说我们可以装来动态加载类并创建对象:

1 | String className = "java.util.Date"; |

比如说我们可以这样来访问字段和方法:

1 |

|

反射有哪些应用场景?

①、Spring 框架就大量使用了反射来动态加载和管理 Bean。

1 | Class<?> clazz = Class.forName("com.example.MyClass"); |

②、Java 的动态代理(Dynamic Proxy)机制就使用了反射来创建代理类。代理类可以在运行时动态处理方法调用,这在实现 AOP 和拦截器时非常有用。

1 | //创建一个处理器实例,负责实际方法的调用逻辑 |

③、JUnit 和 TestNG 等测试框架使用反射机制来发现和执行测试方法。反射允许框架扫描类,查找带有特定注解(如 @Test)的方法,并在运行时调用它们。

1 | Method testMethod = testClass.getMethod("testSomething"); |

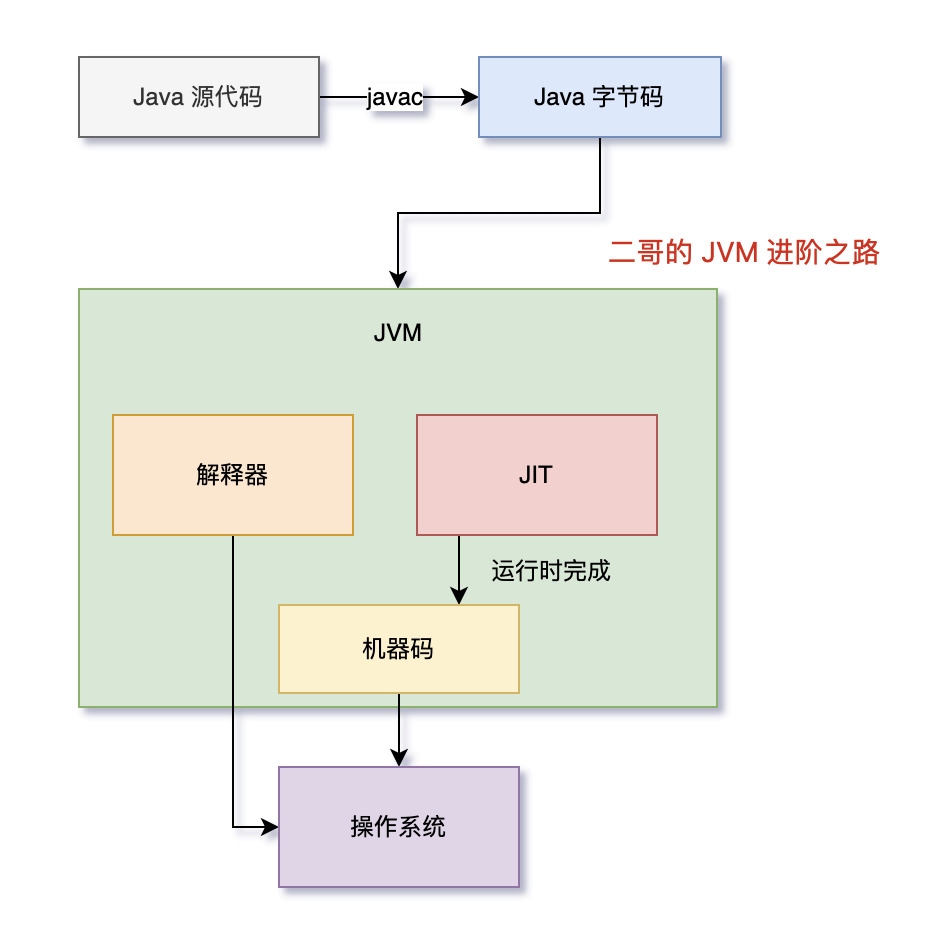

反射的原理是什么?

Java 程序的执行分为编译和运行两步,编译之后会生成字节码(.class)文件,JVM 进行类加载的时候,会加载字节码文件,将类型相关的所有信息加载进方法区,反射就是去获取这些信息,然后进行各种操作。

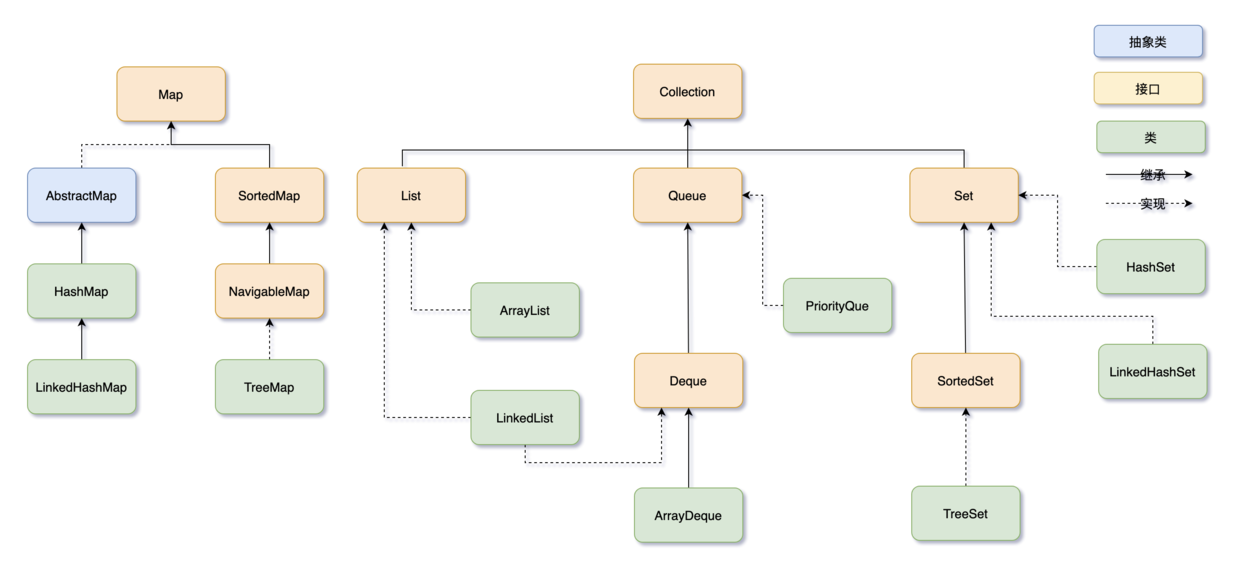

Java集合框架

1.🌟说说有哪些常见的集合框架?

- 推荐阅读:二哥的 Java 进阶之路:Java 集合框架

- 推荐阅读:阻塞队列 BlockingQueue。

集合框架可以分为两条大的支线:

①、第一条支线 Collection,主要由 List、Set、Queue 组成:

- List 代表有序、可重复的集合,典型代表就是封装了动态数组的 ArrayList 和封装了链表的 LinkedList;

- Set 代表无序、不可重复的集合,典型代表就是 HashSet 和 TreeSet;

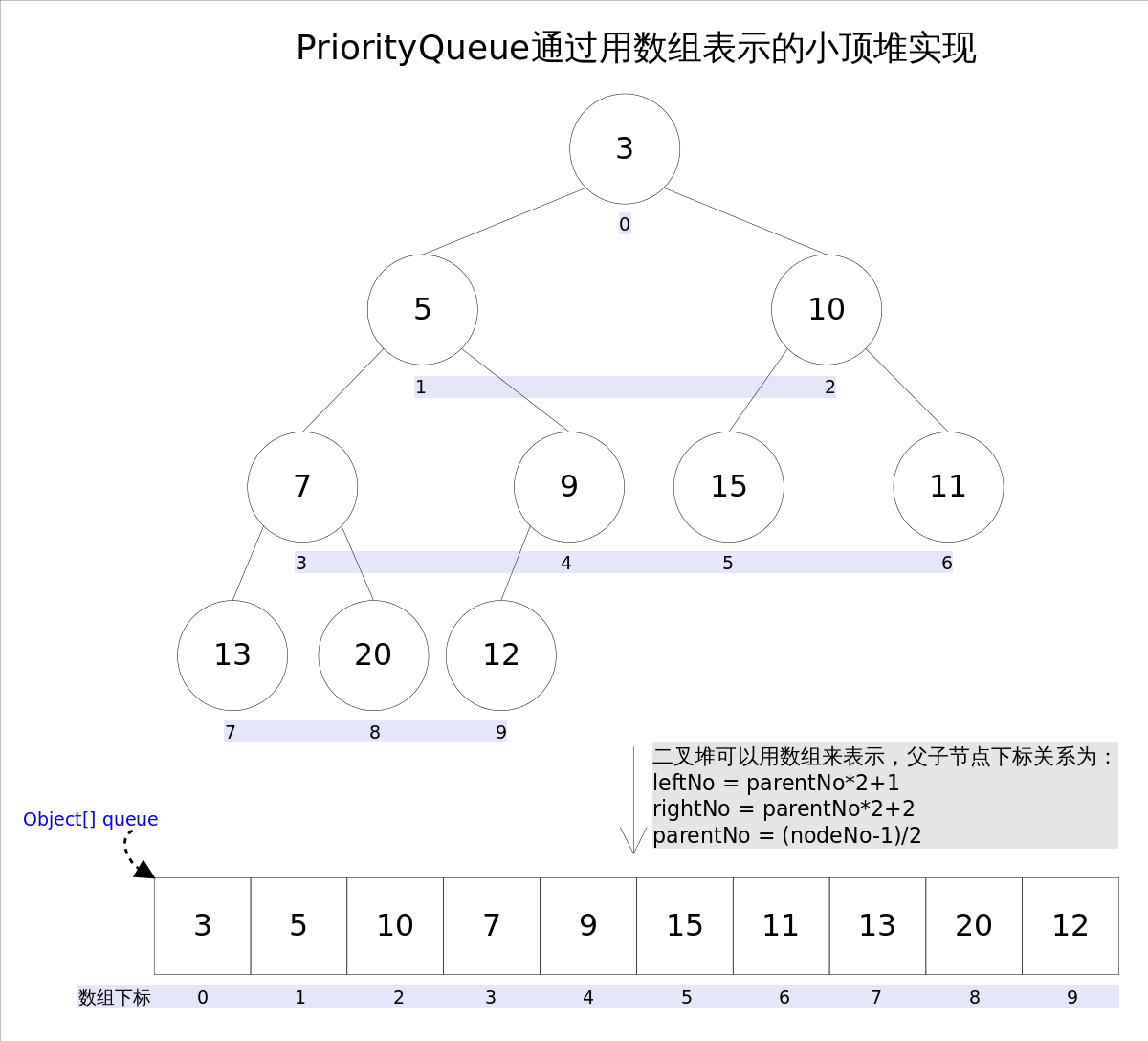

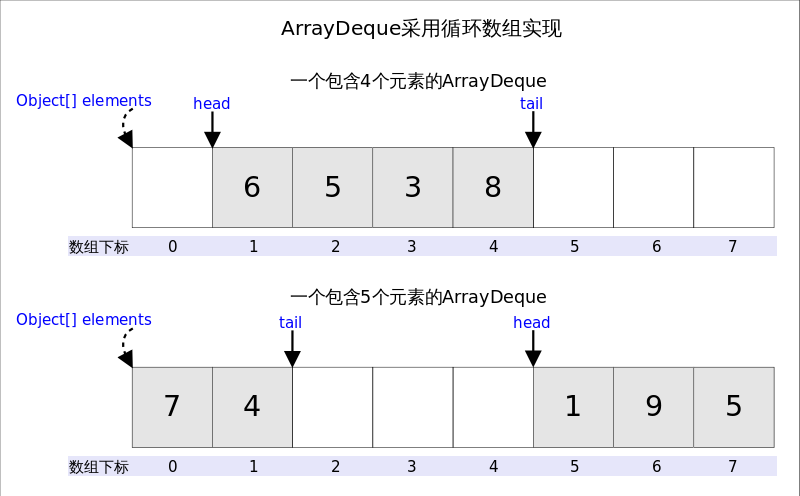

- Queue 代表队列,典型代表就是双端队列 ArrayDeque,以及优先级队列 PriorityQueue。

②、第二条支线 Map,代表键值对的集合,典型代表就是 HashMap。

另外一个回答版本:

①、Collection 接口:最基本的集合框架表示方式,提供了添加、删除、清空等基本操作,它主要有三个子接口:

List:一个有序的集合,可以包含重复的元素。实现类包括 ArrayList、LinkedList 等。Set:一个不包含重复元素的集合。实现类包括 HashSet、LinkedHashSet、TreeSet 等。Queue:一个用于保持元素队列的集合。实现类包括 PriorityQueue、ArrayDeque 等。

②、Map 接口:表示键值对的集合,一个键映射到一个值。键不能重复,每个键只能对应一个值。Map 接口的实现类包括 HashMap、LinkedHashMap、TreeMap 等。

集合框架有哪几个常用工具类?

集合框架位于 java.util 包下,提供了两个常用的工具类:

- Collections:提供了一些对集合进行排序、二分查找、同步的静态方法。

- Arrays:提供了一些对数组进行排序、打印、和 List 进行转换的静态方法。

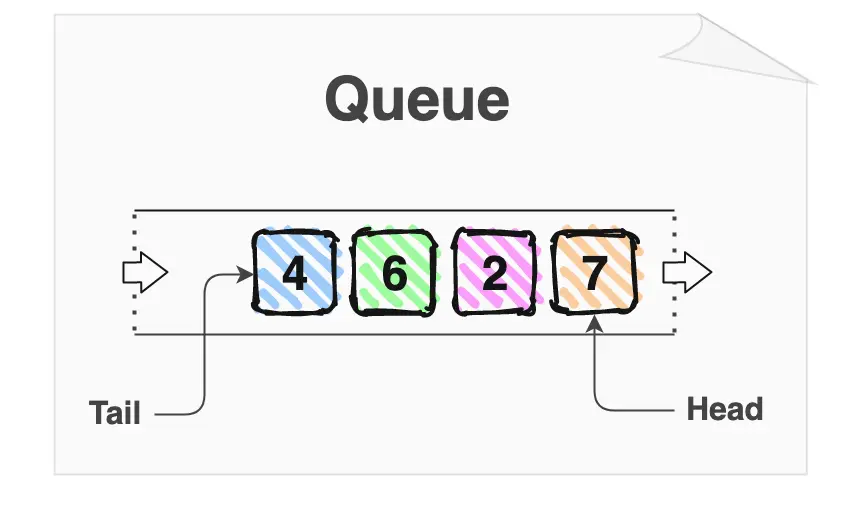

简单介绍一下队列

Java 中的队列主要通过 Queue 接口和并发包下的 BlockingQueue 两个接口来实现。

优先级队列 PriorityQueue 实现了 Queue 接口,是一个无界队列,它的元素按照自然顺序排序或者 Comparator 比较器进行排序。

双端队列 ArrayDeque 也实现了 Queue 接口,是一个基于数组的,可以在两端插入和删除元素的队列。

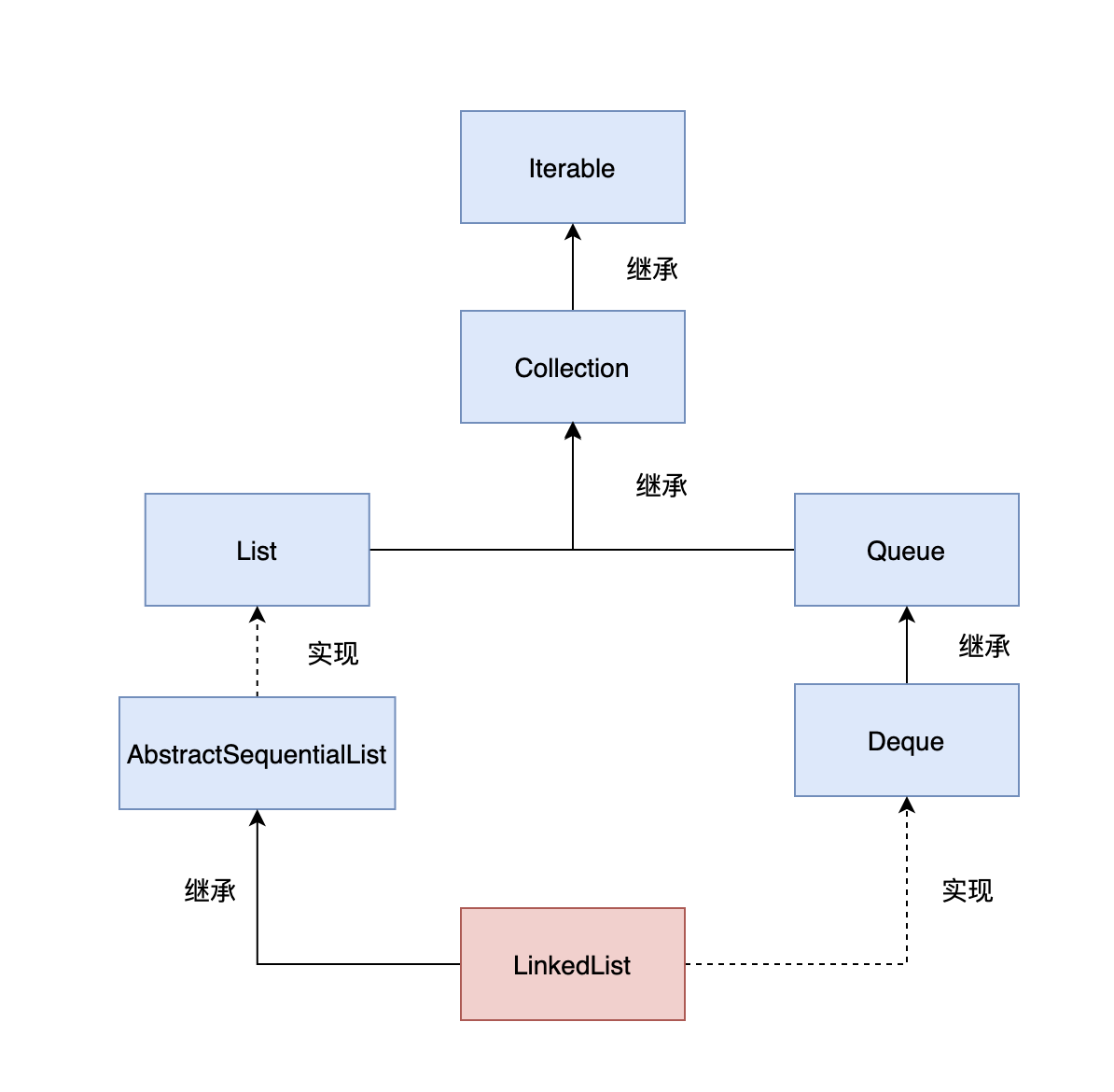

LinkedList 实现了 Queue 接口的子类 Deque,所以也可以当做双端队列来使用。

用过哪些集合类,它们的优劣?

我常用的集合类有 ArrayList、LinkedList、HashMap、LinkedHashMap。

ArrayList 可以看作是一个动态数组,可以在需要时动态扩容数组的容量,只不过需要复制元素到新的数组。优点是访问速度快,可以通过索引直接查找到元素。缺点是插入和删除元素可能需要移动或者复制元素。

LinkedList 是一个双向链表,适合频繁的插入和删除操作。优点是插入和删除元素的时候只需要改变节点的前后指针,缺点是访问元素时需要遍历链表。

HashMap 是一个基于哈希表的键值对集合。优点是可以根据键的哈希值快速查找到值,但有可能会发生哈希冲突,并且不保留键值对的插入顺序。

LinkedHashMap 在 HashMap 的基础上增加了一个双向链表来保持键值对的插入顺序。

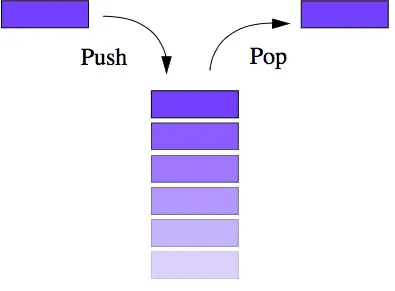

队列和栈的区别了解吗?

队列是一种先进先出(FIFO, First-In-First-Out)的数据结构,第一个加入队列的元素会成为第一个被移除的元素。

栈是一种后进先出(LIFO, Last-In-First-Out)的数据结构,最后一个加入栈的元素会成为第一个被移除的元素。

哪些是线程安全的容器?

像 Vector、Hashtable、ConcurrentHashMap、CopyOnWriteArrayList、ConcurrentLinkedQueue、ArrayBlockingQueue、LinkedBlockingQueue 都是线程安全的。

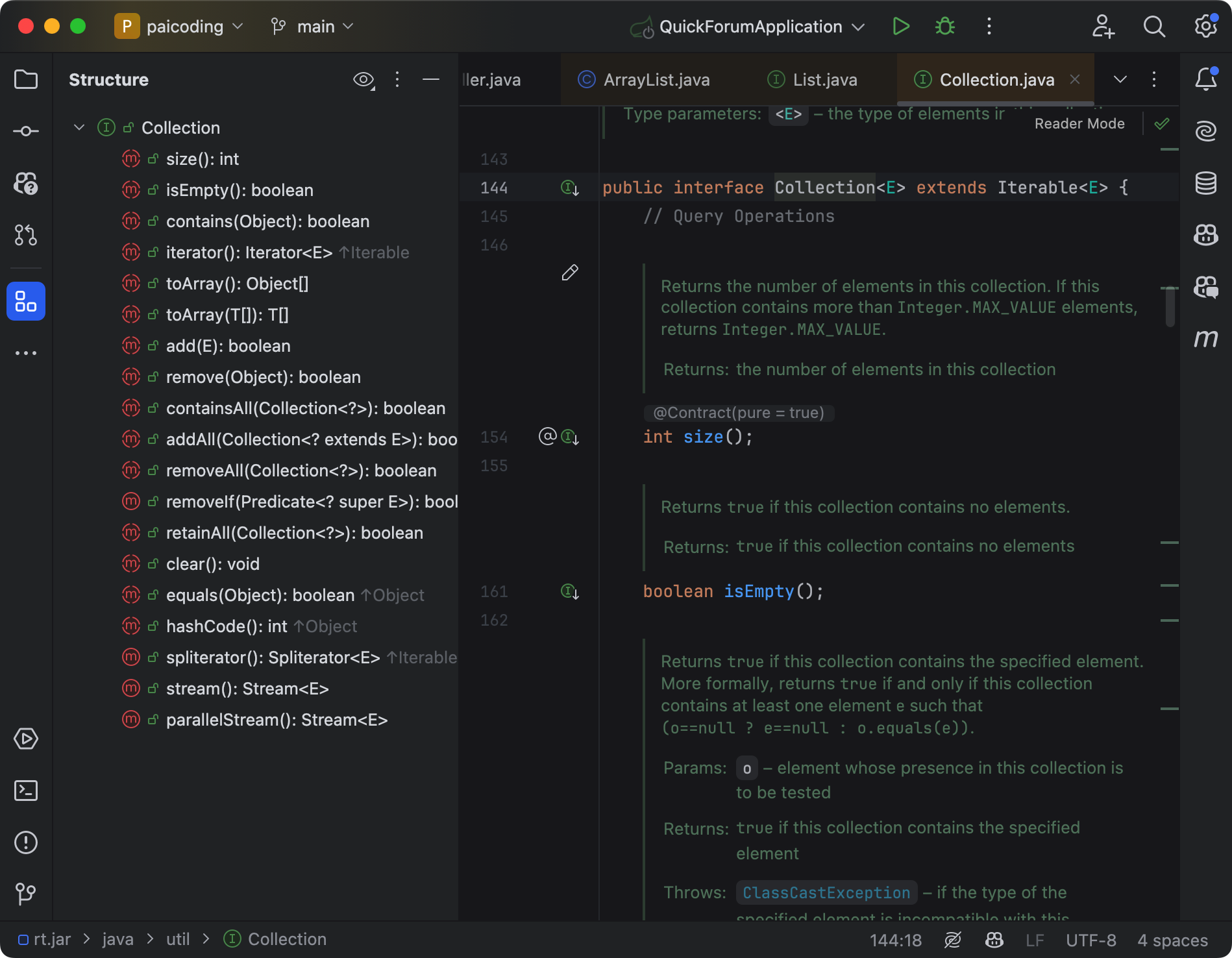

Collection 继承了哪些接口?

Collection 继承了 Iterable 接口,这意味着所有实现 Collection 接口的类都必须实现 iterator() 方法,之后就可以使用增强型 for 循环遍历集合中的元素了。

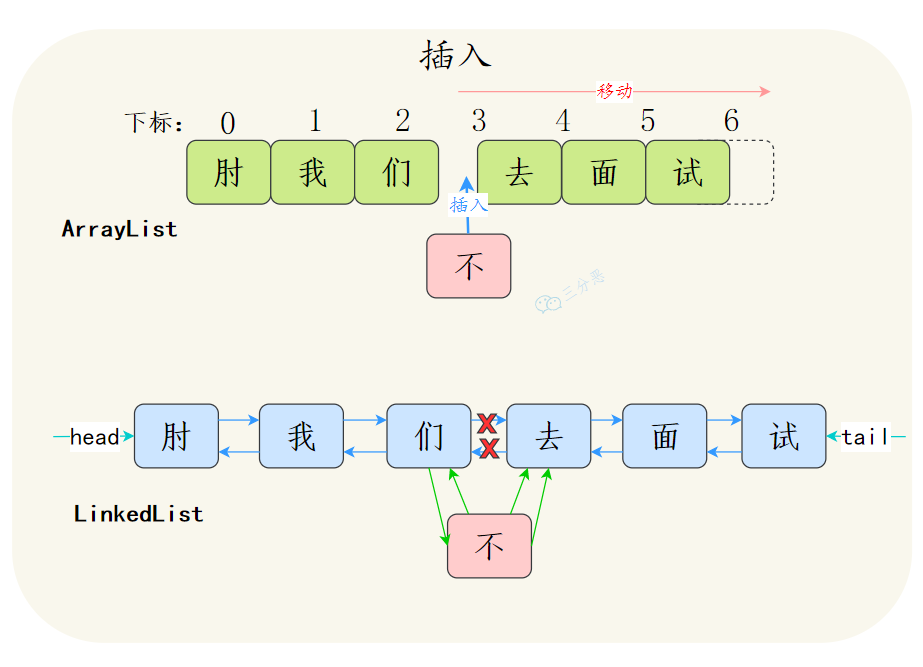

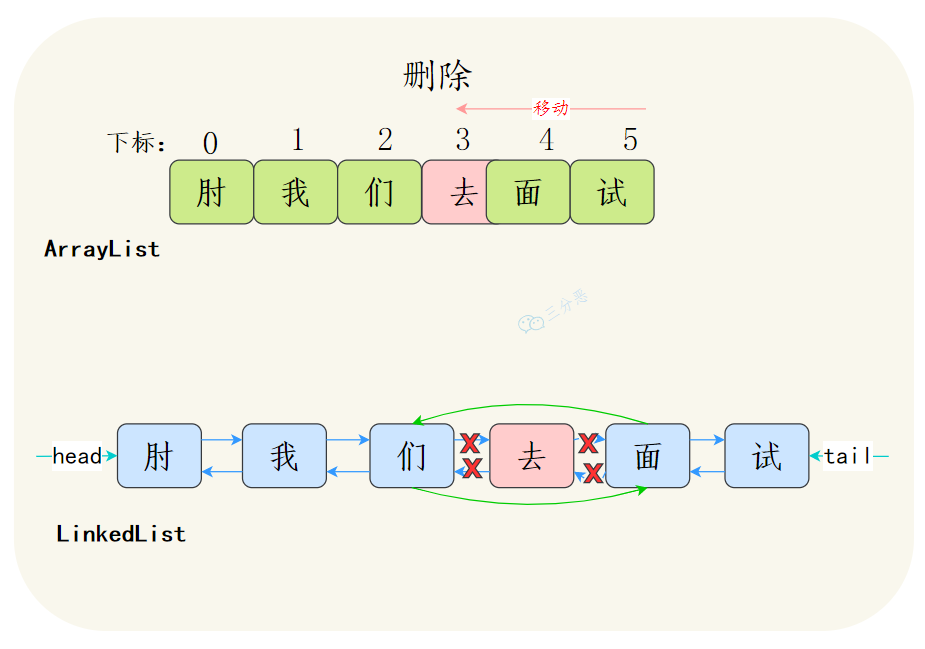

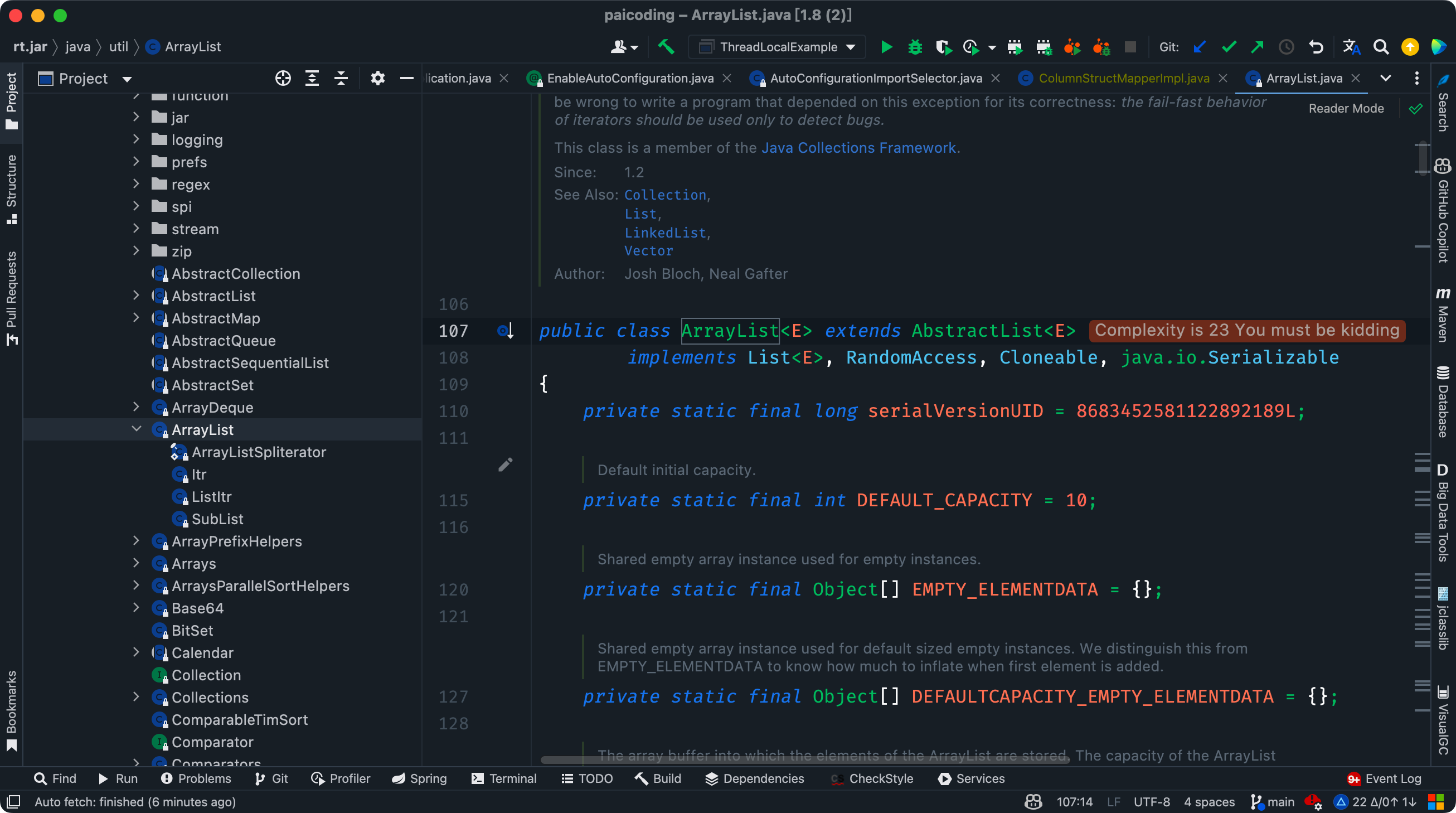

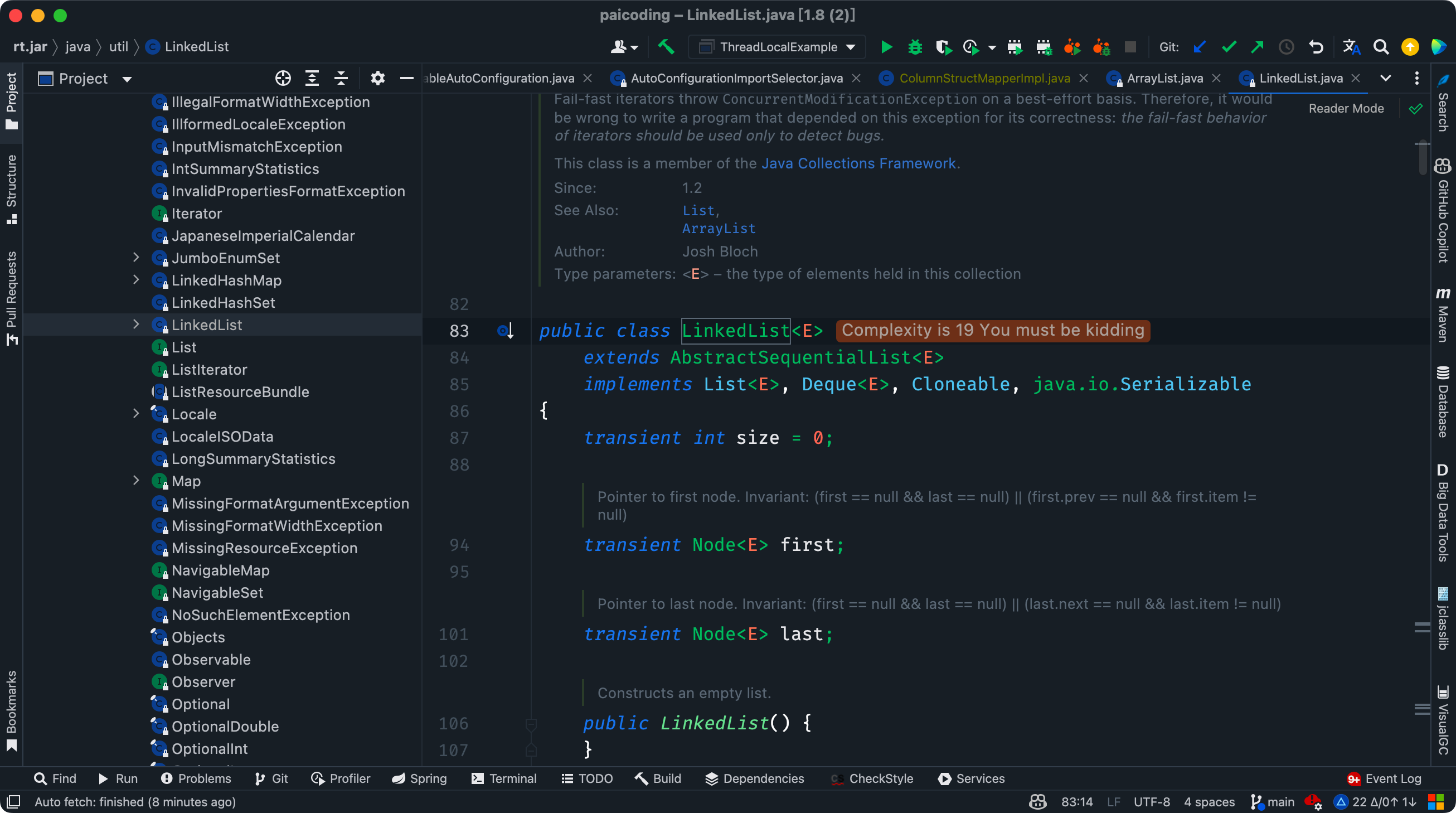

2.🌟ArrayList 和 LinkedList 有什么区别?

推荐阅读:二哥的 Java 进阶之路:ArrayList 和 LinkedList

ArrayList 是基于数组实现的,LinkedList 是基于链表实现的。

ArrayList 和 LinkedList 的用途有什么不同?

多数情况下,ArrayList 更利于查找,LinkedList 更利于增删。

①、由于 ArrayList 是基于数组实现的,所以 get(int index) 可以直接通过数组下标获取,时间复杂度是 O(1);LinkedList 是基于链表实现的,get(int index) 需要遍历链表,时间复杂度是 O(n)。

当然,get(E element) 这种查找,两种集合都需要遍历通过 equals 比较获取元素,所以时间复杂度都是 O(n)。

②、ArrayList 如果增删的是数组的尾部,时间复杂度是 O(1);如果 add 的时候涉及到扩容,时间复杂度会上升到 O(n)。

但如果插入的是中间的位置,就需要把插入位置后的元素向前或者向后移动,甚至还有可能触发扩容,效率就会低很多,变成 O(n)。

LinkedList 因为是链表结构,插入和删除只需要改变前置节点、后置节点和插入节点的引用,因此不需要移动元素。

如果是在链表的头部插入或者删除,时间复杂度是 O(1);如果是在链表的中间插入或者删除,时间复杂度是 O(n),因为需要遍历链表找到插入位置;如果是在链表的尾部插入或者删除,时间复杂度是 O(1)。

ArrayList 和 LinkedList 是否支持随机访问?

①、ArrayList 是基于数组的,也实现了 RandomAccess 接口,所以它支持随机访问,可以通过下标直接获取元素。

②、LinkedList 是基于链表的,所以它没法根据下标直接获取元素,不支持随机访问。

ArrayList 和 LinkedList 内存占用有何不同?

ArrayList 是基于数组的,是一块连续的内存空间,所以它的内存占用是比较紧凑的;但如果涉及到扩容,就会重新分配内存,空间是原来的 1.5 倍。

LinkedList 是基于链表的,每个节点都有一个指向下一个节点和上一个节点的引用,于是每个节点占用的内存空间比 ArrayList 稍微大一点。

ArrayList 和 LinkedList 的使用场景有什么不同?

ArrayList 适用于:

- 随机访问频繁:需要频繁通过索引访问元素的场景。

- 读取操作远多于写入操作:如存储不经常改变的列表。

- 末尾添加元素:需要频繁在列表末尾添加元素的场景。

LinkedList 适用于:

- 频繁插入和删除:在列表中间频繁插入和删除元素的场景。

- 不需要快速随机访问:顺序访问多于随机访问的场景。

- 队列和栈:由于其双向链表的特性,LinkedList 可以实现队列(FIFO)和栈(LIFO)。

链表和数组有什么区别?

- 数组在内存中占用的是一块连续的存储空间,因此我们可以通过数组下标快速访问任意元素。数组在创建时必须指定大小,一旦分配内存,数组的大小就固定了。

- 链表的元素存储在于内存中的任意位置,每个节点通过指针指向下一个节点。

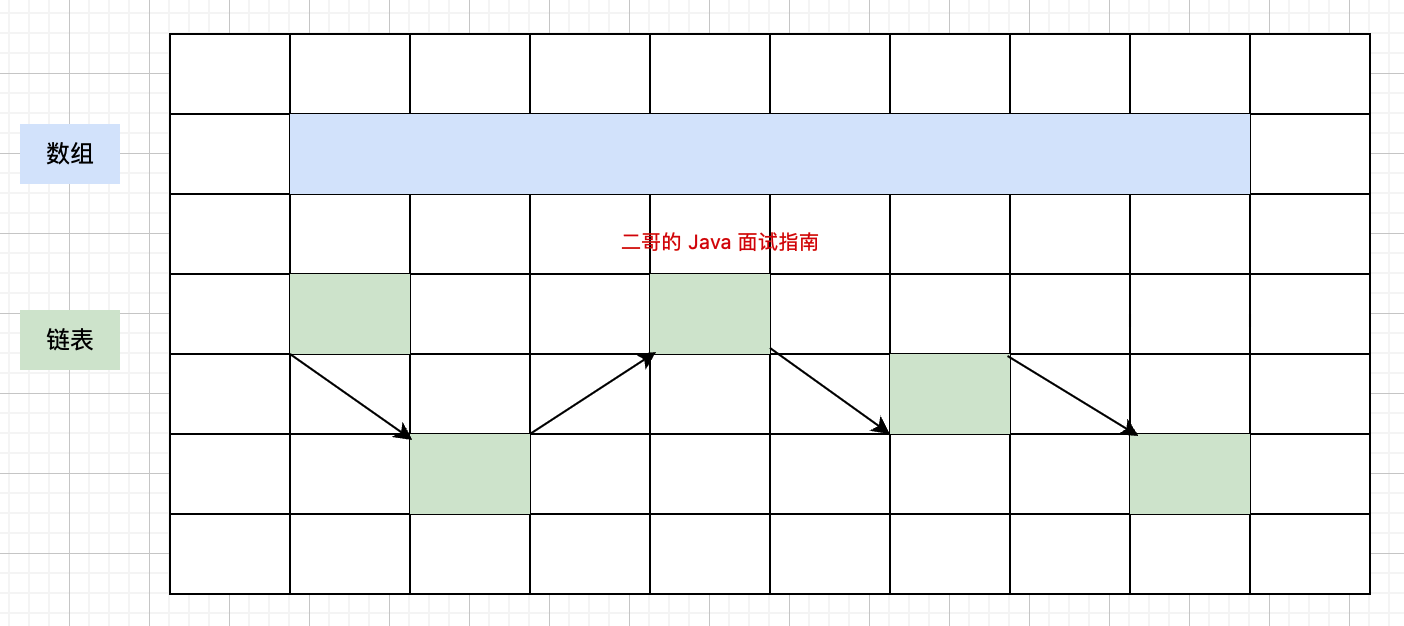

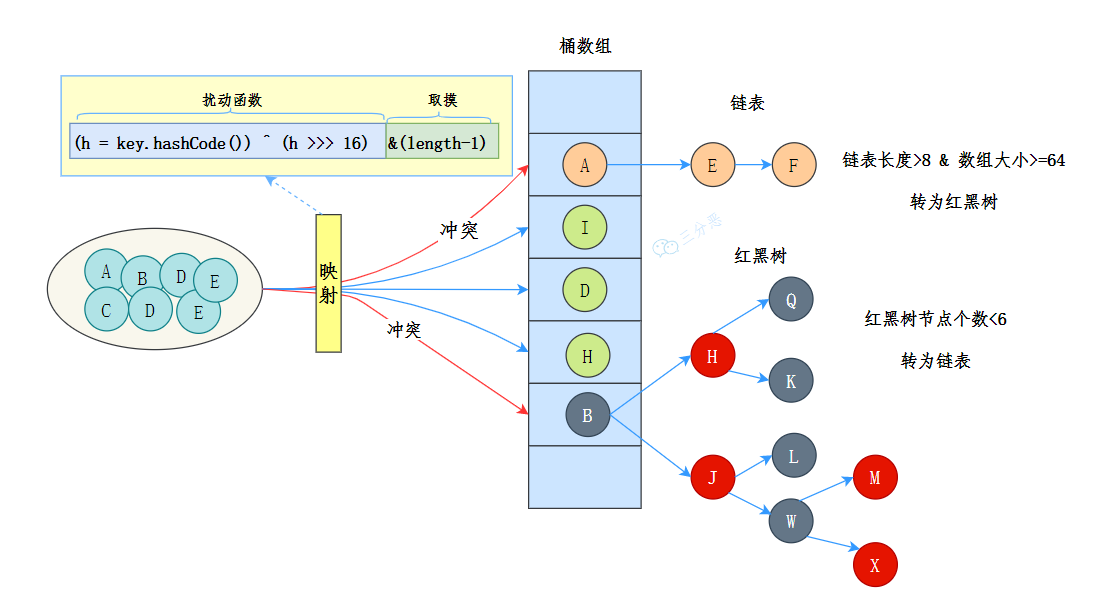

8.🌟能说一下 HashMap 的底层数据结构吗?

JDK 8 中 HashMap 的数据结构是数组+链表+红黑树。

数组用来存储键值对,每个键值对可以通过索引直接拿到,索引是通过对键的哈希值进行进一步的 hash() 处理得到的。

当多个键经过哈希处理后得到相同的索引时,需要通过链表来解决哈希冲突——将具有相同索引的键值对通过链表存储起来。

不过,链表过长时,查询效率会比较低,于是当链表的长度超过 8 时(且数组的长度大于 64),链表就会转换为红黑树。红黑树的查询效率是 O(logn),比链表的 O(n) 要快。

hash() 方法的目标是尽量减少哈希冲突,保证元素能够均匀地分布在数组的每个位置上。

1 | static final int hash(Object key) { |

如果键的哈希值已经在数组中存在,其对应的值将被新值覆盖。

HashMap 的初始容量是 16,随着元素的不断添加,HashMap 就需要进行扩容,阈值是capacity * loadFactor,capacity 为容量,loadFactor 为负载因子,默认为 0.75。

扩容后的数组大小是原来的 2 倍,然后把原来的元素重新计算哈希值,放到新的数组中。

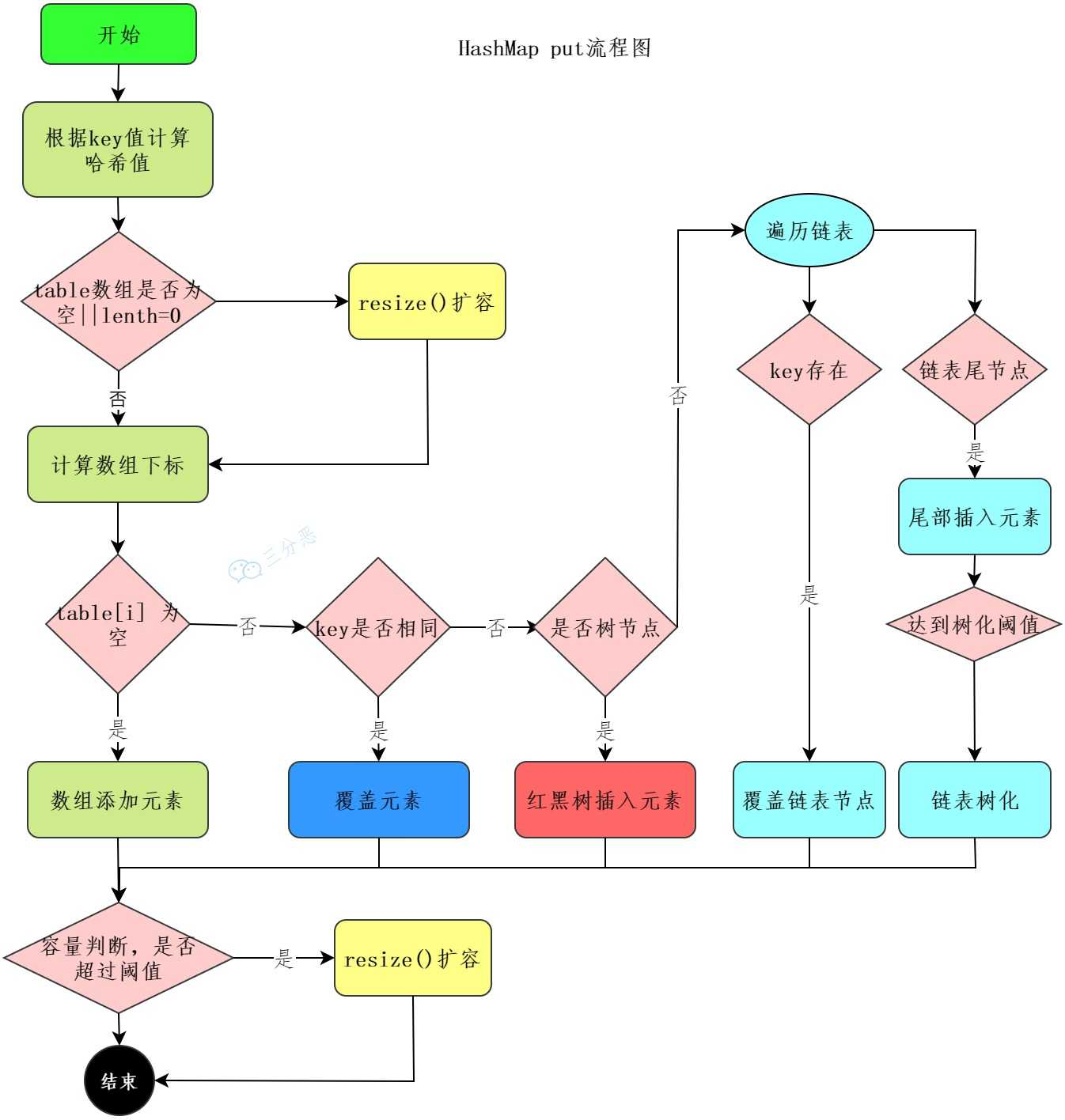

11.🌟HashMap 的 put 流程知道吗?

哈希寻址 → 处理哈希冲突(链表还是红黑树)→ 判断是否需要扩容 → 插入/覆盖节点。

详细版:

第一步,通过 hash 方法进一步扰动哈希值,以减少哈希冲突。

1 | static final int hash(Object key) { |

第二步,进行第一次的数组扩容;并使用哈希值和数组长度进行取模运算,确定索引位置。

1 | if ((tab = table) == null || (n = tab.length) == 0) |

如果当前位置为空,直接将键值对插入该位置;

否则判断当前位置的第一个节点是否与新节点的 key 相同,如果相同直接覆盖 value,如果不同,说明发生哈希冲突。

如果是链表,将新节点添加到链表的尾部;如果链表长度大于等于 8,则将链表转换为红黑树。

1 |

|

每次插入新元素后,检查是否需要扩容,如果当前元素个数大于阈值(capacity * loadFactor),则进行扩容,扩容后的数组大小是原来的 2 倍;并且重新计算每个节点的索引,进行数据重新分布。

只重写元素的 equals 方法没重写 hashCode,put 的时候会发生什么?

如果只重写 equals 方法,没有重写 hashCode 方法,那么会导致 equals 相等的两个对象,hashCode 不相等,这样的话,两个对象会被 put 到数组中不同的位置,导致 get 的时候,无法获取到正确的值。

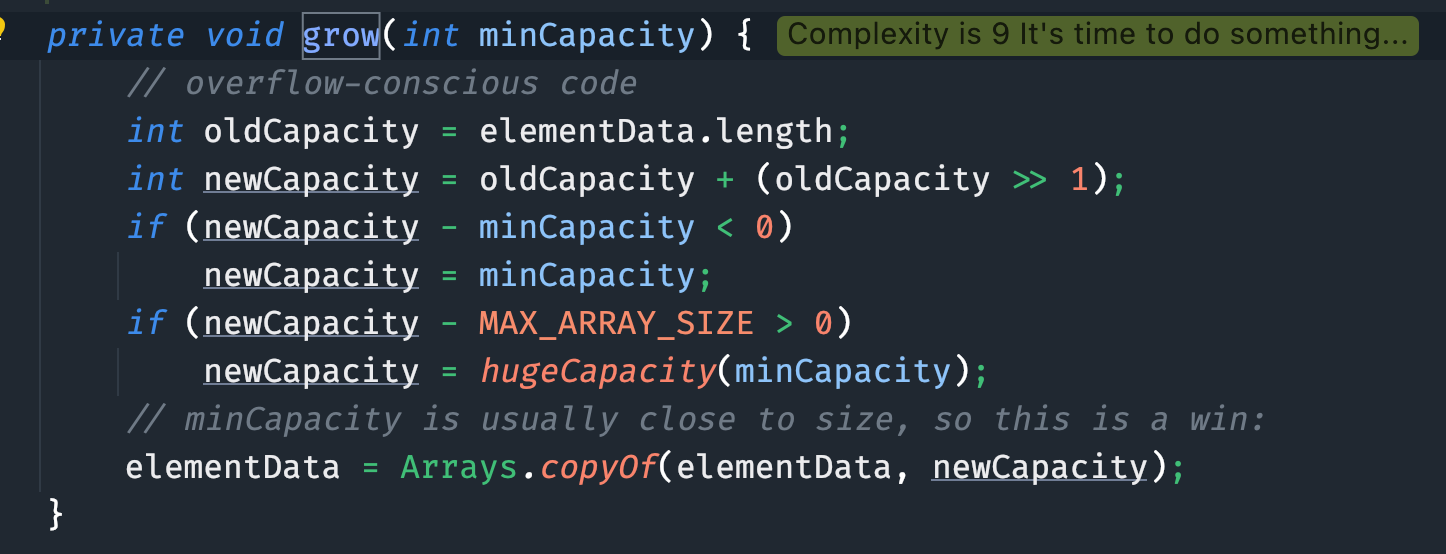

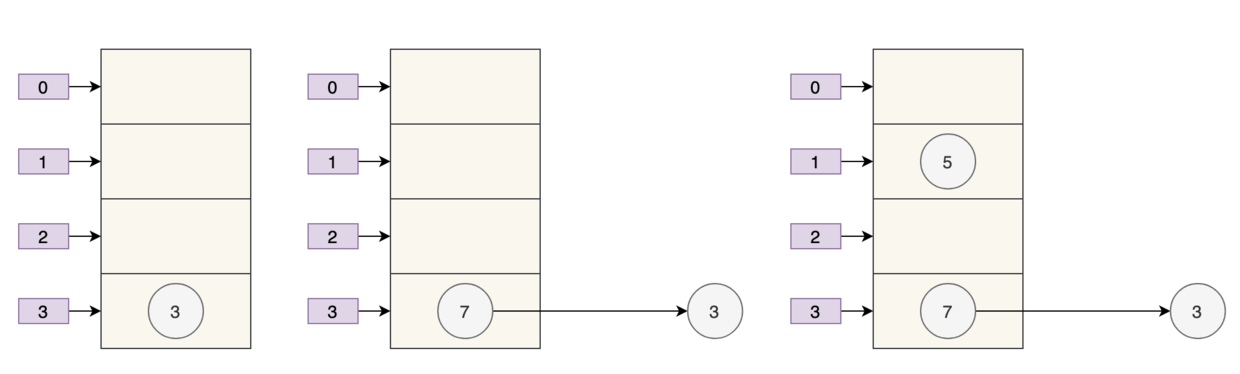

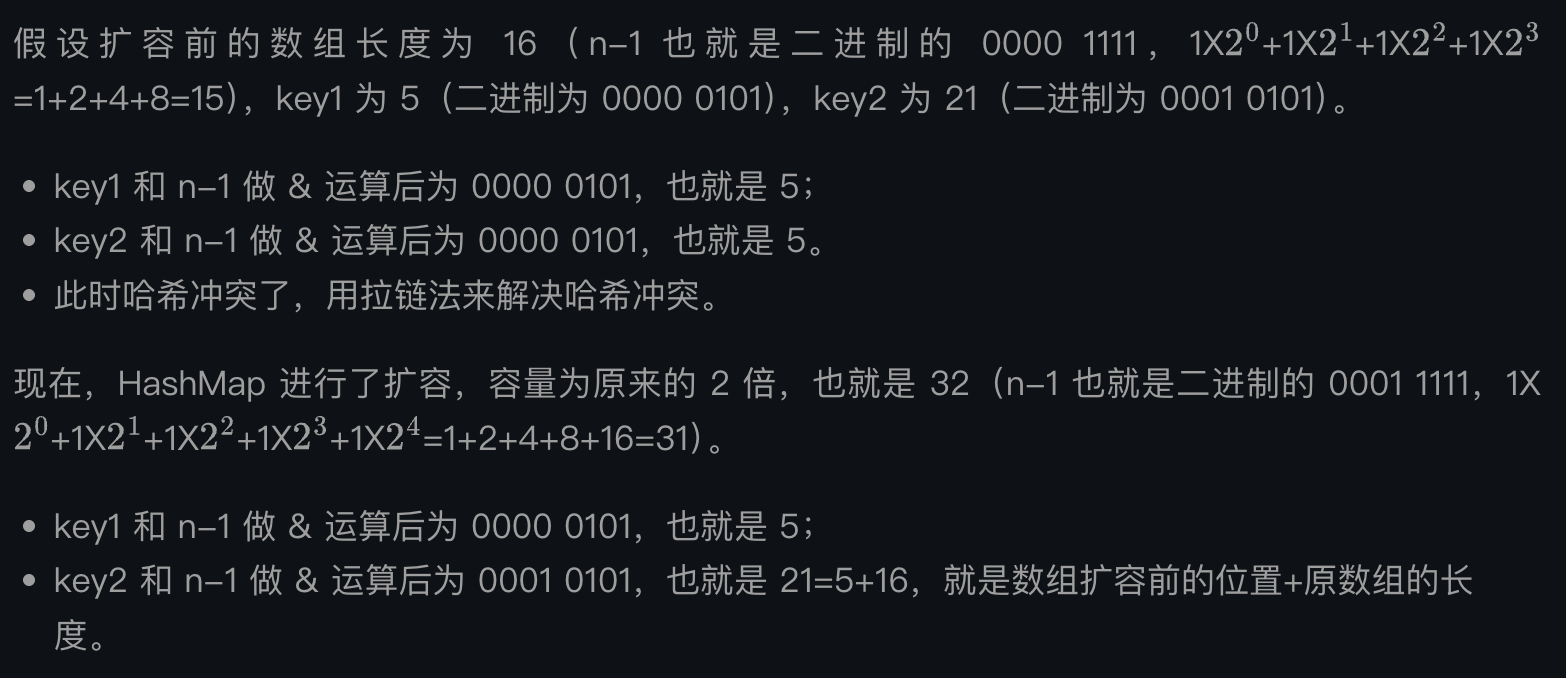

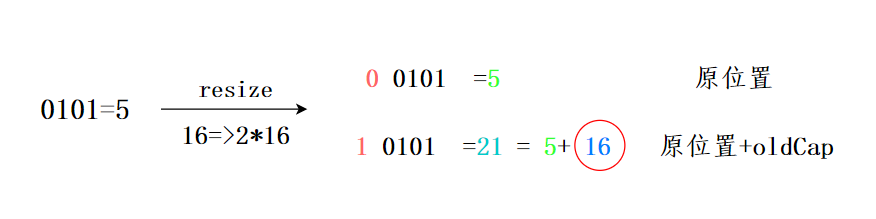

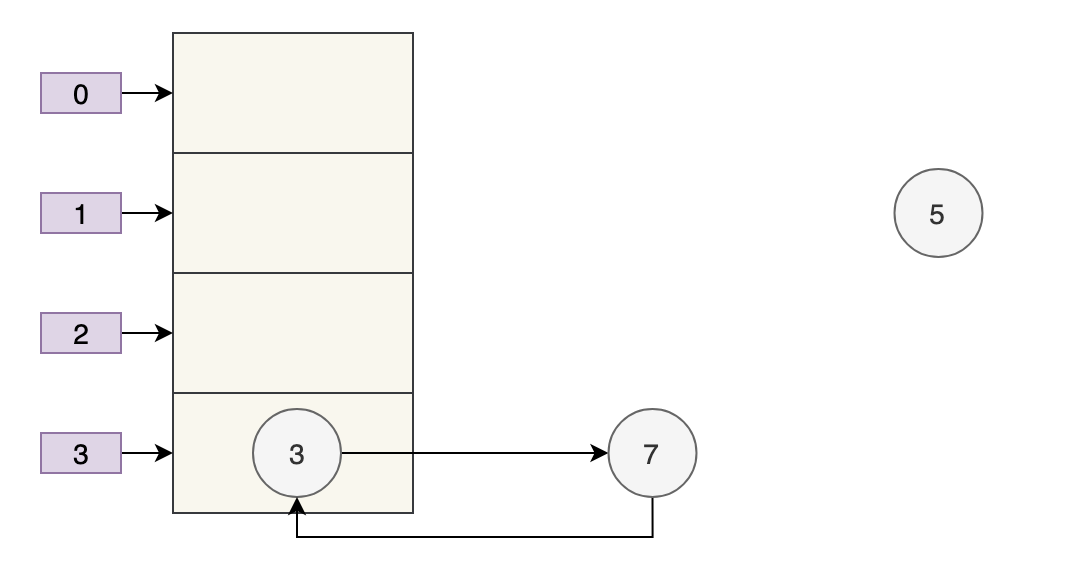

21.🌟HashMap的扩容机制了解吗?

扩容时,HashMap 会创建一个新的数组,其容量是原来的两倍。然后遍历旧哈希表中的元素,将其重新分配到新的哈希表中。

如果当前桶中只有一个元素,那么直接通过键的哈希值与数组大小取模锁定新的索引位置:e.hash & (newCap - 1)。

如果当前桶是红黑树,那么会调用 split() 方法分裂树节点,以保证树的平衡。

如果当前桶是链表,会通过旧键的哈希值与旧的数组大小取模 (e.hash & oldCap) == 0 来作为判断条件,如果条件为真,元素保留在原索引的位置;否则元素移动到原索引 + 旧数组大小的位置。

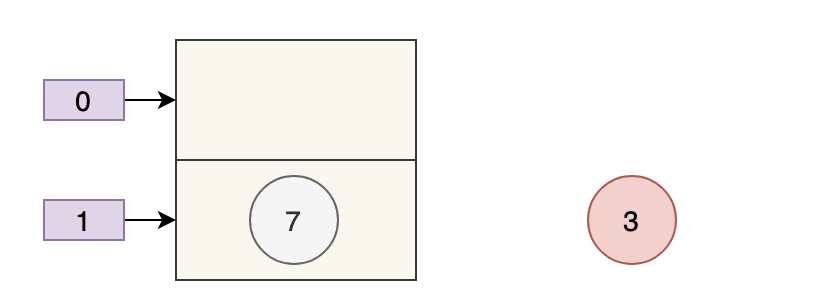

JDK 7 扩容的时候有什么问题?

JDK 7 在扩容的时候使用头插法来重新插入链表节点,这样会导致链表无法保持原有的顺序。

详细解释一下。

JDK 7 是通过哈希值与数组大小-1 进行与运算确定元素下标的。

1 | static int indexFor(int h, int length) { |

我们来假设:

- 数组 table 的长度为 2

- 键的哈希值为 3、7、5

取模运算后,键发生了哈希冲突,它们都需要放到 table[1] 的桶上。那么扩容前就是这个样子:

假设负载因子 loadFactor 为 1,也就是当元素的个数大于 table 的长度时进行扩容。

扩容后的数组容量为 4。

- key 3 取模(3%4)后是 3,放在

table[3]上。 - key 7 取模(7%4)后是 3,放在

table[3]上的链表头部。 - key 5 取模(5%4)后是 1,放在

table[1]上。

可以看到,由于 JDK 采用的是头插法,7 跑到 3 的前面了,原来的顺序是 3、7、5,7 在 3 的后面。

1 | for (Entry<K,V> e : oldTable) { |

最好的情况就是,扩容后的 7 还在 3 的后面,保持原来的顺序。

JDK 8 是怎么解决这个问题的?

JDK 8 改用了尾插法,并且当 (e.hash & oldCap) == 0 时,元素保留在原索引的位置;否则元素移动到原索引 + 旧数组大小的位置。

1 | Node<K,V> loHead = null, loTail = null; |

由于扩容时,数组长度会翻倍,例如:16 → 32, 因此,新数组的索引范围是原索引范围的两倍。

原索引 index = (n - 1) & hash,扩容后的新索引就是 index = (2n - 1) & hash。

也就是说,如果 (e.hash & oldCap) == 0,元素在新数组中的位置与旧位置相同;否则,元素在新数组中的位置是旧位置 + 旧数组大小。

这样可以避免重新计算所有元素的哈希值,只需检查高位的某一位,就可以快速确定新位置。

扩容的时候每个节点都要进行位运算吗?

不需要。HashMap 会通过 (e.hash & oldCap) 来判断节点是否需要移动,0 的话保留原索引;1 才需要移动到新索引(原索引 + oldCap)。

这样就避免了 hashCode 的重新计算,大大提升了扩容的性能。

所以,哪怕有几十万条数据,可能只有一半的数据才需要移动到新位置。另外,位运算的计算速度非常快,因此,尽管扩容操作涉及到遍历整个哈希表并对每个节点进行判断,但这部分操作的计算成本是相对较低的。

24.🌟HashMap 是线程安全的吗?

推荐阅读:HashMap 详解

HashMap 不是线程安全的,主要有以下几个问题:

①、多线程下扩容会死循环。JDK7 中的 HashMap 使用的是头插法来处理链表,在多线程环境下扩容会出现环形链表,造成死循环。

不过,JDK 8 时通过尾插法修复了这个问题,扩容时会保持链表原来的顺序。

②、多线程在进行 put 元素的时候,可能会导致元素丢失。因为计算出来的位置可能会被其他线程覆盖掉,比如说一个县城 put 3 的时候,另外一个线程 put 了 7,就把 3 给弄丢了。

③、put 和 get 并发时,可能导致 get 为 null。线程 1 执行 put 时,因为元素个数超出阈值而扩容,线程 2 此时执行 get,就有可能出现这个问题。

因为线程 1 执行完 table = newTab 之后,线程 2 中的 table 已经发生了改变,比如说索引 3 的键值对移动到了索引 7 的位置,此时线程 2 去 get 索引 3 的元素就 get 不到了。

25.🌟怎么解决 HashMap 线程不安全的问题呢?

在早期的 JDK 版本中,可以用 Hashtable 来保证线程安全。Hashtable 在方法上加了 synchronized 关键字。

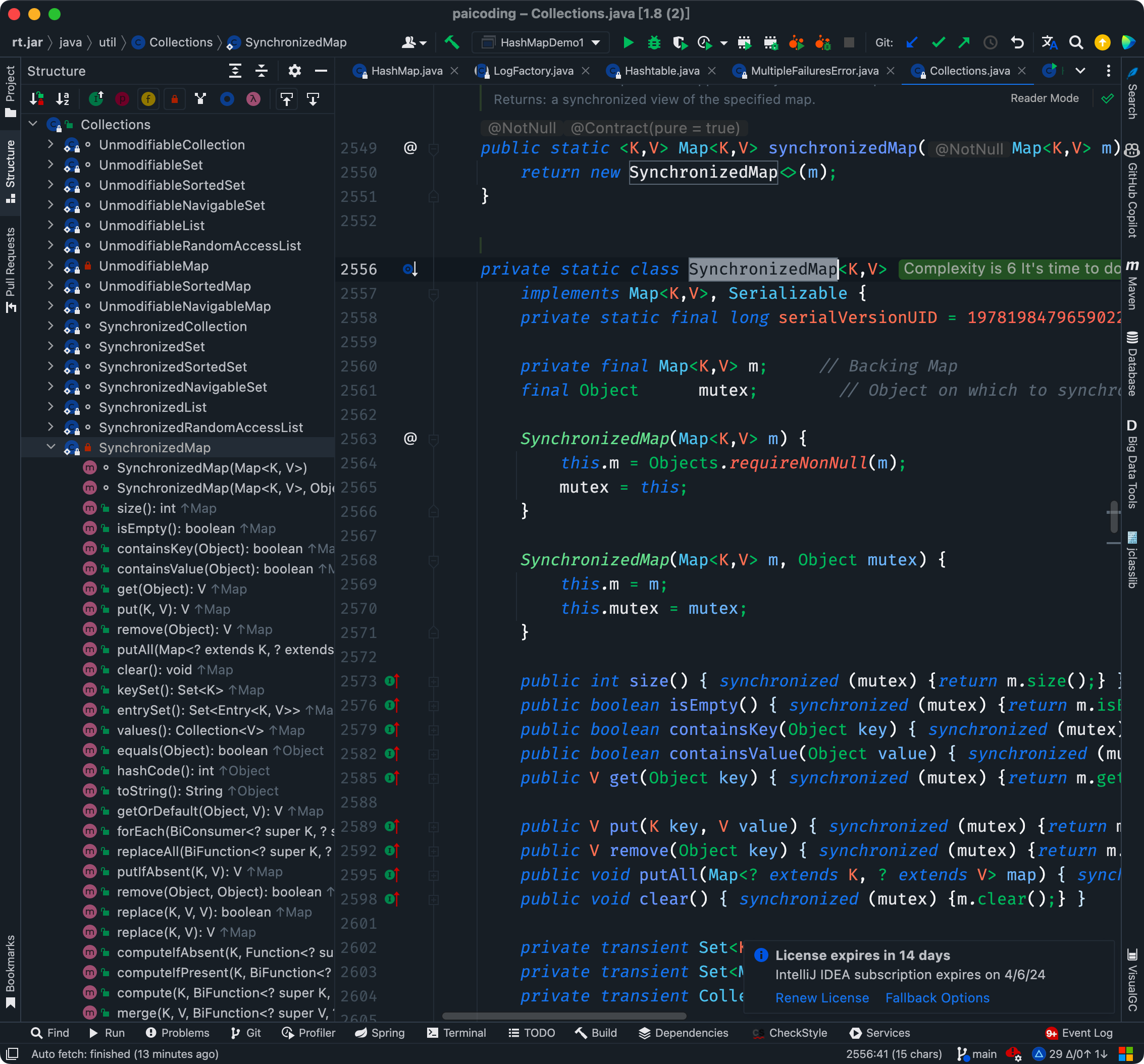

另外,可以通过 Collections.synchronizedMap 方法返回一个线程安全的 Map,内部是通过 synchronized 对象锁来保证线程安全的,比在方法上直接加 synchronized 关键字更轻量级。

更优雅的解决方案是使用并发工具包下的 ConcurrentHashMap,使用了CAS+ synchronized 关键字来保证线程安全。

(分段锁+CAS)

Java并发编程

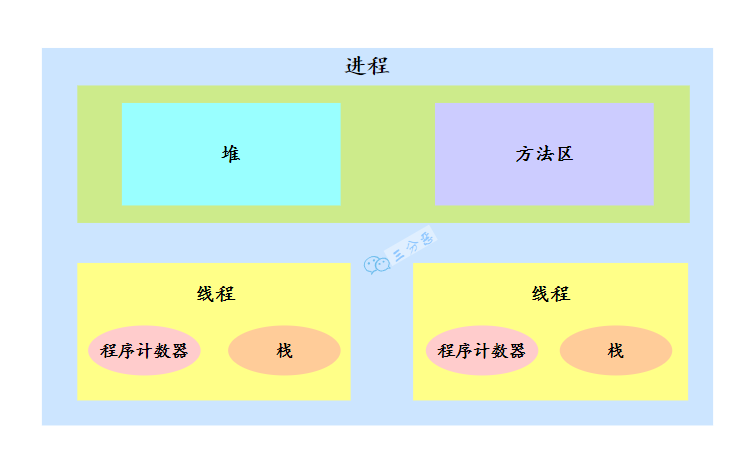

2.🌟说说进程和线程的区别?

推荐阅读:进程与线程的区别是什么?

进程说简单点就是我们在电脑上启动的一个个应用。它是操作系统分配资源的最小单位。

线程是进程中的独立执行单元。多个线程可以共享同一个进程的资源,如内存;每个线程都有自己独立的栈和寄存器。

如何理解协程?

协程被视为比线程更轻量级的并发单元,可以在单线程中实现并发执行,由我们开发者显式调度。

协程是在用户态进行调度的,避免了线程切换时的内核态开销。

Java 自身是不支持携程的,我们可以使用 Quasar、Kotlin 等框架来实现协程。

1 | fun main() = runBlocking { |

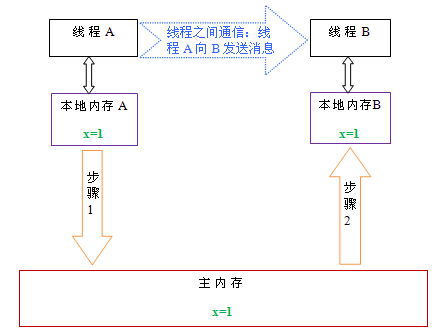

线程间是如何进行通信的?

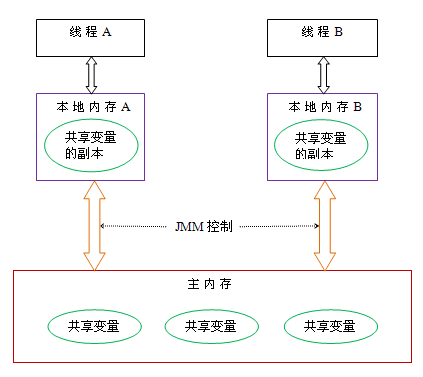

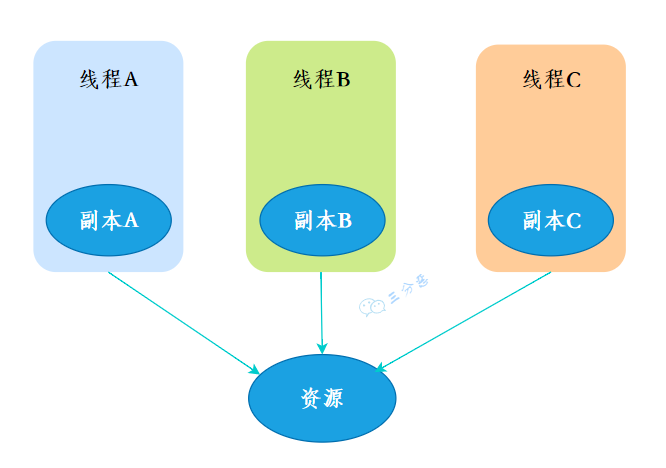

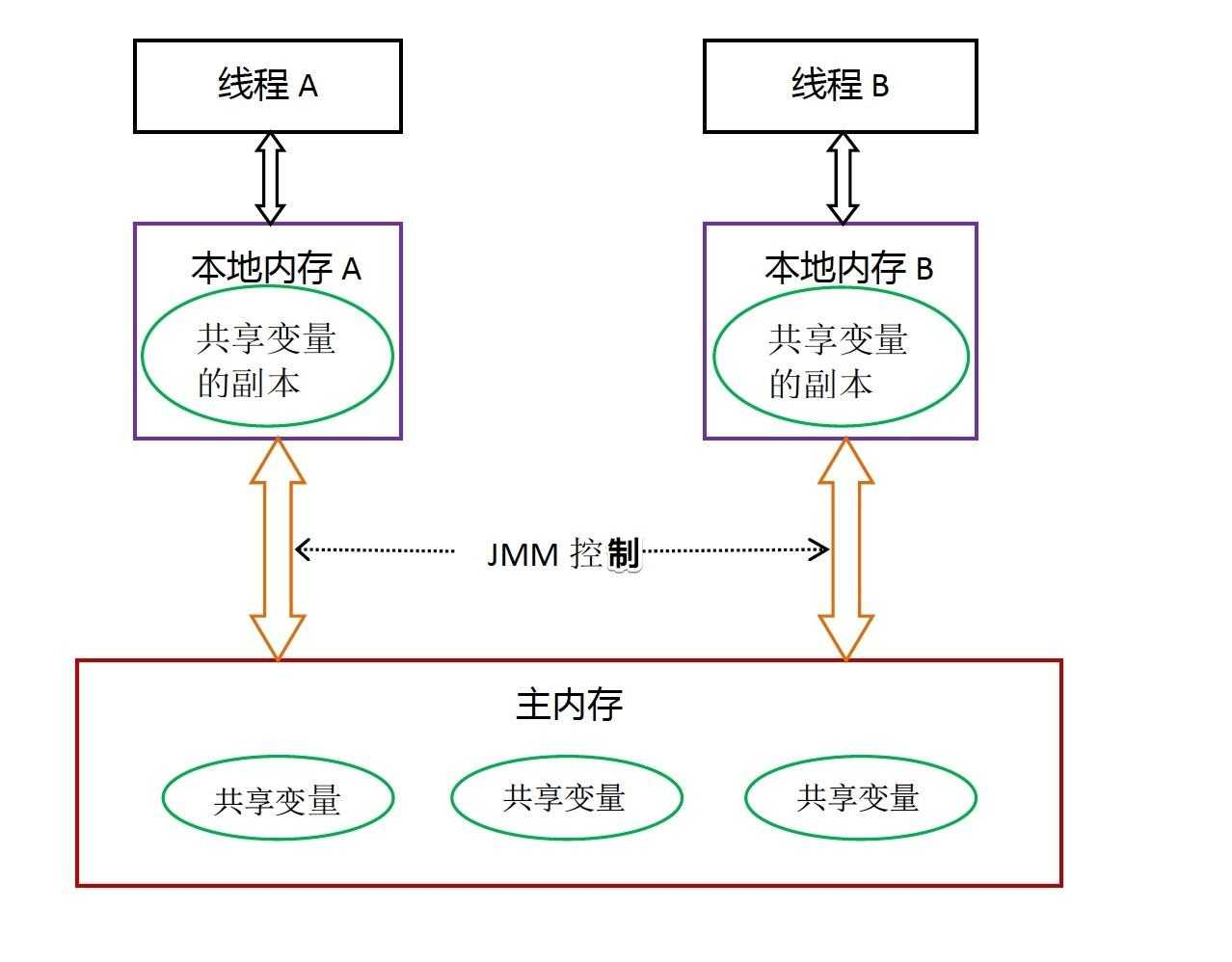

原则上可以通过消息传递和共享内存两种方法来实现。Java 采用的是共享内存的并发模型。

这个模型被称为 Java 内存模型,简写为 JMM,它决定了一个线程对共享变量的写入,何时对另外一个线程可见。当然了,本地内存是 JMM 的一个抽象概念,并不真实存在。

用一句话来概括就是:共享变量存储在主内存中,每个线程的私有本地内存,存储的是这个共享变量的副本。

线程 A 与线程 B 之间如要通信,需要要经历 2 个步骤:

- 线程 A 把本地内存 A 中的共享变量副本刷新到主内存中。

- 线程 B 到主内存中读取线程 A 刷新过的共享变量,再同步到自己的共享变量副本中。

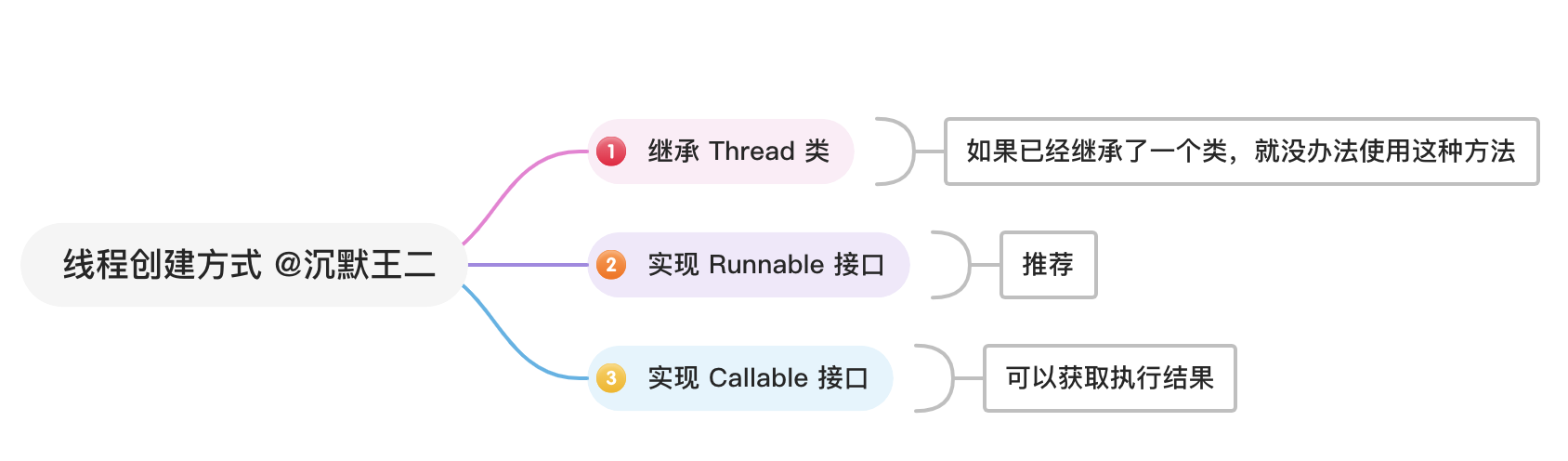

3.🌟说说线程有几种创建方式?

有三种,分别是继承 Thread 类、实现 Runnable 接口、实现 Callable 接口。

第一种需要重写父类 Thread 的 run() 方法,并且调用 start() 方法启动线程。

1 | class ThreadTask extends Thread { |

这种方法的缺点是,如果 ThreadTask 已经继承了另外一个类,就不能再继承 Thread 类了,因为 Java 不支持多重继承。

第二种需要重写 Runnable 接口的 run() 方法,并将实现类的对象作为参数传递给 Thread 对象的构造方法,最后调用 start() 方法启动线程。

1 | class RunnableTask implements Runnable { |

这种方法的优点是可以避免 Java 的单继承限制,并且更符合面向对象的编程思想,因为 Runnable 接口将任务代码和线程控制的代码解耦了。

第三种需要重写 Callable 接口的 call() 方法,然后创建 FutureTask 对象,参数为 Callable 实现类的对象;紧接着创建 Thread 对象,参数为 FutureTask 对象,最后调用 start() 方法启动线程。

1 | class CallableTask implements Callable<String> { |

这种方法的优点是可以获取线程的执行结果。

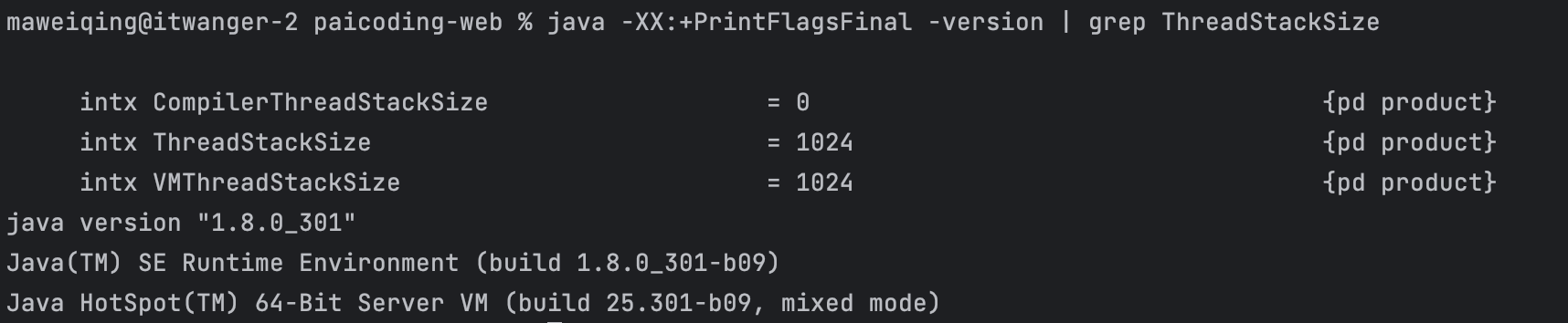

一个 8G 内存的系统最多能创建多少个线程?

推荐阅读:深入理解 JVM 的运行时数据区

理论上大约 8000 个。

创建线程的时候,至少需要分配一个虚拟机栈,在 64 位操作系统中,默认大小为 1M,因此一个线程大约需要 1M 的内存。

但 JVM、操作系统本身的运行就要占一定的内存空间,所以实际上可以创建的线程数远比 8000 少。

详细解释一下。

可以通过 java -XX:+PrintFlagsFinal -version | grep ThreadStackSize 命令查看 JVM 栈的默认大小。

其中 ThreadStackSize 的单位是 KB,也就是说默认的 JVM 栈大小是 1024 KB,也就是 1M。

启动一个 Java 程序,你能说说里面有哪些线程吗?

首先是 main 线程,这是程序执行的入口。

然后是垃圾回收线程,它是一个后台线程,负责回收不再使用的对象。

还有编译器线程,比如 JIT,负责把一部分热点代码编译后放到 codeCache 中。

可以通过下面的代码进行检测:

1 | class ThreadLister { |

结果如下所示:

1 | Thread: Monitor Ctrl-Break (ID=5) |

简单解释下:

Thread: main (ID=1)- 主线程,Java 程序启动时由 JVM 创建。Thread: Reference Handler (ID=2)- 这个线程是用来处理引用对象的,如软引用、弱引用和虚引用。负责清理被 JVM 回收的对象。Thread: Finalizer (ID=3)- 终结器线程,负责调用对象的 finalize 方法。对象在垃圾回收器标记为可回收之前,由该线程执行其 finalize 方法,用于执行特定的资源释放操作。Thread: Signal Dispatcher (ID=4)- 信号调度线程,处理来自操作系统的信号,将它们转发给 JVM 进行进一步处理,例如响应中断、停止等信号。Thread: Monitor Ctrl-Break (ID=5)- 监视器线程,通常由一些特定的 IDE 创建,用于在开发过程中监控和管理程序执行或者处理中断。

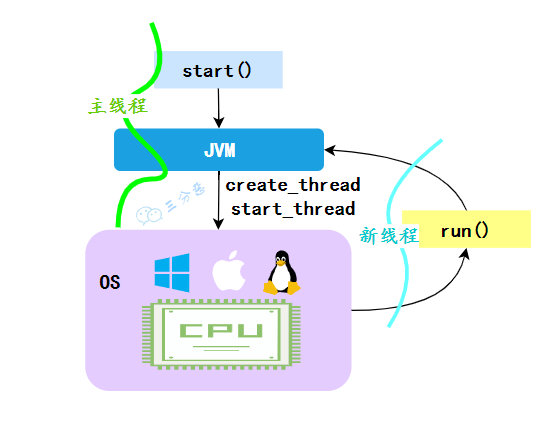

4.🌟调用 start 方法时会执行 run 方法,那怎么不直接调用 run方法?

调用 start() 会创建一个新的线程,并异步执行 run() 方法中的代码。

直接调用 run() 方法只是一个普通的同步方法调用,所有代码都在当前线程中执行,不会创建新线程。没有新的线程创建,也就达不到多线程并发的目的。

通过敲代码体验一下。

1 | class MyThread extends Thread { |

来看输出结果:

1 | main |

也就是说,调用 start() 方法会通知 JVM,去调用底层的线程调度机制来启动新线程。

调用 start() 后,线程进入就绪状态,等待操作系统调度;一旦调度执行,线程会执行其 run() 方法中的代码。

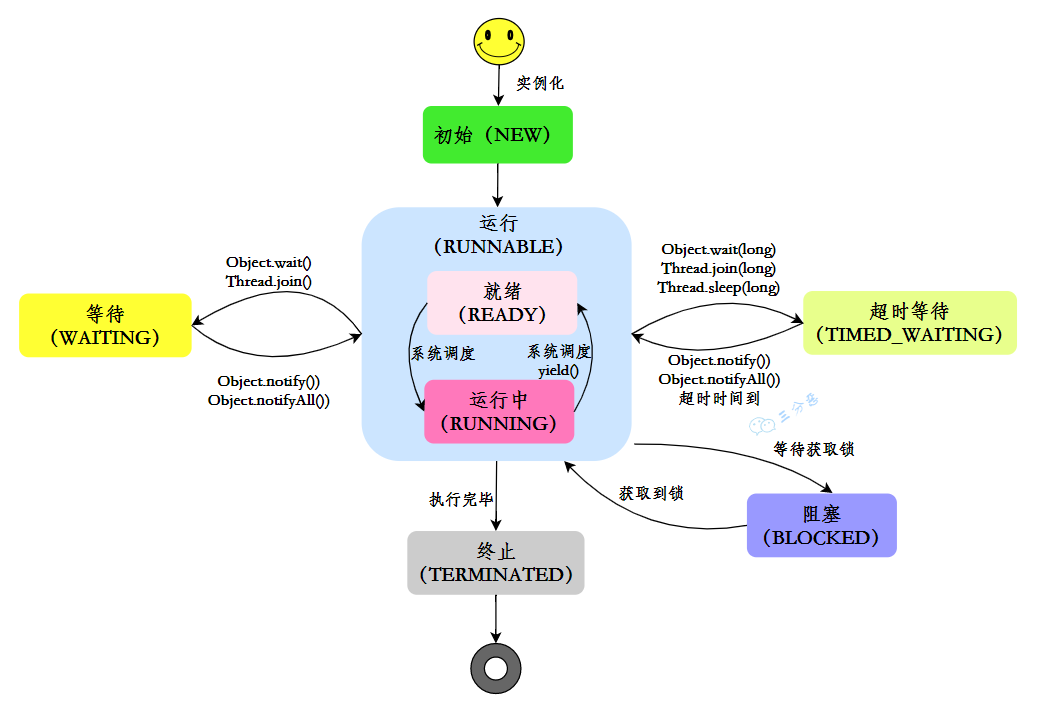

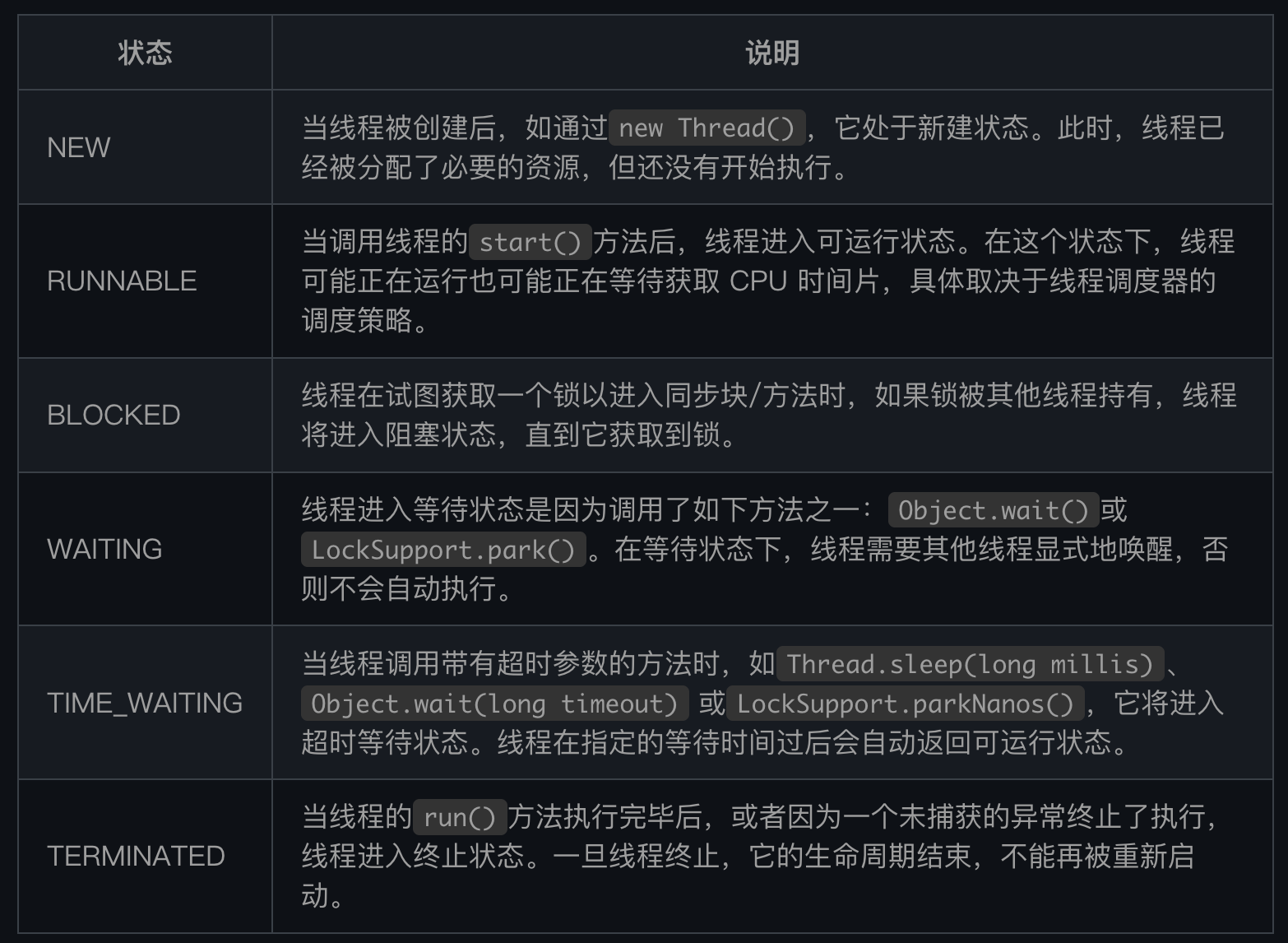

6.🌟线程有几种状态?

6 种。

new代表线程被创建但未启动;runnable代表线程处于就绪或正在运行状态,由操作系统调度;blocked代表线程被阻塞,等待获取锁;waiting代表线程等待其他线程的通知或中断;timed_waiting代表线程会等待一段时间,超时后自动恢复;terminated代表线程执行完毕,生命周期结束。

也就是说,线程的生命周期可以分为五个主要阶段:新建、就绪、运行、阻塞和终止。线程在运行过程中会根据状态的变化在这些阶段之间切换。

1 | class ThreadStateExample { |

用一个表格来做个总结:

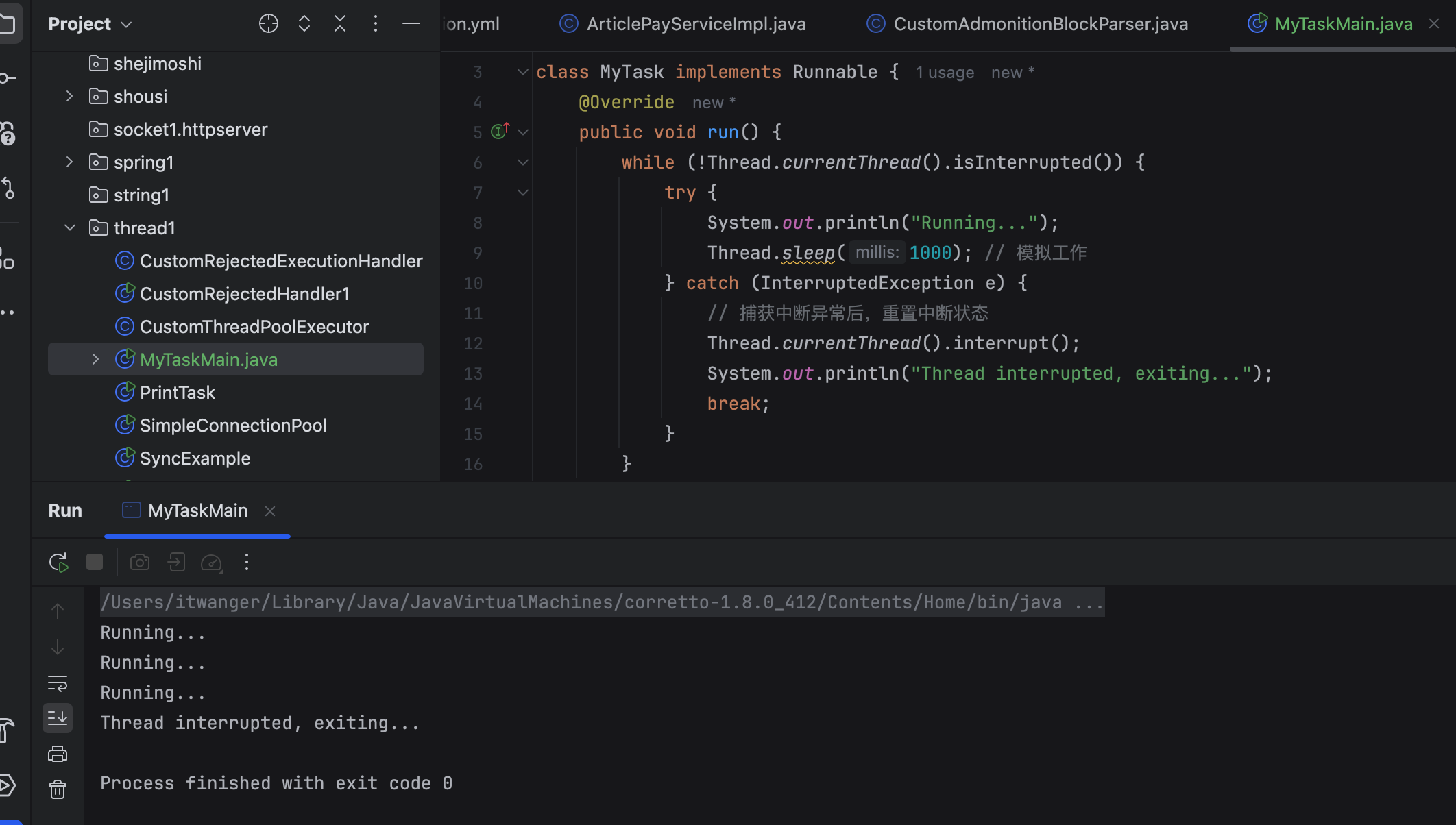

如何强制终止线程?

第一步,调用线程的 interrupt() 方法,请求终止线程。

第二步,在线程的 run() 方法中检查中断状态,如果线程被中断,就退出线程。

1 | class MyTask implements Runnable { |

中断结果:

10.🌟请说说 sleep 和 wait 的区别?(补充)

sleep 会让当前线程休眠,不需要获取对象锁,属于 Thread 类的方法;wait 会让获得对象锁的线程等待,要提前获得对象锁,属于 Object 类的方法。

①、所属类不同

sleep()方法专属于Thread类。wait()方法专属于Object类。

②、锁行为不同

如果一个线程在持有某个对象锁时调用了 sleep 方法,它在睡眠期间仍然会持有这个锁。

1 | class SleepDoesNotReleaseLock { |

输出结果:

1 | Thread 1 会继续持有锁,并且进入睡眠状态 |

从输出中我们可以看到,waitingThread 必须等待 sleepingThread 完成睡眠后才能进入同步代码块。

而当线程执行 wait 方法时,它会释放持有的对象锁,因此其他线程也有机会获取该对象的锁。

1 | class WaitReleasesLock { |

输出结果:

1 | Thread 1 持有锁,准备等待 5 秒 |

这表明 waitingThread 在调用 wait 后确实释放了锁。

③、使用条件不同

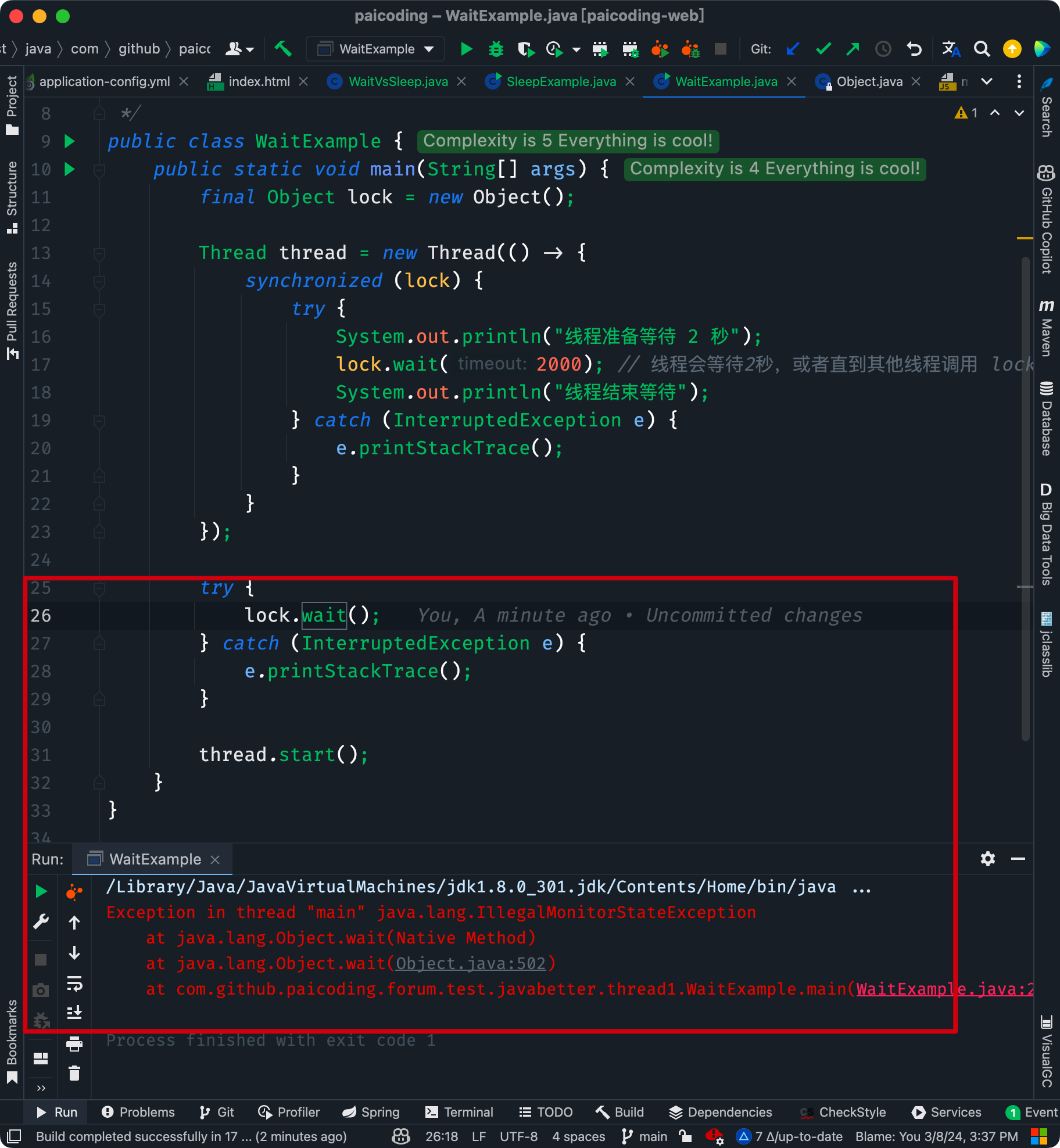

sleep() 方法可以在任何地方被调用。wait() 方法必须在同步代码块或同步方法中被调用,这是因为调用 wait() 方法的前提是当前线程必须持有对象的锁。否则会抛出 IllegalMonitorStateException 异常。

④、唤醒方式不同

调用 sleep 方法后,线程会进入 TIMED_WAITING 状态,即在指定的时间内暂停执行。当指定的时间结束后,线程会自动恢复到 RUNNABLE 状态,等待 CPU 调度再次执行。

调用 wait 方法后,线程会进入 WAITING 状态,直到有其他线程在同一对象上调用 notify 或 notifyAll 方法,线程才会从 WAITING 状态转变为 RUNNABLE 状态,准备再次获得 CPU 的执行权。

我们来通过代码再感受一下 sleep 和 wait 在用法上的区别,先看 sleep 的用法:

1 | class SleepExample { |

再来看 wait() 的用法:

1 | class WaitExample { |

11.🌟怎么保证线程安全?(补充)

线程安全是指在并发环境下,多个线程访问共享资源时,程序能够正确地执行,而不会出现数据不一致的问题。

为了保证线程安全,可以使用 synchronized 关键字对方法加锁,对代码块加锁。线程在执行同步方法、同步代码块时,会获取类锁或者对象锁,其他线程就会阻塞并等待锁。

如果需要更细粒度的锁,可以使用 ReentrantLock 并发重入锁等。

如果需要保证变量的内存可见性,可以使用 volatile 关键字。

对于简单的原子变量操作,还可以使用 Atomic 原子类。

对于线程独立的数据,可以使用 ThreadLocal 来为每个线程提供专属的变量副本。

对于需要并发容器的地方,可以使用 ConcurrentHashMap、CopyOnWriteArrayList 等。

有个int的变量为0,十个线程轮流对其进行++操作(循环10000次),结果大于10 万还是小于等于10万,为什么?

在这个场景中,最终的结果会小于 100000,原因是多线程环境下,++ 操作并不是一个原子操作,而是分为读取、加 1、写回三个步骤。

- 读取变量的值。

- 将读取到的值加 1。

- 将结果写回变量。

这样的话,就会有多个线程读取到相同的值,然后对这个值进行加 1 操作,最终导致结果小于 100000。

详细解释下。

多个线程在并发执行 ++ 操作时,可能出现以下竞态条件:

- 线程 1 读取变量值为 0。

- 线程 2 也读取变量值为 0。

- 线程 1 进行加法运算并将结果 1 写回变量。

- 线程 2 进行加法运算并将结果 1 写回变量,覆盖了线程 1 的结果。

可以通过 synchronized 关键字为 ++ 操作加锁。

1 | class Main { |

或者使用 AtomicInteger 的 incrementAndGet() 方法来替代 ++ 操作,保证变量的原子性。

1 | class Main { |

场景:有一个 key 对应的 value 是一个json 结构,json 当中有好几个子任务,这些子任务如果对 key 进行修改的话,会不会存在线程安全的问题?

会。

在单节点环境中,可以使用 synchronized 关键字或 ReentrantLock 来保证对 key 的修改操作是原子的。

1 | class KeyManager { |

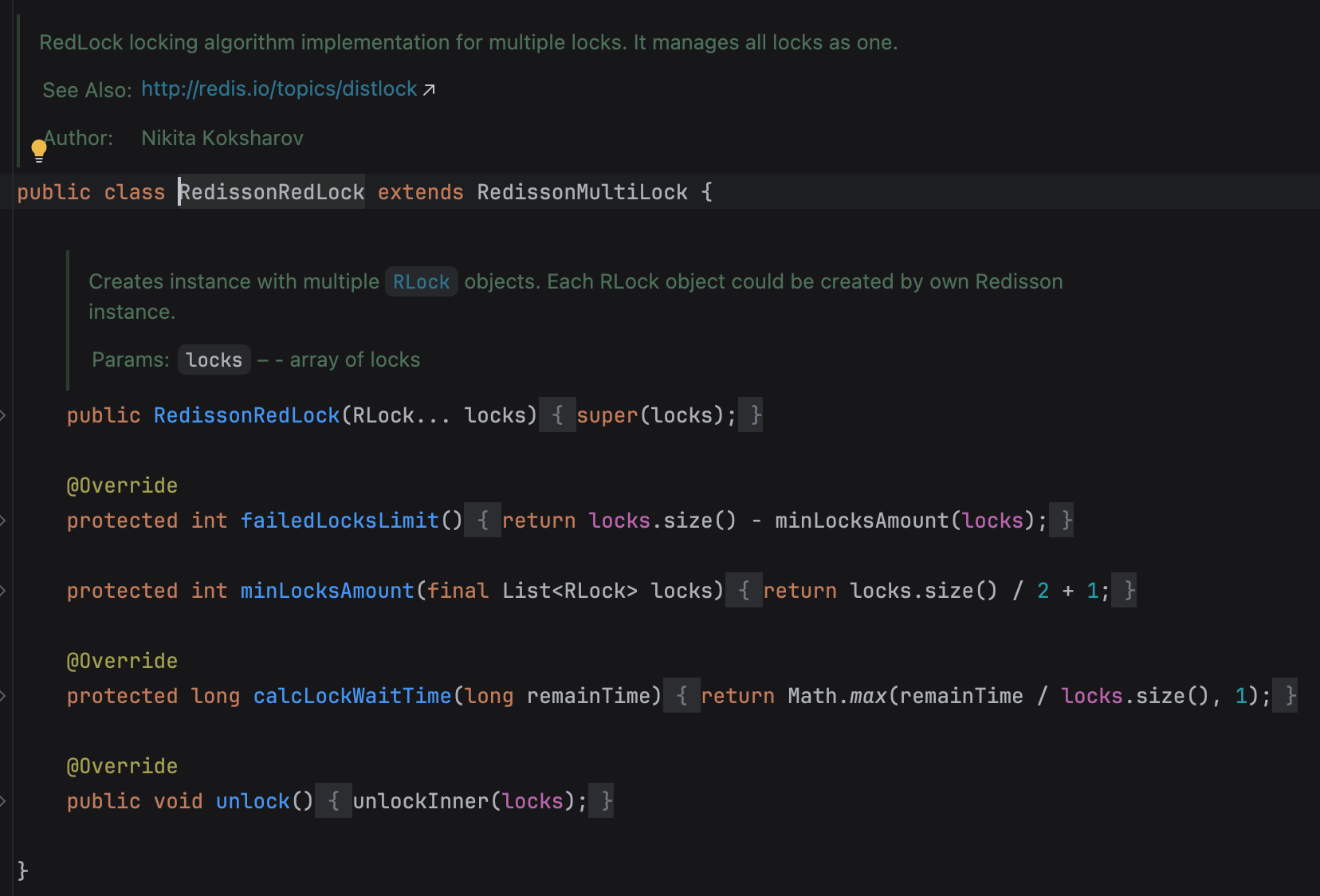

在多节点环境中,可以使用分布式锁 Redisson 来保证对 key 的修改操作是原子的。

1 | class DistributedKeyManager { |

说一个线程安全的使用场景?

单例模式。在多线程环境下,如果多个线程同时尝试创建实例,单例类必须确保只创建一个实例,并提供一个全局访问点。

饿汉式是一种比较直接的实现方式,它通过在类加载时就立即初始化单例对象来保证线程安全。

1 | class Singleton { |

懒汉式单例则在第一次使用时初始化单例对象,这种方式需要使用双重检查锁定来确保线程安全,volatile 关键字用来保证可见性,syncronized 关键字用来保证同步。

1 | class LazySingleton { |

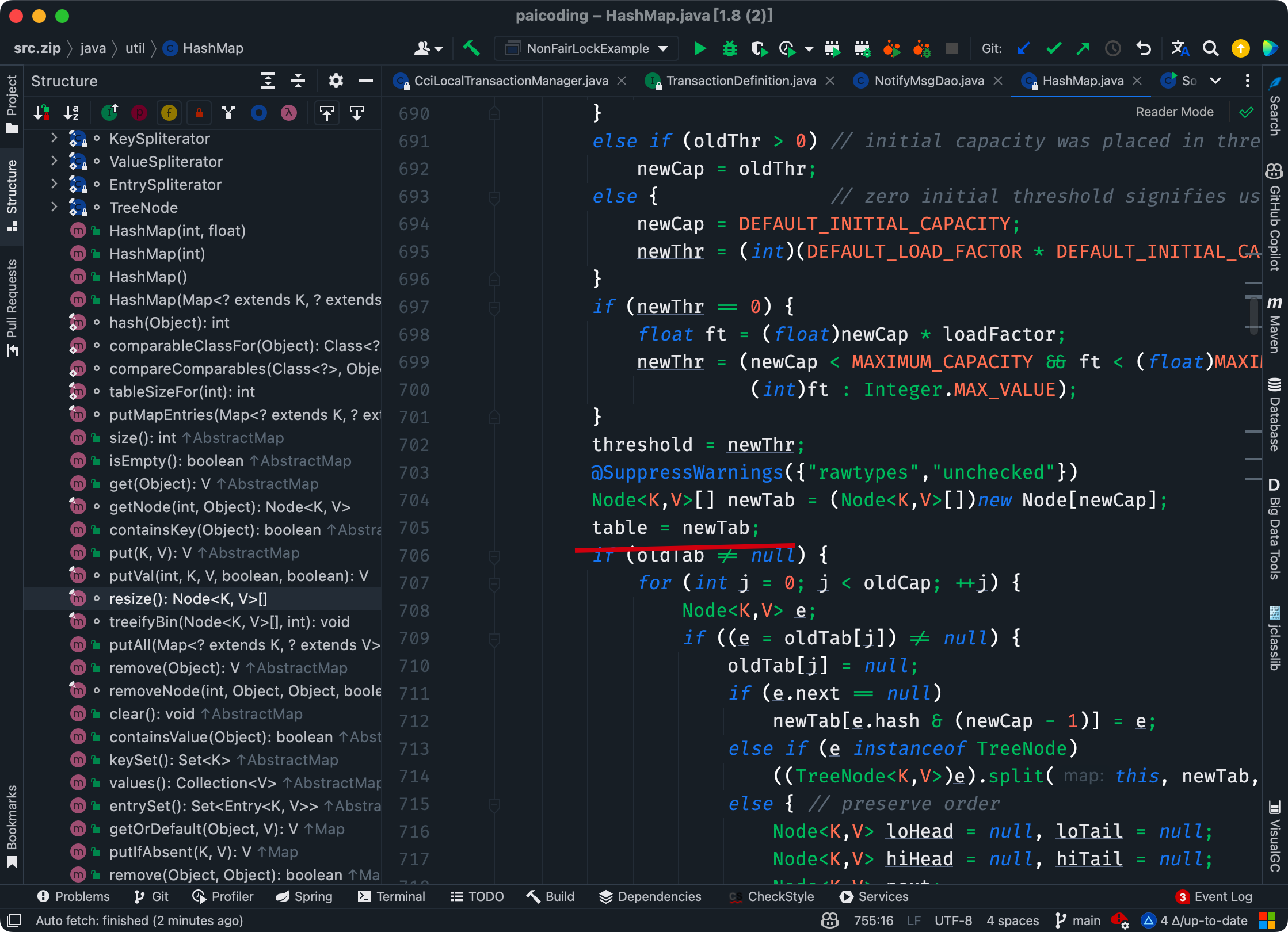

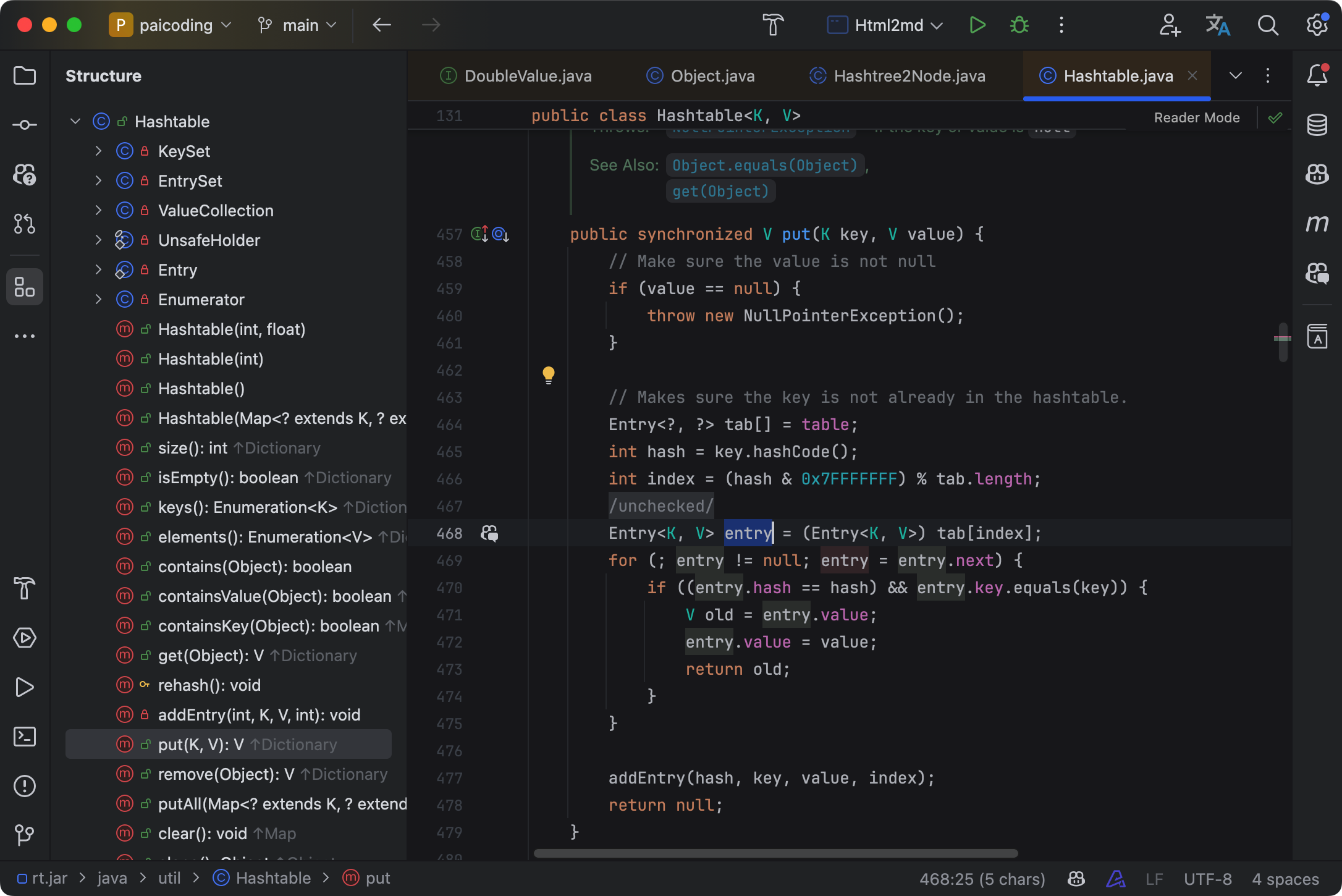

能说一下 Hashtable 的底层数据结构吗?

与 HashMap 类似,Hashtable 的底层数据结构也是一个数组加上链表的方式,然后通过 synchronized 加锁来保证线程安全。

二哥的Java 进阶之路:Hashtable源码

推荐阅读:ThreadLocal 全面解析

12.🌟ThreadLocal 是什么?

ThreadLocal 是一种用于实现线程局部变量的工具类。它允许每个线程都拥有自己的独立副本,从而实现线程隔离。

三分恶面渣逆袭:ThreadLocal线程副本

使用 ThreadLocal 通常分为四步:

①、创建 ThreadLocal

1 | //创建一个ThreadLocal变量 |

②、设置 ThreadLocal 的值

1 | //设置ThreadLocal变量的值 |

③、获取 ThreadLocal 的值

1 | //获取ThreadLocal变量的值 |

④、删除 ThreadLocal 的值

1 | //删除ThreadLocal变量的值 |

在 Web 应用中,可以使用 ThreadLocal 存储用户会话信息,这样每个线程在处理用户请求时都能方便地访问当前用户的会话信息。

在数据库操作中,可以使用 ThreadLocal 存储数据库连接对象,每个线程有自己独立的数据库连接,从而避免了多线程竞争同一数据库连接的问题。

在格式化操作中,例如日期格式化,可以使用 ThreadLocal 存储 SimpleDateFormat 实例,避免多线程共享同一实例导致的线程安全问题。

ThreadLocal 有哪些优点?

每个线程访问的变量副本都是独立的,避免了共享变量引起的线程安全问题。由于 ThreadLocal 实现了变量的线程独占,使得变量不需要同步处理,因此能够避免资源竞争。

ThreadLocal 可用于跨方法、跨类时传递上下文数据,不需要在方法间传递参数。

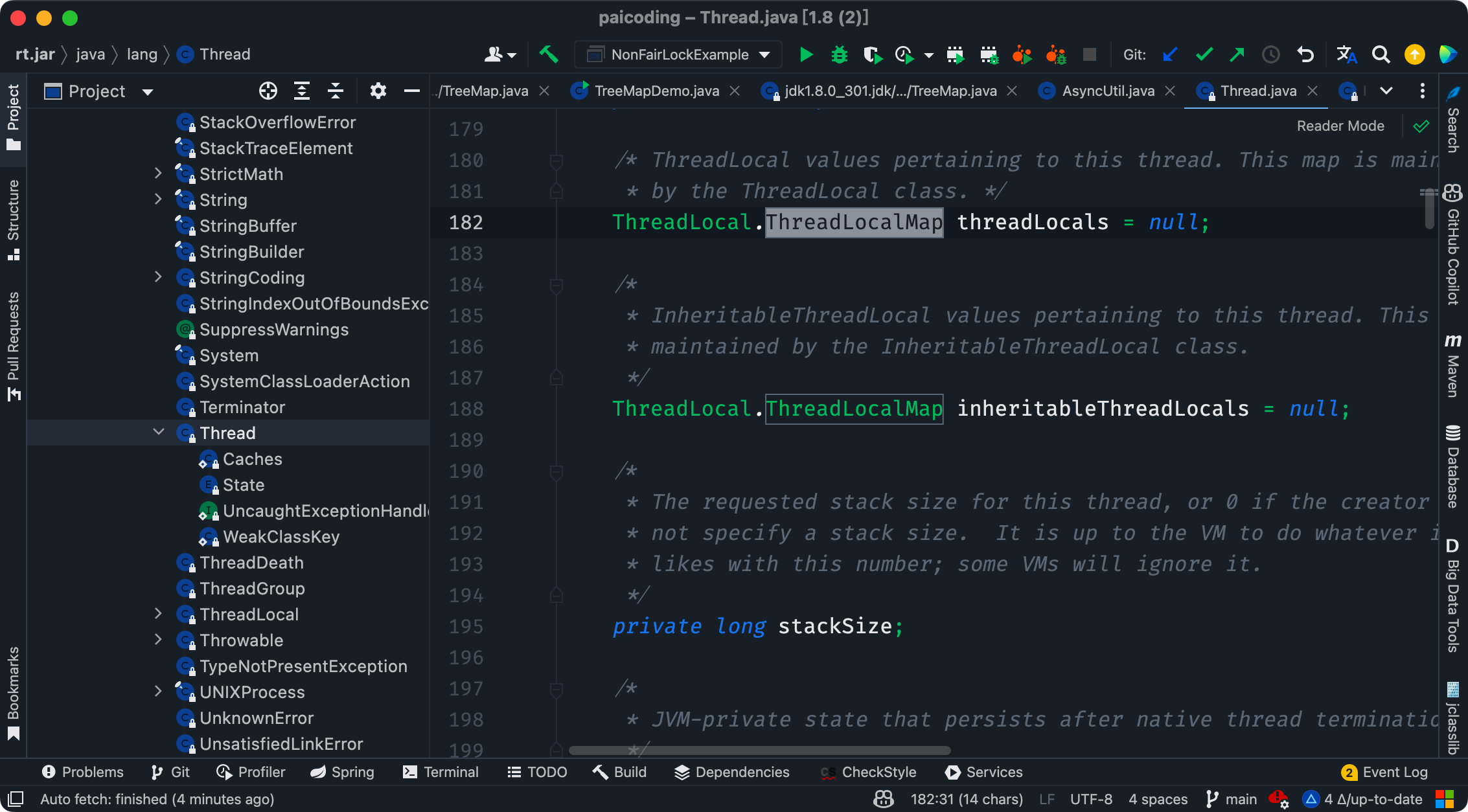

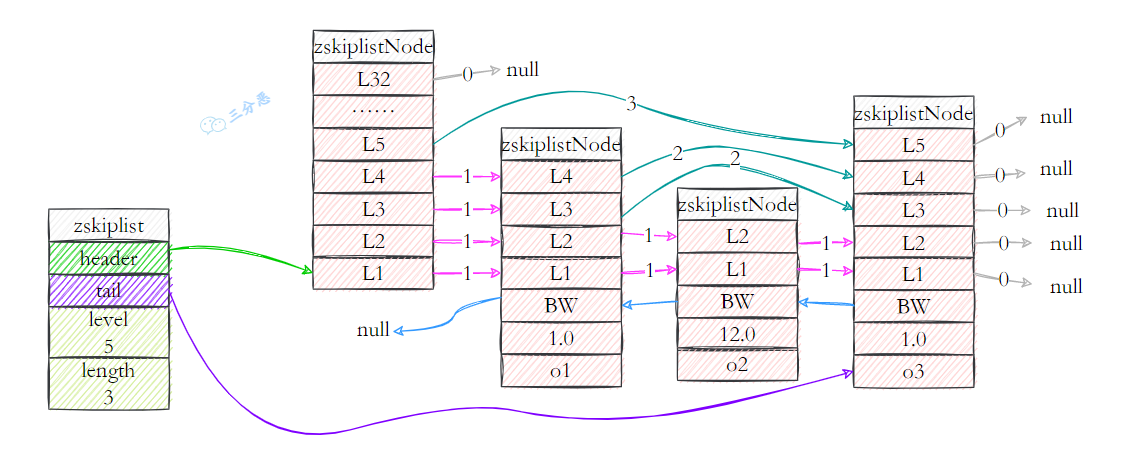

14.🌟ThreadLocal 怎么实现的呢?

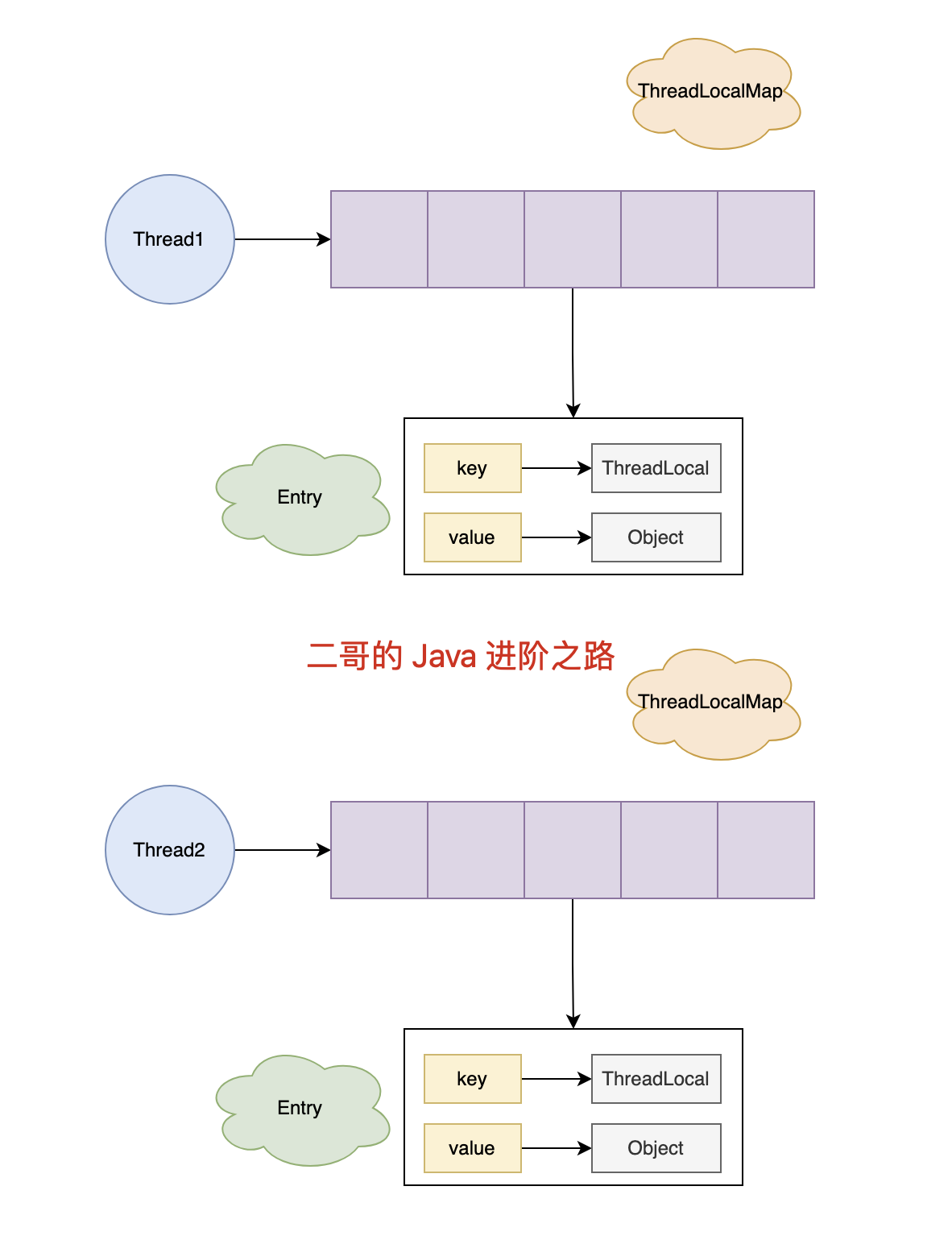

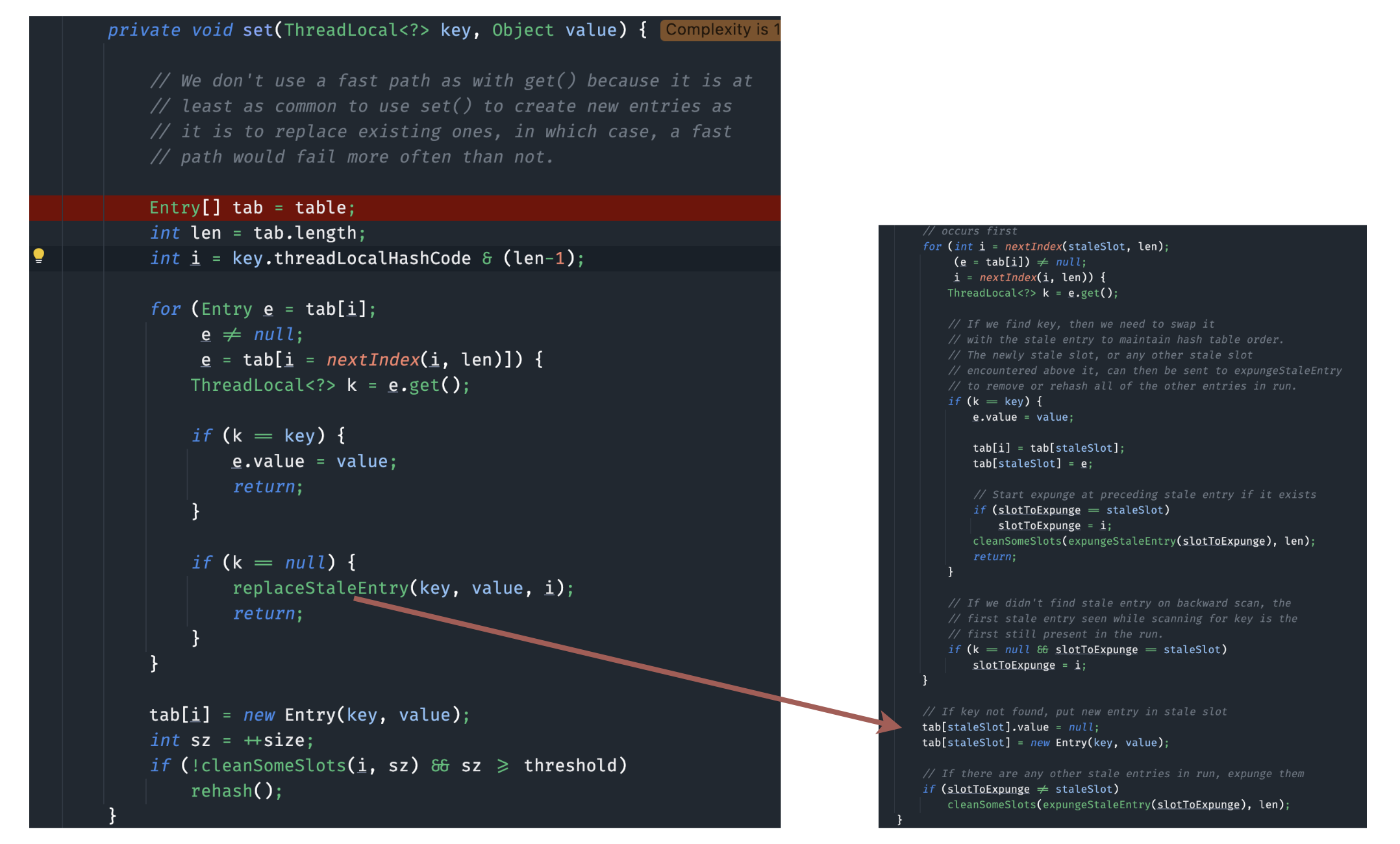

当我们创建一个 ThreadLocal 对象并调用 set 方法时,其实是在当前线程中初始化了一个 ThreadLocalMap。

二哥的 Java 进阶之路:ThreadLocalMap

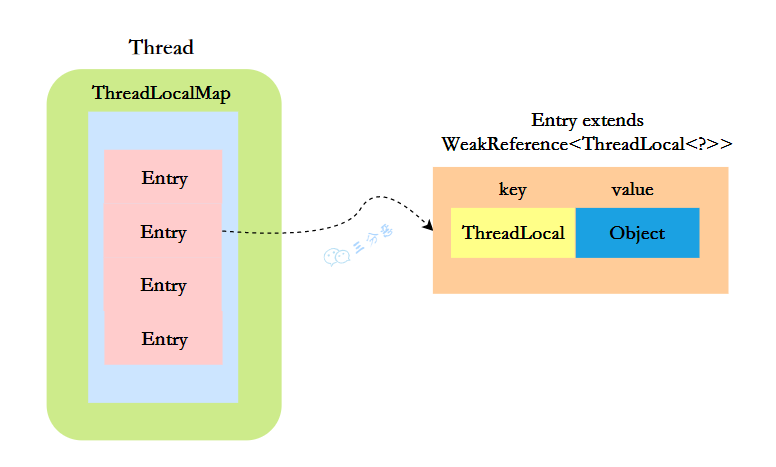

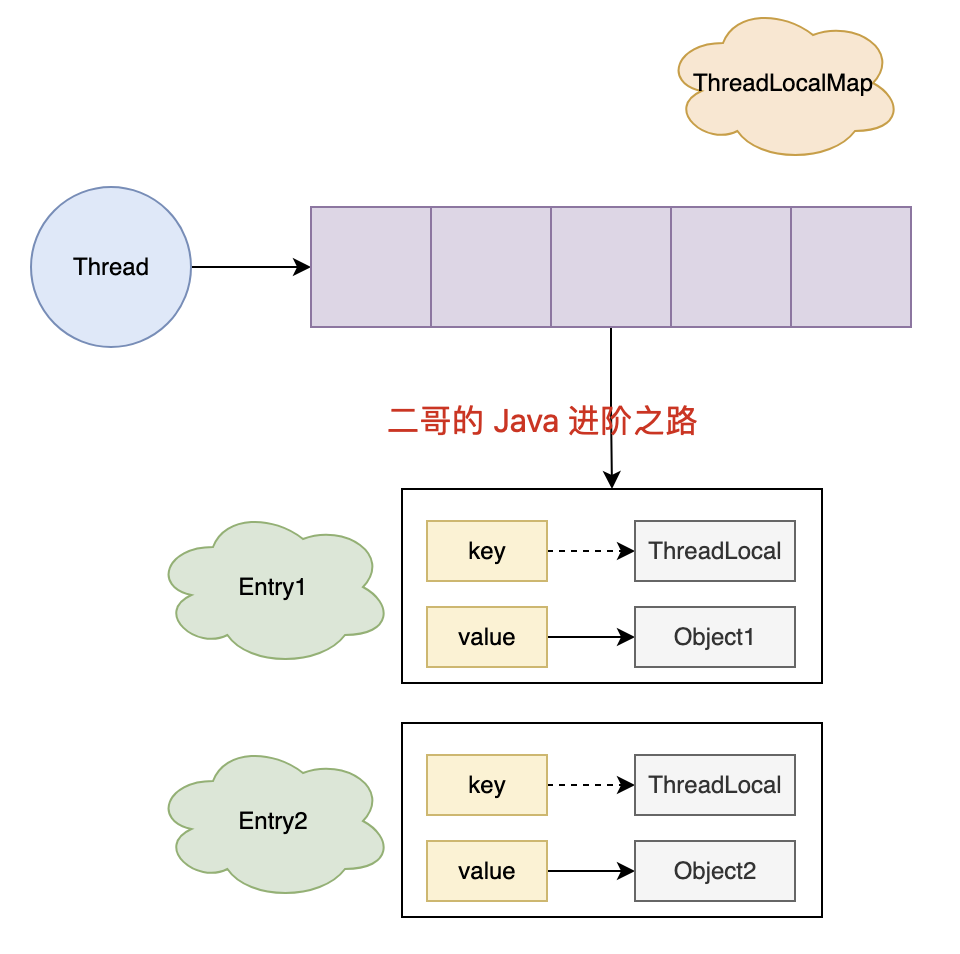

ThreadLocalMap 是 ThreadLocal 的一个静态内部类,它内部维护了一个 Entry 数组,key 是 ThreadLocal 对象,value 是线程的局部变量,这样就相当于为每个线程维护了一个变量副本。

三分恶面渣逆袭:ThreadLoca结构图

Entry 继承了 WeakReference,它限定了 key 是一个弱引用,弱引用的好处是当内存不足时,JVM 会回收 ThreadLocal 对象,并且将其对应的 Entry.value 设置为 null,这样可以在很大程度上避免内存泄漏。

1 | static class Entry extends WeakReference<ThreadLocal<?>> { |

总结一下:

ThreadLocal 的实现原理是,每个线程维护一个 Map,key 为 ThreadLocal 对象,value 为想要实现线程隔离的对象。

1、通过 ThreadLocal 的 set 方法将对象存入 Map 中。

2、通过 ThreadLocal 的 get 方法从 Map 中取出对象。

3、Map 的大小由 ThreadLocal 对象的多少决定。

ThreadLocal 的结构

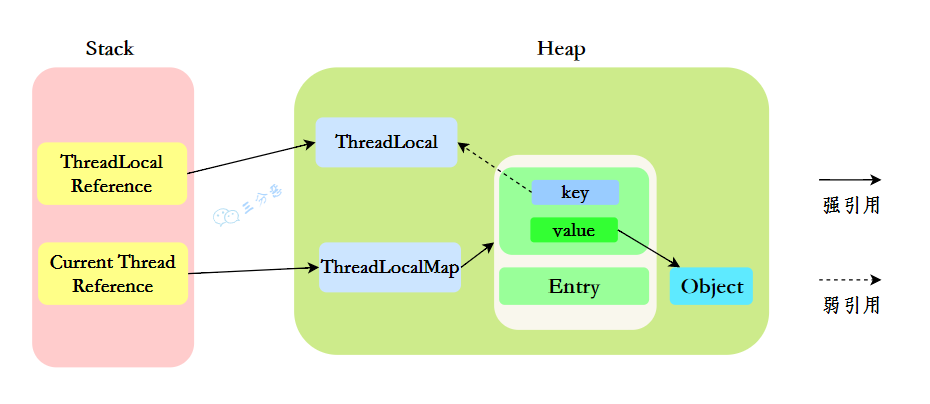

什么是弱引用,什么是强引用?

我先说一下强引用,比如 User user = new User("沉默王二") 中,user 就是一个强引用,new User("沉默王二") 就是强引用对象。

当 user 被置为 null 时(user = null),new User("沉默王二") 对象就会被垃圾回收;否则即便是内存空间不足,JVM 也不会回收 new User("沉默王二") 这个强引用对象,宁愿抛出 OutOfMemoryError。

弱引用,比如说在使用 ThreadLocal 中,Entry 的 key 就是一个弱引用对象。

1 | ThreadLocal<User> userThreadLocal = new ThreadLocal<>(); |

userThreadLocal 是一个强引用,new ThreadLocal<>() 是一个强引用对象;

new User("沉默王二") 是一个强引用对象。

调用 set 方法后,会将 key = new ThreadLocal<>() 放入 ThreadLocalMap 中,此时的 key 是一个弱引用对象。当 JVM 进行垃圾回收时,如果发现了弱引用对象,就会将其回收。

三分恶面渣逆袭:ThreadLocal内存分配

其关系链就是:

- ThreadLocal 强引用 -> ThreadLocal 对象。

- Thread 强引用 -> ThreadLocalMap。

ThreadLocalMap[i]强引用了 -> Entry。- Entry.key 弱引用 -> ThreadLocal 对象。

- Entry.value 强引用 -> 线程的局部变量对象。

15.🌟ThreadLocal 内存泄露是怎么回事?

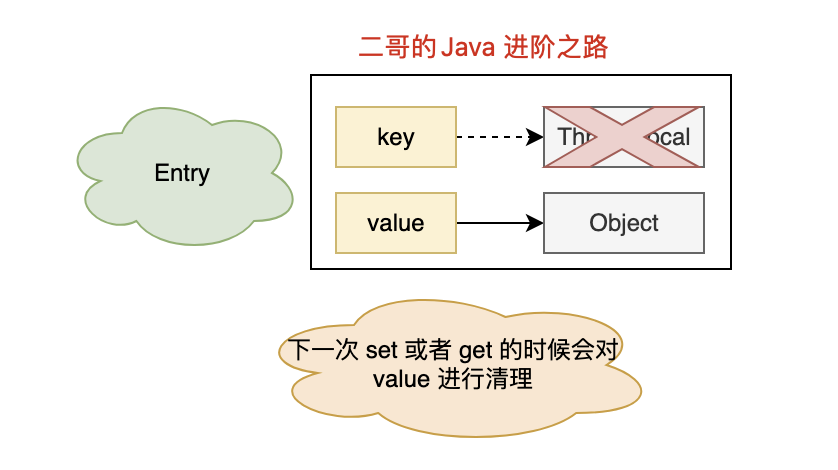

ThreadLocalMap 的 Key 是 弱引用,但 Value 是强引用。

如果一个线程一直在运行,并且 value 一直指向某个强引用对象,那么这个对象就不会被回收,从而导致内存泄漏。

二哥的 Java 进阶之路:ThreadLocalMap 内存溢出

那怎么解决内存泄漏问题呢?

很简单,使用完 ThreadLocal 后,及时调用 remove() 方法释放内存空间。

1 | try { |

remove() 会调用 ThreadLocalMap 的 remove 方法遍历哈希表,找到 key 等于当前 ThreadLocal 的 Entry,找到后会调用 Entry 的 clear 方法,将 Entry 的 value 设置为 null。

1 | private void remove(ThreadLocal<?> key) { |

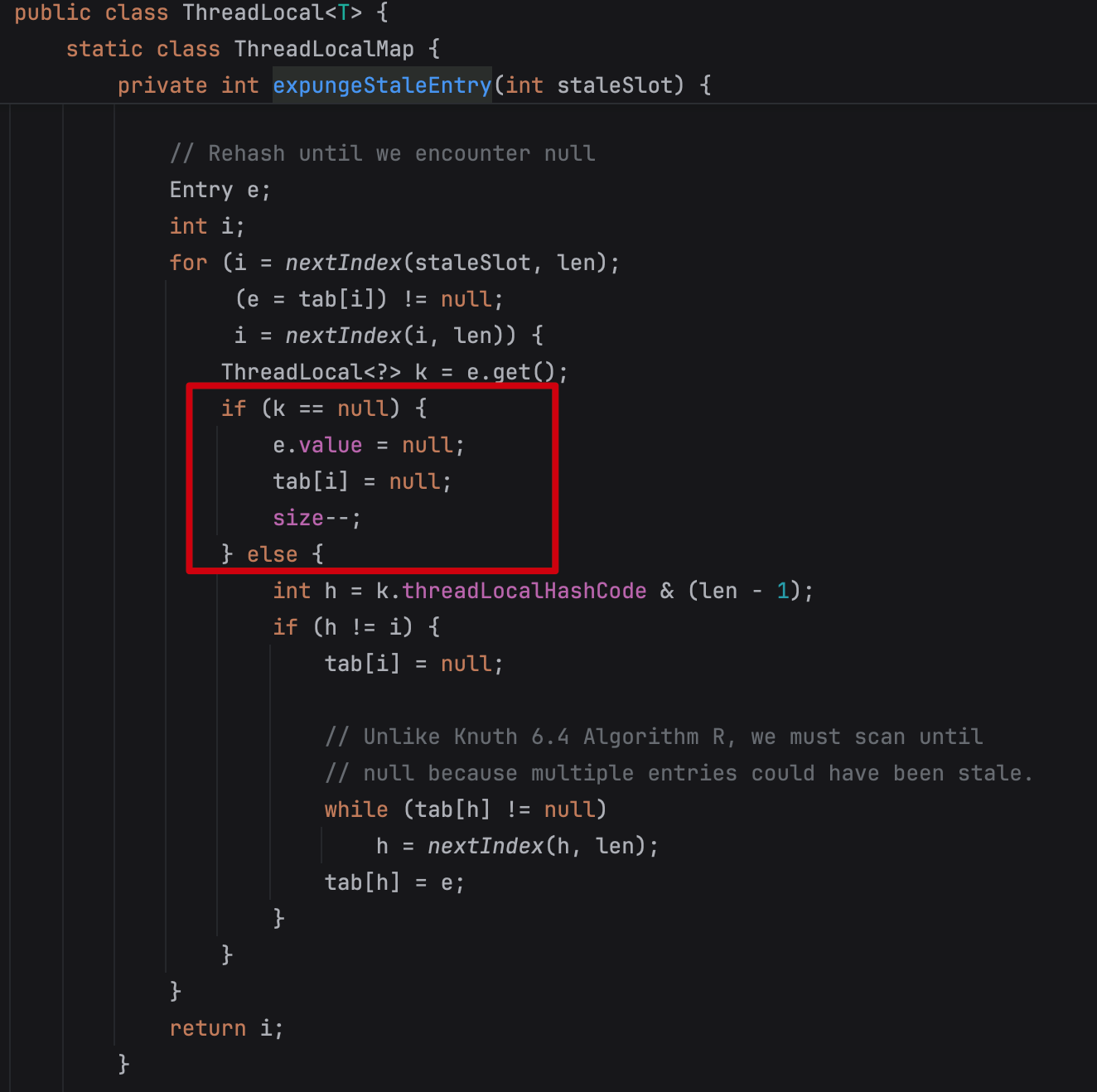

然后执行 expungeStaleEntry() 方法,清除 key 为 null 的 Entry。

二哥的Java进阶之路:expungeStaleEntry

那为什么 key 要设计成弱引用?

弱引用的好处是,当内存不足的时候,JVM 能够及时回收掉弱引用的对象。

比如说:

1 | WeakReference key = new WeakReference(new ThreadLocal()); |

key 是弱引用,new WeakReference(new ThreadLocal()) 是弱引用对象,当 JVM 进行垃圾回收时,只要发现了弱引用对象,就会将其回收。

一旦 key 被回收,ThreadLocalMap 在进行 set、get 的时候就会对 key 为 null 的 Entry 进行清理。

二哥的 Java 进阶之路:清理 entry

总结一下,在 ThreadLocal 被垃圾收集后,下一次访问 ThreadLocalMap 时,Java 会自动清理那些键为 null 的 entry,这个过程会在执行 get()、set()、remove()时触发。

二哥的 Java 进阶之路:replaceStaleEntry方法

你了解哪些 ThreadLocal 的改进方案?

在 JDK 20 Early-Access Build 28 版本中,出现了 ThreadLocal 的改进方案,即 ScopedValue。

还有 Netty 中的 FastThreadLocal,它是 Netty 对 ThreadLocal 的优化,内部维护了一个索引常量 index,每次创建 FastThreadLocal 中都会自动+1,用来取代 hash 冲突带来的损耗,用空间换时间。

1 | private final int index; |

以及阿里的 TransmittableThreadLocal,不仅实现了子线程可以继承父线程 ThreadLocal 的功能,并且还可以跨线程池传递值。

1 | TransmittableThreadLocal<String> context = new TransmittableThreadLocal<>(); |

20.🌟说一下你对 Java 内存模型的理解?

推荐阅读:说说 Java 的内存模型

Java 内存模型是 Java 虚拟机规范中定义的一个抽象模型,用来描述多线程环境中共享变量的内存可见性。

深入浅出 Java 多线程:Java内存模型

共享变量存储在主内存中,每个线程都有一个私有的本地内存,存储了共享变量的副本。

- 当一个线程更改了本地内存中共享变量的副本,它需要 JVM 刷新到主内存中,以确保其他线程可以看到这些更改。

- 当一个线程需要读取共享变量时,它一版会从本地内存中读取。如果本地内存中的副本是过时的,JVM 会将主内存中的共享变量最新值刷新到本地内存中。

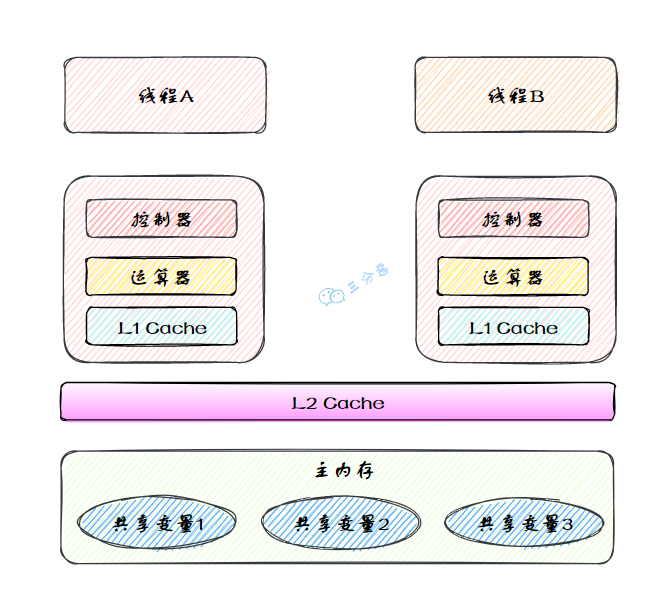

三分恶面渣逆袭:实际线程工作模型

为什么线程要用自己的内存?

线程从主内存拷贝变量到工作内存,可以减少 CPU 访问 RAM 的开销。

每个线程都有自己的变量副本,可以避免多个线程同时修改共享变量导致的数据冲突。

25.🌟volatile 了解吗?

推荐阅读:volatile 关键字解析

了解。

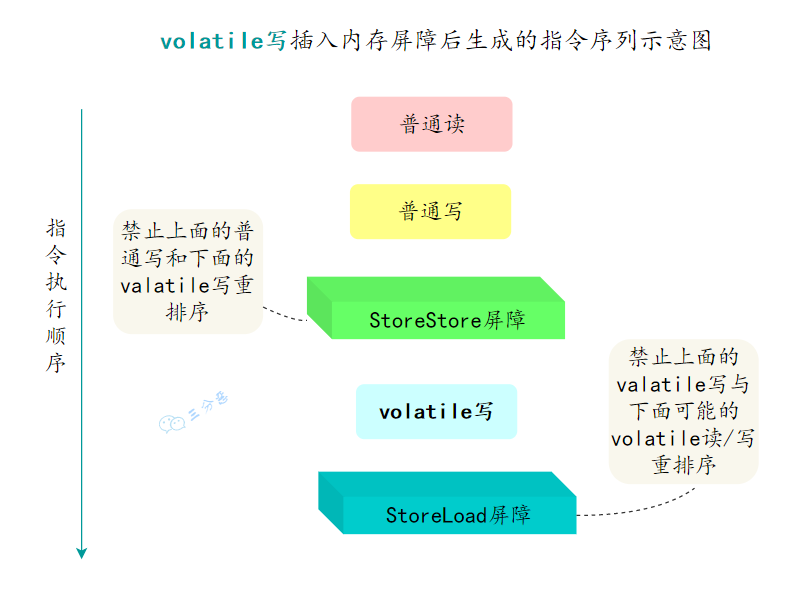

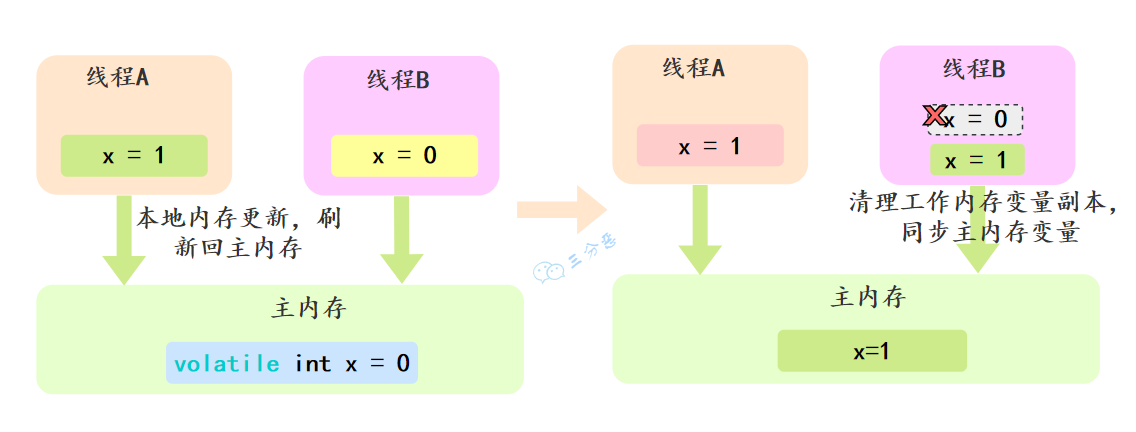

第一,保证可见性,线程修改 volatile 变量后,其他线程能够立即看到最新值;第二,防止指令重排,volatile 变量的写入不会被重排序到它之前的代码。

volatile 怎么保证可见性的?

当线程对 volatile 变量进行写操作时,JVM 会在这个变量写入之后插入一个写屏障指令,这个指令会强制将本地内存中的变量值刷新到主内存中。

三分恶面渣逆袭:volatile写插入内存屏障后生成的指令序列示意图

1 | StoreStore; // 保证写入之前的操作不会重排 |

在 x86 架构下,通常会使用 lock 指令来实现写屏障,例如:

1 | mov [a], 2 ; 将值 2 写入内存地址 a |

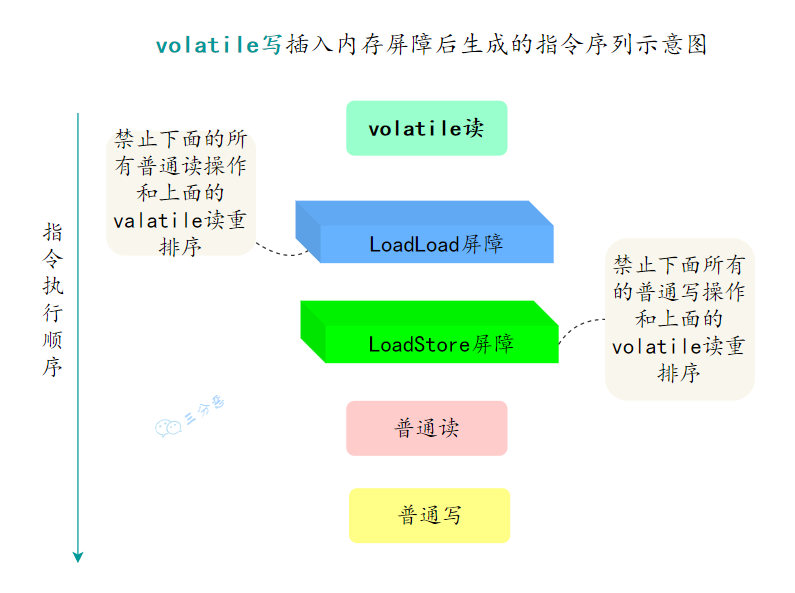

当线程对 volatile 变量进行读操作时,JVM 会插入一个读屏障指令,这个指令会强制让本地内存中的变量值失效,从而重新从主内存中读取最新的值。

三分恶面渣逆袭:volatile写插入内存屏障后生成的指令序列示意图

我们来声明一个 volatile 变量 x:

1 | volatile int x = 0 |

线程 A 对 x 写入后会将其最新的值刷新到主内存中,线程 B 读取 x 时由于本地内存中的 x 失效了,就会从主内存中读取最新的值。

三分恶面渣逆袭:volatile内存可见性

volatile 怎么保证有序性的?

JVM 会在 volatile 变量的读写前后插入 “内存屏障”,以约束 CPU 和编译器的优化行为:

- StoreStore 屏障可以禁止

volatile 写操作与普通写操作的重排 - StoreLoad 屏障会禁止

volatile 写与volatile 读重排 - LoadLoad 屏障会禁止

volatile 读与后续普通读操作重排 - LoadStore 屏障会禁止

volatile 读与后续普通写操作重排

volatile 和 synchronized 的区别?

volatile 关键字用于修饰变量,确保该变量的更新操作对所有线程是可见的,即一旦某个线程修改了 volatile 变量,其他线程会立即看到最新的值。

synchronized 关键字用于修饰方法或代码块,确保同一时刻只有一个线程能够执行该方法或代码块,从而实现互斥访问。

volatile 加在基本类型和对象上的区别?

当 volatile 用于基本数据类型时,能确保该变量的读写操作是直接从主内存中读取或写入的。

1 | private volatile int count = 0; |

当 volatile 用于引用类型时,能确保引用本身的可见性,即确保引用指向的对象地址是最新的。

但是,volatile 并不能保证引用对象内部状态的线程安全。

1 | private volatile SomeObject obj = new SomeObject(); |

虽然 volatile 确保了 obj 引用的可见性,但对 obj 引用的 new SomeObject() 对象并不受 volatile 保护。

如果需要保证引用对象内部状态的线程安全,需要使用 synchronized 或 ReentrantLock 等锁机制。

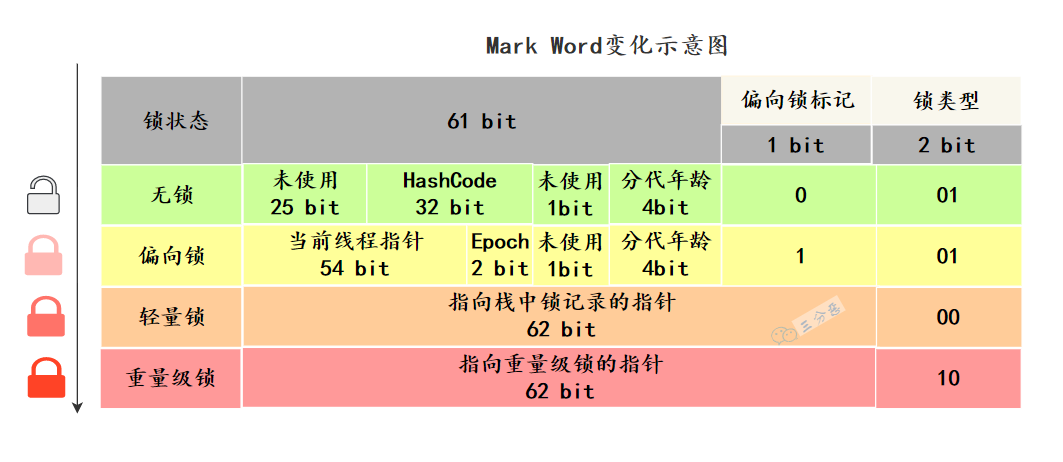

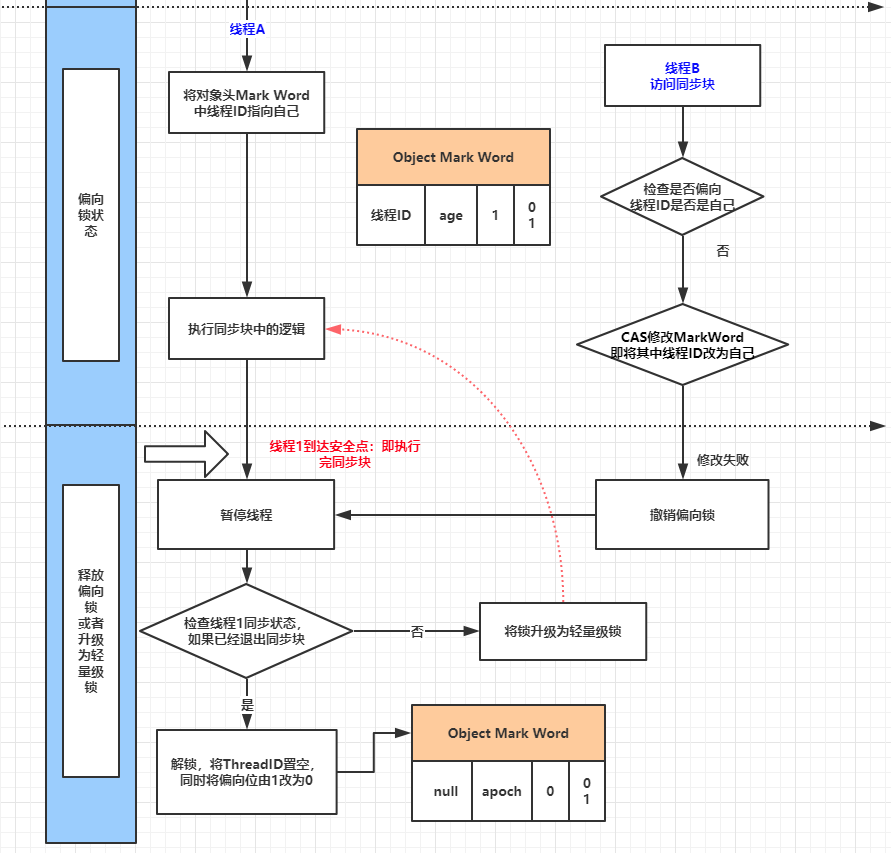

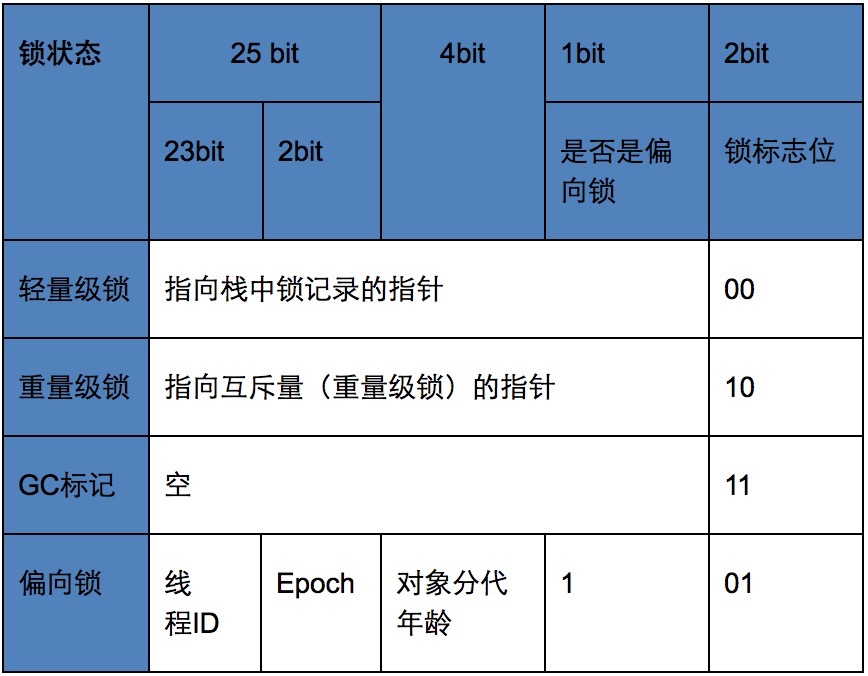

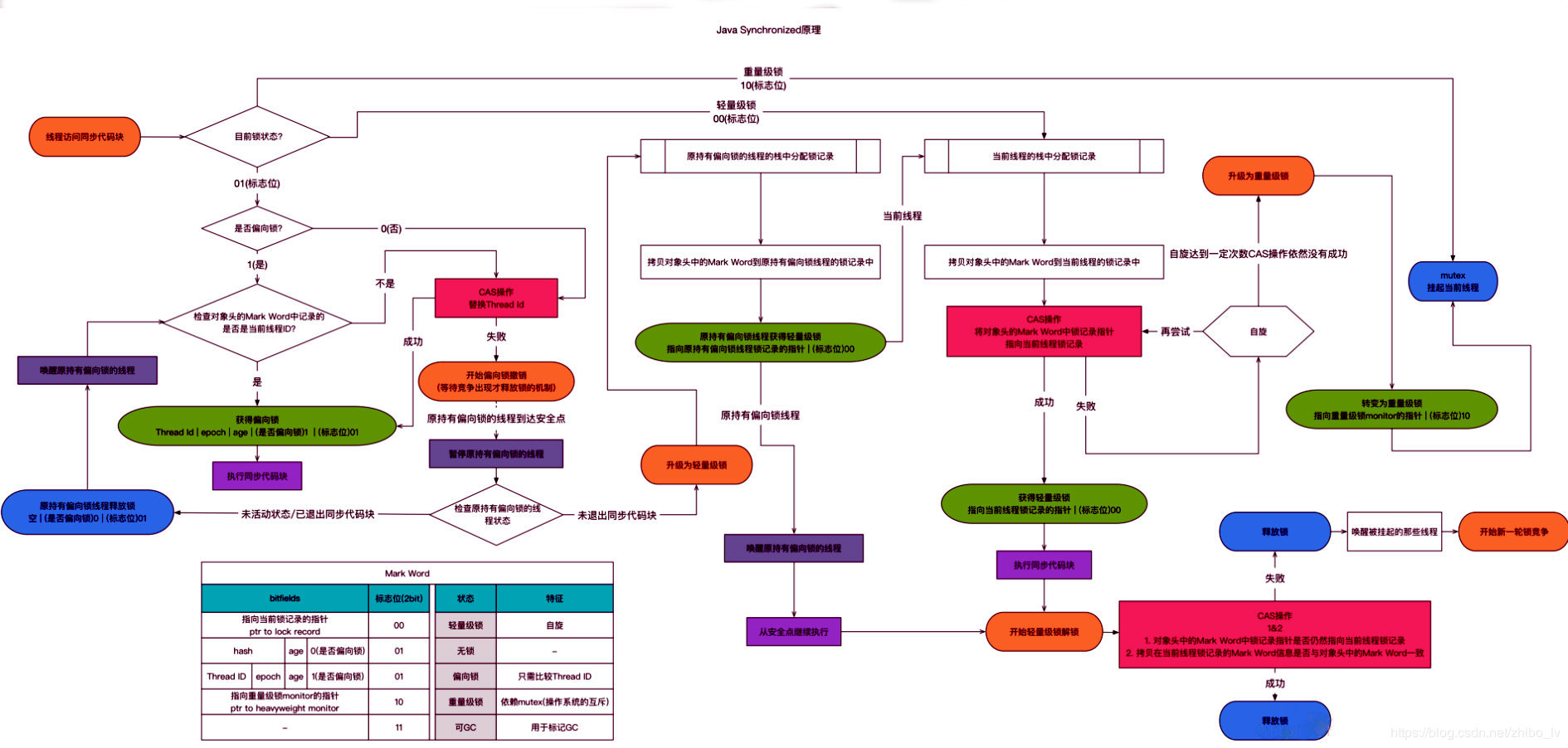

29.🌟synchronized 锁升级了解吗?

推荐阅读:偏向锁、轻量级锁、重量级锁到底是什么?

JDK 1.6 的时候,为了提升 synchronized 的性能,引入了锁升级机制,从低开销的锁逐步升级到高开销的锁,以最大程度减少锁的竞争。

三分恶面渣逆袭:Mark Word变化

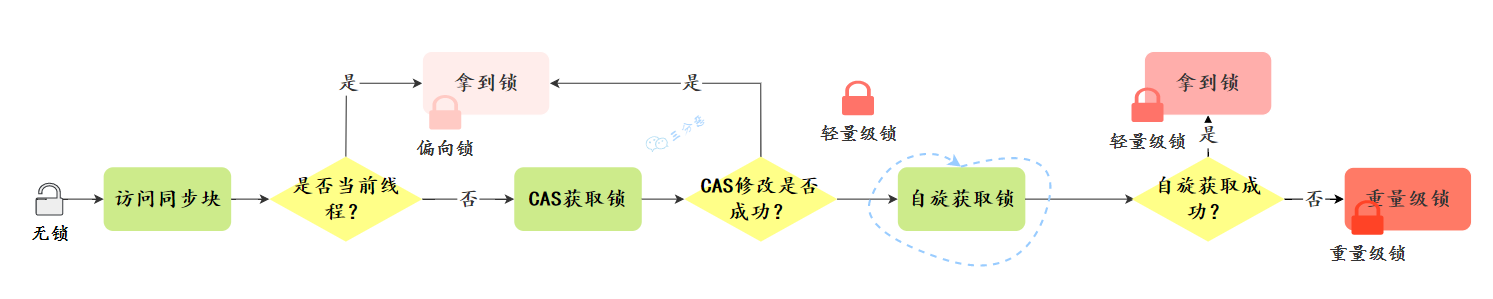

没有线程竞争时,就使用低开销的“偏向锁”,此时没有额外的 CAS 操作;轻度竞争时,使用“轻量级锁”,采用 CAS 自旋,避免线程阻塞;只有在重度竞争时,才使用“重量级锁”,由 Monitor 机制实现,需要线程阻塞。

了解 synchronized 四种锁状态吗?

了解。

①、无锁状态,对象未被锁定,Mark Word 存储对象的哈希码等信息。

②、偏向锁,当线程第一次获取锁时,会进入偏向模式。Mark Word 会记录线程 ID,后续同一线程再次获取锁时,可以直接进入 synchronized 加锁的代码,无需额外加锁。

博客园boluo1230:偏向锁

③、轻量级锁,当多个线程在不同时段获取同一把锁,即不存在锁竞争的情况时,JVM 会采用轻量级锁来避免线程阻塞。

未持有锁的线程通过CAS 自旋等待锁释放。

TodoCoder:自旋和阻塞的区别

当线程进入 synchronized 加锁的代码时,如果对象的锁状态为偏向锁,也就是锁类型为“01”,偏向锁标记为“0”的状态。

博客园wade&luffy:Mark Word

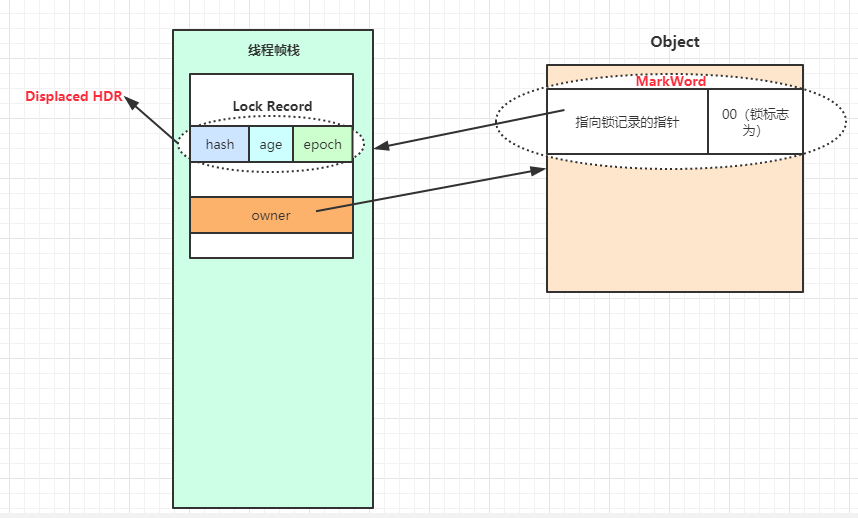

然后采用 CAS 自旋的方式,尝试将对象头中的 Mark Word 替换为指向 Lock Record 的指针,并将 Lock Record 中的 owner 指针指向对象的 Mark Word。

博客园boluo1230:轻量级锁

如果这个替换动作成功了,线程就拥有了该对象的锁,对象头 Mark Word 的锁标志位会更新为“00”,表示对象处于轻量级锁状态。

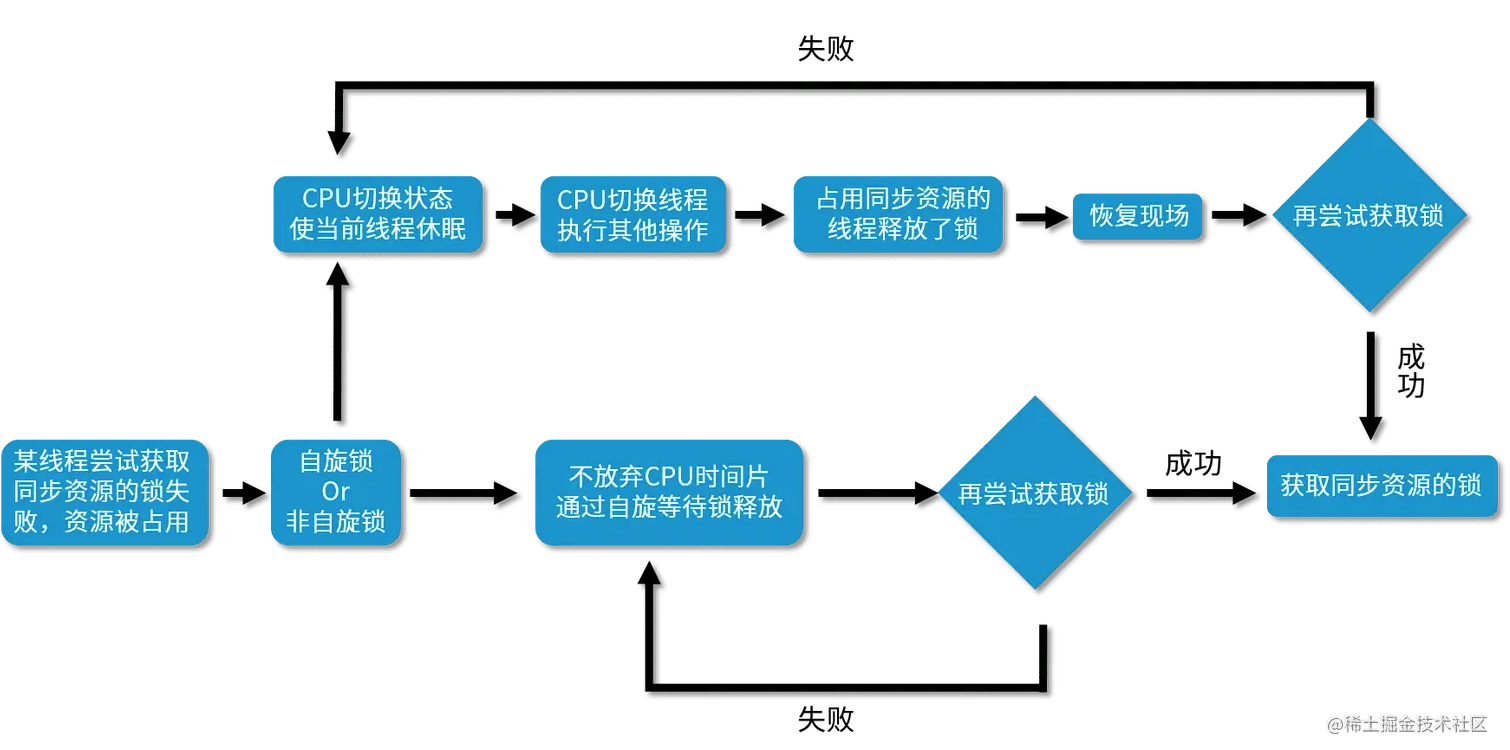

④、重量级锁,如果自旋超过一定的次数,或者一个线程持有锁,一个自旋,又有第三个线程进入 synchronized 加锁的代码时,轻量级锁就会升级为重量级锁。

此时,对象头的锁类型会更新为“10”,Mark Word 会存储指向 Monitor 对象的指针,其他等待锁的线程都会进入阻塞状态。

synchronized 做了哪些优化?

在 JDK 1.6 之前,synchronized 是直接调用 ObjectMonitor 的 enter 和 exit 指令实现的,这种锁也被称为重量级锁,性能较差。

随着 JDK 版本的更新,synchronized 的性能得到了极大的优化:

①、偏向锁:同一个线程可以多次获取同一把锁,无需重复加锁。

②、轻量级锁:当没有线程竞争时,通过 CAS 自旋等待锁,避免直接进入阻塞。

③、锁消除:JIT 可以在运行时进行代码分析,如果发现某些锁操作不可能被多个线程同时访问,就会对这些锁进行消除,从而减少上锁开销。

请详细说说锁升级的过程?

懵逼状态下的回答:锁升级会从无锁升级为偏向锁,再升级为轻量级锁,最后升级为重量级锁。

三分恶面渣逆袭:锁升级简略过程

知道一点,但不深入的回答:

三分恶面渣逆袭:synchronized 锁升级过程

①、偏向锁:当一个线程第一次获取锁时,JVM 会在对象头的 Mark Word 记录这个线程 ID,下次进入 synchronized 时,如果还是同一个线程,可以直接执行,无需额外加锁。

②、轻量级锁:当多个线程尝试获取锁但不是同一个时段,偏向锁会升级为轻量级锁,等待锁的线程通过 CAS 自旋避免进入阻塞状态。

③、重量级锁:如果自旋失败,锁会升级为重量级锁,等待锁的线程会进入阻塞状态,等待监视器 Monitor 进行调度。

详细解释一下:

①、从无锁到偏向锁:

当一个线程首次访问同步代码时,如果此对象处于无锁状态且偏向锁未被禁用,JVM 会将该对象头的锁标记改为偏向锁状态,并记录当前线程 ID。此时,对象头中的 Mark Word 中存储了持有偏向锁的线程 ID。

如果另一个线程尝试获取这个已被偏向的锁,JVM 会检查当前持有偏向锁的线程是否活跃。如果持有偏向锁的线程不活跃,可以将锁偏向给新的线程;否则撤销偏向锁,升级为轻量级锁。

②、偏向锁的轻量级锁:

进行偏向锁撤销时,会遍历堆栈的所有锁记录,暂停拥有偏向锁的线程,并检查锁对象。如果这个过程中发现有其他线程试图获取这个锁,JVM 会撤销偏向锁,并将锁升级为轻量级锁。

当有两个或以上线程竞争同一个偏向锁时,偏向锁模式不再有效,此时偏向锁会被撤销,对象的锁状态会升级为轻量级锁。

③、轻量级锁到重量级锁:

轻量级锁通过自旋来等待锁释放。如果自旋超过预定次数(自旋次数是可调的,并且是自适应的,失败次数多自旋次数就少),表明锁竞争激烈。

当自旋多次失败,或者有线程在等待队列中等待相同的轻量级锁时,轻量级锁会升级为重量级锁。在这种情况下,JVM 会在操作系统层面创建一个互斥锁——Mutex,所有进一步尝试获取该锁的线程将会被阻塞,直到锁被释放。

30.🌟synchronized 和 ReentrantLock 的区别了解吗?

两句话回答:synchronized 由 JVM 内部的 Monitor 机制实现,ReentrantLock基于 AQS 实现。

synchronized 可以自动加锁和解锁,ReentrantLock 需要手动 lock() 和 unlock()。

三分恶面渣逆袭:synchronized和ReentrantLock的区别

如果面试官还想知道更多,可以继续回答:

①、ReentrantLock 可以实现多路选择通知,绑定多个 Condition,而 synchronized 只能通过 wait 和 notify 唤醒,属于单路通知;

1 | ReentrantLock lock = new ReentrantLock(); |

②、synchronized 可以在方法和代码块上加锁,ReentrantLock 只能在代码块上加锁,但可以指定是公平锁还是非公平锁。

1 | // synchronized 修饰方法 |

③、ReentrantLock 提供了一种能够中断等待锁的线程机制,通过 lock.lockInterruptibly() 来实现。

1 | ReentrantLock lock = new ReentrantLock(); |

并发量大的情况下,使用 synchronized 还是 ReentrantLock?

我更倾向于 ReentrantLock,因为:

- ReentrantLock 提供了超时和公平锁等特性,可以应对更复杂的并发场景。

- ReentrantLock 允许更细粒度的锁控制,能有效减少锁竞争。

- ReentrantLock 支持条件变量 Condition,可以实现比 synchronized 更友好的线程间通信机制。

Lock 了解吗?

Lock 是 JUC 中的一个接口,最常用的实现类包括可重入锁 ReentrantLock、读写锁 ReentrantReadWriteLock 等。

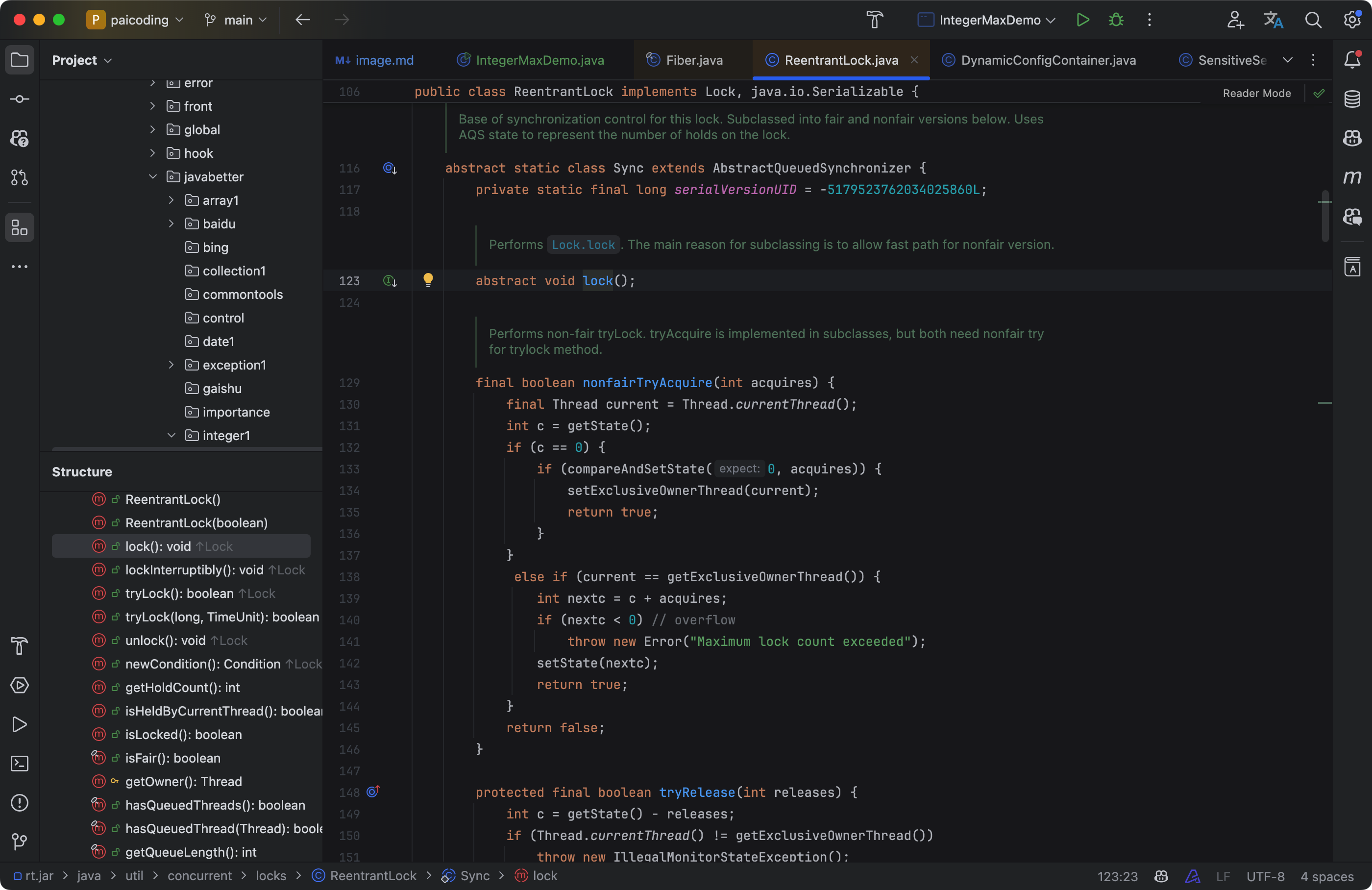

ReentrantLock 的 lock() 方法实现逻辑了解吗?

lock 方法的具体实现由 ReentrantLock 内部的 Sync 类来实现,涉及到线程的自旋、阻塞队列、CAS、AQS 等。

二哥的Java 进阶之路:Lock.lock() 方法源码

lock 方法会首先尝试通过 CAS 来获取锁。如果当前锁没有被持有,会将锁状态设置为 1,表示锁已被占用。否则,会将当前线程加入到 AQS 的等待队列中。

1 | final void lock() { |

32.🌟说说 ReentrantLock 的实现原理?

ReentrantLock 是基于 AQS 实现的 可重入排他锁,使用 CAS 尝试获取锁,失败的话,会进入 CLH 阻塞队列,支持公平锁、非公平锁,可以中断、超时等待。

三分恶面渣逆袭:ReentrantLock 非公平锁加锁流程简图

内部通过一个计数器 state 来跟踪锁的状态和持有次数。当线程调用 lock() 方法获取锁时,ReentrantLock 会检查 state 的值,如果为 0,通过 CAS 修改为 1,表示成功加锁。否则根据当前线程的公平性策略,加入到等待队列中。

线程首次获取锁时,state 值设为 1;如果同一个线程再次获取锁时,state 加 1;每释放一次锁,state 减 1。

当线程调用 unlock() 方法时,ReentrantLock 会将持有锁的 state 减 1,如果 state = 0,则释放锁,并唤醒等待队列中的线程来竞争锁。

使用方式非常简单:

1 | class CounterWithLock { |

new ReentrantLock() 默认创建的是非公平锁 NonfairSync。在非公平锁模式下,锁可能会授予刚刚请求它的线程,而不考虑等待时间。当切换到公平锁模式下,锁会授予等待时间最长的线程。

34.🌟CAS 了解多少?

CAS 是一种乐观锁,用于比较一个变量的当前值是否等于预期值,如果相等,则更新值,否则重试。

CAS 原子性:博客园的紫薇哥哥

在 CAS 中,有三个值:

- V:要更新的变量(var)

- E:预期值(expected)

- N:新值(new)

先判断 V 是否等于 E,如果等于,将 V 的值设置为 N;如果不等,说明已经有其它线程更新了 V,当前线程就放弃更新。

这个比较和替换的操作需要是原子的,不可中断的。Java 中的 CAS 是由 Unsafe 类实现的。

AtomicInteger 类的 compareAndSet 就是一个 CAS 方法:

1 | AtomicInteger atomicInteger = new AtomicInteger(0); |

它调用的是 Unsafe 的 compareAndSwapInt。

二哥的 Java 进阶之路:compareAndSwapInt

怎么保证 CAS 的原子性?

CPU 会发出一个 LOCK 指令进行总线锁定,阻止其他处理器对内存地址进行操作,直到当前指令执行完成。

1 | lock cmpxchg [esi], eax ; 比较 esi 地址中的值与 eax,如果相等则替换 |

总线锁定:博客园的紫薇哥哥

35.🌟CAS 有什么问题?

CAS 存在三个经典问题,ABA 问题、自旋开销大、只能操作一个变量等。

三分恶面渣逆袭:CAS三大问题

什么是 ABA 问题?

ABA 问题指的是,一个值原来是 A,后来被改为 B,再后来又被改回 A,这时 CAS 会误认为这个值没有发生变化。

1 | 线程 1:CAS(A → B),修改变量 A → B |

可以使用版本号/时间戳的方式来解决 ABA 问题。

比如说,每次变量更新时,不仅更新变量的值,还更新一个版本号。CAS 操作时,不仅比较变量的值,还比较版本号。

1 | class OptimisticLockExample { |

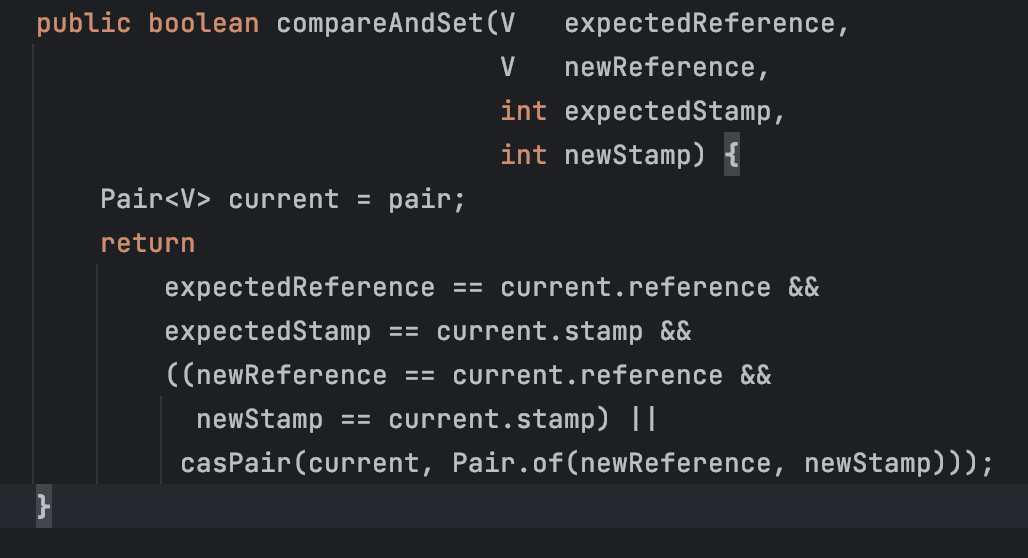

Java 的 AtomicStampedReference 就增加了版本号,它会同时检查引用值和 stamp 是否都相等。

二哥的 Java 进阶之路:AtomicStampedReference

使用示例:

1 | class ABAFix { |

自旋开销大怎么解决?

CAS 失败时会不断自旋重试,如果一直不成功,会给 CPU 带来非常大的执行开销。

可以加一个自旋次数的限制,超过一定次数,就切换到 synchronized 挂起线程。

1 | int MAX_RETRIES = 10; |

涉及到多个变量同时更新怎么办?

可以将多个变量封装为一个对象,使用 AtomicReference 进行 CAS 更新。

1 | class Account { |

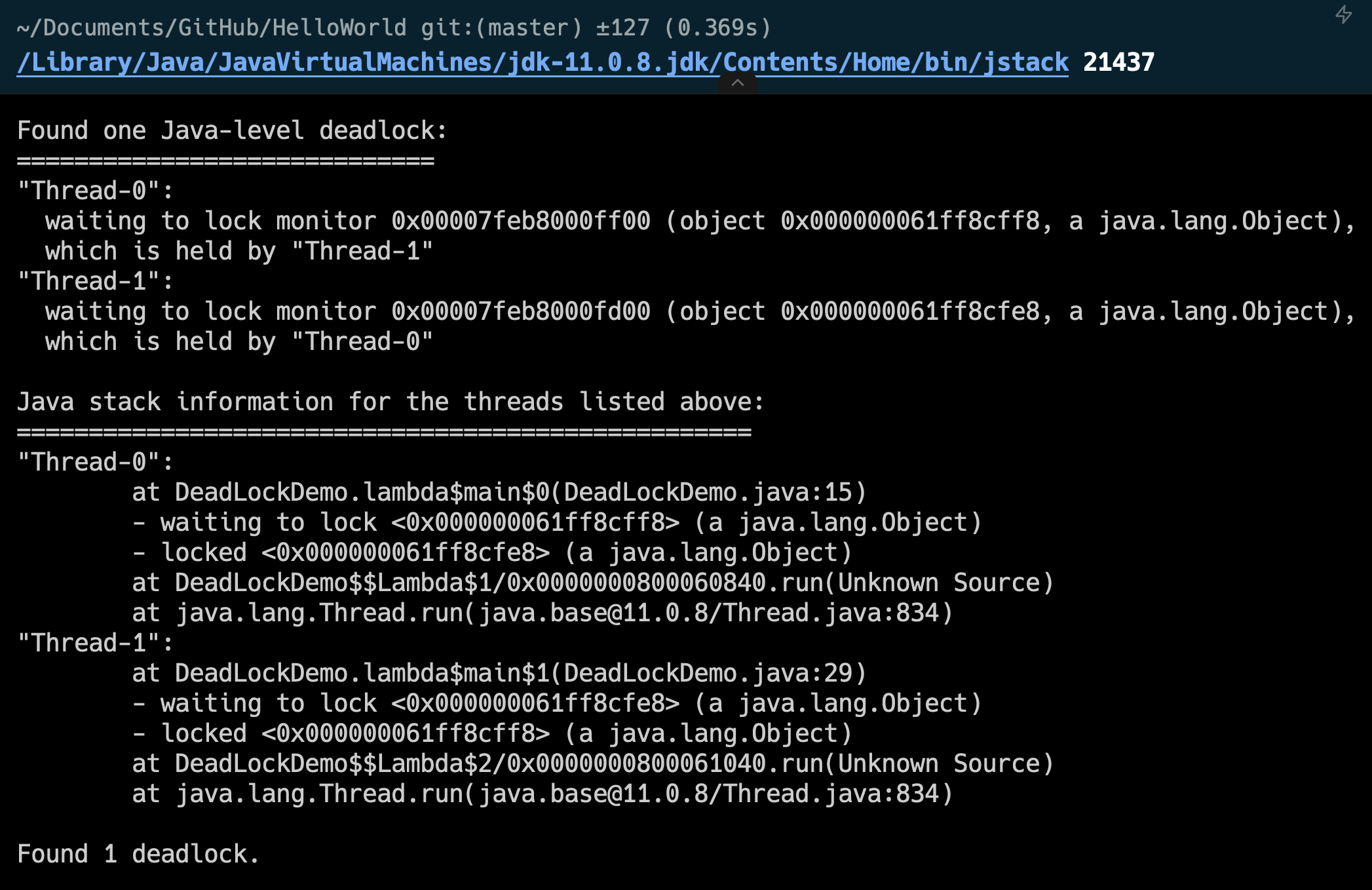

40.🌟死锁问题怎么排查呢?

首先从系统级别上排查,比如说在 Linux 生产环境中,可以先使用 top ps 等命令查看进程状态,看看是否有进程占用了过多的资源。

接着,使用 JDK 自带的一些性能监控工具进行排查,比如说 使用 jps -l 查看当前进程,然后使用 jstack 进程号 查看当前进程的线程堆栈信息,看看是否有线程在等待锁资源。

也可以使用一些可视化的性能监控工具,比如说 JConsole、VisualVM 等,查看线程的运行状态、锁的竞争情况等。

三分恶面渣逆袭:线程死锁检测

我们来通过实际代码说明一下:

1 | class DeadLockDemo { |

创建两个线程,每个线程都试图按照不同的顺序获取两个锁(lock1 和 lock2)。

锁的获取顺序不一致很容易导致死锁。运行这段代码,会发现两个线程都无法继续执行,进入了死锁状态。

二哥的 Java 进阶之路:死锁发生了

运行 jstack pid 命令,可以看到死锁的线程信息。

jstack pid 查看死锁信息

编码时,尽量使用 tryLock() 代替 lock(),tryLock() 可以设置超时时间,避免线程一直等待。

同时,尽量避免一个线程同时获取多个锁,如果需要多个锁,可以按照固定的顺序获取。

推荐阅读:

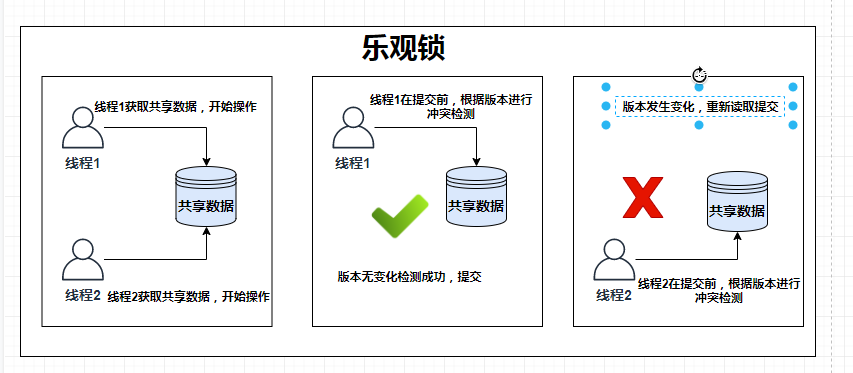

42.🌟聊聊悲观锁和乐观锁?(补充)

好的。

悲观锁认为每次访问共享资源时都会发生冲突,所在在操作前一定要先加锁,防止其他线程修改数据。

乐观锁认为冲突不会总是发生,所以在操作前不加锁,而是在更新数据时检查是否有其他线程修改了数据。如果发现数据被修改了,就会重试。

乐观锁发现有线程过来修改数据,怎么办?

可以重新读取数据,然后再尝试更新,直到成功为止或达到最大重试次数。

1 | 读取数据 -> 尝试更新 -> 成功(返回成功) |

写个代码演示一下:

1 | class CasRetryExample { |

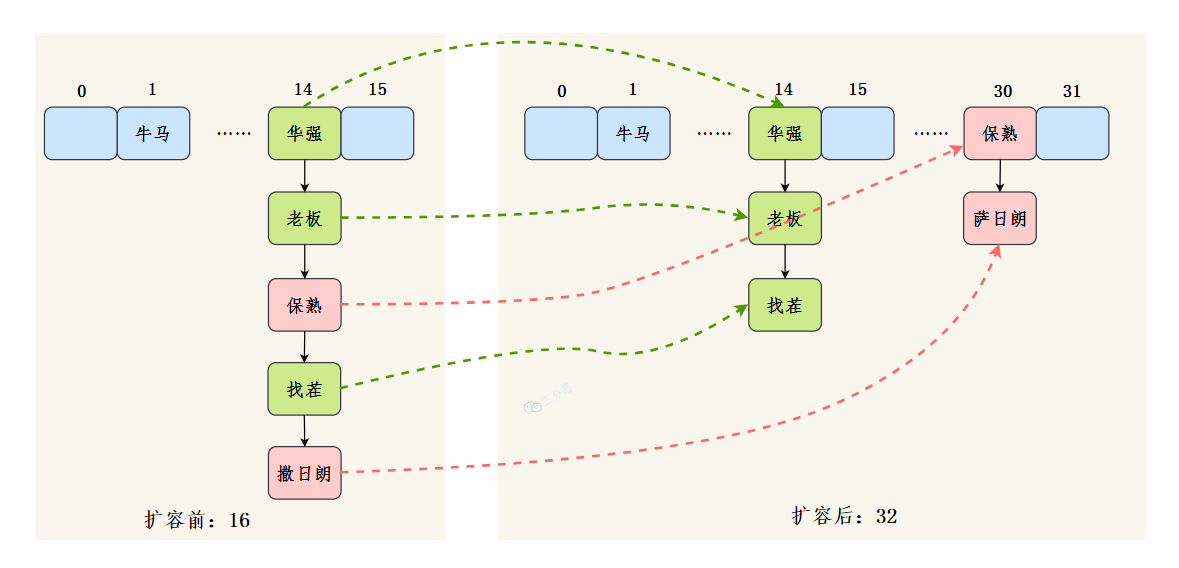

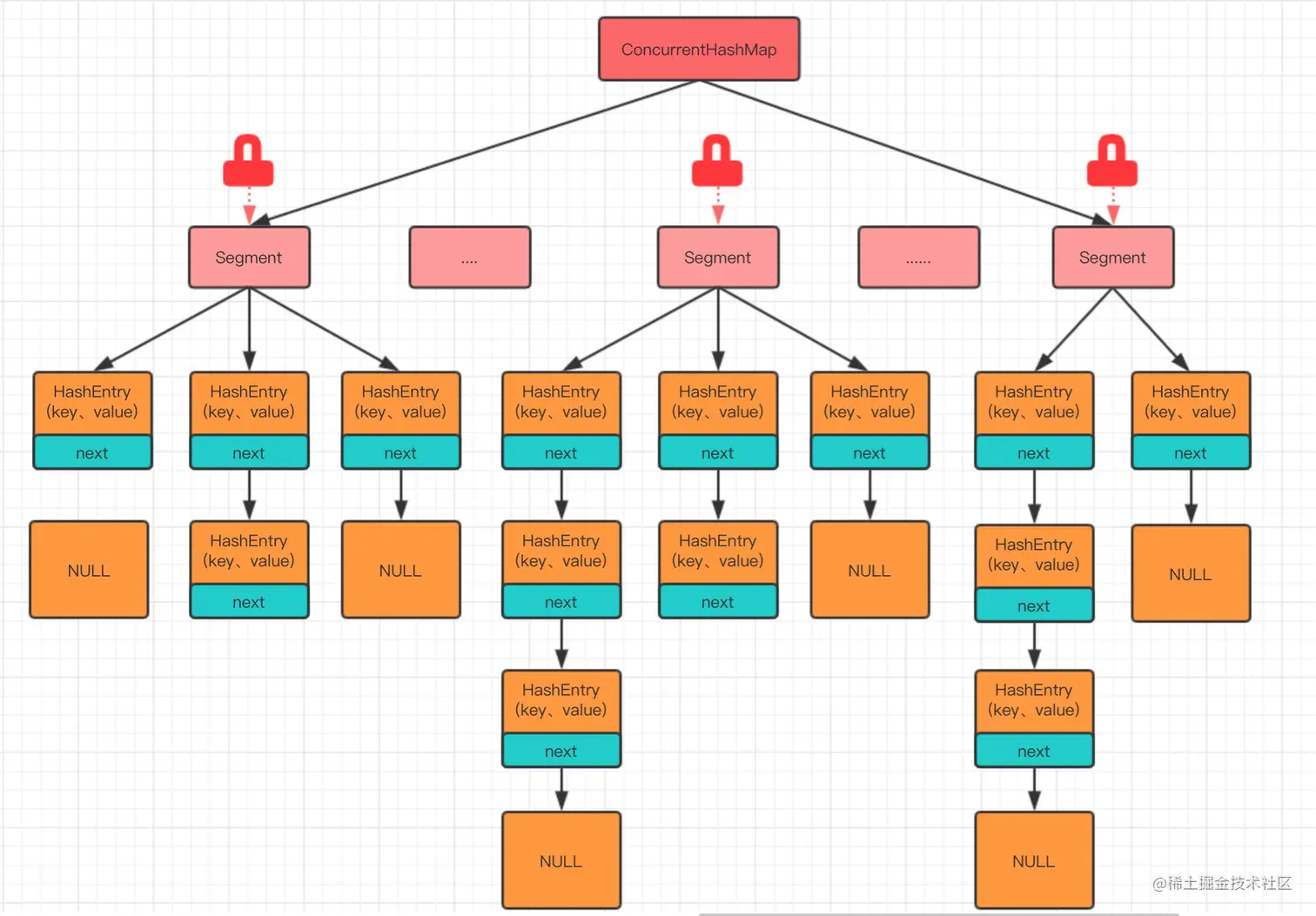

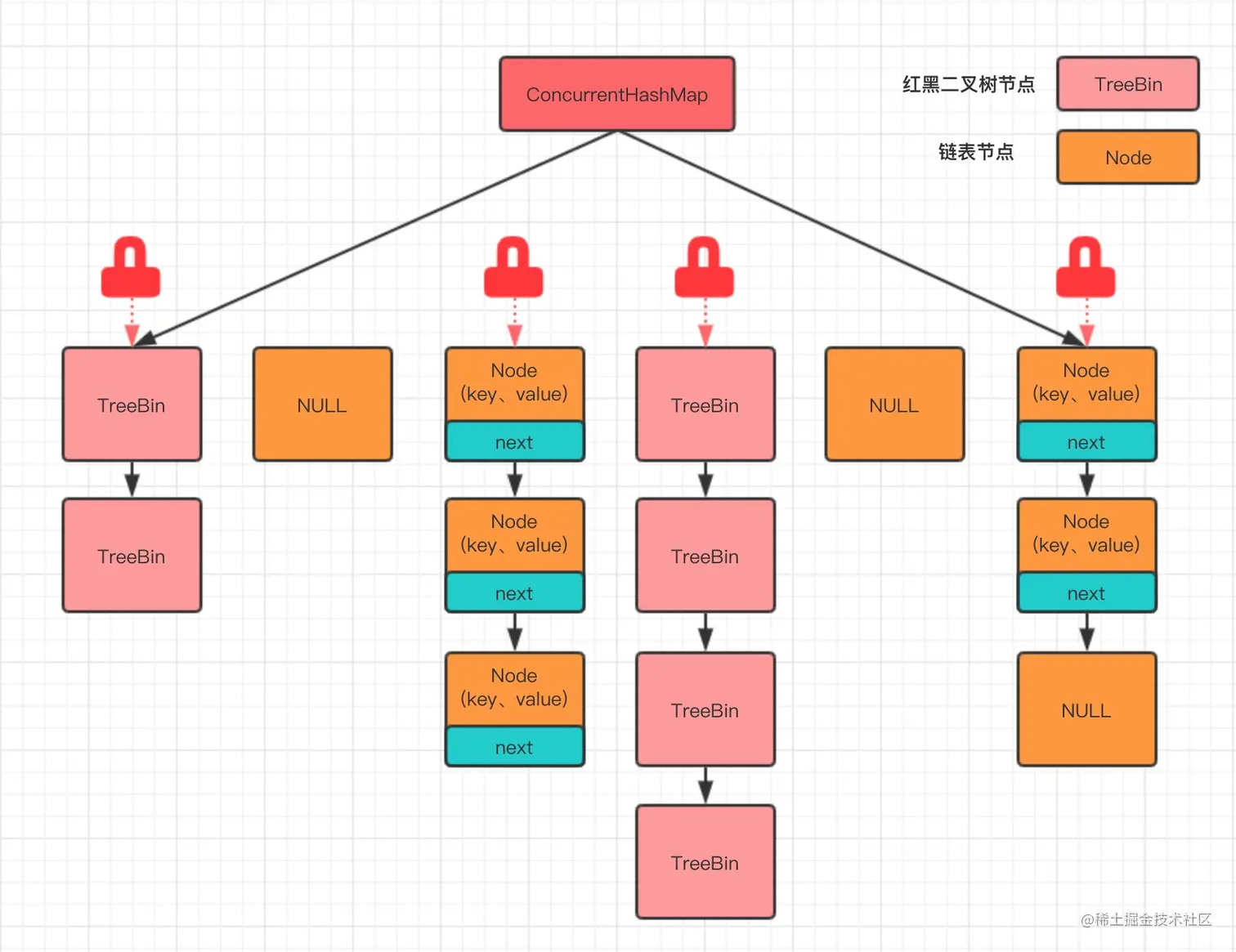

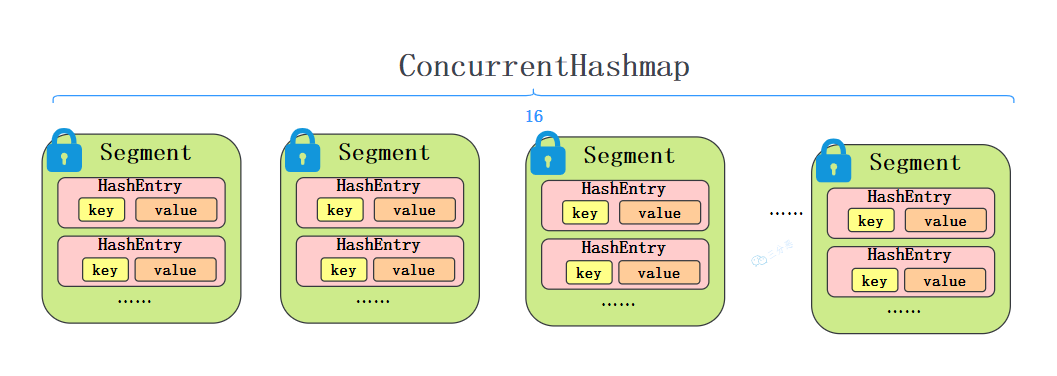

48.🌟能说一下 ConcurrentHashMap 的实现吗?(补充)

好的。ConcurrentHashMap 是 HashMap 的线程安全版本。

JDK 7 采用的是分段锁,整个 Map 会被分为若干段,每个段都可以独立加锁。不同的线程可以同时操作不同的段,从而实现并发。

初念初恋:JDK 7 ConcurrentHashMap

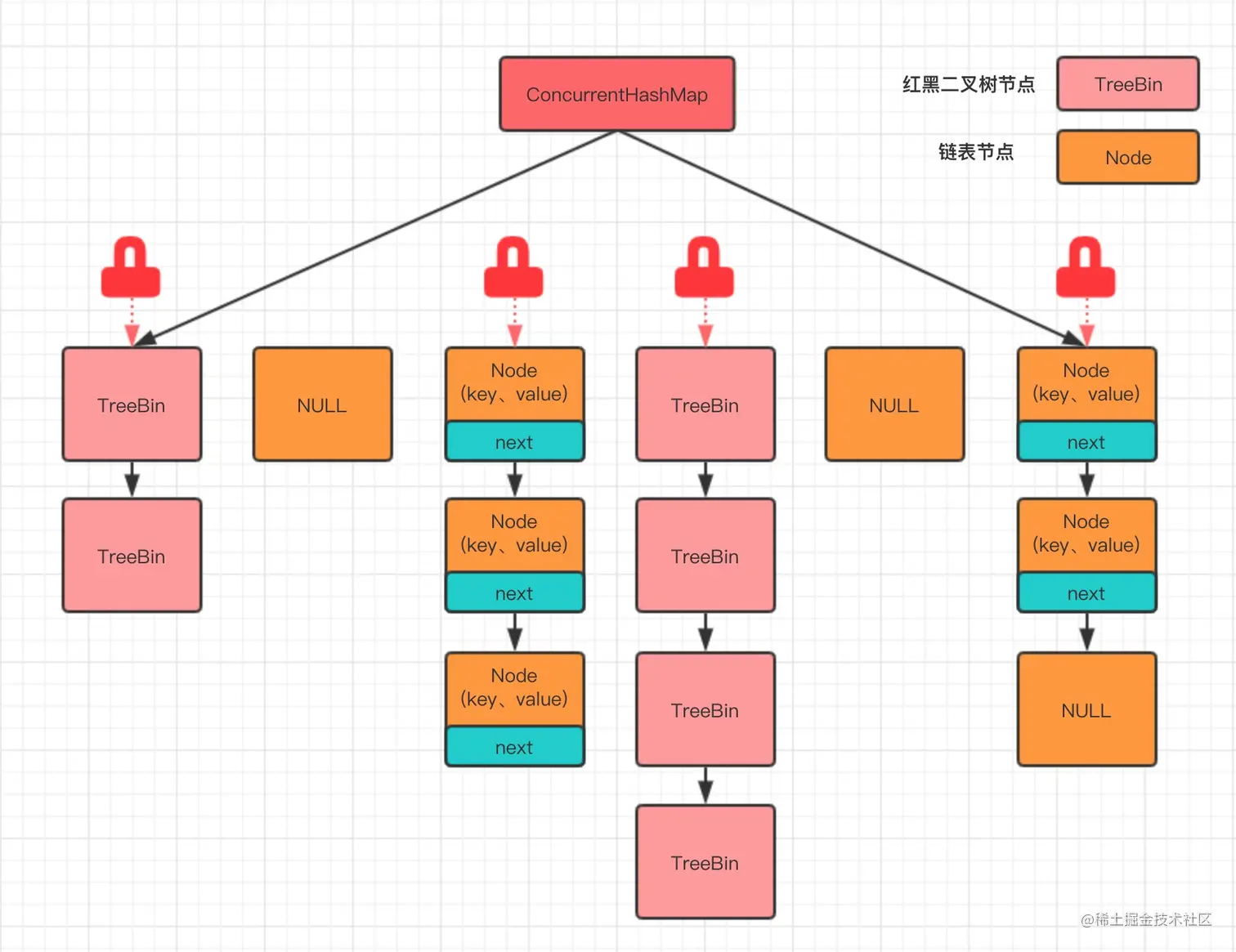

JDK 8 使用了一种更加细粒度的锁——桶锁,再配合 CAS + synchronized 代码块控制并发写入,以最大程度减少锁的竞争。

初念初恋:JDK 8 ConcurrentHashMap

对于读操作,ConcurrentHashMap 使用了 volatile 变量来保证内存可见性。

对于写操作,ConcurrentHashMap 优先使用 CAS 尝试插入,如果成功就直接返回;否则使用 synchronized 代码块进行加锁处理。

说一下 JDK 7 中 ConcurrentHashMap 的实现原理?

好的。

JDK 7 的 ConcurrentHashMap 采用的是分段锁,整个 Map 会被分为若干段,每个段都可以独立加锁,每个段类似一个 Hashtable。

三分恶面渣逆袭:ConcurrentHashMap示意图

每个段维护一个键值对数组 HashEntry<K, V>[] table,HashEntry 是一个单项链表。

1 | static final class HashEntry<K,V> { |

段继承了 ReentrantLock,所以每个段都是一个可重入锁,不同的线程可以同时操作不同的段,从而实现并发。

1 | static final class Segment<K,V> extends ReentrantLock { |

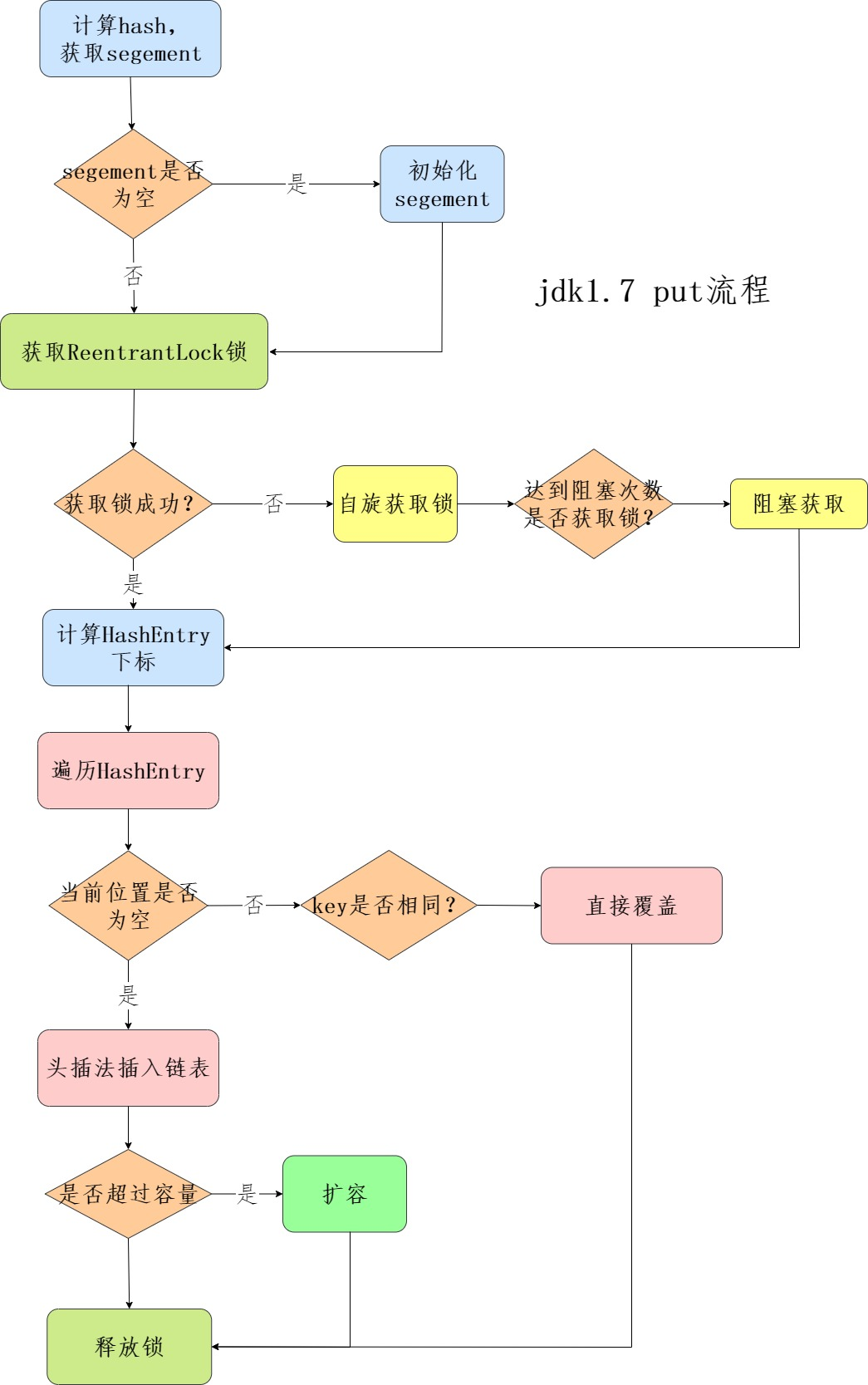

说一下 JDK 7 中 ConcurrentHashMap 的 put 流程?

put 流程和 HashMap 非常类似,只不过是先定位到具体的段,再通过 ReentrantLock 去操作而已。一共可以分为 4 个步骤:

第一步,计算 key 的 hash,定位到段,段如果是空就先初始化;

第二步,使用 ReentrantLock 进行加锁,如果加锁失败就自旋,自旋超过次数就阻塞,保证一定能获取到锁;

第三步,遍历段中的键值对 HashEntry,key 相同直接替换,key 不存在就插入。

第四步,释放锁。

三分恶面渣逆袭:JDK7 put 流程

说一下 JDK 7 中 ConcurrentHashMap 的 get 流程?

get 就更简单了,先计算 key 的 hash 找到段,再遍历段中的键值对,找到就直接返回 value。

get 不用加锁,因为是 value 是 volatile 的,所以线程读取 value 时不会出现可见性问题。

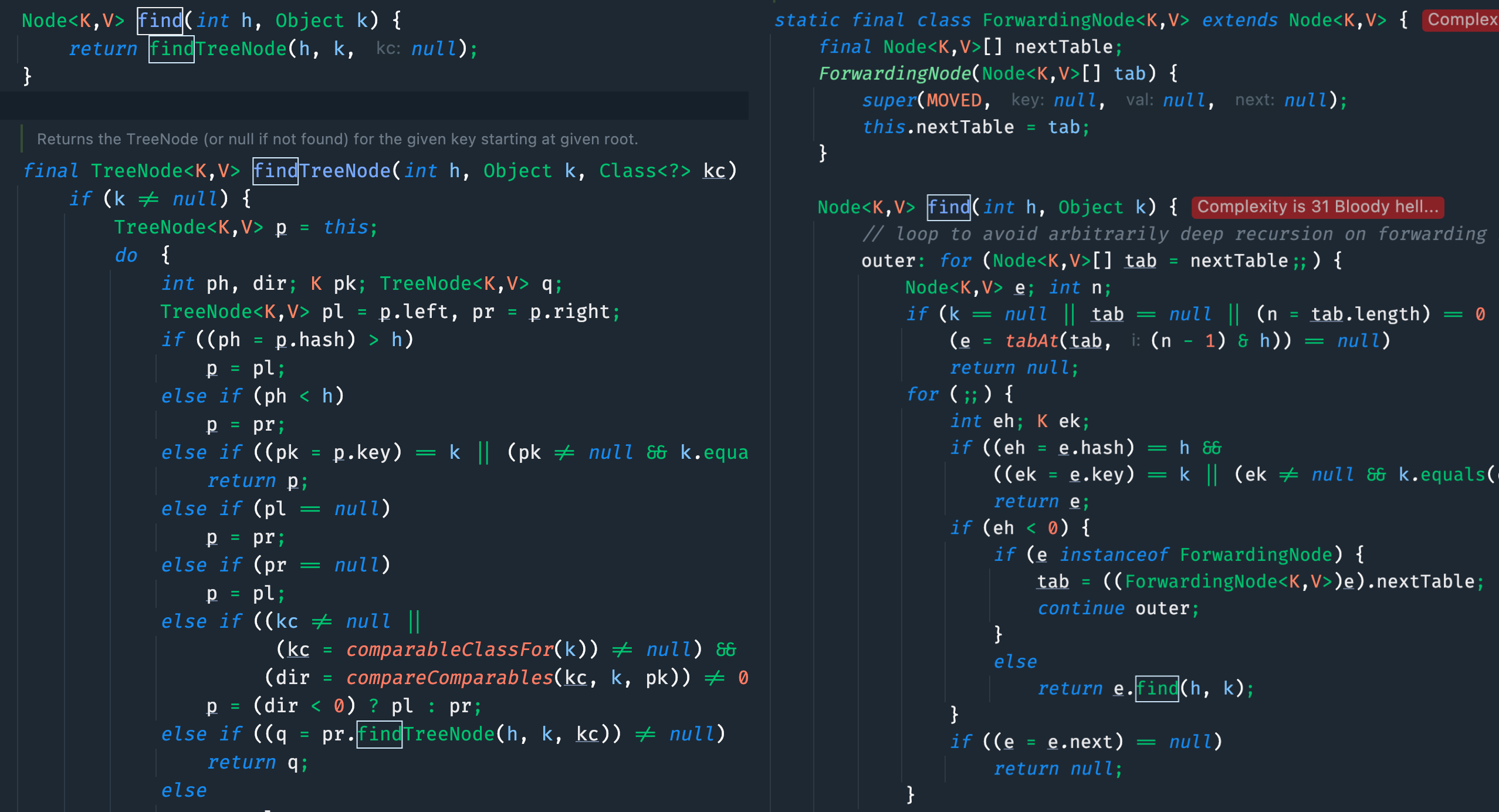

说一下 JDK 8 中 ConcurrentHashMap 的实现原理?

好的。

JDK 8 中的 ConcurrentHashMap 取消了分段锁,采用 CAS + synchronized 来实现更细粒度的桶锁,并且使用红黑树来优化链表以提高哈希冲突时的查询效率,性能比 JDK 7 有了很大的提升。

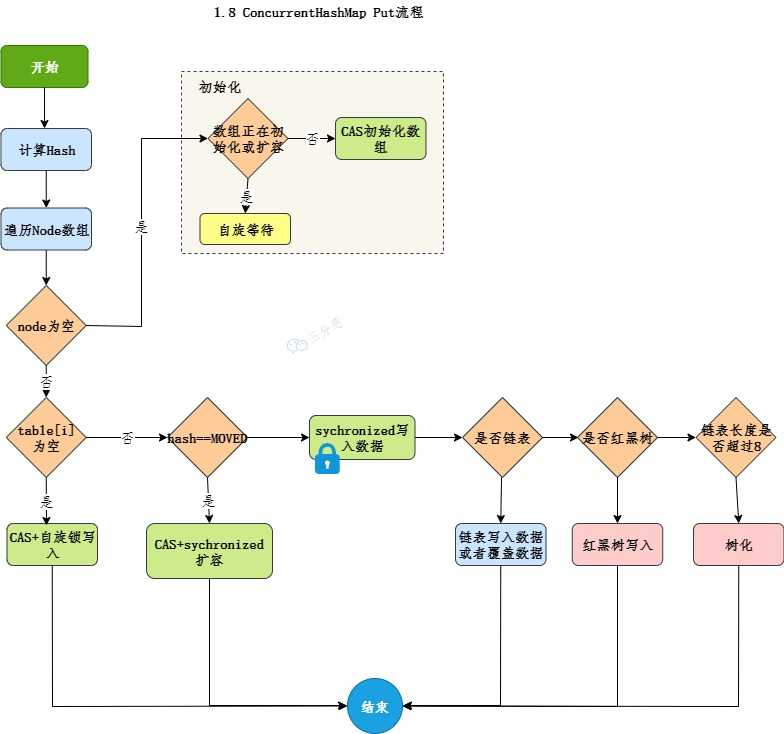

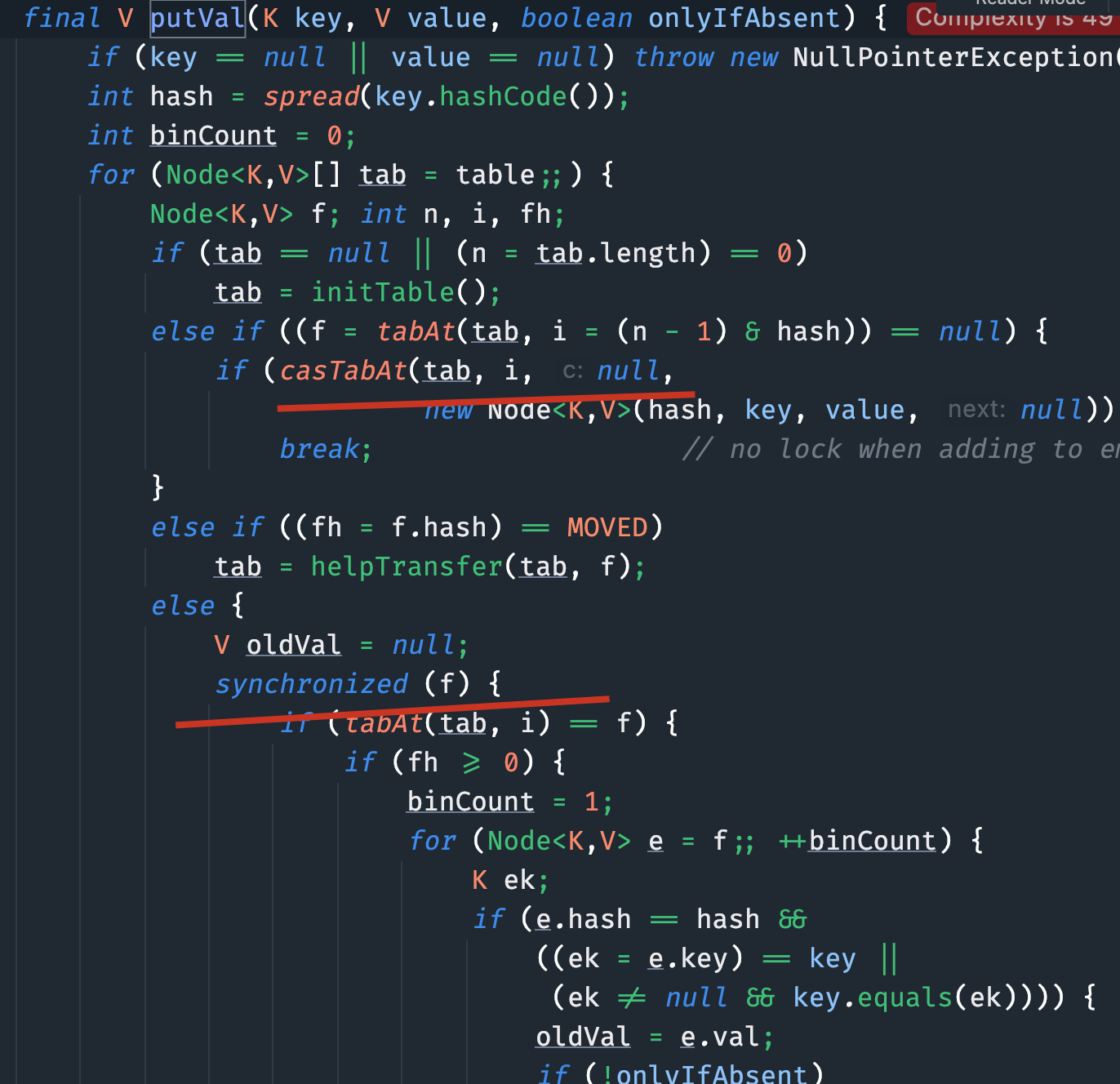

说一下 JDK 8 中 ConcurrentHashMap 的 put 流程?

三分恶面渣逆袭:Java 8 put 流程

第一步,计算 key 的 hash,以确定桶在数组中的位置。如果数组为空,采用 CAS 的方式初始化,以确保只有一个线程在初始化数组。

1 | // 计算 hash |

第二步,如果桶为空,直接 CAS 插入节点。如果 CAS 操作失败,会退化为 synchronized 代码块来插入节点。

1 | // CAS 插入节点 |

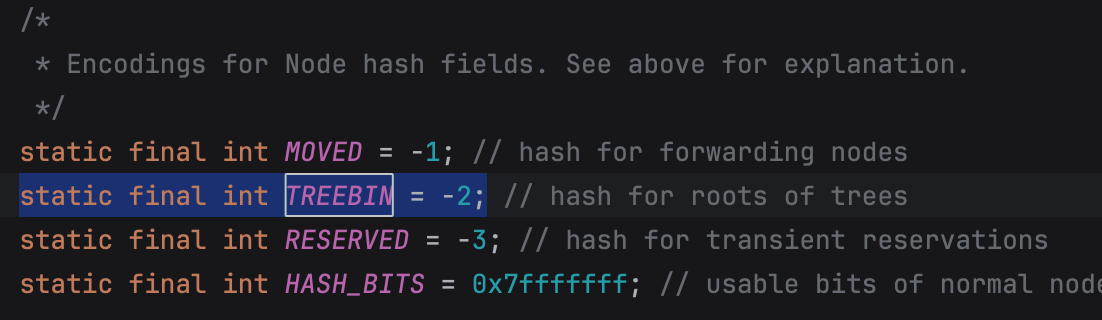

插入的过程中会判断桶的哈希是否小于 0(f.hash >= 0),小于 0 说明是红黑树,大于等于 0 说明是链表。

这里补充一点:在 ConcurrentHashMap 的实现中,红黑树节点 TreeBin 的 hash 值固定为 -2。

二哥的 Java 进阶之路:TreeBin 的哈希值固定为 -2

第三步,如果链表长度超过 8,转换为红黑树。

1 | if (binCount >= TREEIFY_THRESHOLD) |

第四步,在插入新节点后,会调用 addCount() 方法检查是否需要扩容。

1 | addCount(1L, binCount); |

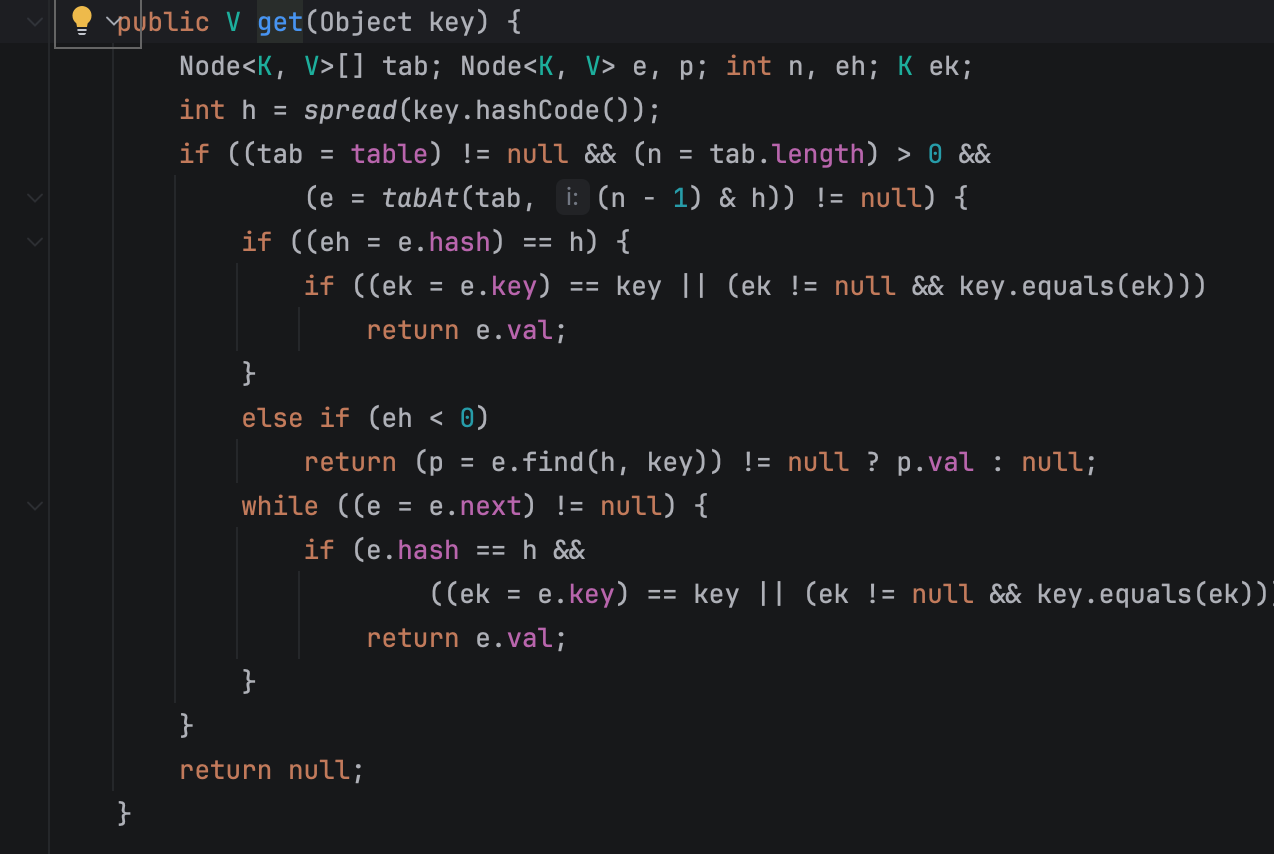

说一下 JDK 8 中 ConcurrentHashMap 的 get 流程?

get 也是通过 key 的 hash 进行定位,如果该位置节点的哈希匹配且键相等,则直接返回值。

二哥的 Java 进阶之路:HashMap 和 ConcurrentHashMap 的 get 方法

如果节点的哈希为负数,说明是个特殊节点,比如说如树节点或者正在迁移的节点,就调用find方法查找。

二哥的 Java 进阶之路:ForwardingNode和TreeNode的 find 方法

否则遍历链表查找匹配的键。如果都没找到,返回 null。

说一下 HashMap 和 ConcurrentHashMap 的区别?

HashMap 是非线程安全的,多线程环境下应该使用 ConcurrentHashMap。

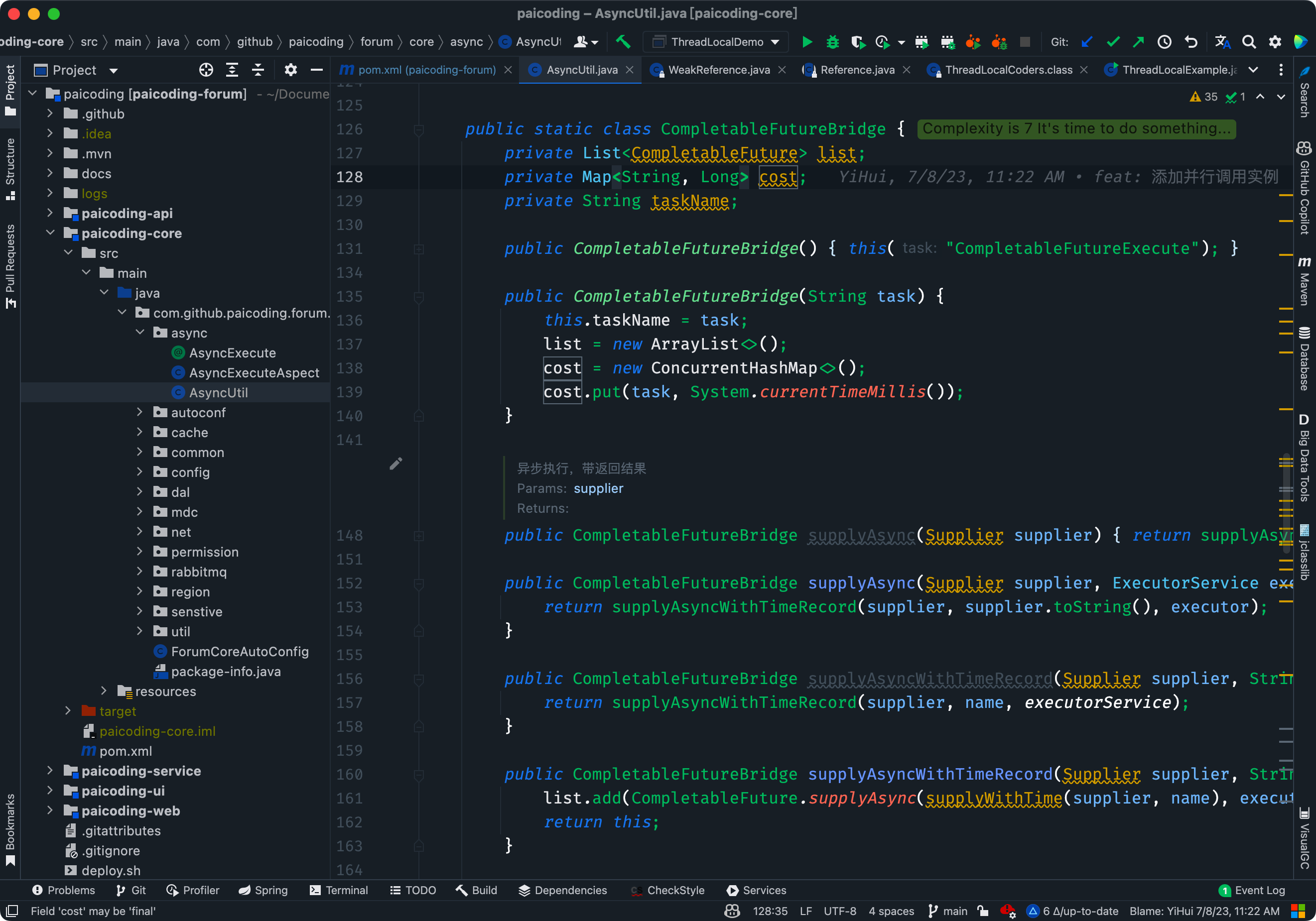

你项目中怎么使用 ConcurrentHashMap 的?

在技术派实战项目中,很多地方都用到了 ConcurrentHashMap,比如说在异步工具类 AsyncUtil 中,就使用了 ConcurrentHashMap 来存储任务的名称和它们的运行时间,以便观察和分析任务的执行情况。

二哥的 Java 进阶之路:技术派的源码封装 ConcurrentHashMap

说一下 ConcurrentHashMap 对 HashMap 的改进?

首先是 hash 的计算方法上,ConcurrentHashMap 的 spread 方法接收一个已经计算好的 hashCode,然后将这个哈希码的高 16 位与自身进行异或运算。

1 | static final int spread(int h) { |

比 HashMap 的 hash 计算多了一个 & HASH_BITS 的操作。这里的 HASH_BITS 是一个常数,值为 0x7fffffff,它确保结果是一个非负整数。

1 | static final int hash(Object key) { |

另外,ConcurrentHashMap 对节点 Node 做了进一步的封装,比如说用 Forwarding Node 来表示正在进行扩容的节点。

1 | static final class ForwardingNode<K,V> extends Node<K,V> { |

最后就是 put 方法,通过 CAS + synchronized 代码块来进行并发写入。

二哥的 Java 进阶之路:ConcurrentHashMap 的源码

为什么 ConcurrentHashMap 在 JDK 1.7 中要用 ReentrantLock,而在 JDK 1.8 要用 synchronized

JDK 1.7 中的 ConcurrentHashMap 使用了分段锁机制,每个 Segment 都继承了 ReentrantLock,这样可以保证每个 Segment 都可以独立地加锁。

而在 JDK 1.8 中,ConcurrentHashMap 取消了 Segment 分段锁,采用了更加精细化的锁——桶锁,以及 CAS 无锁算法,每个桶都可以独立地加锁,只有在 CAS 失败时才会使用 synchronized 代码块加锁,这样可以减少锁的竞争,提高并发性能。

53.🌟什么是线程池?

线程池是用来管理和复用线程的工具,它可以减少线程的创建和销毁开销。

三分恶面渣逆袭:管理线程的池子

在 Java 中,ThreadPoolExecutor 是线程池的核心实现,它通过核心线程数、最大线程数、任务队列和拒绝策略来控制线程的创建和执行。

举个例子:就像你开了一家餐厅,线程池就相当于固定数量的服务员,顾客(任务)来了就安排空闲的服务员(线程)处理,避免了频繁招人和解雇的成本。

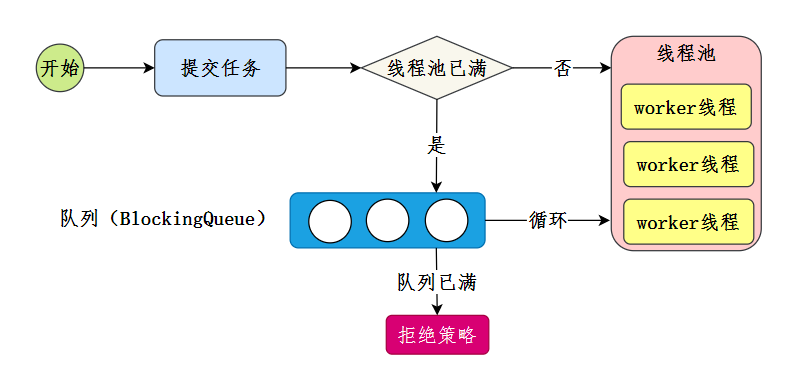

55.🌟说一下线程池的工作流程?

可以简单总结为:

任务提交 → 核心线程执行 → 任务队列缓存 → 非核心线程执行 → 拒绝策略处理。

第一步,线程池通过 submit() 提交任务。

1 | ExecutorService threadPool = Executors.newFixedThreadPool(5); |

第二步,线程池会先创建核心线程来执行任务。

1 | if (workerCountOf(c) < corePoolSize) { |

第三步,如果核心线程都在忙,任务会被放入任务队列中。

1 | workQueue.offer(task); |

第四步,如果任务队列已满,且当前线程数量小于最大线程数,线程池会创建新的线程来处理任务。

1 | if (!addWorker(command, false)) |

第五步,如果线程池中的线程数量已经达到最大线程数,且任务队列已满,线程池会执行拒绝策略。

1 | handler.rejectedExecution(command, this); |

另外一版回答。

第一步,创建线程池。

第二步,调用线程池的 execute()方法,准备执行任务。

- 如果正在运行的线程数量小于 corePoolSize,那么线程池会创建一个新的线程来执行这个任务;

- 如果正在运行的线程数量大于或等于 corePoolSize,那么线程池会将这个任务放入等待队列;

- 如果等待队列满了,而且正在运行的线程数量小于 maximumPoolSize,那么线程池会创建新的线程来执行这个任务;

- 如果等待队列满了,而且正在运行的线程数量大于或等于 maximumPoolSize,那么线程池会执行拒绝策略。

三分恶面渣逆袭:线程池执行流程

第三步,线程执行完毕后,线程并不会立即销毁,而是继续保持在池中等待下一个任务。

第四步,当线程空闲时间超出指定时间,且当前线程数量大于核心线程数时,线程会被回收。

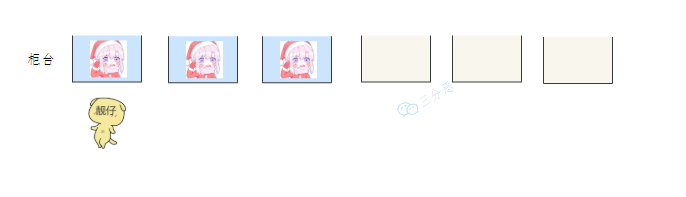

能用一个生活中的例子说明下吗?

可以。有个名叫“你一定暴富”的银行,该银行有 6 个窗口,现在开放了 3 个窗口,坐着 3 个小姐姐在办理业务。

靓仔小二去办理业务,会遇到什么情况呢?

第一情况,小二发现有个空闲的小姐姐,正在翘首以盼,于是小二就快马加鞭跑过去办理了。

三分恶面渣逆袭:直接办理

第二种情况,小姐姐们都在忙,接待员小美招呼小二去排队区区取号排队,让小二稍安勿躁。

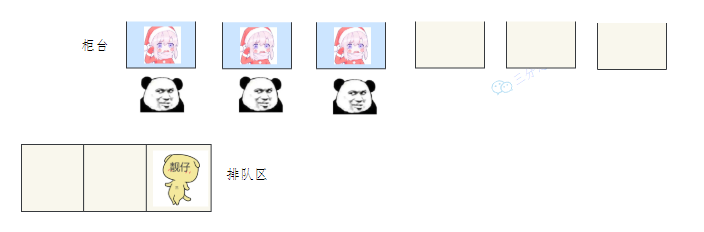

三分恶面渣逆袭:排队等待

第三种情况,不仅小姐姐们都在忙,排队区也满了,小二着急用钱,于是脾气就上来了,和接待员小美对线了起来,要求开放另外 3 个空闲的窗口。

小美迫于小二的压力,开放了另外 3 个窗口,排队区的人立马就冲了过去。

三分恶面渣逆袭:排队区满

第四种情况,6 个窗口的小姐姐都在忙,排队区也满了。。。

三分恶面渣逆袭:等待区,排队区都满

接待员小美给了小二 4 个选项:

- 对不起,我们暴富银行系统瘫痪了。

- 没看忙着呢,谁叫你来办的你找谁去!

- 靓仔,看你比较急,去队里偷偷加个塞。

- 不好意思,今天没办法,你改天再来吧。

这个流程和线程池不能说一模一样,简直就是一模一样:

- corePoolSize 对应营业窗口数 3

- maximumPoolSize 对应最大窗口数 6

- workQueue 对应排队区

- handler 对应接待员小美

1 | class ThreadPoolDemo { |

56.🌟线程池的主要参数有哪些?

线程池有 7 个参数,需要重点关注的有核心线程数、最大线程数、等待队列、拒绝策略。

三分恶面渣逆袭:线程池参数

①、corePoolSize:核心线程数,长期存活,执行任务的主力。

②、maximumPoolSize:线程池允许的最大线程数。

③、workQueue:任务队列,存储等待执行的任务。

④、handler:拒绝策略,任务超载时的处理方式。也就是线程数达到 maximumPoolSiz,任务队列也满了的时候,就会触发拒绝策略。

⑤、threadFactory:线程工厂,用于创建线程,可自定义线程名。

⑥、keepAliveTime:非核心线程的存活时间,空闲时间超过该值就销毁。

⑦、unit:keepAliveTime 参数的时间单位:

- TimeUnit.DAYS; 天

- TimeUnit.HOURS; 小时

- TimeUnit.MINUTES; 分钟

- TimeUnit.SECONDS; 秒

- TimeUnit.MILLISECONDS; 毫秒

- TimeUnit.MICROSECONDS; 微秒

- TimeUnit.NANOSECONDS; 纳秒

能简单说一下参数之间的关系吗?

一句话:任务优先使用核心线程执行,满了进入等待队列,队列满了启用非核心线程备用,线程池达到最大线程数量后触发拒绝策略,非核心线程的空闲时间超过存活时间就被回收。

核心线程数不够会怎么进行处理?

当提交的任务数超过了 corePoolSize,但是小于 maximumPoolSize 时,线程池会创建新的线程来处理任务。

当提交的任务数超过了 maximumPoolSize 时,线程池会根据拒绝策略来处理任务。

举个例子说一下这些参数的变化?

假设一个场景,线程池的配置如下:

1 | corePoolSize = 5 |

场景一:当系统启动后,有 10 个任务提交到线程池。

- 前 5 个任务会立即执行,因为核心线程数足够容纳它们。

- 随后的 5 个任务会被放入等待队列。

场景二:如果此时再有 100 个任务提交到线程池。

- 工作队列已满,线程池会创建额外的线程来执行这些任务,直到线程总数达到 10。

- 如果任务继续增加,超过了工作队列+最大线程数的限制,新来的任务会被 AbortPolicy 拒绝,抛出 RejectedExecutionException 异常。

场景三:如果任务突然减少:

核心线程会一直运行,而超出核心线程数的线程,会在 60 秒后回收。

57.🌟线程池的拒绝策略有哪些?

有四种:

- AbortPolicy:默认的拒绝策略,会抛 RejectedExecutionException 异常。

- CallerRunsPolicy:让提交任务的线程自己来执行这个任务,也就是调用 execute 方法的线程。

- DiscardOldestPolicy:等待队列会丢弃队列中最老的一个任务,也就是队列中等待最久的任务,然后尝试重新提交被拒绝的任务。

- DiscardPolicy:丢弃被拒绝的任务,不做任何处理也不抛出异常。

三分恶面渣逆袭:四种策略

分别对应着小二去银行办理业务被经理“薄纱”的四个场景:“我们系统瘫痪了”、“谁叫你来办的你找谁去”、“看你比较急,去队里加个塞”、“今天没办法,不行你看改一天”。

当线程池无法接受新的任务时,也就是线程数达到 maximumPoolSize,任务队列也满了的时候,就会触发拒绝策略。

如果默认策略不能满足需求,可以通过实现 RejectedExecutionHandler 接口来定义自己的淘汰策略。例如:记录被拒绝任务的日志。

1 | class CustomRejectedHandler { |

67.🌟线程池调优了解吗?(补充)

三分恶面渣逆袭:线程池调优

首先我会根据任务类型设置核心线程数参数,比如 IO 密集型任务会设置为 CPU 核心数*2 的经验值。

其次我会结合线程池动态调整的能力,在流量波动时通过 setCorePoolSize 平滑扩容,或者直接使用 DynamicTp 实现线程池参数的自动化调整。

最后,我会通过内置的监控指标建立容量预警机制。比如通过 JMX 监控线程池的运行状态,设置阈值,当线程池的任务队列长度超过阈值时,触发告警。

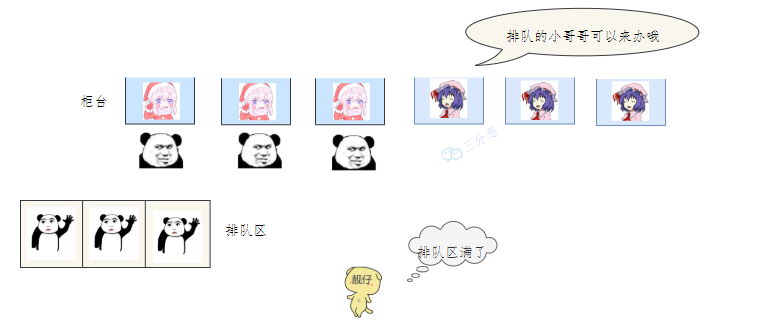

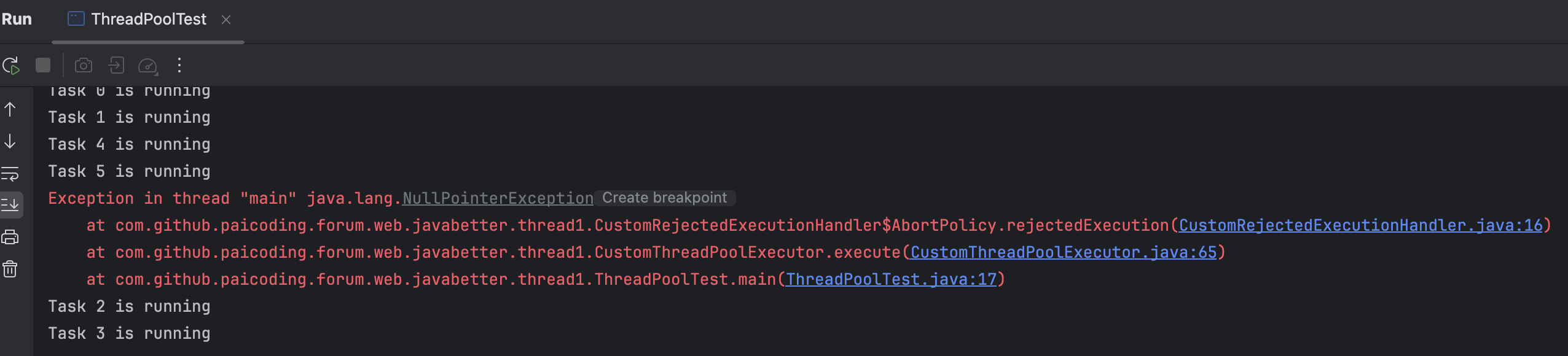

69.🌟你能设计实现一个线程池吗?

推荐阅读:三分恶线程池原理

线程池的主要目的是为了避免频繁地创建和销毁线程。

三分恶面渣逆袭:线程池主要实现流程

我会把线程池看作一个工厂,里面有一群“工人”,也就是线程了,专门用来做任务。

当任务来了,需要先判断有没有空闲的工人,如果有就把任务交给他们;如果没有,就把任务暂存到一个任务队列里,等工人忙完了再去处理。

如果队列满了,还没有空闲的工人,就要考虑扩容,让预备的工人过来干活,但不能超过预定的最大值,防止工厂被挤爆。

如果连扩容也没法解决,就需要一个拒绝策略,可能直接拒绝任务或者报个错。

核心线程池类(可参考):

1 | class CustomThreadPoolExecutor { |

拒绝策略:

1 | /** |

使用示例:

1 | class ThreadPoolTest { |

执行结果:

二哥的 Java 进阶之路:自定义线程池

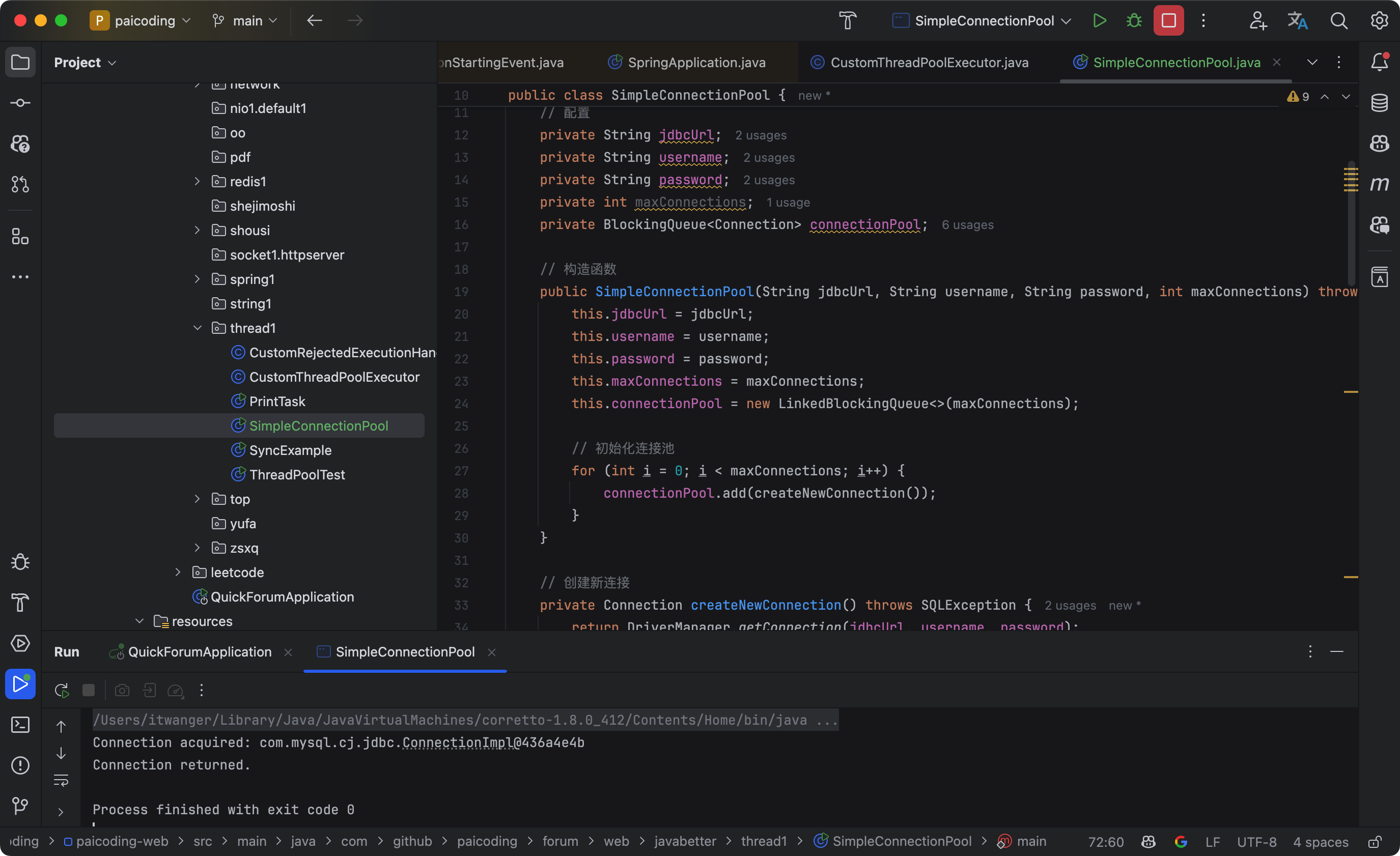

手写一个数据库连接池,可以吗?

可以的,我的思路是这样的:数据库连接池主要是为了避免每次操作数据库时都去创建连接,因为那样很浪费资源。所以我打算在初始化时预先创建好固定数量的连接,然后把它们放到一个线程安全的容器里,后续有请求的时候就从队列里拿,使用完后再归还到队列中。

1 | class SimpleConnectionPool { |

运行结果:

二哥的Java 进阶之路:数据库连接池

JVM

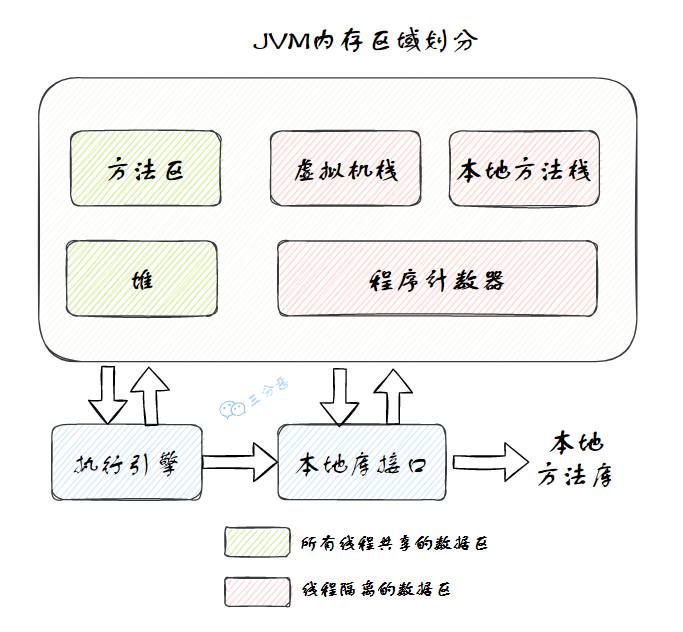

3.🌟能说一下 JVM 的内存区域吗?

推荐阅读:深入理解 JVM 的运行时数据区

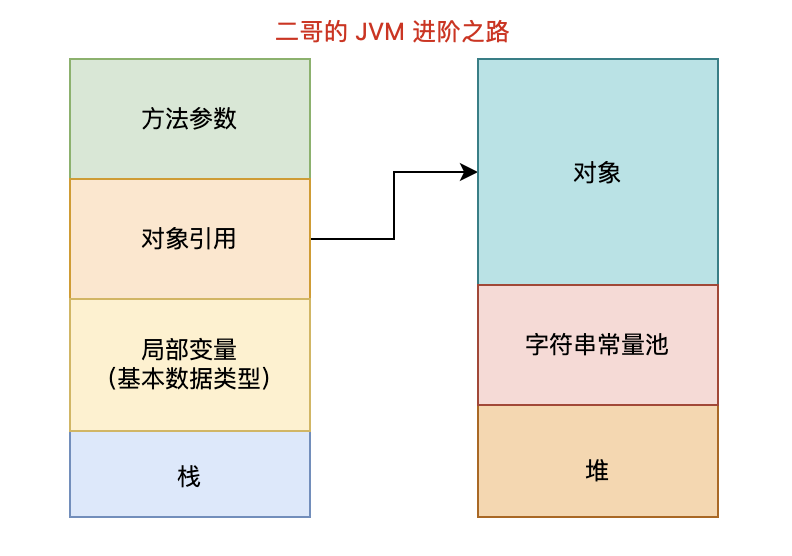

按照 Java 虚拟机规范,JVM 的内存区域可以细分为程序计数器、虚拟机栈、本地方法栈、堆和方法区。

三分恶面渣逆袭:Java虚拟机运行时数据区

其中方法区和堆是线程共享的,虚拟机栈、本地方法栈和程序计数器是线程私有的。

介绍一下程序计数器?

程序计数器也被称为 PC 寄存器,是一块较小的内存空间。它可以看作是当前线程所执行的字节码行号指示器。

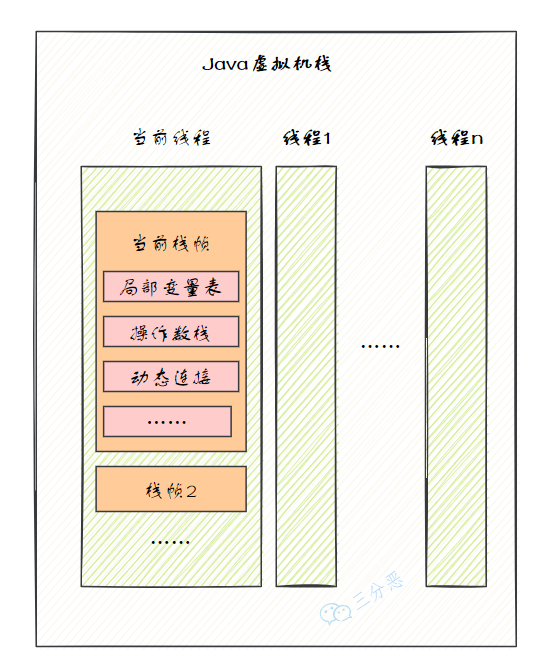

介绍一下 Java 虚拟机栈?

Java 虚拟机栈的生命周期与线程相同。

当线程执行一个方法时,会创建一个对应的栈帧,用于存储局部变量表、操作数栈、动态链接、方法出口等信息,然后栈帧会被压入虚拟机栈中。当方法执行完毕后,栈帧会从虚拟机栈中移除。

三分恶面渣逆袭:Java虚拟机栈

一个什么都没有的空方法,空的参数都没有,那局部变量表里有没有变量?

对于静态方法,由于不需要访问实例对象 this,因此在局部变量表中不会有任何变量。

对于非静态方法,即使是一个完全空的方法,局部变量表中也会有一个用于存储 this 引用的变量。this 引用指向当前实例对象,在方法调用时被隐式传入。

详细解释一下:

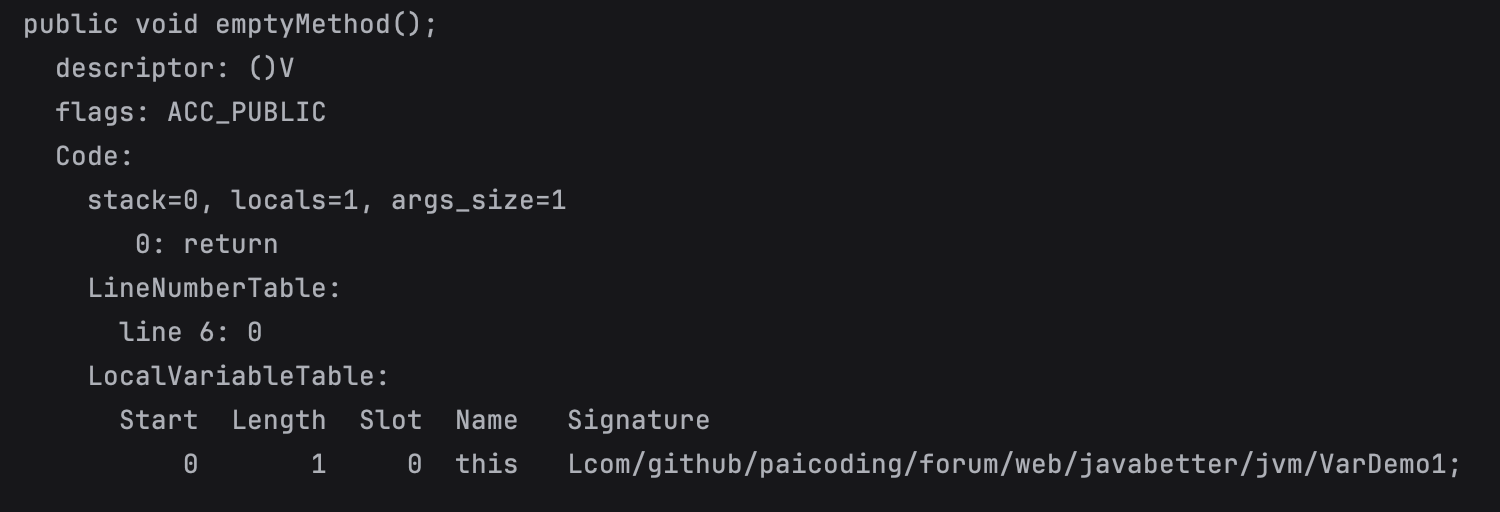

比如说有这样一段代码:

1 | public class VarDemo1 { |

用 javap -v VarDemo1 命令查看编译后的字节码,就可以在 emptyMethod 中看到这样的内容:

二哥的 Java 进阶之路:javap emptyMethod

这里的 locals=1 表示局部变量表有一个变量,即 this,Slot 0 位置存储了 this 引用。

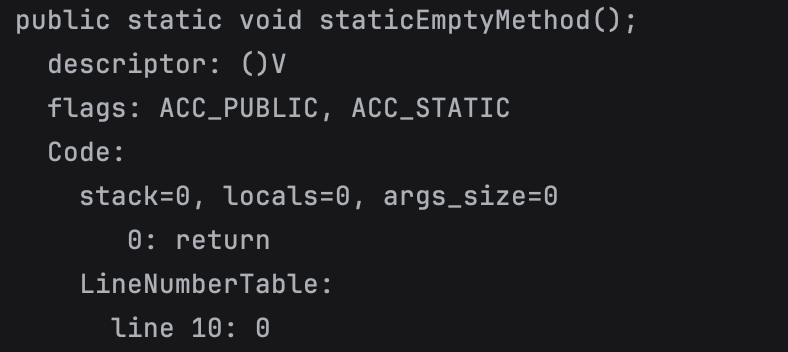

而在静态方法 staticEmptyMethod 中,你会看到这样的内容:

二哥的 Java 进阶之路:javap staticEmptyMethod

这里的 locals=0 表示局部变量表为空,因为静态方法属于类级别方法,不需要 this 引用,也就没有局部变量。

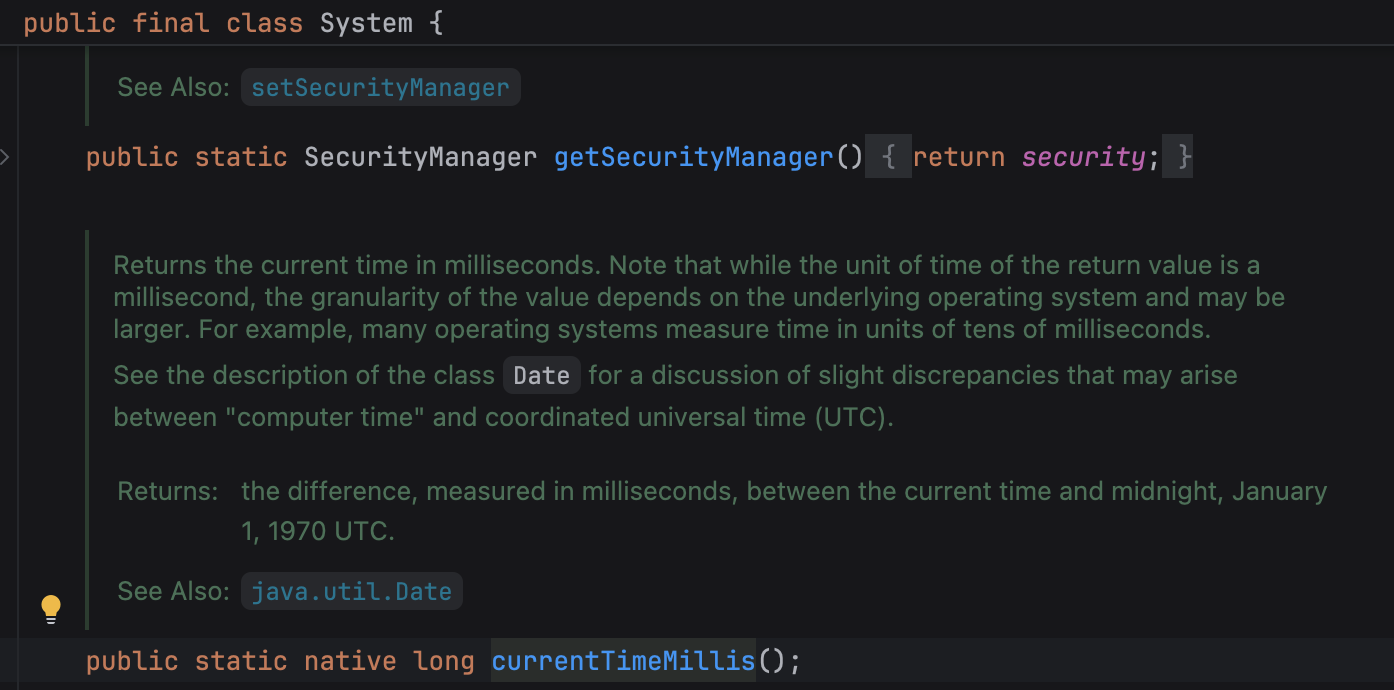

介绍一下本地方法栈?

本地方法栈与虚拟机栈相似,区别在于虚拟机栈是为 JVM 执行 Java 编写的方法服务的,而本地方法栈是为 Java 调用本地 native 方法服务的,通常由 C/C++ 编写。

在本地方法栈中,主要存放了 native 方法的局部变量、动态链接和方法出口等信息。当一个 Java 程序调用一个 native 方法时,JVM 会切换到本地方法栈来执行这个方法。

介绍一下本地方法栈的运行场景?

当 Java 应用需要与操作系统底层或硬件交互时,通常会用到本地方法栈。

比如调用操作系统的特定功能,如内存管理、文件操作、系统时间、系统调用等。

详细说明一下:

比如说获取系统时间的 System.currentTimeMillis() 方法就是调用本地方法,来获取操作系统当前时间的。

二哥的Java 进阶之路:currentTimeMillis方法源码

再比如 JVM 自身的一些底层功能也需要通过本地方法来实现。像 Object 类中的 hashCode() 方法、clone() 方法等。

二哥的Java 进阶之路:hashCode方法源码

native 方法解释一下?

推荐阅读:手把手教你用 C语言实现 Java native 本地方法

native 方法是在 Java 中通过 native 关键字声明的,用于调用非 Java 语言,如 C/C++ 编写的代码。Java 可以通过 JNI,也就是 Java Native Interface 与底层系统、硬件设备、或者本地库进行交互。

介绍一下 Java 堆?

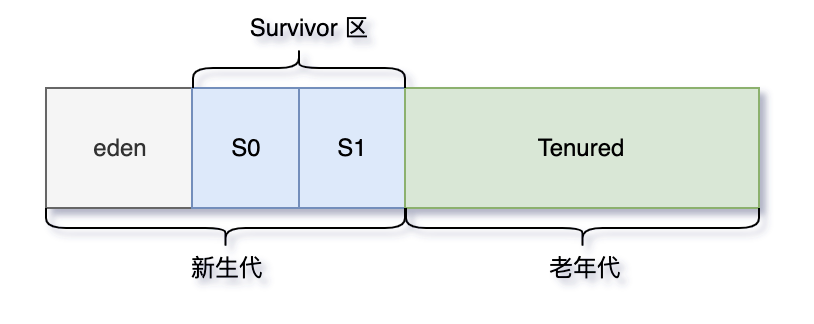

堆是 JVM 中最大的一块内存区域,被所有线程共享,在 JVM 启动时创建,主要用来存储 new 出来的对象。

二哥的 Java 进阶之路:堆

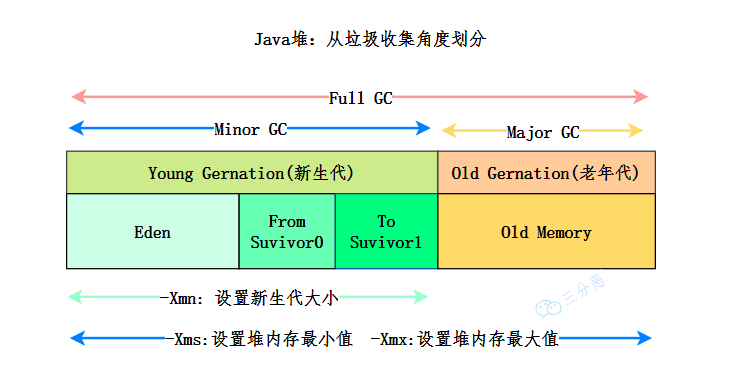

Java 中“几乎”所有的对象都会在堆中分配,堆也是垃圾收集器管理的目标区域。

从内存回收的角度来看,由于垃圾收集器大部分都是基于分代收集理论设计的,所以堆又被细分为新生代、老年代、Eden空间、From Survivor空间、To Survivor空间等。

三分恶面渣逆袭:Java 堆内存结构

随着 JIT 编译器的发展和逃逸技术的逐渐成熟,“所有的对象都会分配到堆上”就不再那么绝对了。

从 JDK 7 开始,JVM 默认开启了逃逸分析,意味着如果某些方法中的对象引用没有被返回或者没有在方法体外使用,也就是未逃逸出去,那么对象可以直接在栈上分配内存。

堆和栈的区别是什么?

堆属于线程共享的内存区域,几乎所有 new 出来的对象都会堆上分配,生命周期不由单个方法调用所决定,可以在方法调用结束后继续存在,直到不再被任何变量引用,最后被垃圾收集器回收。

栈属于线程私有的内存区域,主要存储局部变量、方法参数、对象引用等,通常随着方法调用的结束而自动释放,不需要垃圾收集器处理。

介绍一下方法区?

方法区并不真实存在,属于 Java 虚拟机规范中的一个逻辑概念,用于存储已被 JVM 加载的类信息、常量、静态变量、即时编译器编译后的代码缓存等。

在 HotSpot 虚拟机中,方法区的实现称为永久代 PermGen,但在 Java 8 及之后的版本中,已经被元空间 Metaspace 所替代。

变量存在堆栈的什么位置?

对于局部变量,它存储在当前方法栈帧中的局部变量表中。当方法执行完毕,栈帧被回收,局部变量也会被释放。

1 | public void method() { |

对于静态变量来说,它存储在 Java 虚拟机规范中的方法区中,在 Java 7 中是永久代,在 Java8 及以后 是元空间。

1 | public class StaticVarDemo { |

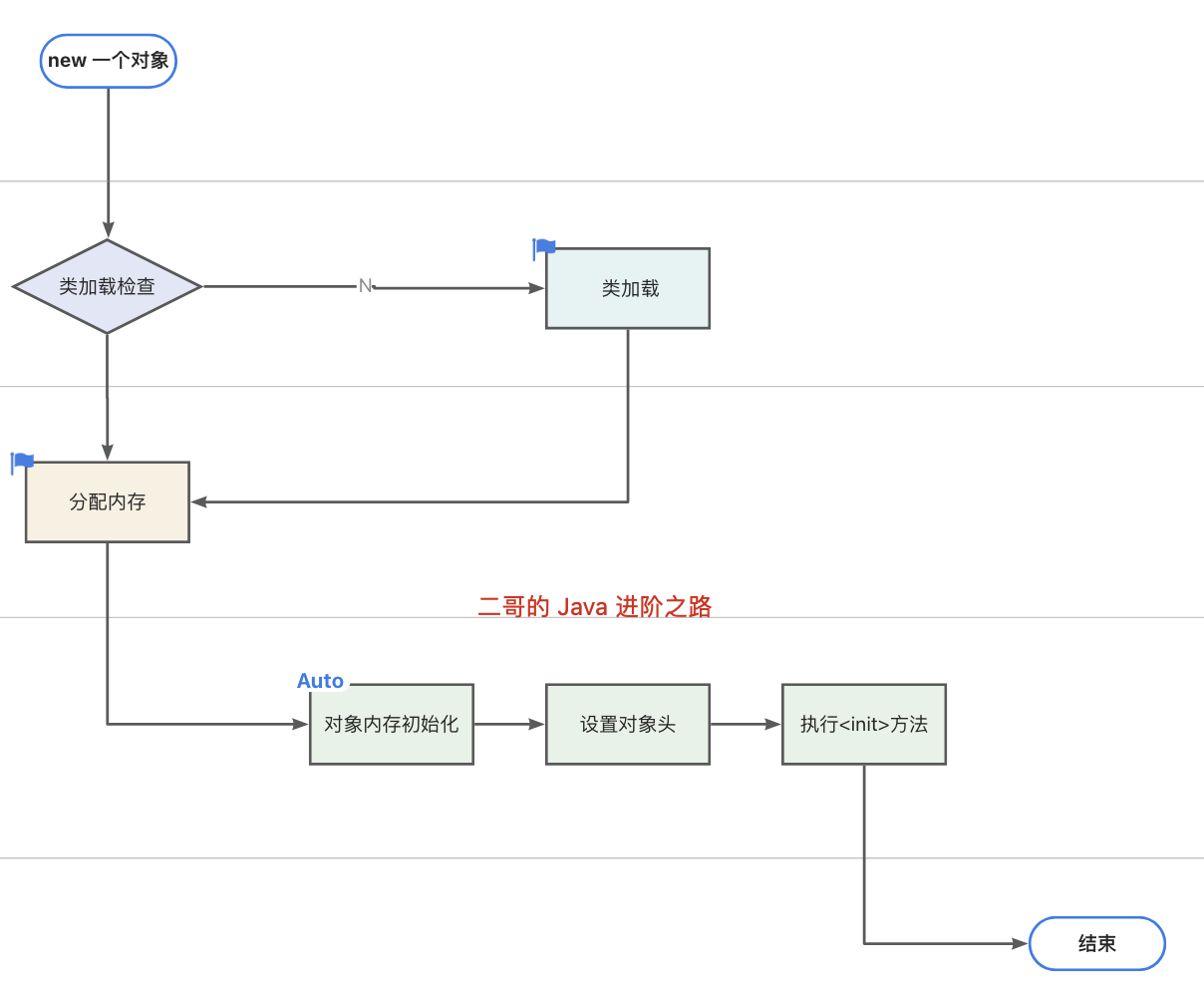

6.🌟对象创建的过程了解吗?

当我们使用 new 关键字创建一个对象时,JVM 首先会检查 new 指令的参数是否能在常量池中定位到类的符号引用,然后检查这个符号引用代表的类是否已被加载、解析和初始化。如果没有,就先执行类加载。

二哥的 Java 进阶之路:对象的创建过程

如果已经加载,JVM 会为对象分配内存完成初始化,比如数值类型的成员变量初始值是 0,布尔类型是 false,对象类型是 null。

接下来会设置对象头,里面包含了对象是哪个类的实例、对象的哈希码、对象的 GC 分代年龄等信息。

最后,JVM 会执行构造方法 <init> 完成赋值操作,将成员变量赋值为预期的值,比如 int age = 18,这样一个对象就创建完成了。

对象的销毁过程了解吗?

当对象不再被任何引用指向时,就会变成垃圾。垃圾收集器会通过可达性分析算法判断对象是否存活,如果对象不可达,就会被回收。

垃圾收集器通过标记清除、标记复制、标记整理等算法来回收内存,将对象占用的内存空间释放出来。

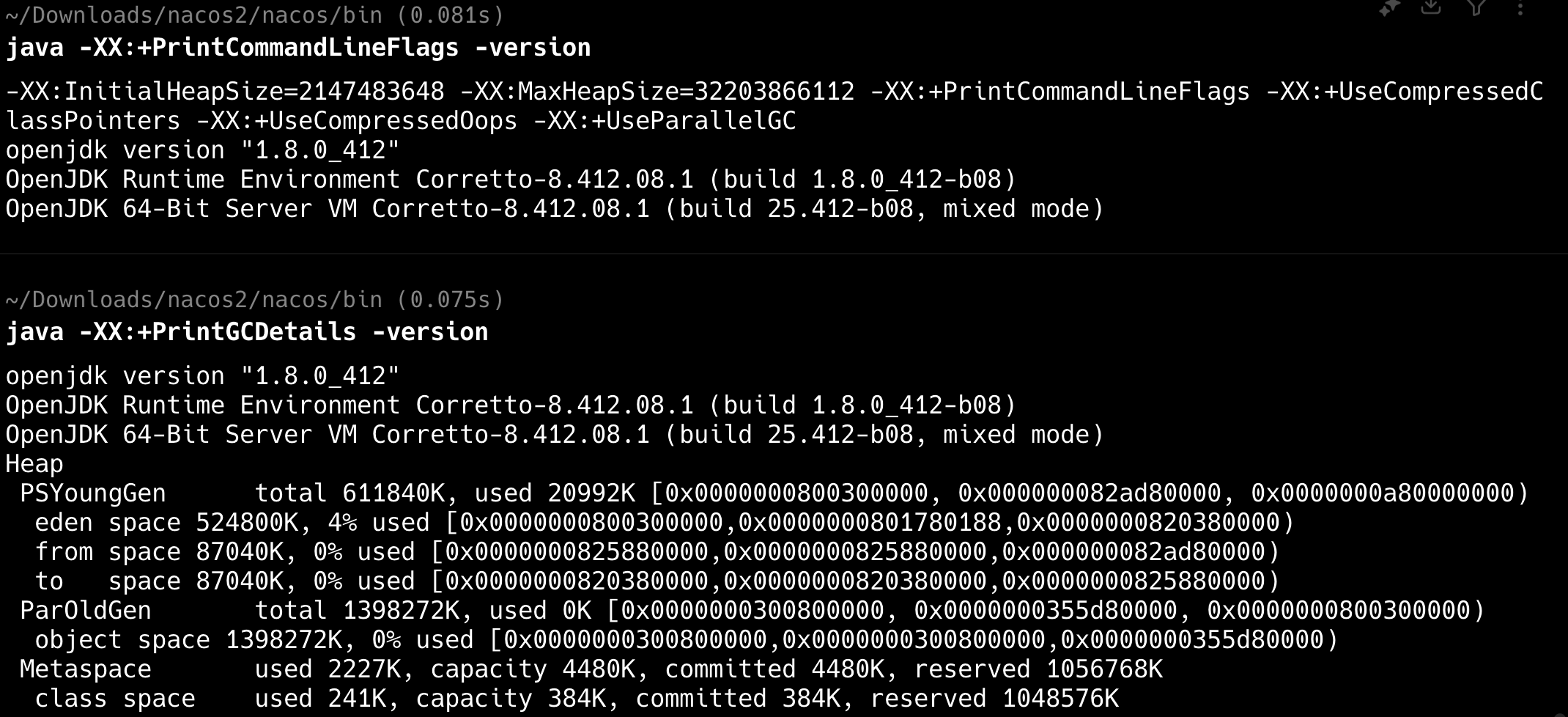

可以通过 java -XX:+PrintCommandLineFlags -version 和 java -XX:+PrintGCDetails -version 命令查看 JVM 的 GC 收集器。

二哥的 Java 进阶之路:JVM 使用的垃圾收集器

可以看到,我本机安装的 JDK 8 默认使用的是 Parallel Scavenge + Parallel Old。

不同参数代表对应的垃圾收集器表单:

| 新生代 | 老年代 | JVM参数 |

|---|---|---|

| Serial | Serial | -XX:+UseSerialGC |

| Parallel Scavenge | Serial | -XX:+UseParallelGC -XX:-UseParallelOldGC |

| Parallel Scavenge | Parallel Old | -XX:+UseParallelGC -XX:+UseParallelOldGC |

| Parallel New | CMS | -XX:+UseParNewGC -XX:+UseConcMarkSweepGC |

| G1 | -XX:+UseG1GC |

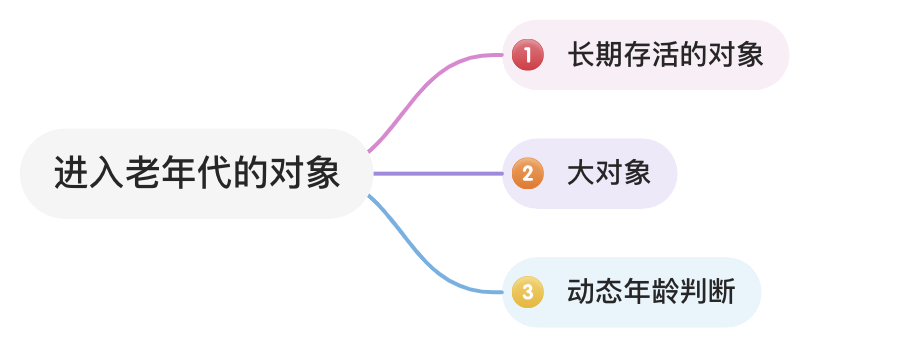

14.🌟对象什么时候会进入老年代?

对象通常会在年轻代中分配,随着时间的推移和垃圾收集的进程,某些满足条件的对象会进入到老年代中,如长期存活的对象。

二哥的 Java 进阶之路:对象进入老年代

长期存活的对象如何判断?

JVM 会为对象维护一个“年龄”计数器,记录对象在新生代中经历 Minor GC 的次数。每次 GC 未被回收的对象,其年龄会加 1。

当超过一个特定阈值,默认值是 15,就会被认为老对象了,需要重点关照。这个年龄阈值可以通过 JVM 参数-XX:MaxTenuringThreshold来设置。

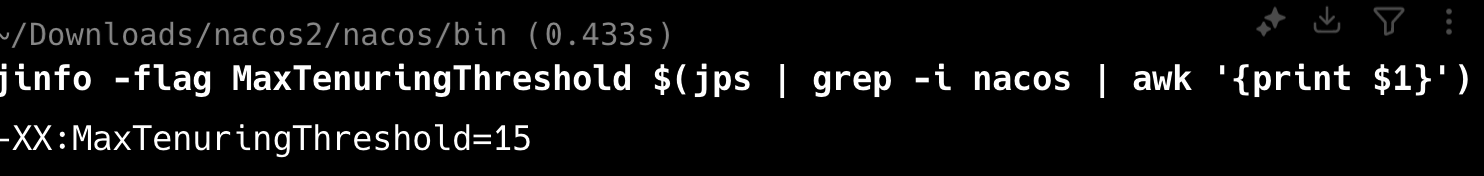

可以通过 jinfo -flag MaxTenuringThreshold $(jps | grep -i nacos | awk '{print $1}') 来查看当前 JVM 的年龄阈值。

二哥的 Java 进阶之路:年龄阈值

- 如果应用中的对象存活时间较短,可以适当调大这个值,让对象在新生代多待一会儿

- 如果对象存活时间较长,可以适当调小这个值,让对象更快进入老年代,减少在新生代的复制次数

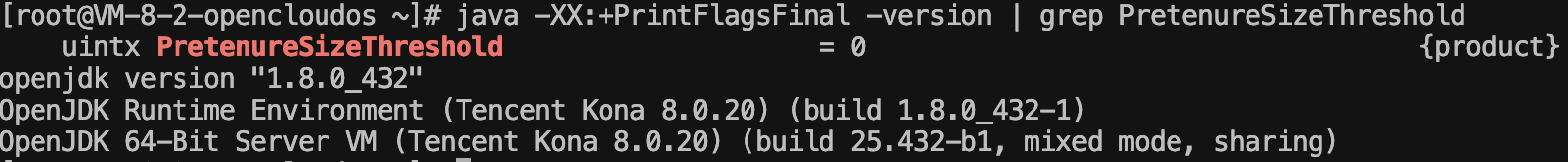

大对象如何判断?

大对象是指占用内存较大的对象,如大数组、长字符串等。

1 | int[] array = new int[1000000]; |

其大小由 JVM 参数 -XX:PretenureSizeThreshold 控制,但在 JDK 8 中,默认值为 0,也就是说默认情况下,对象仅根据 GC 存活的次数来判断是否进入老年代。

二哥的 Java 进阶之路:PretenureSizeThreshold

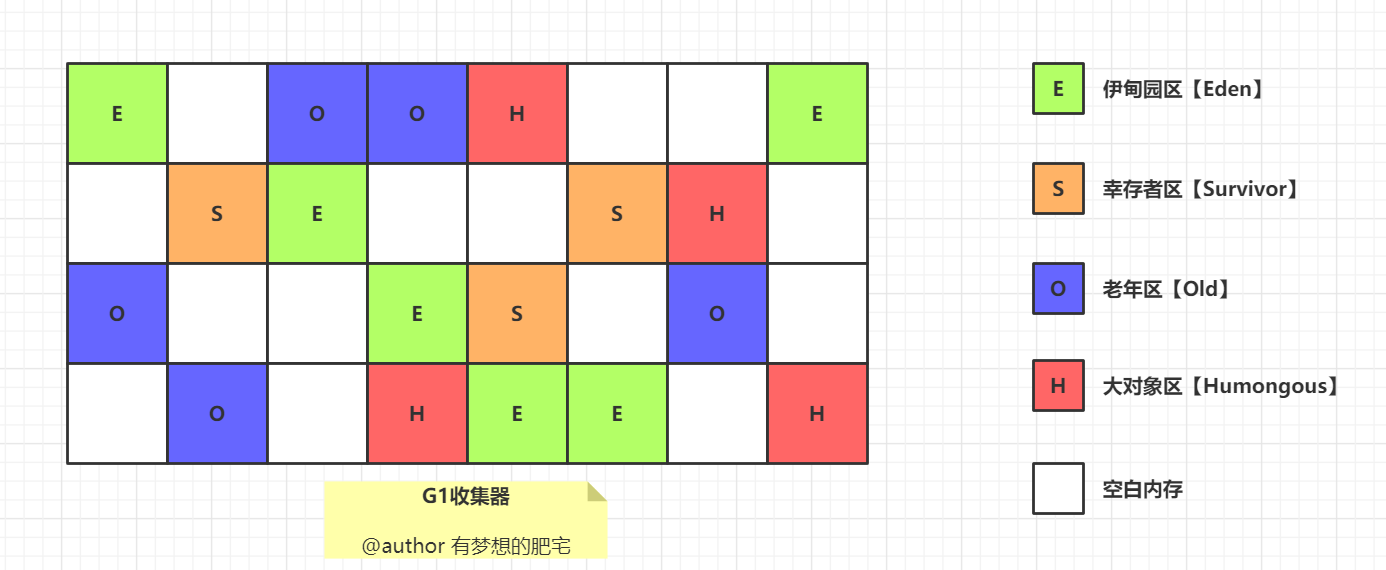

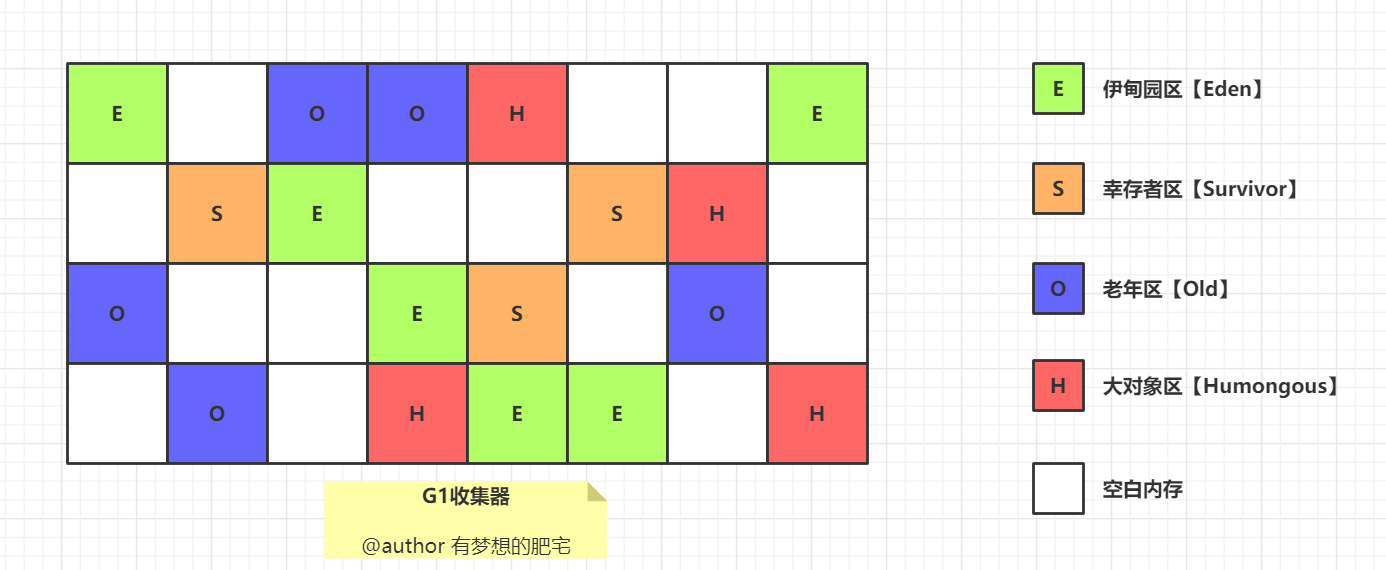

G1 垃圾收集器中,大对象会直接分配到 HUMONGOUS 区域。当对象大小超过一个 Region 容量的 50% 时,会被认为是大对象。

有梦想的肥宅:G1

Region 的大小可以通过 JVM 参数 -XX:G1HeapRegionSize 来设置,默认情况下从 1MB 到 32MB 不等,会根据堆内存大小动态调整。

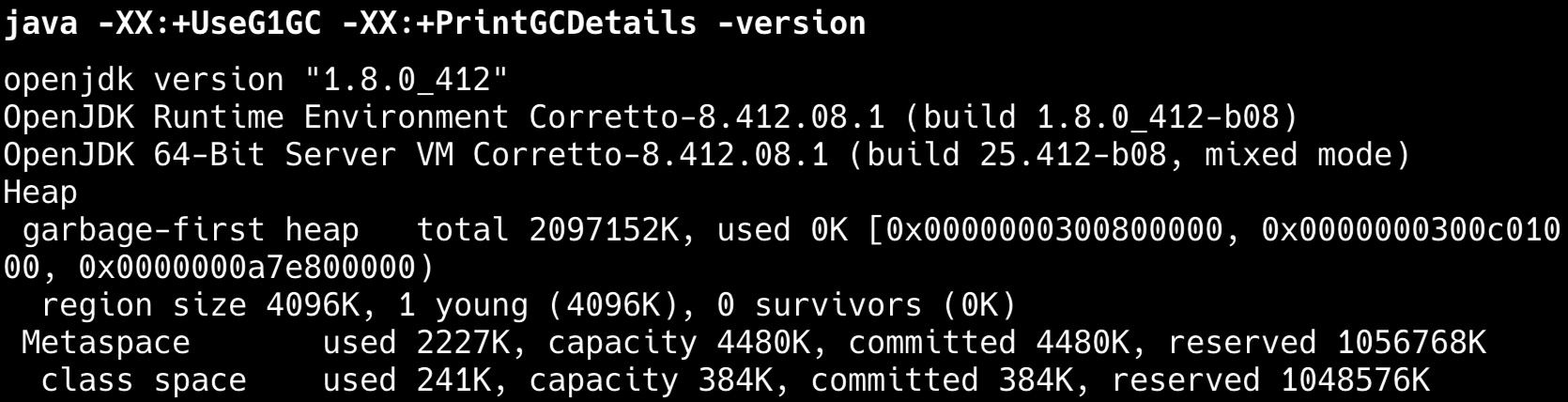

可以通过 java -XX:+UseG1GC -XX:+PrintGCDetails -version 查看 G1 垃圾收集器的相关信息。

二哥的 Java 进阶之路:UseG1GC

从结果上来看,我本机上 G1 的堆大小为 2GB,Region 的大小为 4MB。

动态年龄判定了解吗?

如果 Survivor 区中所有对象的总大小超过了一定比例,通常是 Survivor 区的一半,那么年龄较小的对象也可能会被提前晋升到老年代。

这是因为如果年龄较小的对象在 Survivor 区中占用了较大的空间,会导致 Survivor 区中的对象复制次数增多,影响垃圾回收的效率。

23.🌟讲讲 JVM 的垃圾回收机制(补充)

本题是增补的内容 参照:深入理解 JVM 的垃圾回收机制

垃圾回收就是对内存堆中已经死亡的或者长时间没有使用的对象进行清除或回收。

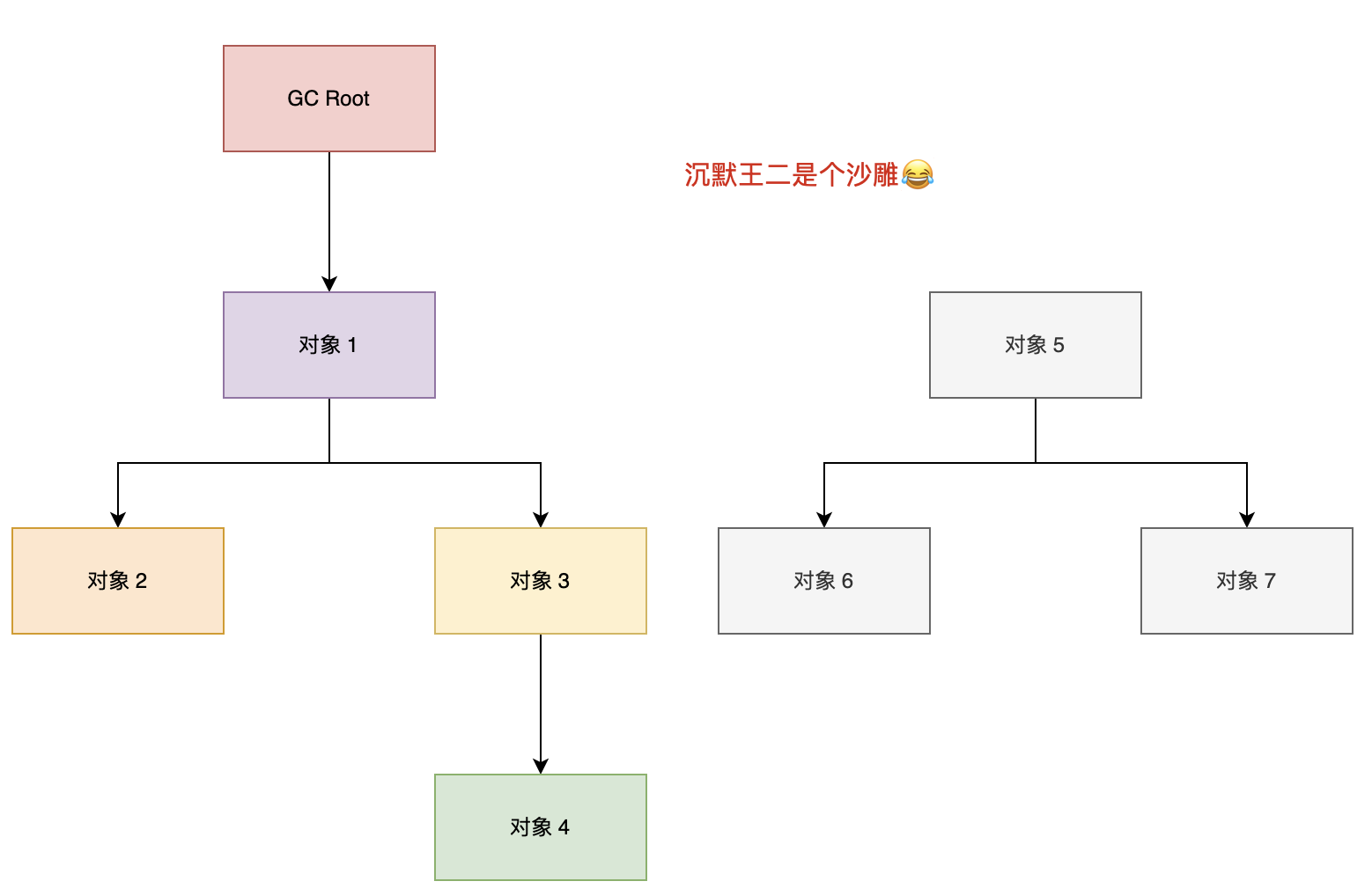

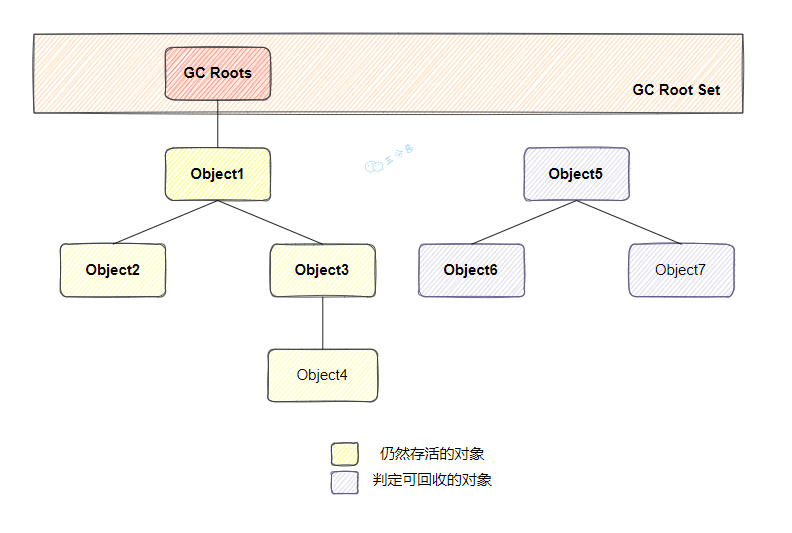

JVM 在做 GC 之前,会先搞清楚什么是垃圾,什么不是垃圾,通常会通过可达性分析算法来判断对象是否存活。

二哥的 Java 进阶之路:可达性分析

在确定了哪些垃圾可以被回收后,垃圾收集器(如 CMS、G1、ZGC)要做的事情就是进行垃圾回收,可以采用标记清除算法、复制算法、标记整理算法、分代收集算法等。

技术派项目使用的 JDK 8,采用的是 CMS 垃圾收集器。

1 | java -XX:+UseConcMarkSweepGC \ |

垃圾回收的过程是什么?

Java 的垃圾回收过程主要分为标记存活对象、清除无用对象、以及内存压缩/整理三个阶段。不同的垃圾回收器在执行这些步骤时会采用不同的策略和算法。

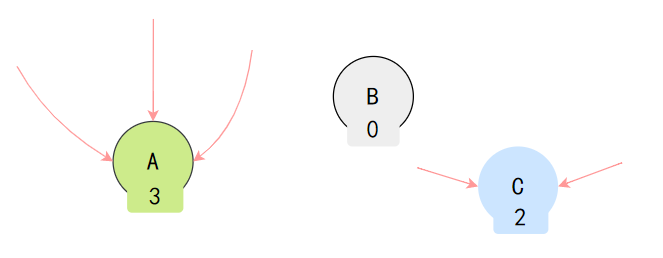

24.🌟如何判断对象仍然存活?

Java 通过可达性分析算法来判断一个对象是否还存活。

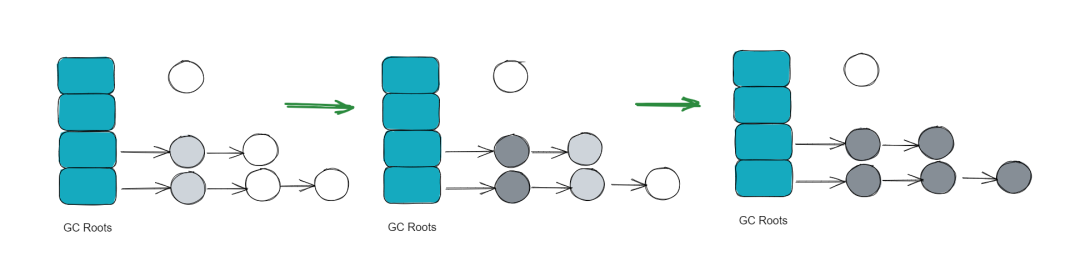

通过一组名为 “GC Roots” 的根对象,进行递归扫描,无法从根对象到达的对象就是“垃圾”,可以被回收。

三分恶面渣逆袭:GC Root

这也是 G1、CMS 等主流垃圾收集器使用的主要算法。

什么是引用计数法?

每个对象有一个引用计数器,记录引用它的次数。当计数器为零时,对象可以被回收。

三分恶面渣逆袭:引用计数法

引用计数法无法解决循环引用的问题。例如,两个对象互相引用,但不再被其他对象引用,它们的引用计数都不为零,因此不会被回收。

做可达性分析的时候,应该有哪些前置性的操作?

在进行垃圾回收之前,JVM 会暂停所有正在执行的应用线程。

这是因为可达性分析过程必须确保在执行分析时,内存中的对象关系不会被应用线程修改。如果不暂停应用线程,可能会出现对象引用的改变,导致垃圾回收过程中判断对象是否可达的结果不一致,从而引发严重的内存错误或数据丢失。

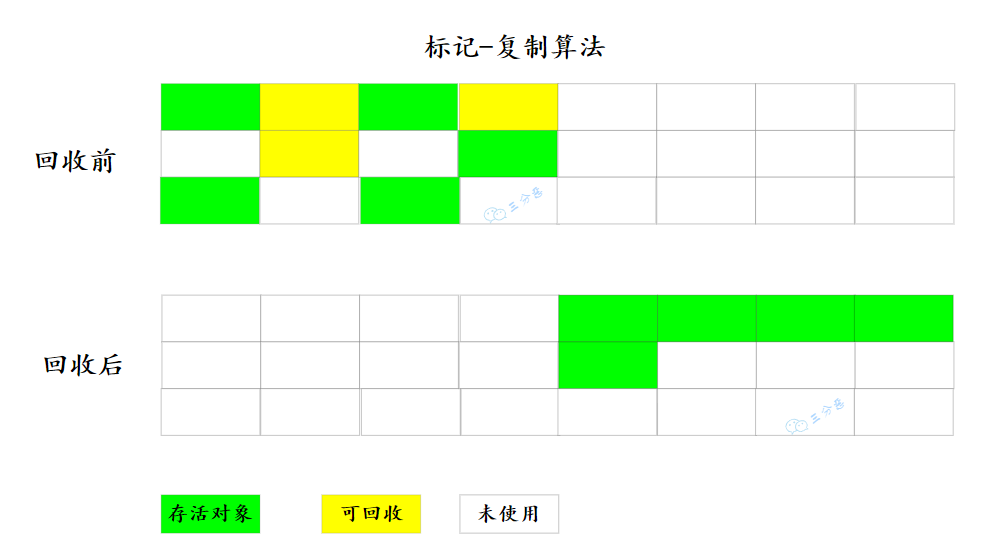

27.🌟垃圾收集算法了解吗?

垃圾收集算法主要有三种,分别是标记-清除算法、标记-复制算法和标记-整理算法。

说说标记-清除算法?

标记-清除算法分为两个阶段:

- 标记:标记所有需要回收的对象

- 清除:回收所有被标记的对象

三分恶面渣逆袭:标记-清除算法

优点是实现简单,缺点是回收过程中会产生内存碎片。

说说标记-复制算法?

标记-复制算法可以解决标记-清除算法的内存碎片问题,因为它将内存空间划分为两块,每次只使用其中一块。当这一块的内存用完了,就将还存活着的对象复制到另外一块上面,然后清理掉这一块。

三分恶面渣逆袭:标记-复制算法

缺点是浪费了一半的内存空间。

说说标记-整理算法?

标记-整理算法是标记-清除复制算法的升级版,它不再划分内存空间,而是将存活的对象向内存的一端移动,然后清理边界以外的内存。

标记-整理算法

缺点是移动对象的成本比较高。

说说分代收集算法?

分代收集算法是目前主流的垃圾收集算法,它根据对象存活周期的不同将内存划分为几块,一般分为新生代和老年代。

二哥的 Java 进阶之路:Java 堆划分

新生代用复制算法,因为大部分对象生命周期短。老年代用标记-整理算法,因为对象存活率较高。

为什么要用分代收集呢?

分代收集算法的核心思想是根据对象的生命周期优化垃圾回收。

新生代的对象生命周期短,使用复制算法可以快速回收。老年代的对象生命周期长,使用标记-整理算法可以减少移动对象的成本。

标记复制的标记过程和复制过程会不会停顿?

在标记-复制算法 中,标记阶段和复制阶段都会触发STW。

- 标记阶段停顿是为了保证对象的引用关系不被修改。

- 复制阶段停顿是防止对象在复制过程中被修改。

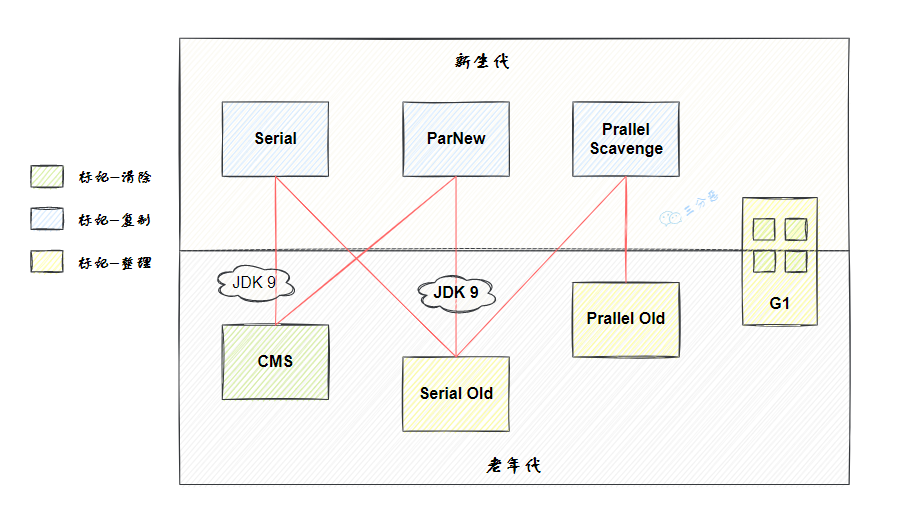

31.🌟知道哪些垃圾收集器?

推荐阅读:深入理解 JVM 的垃圾收集器:CMS、G1、ZGC

JVM 的垃圾收集器主要分为两大类:分代收集器和分区收集器,分代收集器的代表是 CMS,分区收集器的代表是 G1 和 ZGC。

三分恶面渣逆袭:HotSpot虚拟机垃圾收集器

CMS 是第一个关注 GC 停顿时间的垃圾收集器,JDK 1.5 时引入,JDK9 被标记弃用,JDK14 被移除。

G1 在 JDK 1.7 时引入,在 JDK 9 时取代 CMS 成为了默认的垃圾收集器。

ZGC 是 JDK11 推出的一款低延迟垃圾收集器,适用于大内存低延迟服务的内存管理和回收,在 128G 的大堆下,最大停顿时间才 1.68 ms,性能远胜于 G1 和 CMS。

说说 Serial 收集器?

Serial 收集器是最基础、历史最悠久的收集器。

如同它的名字(串行),它是一个单线程工作的收集器,使用一个处理器或一条收集线程去完成垃圾收集工作。并且进行垃圾收集时,必须暂停其他所有工作线程,直到垃圾收集结束——这就是所谓的“Stop The World”。

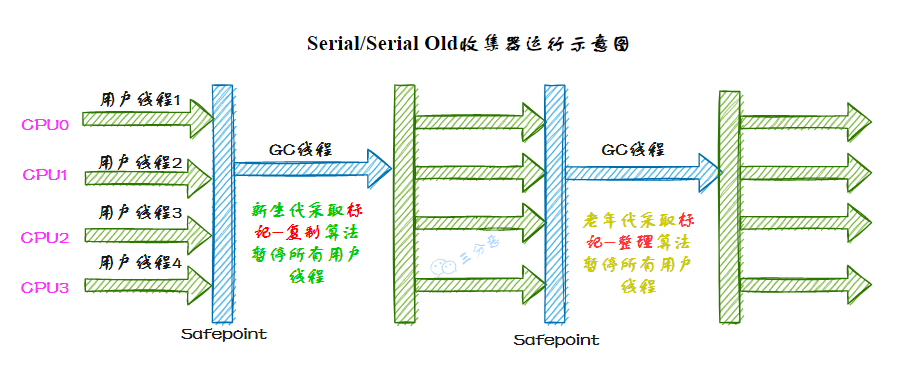

Serial/Serial Old 收集器的运行过程如图:

三分恶面渣逆袭:Serial/Serial Old收集器运行示意图

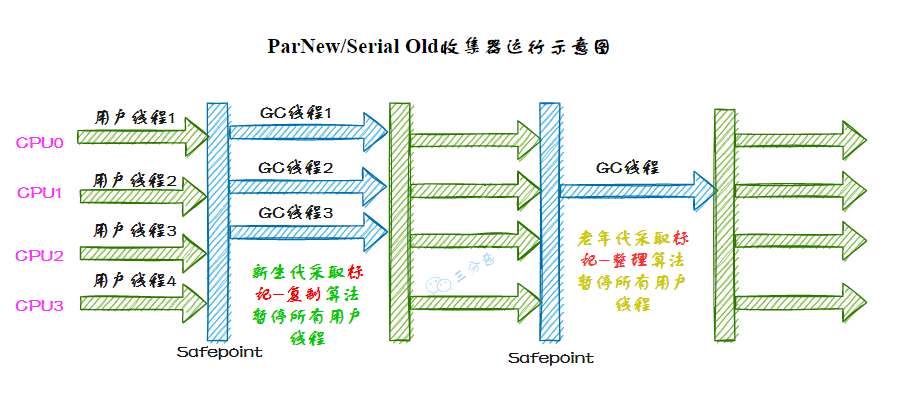

说说 ParNew 收集器?

ParNew 收集器实质上是 Serial 收集器的多线程并行版本,使用多条线程进行垃圾收集。

ParNew/Serial Old 收集器运行示意图如下:

三分恶面渣逆袭:ParNew/Serial Old收集器运行示意图

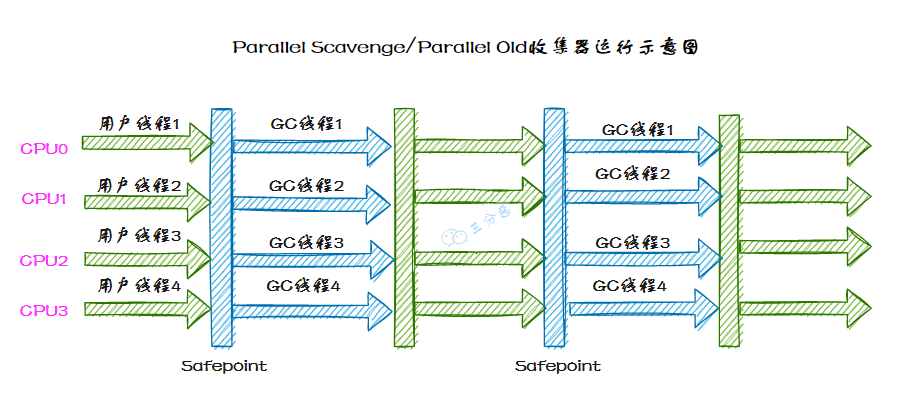

说说 Parallel Scavenge 收集器?

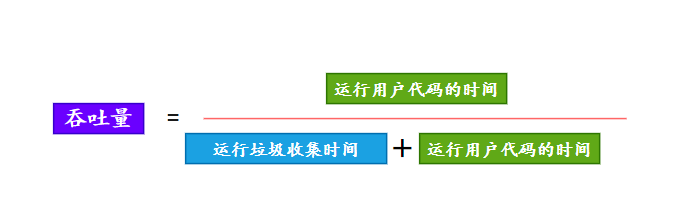

Parallel Scavenge 收集器是一款新生代收集器,基于标记-复制算法实现,也能够并行收集。和 ParNew 有些类似,但 Parallel Scavenge 主要关注的是垃圾收集的吞吐量——所谓吞吐量,就是 CPU 用于运行用户代码的时间和总消耗时间的比值,比值越大,说明垃圾收集的占比越小。

三分恶面渣逆袭:吞吐量

根据对象存活周期的不同会将内存划分为几块,一般是把 Java 堆分为新生代和老年代,这样就可以根据各个年代的特点采用最适当的收集算法。

说说 Serial Old 收集器?

Serial Old 是 Serial 收集器的老年代版本,它同样是一个单线程收集器,使用标记-整理算法。

说说 Parallel Old 收集器?

Parallel Old 是 Parallel Scavenge 收集器的老年代版本,基于标记-整理算法实现,使用多条 GC 线程在 STW 期间同时进行垃圾回收。

三分恶面渣逆袭:Parallel Old收集器

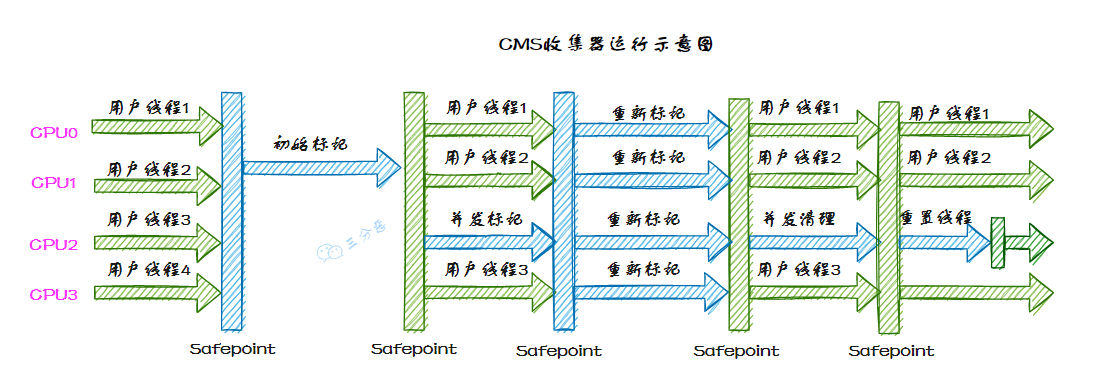

说说 CMS 收集器?

CMS 在 JDK 1.5 时引入,JDK 9 时被标记弃用,JDK 14 时被移除。

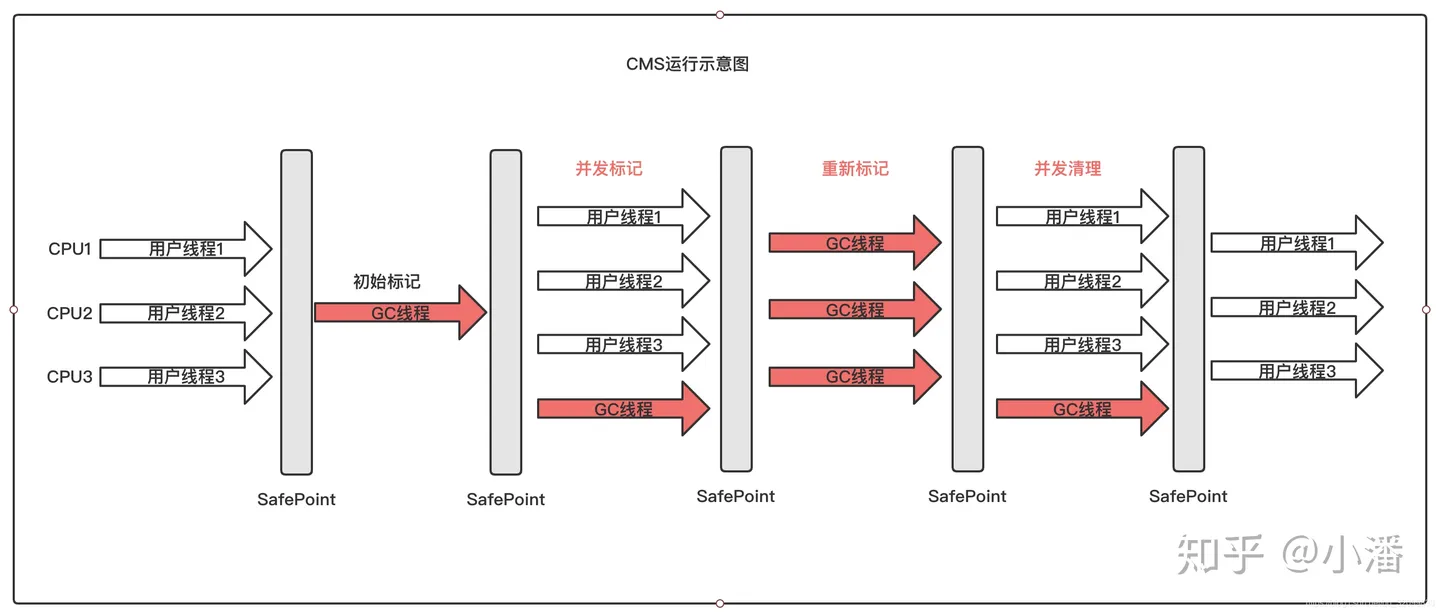

CMS 是一种低延迟的垃圾收集器,采用标记-清除算法,分为初始标记、并发标记、重新标记和并发清除四个阶段,优点是垃圾回收线程和应用线程同时运行,停顿时间短,适合延迟敏感的应用,但容易产生内存碎片,可能触发 Full GC。

小潘:CMS

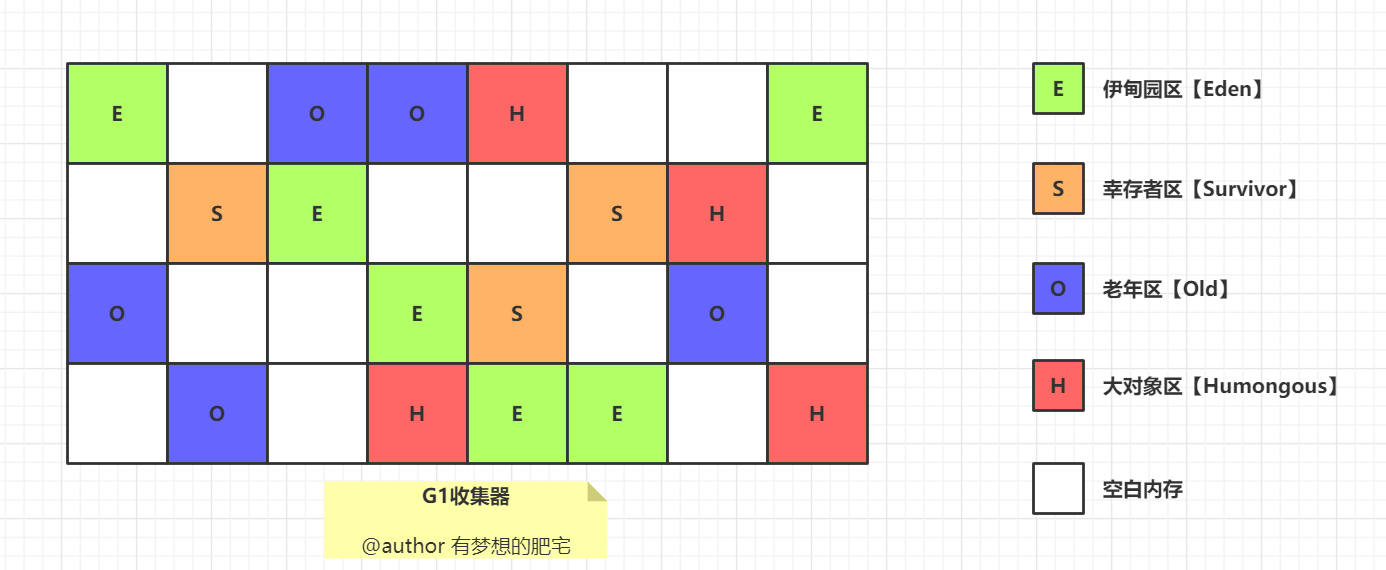

说说 G1 收集器?

G1 在 JDK 1.7 时引入,在 JDK 9 时取代 CMS 成为默认的垃圾收集器。

G1 是一种面向大内存、高吞吐场景的垃圾收集器,它将堆划分为多个小的 Region,通过标记-整理算法,避免了内存碎片问题。优点是停顿时间可控,适合大堆场景,但调优较复杂。

有梦想的肥宅:G1

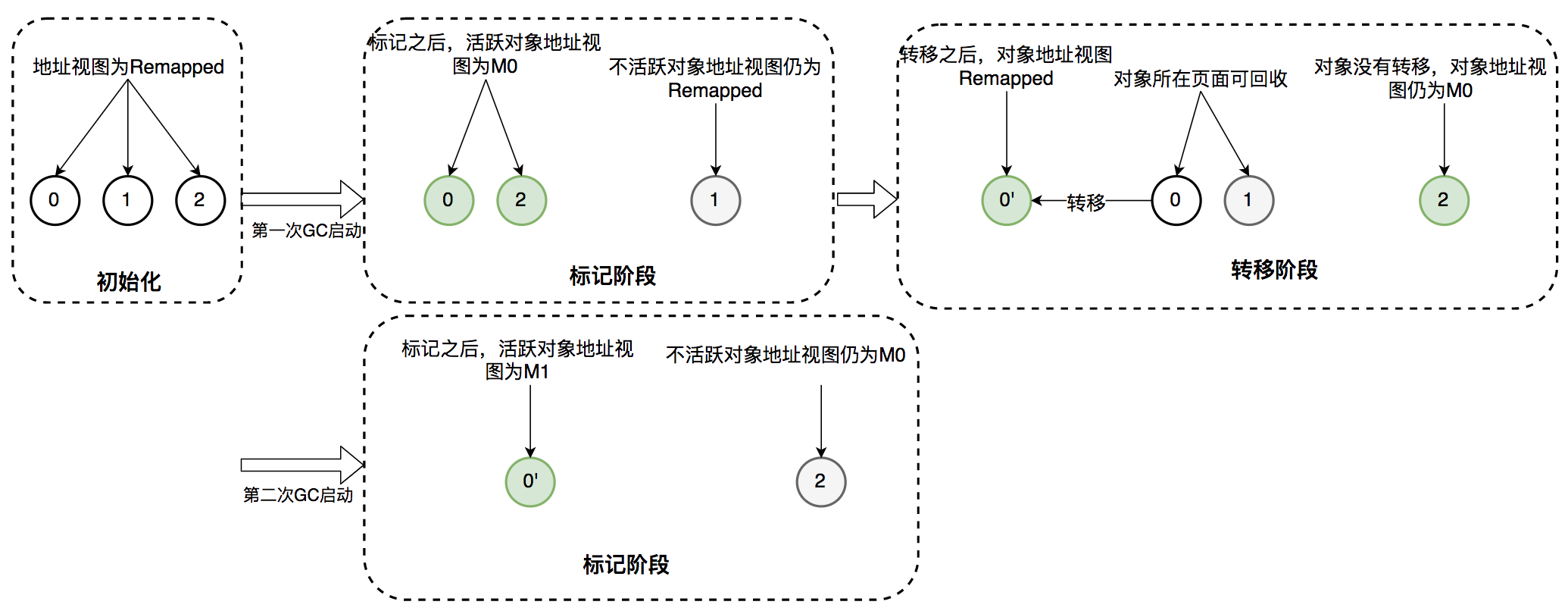

说说 ZGC 收集器?

ZGC 是 JDK 11 时引入的一款低延迟的垃圾收集器,最大特点是将垃圾收集的停顿时间控制在 10ms 以内,即使在 TB 级别的堆内存下也能保持较低的停顿时间。

它通过并发标记和重定位来避免大部分 Stop-The-World 停顿,主要依赖指针染色来管理对象状态。

得物技术:指针染色

- 标记对象的可达性:通过在指针上增加标记位,不需要额外的标记位即可判断对象的存活状态。

- 重定位状态:在对象被移动时,可以通过指针染色来更新对象的引用,而不需要等待全局同步。

适用于需要超低延迟的场景,比如金融交易系统、电商平台。

垃圾回收器的作用是什么?

垃圾回收器的核心作用是自动管理 Java 应用程序的运行时内存。它负责识别哪些内存是不再被应用程序使用的,并释放这些内存以便重新使用。

这一过程减少了程序员手动管理内存的负担,降低了内存泄漏和溢出错误的风险。

32.🌟能详细说一下 CMS 的垃圾收集过程吗?

三分恶面渣逆袭:Concurrent Mark Sweep收集器运行示意图

CMS 使用标记-清除算法进行垃圾收集,分 4 大步:

- 初始标记:标记所有从 GC Roots 直接可达的对象,这个阶段需要 STW,但速度很快。

- 并发标记:从初始标记的对象出发,遍历所有对象,标记所有可达的对象。这个阶段是并发进行的。

- 重新标记:完成剩余的标记工作,包括处理并发阶段遗留下来的少量变动,这个阶段通常需要短暂的 STW 停顿。

- 并发清除:清除未被标记的对象,回收它们占用的内存空间。

你提到了remark,那它remark具体是怎么执行的?三色标记法?

是的,remark 阶段通常会结合三色标记法来执行,确保在并发标记期间所有存活对象都被正确标记。目的是修正并发标记阶段中可能遗漏的对象引用变化。

在 remark 阶段,垃圾收集器会停止应用线程,以确保在这个阶段不会有引用关系的进一步变化。这种暂停通常很短暂。remark 阶段主要包括以下操作:

- 处理写屏障记录的引用变化:在并发标记阶段,应用程序可能会更新对象的引用(比如一个黑色对象新增了对一个白色对象的引用),这些变化通过写屏障记录下来。在 remark 阶段,GC 会处理这些记录,确保所有可达对象都正确地标记为灰色或黑色。

- 扫描灰色对象:再次遍历灰色对象,处理它们的所有引用,确保引用的对象正确标记为灰色或黑色。

- 清理:确保所有引用关系正确处理后,灰色对象标记为黑色,白色对象保持不变。这一步完成后,所有存活对象都应当是黑色的。

什么是三色标记法?

Java全栈架构师:三色标记法

三色标记法用于标记对象的存活状态,它将对象分为三类:

- 白色(White):尚未访问的对象。垃圾回收结束后,仍然为白色的对象会被认为是不可达的对象,可以回收。

- 灰色(Gray):已经访问到但未标记完其引用的对象。灰色对象是需要进一步处理的。

- 黑色(Black):已经访问到并且其所有引用对象都已经标记过。黑色对象是完全处理过的,不需要再处理。

三色标记法的工作流程:

①、初始标记(Initial Marking):从 GC Roots 开始,标记所有直接可达的对象为灰色。

②、并发标记(Concurrent Marking):在此阶段,标记所有灰色对象引用的对象为灰色,然后将灰色对象自身标记为黑色。这个过程是并发的,和应用线程同时进行。

此阶段的一个问题是,应用线程可能在并发标记期间修改对象的引用关系,导致一些对象的标记状态不准确。

③、重新标记(Remarking):重新标记阶段的目标是处理并发标记阶段遗漏的引用变化。为了确保所有存活对象都被正确标记,remark 需要在 STW 暂停期间执行。

④、使用写屏障(Write Barrier)来捕捉并发标记阶段应用线程对对象引用的更新。通过遍历这些更新的引用来修正标记状态,确保遗漏的对象不会被错误地回收。

推荐阅读:小道哥的三色标记

33.🌟G1 垃圾收集器了解吗?

G1 在 JDK 1.7 时引入,在 JDK 9 时取代 CMS 成为默认的垃圾收集器。

有梦想的肥宅:G1 收集器

G1 把 Java 堆划分为多个大小相等的独立区域Region,每个区域都可以扮演新生代或老年代的角色。

同时,G1 还有一个专门为大对象设计的 Region,叫 Humongous 区。

大对象的判定规则是,如果一个大对象超过了一个 Region 大小的 50%,比如每个 Region 是 2M,只要一个对象超过了 1M,就会被放入 Humongous 中。

这种区域化管理使得 G1 可以更灵活地进行垃圾收集,只回收部分区域而不是整个新生代或老年代。

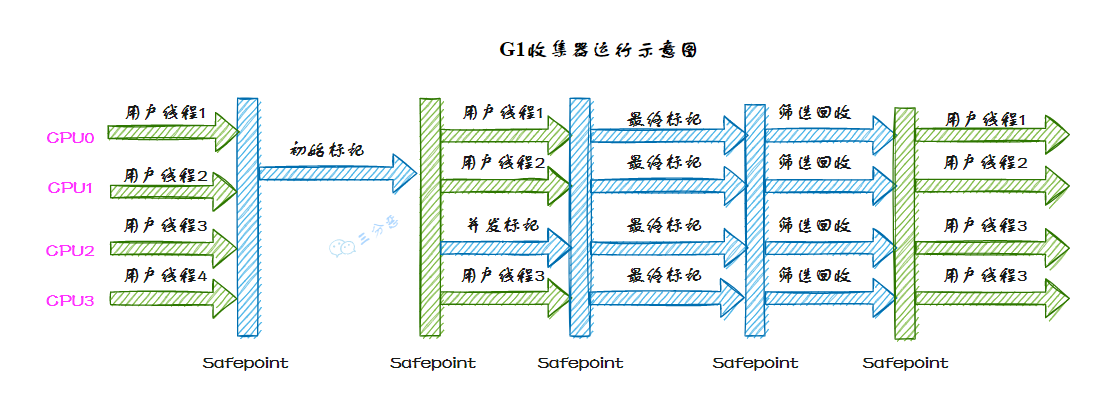

G1 收集器的运行过程大致可划分为这几个步骤:

①、并发标记,G1 通过并发标记的方式找出堆中的垃圾对象。并发标记阶段与应用线程同时执行,不会导致应用线程暂停。

②、混合收集,在并发标记完成后,G1 会计算出哪些区域的回收价值最高(也就是包含最多垃圾的区域),然后优先回收这些区域。这种回收方式包括了部分新生代区域和老年代区域。

选择回收成本低而收益高的区域进行回收,可以提高回收效率和减少停顿时间。

③、可预测的停顿,G1 在垃圾回收期间仍然需要「Stop the World」。不过,G1 在停顿时间上添加了预测机制,用户可以 JVM 启动时指定期望停顿时间,G1 会尽可能地在这个时间内完成垃圾回收。

三分恶面渣逆袭:G1收集器运行示意图

45.🌟了解类的加载机制吗?(补充)

了解。

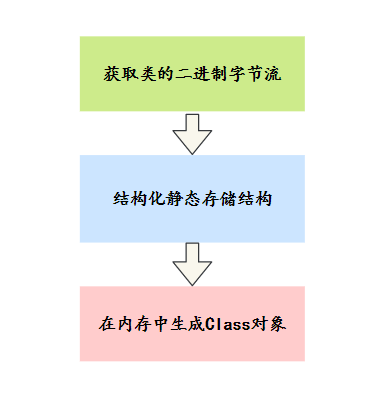

JVM 的操作对象是 Class 文件,JVM 把 Class 文件中描述类的数据结构加载到内存中,并对数据进行校验、解析和初始化,最终转化成可以被 JVM 直接使用的类型,这个过程被称为类加载机制。

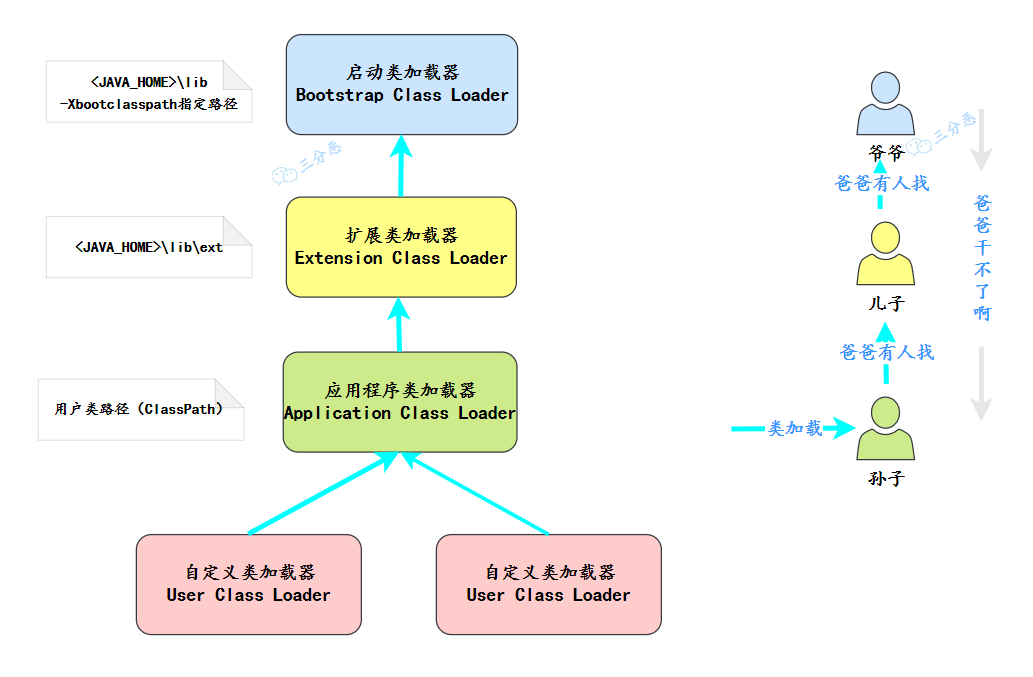

其中最重要的三个概念就是:类加载器、类加载过程和双亲委派模型。

- 类加载器:负责加载类文件,将类文件加载到内存中,生成 Class 对象。

- 类加载过程:包括加载、验证、准备、解析和初始化等步骤。

- 双亲委派模型:当一个类加载器接收到类加载请求时,它会把请求委派给父——类加载器去完成,依次递归,直到最顶层的类加载器,如果父——类加载器无法完成加载请求,子类加载器才会尝试自己去加载。

48.🌟类装载的过程知道吗?

推荐阅读:一文彻底搞懂 Java 类加载机制

知道。

类装载过程包括三个阶段:载入、链接和初始化。

①、载入:将类的二进制字节码加载到内存中。

②、链接可以细分为三个小的阶段:

- 验证:检查类文件格式是否符合 JVM 规范

- 准备:为类的静态变量分配内存并设置默认值。

- 解析:将符号引用替换为直接引用。

③、初始化:执行静态代码块和静态变量初始化。

在准备阶段,静态变量已经被赋过默认初始值了,在初始化阶段,静态变量将被赋值为代码期望赋的值。比如说 static int a = 1;,在准备阶段,a 的值为 0,在初始化阶段,a 的值为 1。

换句话说,初始化阶段是在执行类的构造方法,也就是 javap 中看到的 <clinit>()。

载入过程 JVM 会做什么?

三分恶面渣逆袭:载入

- 1)通过一个类的全限定名来获取定义此类的二进制字节流。

- 2)将这个字节流所代表的静态存储结构转化为方法区的运行时数据结构。

- 3)在内存中生成一个代表这个类的

java.lang.Class对象,作为这个类的访问入口。

49.🌟什么是双亲委派模型?

双亲委派模型要求类加载器在加载类时,先委托父加载器尝试加载,只有父加载器无法加载时,子加载器才会加载。

三分恶面渣逆袭:双亲委派模型

这个过程会一直向上递归,也就是说,从子加载器到父加载器,再到更上层的加载器,一直到最顶层的启动类加载器。

启动类加载器会尝试加载这个类。如果它能够加载这个类,就直接返回;如果它不能加载这个类,就会将加载任务返回给委托它的子加载器。

子加载器尝试加载这个类。如果子加载器也无法加载这个类,它就会继续向下传递这个加载任务,依此类推。

直到某个加载器能够加载这个类,或者所有加载器都无法加载这个类,最终抛出 ClassNotFoundException。

MySQL

🌟0.什么是MYSQL

MySQL 是⼀个开源的关系型数据库,现在⾪属于 Oracle 公司。

删除/创建一张表

DROP TABLE 删除表CREATE TABLE 创建表

创建表的时候,可以通过 PRIMARY KEY 设定主键。

1 | CREATE TABLE users ( |

写一个升序/降序的SQL语句

可以使用ORDER BY字句对查询结果进行排序.

默认情况下是升序排序.如需要降序,使用关键字DESC

例子:

1 | SELECT id, name, salary |

如若对多个字段进行排序:

1 | SELECT id, name, salary |

优先级从左到右,相当于先按工资降序,工资相同再按照姓名升序.

MYSQL出现性能差的原因

可能是 SQL 查询使⽤了全表扫描,也可能是查询语句过于复杂,如多表JOIN或嵌套⼦查询。

也有可能是单表数据量过⼤。

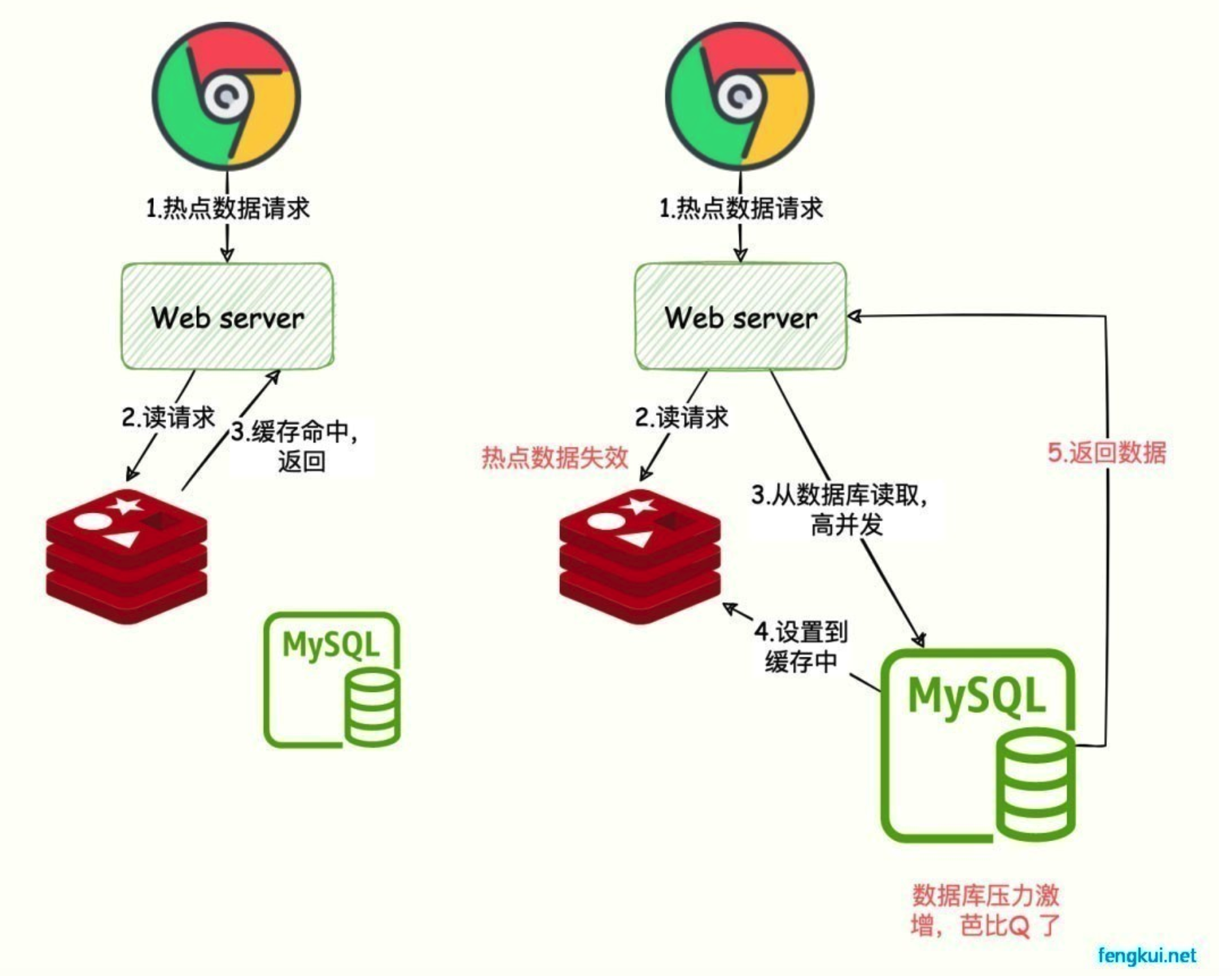

通常情况下,增加索引就可以解决大部分的性能问题.对于热点数据,增加redis缓存,减轻对数据库的压力.

9.🌟如何存储emoji?

因为 emoji是 4 个字节的 UTF-8 字符,⽽ MySQL 的 utf8 字符集只⽀持最多 3 个字节的 UTF-8 字符,所以在 MySQL 中存储 emoji 时,需要使⽤ utf8mb4 字符集。

MySQL 8.0 已经默认⽀持 utf8mb4 字符集,可以通过 SHOW VARIABLES WHERE Variable_name LIKE 'character\_set\_%' OR Variable_name LIKE 'collation%'; 查看。

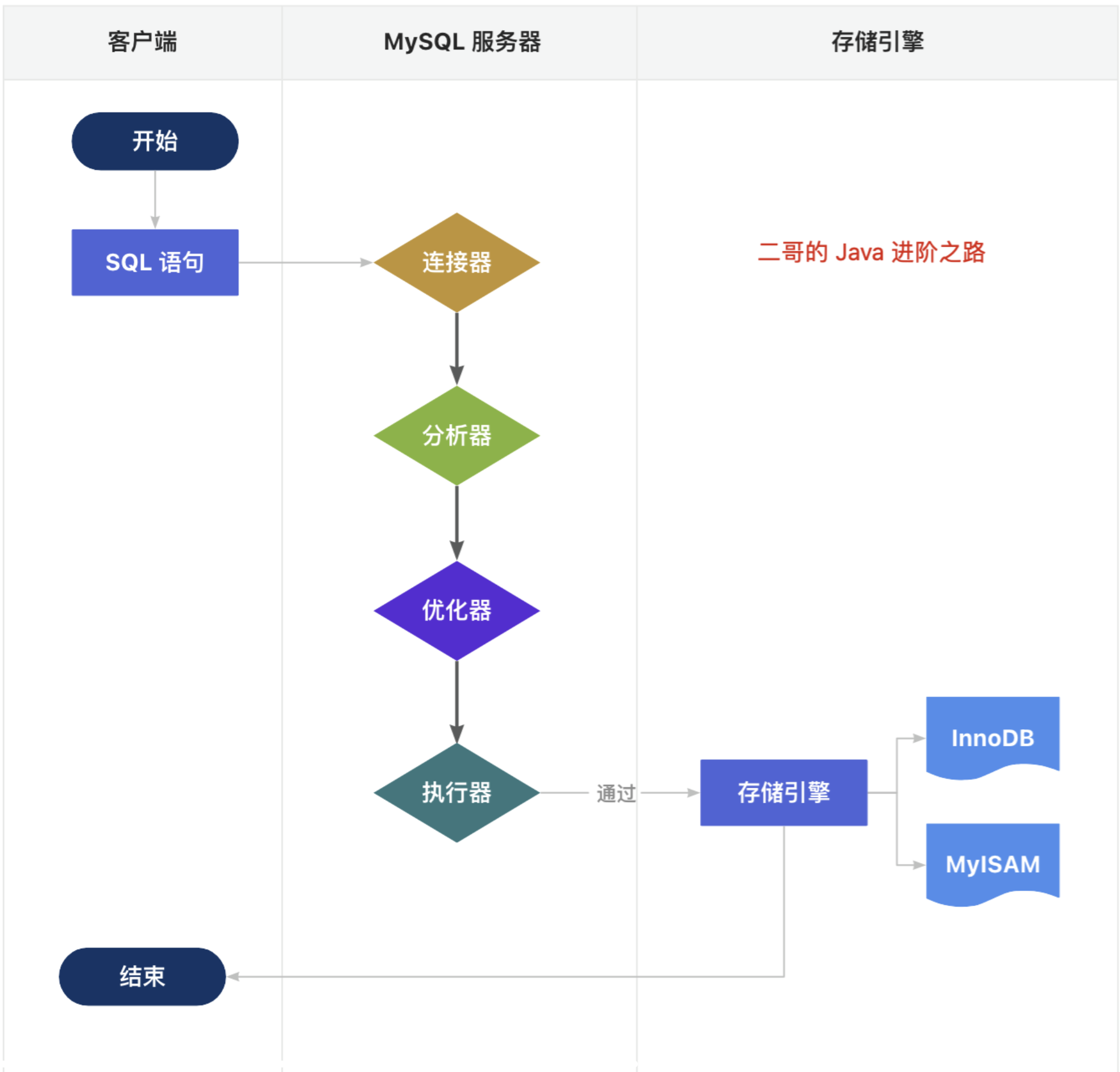

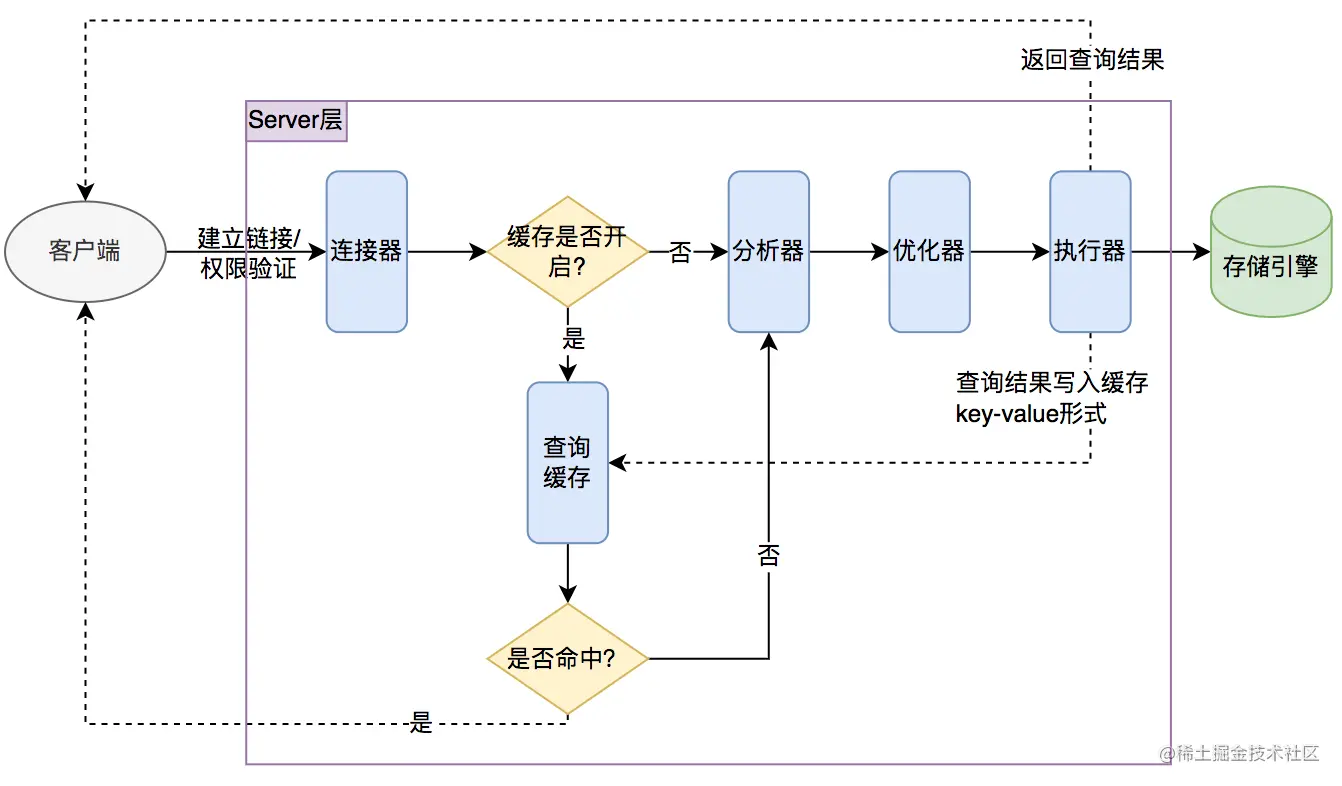

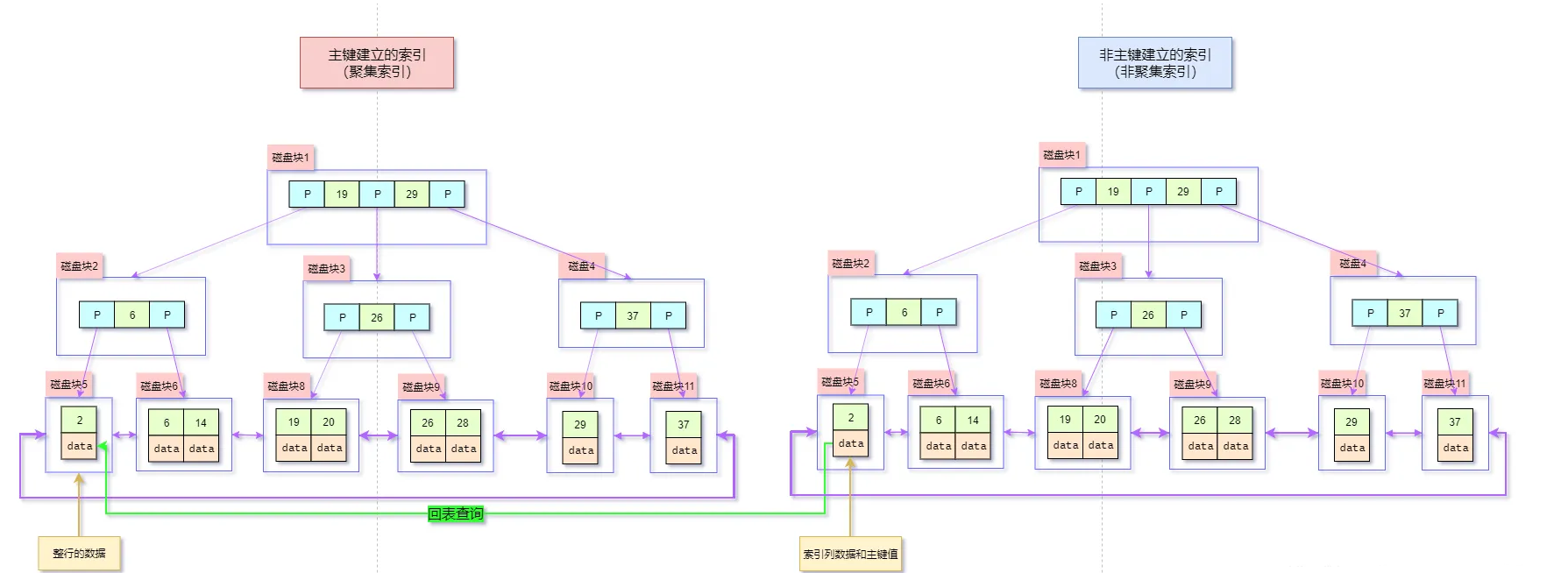

21.🌟一条查询语句SELECT是如何执行的?

当我们执行一条 SELECT 语句时,MySQL 并不会直接去磁盘读取数据,而是经过 6 个步骤来解析、优化、执行,然后再返回结果。

第一步,客户端发送 SQL 查询语句到 MySQL 服务器。

第二步,MySQL 服务器的连接器开始处理这个请求,跟客户端建立连接、获取权限、管理连接。

第三步,解析器对 SQL 语句进行解析,检查语句是否符合 SQL 语法规则,确保数据库、表和列都是存在的,并处理 SQL 语句中的名称解析和权限验证。

第四步,优化器负责确定 SQL 语句的执行计划,这包括选择使用哪些索引,以及决定表之间的连接顺序等。

第五步,执行器会调用存储引擎的 API来进行数据的读写。

第六步,存储引擎负责查询数据,并将执行结果返回给客户端。客户端接收到查询结果,完成这次查询请求。

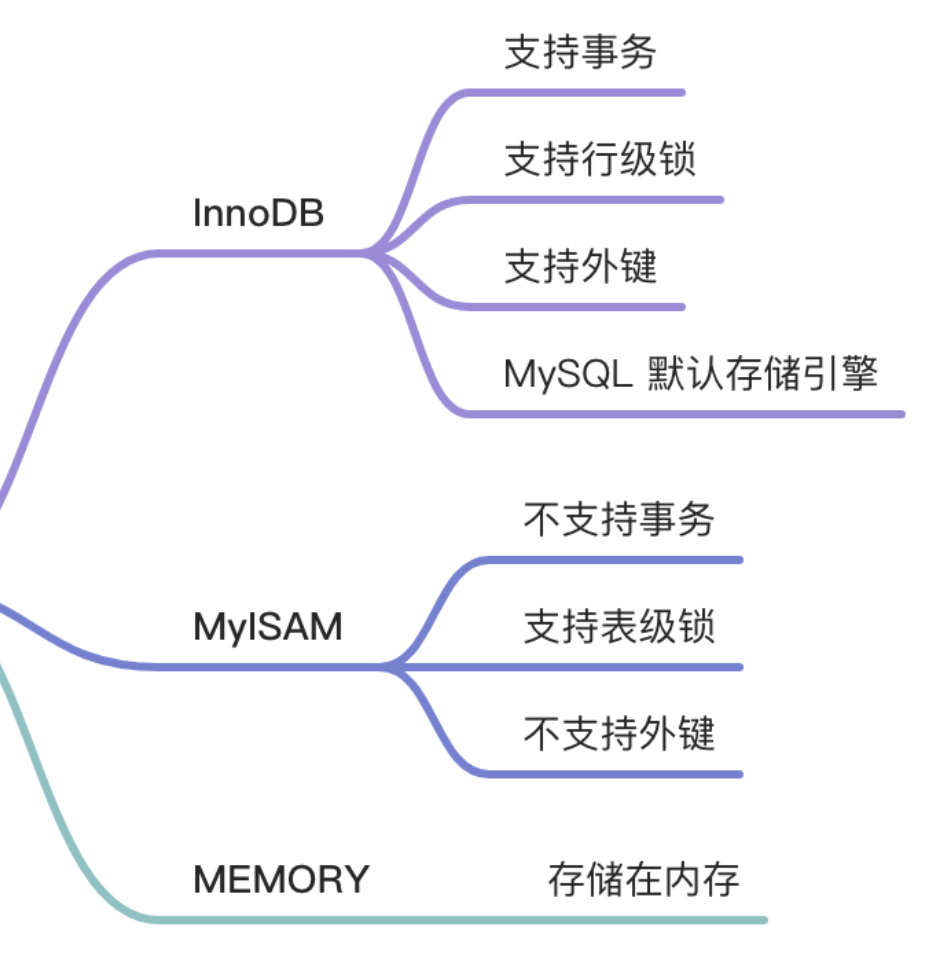

24.🌟MySQL 有哪些常见存储引擎?

MySQL 支持多种存储引擎,常见的有 MyISAM、InnoDB、MEMORY 等。

—这部分是帮助理解 start,面试中可不背—

我来做一个表格对比:

—这部分是帮助理解 end,面试中可不背—

除此之外,我还了解到:

①、MySQL 5.5 之前,默认存储引擎是 MyISAM,5.5 之后是 InnoDB。

②、InnoDB 支持的哈希索引是自适应的,不能人为干预。

③、InnoDB 从 MySQL 5.6 开始,支持全文索引。

④、InnoDB 的最小表空间略小于 10M,最大表空间取决于页面大小。

如何切换 MySQL 的数据引擎?

可以通过 alter table 语句来切换 MySQL 的数据引擎。ALTER TABLE your_table_name ENGINE=InnoDB;

不过不建议,应该提前设计好到底用哪一种存储引擎。

28.🌟MySQL 日志文件有哪些?

有 6 大类,其中错误日志用于问题诊断,慢查询日志用于 SQL 性能分析,general log 用于记录所有的 SQL 语句,binlog 用于主从复制和数据恢复,redo log 用于保证事务持久性,undo log 用于事务回滚和 MVCC。

—-这部分是帮助理解 start,面试中可不背—-

①、错误日志(Error Log):记录 MySQL 服务器启动、运行或停止时出现的问题。

②、慢查询日志(Slow Query Log):记录执行时间超过 long_query_time 值的所有 SQL 语句。这个时间值是可配置的,默认情况下,慢查询日志功能是关闭的。

③、一般查询日志(General Query Log):记录 MySQL 服务器的启动关闭信息,客户端的连接信息,以及更新、查询的 SQL 语句等。

④、二进制日志(Binary Log):记录所有修改数据库状态的 SQL 语句,以及每个语句的执行时间,如 INSERT、UPDATE、DELETE 等,但不包括 SELECT 和 SHOW 这类的操作。

⑤、重做日志(Redo Log):记录对于 InnoDB 表的每个写操作,不是 SQL 级别的,而是物理级别的,主要用于崩溃恢复。

⑥、回滚日志(Undo Log,或者叫事务日志):记录数据被修改前的值,用于事务的回滚。

—-这部分是帮助理解 end,面试中可不背—-

请重点说说 binlog?

binlog 是一种物理日志,会在磁盘上记录数据库的所有修改操作。

如果误删了数据,就可以使用 binlog 进行回退到误删之前的状态。

1 | # 步骤1:恢复全量备份 |

如果要搭建主从复制,就可以让从库定时读取主库的 binlog。

MySQL 提供了三种格式的 binlog:Statement、Row 和 Mixed,分别对应 SQL 语句级别、行级别和混合级别,默认为行级别。

从后缀名上来看,binlog 文件分为两类:以 .index 结尾的索引文件,以 .00000* 结尾的二进制日志文件。

binlog 默认是没有启用的。

生产环境中是一定要启用的,可以通过在 my.cnf 文件中配置 log_bin 参数,以启用 binlog。

1 | log_bin = mysql-bin #开启binlog |

binlog 的配置参数都了解哪些?

log_bin = mysql-bin 用于启用 binlog,这样就可以在 MySQL 的数据目录中找到 db-bin.000001、db-bin.000002 等日志文件。max_binlog_size=104857600 用于设置每个 binlog 文件的大小,不建议设置太大,网络传送起来比较麻烦。

当 binlog 文件达到 max_binlog_size 时,MySQL 会关闭当前文件并创建一个新的 binlog 文件。expire_logs_days = 7 用于设置 binlog 文件的自动过期时间为 7 天。过期的 binlog 文件会被自动删除。防止长时间累积的 binlog 文件占用过多存储空间,所以这个配置很重要。binlog-do-db=db_name,指定哪些数据库表的更新应该被记录。binlog-ignore-db=db_name,指定忽略哪些数据库表的更新。sync_binlog=0,设置每多少次 binlog 写操作会触发一次磁盘同步操作。默认值为 0,表示 MySQL 不会主动触发同步操作,而是依赖操作系统的磁盘缓存策略。

即当执行写操作时,数据会先写入缓存,当缓存区满了再由操作系统将数据一次性刷入磁盘。

如果设置为 1,表示每次 binlog 写操作后都会同步到磁盘,虽然可以保证数据能够及时写入磁盘,但会降低性能。

可以通过 show variables like '%log_bin%'; 查看 binlog 是否开启。

有了binlog为什么还要undolog redolog?

binlog 属于 Server 层,与存储引擎无关,无法直接操作物理数据页。而 redo log 和 undo log 是 InnoDB 存储引擎实现 ACID的基石。

————–ps————-

ACID:

- **原子性(Atomicity)**:

事务是一个不可分割的工作单位,事务中的操作要么全部成功,要么全部失败回滚

通过undo log实现,记录事务开始前的状态,用于回滚 - **一致性(Consistency)**:

事务执行前后,数据库从一个一致状态转变为另一个一致状态

通过其他三个特性(AID)共同保证 - **隔离性(Isolation)**:

多个并发事务执行时,一个事务的执行不应影响其他事务

通过锁机制和MVCC(多版本并发控制)实现 - **持久性(Durability)**:

事务一旦提交,其结果就是永久性的

通过redo log实现,即使系统崩溃也能恢复数据

————–ps————-

binlog 关注的是逻辑变更的全局记录;redo log 用于确保物理变更的持久性,确保事务最终能够刷盘成功;undo log 是逻辑逆向操作日志,记录的是旧值,方便恢复到事务开始前的状态。

另外一种回答方式。

binlog 会记录整个 SQL 或行变化;redo log 是为了恢复已提交但未刷盘的数据,undo log 是为了撤销未提交的事务。

以一次事务更新为例:

1 | # 开启事务 |

事务开始的时候会生成 undo log,记录更新前的数据,比如原值是 18:

undo log: id=1, age=18

修改数据的时候,会将数据写入到 redo log。

比如数据页 page_id=123 上,id=1 的用户被更新为 age=26:

redo log (prepare):

page_id=123, offset=0x40, before=18, after=26

等事务提交的时候,redo log 刷盘,binlog 刷盘。

binlog 写完之后,redo log 的状态会变为 commit:

redo log (commit):

page_id=123, offset=0x40, before=18, after=26

binlog 如果是 Statement 格式,会记录一条 SQL 语句:

UPDATE users SET age = age + 1 WHERE id = 1;

binlog 如果是 Row 格式,会记录:

1 | 表:users |

随后,后台线程会将 redo log 中的变更异步刷新到磁盘。

详细探究一下binlog(长文警告⚠️):

MySQL 的 Binlog 日志是一种二进制格式的日志,Binlog 记录所有的 DDL 和 DML 语句(除了数据查询语句SELECT、SHOW等),以 Event 的形式记录,同时记录语句执行时间。

Binlog 的主要作用有两个:

1. 数据恢复:

因为 Binlog 详细记录了所有修改数据的 SQL,当某一时刻的数据误操作而导致出问题,或者数据库宕机数据丢失,那么可以根据 Binlog 来回放历史数据。

2. 主从复制:

想要做多机备份的业务,可以去监听当前写库的 Binlog 日志,同步写库的所有更改。

Binlog 包括两类文件:二进制日志索引文件(.index):记录所有的二进制文件。二进制日志文件(.00000*):记录所有 DDL 和 DML 语句事件。

Binlog 日志功能默认是开启的,线上情况下 Binlog 日志的增长速度是很快的,在 MySQL 的配置文件 my.cnf 中提供一些参数来对 Binlog 进行设置。

1 | #设置此参数表示启用binlog功能,并制定二进制日志的存储目录 |

需要注意的是:max_binlog_size :Binlog 最大和默认值是 1G,该设置并不能严格控制 Binlog 的大小,尤其是 Binlog 比较靠近最大值而又遇到一个比较大事务时,为了保证事务的完整性不可能做切换日志的动作,只能将该事务的所有 SQL 都记录进当前日志直到事务结束。所以真实文件有时候会大于 max_binlog_size 设定值。expire_logs_days :Binlog 过期删除不是服务定时执行,是需要借助事件触发才执行,事件包括:

- 服务器重启

- 服务器被更新

- 日志达到了最大日志长度 max_binlog_size

- 日志被刷新

二进制日志由配置文件的 log-bin 选项负责启用,MySQL 服务器将在数据根目录创建两个新文件mysql-bin.000001 和 mysql-bin.index,若配置选项没有给出文件名,MySQL 将使用主机名称命名这两个文件,其中 .index 文件包含一份全体日志文件的清单。

sync_binlog:这个参数决定了 Binlog 日志的更新频率。默认 0 ,表示该操作由操作系统根据自身负载自行决定多久写一次磁盘。

sync_binlog = 1 表示每一条事务提交都会立刻写盘。sync_binlog=n 表示 n 个事务提交才会写盘。

根据 MySQL 文档,写 Binlog 的时机是:SQL transaction 执行完,但任何相关的 Locks 还未释放或事务还未最终 commit 前。这样保证了 Binlog 记录的操作时序与数据库实际的数据变更顺序一致。

检查 Binlog 文件是否已开启:

1 | mysql> show variables like '%log_bin%'; |

MySQL 会把用户对所有数据库的内容和结构的修改情况记入 mysql-bin.n 文件,而不会记录 SELECT 和没有实际更新的 UPDATE 语句。

如果你不知道现在有哪些 Binlog 文件,可以使用如下命令:

1 | show binary logs; #查看binlog列表 |

Binlog 文件是二进制文件,强行打开看到的必然是乱码,MySQL 提供了命令行的方式来展示 Binlog 日志:

1 | mysqlbinlog mysql-bin.000002 | more |

mysqlbinlog 命令即可查看。

虽然看起来凌乱其实也有迹可循。Binlog 通过事件的方式来管理日志信息,可以通过 show binlog events in 的语法来查看当前 Binlog 文件对应的详细事件信息。

1 | mysql> show binlog events in 'mysql-bin.000001'; |

这是一份没有任何写入数据的 Binlog 日志文件。Binlog 的版本是V4,可以看到日志的结束时间为 Stop。出现 Stop event 有两种情况:

- 是 master shut down 的时候会在

Binlog文件结尾出现 - 是备机在关闭的时候会写入

relay log结尾,或者执行RESET SLAVE命令执行

本文出现的原因是我有手动停止过 MySQL 服务。

一般来说一份正常的 Binlog 日志文件会以 Rotate event 结束。当 Binlog 文件超过指定大小,Rotate event 会写在文件最后,指向下一个 Binlog 文件。

我们来看看有过数据操作的 Binlog 日志文件是什么样子的。

1 | mysql> show binlog events in 'mysql-bin.000002'; |

上面是没有任何数据操作且没有被截断的 Binlog。接下来我们插入一条数据,再看看 Binlog 事件。

1 | mysql> show binlog events in 'mysql-bin.000002'; |

这是加入一条数据之后的 Binlog 事件。

我们对 event 查询的数据行关键字段来解释一下:

Pos:当前事件的开始位置,每个事件都占用固定的字节大小,结束位置(End_log_position)减去Pos,就是这个事件占用的字节数。

上面的日志中我们能看到,第一个事件位置并不是从 0 开始,而是从 4。MySQL 通过文件中的前 4 个字节,来判断这是不是一个 Binlog 文件。这种方式很常见,很多格式的文件,如 pdf、doc、jpg等,都会通常前几个特定字符判断是否是合法文件。Event_type:表示事件的类型Server_id:表示产生这个事件的 MySQL server_id,通过设置 my.cnf 中的 server-id 选项进行配置End_log_position:下一个事件的开始位置Info:包含事件的具体信息

Binlog 日志格式:

针对不同的使用场景,Binlog 也提供了可定制化的服务,提供了三种模式来提供不同详细程度的日志内容。

Statement模式:基于SQL语句的复制(statement-based replication-SBR)Row模式:基于行的复制(row-based replication-RBR)Mixed模式:混合模式复制(mixed-based replication-MBR)

Statement 模式

保存每一条修改数据的SQL。

该模式只保存一条普通的SQL语句,不涉及到执行的上下文信息。

因为每台 MySQL 数据库的本地环境可能不一样,那么对于依赖到本地环境的函数或者上下文处理的逻辑 SQL 去处理的时候可能同样的语句在不同的机器上执行出来的效果不一致。

比如像 sleep()函数,last_insert_id()函数,等等,这些都跟特定时间的本地环境有关。Row 模式

MySQL V5.1.5 版本开始支持Row模式的 Binlog,它与 Statement 模式的区别在于它不保存具体的 SQL 语句,而是记录具体被修改的信息。

比如一条 update 语句更新10条数据,如果是 Statement 模式那就保存一条 SQL 就够,但是 Row 模式会保存每一行分别更新了什么,有10条数据。

Row 模式的优缺点就很明显了。保存每一个更改的详细信息必然会带来存储空间的快速膨胀,换来的是事件操作的详细记录。所以要求越高代价越高。Mixed 模式

Mixed 模式即以上两种模式的综合体。既然上面两种模式分别走了极简和一丝不苟的极端,那是否可以区分使用场景的情况下将这两种模式综合起来呢?

在 Mixed 模式中,一般的更新语句使用 Statement 模式来保存 Binlog,但是遇到一些函数操作,可能会影响数据准确性的操作则使用 Row 模式来保存。这种方式需要根据每一条具体的 SQL 语句来区分选择哪种模式。

MySQL 从 V5.1.8 开始提供 Mixed 模式,V5.7.7 之前的版本默认是Statement 模式,之后默认使用Row模式, 但是在 8.0 以上版本已经默认使用 Mixed 模式了。

查询当前 Binlog 日志使用格式:

1 | mysql> show global variables like '%binlog_format%'; |

如何通过 mysqlbinlog 命令手动恢复数据

上面说过每一条 event 都有位点信息,如果我们当前的 MySQL 库被无操作或者误删除了,那么该如何通过 Binlog 来恢复到删除之前的数据状态呢?

首先发现误操作之后,先停止 MySQL 服务,防止继续更新。

接着通过 mysqlbinlog命令对二进制文件进行分析,查看误操作之前的位点信息在哪里。

接下来肯定就是恢复数据,当前数据库的数据已经是错的,那么就从开始位置到误操作之前位点的数据肯定的都是正确的;如果误操作之后也有正常的数据进来,这一段时间的位点数据也要备份。

比如说:

误操作的位点开始值为 501,误操作结束的位置为705,之后到800的位点都是正确数据。

那么从 0 - 500 ,706 - 800 都是有效数据,接着我们就可以进行数据恢复了。

先将数据库备份并清空。

接着使用 mysqlbinlog 来恢复数据:

0 - 500 的数据:

1 | mysqlbinlog --start-position=0 --stop-position=500 bin-log.000003 > /root/back.sql; |

上面命令的作用就是将 0 -500 位点的数据恢复到自定义的 SQL 文件中。同理 706 - 800 的数据也是一样操作。之后我们执行这两个 SQL 文件就行了。

Binlog 事件类型

上面我们说到了 Binlog 日志中的事件,不同的操作会对应着不同的事件类型,且不同的 Binlog 日志模式同一个操作的事件类型也不同,下面我们一起看看常见的事件类型。

首先我们看看源码中的事件类型定义:

源码位置:/libbinlogevents/include/binlog_event.h

1 | enum Log_event_type |

这么多的事件类型我们就不一一介绍,挑出来一些常用的来看看。FORMAT_DESCRIPTION_EVENTFORMAT_DESCRIPTION_EVENT 是 Binlog V4 中为了取代之前版本中的 START_EVENT_V3 事件而引入的。它是 Binlog 文件中的第一个事件,而且,该事件只会在 Binlog 中出现一次。MySQL 根据 FORMAT_DESCRIPTION_EVENT 的定义来解析其它事件。

它通常指定了 MySQL 的版本,Binlog 的版本,该 Binlog 文件的创建时间。

QUERY_EVENT

QUERY_EVENT 类型的事件通常在以下几种情况下使用:

事务开始时,执行的 BEGIN 操作

STATEMENT 格式中的 DML 操作

ROW 格式中的 DDL 操作

比如上文我们插入一条数据之后的 Binlog 日志:

1 | mysql> show binlog events in 'mysql-bin.000002'; |

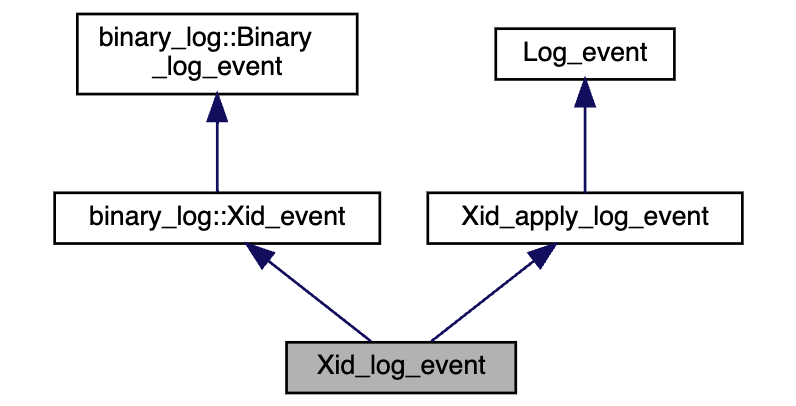

XID_EVENT

在事务提交时,不管是 STATEMENT 还 是ROW 格式的 Binlog,都会在末尾添加一个 XID_EVENT 事件代表事务的结束。该事件记录了该事务的 ID,在 MySQL 进行崩溃恢复时,根据事务在 Binlog 中的提交情况来决定是否提交存储引擎中状态为 prepared 的事务。ROWS_EVENT

对于 ROW 格式的 Binlog,所有的 DML 语句都是记录在 ROWS_EVENT 中。ROWS_EVENT分为三种:WRITE_ROWS_EVENTUPDATE_ROWS_EVENTDELETE_ROWS_EVENT

分别对应 insert,update 和 delete 操作。

对于 insert 操作,WRITE_ROWS_EVENT 包含了要插入的数据。

对于 update 操作,UPDATE_ROWS_EVENT 不仅包含了修改后的数据,还包含了修改前的值。

对于 delete 操作,仅仅需要指定删除的主键(在没有主键的情况下,会给定所有列)。

对比 QUERY_EVENT 事件,是以文本形式记录 DML 操作的。而对于 ROWS_EVENT 事件,并不是文本形式,所以在通过 mysqlbinlog 查看基于 ROW 格式的 Binlog 时,需要指定 -vv –base64-output=decode-rows。

我们来测试一下,首先将日志格式改为 Rows:

1 | mysql> set binlog_format=row; |

然后刷新一下日志文件,重新开始一个 Binlog 日志。我们插入一条数据之后看一下日志:

1 | mysql> show binlog events in 'binlog.000008'; |

说说 redo log 的工作机制?

当事务启动时,MySQL 会为该事务分配一个唯一标识符。

在事务执行过程中,每次对数据进行修改,MySQL 都会生成一条 Redo Log,记录修改前后的数据状态。

这些 Redo Log 首先会被写入内存中的 Redo Log Buffer。

当事务提交时,MySQL 再将 Redo Log Buffer 中的记录刷新到磁盘上的 Redo Log 文件中。

只有当 Redo Log 成功写入磁盘,事务才算真正提交成功。

当 MySQL 崩溃重启时,会先检查 Redo Log。对于已提交的事务,MySQL 会重放 Redo Log 中的记录。

对于未提交的事务,MySQL 会通过 Undo Log 回滚这些修改,确保数据恢复到崩溃前的一致性状态。Redo Log 是循环使用的,当文件写满后会覆盖最早的记录。

为避免覆盖未持久化的记录,MySQL 会定期执行 CheckPoint 操作,将内存中的数据页刷新到磁盘,并记录 CheckPoint 点。

重启时,MySQL 只会重放 CheckPoint 之后的 Redo Log,从而提高恢复效率。

省流版:

- 事务开始

- 记录undo log(旧数据)

- 修改Buffer Pool中的数据

- 写入redo log(prepare状态)

- 写入binlog

- 提交事务(redo log标记为commit)

- 后台异步刷脏页到磁盘

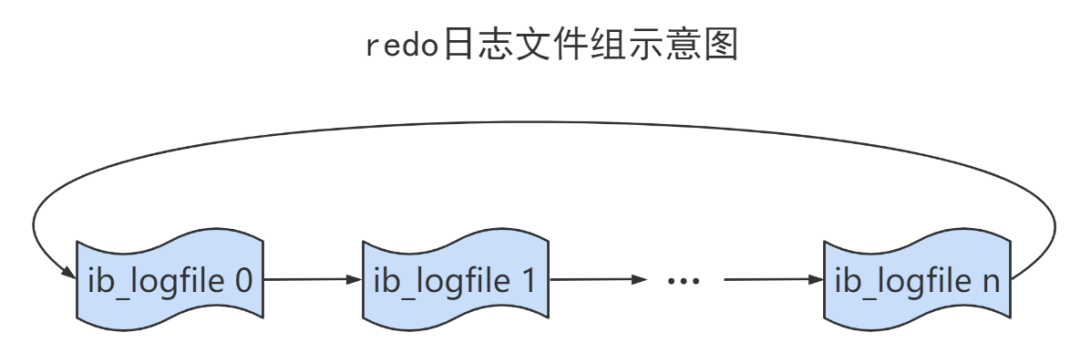

redo log 文件的大小是固定的吗?

redo log 文件是固定大小的,通常配置为一组文件,使用环形方式写入,旧的日志会在空间需要时被覆盖。

命名方式为 ib_logfile0、iblogfile1、、、iblogfilen。默认 2 个文件,每个文件大小为 48MB。

可以通过 show variables like 'innodb_log_file_size'; 查看 redo log 文件的大小;通过 show variables like 'innodb_log_files_in_group'; 查看 redo log 文件的数量。

说一说WAL?

WAL——Write-Ahead Logging。

预写日志是 InnoDB 实现事务持久化的核心机制,它的思想是:先写日志再刷磁盘。

即在修改数据页之前,先将修改记录写入 Redo Log。

这样的话,即使数据页尚未写入磁盘,系统崩溃时也能通过 Redo Log 恢复数据。

—-这部分是帮助理解 start,面试中可不背—-

解释一下为什么需要 WAL:

数据最终是要写入磁盘的,但磁盘 IO 很慢;

如果每次更新都立刻把数据页刷盘,性能很差;

如果还没写入磁盘就宕机,事务会丢失。

WAL 的好处是更新时不直接写数据页,而是先写一份变更记录到 redo log,后台再慢慢把真正的数据页刷盘,一举多得。

—-这部分是帮助理解 end,面试中可不背—-

30.🌟为什么要两阶段提交?

为了保证 redo log 和 binlog 中的数据一致性,防止主从复制和事务状态不一致。

为什么 2PC 能保证 redo log 和 binlog 的强⼀致性?

假如 MySQL 在预写 redo log 之后、写入 binlog 之前崩溃。那么 MySQL 重启后 InnoDB 会回滚该事务,因为 redo log 不是提交状态。并且由于 binlog 中没有写入数据,所以从库也不会有该事务的数据。

假如 MySQL 在写入 binlog 之后、redo log 提交之前崩溃。那么 MySQL 重启后 InnoDB 会提交该事务,因为 redo log 是提交状态。并且由于 binlog 中有写入数据,所以从库也会同步到该事务的数据。

伪代码如下:

1 | // 事务开始 |

XID 了解吗?

XID 是 binlog 中用来标识事务提交的唯一标识符。

在事务提交时,会写入一个 XID_EVENT 到 binlog,表示这个事务真正完成了。

1 | Log_name | Pos | Event_type | Server_id | End_log_pos | Info |

它不仅用于主从复制中事务完整性的判断,也在崩溃恢复中对 redo log 和 binlog 的一致性校验起到关键作用。

XID 可以帮助 MySQL 判断哪些 redo log 是已提交的,哪些是未提交需要回滚的,是两阶段提交机制中非常关键的一环。

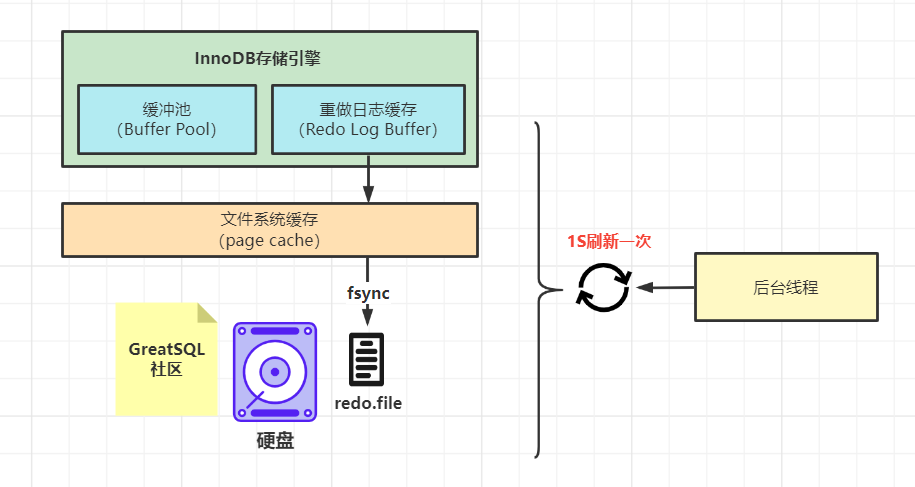

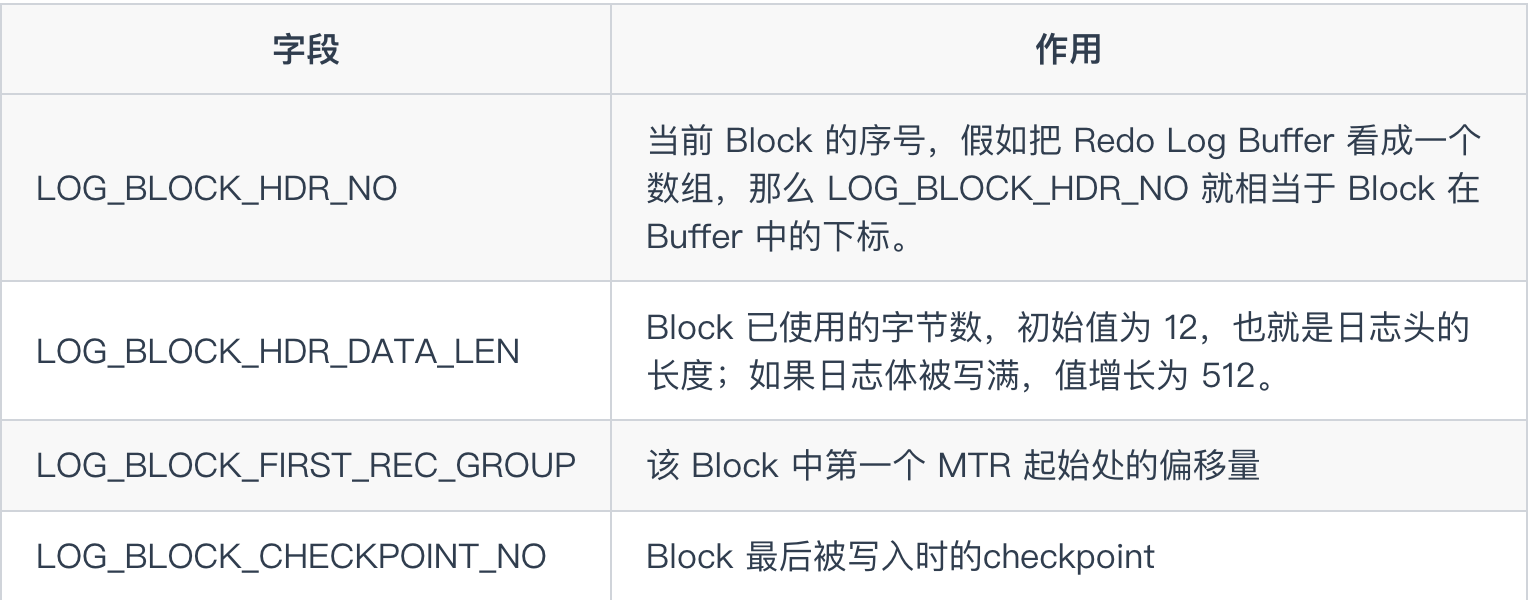

31.🌟redo log 的写入过程了解吗?

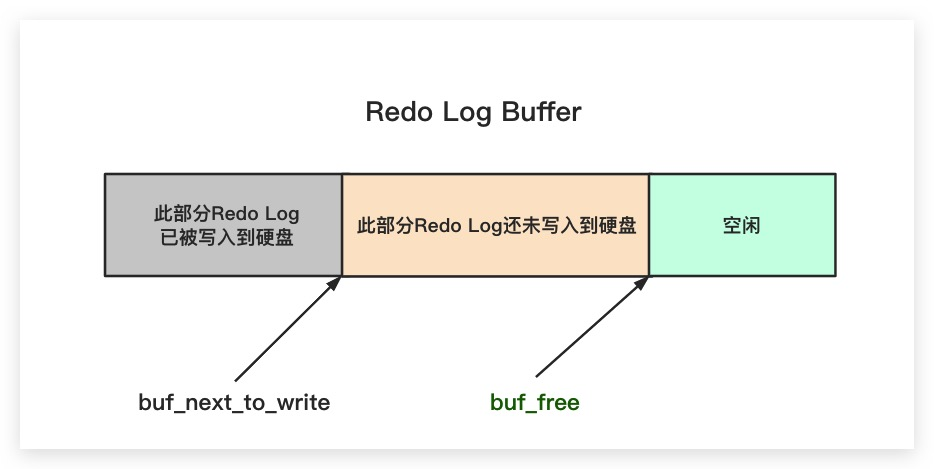

InnoDB 会先将 Redo Log 写入内存中的 Redo Log Buffer,之后再以一定的频率刷入到磁盘的 Redo Log File 中。

哪些场景会触发 redo log 的刷盘动作?

比如说 Redo Log Buffer 的空间不足时,事务提交时,触发 Checkpoint 时,后台线程定期刷盘时。

不过,Redo Log Buffer 刷盘到 Redo Log File 还会涉及到操作系统的磁盘缓存策略,可能不会立即刷盘,而是等待一定时间后才刷盘。

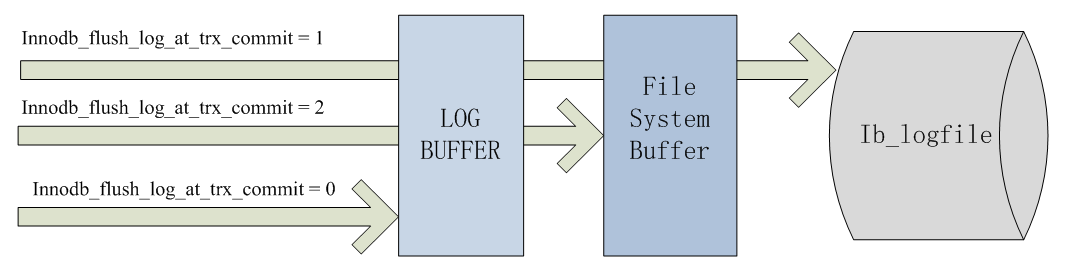

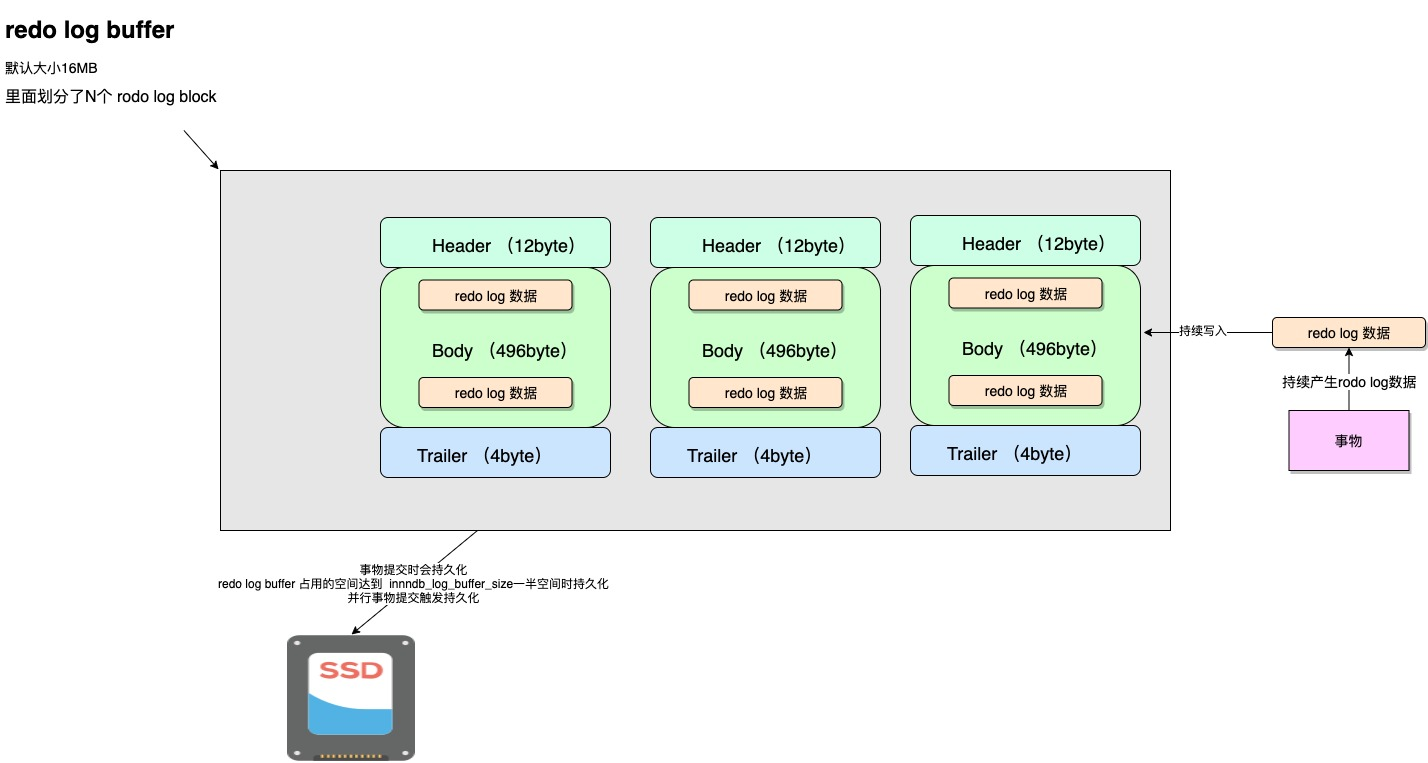

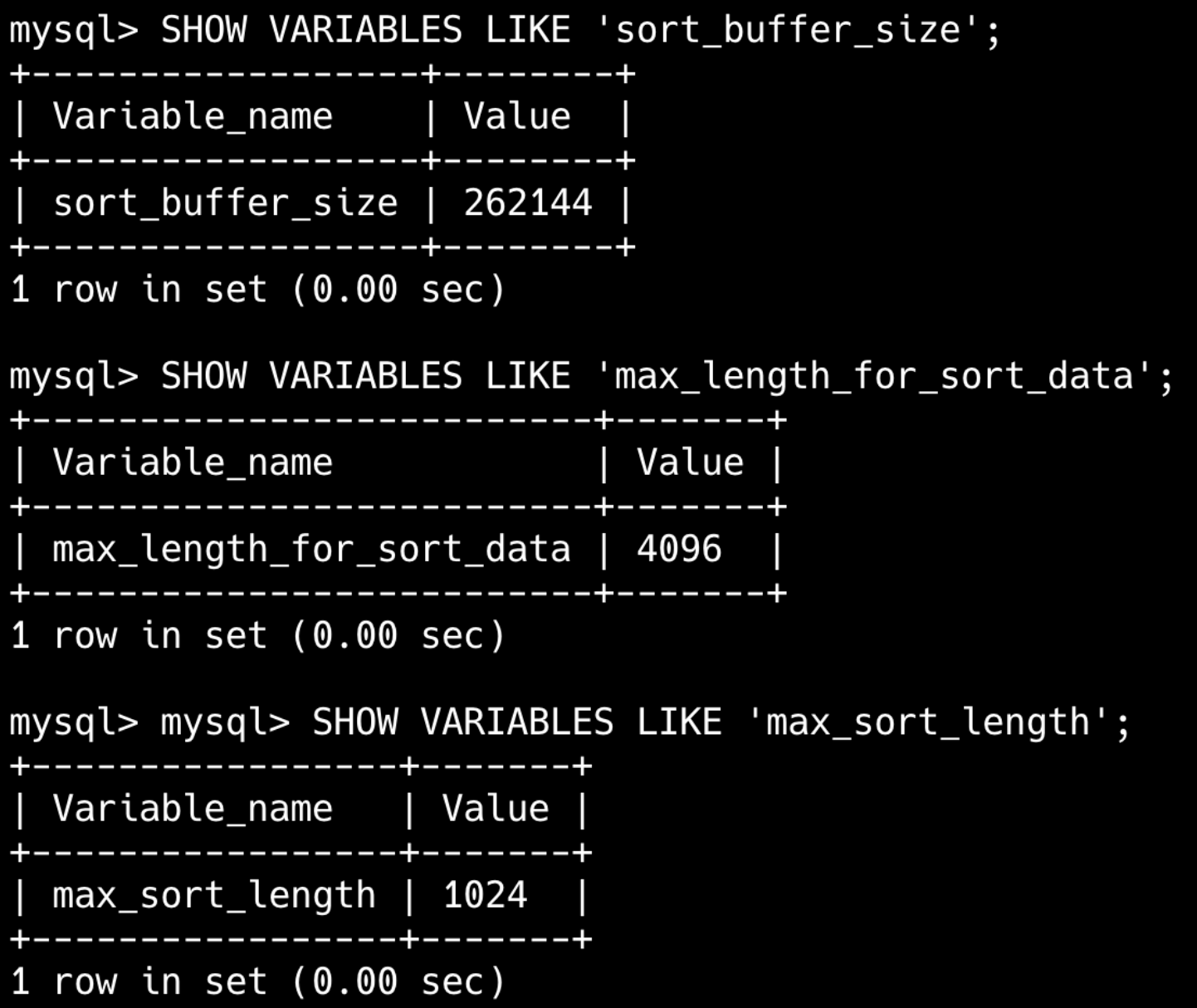

innodb_flush_log_at_trx_commit 参数你了解多少?

innodb_flush_log_at_trx_commit 参数是用来控制事务提交时,Redo Log 的刷盘策略,一共有三种。

0 表示事务提交时不刷盘,而是交给后台线程每隔 1 秒执行一次。这种方式性能最好,但是在 MySQL 宕机时可能会丢失一秒内的事务。

1 表示事务提交时会立即刷盘,确保事务提交后数据就持久化到磁盘。这种方式是最安全的,也是 InnoDB 的默认值。

2 表示事务提交时只把 Redo Log Buffer 写入到 Page Cache,由操作系统决定什么时候刷盘。操作系统宕机时,可能会丢失一部分数据。

一个没有提交事务的 redo log,会不会刷盘?

InnoDB 有一个后台线程,每隔 1 秒会把Redo Log Buffer中的日志写入到文件系统的缓存中,然后调用刷盘操作。

因此,一个没有提交事务的 Redo Log 也可能会被刷新到磁盘中。

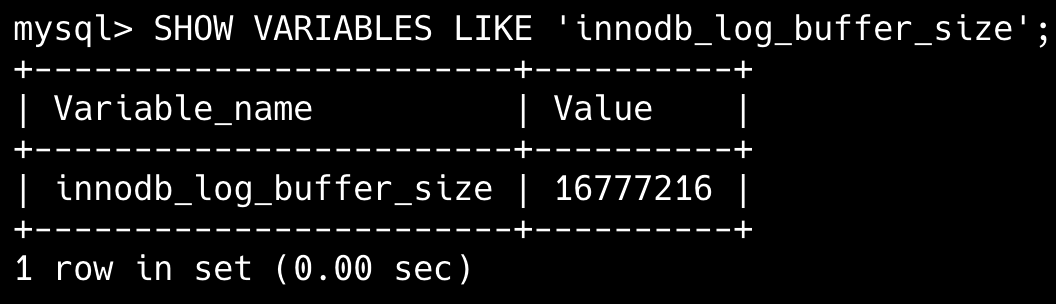

另外,如果当 Redo Log Buffer 占用的空间即将达到 innodb_log_buffer_size 的一半时,也会触发刷盘操作。

Redo Log Buffer 是顺序写还是随机写?

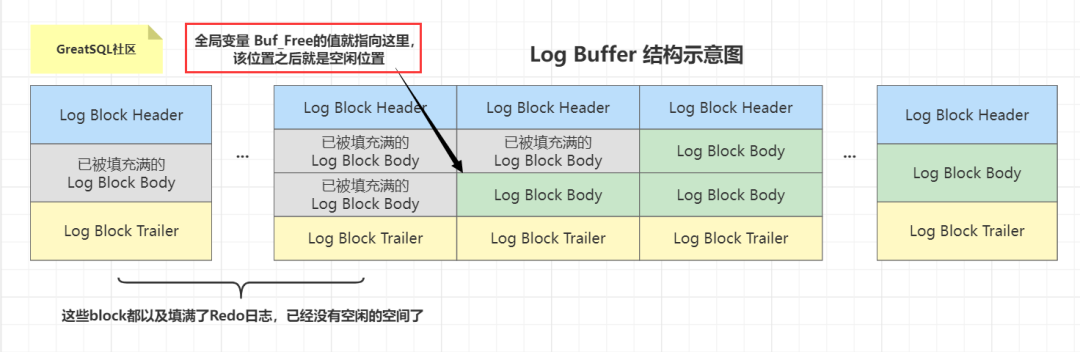

MySQL 在启动后会向操作系统申请一块连续的内存空间作为 Redo Log Buffer,并将其分为若干个连续的 Redo Log Block。

那为了提高写入效率,Redo Log Buffer 采用了顺序写入的方式,会先往前面的 Redo Log Block 中写入,当写满后再往后面的 Block 中写入。

于此同时,InnoDB 还提供了一个全局变量 buf_free,来控制后续的 redo log 记录应该写入到 block 中的哪个位置。

buf_next_to_write 了解吗?

buf_next_to_write 指向 Redo Log Buffer 中下一次需要写入硬盘的起始位置。

而 buf_free 指向的是 Redo Log Buffer 中空闲区域的起始位置。

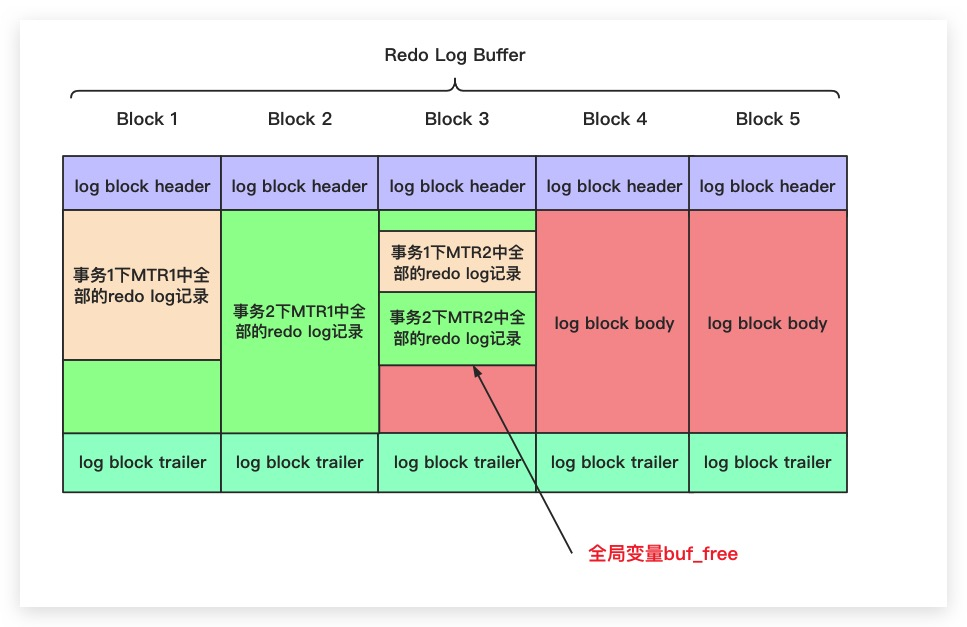

了解 MTR 吗?

Mini Transaction 是 InnoDB 内部用于操作数据页的原子操作单元。

1 | mtr_t mtr; |

多个事务的 Redo Log 会以 MTR 为单位交替写入到 Redo Log Buffer 中,假如事务 1 和事务 2 均有两个 MTR,一旦某个 MTR 结束,就会将其生成的若干条 Redo Log 记录顺序写入到 Redo Log Buffer 中。

也就是说,一个 MTR 会包含一组 Redo Log 记录,是 MySQL 崩溃后恢复事务的最小执行单元。

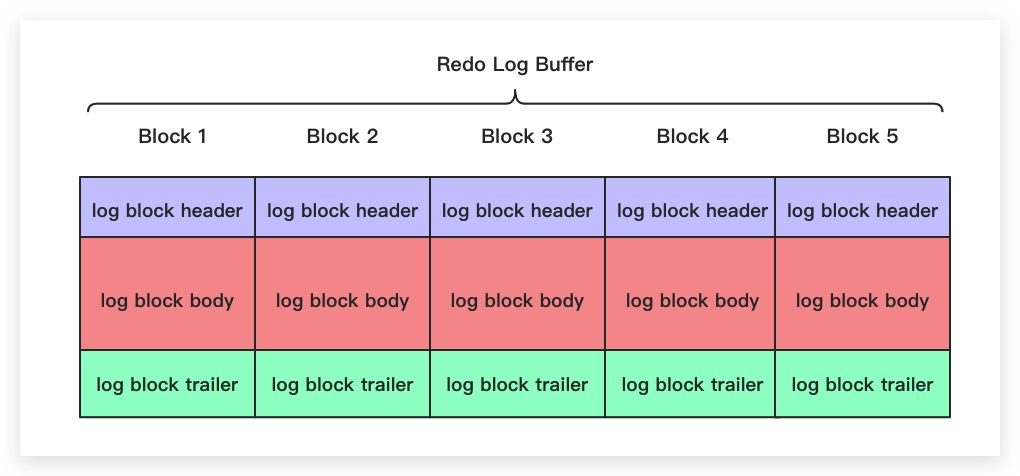

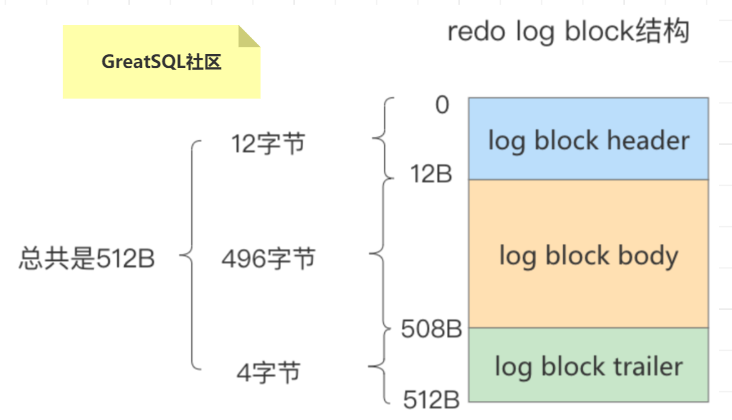

Redo Log Block 的结构了解吗?

Redo Log Block 由日志头、日志体和日志尾组成,一共占用 512 个字节,其中日志头占用 12 个字节,日志尾占用 4 个字节,剩余的 496 个字节用于存储日志体。

日志头包含了当前 Block 的序列号、第一条日志的序列号、类型等信息。

日志尾主要存储的是 LOG_BLOCK_CHECKSUM,也就是 Block 的校验和,主要用于判断 Block 是否完整。

Redo Log Block 为什么设计成 512 字节?

因为机械硬盘的物理扇区大小通常为 512 字节,Redo Log Block 也设计为同样的大小,就可以确保每次写入都是整数个扇区,减少对齐开销。

比如说操作系统的页缓存默认为 4KB,8 个 Redo Log Block 就可以组合成一个页缓存单元,从而提升 Redo Log Buffer 的写入效率。

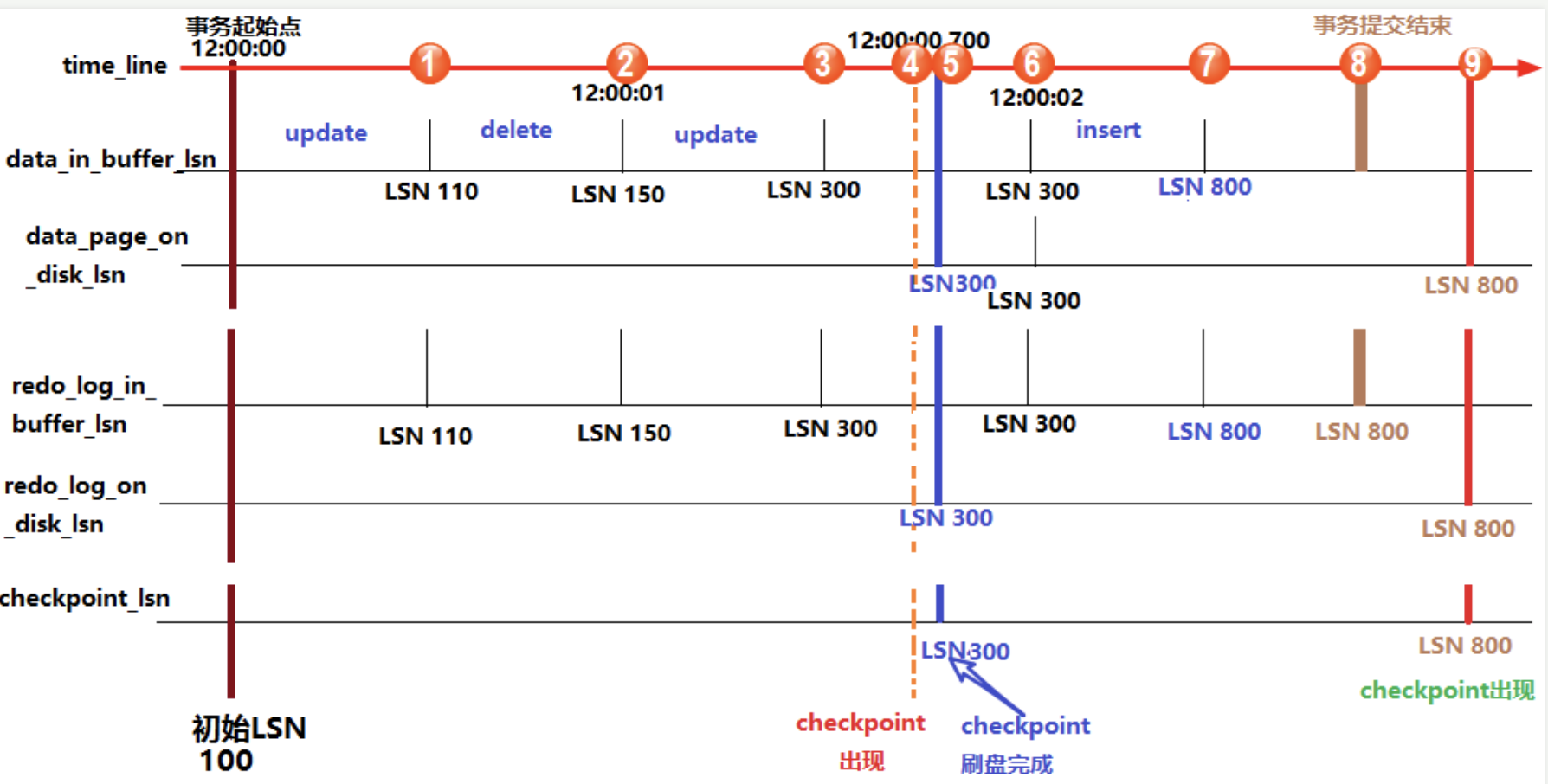

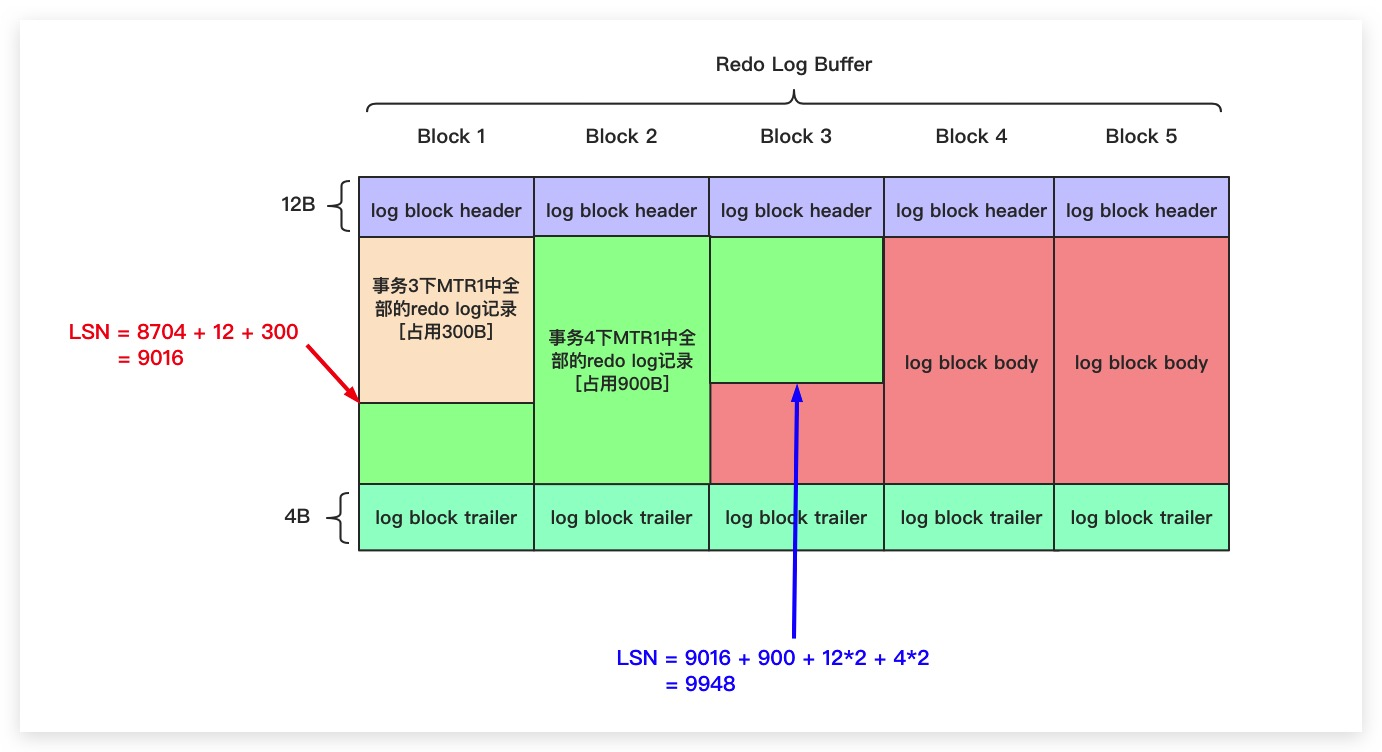

LSN 了解吗?

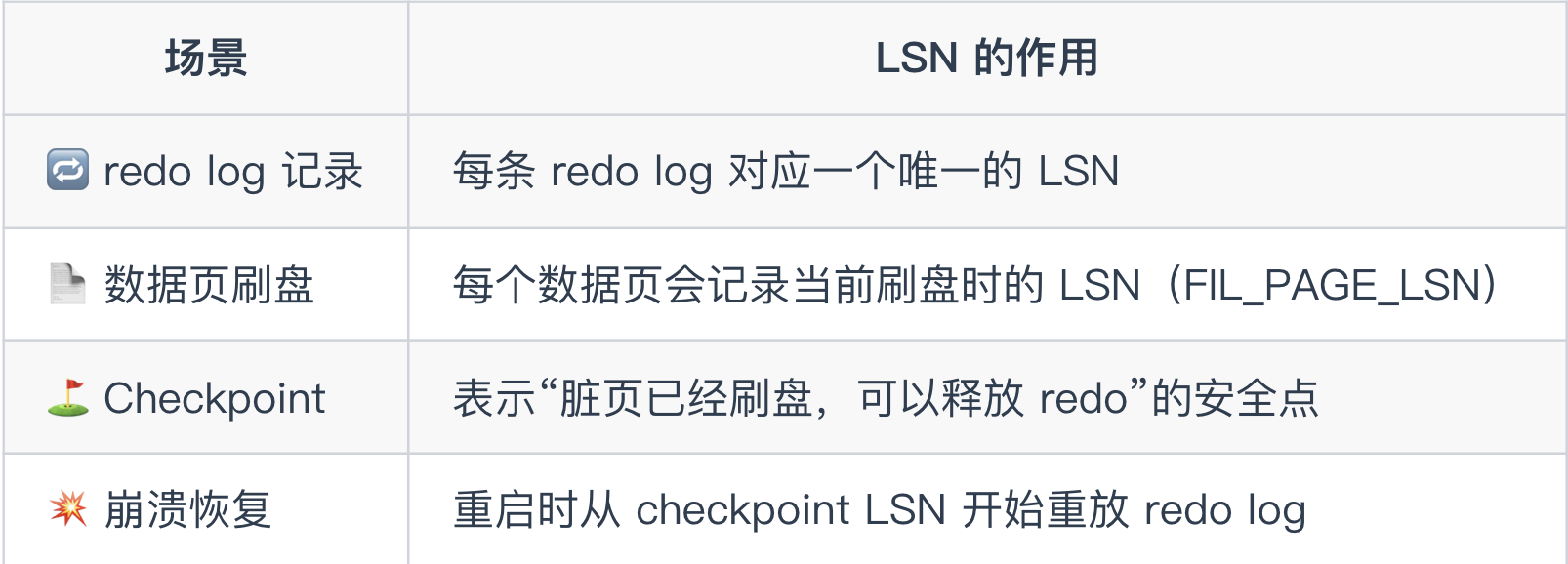

Log Sequence Number 是一个 8 字节的单调递增整数,用来标识事务写入 redo log 的字节总量,存在于 redo log、数据页头部和 checkpoint 中。

—-这部分是帮助理解 start,面试中可不背—-

MySQL 在第一次启动时,LSN 的初始值并不为 0,而是 8704;当 MySQL 再次启动时,会继续使用上一次服务停止时的 LSN。

在计算 LSN 的增量时,不仅需要考虑 log block body 的大小,还需要考虑 log block header 和 log block tail 中部分字节数。

比如说在上图中,事务 3 的 MTR 总量为 300 字节,那么写入到 Redo Log Buffer 中的 LSN 会增长为 8704 + 300 + 12 = 9016。

假如事务 4 的 MTR 总量为 900 字节,那么再次写入到 Redo Log Buffer 中的 LSN 会增长为 9016 + 900 + 122 + 42 = 9948。

2 个 12 字节的 log block header + 2 个 4 字节的 log block tail。

—-这部分是帮助理解 end,面试中可不背—-

核心作用有三个:

第一,redo log 按照 LSN 递增顺序记录所有数据的修改操作。LSN 的递增量等于每次写入日志的字节数。

第二,InnoDB 的每个数据页头部中,都会记录该页最后一次刷新到磁盘时的 LSN。如果数据页的 LSN 小于 redo log 的 LSN,说明该页需要从日志中恢复;否则说明该页已更新。

第三,checkpoint 通过 LSN 记录已刷新到磁盘的数据页位置,减少恢复时需要处理的日志。

—-这部分是帮助理解 start,面试中可不背—-

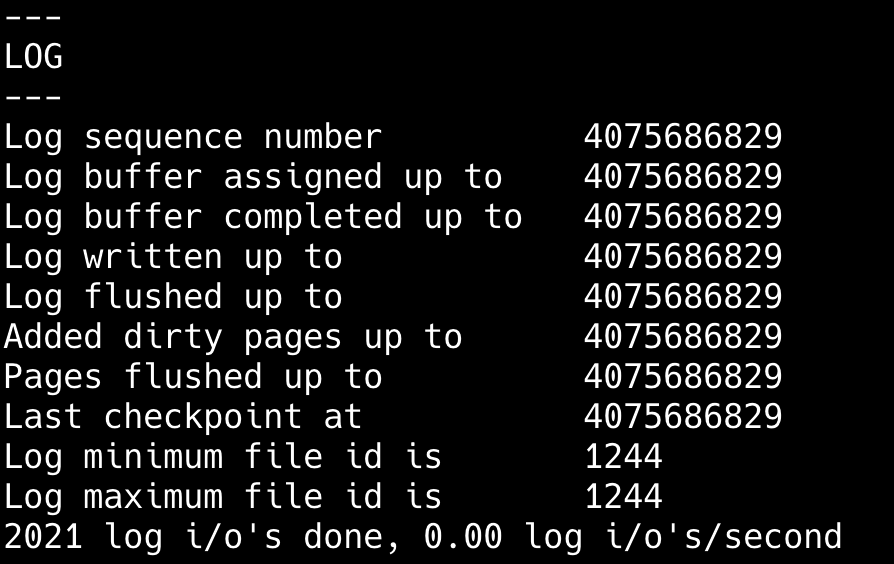

可以通过 show engine innodb status; 查看当前的 LSN 信息。

- Log sequence number:当前系统最大 LSN(已生成的日志总量)。

- Log flushed up to:已写入磁盘的 redo log LSN。

- Pages flushed up to:已刷新到数据页的 LSN。

- Last checkpoint at:最后一次检查点的 LSN,表示已持久化的数据状态。

—-这部分是帮助理解 end,面试中可不背—-

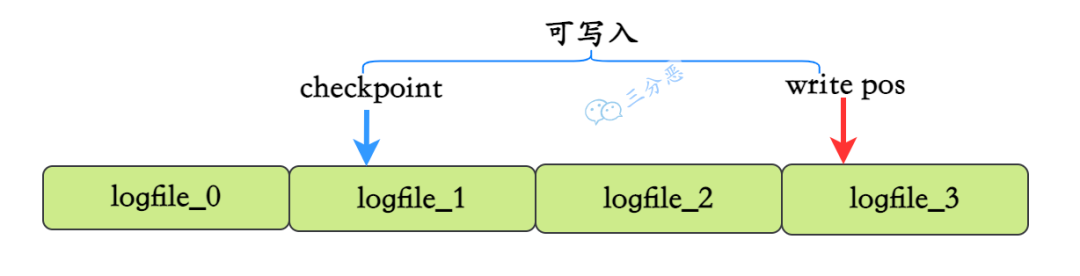

Checkpoint 了解多少?

Checkpoint 是 InnoDB 为了保证事务持久性和回收 redo log 空间的一种机制。

它的作用是在合适的时机将部分脏页刷入磁盘,比如说 buffer pool 的容量不足时。并记录当前 LSN 为 Checkpoint LSN,表示这个位置之前的 redo log file 已经安全,可以被覆盖了。

MySQL 崩溃恢复时只需要从 Checkpoint 之后开始恢复 redo log 就可以了,这样可以最大程度减少恢复所花费的时间。

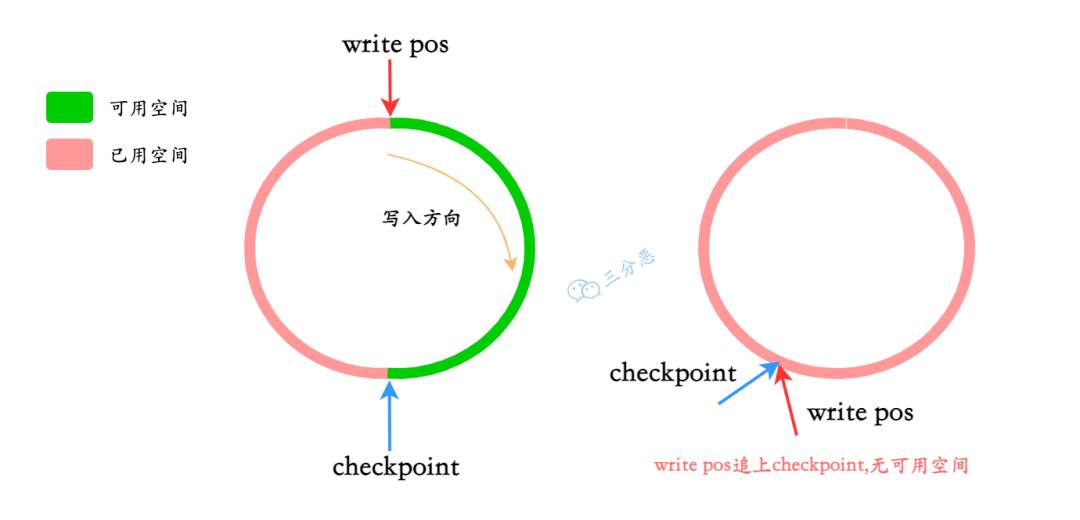

redo log file 的写入是循环的,其中有两个标记位置非常重要,也就是 Checkpoint 和 write pos。

write pos 是 redo log 当前写入的位置,Checkpoint 是可以被覆盖的位置。

当 write pos 追上 Checkpoint 时,表示 redo log 日志已经写满。这时候就要暂停写入并强制刷盘,释放可覆写的日志空间。

关于redo log 的调优参数了解多少?

如果是高并发写入的电商系统,可以最大化写入吞吐量,容忍秒级数据丢失的风险。

1 | innodb_flush_log_at_trx_commit = 2 |

如果是金融交易系统,需要保证数据零丢失,接受较低的吞吐量。

1 | innodb_flush_log_at_trx_commit = 1 |

核心参数一览表:

总结

- 对数据一致性要求高的场景,如金融交易使用innodb_flush_log_at_trx_commit=1,对写入吞吐量敏感的场景,如日志采集可以使用 =2 或 =0,需要结合 sync_binlog 参数

- sync_binlog 参数控制 binlog 的刷盘策略,可以设置为 0、1、N,0 表示依赖系统刷盘,1 表示每次事务提交都刷盘(推荐与 innodb_flush_log_at_trx_commit=1 搭配),N=1000 表示累计 1000 次事务后刷盘

- innodb_redo_log_capacity 动态调整 Redo Log 总容量,可以根据业务负载情况调整,建议设置为 1 小时写入量的峰值(如每秒 10MB 写入则设为 36GB)

- innodb_io_capacity 定义 InnoDB 后台线程的每秒 I/O 操作上限,直接影响脏页刷新速率;机械硬盘建议 200-500,SSD 建议 1000-2000,NVMe SSD 可设为 5000+

- innodb_lru_scan_depth 控制每个缓冲池实例中 LRU 列表的扫描深度,决定每秒可刷新的脏页数量,默认值 1024 适用于多数场景,I/O 密集型负载可适当降低(如 512),减少 CPU 开销。

🌟32.什么是慢 SQL?

拓展阅读: https://juejin.cn/post/7048974570228809741

MySQL 中有一个叫long_query_time的参数,原则上执行时间超过该参数值的 SQL 就是慢 SQL,会被记录到慢查询日志中。

—-这部分是帮助理解 start,面试中可不背—-

可通过 show variables like ‘long_query_time’; 查看当前的 long_query_time 的参数值。

—-这部分是帮助理解 end,面试中可不背—-

SQL 的执行过程了解吗?

SQL 的执行过程大致可以分为六个阶段:连接管理、语法解析、语义分析、查询优化、执行器调度、存储引擎读写等。Server 层负责理解和规划 SQL 怎么执行,存储引擎层负责数据的真正读写。

—-这部分是帮助理解 start,面试中可不背—-

来详细拆解一下:

- 客户端发送 SQL 语句给 MySQL 服务器。

- 如果查询缓存打开则会优先查询缓存,缓存中有对应的结果就直接返回。不过,MySQL 8.0 已经移除了查询缓存。这部分的功能正在被 Redis 等缓存中间件取代。

- 分析器对 SQL 语句进行语法分析,判断是否有语法错误。

- 搞清楚 SQL 语句要干嘛后,MySQL 会通过优化器生成执行计划。

- 执行器调用存储引擎的接口,执行 SQL 语句。

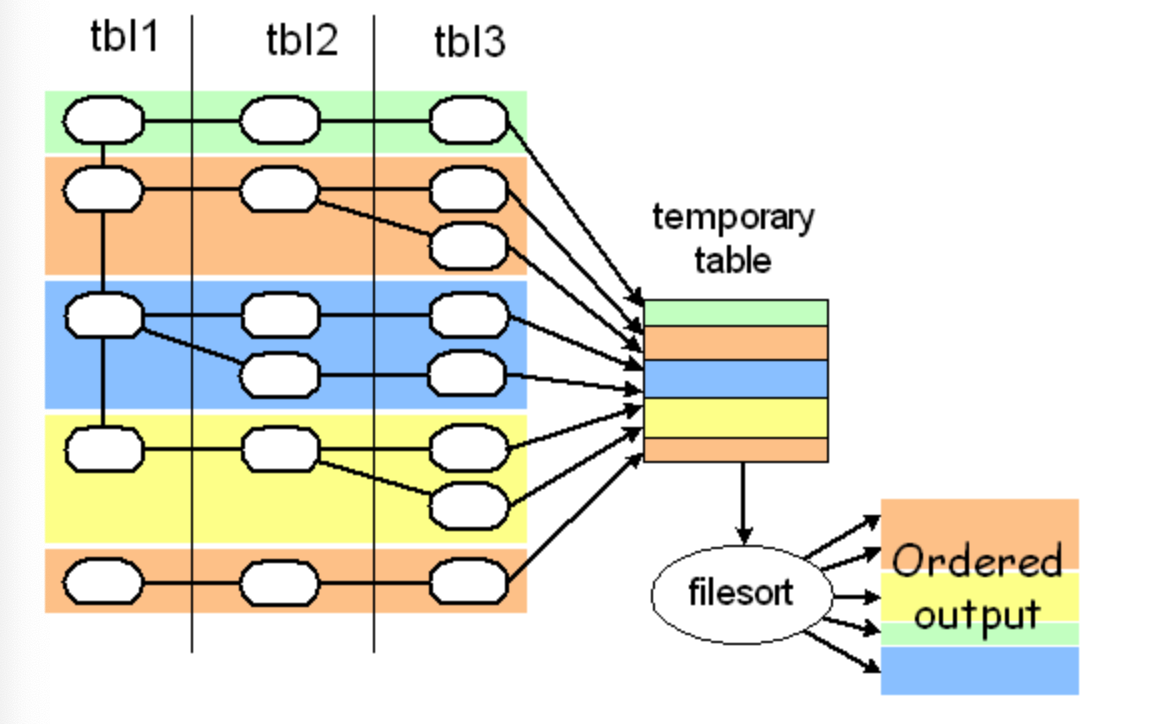

SQL 执行过程中,优化器通过成本计算预估出执行效率最高的方式,基本的预估维度为:

- IO 成本:从磁盘读取数据到内存的开销。

- CPU 成本:CPU 处理内存中数据的开销。

基于这两个维度,可以得出影响 SQL 执行效率的因素有:

①、IO 成本,数据量越大,IO 成本越高。所以要尽量查询必要的字段;尽量分页查询;尽量通过索引加快查询。

②、CPU 成本,尽量避免复杂的查询条件,如有必要,考虑对子查询结果进行过滤。

—-这部分是帮助理解 end,面试中可不背—-

如何优化慢SQL?

首先,需要找到那些比较慢的 SQL,可以通过启用慢查询日志,记录那些超过指定执行时间的 SQL 查询。

也可以使用 show processlist; 命令查看当前正在执行的 SQL 语句,找出执行时间较长的 SQL。

或者在业务基建中加入对慢 SQL 的监控,常见的方案有字节码插桩、连接池扩展、ORM 框架扩展等。

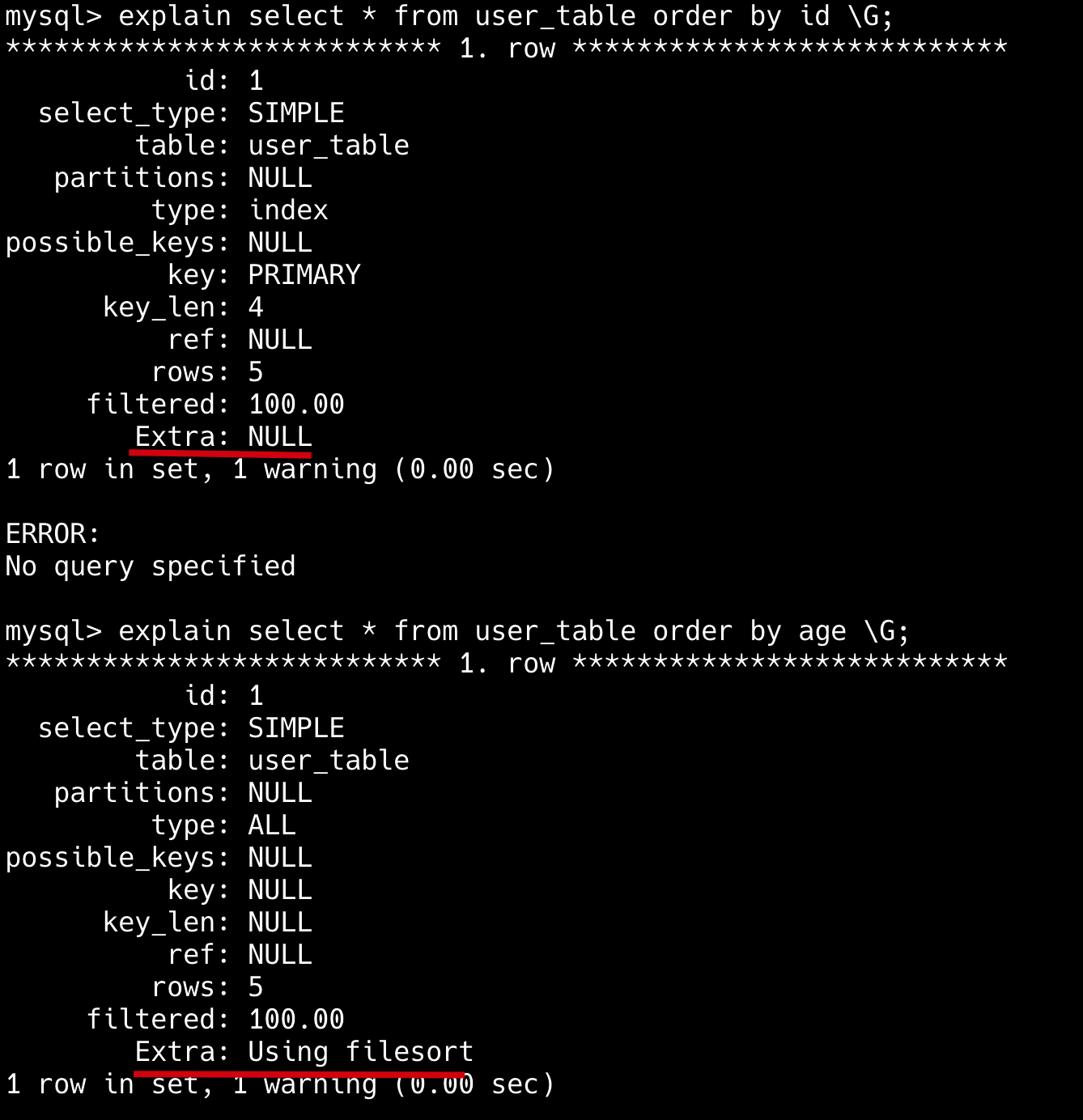

然后,使用 EXPLAIN 查看慢 SQL 的执行计划,看看有没有用索引,大部分情况下,慢 SQL 的原因都是因为没有用到索引。

EXPLAIN SELECT * FROM your_table WHERE conditions;

最后,根据分析结果,通过添加索引、优化查询条件、减少返回字段等方式进行优化。

慢sql日志怎么开启?

编辑 MySQL 的配置文件 my.cnf,设置 slow_query_log 参数为 1。

1 | slow_query_log = 1 |

然后重启 MySQL 就好了。

也可以通过 set global 命令动态设置。

1 | SET GLOBAL slow_query_log = 'ON'; |

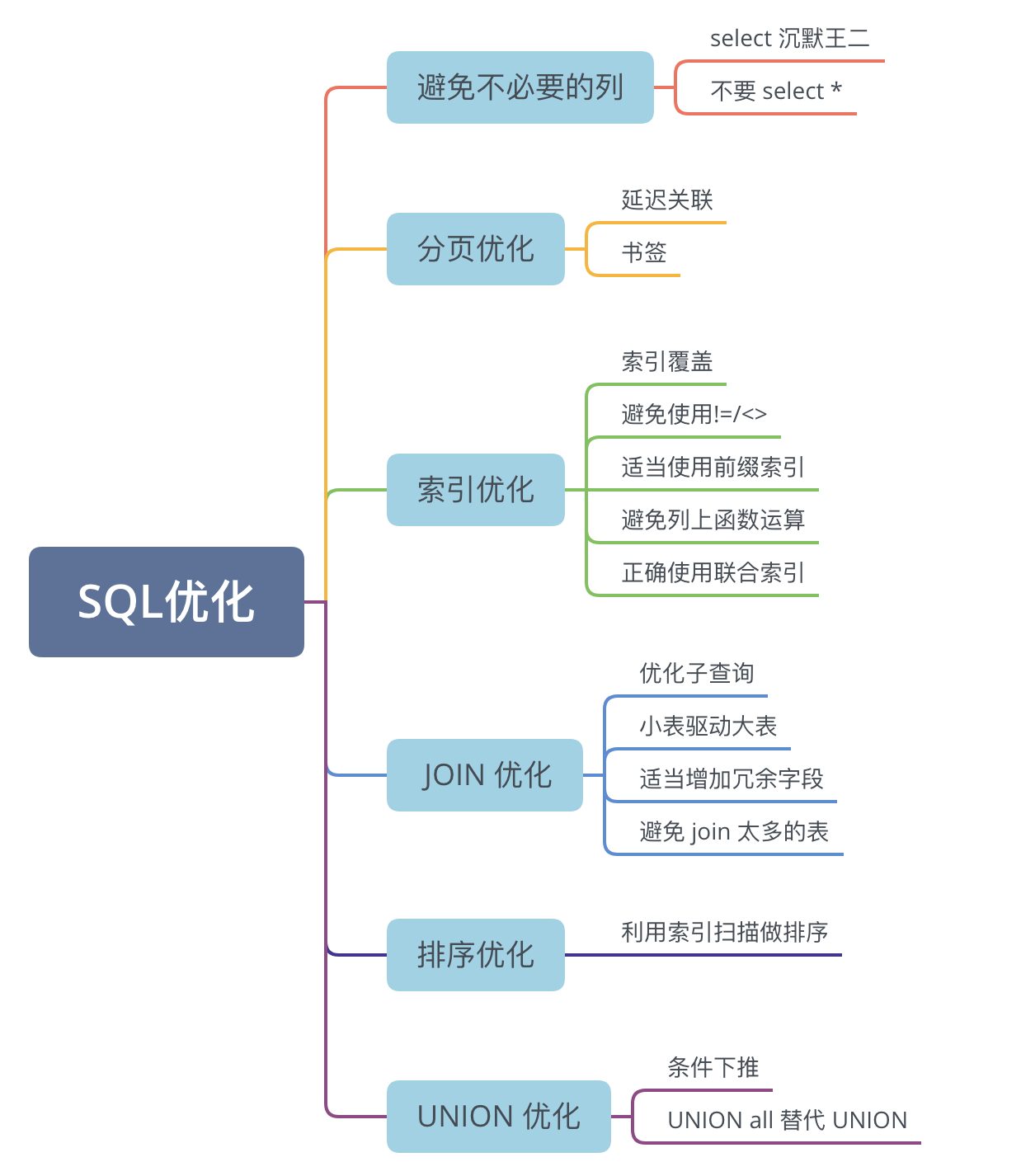

🌟33.你知道哪些方法来优化 SQL?

SQL 优化的方法非常多,但本质上就一句话:尽可能少地扫描、尽快地返回结果。

最常见的做法就是加索引、改写 SQL 让它用上索引,比如说使用覆盖索引、让联合索引遵守最左前缀原则等。

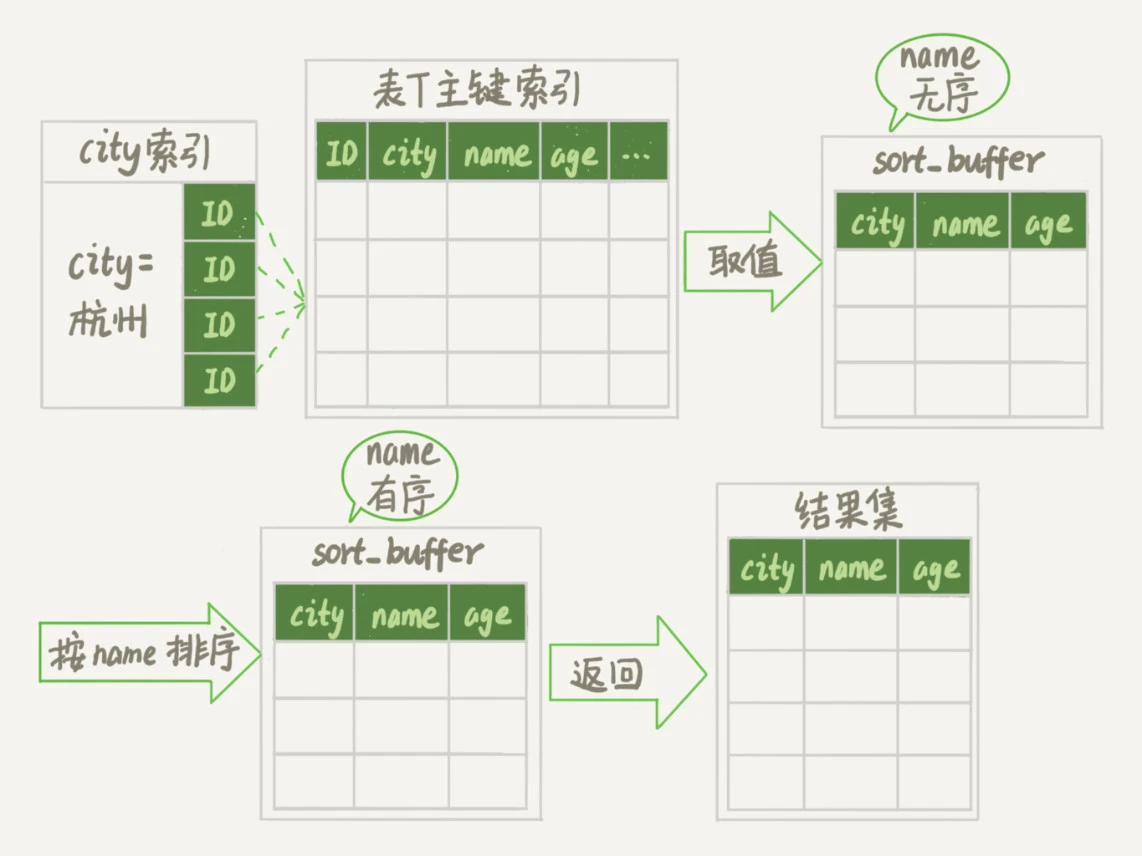

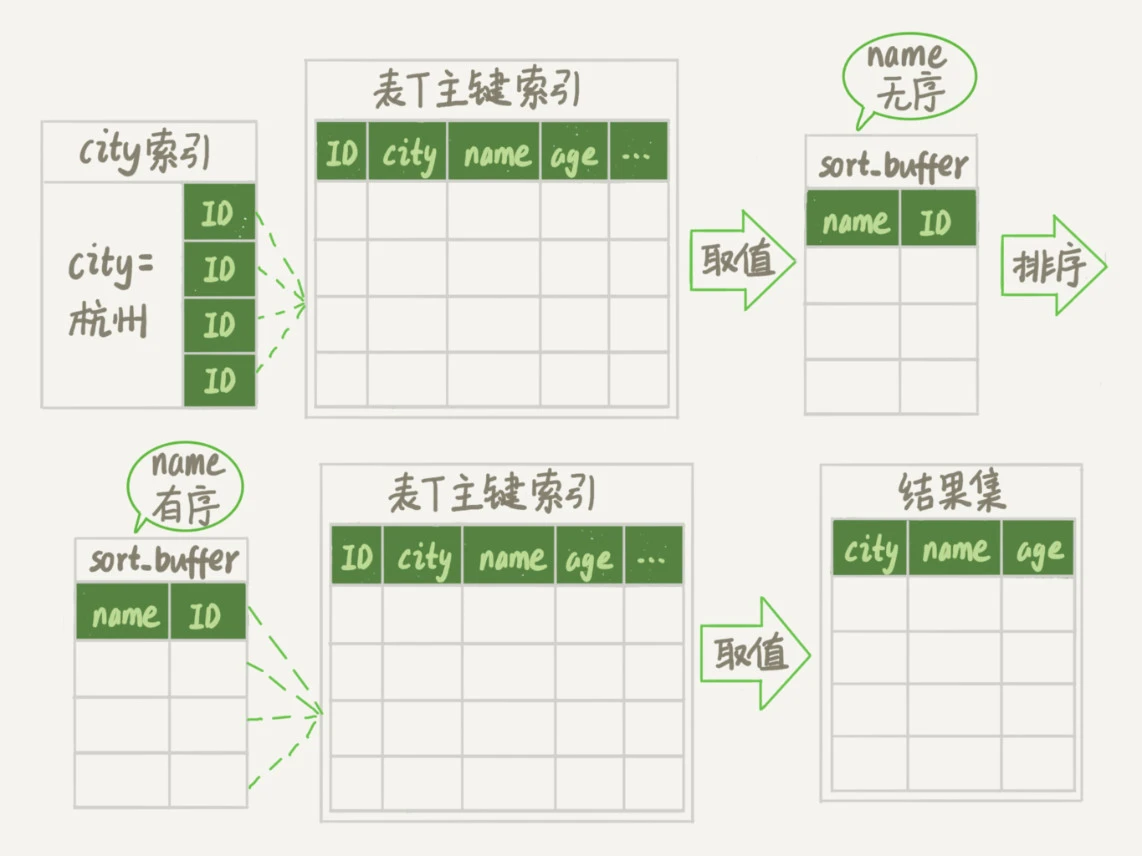

如何利用覆盖索引?

覆盖索引的核心是“查询所需的字段都在同一个索引里”,这样 MySQL 就不需要回表,直接从索引中返回结果。

实际使用中,我会优先考虑把 WHERE 和 SELECT 涉及的字段一起建联合索引,并通过 EXPLAIN 观察结果是否有 Using index,确认命中索引。

—-这部分是帮助理解 start,面试中可不背—-

举个例子,现在要从 test 表中查询 city 为上海的 name 字段。

1 | select name from test where city='上海' |

如果仅在 city 字段上添加索引,那么这条查询语句会先通过索引找到 city 为上海的行,然后再回表查询 name 字段。

为了避免回表查询,可以在 city 和 name 字段上建立联合索引,这样查询结果就可以直接从索引中获取。

1 | alter table test add index index1(city,name); |

相当于利用空间换时间,把查询结果都放到了索引里,不需要回表查询。

—-这部分是帮助理解 end,面试中可不背—-

如何正确使用联合索引?

使用联合索引最重要的一条是遵守最左前缀原则,也就是查询条件需要从索引的左侧字段开始。

—-这部分是帮助理解 start,面试中可不背—-

比如说我们创建了一个三列的联合索引。

1 | CREATE INDEX idx_name_age_sex ON user(name, age, sex); |

我们来看一下什么样的查询条件可以用到这个索引:

—-这部分是帮助理解 end,面试中可不背—-

如何进行分页优化?

分页优化的核心是避免深度偏移(Deep Offset)带来的全表扫描,可以通过两种方式来优化:延迟关联和添加书签。

延迟关联适用于需要从多个表中获取数据且主表行数较多的情况。

它首先从索引表中检索出需要的行 ID,然后再根据这些 ID 去关联其他的表获取详细信息。

1 | SELECT e.id, e.name, d.details |

延迟关联后,第一步只查主键,速度快,第二步只处理 20 条数据,效率高。

1 | SELECT e.id, e.name, d.details |

添加书签的方式是通过记住上一次查询返回的最后一行主键值,然后在下一次查询的时候从这个值开始,从而跳过偏移量计算,仅扫描目标数据,适合翻页、资讯流等场景。

假设需要对用户表进行分页。

1 | SELECT id, name |

通过添加书签来优化后,查询不再使用OFFSET,而是从上一页最后一个用户的 ID 开始查询。这种方法可以有效避免不必要的数据扫描,提高了分页查询的效率。

1 | SELECT id, name |

为什么分页会变慢?

分页查询的效率问题主要是由于 OFFSET 的存在,OFFSET 会导致 MySQL 必须扫描和跳过 offset + limit 条数据,这个过程是非常耗时的。

比如说,我们要查询第 100000 条数据,那么 MySQL 就必须扫描 100000 条数据,然后再返回 10 条数据。

1 | SELECT * FROM user ORDER BY id LIMIT 100000, 10; |

数据越多、偏移越大,就越慢!

JOIN 代替子查询有什么好处?

第一,JOIN 的 ON 条件能更直接地触发索引,而子查询可能因嵌套导致索引失效。

第二,JOIN 的一次连接操作替代了子查询的多次重复执行,尤其在大数据量的情况下性能差异明显。

—-这部分是帮助理解 start,面试中可不背—-

比如说我们有两个表 orders 和 customers。

1 | CREATE TABLE orders ( |

子查询的写法:

1 | SELECT o.order_id, o.amount, |

JOIN 的写法:

1 | SELECT o.order_id, o.amount, c.name AS customer_name |

对于子查询,执行流程是这样的:

- 外层 orders 表的每一行都会触发一次子查询。

- 如果 orders 表有 1000 条记录,则子查询会执行 1000 次。

- 每次子查询都需要单独查询 customers 表(即使 customer_id 相同)。

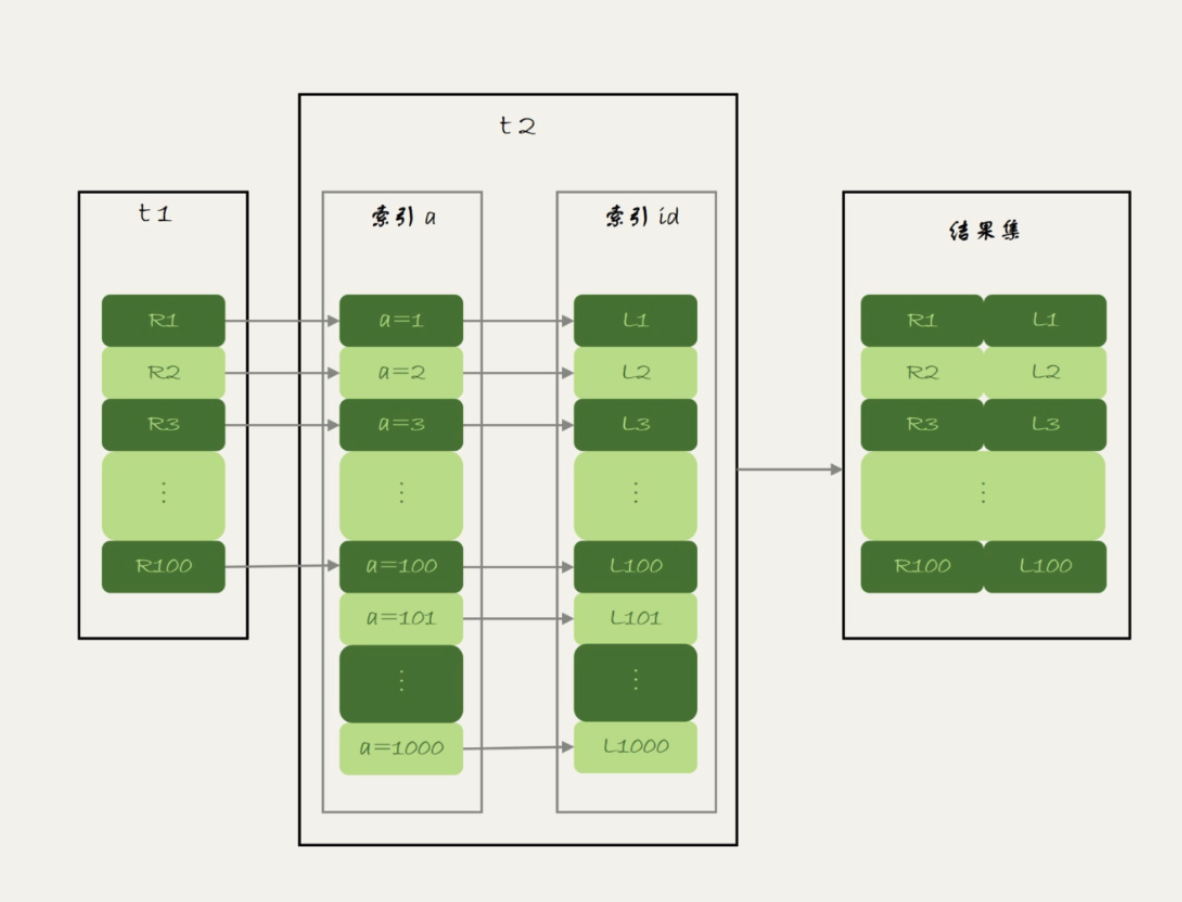

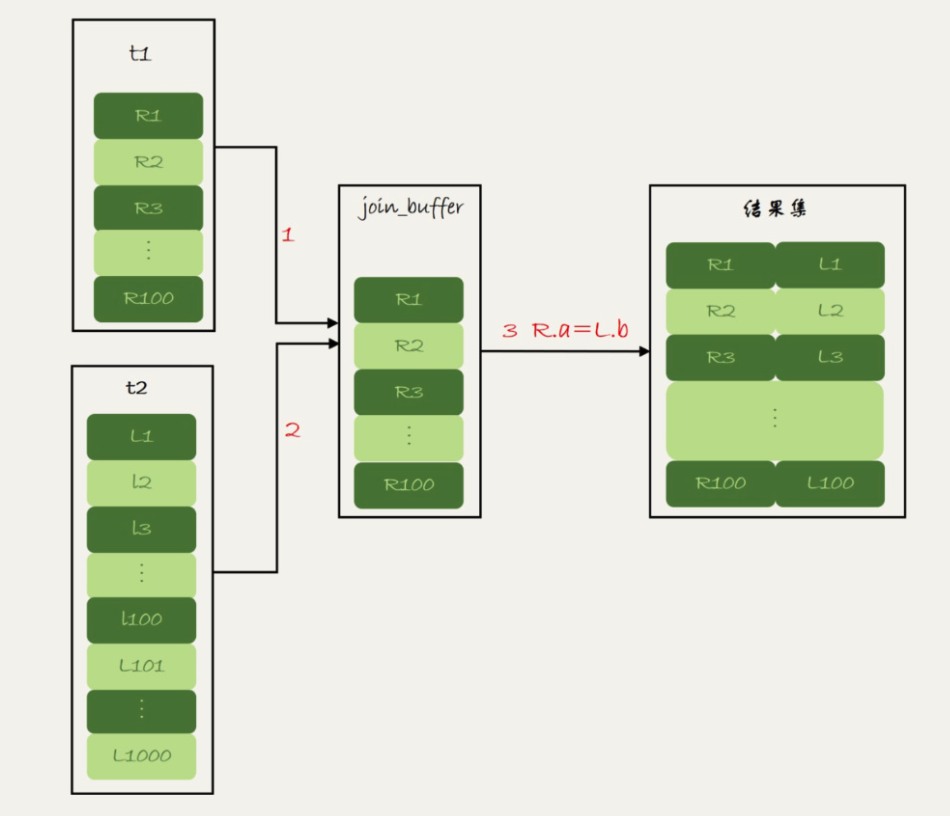

而 JOIN 的执行流程是这样的:

- 数据库优化器会将两张表的连接操作合并为一次执行。

- 通过索引(如 orders.customer_id 和 customers.customer_id)快速关联数据。

- 仅执行一次关联操作,而非多次子查询。

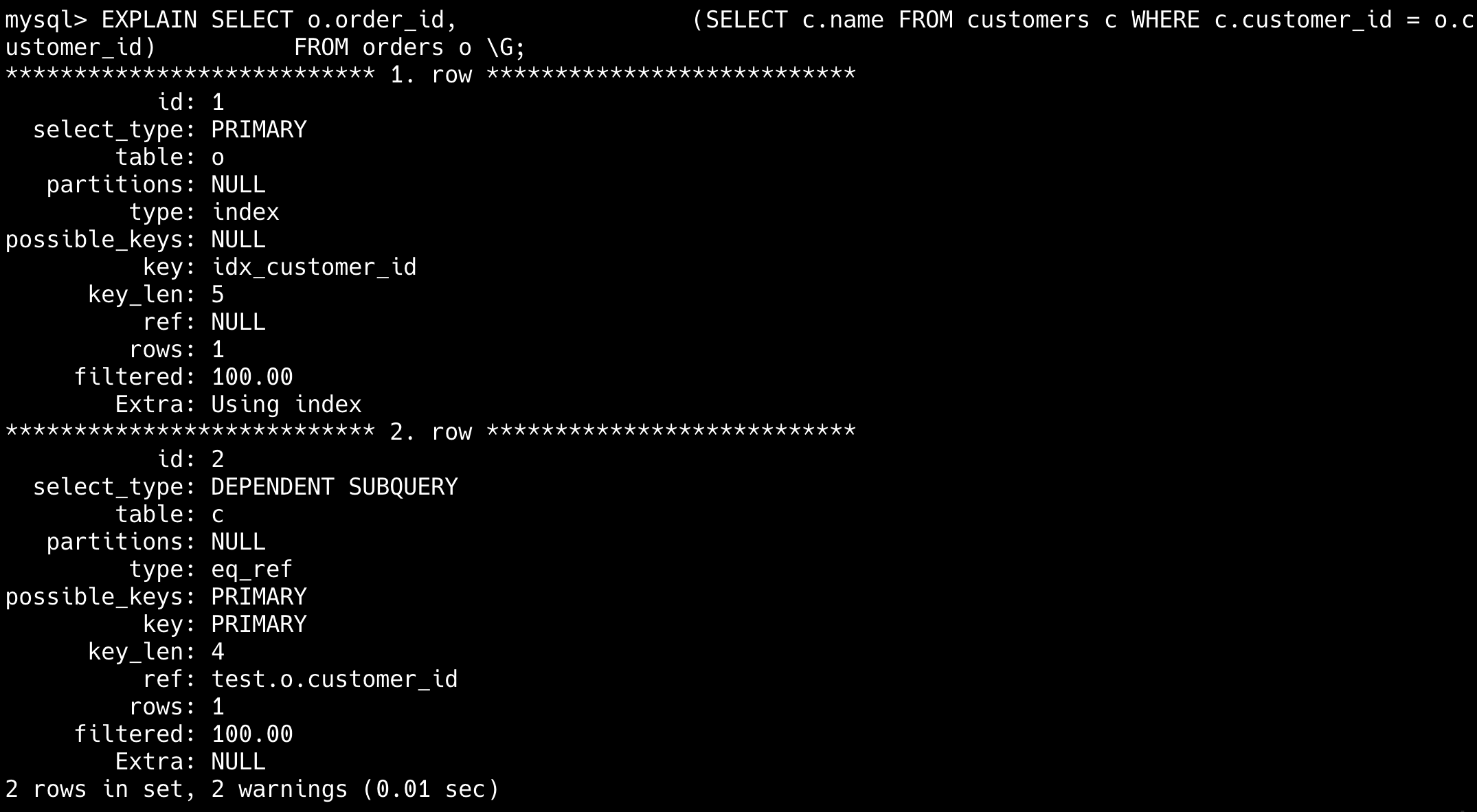

来看一下子查询的执行计划:1

2

3EXPLAIN SELECT o.order_id,